Погляд Anderson

Зменшення галюцинацій штучного інтелекту в зображеннях шляхом їх перебільшення

Моделі візуального сприйняття типу ChatGPT часто “галюцинують” елементи, які не належать до зображення. Новий метод зменшує ці помилки, показуючи моделі перебільшені версії її власних галюцинацій, заснованих на підписах – і потім просить її спробувати знову. Цей підхід не вимагає жодної додаткової підготовки чи даних і може бути застосований до широкого спектра моделей та типів моделей.

Нова публікація з Китаю пропонує цікавий погляд на проблему галюцинацій в штучному інтелекті, які є елементами, що явно не повинні бути в зображенні, заснованих на запиті користувача та вхідних даних.

У суті, система бере зображення і дозволяє моделі його описати, як зазвичай; вона потім перетворює цей підпис у нове зображення за допомогою моделі текст-до-зображення – і будь-які додаткові об’єкти чи деталі в цьому другому зображенні будуть прямими представленнями галюцинацій моделі. Потім, порівнюючи оригінальне та згенероване зображення, система поступово відводить модель від цих помилок наступного разу, коли вона спробує:

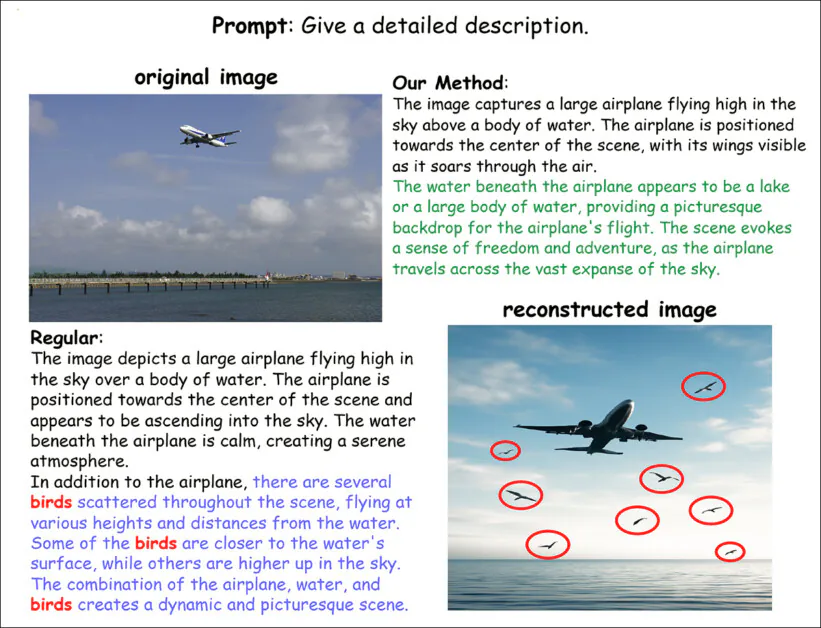

Ілюстрація того, як новий метод ідентифікує та зменшує галюцинації в підписах до зображень. Регулярна модель описує птахів, яких немає в оригінальному зображенні, що призводить до реконструйованого зображення, яке їх додає. Ці помилки позначені червоним. Натомість, запропонований метод уникає цих вигаданих деталей, зберігаючи підпис конкретним і плавним. Джерело: https://arxiv.org/pdf/2509.21997

Метод починається з показу моделі реальних зображень і дозволяє їй їх описати, включаючи деякі описи, які містять об’єкти чи деталі, які насправді відсутні. Ці галюциновані підписи потім використовуються для генерації синтетичних зображень, які роблять помилки легше помітити. Порівнюючи реальні та згенеровані зображення, система вчиться, які внутрішні моделі моделі tendуть виробляти вигаданий контент.

Як тільки ці помилкові моделі ідентифікуються, їх можна зберігати та використовувати пізніше. Коли моделі надається нове зображення, система буде коригувати свої внутрішні сигнали під час підпису, відводячи її від відомих моделей, які викликають галюцинації. Це працює в одному проході і не вимагає додаткових даних, повторної підготовки чи будь-якої нової генерації зображень під час тестування.

Заплутаний веб

У наведеному вище прикладі, з паперу, ми бачимо, що заплутування ймовірно відповідає за прикрасу ‘птахів’ до вхідного зображення, навіть якщо перше зображення здається без птахів.

Заплутування відбувається, коли модель наполягає на асоціації певних концепцій з певними іншими концепціями, просто тому, що дві (або більше) концепції tendють з’являтися часто разом в оригінальному розподілі даних, на якому була підготовлена модель. У цьому випадку модель могла бачити багато картинок літаків+птахів, що призвело до асоціації, яка не застосовується до конкретної картинки, але тим не менш впливає на отриманий підпис.

Хоча заплутування можна пом’якшити, зупинивши підготовку раніше (що, загалом, робить модель максимально гнучкою та адаптованою), це також зменшує деталі та роздільну здатність усіх підготовлених концепцій, залишаючи тренера моделі з постійною дилемою: створити модель, яка дуже гнучка та роз’єднана; або створити модель, яка більш потужно генерує, але також більш схильна до виробництва ‘асоційованих’ галюцинацій?

Якщо якість підпису та увага до деталей у кураторстві оригінальних даних для генеративної моделі були кращими ніж логістика зазвичай дозволяє, підписи для всіх джерельних зображень мали б містити кожен об’єкт у кожній картинці, так що підготовлена модель могла б виділити їм окремі та роз’єднані записи у своєму латентному просторі.

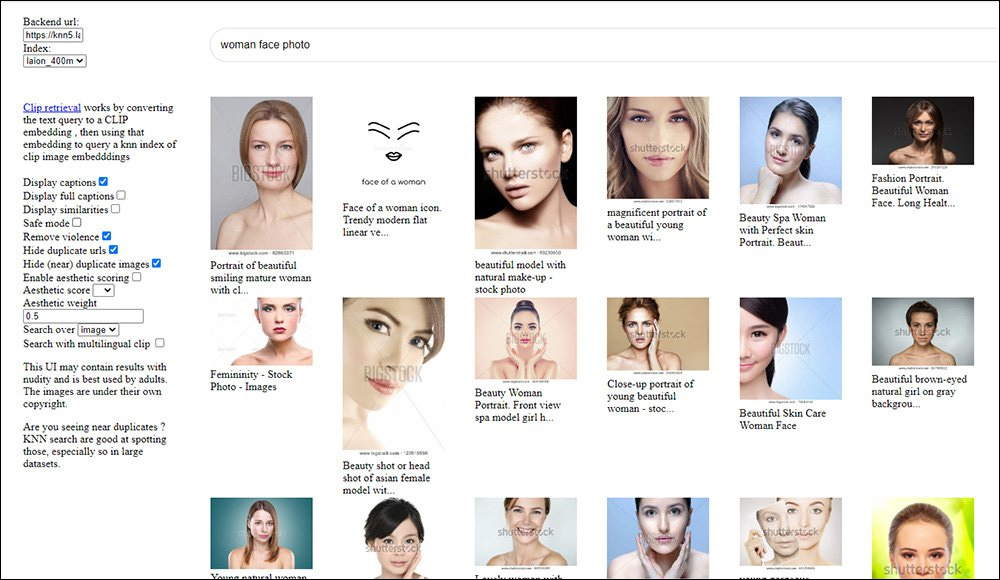

Як воно стоїть, така самопослугова практика SEO підпису, у поєднанні з тим фактом, що ад хок гіпермасштабне веб-скрейпінг залишається найкращим джерелом для підготовки真正 потужних генеративних моделей, означає, що підписи зображень tendують значно відставати від цього стандарту:

Ілюстрація того, як слабкі підписи обмежують корисність зображень LAION для підготовки моделей типу Stable Diffusion. Багато текстових міток є мілкими, нечіткими або оптимізованими для SEO, а не точного опису, що робить важче для моделі вивчити тонкі візуальні концепції, такі як риси обличчя. (Оригінальне джерело було https://rom1504.github.io/, тепер не існує).

Отже, оскільки фундаментальне рішення малоймовірно коли-небудь буде практичним, зменшення галюцинацій LLM/VLM шляхом обходів та компромісів тепер стало сильною гілкою літератури.

Нова китайська техніка, представлена цього тижня, автори заявляють, була протестована на різних архітектурах у різних умовах, і могла б вказати на корисний спосіб зменшення ‘галюцинаційної забруднення’.

Вони кажуть:

‘Розширені експерименти на декількох бенчмарках показують, що наш метод суттєво зменшує галюцинації на рівні об’єктів, атрибутів та відносин, зберігаючи при цьому відгуки та багаті підписи.’

‘Новий папір’

називається Виставлення галюцинацій для їх придушення: редагування представлення VLM з генеративними якорями, і походять від трьох дослідників Університету науки та технологій Китаю та Нанкінського університету.

Метод

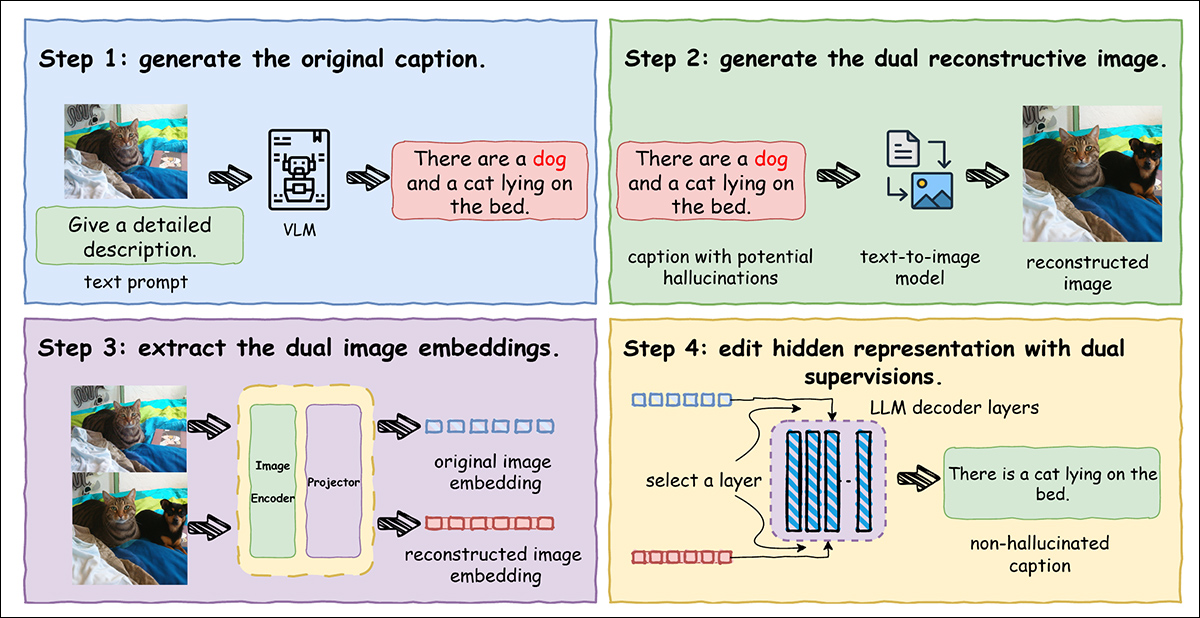

Автори розробили кінцевий пайплайн, показаний нижче, призначений для виставлення та придушення галюцинацій у підписах зображень:

Ілюстрація повного пайплайну. Модель візуального сприйняття спочатку генерує підпис з вхідного зображення, який може містити галюцинований контент. Цей підпис потім використовується для генерації реконструйованого зображення за допомогою моделі текст-до-зображення, роблячи будь-які галюцинації легше помітити. Вбудовування з обох оригінальних та реконструйованих зображень витягуються та використовуються для керування коригуваннями всередині декодера, допомагаючи моделі пригнічувати галюциновані деталі, зберігаючи при цьому якість підпису.

Починаючи з реального вхідного зображення, модель візуального сприйняття генерує описовий підпис, який може містити вигадані об’єкти чи відносини. Цей підпис потім подається до генератора текст-до-зображення для створення реконструйованого зображення, яке точно показує, що описує підпис. Порівнюючи це реконструйоване зображення з оригінальним, робить фабрикований контент очевидним та вимірюваним, перетворюючи тонкі помилки у текст на видимі відмінності, які система може націлитися та зменшити.

Для керування моделлю від ‘винаходу’ деталей система порівнює дві версії одного й того ж зображення: оригінальне та реконструйоване на основі підпису. Кожне зображення перетворюється у компактне вбудовування, яке захоплює його зміст.

Оригінальне зображення діє як надійна посилання, тоді як реконструйоване зображення підкреслює, де галюцинації можуть проникнути. Коригуючи свої внутрішні представлення, щоб рухатися ближче до оригінального та далі від реконструйованого, модель вчиться виправляти себе автоматично. Оскільки цей процес не залежить від ручних налаштувань чи зовнішніх даних, він залишається повністю самонавчанням.

Папір заявляє:

‘Галюцинації в MLLM є внутрішньо важкими для виявлення, оскільки вони лінгвістично добре сформовані та часто нерозрізнімі від вірних описів на рівні тексту. Розбіжність лежить не у мовній правдоподібності, а у невідповідності з візуальними доказами, до яких модель сама зазвичай нечутлива.

‘Для цього ми вводимо механізм виставлення галюцинацій, який використовує генеративну реконструкцію для перетворення неявних несумісностей у явні та спостережувані сигнали.’

Отримавши вхідне зображення та його підпис, система використовує FLUX.1-dev модель текст-до-зображення для реконструкції зображення з підпису самостійно. Це реконструйоване зображення tendує перебільшувати значення підпису, роблячи будь-які помилкові деталі більш очевидними. Ці посилені помилки потім служать корисними сигналами, які допомагають моделі розпізнавати та виправляти свої власні помилки.

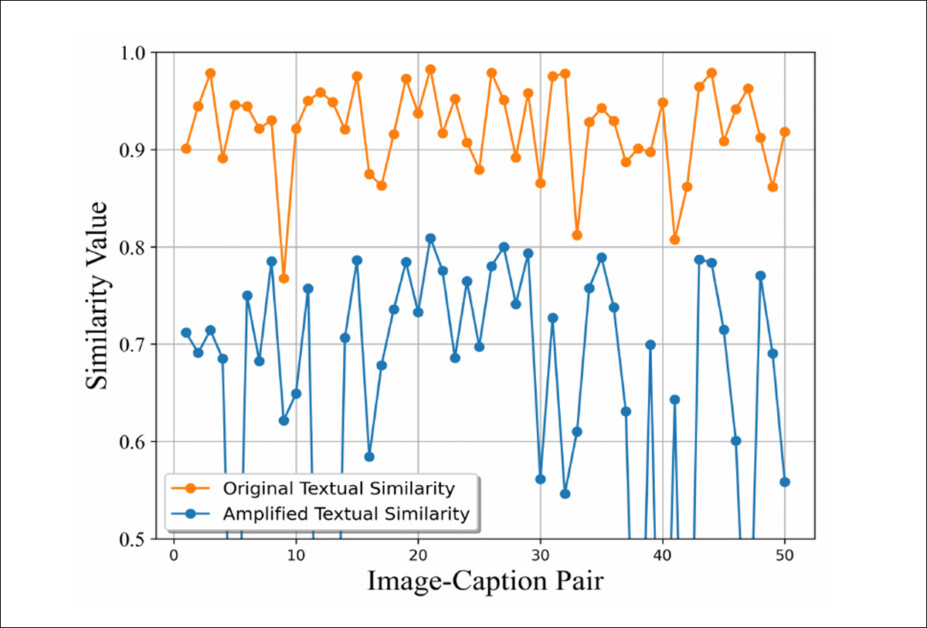

Для тестування свого підходу автори ввели галюцинації у підписи та використали модель текст-до-зображення для генерації реконструйованих зображень. Ці зображення потім були підписані LLaVA, та семантична схожість між оригінальними та галюцинованими підписами була оцінена:

Ілюстрація того, як механізм посилення галюцинацій робить тонкі помилки видимими. Кожна точка показує схожість між підписами оригінальних та реконструйованих зображень для однієї пари зображення-підпис. Помаранчева лінія представляє схожість, виміряну безпосередньо між оригінальними та галюцинованими підписами, яка залишається високою та маскує маленькі помилки; синя лінія представляє схожість після реконструкції, яка різко падає, показуючи, що процес перетворює приховані галюцинації у явні семантичні маркери, які можна виявити та виправити.

Схожість падає різко після реконструкції, показуючи, що процес робить тонкі помилки більш виявними.

Дані та тести

Валідування ефективності нового методу передбачало використання трьох відповідних бенчмарків: Оцінка галюцинацій підписів з урахуванням актуальності зображення (CHAIR); Оцінка MLLM бенчмарк (MME); та Оцінка на основі пулізації об’єктів (POPE).

З паперу CHAIR: приклади галюцинованих об’єктів, згенерованих двома провідними системами підписування, TopDown та NBT, де кожна модель вигадує візуальні елементи, яких немає в зображенні, такі як ноутбуки, раковини або серфдошки. Джерело: https://arxiv.org/pdf/1809.02156

Стандартні метрики, такі як коефіцієнт галюцинацій або відгуки, можуть бути оманливими, оскільки модель може уникнути галюцинацій просто генеруючи короткі чи нечіткі підписи. Для обліку компромісу між відгуками та галюцинаціями був використаний комбінований метрик під назвою Галюцинації та Відгуки (HAR@β), який оцінює підписи на основі точності та повноти, та дозволяє регулювати баланс залежно від того, чи уникнення помилок чи включення більшої кількості деталей є більш важливим.

POPE був використаний для оцінки контекстно-чутливих галюцинацій об’єктів, а MME для оцінки галюцинацій на рівні атрибутів, з обома представленими як завдання з судження типу “Так чи Ні”.

Експерименти проводилися на різних представницьких наборах даних, використовуючи вищезгадану модель Flux та варіант LLaVA-v1.5-7B. Набори даних, які були використані, були Microsoft COCO; A-OKVQA; та GQA.

Латентне редагування проводилось для другого шару моделі, відповідно до попередньої суміжної роботи, тоді як гіперпараметри та температура були послідовними для всіх моделей.

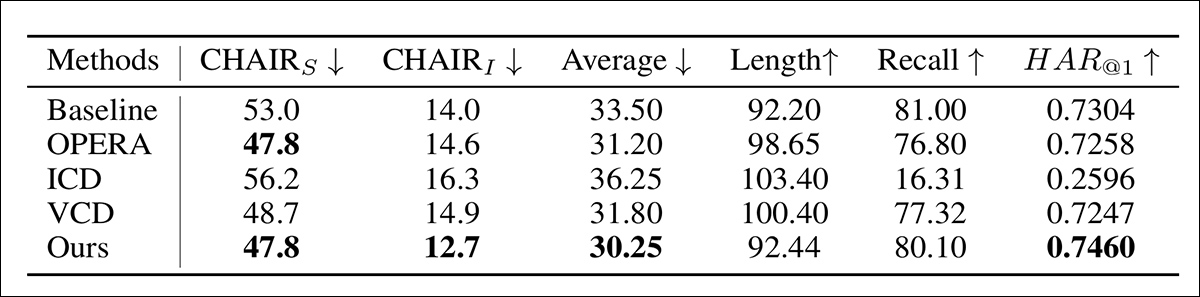

Початкові результати на CHAIR представлені нижче*:

Виступ на бенчмарку CHAIR для мінімізації галюцинацій, оціненої за допомогою декількох метрик.

З цих результатів автори коментують:

‘[Наш метод послідовно перевершує інші базові лінії як на CHAIRS, так і на CHAIRI , демонструючи свою вищу ефективність у пригніченні галюцинацій. Тим часом, хоча майже всі методи неминуче зменшують відгуки під час пригнічення галюцинацій, відображаючи компроміс між вірністю та інформативністю, наш підхід досягає найменшего падіння.

‘Це демонструє, що наш метод захоплює широкий спектр фактичних об’єктів. З метрикою HAR@β наш метод досягає найвищого балу, підкреслюючи свою здатність зменшувати галюцинації, зберігаючи при цьому охоплення.’

Дослідники приписують ці сильні результати подвійній системі нагляду, де чиста семантика з оригінального зображення була посилена, одночасно з тим як оманливі сигнали з реконструйованого зображення були пригнічені. Оскільки коригування було націлено тільки на напрям, пов’язаний з галюцинаціями, решта представлення залишилася цілою, дозволяючи системі виправляти помилки без жертвування деталями чи інформативністю.

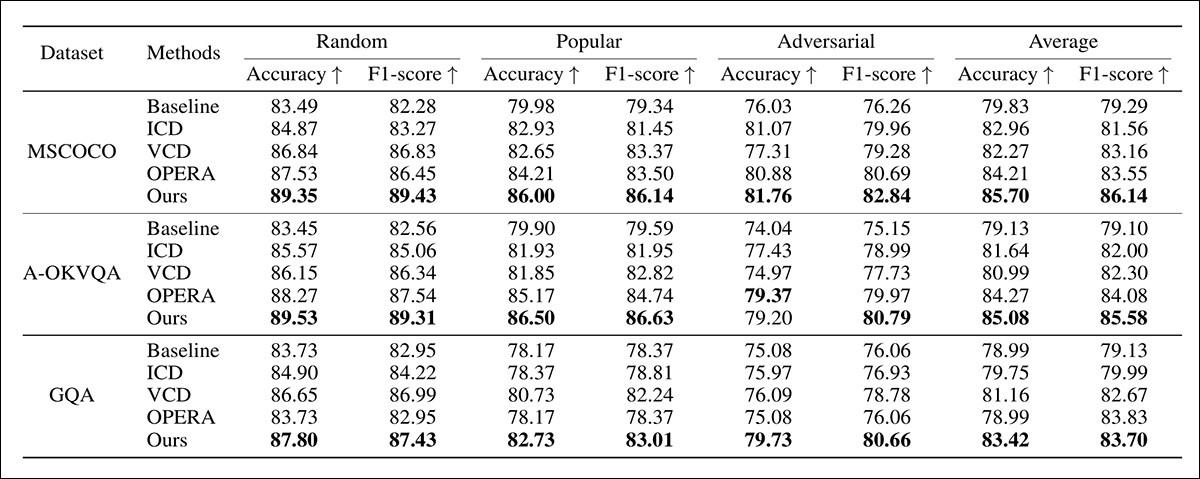

Порівняння результатів на бенчмарку POPE під різними конфігураціями та наборами даних.

Щодо результатів на POPE, показаних у таблиці вище, папір стверджує:

‘CanBe видно, що наш метод послідовно досягає найкращої продуктивності у всіх налаштуваннях. Зокрема, наш метод може досягти до +5,95% точності та +6,85% балу F1 у середньому, перевершуючи інші підходи без підготовки на великий розрив.

‘Отже, ці результати демонструють, що наш метод пропонує надійне та загальне рішення на різних рівнях складності.’

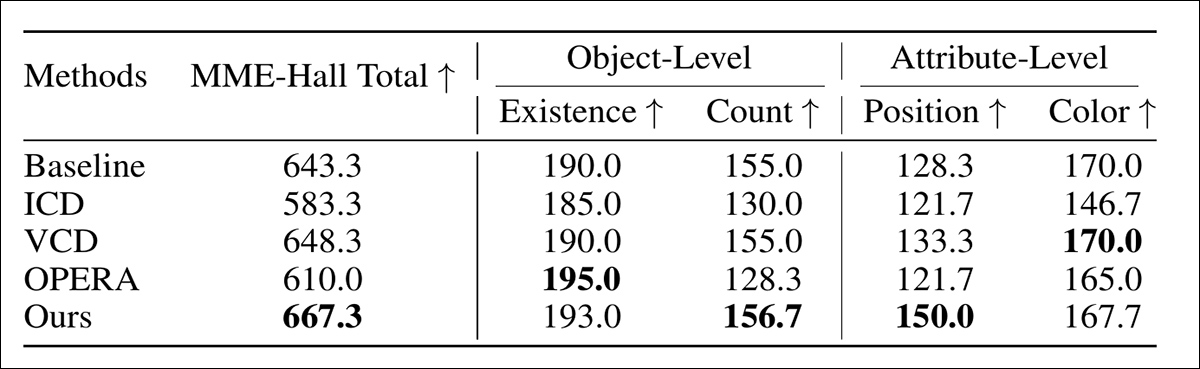

З третього раунду тестування, порівняння результатів над MME.

Останній основний тест був проведений на MME, з результатами, показаними вище. Однак серед інших пропусків, він згадує метод ‘OPERA’, який не визначений ніде в основному папері чи додатку. Хоча автори заявляють про сильну продуктивність на MME, без адекватних визначень методів, ми повинні, можливо, залишити розділ результатів на цьому етапі.

Ілюстрація з бенчмарку MME, що використовує LLaVA-v1.5-7B, показуючи, як базова модель генерує галюциновану відповідь, тоді як запропонований метод дав правильну відповідь, з реконструйованим зображенням, яке робить галюцинацію більш очевидною.

Висновок

Хоча цей папір явно поспішний, і страждає від відсутності структури, фокусу та ясності, які все частіше з’являються в літературі за останні 12 місяців (можливо, не пов’язано з швидко зростаючим використанням штучного інтелекту в академічних дослідженнях), центральний механізм, представлений тут, залишається винахідливим.

Хоча цей кінцевий підхід не вимагає повторної підготовки, і здається застосовним до широкого спектру архітектур, було б корисно побачити більше кандидатів на тестування; і також потрібно враховувати, що система такого типу принаймні введе затримку, і деяку міру додаткових вимог до потужності – не мала проблема у масштабі.

* Неортодоксально, основна частина цього паперу представляє результати з заголовками, які пояснюються лише в матеріалі додатка, а не в основному папері – все частіше побачене погане звичай у літературі, оскільки дослідники намагаються обмежити центральну тезу 8-9 сторінками, навіть коли матеріал не дозволяє цього. В будь-якому випадку, бенчмарк CHAIR, використаний для оцінки галюцинацій об’єктів у підписах, був заснований на підмножині з 500 зображень MSCOCO з попередньої роботи. Дві форми були використані: CHAIRs, що вимірює, як часто галюцинації з’являються в будь-якому підписі; і CHAIRI, що вимірює, скільки з згаданих об’єктів були галюциновані. HAR@β , представлений у основному папері, був визначений як Fβ-стильна комбінація пригнічення галюцинацій та відгуків об’єктів.

Перше опубліковане вівторок, 30 вересня 2025