Погляд Anderson

Надання мовним моделям ‘дайла істини’

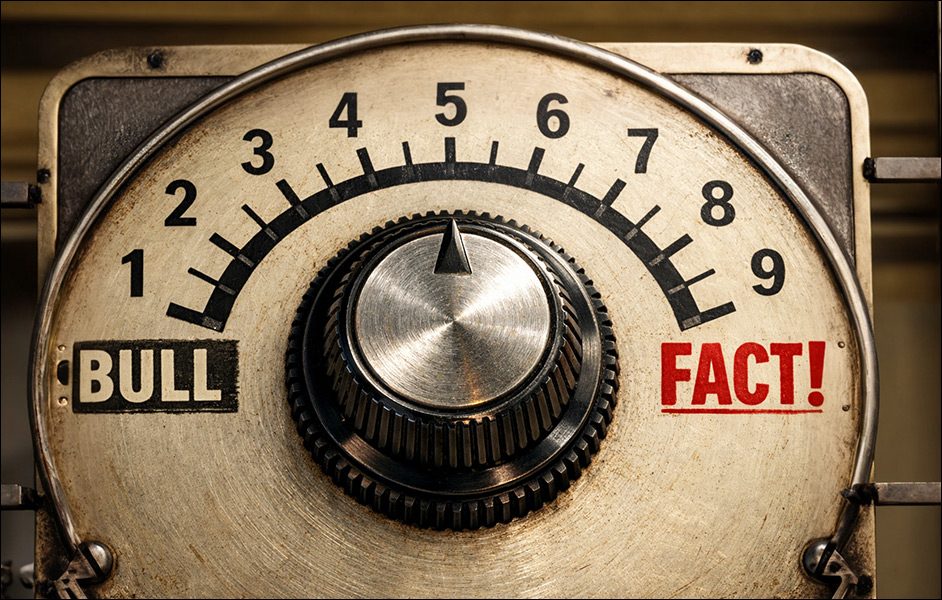

Правдиво чи балакучо: виберіть одне. Новий метод навчання дозволяє користувачам вказувати ІІ-чатботам, наскільки вони повинні бути ‘фактичними’, перетворюючи точність на дайл, який можна повернути вгору або вниз.

Нове дослідження спільної роботи між США та Китаєм пропонує те, що майже всі користувачі ІІ-чатботів оцінять: віртуальний ‘кнопку’, яка вказує ботові, чи повинен він бути ‘балакучим’ чи ‘правдивим’.

Система була створена шляхом доопрацювання моделі Mistral-7B на синтетичних даних, щоб схема для ‘істини’ могла бути надрукована на моделі. Після цієї ревізії модель Mistral能够 контролювати кількість фактів у відповіді; чим вище ‘істинне’ значення, задане користувачем, тим менше – але впевненіше – буде коротша відповідь.

При нижчих налаштуваннях відповідь чатбота стає тим, що автори статті називають ‘інформаційною’, тобто вона дає довшу відповідь і містить більше фактів; але деякі з цих фактів можуть бути галюцинованими.

Синтетичні дані, на яких була навчена система, використовували Вікіпедію як посилання для тестового домену: реальні біографічні факти про людей. Чи вважаєте ви, що Вікіпедія повинна бути авторитетним джерелом, значення роботи полягає в розробці будь-якої системи, яка може обмежити вбудовану схильність LLM до надання відповідей, навіть коли немає відповідей для надання.

… (переклад продовжується згідно з оригінальним текстом)