Погляд Anderson

До повного контролю в генерації відео штучним інтелектом

Моделі відео-фундаменту, такі як Hunyuan і Wan 2.1, хоча й потужні, не пропонують користувачам такого ж рівня детального контролю, який вимагається у виробництві фільмів і телебачення (особливо у виробництві візуальних ефектів).

У професійних студіях візуальних ефектів відкриті моделі, такі як ці, разом з раніше розробленими моделями, заснованими на зображеннях (а не на відео), такими як Stable Diffusion, Kandinsky і Flux, зазвичай використовуються разом з рядом допоміжних інструментів, які адаптують їхню сиру вихідну інформацію для задоволення конкретних творчих потреб. Коли режисер говорить: “Це виглядає добре, але чи можна зробити це трохи більше [n]?” ви не можете відповісти, сказавши, що модель не достатньо точна, щоб обробляти такі запити.

Натомість команда AI VFX використовуватиме ряд традиційних CGI і композиційних технік, у поєднанні з власними процедурами і робочими процесами, розробленими за час, щоб спробувати розширити межі синтезу відео трохи далі.

Отже, за аналогією, модель відео-фундаменту є подібною до стандартної установки веб-браузера, такого як Chrome; вона робить багато з коробки, але якщо ви хочете, щоб вона адаптувалася до ваших потреб, а не навпаки, вам потрібно деякі плагіни.

Контрольні фріки

У світі синтезу зображень на основі дифузії найважливішою такою третьою системою є ControlNet.

ControlNet – це техніка додавання структурованого контролю до генеративних моделей, заснованих на дифузії, що дозволяє користувачам керувати генерацією зображень або відео за допомогою додаткових входів, таких як карти країв, карти глибини або інформація про позу.

Різні методи ControlNet дозволяють створювати зображення за глибиною (верхній ряд), сегментацію за зображенням (нижній лівий) і керування позою генерації зображень людей і тварин (нижній лівий).

Натомість ніж покладатися виключно на текстові запити, ControlNet вводить окремі гілки нейронної мережі, або адаптери, які обробляють ці умовні сигнали, зберігаючи при цьому генеративні можливості базової моделі.

Це дозволяє створювати тонко налаштовані виходи, які більш точно відповідають специфікаціям користувача, що робить його особливо корисним у застосуваннях, де потрібний точний композиційний, структурний або руховий контроль:

З керуючою позою можна отримати різноманітні точні типи виходу за допомогою ControlNet. Джерело: https://arxiv.org/pdf/2302.05543

Однак рамки адаптерів такого типу працюють зовні на наборі нейронних процесів, які дуже внутрішньоорієнтовані. Ці підходи мають кілька недоліків.

По-перше, адаптери тренуються незалежно, що призводить до конфліктів гілок при комбінації декількох адаптерів, що може призвести до погіршення якості генерації.

По-друге, вони вводять редундантність параметрів, що вимагає додаткових обчислень і пам’яті для кожного адаптера, що робить масштабування неефективним.

По-третє, незважаючи на свою гнучкість, адаптери часто дають підоптимальні результати порівняно з моделями, які повністю налаштовуються для генерації з декількома умовами. Ці питання роблять методи на основі адаптерів менш ефективними для завдань, які вимагають безшовної інтеграції декількох сигналів контролю.

Ідеально було б, якщо можливості ControlNet були б треновані рідно в моделі, у модульному вигляді, який міг би адаптуватися до пізніх і очевидних інновацій, таких як одночасна генерація відео/аудіо або вбудовані можливості синхронізації губ (для зовнішнього аудіо).

Як це стоїть, кожна додаткова функціональність представляє або задачу постпродакшну, або ненативну процедуру, яка повинна орієнтуватися в тісно пов’язаних і чутливих вагах будь-якої моделі-фундаменту, на якій вона працює.

FullDiT

У цю патову ситуацію вступає нова пропозиція з Китаю, яка передбачає систему, в якій заходи типу ControlNet кодуються безпосередньо в генеративну модель відео під час тренування, а не відкладаються на післяthought.

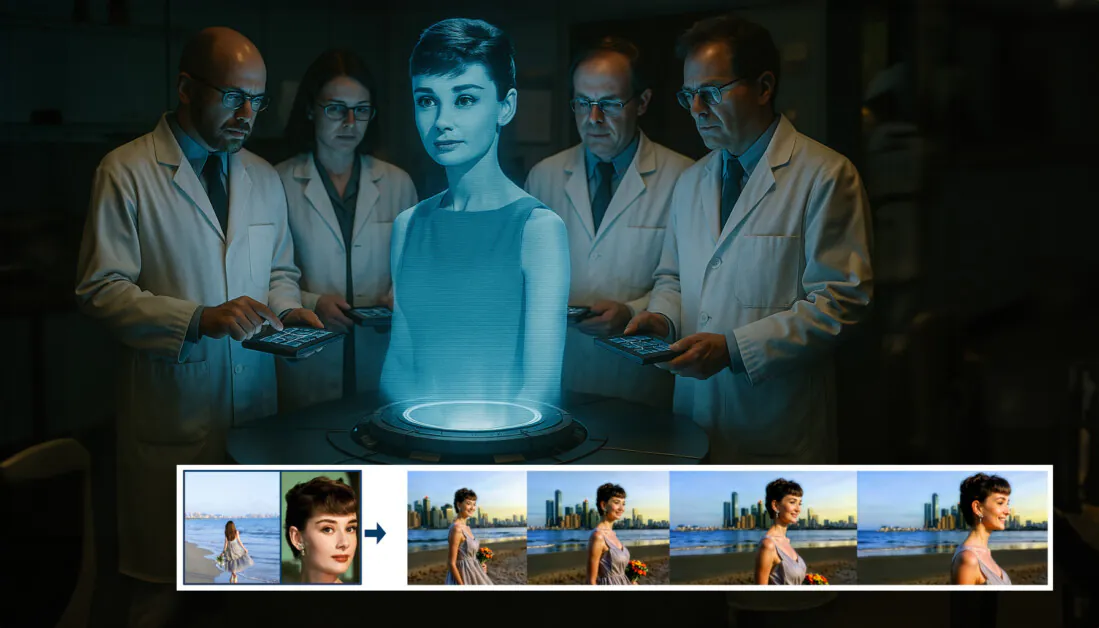

З нової статті: підхід FullDiT може включати імпозицію ідентичності, глибину та рух камери в рідну генерацію і може викликати будь-яку комбінацію цих одночасно. Джерело: https://arxiv.org/pdf/2503.19907

Названа FullDiT, новий підхід зливає багатоманітні умови, такі як перехід ідентичності, картографія глибини та рух камери, в інтегровану частину тренованої генеративної моделі відео, для якої автори створили прототип тренованої моделі та супроводжуючі відеокліпи на сайті проекту.

У наведеному нижче прикладі ми бачимо генерації, які включають рух камери, інформацію про ідентичність і текстову інформацію (тобто керуючі текстові запити користувача):

Натисніть, щоб відтворити. Приклади імпозиції користувача типу ControlNet з використанням лише рідної тренованої моделі-фундаменту. Джерело: https://fulldit.github.io/

Зазначається, що автори не пропонують свою експериментальну треновану модель як функціональну модель-фундамент, а радше як доказ концепції для рідних текст-відео (T2V) і зображення-відео (I2V) моделей, які пропонують користувачам більше контролю, ніж просто зображення-запит або текстовий запит.

Оскільки подібних моделей ще немає, дослідники створили новий бенчмарк під назвою FullBench, для оцінки багатоманітних відео, і заявили про досягнення найкращих результатів у порівнянні з попередніми підходами. Однак, оскільки FullBench був розроблений самими авторами, його об’єктивність не перевірена, а набір даних з 1 400 випадків може бути занадто обмеженим для більш широких висновків.

Можливо, найцікавішим аспектом архітектури, яку пропонує стаття, є її потенціал включення нових типів контролю. Автори заявляють:

‘У цій роботі ми досліджуємо лише контрольні умови камери, ідентичності та глибини. Ми не досліджували інші умови та модальності, такі як аудіо, мовлення, хмарні точки, обмежувальні рамки об’єктів, оптичний потік тощо. Хоча дизайн FullDiT може безшовно інтегрувати інші модальності з мінімальними змінами архітектури, питання про те, як швидко і ефективно адаптувати існуючі моделі до нових умов і модальностей, залишається важливим питанням, яке вимагає подальшого дослідження.’

Як це стоїть, кожна додаткова функціональність представляє або задачу постпродакшну, або ненативну процедуру, яка повинна орієнтуватися в тісно пов’язаних і чутливих вагах будь-якої моделі-фундаменту, на якій вона працює.

Метод

Автори стверджують, що єдиний механізм уваги FullDiT дозволяє сильніше навчання представлення між модальностями шляхом захоплення як просторових, так і тимчасових відносин між умовами:

З нової статті: FullDiT інтегрує декілька умов через повну самоуправління, перетворюючи їх у єдину послідовність. На відміну від цього, моделі на основі адаптерів (ліворуч) використовують окремі модулі для кожного входу, що призводить до надмірності, конфліктів і слабшої продуктивності.

На відміну від моделей на основі адаптерів, які обробляють кожен потік входів окремо, ця спільна структура уваги уникає конфліктів гілок і знижує надмірність параметрів. Вони також стверджують, що архітектура може бути масштабована до нових типів входів без суттєвої перебудови – і що схема моделі показує ознаки узагальнення до комбінацій умов, яких не бачила під час тренування, таких як зв’язування руху камери з ідентичністю персонажа.

Натисніть, щоб відтворити. Приклади генерації ідентичності з сайту проекту.

У архітектурі FullDiT усі умовні входи – такі як текст, рух камери, ідентичність і глибина – спочатку перетворюються у єдиний уніфікований формат токенів. Ці токени потім конкатенуються в єдину довгу послідовність, яку обробляє стек трансформерних шарів за допомогою повної самоуправління. Цей підхід слідує попереднім роботам, таким як Open-Sora Plan і Movie Gen.

Цей дизайн дозволяє моделі навчатися тимчасовим і просторовим відносинам спільно через усі умови. Кожний трансформерний блок працює над цілою послідовністю, дозволяючи динамічні взаємодії між модальностями без залежності від окремих модулів для кожного входу – і, як ми вже зазначали, архітектура розроблена як розширення, що робить її набагато легше включення додаткових сигналів контролю в майбутньому, без суттєвих структурних змін.

Сила трьох

FullDiT перетворює кожний сигнал контролю в стандартизований формат токенів, щоб усі умови могли бути оброблені разом у єдиному механізмі уваги. Для руху камери модель кодує послідовність зовнішніх параметрів – таких як позиція і орієнтація – для кожного кадру. Ці параметри відмічені часом і проєктовані в вектори вкладення, які відображають тимчасову природу сигналу.

Інформація про ідентичність обробляється інакше, оскільки вона є внутрішньо просторовою, а не тимчасовою. Модель використовує карти ідентичності, які вказують, які персонажі присутні в яких частинах кожного кадру. Ці карти діляться на патчі, з кожним патчем, проєктованим у вектор вкладення, який захоплює просторові сигнали ідентичності, дозволяючи моделі асоціювати конкретні регіони кадру з конкретними сутностями.

Глибина є просторово-тимчасовим сигналом, і модель обробляє її, ділячи відео глибини на 3D-патчі, які охоплюють як простір, так і час. Ці патчі потім вкладені таким чином, щоб зберегти їхню структуру через кадри.

Як тільки вони вкладені, усі ці токени умов (камера, ідентичність і глибина) конкатенуються в єдину довгу послідовність, дозволяючи FullDiT обробляти їх разом за допомогою повної самоуправління. Ця спільна репрезентація дозволяє моделі навчатися взаємодіям між модальностями і через час без залежності від ізольованих потоків обробки.

Дані та тести

Підхід до тренування FullDiT залежав від вибірково анотованих наборів даних, адаптованих до кожного типу умов, а не вимагав наявності всіх умов одночасно.

Для текстових умов ініціатива слідує структурованому підходу до анотації, викладеному в проекті MiraData.

Відеозбір і потік анотації з проекту MiraData. Джерело: https://arxiv.org/pdf/2407.06358

Для руху камери основним джерелом даних був набір даних RealEstate10K через його високоякісні анотації параметрів камери.

Однак автори спостерігали, що тренування виключно на стаціонарних наборах даних камер, таких як RealEstate10K, схильне до зниження динамічних об’єктів і руху людей у згенерованих відео. Щоб протидіяти цьому, вони провели додаткове тонке налаштування за допомогою внутрішніх наборів даних, які включали більш динамічні рухи камери.

Анотації ідентичності генерувалися за допомогою потоку, розробленого для проекту ConceptMaster, який дозволяв ефективне фільтрування і витягування тонких сигналів ідентичності.

Фреймворк ConceptMaster розроблений для вирішення проблем декуплінгу ідентичності, зберігаючи при цьому вірність концепції в налаштованих відео. Джерело: https://arxiv.org/pdf/2501.04698

Анотації глибини отримувалися з набору даних Panda-70M за допомогою Depth Anything.

Оптимізація через порядку даних

Автори також реалізували прогресивний графік тренування, вводячи більш складні умови раніше в тренуванні, щоб забезпечити те, що модель здобула сильні репрезентації до того, як простіші завдання були додані. Порядок тренування проходив від тексту до камери умов, потім ідентичностей, і нарешті глибини, з легшими завданнями, які зазвичай вводилися пізніше і з меншою кількістю прикладів.

Автори підкреслюють значення порядку завдання так:

‘Під час фази попереднього тренування ми відзначили, що більш складні завдання вимагають тривалого часу тренування і повинні бути введені раніше в процесі навчання. Ці складні завдання включають складні розподіли даних, які суттєво відрізняються від вихідного відео, що вимагає від моделі мати достатню ємність, щоб точно захопити і репрезентувати їх.

‘Натомість введення легких завдань занадто рано може привести до того, що модель буде віддавати перевагу навчанню їм перш за все, оскільки вони забезпечують більш негайний зворотній зв’язок оптимізації, що перешкоджає збіганню більш складних завдань.’

Ілюстрація порядку тренування даних, прийнятого дослідниками, з червоним кольором, який вказує на більший обсяг даних.

Після початкового попереднього тренування остаточна фаза тонкого налаштування далі уточнила модель, щоб покращити візуальну якість і рухові динаміки. Після цього тренування слідувало стандартному тренуванню кадрів дифузійної моделі*: шум додавався до відео-латентів, і модель навчалася передбачати і видаляти його, використовуючи вкладені токени умов як керівництво.

Щоб ефективно оцінити FullDiT і забезпечити справедливе порівняння з існуючими методами, і в відсутності будь-якого іншого відповідного бенчмарку, автори ввели FullBench, кураторський бенчмарк-сюїт, що складається з 1 400 окремих тестових випадків.

Інстанс огляду даних для нового бенчмарку FullBench. Джерело: https://huggingface.co/datasets/KwaiVGI/FullBench

Кожна точка даних забезпечувала анотації для різних сигналів контролю, включаючи рух камери, ідентичність і глибину.

Метрики

Автори оцінювали FullDiT за допомогою десяти метрик, які охоплювали п’ять основних аспектів продуктивності: вирівнювання тексту, контроль камери, схожість ідентичності, точність глибини і загальна якість відео.

Вирівнювання тексту вимірювалося за допомогою CLIP подібності, тоді як контроль камери оцінювався за допомогою помилки обертання (RotErr), помилки трансляції (TransErr) і консистентності руху камери (CamMC), слідуючи підходу CamI2V (в проекті CameraCtrl).

Схожість ідентичності оцінювалася за допомогою DINO-I і CLIP-I, а точність контролю глибини кількісно оцінювалася за допомогою Середньої абсолютної похибки (MAE).

Якість відео оцінювалася трьома метриками з MiraData: подібністю кадрів CLIP для гладкості; відстанню руху на основі оптичного потоку для динаміки; і балами LAION-Aesthetic для візуальної привабливості.

Тренування

Автори тренували FullDiT за допомогою внутрішньої (не опублікованої) текст-відео дифузійної моделі, що містить близько одного мільярда параметрів. Вони свідомо обрали скромний розмір параметрів, щоб зберегти справедливість порівнянь з попередніми методами і забезпечити репродуктивність.

Оскільки тренувальні відео відрізнялися за тривалістю і роздільною здатністю, автори стандартизували кожну партію шляхом зміни розміру і доповнення відео до загальної роздільної здатності, вибірково вибравши 77 кадрів за послідовність і використовуючи застосовану увагу і маски втрат, щоб оптимізувати ефективність тренування.

Оптимізатор Adam використовувався з швидкістю навчання 1×10−5 по кластеру з 64 графічних процесорів NVIDIA H800, для загальної суми 5 120 ГБ відеопам’яті (врахуйте, що в ентузіастських синтезних спільнотах 24 ГБ на RTX 3090 все ще вважається розкішним стандартом).

Модель була тренована протягом близько 32 000 кроків, включаючи до трьох ідентичностей на відео, разом з 20 кадрами умов камери і 21 кадром умов глибини, обидва з яких рівномірно вибрані з загальних 77 кадрів.

Для інференсу модель генерувала відео з роздільною здатністю 384×672 пікселів (приблизно п’ять секунд при 15 кадрах за секунду) з 50 кроками інференсу дифузії і шкалою безкласифікаторного керівництва у п’ять.

Попередні методи

Для оцінки камери-відео автори порівняли FullDiT з MotionCtrl, CameraCtrl і CamI2V, з усіма моделями, тренованими за допомогою набору даних RealEstate10k, щоб забезпечити послідовність і справедливість.

У генерації, умовній на ідентичності, оскільки не було доступних порівняних відкритих моделей з декількома ідентичностями, модель була протестована проти 1-мільярдної моделі ConceptMaster, використовуючи相同ні тренувальні дані і архітектуру.

Для завдань глибини-відео порівняння проводилися з Ctrl-Adapter і ControlVideo.

Кількісні результати генерації відео для одного завдання. FullDiT був порівняний з MotionCtrl, CameraCtrl і CamI2V для генерації камери-відео; 1-мільярдна версія ConceptMaster для генерації ідентичності-відео; і Ctrl-Adapter і ControlVideo для завдань глибини-відео. Усі моделі були оцінені за їхніми замовчувальними налаштуваннями. Для послідовності 16 кадрів були рівномірно вибрані з кожного методу, що відповідає довжині виходу попередніх моделей.

Результати свідчать про те, що FullDiT, незважаючи на обробку декількох сигналів контролю одночасно, досяг найкращої продуктивності у метриках, пов’язаних з текстом, рухом камери, ідентичністю і контролем глибини.

У загальних метриках якості система загалом перевершувала інші методи, хоча її гладкість була трохи нижчою, ніж у ConceptMaster. Тут автори коментують:

‘Гладкість FullDiT трохи нижча, ніж у ConceptMaster, оскільки розрахунок гладкості заснований на подібності CLIP між сусідніми кадрами. Оскільки FullDiT демонструє значно більшу динамічність порівняно з ConceptMaster, метрика гладкості впливає на великі варіації між сусідніми кадрами.

‘Для оцінки естетики, оскільки модель оцінювання віддає перевагу зображенням у стилі малюнків, ControlVideo зазвичай генерує відео в цьому стилі, тому вона досягає високого балу за естетикою.’

Відносно якісного порівняння, можливо, краще звернутися до зразкових відео на сайті проекту FullDiT, оскільки приклади PDF статичні (і також занадто великі, щоб повністю відтворити тут).

Перший розділ відтворених якісних результатів у PDF. Будь ласка, зверніться до джерельної статті для додаткових прикладів, які занадто обширні, щоб відтворити тут.

Автори коментують:

‘FullDiT демонструє кращу збереження ідентичності і генерує відео з кращою динамічністю і візуальною якістю порівняно з [ConceptMaster]. Оскільки ConceptMaster і FullDiT тренуються на тій же основі, це підкреслює ефективність ін’єкції умов з повною увагою.

‘…інші результати демонструють вищу керованність і генерацію якості FullDiT порівняно з існуючими методами генерації глибини-відео і камери-відео.’

Розділ PDF-прикладів виходу FullDiT з декількома сигналами. Будь ласка, зверніться до джерельної статті і сайту проекту для додаткових прикладів.

Висновок

Хоча FullDiT є цікавим кроком до більш повноцінної моделі відео-фундаменту, залишається питання, чи буде попит на інструменти типу ControlNet достатнім, щоб виправдати реалізацію таких функцій у великому масштабі, принаймні для проектів з відкритим кодом, які будуть боротися за отримання величезної кількості потужності обробки GPU без комерційної підтримки.

Основною проблемою є те, що використання систем, таких як Глибина і Поза, зазвичай вимагає суттєвої знайомості з відносно складними інтерфейсами користувача, такими як ComfyUI. Тому здається, що функціональна модель з відкритим кодом цього типу найімовірніше буде розроблена групою менших компаній з візуальних ефектів, які не мають коштів (або бажання, враховуючи, що такі системи швидко стають застарілими через оновлення моделей) для кураторства і тренування такої моделі за закритими дверима.

З іншого боку, API-орієнтовані системи “орендувати-АІ” можуть бути добре мотивовані для розробки простіших і більш зручних інтерпретаційних методів для моделей, у яких системи контролю були безпосередньо треновані.

Натисніть, щоб відтворити. Контроль Глибина+Текст, накладений на генерацію відео за допомогою FullDiT.

* Автори не уточнюють жодної відомої базової моделі (тобто SDXL тощо)

Опубліковано вперше у четвер, 27 березня 2025