Погляд Anderson

“Шкідливі” дані, що забруднюють продуктивність генеративного ШІ

Нове дослідження виявляє, що багато популярних наборів зображень, які використовуються для навчання моделей ШІ, забруднені тестовими зображеннями або майже дублікатами, що дозволяє моделям “шукати”, запам’ятовуючи відповіді замість навчання. Це “просочування” поширене, але зазвичай не виявляється, тихо завищуючи результати та надаючи несправедливі переваги моделям, навченим на веб-масштабних даних.

Коли ви складаєте іспит з водіння, вам зазвичай не повідомляють заздалегідь, якими саме дорогами будуть користуватися під час тесту. Якби вам це сказали (і якби вам трохи бракувало доброчесності), ви могли б “оптимізувати” підготовку до тесту, багаторазово тренуючись саме на цьому маршруті, замість того, щоб розвивати ширші навички водіння, які дозволяють обслуговувати будь-який маршрут досить добре.

У навчанні моделей машинного навчання це розумна аналогія для розділення на тестову вибірку – поділу даних навчальної вибірки між (зазвичай) 70% для даних, які будуть використовуватися для навчання моделі, та рештою 30%, що використовуються як дані “в реальних умовах”.

Оскільки модель ніколи не бачила даних “в реальних умовах”, якщо модель добре працює на цих даних, можна припустити, що вона ефективна та продуктивна; якщо ні, модель, можливо, перенавчилася на збалансованому наборі – або ж дані потребували додаткової обробки та визначення.

У будь-якому випадку, не оцінювати моделі на їхніх навчальних даних є основним принципом сучасного методу в дослідженнях та розробці ШІ.

Ще раз, будь ласка

Згідно з новою науковою роботою з Японії, сектор досліджень комп’ютерного зору та генеративного ШІ навіть віддалено не наблизився до зусиль дослідників LLM щодо забезпечення того, щоб тестові дані не забруднювали навчальні; у тестах дослідники виявили, що кожен гіпермасштабний набір даних зображень, який вони вивчали, включаючи ті, що живлять деякі з найбільших сучасних систем генеративного ШІ, певною мірою дозволив своїм тестовим даним потрапити до навчальних даних – це означає, що бенчмарки та звіти про продуктивність моделей, навчених на цих розділах, будуть не точнішими за результат іспиту того, хто проніс шпаргалку до екзаменаційної зали, і не відображатимуть реальну продуктивність на справді нових даних.

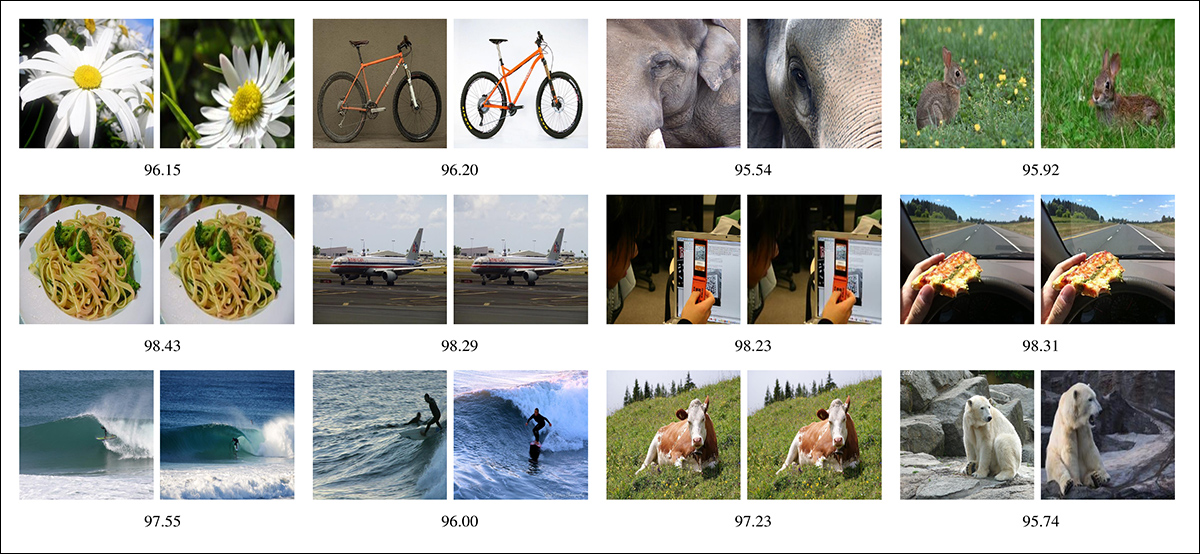

Приклади перехресного забруднення даних, виявлені дослідниками, коли дублікати або майже дублікати даних існують як у навчальних, так і в тестових даних. Source: https://arxiv.org/pdf/2508.17416

На зображенні вище з нової роботи ми бачимо приклади або дублікатів, або майже дублікатів даних, знайдених як у базових навчальних даних, так і в тестових даних різних моделей – достатньо, щоб зробити недійсною продуктивність моделі на цих даних і трохи завищити її загальні результати в цілому, створюючи видимість рівня узагальнення, якого модель, можливо, насправді не досягла.

Щоб ускладнити справу, забруднення, здається, відбувається в різноманітних можливих сценаріях, включаючи “попереднє навчання“, де ваги старіших моделей-попередників використовуються для “запуску” нової моделі. Якщо вихідна, старіша модель має частину тих самих даних, що й новіший набір даних, який проходить попереднє навчання, то перехресне забруднення може статися навіть якщо розділення 70/30 або 80/20 є чистим.

Кумулятивний ефект

Це майже напевно відбувається навіть у найновіших наборах даних: обсяг наборів даних зору/мови надзвичайно зріс за останні п’ять років, включаючи не лише найновіші дані зображень у мережі, але й повторно збираючи багато тих самих даних, що наповнювали ті старіші, історичні набори.

Крім того, автоматизовані процедури, призначені для пошуку та фільтрації мільярдів зображень на наявність дублікатів і майже дублікатів, тепер стикаються з настільки тяжким завданням, що сама обробка – її вартість з точки зору часу та грошей – тепер повинна розглядатися в контексті бюджетних обмежень.

Тим часом дублювання зображень є неминучим наслідком такого ad hoc веб-сканування, що стоїть за масивними колекціями, як-от Common Crawl, через поширену практику повторного розміщення та перестиснення зображень, а також застосування редагувань, таких як обрізання та навіть віддзеркалення (щоб уникнути виявлення, коли зображення, наприклад, могло бути використано без дозволу).

Автори зазначають*:

“Просочування даних є поширеною проблемою, яка існує в більшості візуальних наборів даних. Просочування може приховувати здатність моделей до узагальнення, що особливо проблематично при порівнянні моделей, навчених на різних наборах даних, оскільки призводить до несправедливих порівнянь.

Ми закликаємо розробників наборів даних ретельно обмірковувати наслідки цих оцінок. Для справедливішої оцінки моделей ми рекомендуємо використовувати детектори дублікатів, які враховують як жорстке, так і м’яке просочування.

В ідеалі, “просочилися” зображення слід видаляти з навчального набору, а якщо це неможливо, їх принаймні слід видалити з тестового набору.”

У роботі детально описується низка тестів, які дослідники провели на масивних і популярних наборах даних – кожен з яких продемонстрував певний рівень забруднення.

Нова робота має назву Data Leakage in Visual Datasets і належить трьом дослідникам з Університету Осаки.

Метод

Автори роботи визначають просочування за трьома вимірами: модальність, охоплення та ступінь.

Модальність розрізняє, чи “просочилися” лише зображення, чи і зображення, і мітки; охоплення визначає, чи відбувається перекриття в межах одного набору даних чи між різними наборами; а ступінь визначає, чи є дубльований вміст абсолютно однаковим чи лише схожим.

Щодо просочування, два сценарії, розглянуті в роботі, це внутрішньонабірне просочування (коли оціночні зображення з’являються знову в навчальному розділі того самого набору даних) та міжнабірне просочування (коли оціночні зображення з одного набору даних присутні в іншому наборі даних, що використовується для навчання).

Щодо ступеня, визначено два рівні: м’яке просочування (коли зображення не ідентичні, але мають незначні відмінності) та жорстке просочування (коли зображення абсолютно однакові в навчанні та оцінці).

Дослідники підходять до виявлення просочування з точки зору пошуку зображень, використовуючи кодувальники зображень для представлення кожного зображення як вектора ознак. Набір запитів – це дані для оцінки, тоді як колекція – це навчальний набір.

Для менших наборів даних кожен вектор запиту безпосередньо порівнювався з усіма навчальними векторами за допомогою косинусної схожості. Для більших наборів даних був побудований Faiss індекс, щоб забезпечити швидший пошук за методом K-найближчих сусідів (KNN).

Оскільки кодувальник повинен захоплювати достатньо візуальної інформації для виявлення тонких схожостей, але залишатися ефективним перед обличчям дуже великих обсягів даних, автори покладалися на попередньо обчислені ознаки CLIP, надані творцями наборів даних, у випадку колекції LAION, що лежить в основі Stable Diffusion та подальших проектів.

Автори зазначають, що дозвіл CLIP використовувати своє “дистильоване” розуміння набору даних (замість масштабного опитування фактичних файлів) значно прискорило процес і забезпечило покращену узгодженість між порівняннями.

Дані та тести

Кодувальник зображень CLIP, використаний у тестах для нової роботи, був стандартним CLIP ViT-B/32, спочатку використаним для відсіювання LAION. Щоб встановити, чи пов’язані різноманітні зображення між собою, KNN використовувався за допомогою AutoFaiss.

Набори даних були згруповані на три типи: набори даних для попереднього навчання – великі, зібрані з веб-сайтів колекції, що використовуються для навчання універсальних моделей; навчальні набори даних – менші, часто анотовані колекції, призначені для безпосереднього налаштування моделі; та бенчмаркові набори даних – вручну анотовані та використовуються виключно для оцінки.

Аналіз охопив двадцять розділів у семи наборах даних: Microsoft COCO використовувався як навчальний, так і оціночний набір, включаючи розділи train, validation, test та unlabeled; Flickr30k служив виключно як бенчмарк; а колекція Google Conceptual Captions (GCC) розглядалася як джерело попереднього навчання, причому її частина validation також використовувалася для оцінки.

Крім того, ImageNet викори