Найкраще

10 найкращих алгоритмів машинного навчання

Хоча ми живемо в часи надзвичайних інновацій у машинному навчанні з прискоренням на GPU, останні наукові роботи часто (і помітно) містять алгоритми, яким десятиліття, а в окремих випадках — 70 років. Дехто може стверджувати, що багато з цих старих методів належать до сфери «статистичного аналізу», а не машинного навчання, і вважають за краще датувати початок галузі лише 1957 роком, з винаходом перцептрона. З огляду на ступінь, в якому ці старі алгоритми підтримують та переплітаються з останніми трендами та гучними досягненнями в машинному навчанні, така позиція є спірною. Тож давайте поглянемо на деякі «класичні» будівельні блоки, що лежать в основі останніх інновацій, а також на деякі новіші алгоритми, які вже претендують на місце в залі слави ШІ.

1: Трансформери

У 2017 році Google Research очолив дослідницьку співпрацю, яка завершилася статтею Attention Is All You Need. У роботі було окреслено нову архітектуру, яка перетворила механізми уваги з «допоміжного каналу» в моделях кодувальник/декодувальник та рекурентних мережах на самостійну центральну трансформаційну технологію. Цей підхід отримав назву Трансформер і з того часу став революційною методологією в обробці природної мови (NLP), живлячи, серед багатьох інших прикладів, авторегресійну мовну модель та візитну картку ШІ — GPT-3.

Хронологія гіпермасштабних проектів NLP на базі Трансформерів. Джерело: Microsoft

Архітектура Трансформера також перейшла з NLP у комп’ютерний зір, живлячи нове покоління фреймворків синтезу зображень, таких як CLIP та DALL-E від OpenAI, які використовують відображення домену текст>зображення для завершення неповних зображень та синтезу нових зображень з навчених доменів, серед зростаючої кількості пов’язаних додатків.

DALL-E намагається завершити часткове зображення бюста Платона. Джерело: https://openai.com/blog/dall-e/

2: Generative Adversarial Networks (GANs)

Хоча трансформери отримали надзвичайне висвітлення в ЗМІ завдяки виходу та впровадженню GPT-3, Generative Adversarial Network (GAN) сама по собі стала впізнаваним брендом і, можливо, згодом стане дієсловом, як і deepfake. Вперше запропоновані у 2014 році та переважно використовувані для синтезу зображень, архітектура Generative Adversarial Network складається з Генератора та Дискримінатора. Генератор циклічно перебирає тисячі зображень у наборі даних, ітеративно намагаючись їх відтворити. Для кожної спроби Дискримінатор оцінює роботу Генератора та відправляє Генератор назад, щоб він працював краще, але не даючи жодного розуміння того, в чому полягала помилка попереднього відтворення.

Джерело: https://developers.google.com/machine-learning/gan/gan_structure

Це змушує Генератор досліджувати безліч шляхів, замість того щоб слідувати потенційним глухим кутам, які виникли б, якби Дискримінатор сказав йому, де він помиляється (див. №8 нижче). До завершення навчання Генератор має детальну та всебічну карту взаємозв’язків між точками в наборі даних.

Зі статті Improving GAN Equilibrium by Raising Spatial Awareness: новий фреймворк циклічно проходить через іноді загадковий латентний простір GAN, забезпечуючи респонсивну інструментальність для архітектури синтезу зображень. Джерело: https://genforce.github.io/eqgan/

За аналогією, це різниця між вивченням однієї буденної поїздки до центру Лондона та ретельним опануванням The Knowledge. Результатом є високорівнева колекція ознак у латентному просторі навченої моделі. Семантичним індикатором високорівневої ознаки може бути «людина», тоді як спуск через специфічність, пов’язану з ознакою, може виявити інші навчені характеристики, такі як «чоловіча» та «жіноча». На нижчих рівнях підозначки можуть розбиватися на «блондин», «європеоїд» тощо. Заплутаність є помітною проблемою в латентному просторі GAN та фреймворків кодувальник/декодувальник: чи є посмішка на згенерованому GAN жіночому обличчі заплутаною ознакою її «ідентичності» в латентному просторі, чи це паралельна гілка?

Згенеровані GAN обличчя з thispersondoesnotexist. Джерело: https://this-person-does-not-exist.com/en

Останні кілька років принесли зростаючу кількість нових дослідницьких ініціатив у цьому напрямку, можливо, прокладаючи шлях для редагування на рівні ознак у стилі Photoshop для латентного простору GAN, але наразі багато трансформацій є фактично пакетами «все або нічого». Примітно, що реліз EditGAN від NVIDIA наприкінці 2021 року досягає високого рівня інтерпретованості в латентному просторі за допомогою масок семантичної сегментації. Популярне використання Окрім їхньої (насправді досить обмеженої) участі у популярних deepfake-відео, орієнтовані на зображення/відео GAN поширилися за останні чотири роки, захоплюючи як дослідників, так і громадськість. Відстежувати запаморочливу швидкість і частоту нових релізів є складним завданням, хоча репозиторій GitHub Awesome GAN Applications має на меті надати вичерпний список. Generative Adversarial Networks теоретично можуть виводити ознаки з будь-якого чітко окресленого домену, включаючи текст.

3: SVM

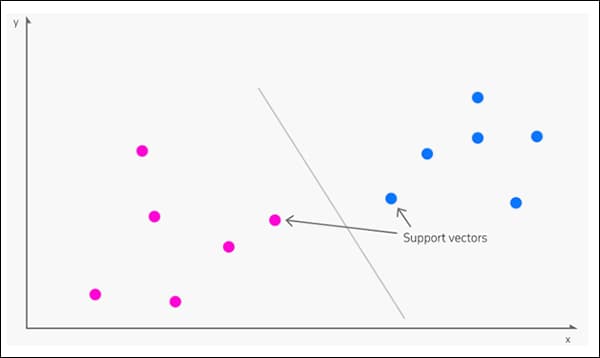

Виникнувши у 1963 році, Support Vector Machine (SVM) є основним алгоритмом, який часто з’являється в нових дослідженнях. У SVM вектори відображають взаємне розташування точок даних у наборі даних, тоді як опорні вектори окреслюють межі між різними групами, ознаками або рисами.

Опорні вектори визначають межі між групами. Джерело: https://www.kdnuggets.com/2016/07/support-vector-machines-simple-explanation.html

Отримана межа називається гіперплощиною. На низьких рівнях ознак SVM є двовимірним (зображення вище), але там, де визнано більшу кількість груп або типів, він стає тривимірним. <img class="wp-image-180123 size-full" src="https://www.unite.ai/wp-content