Штучний інтелект

Дослідники створили альтернативу GPU

Комп’ютерні вчені з Райсського університету разом з колегами з Intel розробили більш економічну альтернативу GPU. Нова алгоритм називається “підлінійний двигун глибокого навчання” (SLIDE), і він використовує загальні процесори (CPU) без спеціалізованого прискорювального апаратного забезпечення.

Результати були представлені в конференц-центрі Остіна, який проводить конференцію з систем машинного навчання MLSys.

Однією з найбільших проблем у сфері штучного інтелекту (AI) є спеціалізоване прискорювальне апаратне забезпечення, chẳng hạn як графічні процесори (GPU). До нових розробок вважалося, що для прискорення технології глибокого навчання потрібне використання цього спеціалізованого апаратного забезпечення.

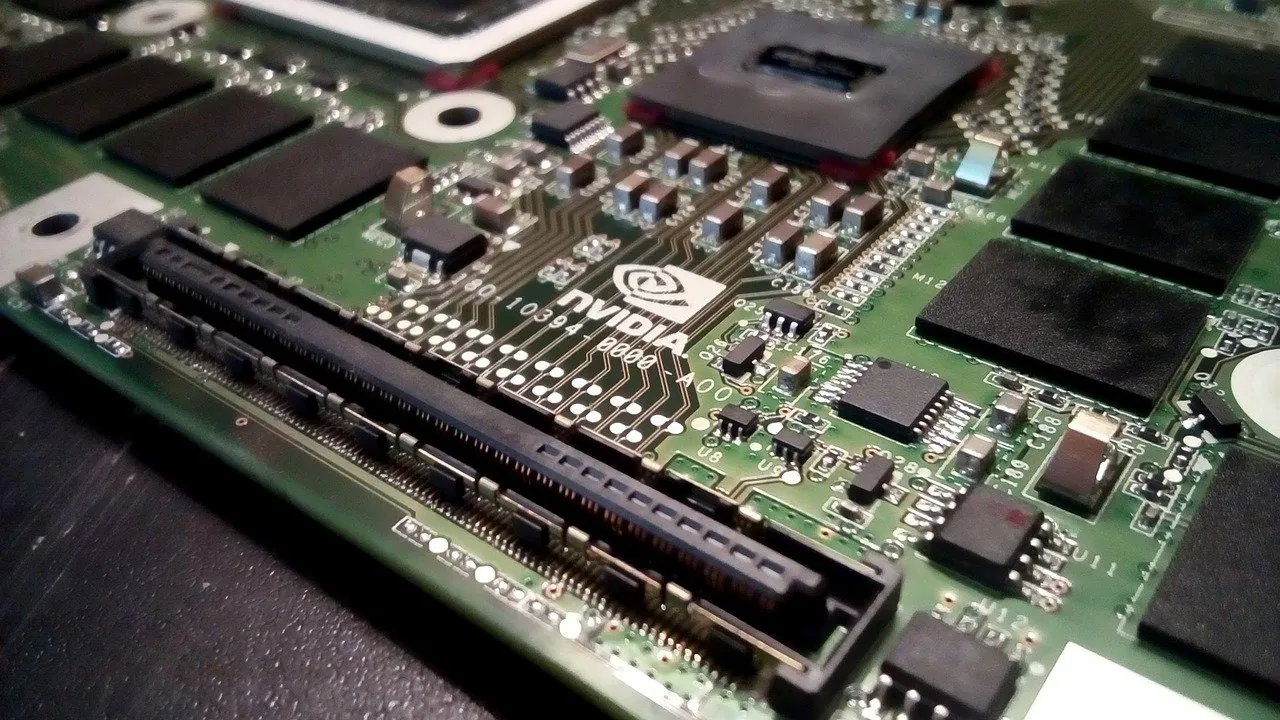

Багато компаній віддають велике значення інвестиціям в GPU і спеціалізоване апаратне забезпечення для глибокого навчання, яке відповідає за технології, такі як цифрові помічники, розпізнавання облич і системи рекомендацій товарів. Одною з таких компаній є Nvidia, яка створює графічні процесори Tesla V100 Tensor Core. Nvidia недавно повідомила про зростання доходів у четвертому кварталі на 41% порівняно з минулим роком.

Розробка SLIDE відкриває абсолютно нові можливості.

Аншумалі Шрівастава – асистент-професор у школі інженерії Брауна Райсського університету і допоміг винайти SLIDE разом з аспірантами Бейді Чен і Таруном Медіні.

“Наші тести показують, що SLIDE – це перший розумний алгоритмічний варіант глибокого навчання на CPU, який може перевершити апаратне прискорення GPU на промислових масштабах рекомендаційних наборів даних з великими пов’язаними архітектурами”, – сказав Шрівастава.

SLIDE долає проблему GPU завдяки цілком іншому підходу до глибокого навчання. На даний момент стандартною технікою навчання глибоких нейронних мереж є “базове поширення”, яке вимагає множення матриць. Ця робота вимагає використання GPU, тому дослідники змінили навчання нейронної мережі так, щоб його можна було розв’язати за допомогою хеш-таблиць.

Цій новий підхід значно знижує обчислювальне навантаження для SLIDE. Поточна найкраща платформа GPU, яку компанії, такі як Amazon і Google, використовують для хмарного глибокого навчання, має вісім Tesla V100, і ціна становить близько 100 000 доларів.

“У нас є одна в лабораторії, і в нашому тестовому випадку ми взяли робоче навантаження, яке ідеально підходить для V100, одне з більш ніж 100 мільйонами параметрів у великих, пов’язаних мережах, які поміщаються в пам’яті GPU”, – сказав Шрівастава. “Ми тренували її з найкращим (програмним) пакетом, який є, Google’s TensorFlow, і це зайняло 3,5 години тренування.

“Потім ми показали, що наш новий алгоритм може виконати тренування за один годину, не на GPU, а на 44-ядерному процесорі Xeon-класу”, – продовжив він.

Хешування – це тип методу індексування даних, винайдений у 1990-х роках для інтернет-пошуку. Чисельні методи використовуються для кодування великих обсягів інформації у вигляді рядка цифр, який називається хешем. Хеші перераховуються для створення таблиць, які можна швидко шукати.

“Було б безглуздо реалізувати наш алгоритм на TensorFlow або PyTorch, оскільки перша річ, яку вони хочуть зробити, – це перетворити все, що ви робите, на проблему множення матриць”, – сказав Чен. “Це саме те, від чого ми хотіли відмовитися. Тому ми написали свій власний код на C++ з нуля”.

За словами Шрівастави, найбільша перевага SLIDE полягає в тому, що він паралельний за даними.

“Під паралельністю за даними я маю на увазі, що якщо у мене є два екземпляри даних, на яких я хочу тренуватися, скажімо, одне – зображення кота, а інше – автобуса, вони, ймовірно, активують різні нейрони, і SLIDE може оновити або тренуватися на цих двох незалежно”, – сказав він. “Це значно краще використання паралелізму для CPU”.

“З іншого боку, порівняно з GPU, нам потрібно велика пам’ять”, – сказав він. “Є ієрархія кешу в основній пам’яті, і якщо ви не будете обережні з ним, ви можете потрапити в проблему, таку як кеш-трешинг, де ви отримуєте багато промахів кешу”.

SLIDE відкрив двері для нових способів реалізації глибокого навчання, і Шрівастава вважає, що це тільки початок.

“Ми тільки поцарапали поверхню”, – сказав він. “Є багато чого ми ще можемо зробити для оптимізації. Ми не використали векторизацію, наприклад, або вбудовані прискорювачі в CPU, такі як Intel Deep Learning Boost. Є багато інших трюків, які ми все ще можемо використовувати, щоб зробити це ще швидшим”.