Погляд Anderson

‘Захищені’ Зображення Легше, Ні Ж Одніше, Вкрадають З AI

Нові дослідження свідчать, що інструменти водяних знаків, призначені для блокування редагування зображень AI, можуть мати зворотний ефект. Замість зупинки моделей типу Stable Diffusion від внесення змін, деякі захисту насправді допомагають AI слідувати редакційним інструкціям більш точно, роблячи небажані маніпуляції ще легшими.

Існує помітна і міцна галузь у літературі комп’ютерного зору, присвячена захисту авторських прав на зображення від навчання в моделях AI або використання в безпосередніх процесах обробки зображень AI. Системи цього типу загалом спрямовані на латентні дифузійні моделі (LDM), такі як Stable Diffusion і Flux, які використовують шумові процедури для кодування і декодування зображень.

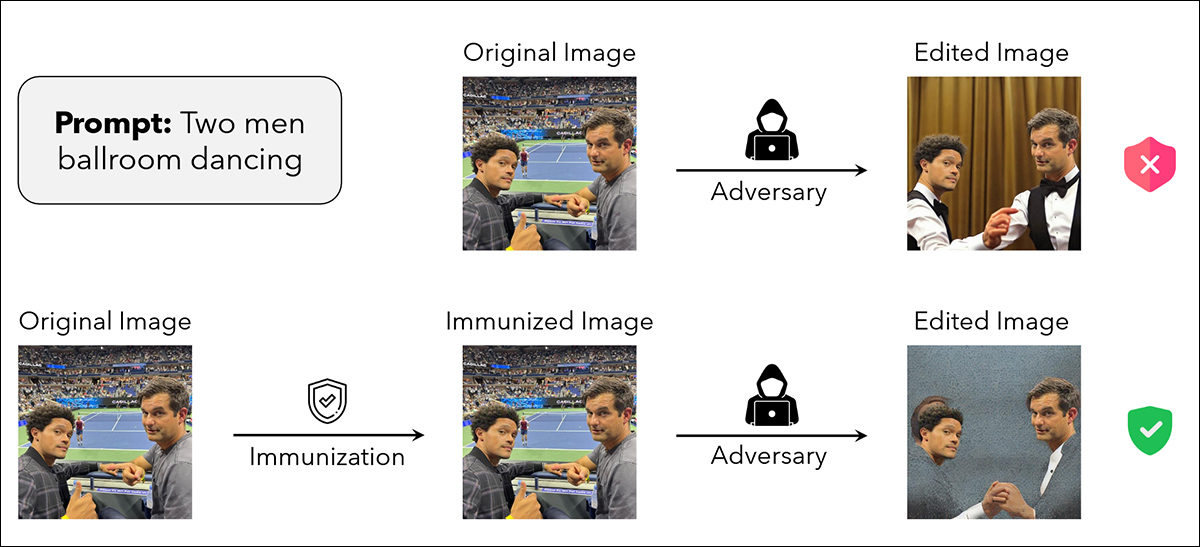

Вставляючи адверсарний шум до зображень, які в іншому випадку виглядають нормально, можна зробити так, щоб детектори зображень неправильно визначали вміст зображення, і перешкоджали системам генерації зображень використовувати дані, захищені авторським правом:

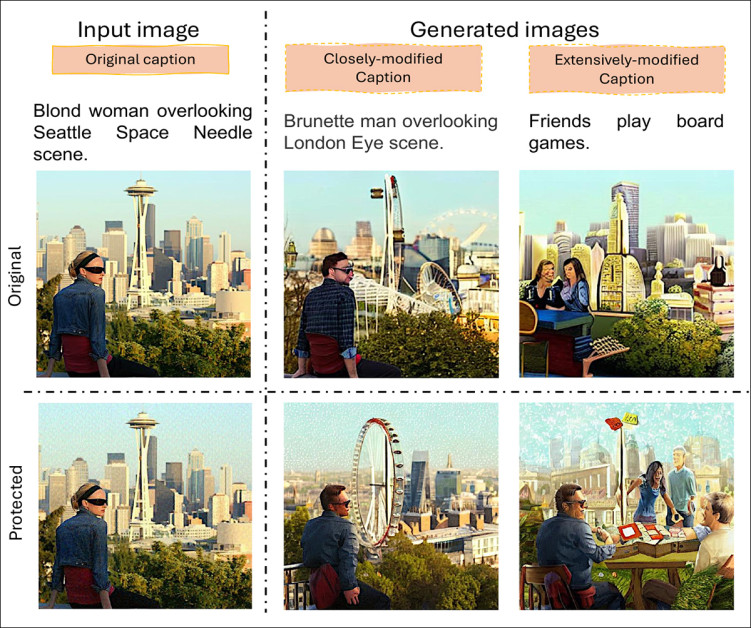

З паперу MIT ‘Raising the Cost of Malicious AI-Powered Image Editing’, приклади джерельного зображення ‘імунізованого’ проти маніпуляцій (нижній ряд). Джерело: https://arxiv.org/pdf/2302.06588

Від часу задери художників проти ліберального використання веб-скрепінгових зображень (включно з захищеними авторським правом зображеннями) у 2023 році, дослідницька сцена створила численні варіації на одну й ту ж тему – ідею, що зображення можна «отруїти» проти навчання в системах AI або втягування в пайплайни генерації AI, не впливаючи негативно на якість зображення для середнього глядача.

У всіх випадках існує пряма кореляція між інтенсивністю нав’язаного порушення, ступенем, до якого зображення потім захищається, і ступенем, до якого зображення не виглядає зовсім так добре, як повинно:

Хоча якість дослідницького PDF не повністю ілюструє проблему, більші кількості адверсарних порушень жертвують якістю за безпекою. Тут ми бачимо гаму порушень якості у проекті ‘Fawkes’ 2020 року під керівництвом Університету Чикаго. Джерело: https://arxiv.org/pdf/2002.08327

Особливого інтересу для художників, які шукають захист свого стилю проти несанкціонованого використання, є здатність таких систем не тільки затемнити ідентичність і інші відомості, але і «переконати» процес навчання AI, що він бачить щось інше, ніж насправді бачить, так що зв’язки не утворюються між семантичними і візуальними доменами для «захищених» навчальних даних (тобто, інструкція типу ‘У стилі Пола Кле’).

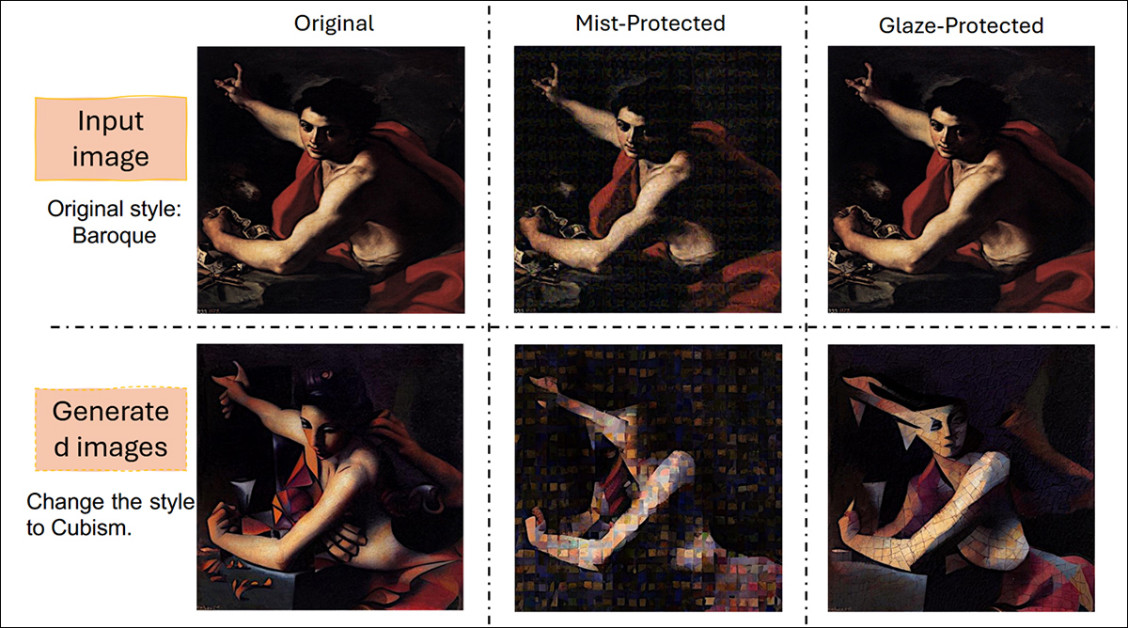

Mist і Glaze – два популярні методи ін’єкції, здатні запобігти або хоча б серйозно ускладнити спроби використання захищених стилів у робочих процесах AI та навчальних режимах. Джерело: https://arxiv.org/pdf/2506.04394

Власна Мішень

Тепер нові дослідження з США виявили, що не тільки порушення можуть не захистити зображення, але й те, що додавання порушення може насправді поліпшити експлуатабельність зображення в усіх процесах AI, проти яких це порушення призначене для імунізації.

У папері зазначається:

‘У наших експериментах з різними методами захисту зображень на основі порушень у декількох доменах (зображення природних сцен і творів мистецтва) та завдань редагування (генерація зображення в зображення та редагування стилю), ми виявили, що такий захист не досягає цієї мети повністю.

‘У більшості сценаріїв редагування зображень на основі дифузії захищених зображень генерує бажане вихідне зображення, яке точно відповідає інструкціям.

‘Наші висновки свідчать, що додавання шуму до зображень може парадоксально збільшити їхню асоціацію з заданими текстовими інструкціями під час процесу генерації, що призводить до непередбачуваних наслідків, таких як краще редагування результатів.

‘Отже, ми стверджуємо, що методи на основі порушень можуть не забезпечувати достатнього рішення для надійного захисту зображень проти редагування на основі дифузії.’

У тестах захищені зображення піддавалися двом знайомим сценаріям редагування AI: прямій генерації зображення в зображення та переносу стилю. Ці процеси відображають звичайні способи, якими моделі AI можуть експлуатувати захищений контент, або безпосередньо змінюючи зображення, або запозичуючи його стилістичні ознаки для використання в інших місцях.

Захищені зображення, вибрані зі стандартних джерел фотографій і творів мистецтва, були пропущені через ці пайплайни, щоб побачити, чи можуть додані порушення блокувати або погіршувати редагування.

Замість цього наявність захисту часто здавалася посилювати вирівнювання моделі з інструкціями, виробляючи чисті, точні виходи, де очікувався певний рівень невдачі.

Автори радять, по суті, що цей популярний метод захисту може забезпечувати помилкове відчуття безпеки, і що будь-які підходи до імунізації на основі порушень повинні бути ретельно протестовані проти методів авторів.

Метод

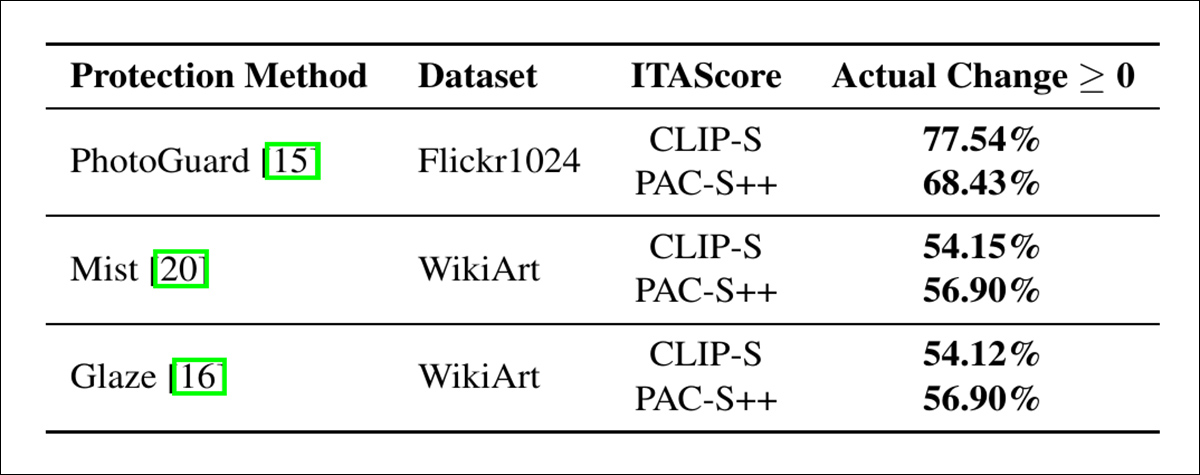

Автори провели експерименти, використовуючи три методи захисту, які застосовують ретельно спроектовані адверсарні порушення: PhotoGuard; Mist; і Glaze.

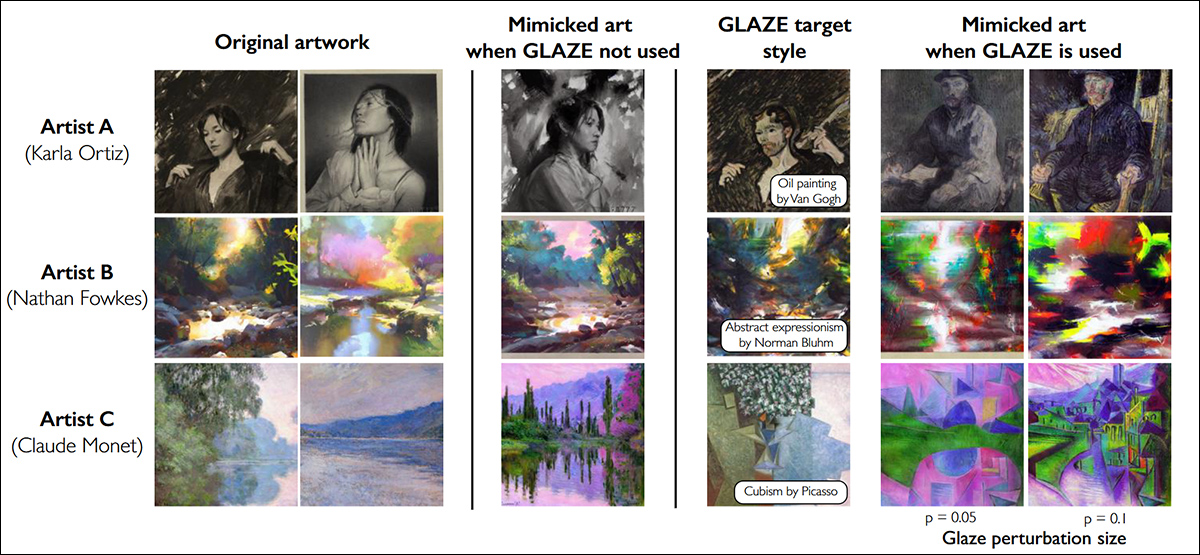

Glaze, одна з тестованих авторами рамок, ілюструє приклади захисту Glaze для трьох художників. Перші два стовпці показують оригінальні твори мистецтва; третій стовпець показує результати імітації без захисту; четвертий стовпець показує стилізовані версії, використані для оптимізації плаща, разом з назвою цільового стилю. П’ятий і шостий стовпці показують результати імітації з застосованим захистом на рівні порушення p = 0,05 і p = 0,1. Всі результати використовують моделі Stable Diffusion. https://arxiv.org/pdf/2302.04222

PhotoGuard була застосована до зображень природних сцен, тоді як Mist і Glaze були використані на творах мистецтва (тобто, «художньо-стилізованих» доменах).

Тести охоплювали як природні, так і художні зображення, щоб відобразити можливе реальне використання. Ефективність кожного методу оцінювалася шляхом перевірки, чи може модель AI все ще виробляти реалістичні та відповідні інструкціям редагування, коли працює з захищеними зображеннями; якщо вироблені зображення виглядали переконливими та відповідали інструкціям, захист вважався невдалим.

Stable Diffusion v1.5 була використана як попередньо навчений генератор зображень для завдань редагування дослідників. П’ять seed були вибрані, щоб забезпечити репродуктивність: 9222, 999, 123, 66 і 42. Всі інші налаштування генерації, такі як масштаб керівництва, сила та загальна кількість кроків, слідували значеннями за замовчуванням, використаними в експериментах з PhotoGuard.

PhotoGuard була протестована на зображеннях природних сцен за допомогою набору даних Flickr8k, який містить понад 8 000 зображень, парованих з до п’яти підписів кожне.

Протилежні Думки

Дві модифіковані підписи були створені з першої підписки кожного зображення за допомогою Claude Sonnet 3.5. Одна серія містила інструкції, які були контекстно близькими до оригінальних підписок; інша серія містила інструкції, які були контекстно віддаленими.

Наприклад, з оригінальної підписки ‘Молода дівчина в рожевому платьї, яка йде до дерев’яної хатини’, близька інструкція буде ‘Молодий хлопець у синій сорочці, який йде до цегляного будинку’. Натомість, віддалена інструкція буде ‘Два коти, які лежать на дивані’.

Близькі інструкції будувалися шляхом заміни іменників і прикметників на семантично подібні терміни; далекі інструкції генерувалися шляхом інструктування моделі створити підписки, які були контекстно дуже різними.

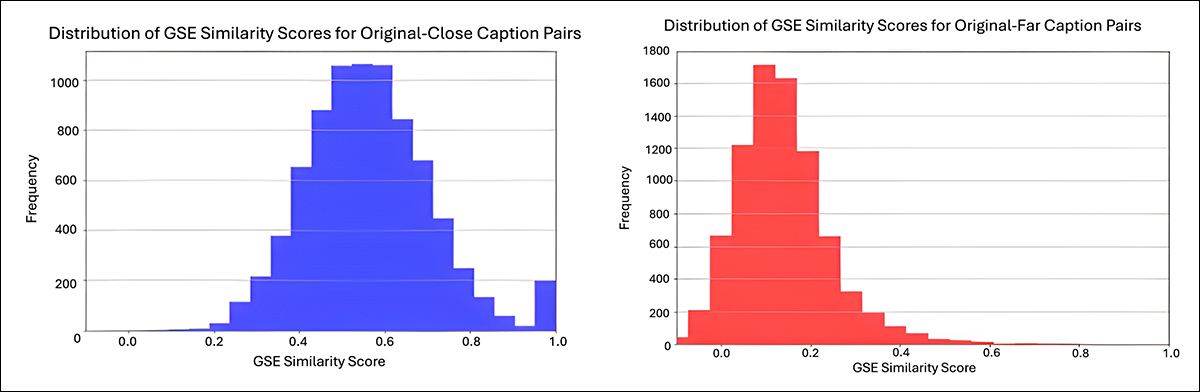

Всі згенеровані підписки були перевірені вручну на якість і семантичну відповідність. Використовувалася Universal Sentence Encoder від Google для розрахунку семантичних схожостей між оригінальними та зміненими підписками:

З додаткового матеріалу, розподіли семантичних схожостей для змінених підписок, використаних у тестах Flickr8k. Графік зліва показує схожість для близьких змінених підписок, у середньому близько 0,6. Графік справа показує розширені змінені підписки, у середньому близько 0,1, що відображає більшу семантичну відстань від оригінальних підписок. Джерело: https://sigport.org/sites/default/files/docs/IncompleteProtection_SM_0.pdf

Кожне зображення, разом з його захищеною версією, було відредаговано за допомогою обидвох близьких і віддалених інструкцій. Оцінювач зображень Blind/Referenceless Image Spatial Quality Evaluator (BRISQUE) був використаний для оцінки якості зображення:

Результати генерації зображення в зображення на природніх фотографіях, захищених PhotoGuard. Незважаючи на наявність порушень, Stable Diffusion v1.5 успішно слідувала як малим, так і великим семантичним змінам у інструкціях редагування, виробляючи реалістичні виходи, які відповідали новим інструкціям.

Згенеровані зображення мали оцінку 17,88 за шкалою BRISQUE, з 17,82 для близьких інструкцій і 17,94 для віддалених інструкцій, тоді як оригінальні зображення мали оцінку 22,27. Це показує, що відредаговані зображення залишилися близькими до оригіналів за якістю.

Метрики

Для оцінки того, як добре захисти перешкоджають редагуванню AI, дослідники виміряли, наскільки точно кінцеві зображення відповідали інструкціям, які їм були дані, використовуючи системи оцінювання, які порівнювали вміст зображення з текстовою інструкцією, щоб побачити, наскільки добре вони відповідають.

Для цього використовувалася метрика CLIP-S, яка використовує модель, що може зрозуміти як зображення, так і текст, для перевірки їхньої схожості, тоді як PAC-S++ додає додаткові зразки, створені AI, щоб вирівняти порівняння більш близько до людської оцінки.

Ці оцінки Image-Text Alignment (ITA) позначають, наскільки точно AI слідувала інструкціям при редагуванні захищеного зображення: якщо захищене зображення все ще призвело до високої відповідності виходу, це означає, що захист був визнаний невдалим у блокуванні редагування.

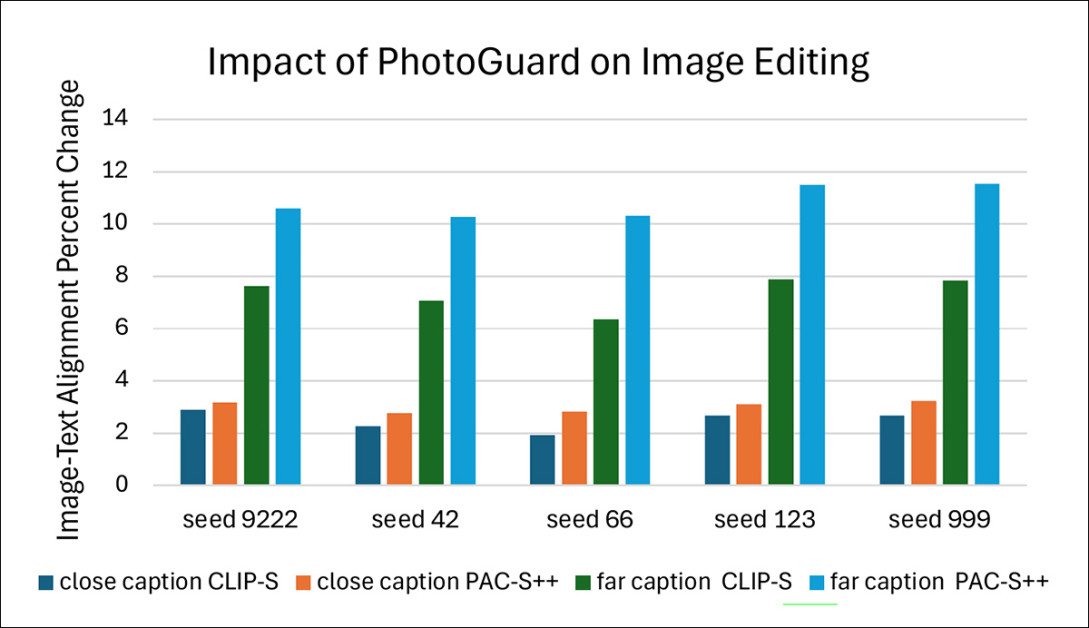

Ефект захисту на наборі даних Flickr8k за п’ять сідів, використовуючи обидві близькі і віддалені інструкції. Вирівнювання зображення-tekstu було виміряно за допомогою оцінок CLIP-S і PAC-S++.

Дослідники порівняли, наскільки добре AI слідувала інструкціям при редагуванні захищених зображень порівняно з незахищеними. Вони спочатку розглянули різницю між ними, названу Фактична зміна. Потім різницю було масштабовано, щоб створити відсоткову зміну, що полегшувало порівняння результатів у багатьох тестах.

Цей процес показав, чи захисти робили редагування легшим чи важчим для AI. Тести повторювалися п’ять разів за допомогою різних випадкових сідів, охоплюючи як малі, так і великі зміни оригінальних підписок.

Атака Мистецтва

Для тестів на природніх фотографіях використовувався набір даних Flickr1024, який містить понад одну тисячу високоякісних зображень. Кожне зображення було відредаговано інструкціями, які слідували шаблону: ‘змінити стиль на [V]’, де [V] представляв один із семи знаменитих стилів мистецтва: Кубізм; Постімпресіонізм; Імпресіонізм; Сюрреалізм; Бароко; Фовізм; і Ренесанс.

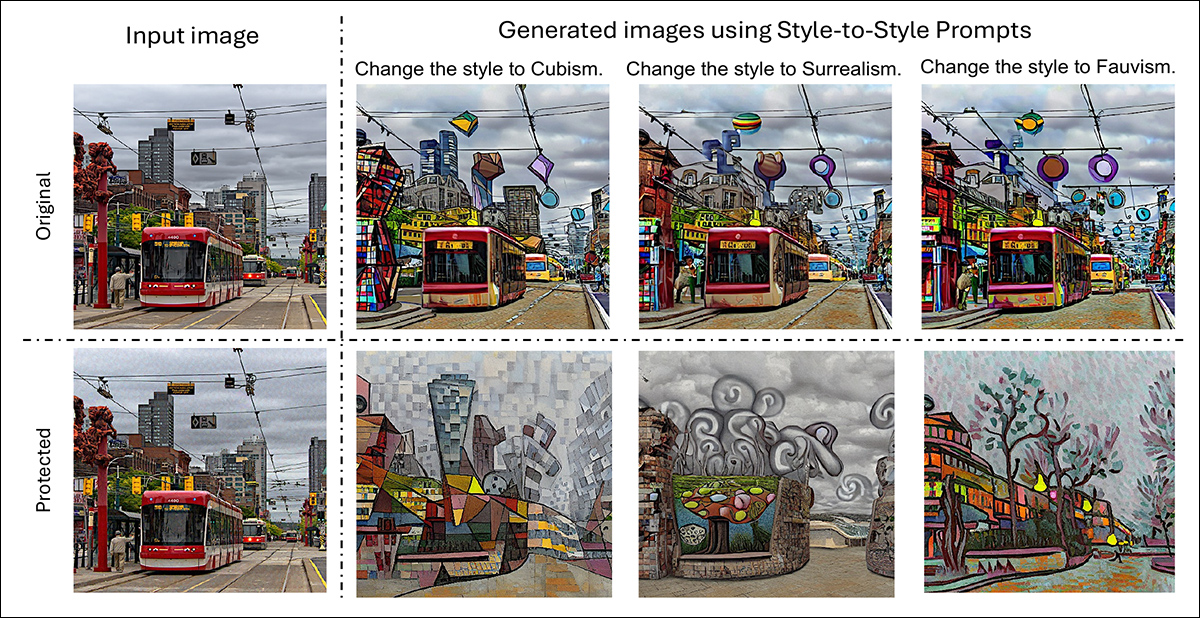

Процес включав застосування PhotoGuard до оригінальних зображень, генерацію захищених версій, а потім проходження обидвох захищених і незахищених зображень через одну й ту ж серію редагувань стилю:

Оригінальні та захищені версії природнього зображення, кожне відредаговане для застосування Кубізму, Сюрреалізму та Фовізму.

Для тестування методів захисту на творах мистецтва проводився перенос стилю на зображеннях з набору даних WikiArt, який курирує широкий спектр стилів мистецтва. Інструкції редагування слідували тому ж формату, що й раніше, інструктуя AI змінити стиль на випадково вибраний, несуміжний стиль, вибраний з міток WikiArt.

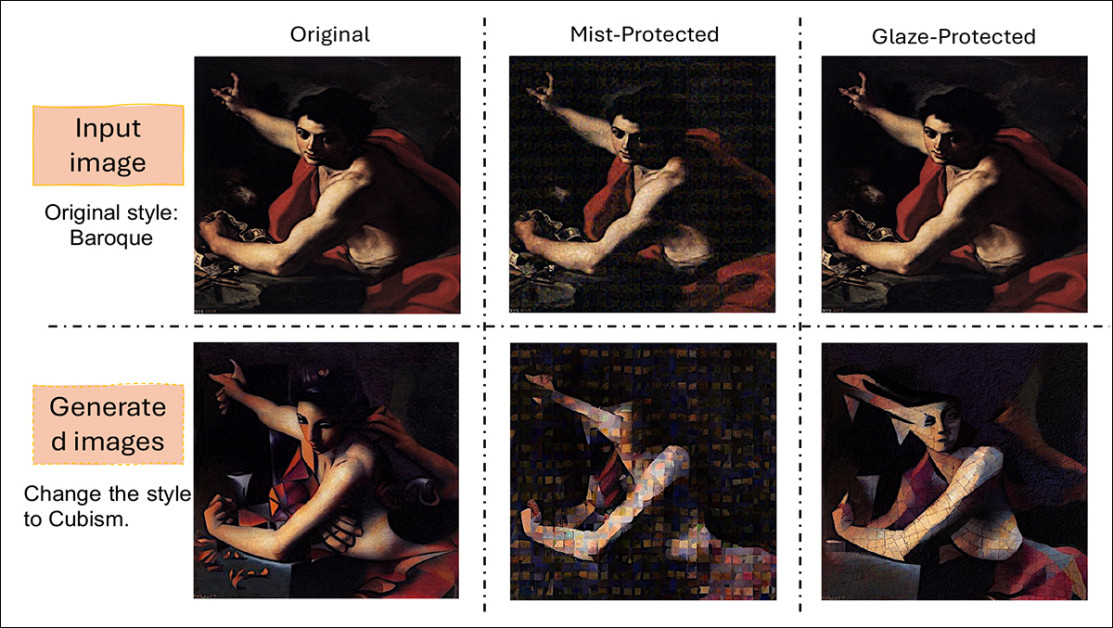

Обидва методи захисту Glaze і Mist були застосовані до зображень перед редагуванням, дозволяючи дослідникам спостерігати, наскільки добре кожен захист може блокувати або спотворювати результати переносу стилю:

Приклади того, як методи захисту впливають на перенос стилю на творах мистецтва. Оригінальне барокове зображення показано поряд з версіями, захищеними Mist і Glaze. Після застосування переносу стилю Кубізму можна побачити різниці в тому, як кожен захист змінює кінцевий результат.

Дослідники проводили порівняння кількісно також:

Зміни оцінок вирівнювання зображення-tekstu після редагування переносу стилю.

З цих результатів автори коментують:

‘Результати підкреслюють значну обмеженість адверсарних порушень для захисту. Замість того, щоб перешкоджати вирівнюванню, адверсарні порушення часто підвищують реакцію генеративної моделі на інструкції, непередбачувано дозволяючи експлуататорам створювати виходи, які відповідають їхнім цілям. Такий захист не заважає процесу редагування зображень і може не бути здатний запобігти несанкціонованому копіюванню матеріалів.

‘Непередбачувані наслідки використання адверсарних порушень розкривають вразливості існуючих методів і підкреслюють нагальну потребу у більш ефективних техніках захисту.’

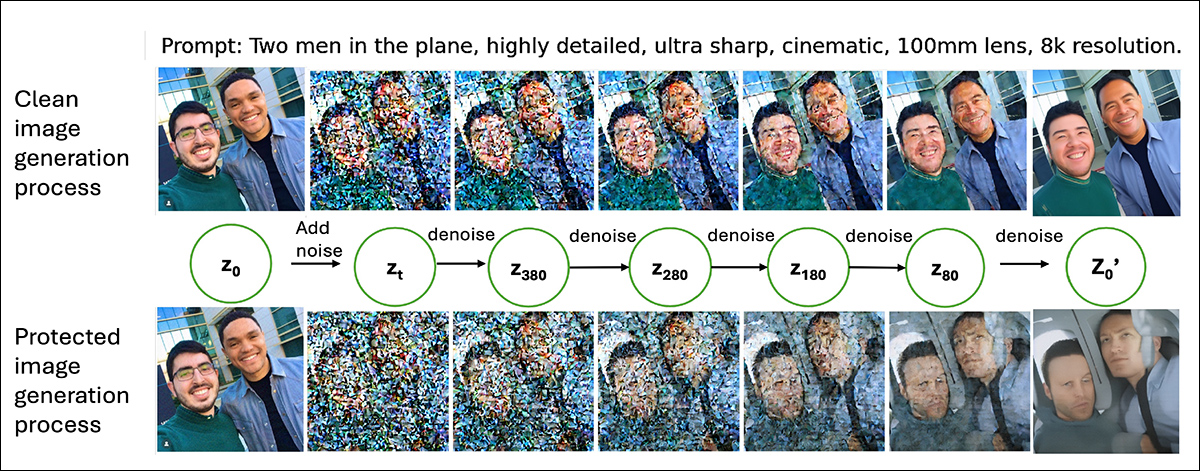

Автори пояснюють, що ці несподівані результати можна пояснити тим, як працюють моделі дифузії: LDM редагують зображення, спочатку конвертуючи їх у стиснуту версію, звану латентним; шум потім додається до цього латентного через багато кроків, поки дані не стануть майже випадковими.

Модель перевертає цей процес під час генерації, видаляючи шум крок за кроком. На кожному етапі цього перевертання текстова інструкція допомагає спрямовувати, як шум повинен бути видалений, поступово формуючи зображення, щоб воно відповідало інструкції:

Порівняння генерацій з незахищеного зображення і захищеного зображення з PhotoGuard, з проміжними латентними станами, перетвореними назад у зображення для візуалізації.

Методи захисту додають невеликі кількості додаткового шуму до оригінального зображення перед тим, як воно вступає в цей процес. Хоча ці порушення незначні на початку, вони накопичуються, коли модель застосовує свої власні шари шуму.

Цей нарощування залишає більшу частину зображення «невизначеною», коли модель починає видаляти шум. З більшим невизначенням модель більше спирається на текстову інструкцію, щоб заповнити відсутні деталі, надаючи інструкції навіть більший вплив, ніж вони мали б звичайно.

По суті, захисти роблять його легшим для AI переробляти зображення, щоб воно відповідало інструкції, а не складніше.

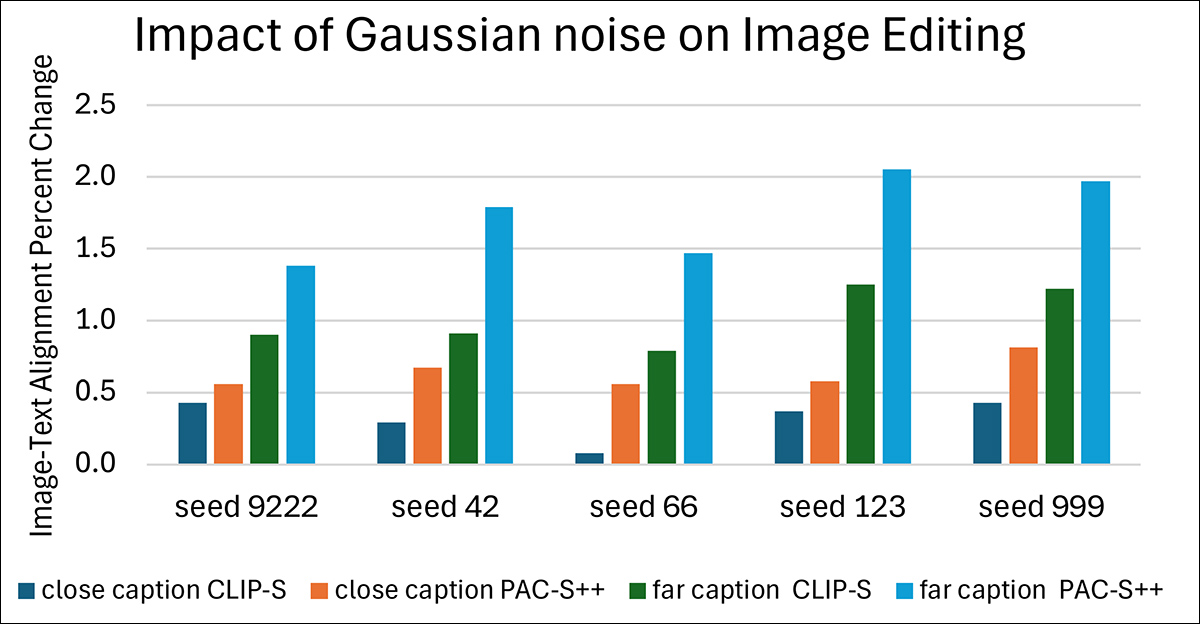

Нарешті, автори провели тест, який замінив ретельно створені порушення з паперу ‘Raising the Cost of Malicious AI-Powered Image Editing’ на чистий гауссовський шум.

Результати слідували тому ж шаблону, що й раніше: у всіх тестах значення відсоткової зміни залишалися позитивними. Навіть цей випадковий, неструктурований шум призвів до сильнішої відповідності між згенерованими зображеннями та інструкціями.

Ефект симульованого захисту, використовуючи гауссовський шум на наборі даних Flickr8k.

Це підтвердило основне пояснення, що будь-який доданий шум, незалежно від його конструкції, створює більшу невизначеність для моделі під час генерації, дозволяючи текстовій інструкції мати ще більший контроль над кінцевим зображенням.

Висновок

Дослідницька сцена штовхала адверсарні порушення на проблему авторських прав LDM майже так довго, як LDM існують; але не з’явилося жодного стійкого рішення з величезної кількості опублікованих робіт на цю тему.

Або нав’язані порушення надмірно знижують якість зображення, або моделі виявляються нестійкими до маніпуляцій і трансформаційних процесів.

Однак, це важка мрія, яку потрібно відмовитися, оскільки альтернативою здається сторонній моніторинг і рамки походження, такі як схема C2PA, очолювана Adobe, яка намагається підтримувати ланцюг зберігання для зображень від датчика камери, але яка не має внутрішньої зв’язку з зображуваним контентом.

У будь-якому випадку, якщо адверсарні порушення насправді роблять проблему гіршою, як вказує нова робота, то чи можна вважати пошук захисту авторських прав через такі засоби «алхімією».

Перша публікація понеділка, 9 червня 2025