Штучний інтелект

Генерація парафраз за допомогою глибокого навчання з підкріпленням – лідери думок

Коли ми пишемо або говоримо, усі ми колись задумувалися, чи є кращий спосіб передати ідею іншим. Які слова мені використовувати? Як структурувати думку? Як вони, ймовірно, відреагують? У Phrasee ми багато часу думаємо про мову – що працює, а що ні.

Представіть собі, що ви пишете тему електронної кампанії, яка буде надіслана 10 мільйонам людей у вашому списку, що пропагує знижку 20% на новий ноутбук.

Який рядок ви вибере?

- Тепер ви можете отримати додаткову знижку 20% на свій наступний замовлення

- Готуйтеся – додаткова знижка 20%

Хоча вони передають одну й ту ж інформацію, один досяг майже на 15% вищого рівня відкриття, ніж інший (і я ставлю на те, що ви не можете перемогти нашу модель у передбаченні, який із них? ). Хоча мову часто можна тестувати за допомогою A/B-тестування або багаторукого бандита, автоматичне генерація парафраз залишається дуже складною науковою проблемою.

Два речення вважаються парафразами одне одного, якщо вони мають однаковий зміст і можуть бути використані взаємозамінно. Інша важлива річ, яку часто приймають як належне, – це те, чи є речення, згенероване машиною, витонченим.

На відміну від наглядового навчання, агенти навчання з підкріпленням (RL) вчаться, взаємодіючи зі своєю середовищем і спостерігаючи за нагородами, які вони отримують у результаті. Ця дещо нюансова різниця має великі наслідки для того, як працюють алгоритми та як тренуються моделі. Глибоке навчання з підкріпленням використовує нейронні мережі як апроксиматор функції, щоб дозволити агенту вивчити, як перевершити людей у складних середовищах, таких як Go, Atari та StarCraft II.

Незважаючи на цей успіх, навчання з підкріпленням не було широко застосовано до реальних проблем, включаючи обробку природної мови (NLP).

У рамках моєї магістерської дисертації з науки про дані ми демонструємо, як глибоке навчання з підкріпленням можна використовувати для перевершення методів наглядового навчання в автоматичній генерації парафразів вхідного тексту. Проблема генерації найкращого парафразу можна розглядати як пошук серії слів, які максимізують семантичну схожість між реченнями, зберігаючи при цьому витонченість у виведенні. Агенти RL добре підходять для пошуку найкращого набору дій для досягнення максимальної очікуваної нагороди в контрольованих середовищах.

На відміну від більшості проблем у машинному навчанні, найбільша проблема в більшості застосунків генерації природної мови (NLG) не полягає в моделюванні, а радше в оцінці. Хоча оцінка людини зараз вважається золотим стандартом у оцінці NLG, вона має суттєві недоліки, включаючи те, що вона дорога, тривала, складна для налаштування та не має репродуктивності в експериментах та наборах даних (Han, 2016). Як результат, дослідники вже давно шукають автоматичні метрики, які були б простими, узагальненими та відображали б людську думку (Papineni et al., 2002).

Найпоширеніші автоматичні методи оцінки при оцінці автоматично згенерованих підписів до зображень підсумовуються нижче з їхніми плюсами та мінусами:

Генерація парафраз за допомогою навчання з підкріпленням: конвеєр

Ми розробили систему під назвою ParaPhrasee, яка генерує парафрази високої якості. Система складається з кількох етапів для застосування навчання з підкріпленням у обчислювально ефективному порядку. Короткий підсумок високорівневого конвеєра наведено нижче з більш докладною інформацією у дисертації.

Набір даних

Існує кілька наборів даних парафраз, доступних для досліджень, включаючи: корпус парафраз Microsoft, змагання ACL з семантичної схожості тексту, дублікат питань Quora та спільні посилання Twitter. Ми обрали MS-COCO через його розмір, чистоту та використання як еталон для двох відомих робіт з генерації парафраз. MS-COCO містить 120 тисяч зображень звичайних сцен з 5 підписами до зображення, наданими 5 різними людьми-анотаторами.

Хоча він в основному призначений для досліджень у галузі комп’ютерного зору, підписи до зображень мають високу семантичну схожість і є цікавими парафразами. Оскільки підписи до зображень надані різними людьми, вони мають дрібні відмінності у деталях, наданих у сцені, тому згенеровані речення схильні до галюцинацій.

Наглядована модель

Хоча навчання з підкріпленням значно покращилось у плані зразкової ефективності, часу навчання та загальних найкращих практик, навчання моделей RL з нуля все ще порівняно дуже повільне та нестабільне (Arulkumaran et al., 2017). Тому, замість навчання з нуля, ми спочатку тренуємо наглядовану модель, а потім донастраємо її за допомогою RL.

Ми використовуємо фреймворк кодувача-дешифрувача та оцінюємо продуктивність декількох базових наглядованих моделей. При донастроюванні моделі за допомогою RL ми донастраємо лише мережу дешифрувача та вважаємо мережу кодувача статичною. Таким чином, ми розглядаємо два основних фреймворки:

- Тренування наглядованої моделі з нуля за допомогою стандартної/ванільної моделі кодувача-дешифрувача з GRU

- Використання попередньо тренованих моделей вкладення речень для кодувача, включаючи: пуловані вкладення слів (GloVe), InferSent та BERT

Наглядовані моделі схильні демонструвати досить схожу продуктивність у всіх моделях, причому BERT та ванільний кодувач-дешифрувач досягають найкращої продуктивності.

Хоча продуктивність схильна бути прийнятною, існують три поширені джерела помилок: заїкання, генерація фрагментів речень та галюцинації. Це основні проблеми, які використання RL намагається вирішити.

Модель навчання з підкріпленням

Реалізація алгоритмів RL дуже складна, особливо коли ви не знаєте, чи можна розв’язати проблему. Можуть бути проблеми у реалізації вашого середовища, вашого агента, ваших гіперпараметрів, вашої функції нагороди або будь-якої їхньої комбінації! Ці проблеми загострюються, коли ви робите глибоке навчання з підкріпленням, оскільки ви отримуєте додаткову складність відладки нейронних мереж.

Як і при будь-якій відладці, важливо починати просто. Ми реалізували варіанти двох добре зрозумілих іграшкових середовищ RL (CartPole та FrozenLake), щоб протестувати алгоритми RL та знайти повторювану стратегію для перенесення знань з наглядованої моделі.

Ми виявили, що використання алгоритму актора-критика перевершує REINFORCE у цих середовищах. У плані перенесення знань до моделі актора-критика ми виявили, що ініціалізація ваг актора за допомогою тренованої наглядованої моделі та попереднє тренування критика досягають найкращої продуктивності. Ми виявили, що узагальнення складних підходів до дистиляції політики до нових середовищ досить складне, оскільки вони вводять багато нових гіперпараметрів, які потрібно налаштувати для роботи.

Підтримані цими знаннями, ми потім приступаємо до розробки підходу для завдання генерації парафраз. Ми спочатку повинні створити середовище.

Середовище дозволяє нам легко протестувати вплив використання різних метрик оцінки як функцій нагороди.

Ми потім визначаємо агента, оскільки він має багато переваг, ми використовуємо архітектуру актора-критика. Актор використовується для вибору наступного слова у послідовності та має свої ваги, ініціалізовані за допомогою наглядованої моделі. Критик надає оцінку очікуваної нагороди, яку стан, ймовірно, отримає, щоб допомогти актору вивчити.

Проектування правильної функції нагороди

Найважливішим компонентом проекту системи RL є функція нагороди, оскільки це те, чого агент RL намагається оптимізувати. Якщо функція нагороди неправильна, то результати будуть поганими, навіть якщо кожна інша частина системи працює!

Класичний приклад цього – CoastRunners, де дослідники OpenAI встановили функцію нагороди як максимізацію загального рахунку, а не перемогу в гонці. Результатом цього стало те, що агент виявив петлю, де він міг отримати найвищий рахунок, вдаряючи по турбо без завершення гонки.

https://www.youtube.com/watch?time_continue=2&v=tlOIHko8ySg&feature=emb_title

Оскільки оцінка якості парафраз сама по собі є нерозв’язаною проблемою, проектування функції нагороди, яка автоматично захоплює цю мету, ще складніше. Більшість аспектів мови не розкладаються добре на лінійні метрики та залежать від завдання (Novikova et al., 2017).

Агент RL часто виявляє цікаву стратегію для максимізації нагород, яка використовує слабкості у метриці оцінки, а не генерує високоякісний текст. Це схильне призводити до поганої продуктивності на метриках, яких агент не оптимізує безпосередньо.

Ми розглядаємо три основні підходи:

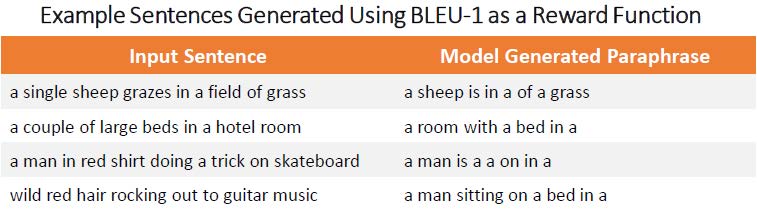

- Метрики перекриття слів

Звичайні метрики оцінки NLP розглядають частку перекриття слів між згенерованим парафразом та реченням оцінки. Чим більше перекриття, тим більша нагорода. Проблема з підходами на рівні слів полягає в тому, що агент включає занадто багато сполучних слів, таких як “а є на з”, і немає міри витонченості. Це призводить до дуже низькоякісних парафраз.

- Метрики схожості та витонченості на рівні речень

Основними властивостями згенерованого парафразу є те, що він повинен бути витонченим та семантично схожим на вхідне речення. Тому ми намагаємося явно оцінити ці показники окремо, а потім об’єднати метрики. Для семантичної схожості ми використовуємо косинусну схожість між вкладеннями речень з попередньо тренованих моделей, включаючи BERT. Для витонченості ми використовуємо оцінку, засновану на перплексії речення з GPT-2. Чим більша косинусна схожість та оцінка витонченості, тим більша нагорода.

Ми спробували багато різних комбінацій моделей вкладення речень та моделей витонченості, і хоча продуктивність була прийнятною, основною проблемою, з якою агент зіткнувся, було те, що він не достатньо балансував семантичну схожість з витонченістю. Для більшості конфігурацій агент пріоритезував витонченість, що призводило до видалення деталей та більшості сутностей, які розміщувалися “в центрі” чогось або переміщувалися “на стол” або “на сторону дороги”.

Мультиоб’єктне навчання з підкріпленням є відкритим науковим питанням і дуже складним у цьому випадку.

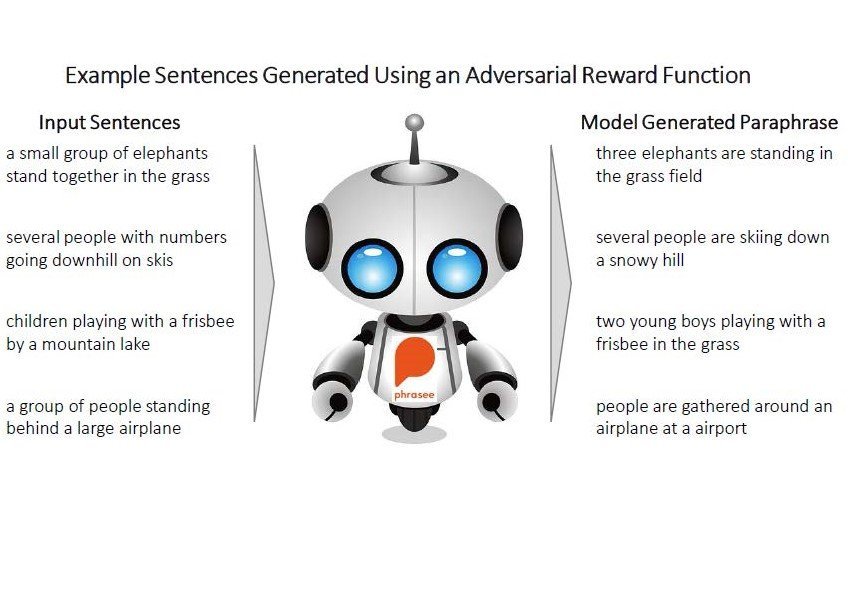

- Використання моделі-антагоніста як функції нагороди

Оскільки люди вважаються золотим стандартом у оцінці, ми тренуємо окрему модель, яку називають дискримінатором, для передбачення того, чи є два речення парафразами одне одного (подібно до того, як людина б це оцінила). Метою моделі RL є переконати цю модель у тому, що згенероване речення є парафразом вхідного. Дискримінатор генерує оцінку того, наскільки ймовірно, що два речення будуть парафразами одне одного, яка використовується як нагорода для тренування агента.

Кожні 5 000 спроб дискримінатору повідомляється, який парафраз походив з набору даних, а який був згенерований, щоб він міг покращити свої майбутні спроби. Процес триває протягом декількох раундів, при цьому агент намагається обманути дискримінатор, а дискримінатор намагається розрізнити згенеровані парафрази та парафрази з набору даних.

Після декількох раундів тренування агент генерує парафрази, які перевершують наглядовані моделі та інші функції нагороди.

Висновок та обмеження

Антагоністичні підходи (включаючи самограї для ігор) пропонують дуже перспективний підхід для тренування алгоритмів RL з метою перевершення людської продуктивності у певних завданнях без явного визначення функції нагороди.

Хоча RL було能够 перевершити наглядоване навчання в цьому випадку, додаткова накладність у плані коду, обчислень та складності не варто продуктивності, яку вона дає, для більшості застосунків. RL найкраще використовувати в ситуаціях, коли наглядоване навчання не можна легко застосувати, а функція нагороди легко визначається (наприклад, у іграх Atari). Підходи та алгоритми значно більш зрілі у наглядованому навчанні, а сигнал помилки значно сильніший, що призводить до значно швидшого та стабільнішого тренування.

Іншим фактором є те, що, як і у випадку з іншими нейронними підходами, агент може дуже драматично провалитися у випадках, коли вхідні дані відрізняються від тих, які він бачив раніше, що вимагає додаткового шару перевірок для застосунків у виробництві.

Виbuch інтересу до підходів RL та досягнень у сфері обчислювальної інфраструктури за останні кілька років розблокують величезні можливості для застосування RL у промисловості, особливо у сфері NLP.