Штучний інтелект

NeRF: Навчання Дронів у Нейронних Радіанних Середовищах

Дослідники з Стенфордського університету розробили новий спосіб навчання дронів навігації у фотореалістичних та високоточних середовищах, використовуючи недавній інтерес до Нейронних Радіанних Полів (NeRF).

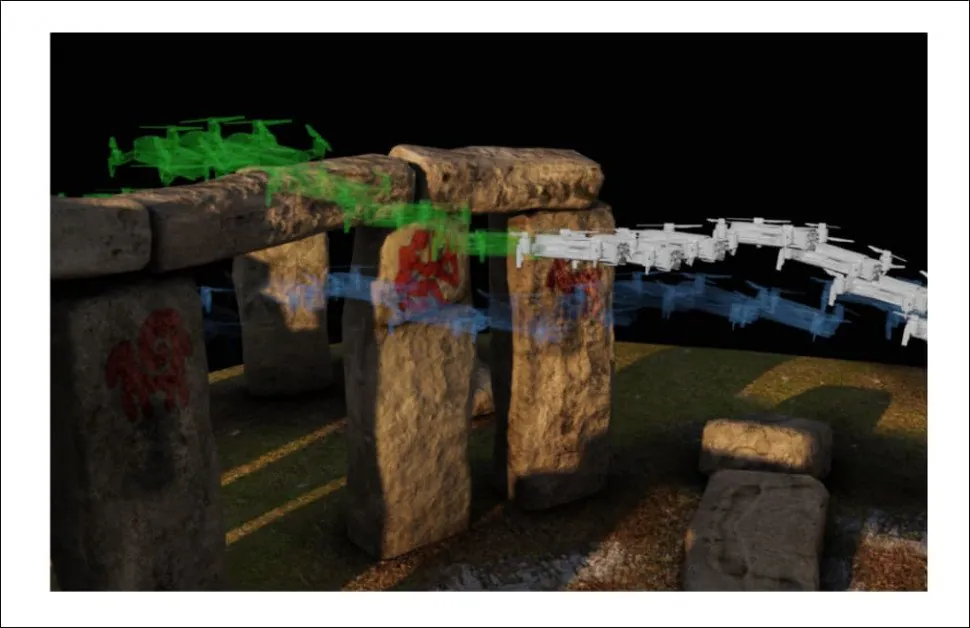

Дрони можуть бути навчені у віртуальних середовищах, відображених безпосередньо з реальних місць, без необхідності спеціалізованого 3D-сценарного реконструювання. На цьому зображенні з проекту додано порушення вітру як потенційна перешкода для дрону, і ми бачимо, як дрон тимчасово відхиляється від своєї траєкторії та компенсує в останній момент, щоб уникнути потенційної перешкоди. Source: https://mikh3x4.github.io/nerf-navigation/

Метод пропонує можливість інтерактивного навчання дронів (або інших типів об’єктів) у віртуальних сценаріях, які автоматично включають об’ємну інформацію (для розрахунку уникнення зіткнень), текстурування, взяте безпосередньо з реальних фотографій (для допомоги у навчанні дронів розпізнаванню зображень у більш реалістичній формі), та реальне освітлення (для забезпечення різноманітних освітніх сценаріїв та уникнення надмірної оптимізації до оригінального знімку сцени).

Об’єкт-кровать навігації у складному віртуальному середовищі, яке було б дуже складно відобразити за допомогою геометричної захоплення та перефарбовування у традиційних AR/VR-потоках, але яке було автоматично відтворено у NeRF з обмеженої кількості фотографій. Source: https://www.youtube.com/watch?v=5JjWpv9BaaE

Типові реалізації NeRF не мають траєкторних механізмів, оскільки більшість проектів NeRF за останні 18 місяців зосередилися на інших викликах, таких як сцена перезапису, відображення відбитків, композиція та розкладання захоплених елементів.

NeRF як VR/AR

Нова праця називається Навігація роботів тільки за допомогою зору у світі Нейронних Радіанних Полів і є співробітництвом між трьома кафедрами Стенфордського університету: Аеронавтики та Астронавтики, Механічної Інженерії та Комп’ютерних Наук.

NeRF не є (справді) CGI

Оскільки середовище NeRF є навігаційною 3D-сценою, це стало неправильно зрозумілою технологією з моменту її появи у 2020 році, часто сприймається як метод автоматизованого створення мешів та текстур, а не заміни 3D-середовищ, знайомих глядачам з відділів візуальних ефектів Голлівуду та фантастичних сцен Augmented Reality та Virtual Reality середовищ.

NeRF витягує геометричну та текстурну інформацію з обмеженої кількості зображень, розрахованої як об’ємна інформація. Source: https://www.matthewtancik.com/nerf

Семантичне сегментування

Навіть якщо NeRF ефективно складається з ‘Комп’ютерної Графіки’ (CGI), це пропонує цілком іншу методологію та високоавтоматизований потік. Крім того, NeRF може ізолювати та ‘запакувати’ рухомі частини сцени, щоб вони могли бути додані, видалені, прискорені та загалом діяти як окремі аспекти у віртуальному середовищі – можливість, яка значно перевершує сучасний стан справ у ‘голлівудському’ тлумаченні того, що таке CGI.

Співробітництво від Шанхайського Технологічного Університету, випущене улітку 2021 року, пропонує метод індивідуалізації рухомих елементів NeRF у ‘вставні’ аспекти сцени. Source: https://www.youtube.com/watch?v=Wp4HfOwFGP4