Штучний Інтелект

NeRF: тренування дронів у середовищах нейронного випромінювання

Дослідники зі Стенфордського університету винайшли новий спосіб навчання дронів орієнтуванню в фотореалістичному та високоточному середовищі, використовуючи нещодавні лавина інтересу у полях нейронного випромінювання (NeRF).

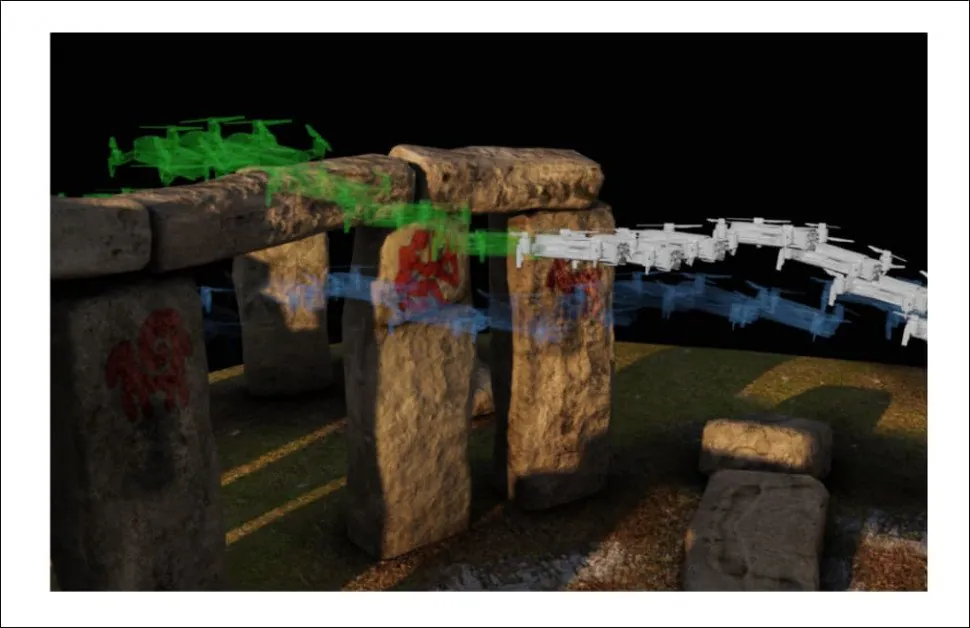

Дрони можна навчати у віртуальних середовищах, нанесених на карту безпосередньо з реальних місць, без необхідності спеціальної 3D-реконструкції сцени. На цьому зображенні проекту вітер додано як потенційну перешкоду для дрона, і ми бачимо, як дрон миттєво відхиляється від траєкторії та компенсує це в останній момент, щоб уникнути потенційної перешкоди. Джерело: https://mikh3x4.github.io/nerf-navigation/

Метод пропонує можливість інтерактивного навчання дронів (або інших типів об’єктів) у віртуальних сценаріях, які автоматично включають інформацію про обсяг (для розрахунку уникнення зіткнень), текстурування, намальоване безпосередньо з реальних фотографій (щоб допомогти навчити мережі розпізнавання зображень дронів у більш реалістичний спосіб) і освітлення в реальному світі (щоб забезпечити адаптацію різноманітних сценаріїв освітлення до мережі, уникаючи надмірної адаптації або надмірної оптимізації оригінального знімка сцени).

Диван-об’єкт переміщається у складному віртуальному середовищі, яке було б дуже важко відобразити за допомогою захоплення геометрії та ретекстурування в традиційних робочих процесах AR/VR, але яке було автоматично відтворено в NeRF з обмеженої кількості фотографій. Джерело: https://www.youtube.com/watch?v=5JjWpv9BaaE

Типові реалізації NeRF не містять механізмів траєкторії, оскільки більшість проектів NeRF за останні 18 місяців були зосереджені на інших викликах, таких як переосвітлення сцени, рендеринг відображення, Компостування та розплутування захоплених елементів. Тому основною інновацією в новому документі є впровадження середовища NeRF як навігаційного простору без великого обладнання та трудомістких процедур, які були б необхідні для моделювання його як 3D-середовища на основі захоплення датчиків і реконструкції CGI.

NeRF як VR/AR

Новий папір має титул Робот-навігатор лише для зору у світі нейронного випромінювання, і є результатом співпраці між трьома відділами Стенфордського університету: аеронавтики та астронавтики, машинобудування та комп’ютерних наук.

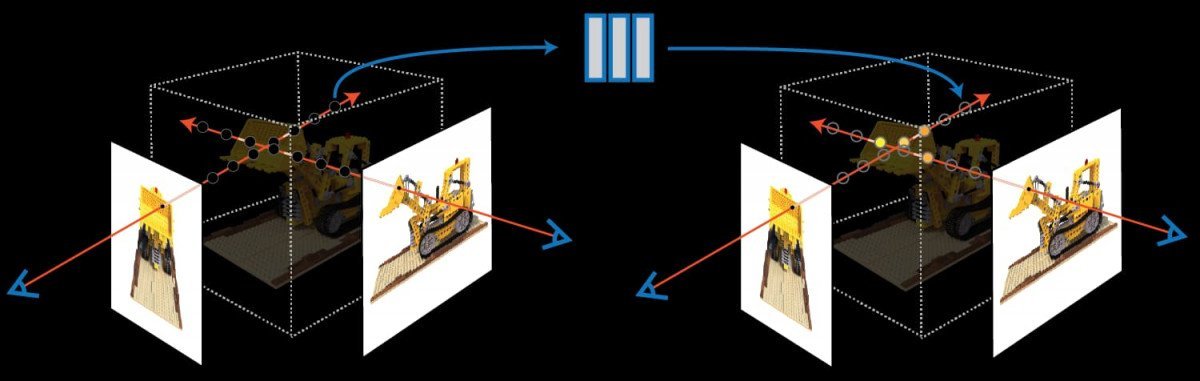

У роботі пропонується навігаційна структура, яка забезпечує робота попередньо навченим середовищем NeRF, об’ємна щільність якого розмежовує можливі шляхи для пристрою. Він також містить фільтр для оцінки того, де знаходиться робот у віртуальному середовищі, на основі розпізнавання зображень вбудованої RGB-камери робота. Таким чином дрон або робот може точніше «галюцинувати», що він може очікувати побачити в певному середовищі.

Оптимізатор траєкторії проекту переміщується через NeRF-модель Стоунхенджа, яка була згенерована за допомогою фотограмметрії та інтерпретації зображень (у цьому випадку сітчастих моделей) у середовищі Neural Radiance. Планувальник траєкторії розраховує кілька можливих шляхів перед встановленням оптимальної траєкторії над аркою.

Оскільки середовище NeRF містить повністю змодельовані оклюзії, дрон може легше навчитися розраховувати перешкоди, оскільки нейронна мережа, що стоїть за NeRF, може відображати зв’язок між оклюзіями та тим, як бортові навігаційні системи дрона сприймають середовище. Автоматизований конвеєр створення NeRF пропонує відносно тривіальний метод створення гіперреальних навчальних просторів лише з кількома фотографіями.

Платформа онлайнового перепланування, розроблена для Стенфордського проекту, забезпечує стійкий і повністю заснований на баченні конвеєр навігації.

Стенфордська ініціатива є однією з перших, хто розглядає можливості дослідження простору NeRF у контексті навігаційного середовища у стилі VR. Поля нейронного випромінювання є новою технологією, яка наразі є предметом багатьох наукових зусиль для оптимізації високих вимог до обчислювальних ресурсів, а також для роз’єднання захоплених елементів.

Nerf (справді) не є CGI

Оскільки середовище NeRF є навігаційною 3D-сценою, з моменту появи в 2020 році це стало неправильно зрозумілою технологією, яка часто сприймається як метод автоматизації створення сіток і текстур, а не як заміна 3D-середовища, знайомого глядачам із голлівудських відділів VFX і фантастичні сцени середовищ доповненої реальності та віртуальної реальності.

NeRF витягує інформацію про геометрію та текстуру з дуже обмеженої кількості точок огляду зображення, обчислюючи різницю між зображеннями як об’ємну інформацію. Джерело: https://www.matthewtancik.com/nerf

Насправді середовище NeRF більше схоже на «живий» простір візуалізації, де об’єднання інформації про пікселі та освітлення зберігається та переміщується в активній та працюючій нейронній мережі.

Ключ до потенціалу NeRF полягає в тому, що для відтворення середовища потрібна лише обмежена кількість зображень, а згенероване середовище містить усю необхідну інформацію для високоточної реконструкції без потреби в послугах модельєрів, текстуристів, освітлювачів. спеціалістів та орди інших учасників «традиційної» CGI.

Семантична сегментація

Навіть якщо NeRF фактично являє собою «комп’ютерно створені зображення» (CGI), він пропонує зовсім іншу методологію та високоавтоматизований конвеєр. Крім того, NeRF може ізолювати та «інкапсулювати» рухомі частини сцени, щоб їх можна було додавати, видаляти, пришвидшувати та загалом працювати як окремі аспекти у віртуальному середовищі – можливість, яка значно перевищує поточний стан the-art у «голлівудській» інтерпретації того, що таке CGI.

A співробітництво від Шанхайського технічного університету, випущений влітку 2021 року, пропонує метод індивідуалізації рухомих елементів NeRF у «вставляються» грані для сцени. Джерело: https://www.youtube.com/watch?v=Wp4HfOwFGP4

З іншого боку, архітектура NeRF є трохи «чорним ящиком»; наразі неможливо витягнути об’єкт із середовища NeRF і безпосередньо маніпулювати ним за допомогою традиційних інструментів на основі сітки та зображень, хоча низка дослідницьких зусиль починає робити прорив у деконструкції матриці, що лежить в основі середовищ рендерингу нейронної мережі NeRF.