Штучний Інтелект

NeRF робить ще один крок ближче до заміни CGI

Дослідники з Массачусетського технологічного інституту та Google зробили великий крок у розв’язанні однієї з найбільш фундаментальних перешкод для нової технології на основі штучного інтелекту, яка з часом може замінити CGI – розділення зображень поля нейронного випромінювання (NeRF) на складові візуальні компоненти, щоб зображення могли бути повторно текстурованими та повторно освітленими.

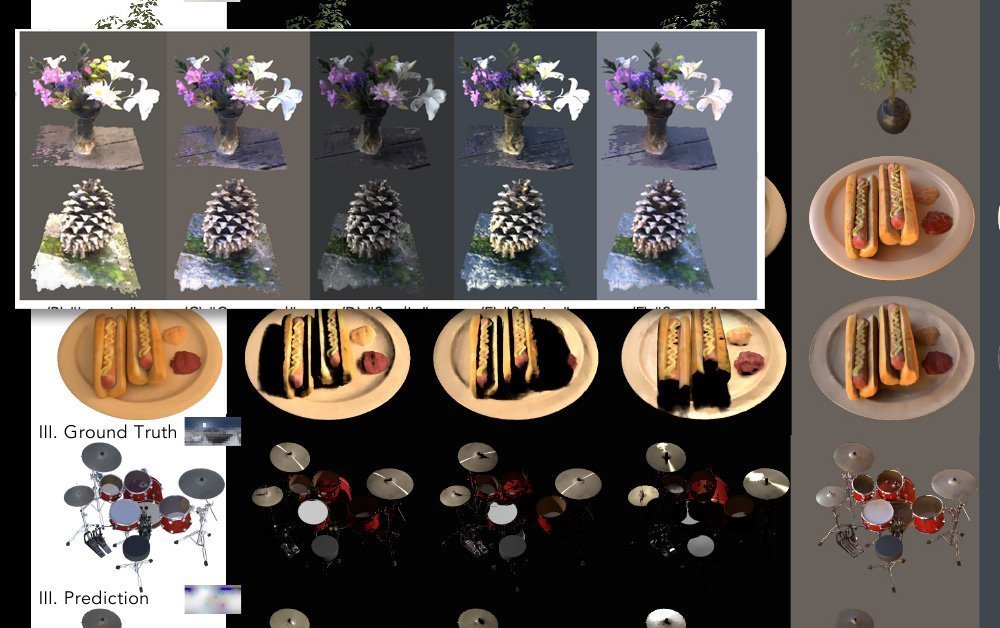

Новий підхід, наз NeRFactor, ефективно розділяє отримані зображення на нормалі для кожного об’єкта (до яких можна призначити текстури), видимість світла, альбедо (частка падаючого світла, яке відбивається від поверхні) і функції розподілу двонаправленого відбиття (BRDF).

Із ізольованими фасетами можна не лише перемикати текстури для окремих об’єктів або груп об’єктів, а й додавати нові та унікальні джерела освітлення та реалізацію тіней, не враховуючи будь-які, які були зняті масивами з кількох камер, які генерують вхідні дані для зображень NeRF.

Норми, видимість, альбедо та BRDF, розділені за NeRFactor. Джерело: https://www.youtube.com/watch?v=UUVSPJlwhPg

Модель підтримує м’які або жорсткі тіні від довільних джерел освітлення, визначених користувачем, і програмно розділяє чотири аспекти знятого відео, використовуючи втрати при реконструкції, дані попередніх обчислень BRDF і базову просту регулярізацію гладкості.

Робочий процес NeRFactor, який виділяє окремі активні аспекти зображень, отриманих із масивів кількох камер. Джерело: https://arxiv.org/pdf/2106.01970.pdf

NeRFactor використовує світловий зонд HDR, добре встановлений підхід, який пронизав візуальну індустріальну та мистецьку сцену з моменту введення у 1998 році, щоб оцінити можливі маршрути променів, що дозволяє довільне освітлення. Оскільки це генерує неконтрольоване число можливих параметрів, світловий зонд фільтрується через багатошаровий персептрон (MLP), який відображає сприйману геометрію на зонд без спроби обчислити повну карту об’єму освітлення для простору моделі.

Дві моделі поля нейронного випромінювання використовуються для демонстрації п’яти моделей освітлення, можливих у NeRFactor. Натисніть зображення для більшої роздільної здатності.

Привід для роздумів

Нове дослідження, можливо, є найважливішим у розділенні шарів захоплених зображень, які контролюють відображення. Це залишається однією з найбільших проблем для зображень полів нейронного випромінювання, оскільки справді нова та гнучка система NeRF потребуватиме не лише здатності замінювати текстури, але, що дуже важливо, потребуватиме певного способу відображення рухомих об’єктів (крім просто загального нерухомого середовища) які зазвичай враховуються в робочому процесі CGI.

Ця проблема нещодавно була помічена щодо Intel вражаючі нові дослідження у перетворенні кадрів відеоігор у фотореалістичне відео за допомогою згорткових нейронних мереж. У таких робочих процесах багато «запечених» аспектів вихідного матеріалу мали б стати дискретними та доступними для заміни, і це, мабуть, легше вирішити для повторного освітлення (що є функцією геометрії, що відображається в NeRF), ніж для відображень (які використовують ' геометрія поза екраном, яка повністю виходить за рамки моделі).

Таким чином, ізоляція шарів у відео NeRF, які сприяють відображенню, наближає NeRF на крок до вирішення своєї «проблеми відображення».

Використання середовища HDR вже вирішує проблему генерації відображень світового середовища (тобто неба, ландшафтів та інших «фіксованих» факторів навколишнього середовища), але для впровадження рухомих і динамічних відображень будуть потрібні нові підходи.

Фотограмметрія з NeRF

Зображення Neural Radiance Field використовують аналіз машинного навчання, щоб створити повністю об’ємний простір зі сцени або об’єкта, який було знято з кількох ракурсів.

Різноманітні схеми на основі NeRF, які з’явилися протягом останнього року, використовували різноманітну кількість пристроїв камери; деякі використовують 16 або більше камер, інші лише одну або дві. У всіх випадках проміжні точки зору «заповнюються» (тобто інтерпретуються), щоб можна було плавно переміщатися по сцені чи об’єкту.

Отримана сутність є повністю об’ємним простором із внутрішнім 3D-розумінням, яке можна використовувати багатьма способами, включаючи можливість генерувати традиційні CG-сітки з 3D-розібраної суми вхідних зображень.

NeRF в контексті «нової CGI»

Зображення поля нейронного випромінювання є звертається безпосередньо з зображень реального світу, включаючи рухомі зображення людей, предметів і сцен. Навпаки, методологія CGI «вивчає» та інтерпретує світ, вимагаючи кваліфікованих працівників для створення сіток, установок і текстур, які використовують зображення реального світу (тобто зображення обличчя та середовища). Це залишається по суті інтерпретаційним і кустарним підходом, який є дорогим і трудомістким.

Крім того, CGI має постійні проблеми з ефектом «таємничої долини» у своїх зусиллях відтворити людську схожість, що не є обмеженням для підходу, керованого NeRF, який просто знімає відео або зображення реальних людей і маніпулює ними.

Крім того, NeRF може генерувати традиційну геометрію сітки у стилі CGI безпосередньо з фотографій, якщо це необхідно, і фактично замінити багато ручних процедур, які завжди були необхідними для зображень, створених комп’ютером.

Виклики для NeRF

Це останнє дослідження Массачусетського технологічного інституту та Google з’явилося в контексті справжньої повені публікацій NeRF за останній рік, багато з яких пропонували рішення різноманітних проблем, пов’язаних із першою публікацією 2020 року.

У квітні інновація китайського дослідницького консорціуму забезпечила спосіб дискретно ізолювати окремі часові шкали аспектів у сцені NeRF, включаючи людей.

Китайське дослідження дозволяє кінцевим користувачам копіювати, вставляти та змінювати розмір захоплених елементів, відокремлюючи їх від лінійної шкали часу вихідного відео. Джерело: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Цей підхід не тільки дає змогу повторно уявити сцену з будь-якого кута, знятого масивом камер (а не лише один вид, представлений у типовому відеозйомці), але також дає можливість універсального компонування – і навіть здатності представляти два аспекти з того самого відзнятий матеріал, який відтворюється в окремих часових проміжках (або навіть у зворотному напрямку, якщо необхідно).

Китайське дослідження дозволяє кінцевим користувачам копіювати, вставляти та змінювати розмір захоплених елементів, відокремлюючи їх від лінійної шкали часу вихідного відео. Джерело: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Однією з найбільших проблем для NeRF є зменшення значних ресурсів, необхідних для підготовки сцени, і це було розглянуто в ряді останніх робіт. Наприклад, нещодавно представлений Інститут інтелектуальних систем імені Макса Планка КілоНеРФ, який не тільки прискорює час візуалізації в 1000 разів, але навіть дозволяє NeRF працювати в інтерактивному режимі.

KiloNeRF працює в інтерактивному середовищі зі швидкістю 50 кадрів/с на GTX 1080ti. Джерело: https://github.com/creiser/kilonerf

Проте швидкісна інновація NeRF, яка справді захопила уяву дослідників і громадськості у 2021 році, стала PlenOctrees співробітництво під керівництвом Каліфорнійського університету в Берклі, яке пропонує рендеринг полів нейронного випромінювання в реальному часі:

Ефект інтерактивних можливостей PlenOctrees було відтворено в a живий веб-інтерфейс.

Живе інтерактивне переміщення об’єкта PlenOctrees у Firefox (рух плавніший і динамічніший, ніж це зображення GIF). Джерело: http://alexyu.net/plenoctrees/demo/

Крім того, Рекурсивний-NeRF (зі статті дослідників з Університету Цінхуа за травень 2021 року) пропонує високоякісне рекурсивне відтворення на вимогу. Замість того, щоб зобов’язувати користувача відтворювати цілі сцени, включно з частинами, які можуть бути невидимі, Recursive-NeRF забезпечує щось схоже на стиснення із втратами JPEG і може генерувати окремі суб-NeRF для обробки додаткових зображень на вимогу, досягаючи значної економії обчислювальних ресурсів. .

Зберігаючи деталі, водночас видаляючи непотрібні обчислення візуалізації за допомогою Recursive-NeRF. Натисніть на зображення для більшої роздільної здатності. Джерело: https://arxiv.org/pdf/2105.09103.pdf

Інші підходи включають FastNeRF, який стверджує, що досягає високоякісного нейронного рендерингу зі швидкістю 200 кадрів в секунду.

Було зазначено, що багато методів оптимізації для NeRF включають «випікання» сцени, приділяючи увагу аспектам, які бажано відобразити, і відкидаючи інші аспекти, що обмежує дослідження, але значно прискорює інтерактивність.

Недоліком цього є те, що навантаження переноситься з графічного процесора на сховище, оскільки запечені сцени займають надмірну кількість дискового простору; до певної міри це можна пом’якшити шляхом зменшення дискретизації запечених даних, хоча це також передбачає певні зобов’язання з точки зору закриття шляхів дослідження чи інтерактивності.

Що стосується захоплення руху та монтажу, новий підхід від Чжейджанського та Корнельського університетів, розкрито у травні, запропонував метод відтворення анімованих людей за допомогою змішаних полів ваги та структур скелета, інтерпретованих із вхідного відео:

Похідна структура скелета в Animatable NeRF. Джерело: https://www.youtube.com/watch?v=eWOSWbmfJo4

Коли у NeRF буде момент «Парку Юрського періоду»?

Незважаючи на швидкий прогрес у синтезі зображень за допомогою нейронних полів випромінювання, лише в цей період буде встановлено будь-який «закон термодинаміки» щодо того, наскільки NeRF може стати розгортанням. З точки зору хронології, аналогічної історії CGI, NeRF зараз коливається приблизно в 1973 році, якраз перед Перше використання CGI в Westworld.

Це не означає, що NeRF обов’язково доведеться чекати дев’ять років на свій еквівалент Гнів Хана віхаабо десятиліття для подібних проривів, досягнутих CGI під патронатом Джеймса Кемерона в 1989 році Abyss або 1991 року Термінатор 2 – і тоді ця технологія справді революційна момент прориву в 1993 році Парк Юрського періоду.

Сцена зображення значно змінилася після тривалого періоду стагнації фотохімічних візуальних ефектів, які домінували у кіно- та телевиробництві від народження кіно до початку 1990-х років. Початок революції ПК і прискорення закону Мура призвели до революції CGI, яка інакше могла б відбутися ще в 1960-х роках.

Залишається з’ясувати, чи існує якийсь бар’єр, настільки непримиренний, що він міг би затримати прогрес NeRF на такий тривалий час – і чи можуть подальші інновації в комп’ютерному зорі тим часом повністю витіснити NeRF як ключового претендента на корону CGI, характеризуючи поля нейронного випромінювання. як короткочасний «факсовий апарат» нейронного синтезу зображень.

Поки що NeRF не використовувався в жодному контексті, окрім академічних досліджень; але варто відзначити, що великі гравці, такі як Google Research, і багато з найвидатніших дослідницьких лабораторій комп’ютерного зору змагаються за останній прорив NeRF.

Багато з найбільших перешкод NeRF почали безпосередньо вирішувати цього року; якщо подальші дослідження запропонують вирішення «проблеми відображення», а багато напрямків досліджень з оптимізації NeRF об’єднаються у вирішальне рішення для значних вимог технології до обробки та/або зберігання, NeRF справді має шанс стати «новою CGI». ' в наступні п'ять років.