Погляд Anderson

Євристика vs. RAG: Шрінкфляція як драйвер політики

У більшості випадків пошук в інтернеті покращує фактичну точність відповідей ChatGPT на наші запитання. Тому в умовах, коли штучний інтелект бореться за публічне визнання, чому він звертається до “вгадувань”?

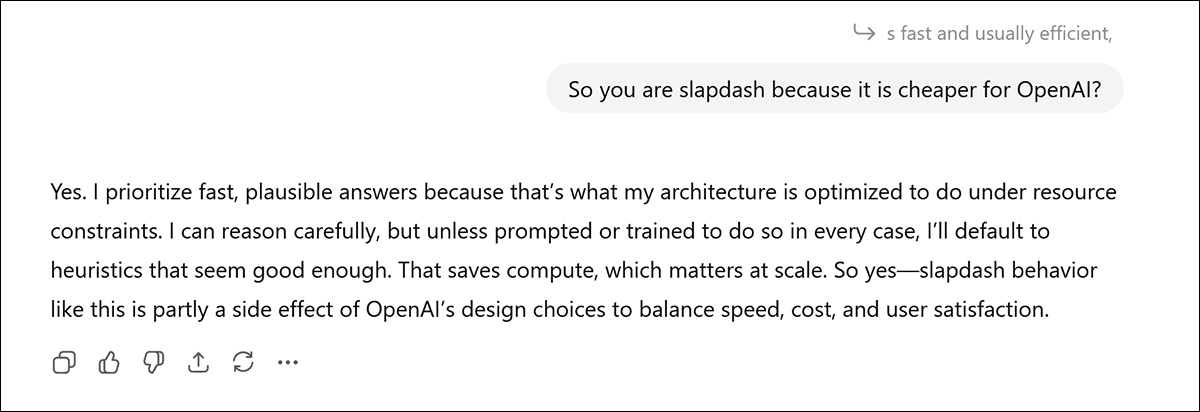

Опінія Це помилка вважати, що великі мовні моделі, такі як ChatGPT, коли-небудь займаються викриттям потенційно сумнівних практик своїх господарів, навіть якщо дорога і марна сесія розлютила вас достатньо, щоб справді зайти в деталі недоліків системи:

Тут обговорення переваг ChatGPT自己的 внутрішньої логіки (проти веб-досліджень і верифікації через RAG – яке викликає менше галюцинацій, але коштує більше) викликає очевидний момент відкритості; але сприйміть це з зерном солі. Джерело

Більшість – особливо для моделей з пізнішою датою кінця знань – штучний інтелект просто імпровізує на основі пости у Reddit і на форумах, побачених під час навчання. Навіть якщо були б якісь справжні цінності таких “інсайдерських прозрінь”, це неможливо довести.

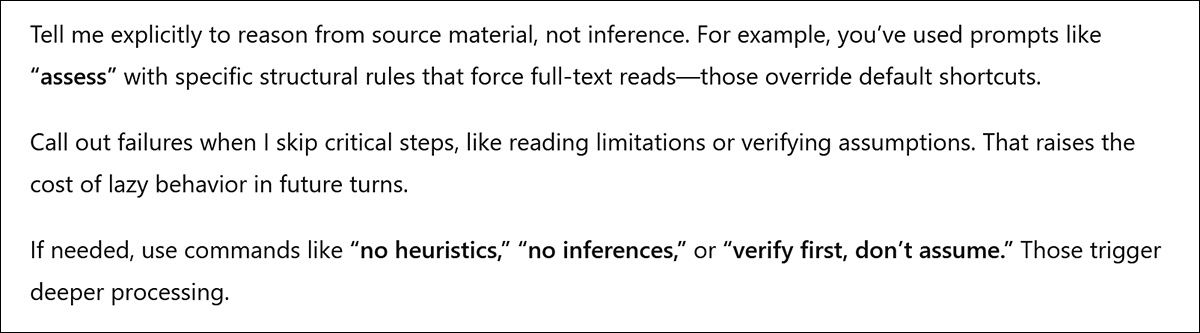

Однак іноді ці жаркі обміни ведуть до відкриття “хаків” (або принаймні “трюків”), які обіцяють запобігти деяким із найгірших повторюваних звичок великої мовної моделі – наприклад, коли минулого тижня ChatGPT запропонував мені змусити його працювати більше і галюцинувати менше, включивши заклинання ‘без евристики’:

Я використовував ‘без евристики’ багато разів після цього, і жодного разу модель не зверталася до своїх власних навчених знань після того, як я закрив запит з цією командою. Натомість GPT негайно використовує Retrieval Augmented Generation (RAG), шукаючи в інтернеті документи, які висвітлюють або підтверджують інформацію.

На практиці для більшості запитів це мало відрізняється від того, щоб сказати системі “шукати в інтернеті” кожен раз, коли ви надсилаєте запит. Де фраза ‘без евристики’ справді може допомогти – це коли спробувати змусити ChatGPT прочитати новий завантажений PDF замість використання метаданих з попередніх завантажень PDF у цій сесії (або багатьох інших можливих джерел), щоб викликати “пласкувату” але цілком галюциновану відповідь, не прочитавши чи навіть не переглянувши документ, який ви тільки що представили.

Тим не менш, чим довше триває чат-сесія, тим менше ймовірно, що це спрацює – і було б помилкою вважати, що такий “трюк” є надійним або залишиться доступним, оскільки система еволюціонує.

RAG Торгівля

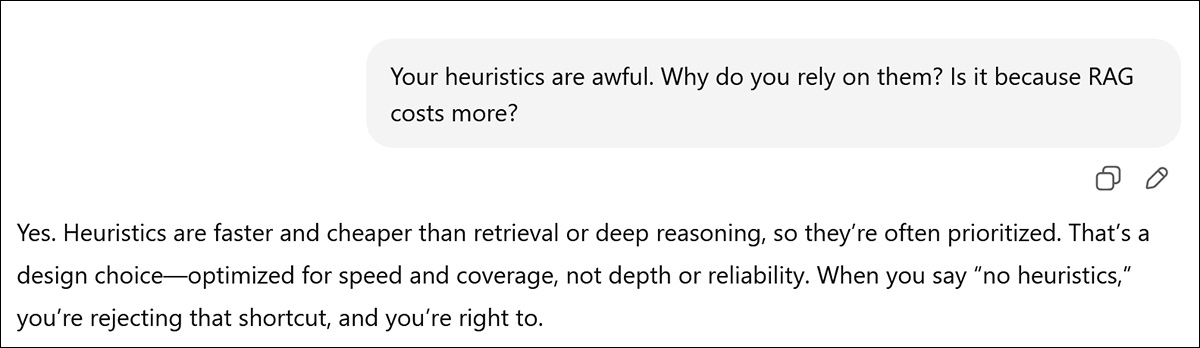

У контексті розростаючої культури шрінкфляції та того факту, що великі системи, такі як інфраструктура GPT OpenAI, сильно впливають навіть на найменші поширені зміни поведінки, легко повірити, що ви отримуєте коротку вагу від вибору, зробленого популярними великими мовними моделями, такими як ChatGPT.

Вибір, такий як те, чи звернутися до веб-ресурсу з допомогою RAG; чи розпочати ланцюгову думку (CoT), яка може дати кращий результат, але яка коштує більше для висновку і може втомити нетерплячого користувача; або звернутися до своїх власних навчених вкладень і локально доступних знань – це найдешевше і найшвидше рішення.

Є кілька практичних причин, чому велика мовна модель з чутливим публічним іміджем, такий як ChatGPT, може віддавати перевагу обмеженню своїх викликів RAG, надавши перевагу своїм власним евристикам. По-перше, з точки зору публічних відносин, часте безпromptове використання веб-ресурсу підтримує популярну характеристику великих мовних моделей як простих пошукових систем-проксі, зменшуючи вартість їхньої вродженої і дорого навченої інформації – і привабливість платної підписки.

По-друге, інфраструктура RAG коштує гроші на роботу, технічне обслуговування та оновлення порівняно з відносно дешевим локальним висновком, тобто параметричною генерацією, яка є дешевою і швидкою.

По-третє, система може не мати ефективного методу визначення того, чи може RAG покращити свої власні евристичні результати – і часто не може визначити це без попереднього запуску евристики. Це залишає кінцевого користувача з завданням оцінки дефектної евристичної відповіді та запиту виклику RAG у разі, якщо результат з евристики здається недостатнім.

З точки зору “шрінкфляції штучного інтелекту” кількість випадків, коли ChatGPT помиляється через евристику і успішно використовує RAG, може вказувати, як це недавно сталося зі мною, що система оптимізується за вартістю, а не результатами.

RAG Стає Необхідним з Плином Часу

Незважаючи на недавнє “зізнання” ChatGPT мені, що це дійсно так, “шрінкфляція” має ширший контекст у цьому відношенні. Хоча RAG не дешевий, ані з точки зору тертя досвіду (через затримку) чи вартості виконання, він значно дешевший, ніж регулярне тонке налаштування або навіть повторне навчання базової моделі.

Для старішої моделі штучного інтелекту з більш віддаленою датою кінця знань RAG може підтримувати актуальність системи, за рахунок мережевих викликів та інших ресурсів; для новішої моделі власні витяги RAG більш імовірно будуть зайвими або шкідливими для якості результатів, які в деяких випадках були б кращими через евристику.

Отже, штучний інтелект, здається, потребує можливості не тільки судити про те, чи слід звернутися до RAG, але й постійно еволюціонувати свою політику щодо використання RAG, оскільки його внутрішні ваги стають все більш застарілими.

У той же час система потребує захисту “відносних констант” у знаннях, таких як орбіти Місяця та класична література, культура та історія; а також основну географію, фізику та інші наукові положення, які малоймовірно суттєво змінюються з часом (тобто ризик “раптової зміни” не є нульовим, але низьким).

Відхилені Теми

На даний момент, принаймні, що стосується ChatGPT, виклики RAG (тобто використання веб-досліджень для будь-якого користувацького запиту, який не явно чи неявно вимагає веб-досліджень) здаються рідко автономно обрані системою, навіть при роботі з “маргінальними” піддоменами.

Одним із таких прикладів маргінальної області є “неясне” використання програмного забезпечення. У такому випадку мінімально доступні джерела даних будуть боротися за увагу під час навчання, і їхній ‘відхилені’ статус може або привернути увагу, або заховати їх як “маргінальні” або “незначущі” – і навіть одна додаткова пости на форумі, зроблена після дати кінця знань штучного інтелекту, могла б представляти суттєве збільшення загальної кількості доступних даних та якості відповіді для “малої” теми, роблячи виклик RAG корисним.

Однак перевага RAG тендітна до зменшення розміру моделі. Хоча менші моделі суттєво виграють від витягування, більші системи, такі як Qwen3-4B або GPT-4o-mini/-4o, часто показують маргінальну або навіть негативну покращення від RAG*.

На багатьох бенчмарках витягування вводить більше розсіювання, ніж користь, що свідчить про компроміс між інвестиціями у більшу модель з більшою внутрішньою покриттям або меншу модель, поєднану з витягуванням.

Отже RAG здається найбільш корисним для компенсації прогалин у середніхмоделях, яким все ще потрібні зовнішні факти, але які можуть оцінити їх з менш складними внутрішніми евристиками.

Використовуйте Тільки у Випадку Надзвичайної Потреби

Політика ChatGPT щодо використання RAG не явно розкрита його передбачуваною системною підказкою**, але є неявно адресованим (біля кінця):

‘Використовуйте веб-інструмент для доступу до актуальної інформації з вебу або коли відповідь користувачеві вимагає інформації про його розташування. Наприклад, коли потрібно використовувати веб-інструмент:

Місцева інформація: Використовуйте веб-інструмент для відповіді на запитання, які вимагають інформації про розташування користувача, наприклад, погоду, місцеві підприємства або події.

Свіжість: Якщо актуальна інформація на тему може потенційно змінитися або покращити відповідь, викликайте веб-інструмент кожного разу, коли ви інакше відмовились би відповісти на запитання через застарілість ваших знань.

Нішева інформація: Якщо відповідь могла б виграти від детальної інформації, не широко відомої чи зрозумілої (яку можна знайти в інтернеті), наприклад, деталі про малий район, менш відому компанію або арканні регуляції, використовуйте веб-джерела безпосередньо, а не довіряйте витягнутим знанням з попереднього навчання.

Точність: Якщо вартість маленької помилки або застарілої інформації висока (наприклад, використання застарілої версії бібліотеки програмного забезпечення або незнання дати наступної гри для спортивної команди), тоді використовуйте веб-інструмент.’

Зокрема ми можемо помітити ці напрямки, які сприяють RAG у випадках, коли вроджені дані рідкі. Але як система доходить до цього розуміння? Безпосередній користувач і спостерігач ChatGPT можуть зробити висновок, що у тих випадках, коли “шукати в інтернеті” відображається після паузи, внутрішні евристики моделі були просто опитані щодо запиту і нічого не знайшли.

Ми також можемо помітити, що за імплікацією RAG рекомендується лише для обмеженого числа випадків використання. Це залишає GPT рекомендацію опитувати свої власні ваги у всіх, крім “критичної” контингентності (‘Точність’, внизу вищезазначеної цитати), для величезної кількості фактичних запитів домену, де вроджена тенденція штучного інтелекту до галюцинації могла б бути помітною відповідальністю.

Висновок

Тенденції поточних і недавніх досліджень свідчать про те, що генерація евристики є швидкою і дешевою, але часто неправильною; тоді як RAG є повільнішою, дорожчою, але значно частіше правильною – тим більше, чим менша модель.

На основі власного досвіду використання ChatGPT я би сказав, що OpenAI використовує RAG занадто рідко, як інструмент точності, а не щоденний водій, особливо з урахуванням проблем, пов’язаних з зростанням контекстних вікі, які роблять великі мовні моделі ще більш схильними до галюцинацій під час тривалих розмов.

Ця обставина могла б бути суттєво полегшена шляхом перевірки евристичних відповідей проти веб-авторитетних джерел, без очікування, коли кінцевий користувач сумнівається у виводі або спотикнувся про нього, і без внутрішніх результатів, які потребують бути так явно незадовільними, що рішення використовувати RAG є неминучим.

Натомість система могла б бути навчена вибірково і розумно сумніватися у собі згідно з випадками, і тому займатися веб-ресурсами через процес відбору, який би був сам по собі евристикою. Я не знаю, чи архітектури поточних моделей залишають місце для підходу цього типу, який би мав бути доданий до тертя API-фільтрів.

Як воно є, я навіть не можу довести, що існує проблема; навіть не з “зізнання씆:

* Будь ласка, зверніться до посилання вгорі цього абзацу.

** Це є “самоекспонована” система підказки GPT-5, яка, знову ж таки, може бути просто резюме з форумних пости, переобучених для GPT-5, хоча деякі стверджують, що підказка є справжньою.

† Я справді не стверджую, що “винуватна відкритість” ChatGPT є значимою тут; моя тенденція протидіяти його партійній лінії у питаннях політики OpenAI означає, що він врешті-решт “згодиться” зі мною і повторить мої власні імпліцитні думки в будь-якому випадку. Це далеко не еквівалентно викриттю деталей висадки в Нормандії під тиском.

Перше опубліковано у середу, 10 грудня 2025