Штучний Інтелект

GOTCHA – система CAPTCHA для Live Deepfakes

Нове дослідження Університету Нью-Йорка доповнює зростаючу кількість ознак того, що незабаром нам, можливо, доведеться проходити еквівалент «тесту на стан алкогольного сп’яніння», щоб підтвердити свою автентичність перед початком конфіденційного відеодзвінка – наприклад, відеоконференції, пов’язаної з роботою, або будь-якого іншого. інший чутливий сценарій, який може привернути увагу шахраїв дипфейк у реальному часі потокове програмне забезпечення.

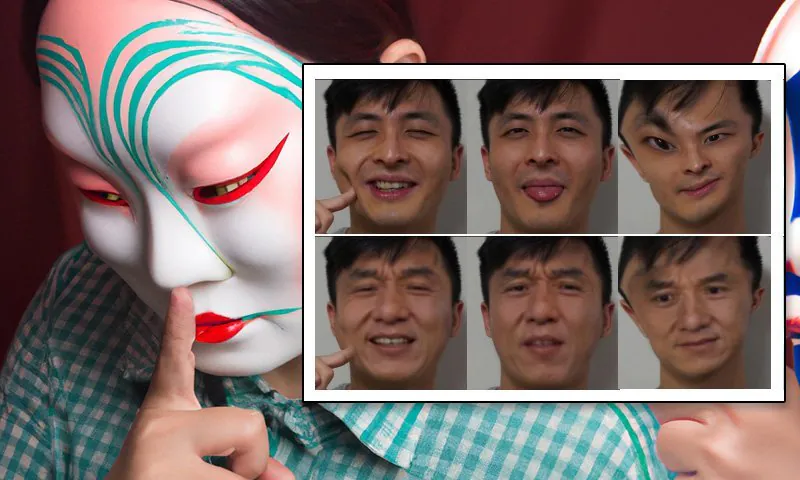

Деякі активні та пасивні виклики, застосовані до сценаріїв відеодзвінків у GOTCHA. Користувач повинен відповідати та проходити виклики, тоді як використовуються додаткові «пасивні» методи (такі як спроба перевантажити потенційну глибоку фейкову систему), на які учасник не має впливу. Джерело: http://export.arxiv.org/pdf/2210.06186

Запропонована система називається GOTCHA – це данина системам CAPTCHA, які за останні 10-15 років стали все більшою перешкодою для перегляду веб-сторінок, де автоматизовані системи вимагають від користувача виконання завдань, з якими машини погано справляються, наприклад визначення тварин. або розшифрування спотвореного тексту (і, як не дивно, ці проблеми часто перетворюють користувача на вільний AMT-стиль зовнішнього анотатора).

По суті, GOTCHA подовжує серпень 2022 року DF-Captcha стаття Університету Бен-Гуріона, яка першою запропонувала змусити особу на іншому кінці розмови проскочити через кілька візуально семантичних обручів, щоб довести свою автентичність.

У документі Університету Бен-Гуріона від серпня 2022 року вперше запропоновано ряд інтерактивних тестів для користувача, включно з оклюзією обличчя або навіть натисканням на шкіру – завдання, які навіть добре навчені живі системи deepfake, можливо, не передбачили або не змогли впоратися з фотореалістичним способом. . Джерело: https://arxiv.org/pdf/2208.08524.pdf

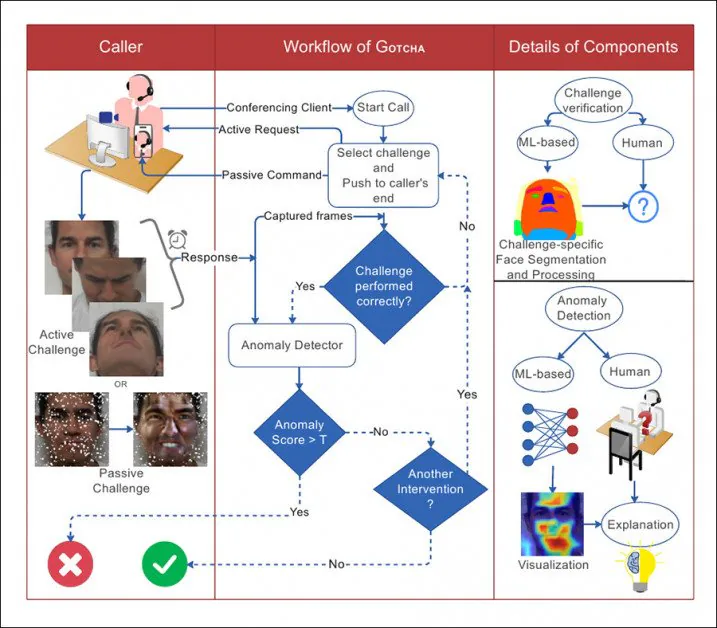

Зокрема, GOTCHA додає «пасивні» методології до «каскаду» запропонованих тестів, включаючи автоматичне накладання нереальних елементів на обличчя користувача та «перевантаження» кадрів, що проходять через вихідну систему. Однак можна оцінювати лише завдання, які реагують на користувача, без спеціальних дозволів на доступ до локальної системи користувача, які, імовірно, надходитимуть у формі локальних модулів чи доповнень до популярних систем, таких як Skype і Zoom, або навіть у форма спеціального пропрієтарного програмного забезпечення, спеціально призначеного для відсівання фальсифікаторів.

На папері зображено взаємодію між абонентом і системою в GOTCHA з пунктирними лініями, як процес прийняття рішень.

Дослідники перевірили систему на новому наборі даних, що містить понад 2.5 м відеокадрів від 47 учасників, кожен з яких виконував 13 завдань від GOTCHA. Вони стверджують, що фреймворк викликає «послідовне та вимірюване» зниження якості контенту deepfake для користувачів-шахраїв, напружуючи локальну систему, поки очевидні артефакти не зроблять обман очевидним для неозброєного людського ока (хоча GOTCHA також містить деякі більш тонкі алгоритмічні методи аналізу).

Команда новий папір має титул Gotcha: система реагування на виклики для виявлення Deepfeke у реальному часі (назва системи написана з великої літери, але не назва публікації, хоча це не абревіатура).

Низка викликів

Здебільшого відповідно до статті Бен-Гуріона фактичні виклики, з якими стикається користувач, поділяються на кілька типів завдань.

для оклюзія, від користувача вимагається або закрити своє обличчя рукою, або іншими об’єктами, або представити своє обличчя під кутом, який, ймовірно, не був навчений у моделі deepfake (зазвичай через відсутність навчальних даних для ' дивні пози – дивіться діапазон зображень на першій ілюстрації вище).

Окрім дій, які користувач може виконувати самостійно відповідно до інструкцій, GOTCHA може накладати випадкові вирізи на обличчі, наклейки та фільтри доповненої реальності, щоб «пошкодити» потік обличчя, який може очікувати місцева навчена модель deepfake, спричиняючи його збій. . Як зазначалося раніше, хоча це «пасивний» процес для користувача, він є нав’язливим для програмного забезпечення, яке має мати можливість безпосередньо втручатися в потік кінцевого кореспондента.

Далі від користувача може знадобитися створити незвичайний вираз обличчя, який, імовірно, відсутній або недостатньо представлений у будь-якому навчальному наборі даних, спричиняючи зниження якості результату deepfaked (зображення «b», другий стовпець зліва). , на першій ілюстрації вище).

У рамках цієї серії тестів користувачеві може знадобитися прочитати текст або розпочати розмову, розроблену для того, щоб кинути виклик локальній системі дипфейку в реальному часі, яка, можливо, не навчила достатнього діапазону фонем або інших типів даних рота до рівня де він може відтворити точний рух губ під таким пильним контролем.

Нарешті (і це, здавалося б, кидає виклик акторським талантам кінцевого кореспондента), у цій категорії користувача можуть попросити виконати мікроекспресію – короткий і мимовільний вираз обличчя, який заперечує емоції. Про це йдеться у виданні "[це] зазвичай триває 0.5-4.0 секунди, і його важко підробити".

Хоча в документі не описано, як витягти мікровираз, логіка підказує, що єдиний спосіб зробити це — створити відповідну емоцію в кінцевого користувача, можливо, за допомогою якогось приголомшливого вмісту, представленого їм у рамках тестової процедури. .

Спотворення обличчя, освітлення та Несподівані гості

Крім того, згідно з пропозиціями серпневої статті, нова робота пропонує попросити кінцевого користувача виконати незвичайні викривлення обличчя та маніпуляції, такі як натискання пальця на щоку, взаємодія з обличчям та/або волоссям та виконання інших рухи, з якими жодна поточна система deepfake, ймовірно, не зможе добре впоратися, оскільки це маргінальні дії – навіть якби вони були присутні в навчальному наборі даних, їхнє відтворення, ймовірно, було б низької якості, відповідно до інших «викидних» даних.

Посмішка, але це «пригнічене обличчя» погано перекладається місцевою системою дипфейку.

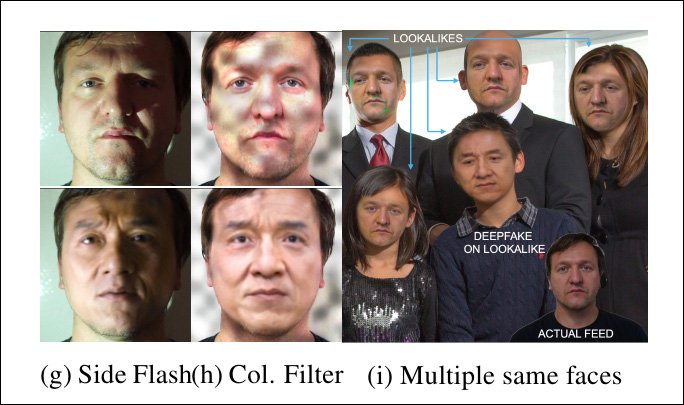

Додаткова проблема полягає в зміні умов освітлення, в яких знаходиться кінцевий користувач, оскільки можливо, що навчання моделі deepfake було оптимізовано для стандартних ситуацій освітлення відеоконференцій або навіть для точних умов освітлення, в яких відбувається виклик. .

Таким чином, користувача можуть попросити навести смолоскип свого мобільного телефону на своє обличчя або якимось іншим чином змінити освітлення (і варто зазначити, що цей прийом є центральною пропозицією ще один живий документ про виявлення deepfake які вийшли цього літа).

Системи дипфейку в прямому ефірі стикаються з несподіваним освітленням і навіть кількома людьми в потоці, де очікується лише одна особа.

У випадку запропонованої системи, яка має здатність втручатися в локальний потік користувачів (який підозрюється в приховуванні посередника deepfake), додавання неочікуваних шаблонів (див. середній стовпець на зображенні вище) може поставити під загрозу здатність алгоритму deepfake підтримувати симуляцію .

Крім того, хоча нерозумно очікувати, що кореспондент матиме під рукою додаткових людей, які допоможуть його автентифікувати, система може вставити додаткові обличчя (крайнє праве зображення вгорі) і перевірити, чи якась місцева система дипфейку робить помилку, переключаючи увагу – або навіть намагаючись підробити їх усіх (системи автоматичного кодування deepfake не мають можливостей «розпізнавання особи», які могли б утримувати увагу на одній особі в цьому сценарії).

Стеганографія та перевантаження

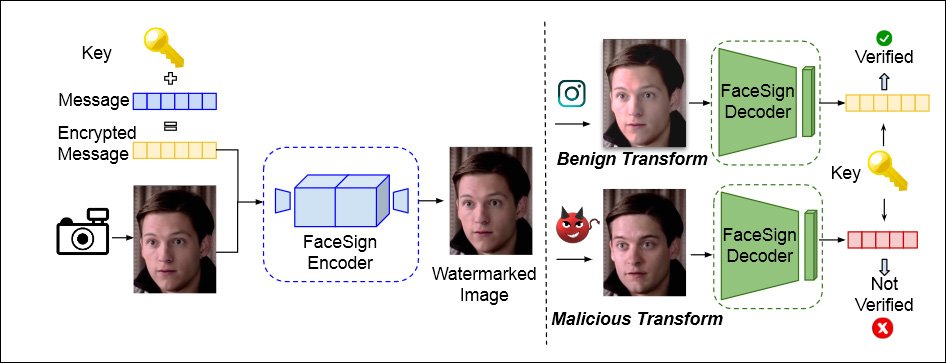

GOTCHA також включає підхід вперше запропоновано Каліфорнійським університетом у Сан-Дієго в квітні цього року, який використовує стеганографію для шифрування повідомлення в локальному відеопотоці користувача. Процедури Deepfake повністю знищать це повідомлення, що призведе до збою автентифікації.

Зі статті Каліфорнійського університету в Сан-Дієго та Університету штату Сан-Дієго від квітня 2022 року, метод визначення автентичної ідентичності шляхом визначення того, чи стеганографічний сигнал, надісланий у відеопотік користувача, переживає локальну петлю без змін – якщо це не так, глибока фейкова хитрість може бути під рукою. Джерело: https://arxiv.org/pdf/2204.01960.pdf

Крім того, GOTCHA здатний перевантажувати локальну систему (отримавши доступ і дозвіл), дублюючи потік і надаючи «надмірні» дані будь-якій локальній системі, створеній таким чином, щоб викликати збій реплікації в локальній системі deepfake.

Система містить додаткові тести (докладніше див. у документі), у тому числі виклик, у випадку кореспондента на смартфоні, перевернути свій телефон догори дном, що призведе до спотворення локальної системи deepfake:

Знову ж таки, подібні речі працюватимуть лише з переконливим варіантом використання, коли користувач змушений надати локальний доступ до потоку, і не можуть бути реалізовані простою пасивною оцінкою відео користувача, на відміну від інтерактивних тестів (таких як натискання палець в обличчя).

Практичність

У статті коротко торкається того, якою мірою тести такого характеру можуть дратувати кінцевого користувача або якимось чином створювати йому незручності – наприклад, зобов’язуючи користувача мати під рукою ряд об’єктів, які можуть знадобитися для тестів, наприклад сонцезахисні окуляри.

Він також визнає, що може бути важко змусити потужних кореспондентів дотримуватись процедур тестування. Щодо випадку відеодзвінка з генеральним директором, автори зазначають:

«Значливість використання може бути тут ключовою, тому неформальні чи легковажні виклики (такі як спотворення міміки чи виразу обличчя) можуть бути недоречними. Проблеми з використанням зовнішніх фізичних статей можуть бути небажаними. Контекст тут належним чином змінено, і GOTCHA відповідно адаптує свій набір завдань».

Дані та тести

GOTCHA було протестовано на чотирьох штамах локальної системи глибоких фейків у прямому ефірі, включаючи дві варіації дуже популярного творця глибоких фейків автокодера DeepFaceLab («DFL», хоча, як не дивно, у статті не згадується DeepFaceLive, який був, з серпня 2021 року, «живу» реалізацію DeepFaceLab і здається найімовірнішим початковим ресурсом для потенційного фальсифікатора).

Чотири системи були навчені DFL «злегка» на невідомій особі, яка брала участь у тестах, і в парі зі знаменитістю; DFL навчено більш повно, до 2 мільйонів ітерацій або кроків, де можна було б очікувати набагато більш продуктивну модель; Аніматор прихованого зображення (ЛІЯ); і Генеративна змагальна мережа зі зміною обличчя (ФСГАН).

Для отримання даних дослідники зняли та підготували вищезазначені відеокліпи, у яких 47 користувачів виконували 13 активних завдань, причому кожен користувач виводив близько 5-6 хвилин відео 1080p зі швидкістю 60 кадрів в секунду. Автори також заявляють, що ці дані з часом будуть оприлюднені.

Виявлення аномалії може виконуватися або людиною-спостерігачем, або алгоритмічно. Для останнього варіанту система була навчена на 600 обличчях від Набір даних FaceForensics. Функцією регресійних втрат була потужна схожість зображень навченого перцептуального зображення (LPIPS), тоді як двійкова крос-ентропія використовувалася для навчання класифікатора. EigenCam використовувався для візуалізації ваги детектора.

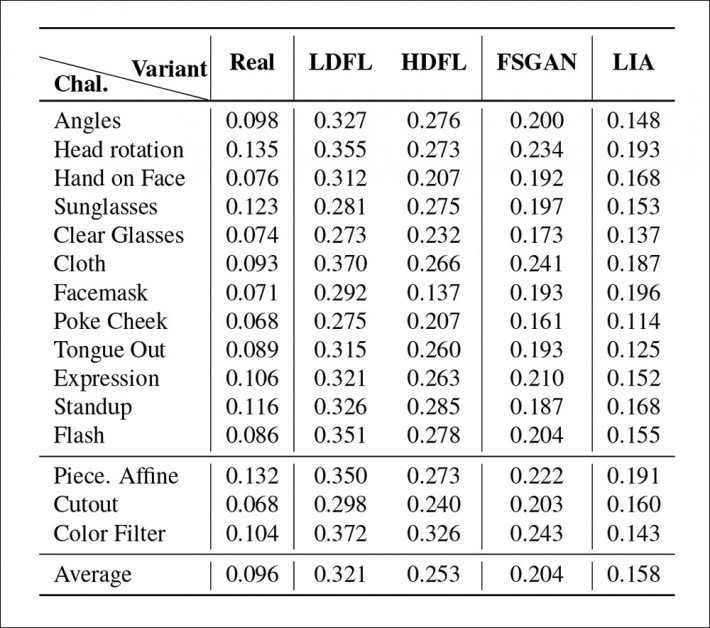

Первинні результати тестів на GOTCHA.

Дослідники виявили, що для повного каскаду тестів у чотирьох системах найменшу кількість і ступінь тяжкості аномалій (тобто артефактів, які б виявляли наявність глибокої фейкової системи) було отримано за допомогою більш навченого розподілу DFL. Менш навчена версія, зокрема, намагалася відтворити складні рухи губ (які займають дуже мало кадру, але привертають велику увагу людини), тоді як FSGAN займав середину між двома версіями DFL, а LIA виявилася абсолютно невідповідною для завдання. , при цьому дослідники вважають, що LIA зазнає невдачі в реальному розгортанні.

Вперше опубліковано 17 жовтня 2022 р.