Погляд Anderson

Надання відчуття запаху розробці штучного інтелекту

Нова набір даних штучного інтелекту вчить машини відчувати запах, асоціюючи дані про запах з зображеннями, що дозволяє моделям співставляти запахи з об’єктами, сценами та матеріалами.

Можливо, через те, що машини, що видають запах, мають таку строкату історію, ольфакція є досить занедбаною чуттям у літературі досліджень штучного інтелекту. Якщо ви не планували створити ще одну роботу в довгій серії (більше століття на сьогодні) смелл-о-візіон саги, випадки використання завжди здавалися досить “нішевими” у порівнянні з потенційним використанням наборів даних зображень, аудіо та відео та моделей штучного інтелекту, які тренуються з них.

На самом деле, можливість автоматизації, індустріалізації та популяризації видів детектування, які пропонують бомби-поводи, поводи для виявлення трупів, поводи для виявлення захворювань та інших видів собачих детекторів, буде помітною перевагою в муніципальних та охоронних службах. Незважаючи на високий попит, далеко вище пропозиції, навчання та утримання детектування собак – це дорогий бізнес, який не завжди пропонує хорошу вартість за гроші.

До сьогодні більшість досліджень, які заходять у цю область вивчення, були обмежені лабораторією, з кураторськими колекціями, які зазвичай складаються з прикладів з ручними функціями – профіль, нахилений більше до індивідуальних ремесел, ніж індустріальних застосунків.

Вперед носом

У цю досить застарілу атмосферу приходить цікаве нове академічне/промислове співробітництво зі США, в якому команда дослідників провела кілька місяців каталогізації різноманітних запахів у приміських та приміських середовищах у місті Нью-Йорк – і, вперше, зібрав зображення, пов’язані з захопленими запахами:

Помітте центральний сенсор, ‘ніс’ ольфакторного пристрою. Навчений тільки на запах, модель вгадує, чи це нюхає граніт, пластик чи шкіру – і навіть ідентифікує кімнату, в якій знаходиться, не бачачи жодного пікселя. Джерело

Ці дослідження привели авторів нової роботи до розробки спину на популярній рамці Contrastive Language-Image Pretraining (CLIP), яка з’єднує текст і зображення, у вигляді Contrastive Olfaction-Image Pretraining (COIP) – який з’єднує запахи і зображення.

Верх: синхронізоване відео і ольфакторні дані сенсора захоплюються в природних умовах за допомогою камери-нос-приладу. Нижче ліворуч (б): спільне вкладення вивчається через самонавчальний нагляд. (с): система відновлює візуальні відповідності на основі лише запиту запаху. (d): окремі зразки запаху використовуються для класифікації категорій середовища, об’єктів і матеріалів. (e): дуже схожі запахи, такі як два типи трави, розрізняються без візуального вводу. Джерело

Новий набір даних, озаглавлений Нью-Йоркські запахи, містить 7 000 пар запаху-зображення, що містять 3 500 різних об’єктів. Коли навчені в тестах, нові дані були виявлені кращими за популярні ручні функції в відносно невеликій кількості подібних попередніх наборів даних.

Автори сподіваються, що їхній перший виступ відкриє шлях для подальших робіт щодо ольфакторних систем детектування, призначених для роботи в дикій природі, так само, як і поводи-детектори*:

‘Ми бачимо цей набір даних як крок до багатомодальної ольфакторної перцепції в дикій природі, а також крок до з’єднання зору з запахом. Хоча ольфакція традиційно підходила до обмежених умов, таких як забезпечення якості, є багато застосунків у природних умовах.

‘Наприклад, як люди, ми постійно використовуємо свій запах, щоб оцінити якість їжі, ідентифікувати небезпеки та виявити невидимі об’єкти.

‘Крім того, багато тварин, таких як собаки, ведмеді та миші, показують надлюдські ольфакторні здатності, що свідчить про те, що людська перцепція запаху далеко не межа можливостей машин.’

Хоча нова робота, озаглавлена Нью-Йоркські запахи: Великий багатомодальний набір даних для ольфакції, обіцяє, що дані та код будуть випущені, файл даних розміром 27 ГБ вже доступний через сайт проекту. Робота була створена дев’ятьма дослідниками з Колумбійського університету, Корнелльського університету та Osmo Labs.

Метод

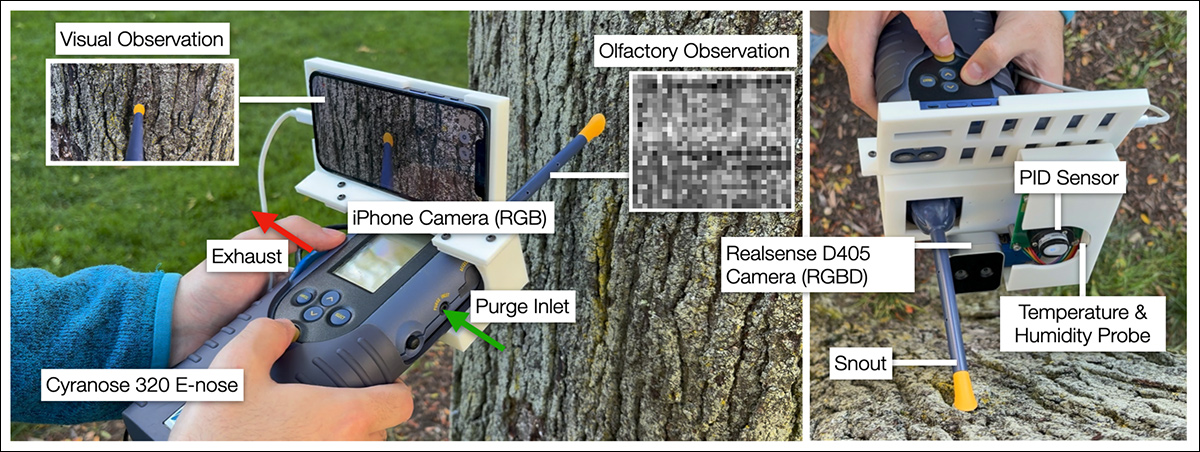

Для збору матеріалу для нового зібрання дослідники використовували електронний ніс Cyranose 320, з iPhone, встановленим над переднім входом, щоб захопити візуально, які запахи реєструвалися:

Портативний сенсорний пристрій збирає пари відео та даних запаху, встановлюючи iPhone камеру на Cyranose 320 е-нос. Ніс спрямований на об’єкти, тоді як вихлоп і впуск керують потоком повітря під час збору. Камера RGB‑D захоплює глибину, тоді як концентрація летючих органічних сполук (VOC), температура та вологість реєструються через інтегровані сенсори, включаючи модуль пропорційного-інтегрального-диференціального (PID) та екологічний зонд.

Пристрій Cyranose працює на частоті 2 Гц, реєструючи 32-мірні ольфакторні часові кроки. Концентрації летючих органічних сполук (VOC) реєструвалися за допомогою сенсора MiniPID2 PPM WR.

Портативна одиниця функціонувала як гнучкий сенсор, передаючи дані на більш потужну мобільну станцію для обробки.

Для розміщення цільового запаху в контексті реєструвався “базовий запах”, перш ніж більш конкретний об’єкт був цілеспрямовано націлений на “ніс” Cyranose. Амб’єнтний зразок потім був взятий з бічного порту в одиниці, щоб забезпечити, що він був достатньо далеко від основного джерела запаху, щоб не бути забрудненим.

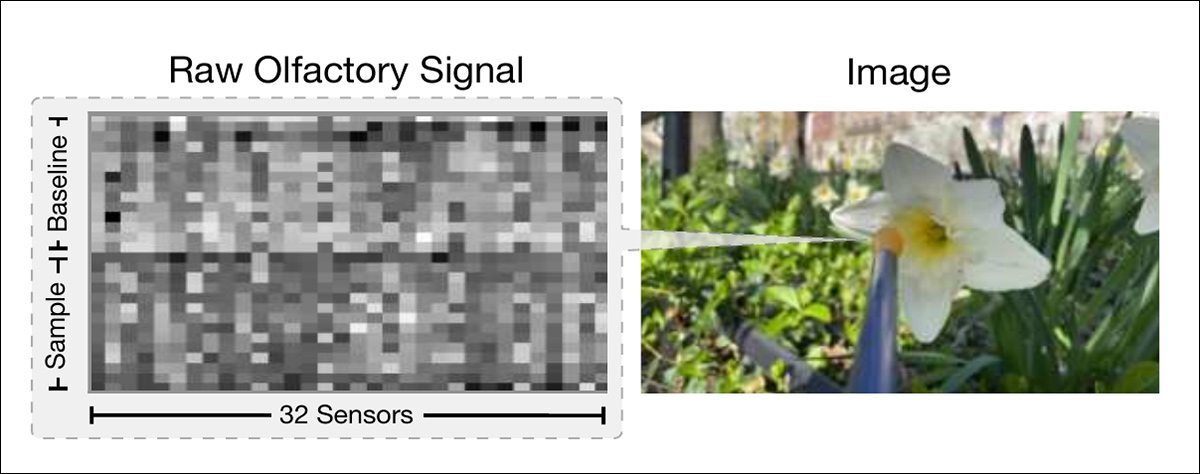

Два зразки були взяті через основний впуск сенсора, з кожним 10-секундним записом, захопленим з різних позицій навколо об’єкта, щоб поліпшити ефективність даних. Зразки потім були об’єднані з амб’єнтним базовим для формування 28×32 матриці, представляючи повне ольфакторне вимірювання:

Цей приклад показує сигнал і відповідне зображення для квітки. Повний ольфакторний сигнал складається з 28×32 матриці, об’єднуючи 14-кадровий амб’єнтний базовий зразок з двома 10-секундними зразками, взятими з різних кутів навколо цільового об’єкта.

Дані та тести

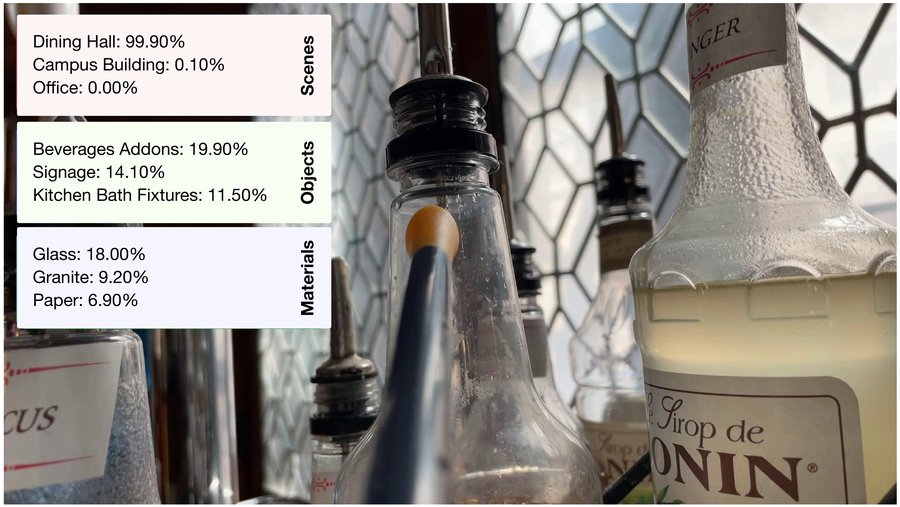

Моделі мови та зору (VLMs) були використані для автоматичного маркування об’єктів та матеріалів, захоплених iPhone в пристрої Cyranose, з GPT-4o, використаним для цієї задачі; однак категорії сцен були марковані вручну:

Маленький зразок з великої ілюстрації в джерельній роботі, що деталізує різноманітні джерела запахів та середовища, захоплені в проекті.

Набір даних був розділений на навчальні та валідні розділи, з обома зразками з кожного об’єкта, призначеними для одного розділу, щоб уникнути перетину. Остаточна колекція складається з 7 000 ольфакторно-візуальних пар, взятих з 3 500 незамаркованих об’єктів, разом з 70 годинами відео та 196 000 часових кроків сирого ольфакторного даних з обох базових та зразкових фаз.

Дані були зібрані протягом 60 сесій за два місяці, охоплюючи парки, університетські будівлі, офіси, вулиці, бібліотеки, квартири та їдальні, з кількома сесіями, проведеними в кожному місці. Результати набору даних містять 41% зовнішніх та 59% внутрішніх середовищ.

Для розробки загальних ольфакторних представлень автори тренували контрастивну модель для асоціації синхронізованих зображень-запахів з набору даних. Цей підхід, згаданий вище COIP, використовує функцію втрат, адаптовану з CLIP, для вирівнювання вкладень співвідносних візуальних та ольфакторних сигналів.

Навчання використовувало як візуальний кодувач, так і запаховий кодувач, з метою навчання моделі привести відповідні запахи та зображення ближче разом у спільному просторі представлення. Результати представляють підтримку ряду задач нижнього рівня, включаючи відновлення зображення-запаху, розпізнавання сцен та об’єктів, класифікацію матеріалів та тонку дискримінацію запахів.

Модель була тренована за допомогою двох типів ольфакторних входів: повного сирого сигналу сенсора та скороченого ручного підсумовування, відомого як смелл-принти – широко використовувані функції в дослідженнях ольфакції, які стискають кожну відповідь сенсора в одне число шляхом порівняння пікової опору під час збору з середньою опорою під час амб’єнтного базового рівня.

Натомість сирі входи, записані по всьому Нью-Йорку, складаються з часової серії з 32 хімічних сенсорів всередині пристрою Cyranose, захоплюючи, як кожен сенсор змінює свій електричний опір з часом, реагуючи на запах.

Для кураторства набору даних цей неопрацьований сигнал був поданий безпосередньо в нейронну мережу, дозволяючи здійснювати навчання від початку до кінця з конвольюційним або трансформаторним потужним підходом. Моделі були треновані за допомогою як смелл-принтів, так і сирого входу, зібраного з різних середовищ у місті Нью-Йорк, з обома типами входів, оціненими за допомогою контрастного навчання.

Перехресне відновлення

Перехресне відновлення було оцінено шляхом вкладення кожного зразка запаху та його парного зображення в спільний простір представлення та тестування того, чи можна відновити правильне зображення на основі самого ольфакторного входу.

Рейтинг визначався близькістю кожного зображення-вкладення до запиту запаху в цьому просторі, а продуктивність вимірювалася за допомогою середнього рангу, медіанного рангу та відкликання на декілька порогів:

Точність перехресного відновлення для різних кодувачів запаху, показуючи, як добре кожна модель ідентифікує правильне зображення з запиту запаху. Результати порівнюють архітектури, треновані на сирому ольфакторному сигналі, з тими, які використовують смелл-принти.

Відносно цих результатів автори заявляють:

‘Контрастне попереднє тренування, що використовує смелл-принт, виконує краще, ніж випадковість у всіх метриках. Однак тренування ольфакторного кодувача на сирому ольфакторному сигналі призводить до суттєвого покращення порівняно з кодувачем смелл-принту, незалежно від архітектури.

‘Це показує багатшу інформацію, присутню в сирому ольфакторному даних, що відкриває сильніші перехресні асоціації між зором і запахом.’

Деталь з сьомої ілюстрації в джерельній роботі, яка є занадто стисненою, щоб відтворити значуще тут. Тут приклади перехресного відновлення, показуючи, як модель пов’язує запахи з відповідними зображеннями. Кожний ряд починається з запиту запаху, за яким слідують найкращі рейтингові прогнози зображень у спільному просторі вкладення. Правильне зображення для кожного запиту окреслено зеленим, показуючи, як запахи від книг, рослин, кам’яної кладки та інших матеріалів притягують модель до візуально та семантично пов’язаних сцен.

Автори також зазначають, що результати відновлення часто показують семантичні групування:

‘Відновлення з нашої моделі часто показують семантичні групування. Запах книги відновлює зображення інших книг, запах листя відновлює зображення листя.

‘Ці результати свідчать про те, що вивчене представлення захоплює значущу перехресну структуру.’

Розпізнавання сцен, об’єктів та матеріалів

Спроможність моделі розпізнавати запахи без візуального входу була оцінена шляхом тренування її для ідентифікації сцен, об’єктів та матеріалів на основі лише ольфакторних даних; для цього було використано лінійний зонд (простий класифікатор, тренований на заморожених представленнях) для оцінки того, скільки інформації було закодовано в вивчених запахових вкладеннях.

Мітки були виведені з парних зображень у навчальному наборі за допомогою GPT-4o – але лише ольфакторний сигнал був використаний під час класифікації.

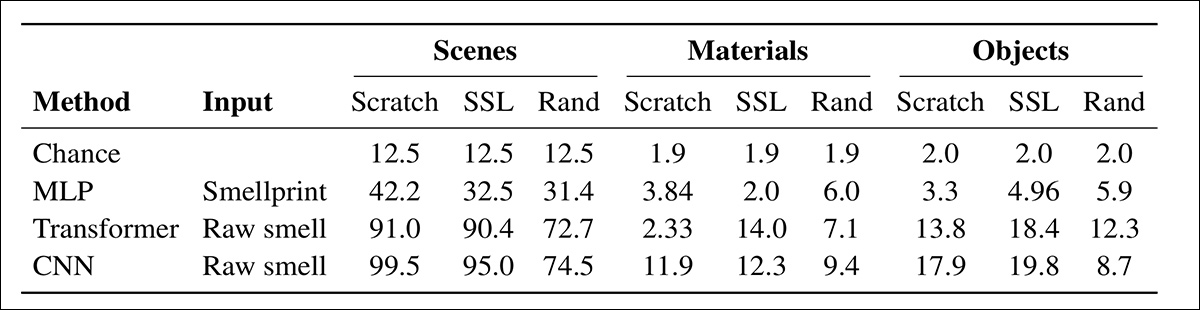

Були протестовані кілька типів кодувачів: деякі ініціалізовані випадково, деякі треновані з нуля, а інші треновані за допомогою контрастного навчання для вирівнювання запаху та зору в спільному просторі представлення, з сирими даними та смелл-принтами, оціненими:

Точність класифікації для сцен, матеріалів та об’єктів була оцінена за допомогою ольфакторних сигналів самостійно. Сирі дані сенсора перевершують смелл-принти, з конволюційними нейронними мережами, тренованими з нуля, які дають найкращі результати, включаючи 99,5% для сцен. Самонавчальне попереднє тренування допомогло в деяких випадках, але загалом було перевершено наглядовим тренуванням. Вагові базові лінії вказують на те, що ємність моделі сама по собі виявляється недостатньою.

Значно вища точність була отримана, коли використовувалися сирі ольфакторні дані, особливо в моделях, тренованих з跨-модальним наглядом. Автори коментують**:

‘Моделі, треновані на сирому сенсорному вході, також досягають вищої точності, ніж моделі, треновані з ручними функціями смелл-принтів. Ці результати показують, що глибоке навчання з сирого ольфакторного сигналу значно краще, ніж ручні функції.’

Тонка дискримінація

Для оцінки того, чи можуть бути вивчені тонкі відмінності запахів, був створений бенчмарк з двох видів трав, що співіснують на одному університетському газоні. Чергові зразки були зібрані протягом шести 30-хвилинних сесій, давши 256 прикладів. Лінійний класифікатор був тренований на функціях з ольфакторно-візуального контрастного навчання, і оцінений на відокремленому наборі з 42 зразків:

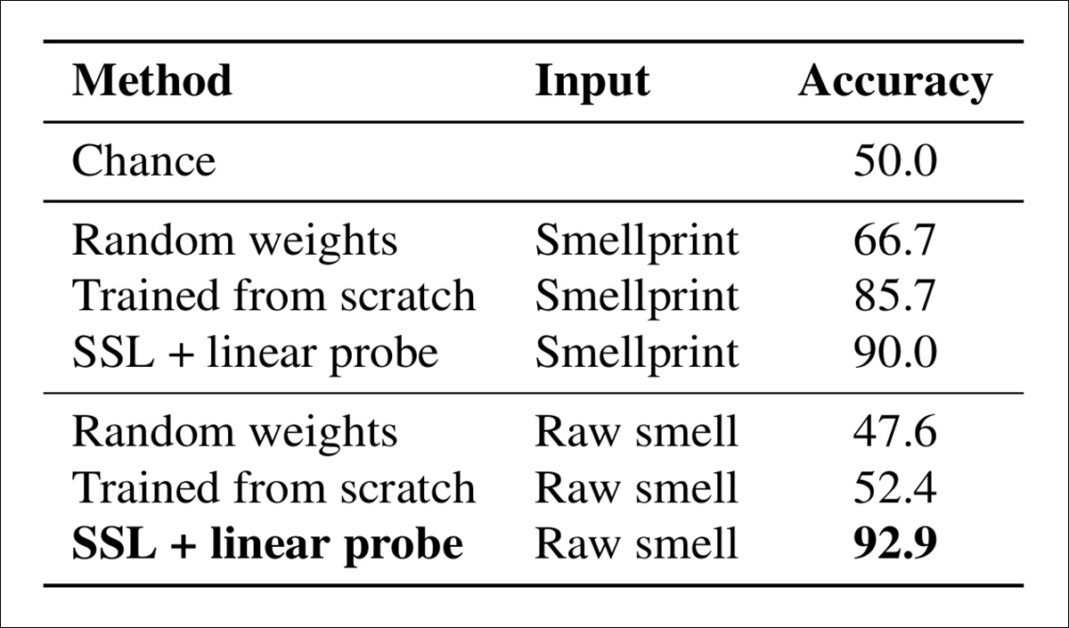

Точність класифікації видів трав за допомогою лише запаху. Моделі були оцінені за їхню здатність розрізняти два візуально схожі види трав за допомогою лише ольфакторного входу. Продуктивність була порівняна через смелл-принти та сирі дані сенсора, з моделями, які або випадково ініціалізовані, або треновані з нуля, або треновані за допомогою самонавчального навчання (SSL), за яким слідував лінійний зонд. Найвища точність, 92,9%, була досягнута за допомогою сирого ольфакторного сигналу з SSL, вказуючи на те, що тонкі відмінності запахів краще захоплюються через сирі дані та візуальне тренування.

Тут дослідники зазначають:

‘Тренування на сирому ольфакторному сигналі (замість ручних функцій) дає найвищу точність – перевершуючи всі варіанти, засновані на смелл-принтах.

‘Ці результати свідчать про те, що ольфакторно-візуальне навчання зберігає більше тонкої інформації, ніж навчання з смелл-принтами, і що візуальне нагляд надає сигнал для використання цієї інформації.’

Висновок

Хоча синтез запаху, ймовірно, залишиться нерозв’язаною проблемою певний час, ефективна та доступна система аналізу запаху в дикій природі має величезний потенціал, не тільки для поліцейських, охоронних та медичних цілей, але також для контролю якості життя та моніторингу міської території.

На даний час обладнання, яке використовується, є нішевим і зазвичай досить дорогим; тому справжній прогрес у сфері “ольфакторного штучного інтелекту” для детектування, ймовірно, буде вимагати видатного та доступного сенсора в дусі Raspberry PI.

* Моя конвертація внутрішніх посилань авторів у гіперпосилання.

** Будь ласка, зверніть увагу, що подальші ілюстрації (фігур 8) доступні в джерельній роботі, але краще переглядати їх у цьому контексті.

Перша публікація у п’ятницю, 28 листопада 2025