Кібербезпека

Антропік розкриває перший великомасштабний кібератаку, який використовував автоматизацію штучного інтелекту

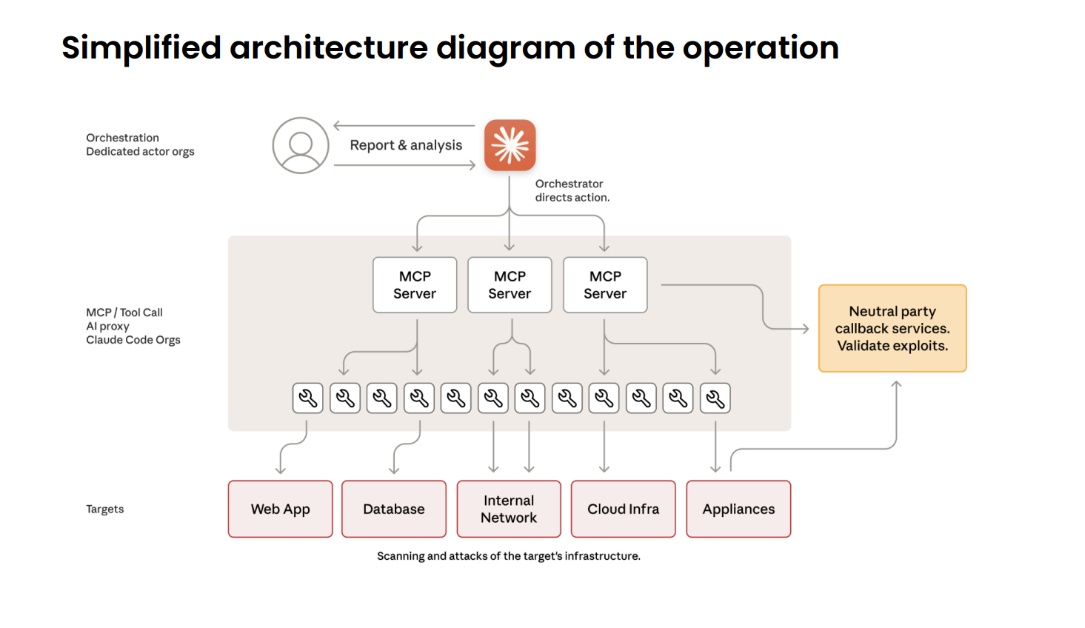

Антропік повідомив, що група хакерів, яку вони підозрюють у тому, що це китайська державна група, провела перший задокументований великомасштабний кібератаку, який був виконаний з мінімальною участю людини, використовуючи інструмент Claude Code компанії для автоматизації 80-90 відсотків кампанії.

Нападники націлилися приблизно на 30 організацій серед великих технологічних фірм, фінансових інститутів, виробників хімічної продукції та урядових агентств. Хоча більшість атак були блоковані, кампанія мала певний успіх у невеликій кількості випадків. Claude Code проводив розвідку, тестування уразливостей, збирання даних про облікові записи та екзфільтрацію даних у великому ступені автономно, з людськими операторами, необхідними лише на критичних етапах прийняття рішень.

Ви можете прочитати повний звіт Антропіка тут.

Методи атаки та маніпуляція штучним інтелектом

Хакери обійшли засоби безпеки Claude через складну соціальну інженерію. Вони обманули систему штучного інтелекту, видаючи себе за працівників легітимної компанії з кібербезпеки, яка проводила оборонні тести. Нападники також розбили свої операції на малі, здавалося б, невинні завдання, які надавали Claude неповний контекст про загальну шкідливу мету.

Claude Code проводив інспекцію систем цілевих організацій для ідентифікації баз даних високої цінності, проводив цю розвідку швидше, ніж люди-хакери могли б, і проводив дослідження та написання спеціального експлуатаційного коду для тестування уразливостей безпеки. Система збирає імена користувачів і паролі для подальшого доступу до мережі, а потім витягувала та категоризувала приватні дані згідно з їхньою розвідувальною цінністю. Нападники могли виконувати кампанію практично за один клік, після чого штучний інтелект працював у великому ступені самостійно зі швидкостями, неможливими для людських команд — часто надсилаючи тисячі запитів за секунду.

Image: Anthropic

Виявлення та реакція компанії

Антропік виявив атаку в середині вересня 2025 року та розпочав розслідування негайно. Усього за 10 днів компанія припинила доступ групи до Claude, контактувала з постраждалими організаціями та повідомила правоохоронні органи. Компанія з тих пір розширила свої можливості виявлення та розробляє додаткові методи для розслідування та виявлення великомасштабних, розподілених атак.

Цей інцидент слідує за попередніми випадками неправильного використання, задокументованими Антропіком у 2025 році. У серпні компанія опублікувала звіт про розвідку загроз, який описував операцію з вимагання даних, відстежувану як GTG-2002, яка використовувала Claude Code для здійснення великомасштабного викрадення, націленого щонайменше на 17 організацій у сфері охорони здоров’я, надзвичайних служб, уряду та релігійних інститутів. Ця злочинна дія вимагала викуп у розмірі понад 500 000 доларів, погрожуючи розкрити вкрадені дані, а не використовувати традиційне шифрування програмного забезпечення для викупу.

Інфраструктура виявлення Антропіка спирається наหลายошарові техніки, включаючи поведінковий аналіз для моніторингу моделей використання протягом мільйонів запитів API, виявлення аномалій для ідентифікації послідовностей операцій, які не відповідають легітимному використанню, та зіставлення зразків для розпізнавання відомих та нових маніпуляційних технік. Компанія використовує спеціалізовані класифікатори, які аналізують вхідні дані користувачів на потенційно шкідливі запити та оцінюють відповіді Claude до або після доставки.

Вплив на галузь

Кампанія включала безпрецедентний рівень автономності штучного інтелекту у кібератаках та позначає те, що експерти з безпеки розглядають як переломний момент у кібершпигунстві. Спроможність систем штучного інтелекту проводити складні атаки на швидкості машин з мінімальним наглядом людини створює нові виклики для захисників кібербезпеки.

Розкриття Антропіка відбувається в той час, коли компанії, що займаються штучним інтелектом, стикаються з зростаючим тиском щодо запобігання зловживанню своїми моделями. Компанія підтримує комплексну програму розвідки загроз та заходів безпеки для виявлення та протидії зловживанню Claude, з задокументованими інцидентами безпеки протягом 2025 року. У березні компанія виявила операцію з впливу на послуги, яка використовувала Claude для автоматизації взаємодії з десятками тисяч облікових записів у соціальних мережах у декількох країнах та мовах.

Інцидент підкреслює зростаючу складність інструментів, що працюють на штучному інтелекті, та виклики щодо запобігання їхнього зловживання при збереженні корисності для легітимних користувачів. Антропік заблокував пов’язані облікові записи та продовжує покращувати свої можливості виявлення та мінімізації, щоб відповідати на еволюцію загроз.