Штучний інтелект

Особисте бачення тенденцій літератури з комп’ютерного зору в 2024 році

Я безперервно слідкував за дослідженнями комп’ютерного зору (CV) та синтезу зображень на Arxiv та в інших місцях уже близько п’яти років, тому тенденції стають очевидними з часом, і вони змінюються в нових напрямках кожен рік.

Отже, оскільки 2024 рік підходить до кінця, я подумав, що варто розглянути деякі нові або еволюційні характеристики в розділі Computer Vision and Pattern Recognition section. Ці спостереження, хоча й інформовані сотнями годин вивчення сцени, є строго анекдотичними.

Тривале зростання Східної Азії

До кінця 2023 року я помітив, що більшість літератури в категорії “синтез голосу” виходила з Китаю та інших регіонів Східної Азії. На кінець 2024 року я повинен констатувати (анекдотично), що це тепер застосовується також до досліджень з синтезу зображень і відео.

Це не означає, що Китай і сусідні країни обов’язково завжди видають найкращу роботу (вдійсні, є деякі докази протилежного); ні, це не враховує високої ймовірності того, що в Китаї (як і на Заході) деякі з найцікавіших і найпотужніших нових систем, що розробляються, є пропріетарними і виключені з наукової літератури.

Але це свідчить про те, що Східна Азія обходить Захід за об’ємом, в цьому відношенні. Те, що це варте, залежить від того, якою мірою ви вірите в життєздатність Edison-стильної наполегливості, яка зазвичай виявляється неефективною у разі непереборних перешкод.

Є багато таких перешкод у генераційній штучній інтелект, і не легко знати, які з них можна вирішити, звернувшись до існуючих архітектур, а які будуть потребувати переосмислення з нуля.

Хоча дослідники з Східної Азії, здається, видають більшу кількість робіт з комп’ютерного зору, я помітив збільшення частоти “Франкенштейнівських” проектів – ініціатив, які складаються з поєднання попередніх робіт, при цьому додаючи обмежену архітектурну новизну (або можливо просто інший тип даних).

Цього року значно більша кількість робіт з Східної Азії (в основному китайських або спільних робіт з Китаєм) здавалося, що вони керуються квотами, а не заслугами, суттєво збільшуючи співвідношення сигнал-шум у вже переповненій галузі.

В той же час, більша кількість робіт з Східної Азії також привернула мою увагу та захоплення в 2024 році. Отже, якщо це вся гра з чисел, то вона не провалюється – але ні, вона не дешева.

Збільшення обсягу подань

Об’єм робіт, по всіх країнах походження, очевидно збільшився в 2024 році.

Найпопулярніший день публікації змінюється протягом року; зараз це вівторок, коли кількість подань до розділу Computer Vision and Pattern Recognition часто становить близько 300-350 в один день, у “пікові” періоди (травень-серпень і жовтень-грудень, тобто сезон конференцій і “сезон річної квоти”, відповідно).

Поза моїм власним досвідом, Arxiv сам повідомляє про рекордну кількість подань у жовтні 2024 року, з 6000 нових подань, а розділ Computer Vision став другим за кількістю подань після Machine Learning.

Однак, оскільки розділ Machine Learning на Arxiv часто використовується як “додатковий” або агрегований надряд, це свідчить про те, що Computer Vision і Pattern Recognition насправді є найбільш поданим розділом Arxiv.

Власні статистичні дані Arxiv явно зображують комп’ютерну науку як явного лідера за кількістю подань:

Комп’ютерна наука (CS) домінує у статистиці подань на Arxiv за останні п’ять років. Джерело: https://info.arxiv.org/about/reports/submission_category_by_year.html

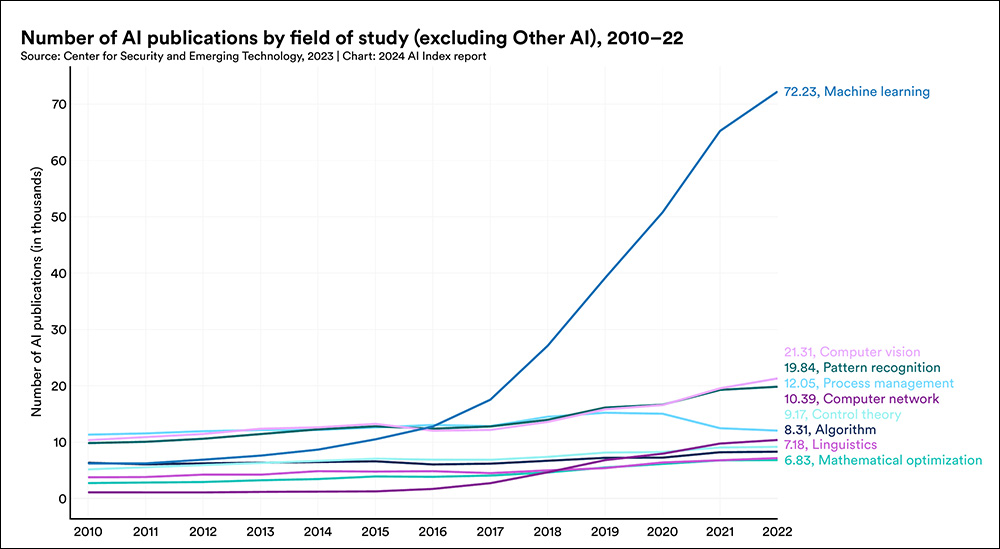

Звіт 2024 AI Index Стенфордського університету, хоча й не能够 повідомити про найновіші статистичні дані, також підкреслює помітне зростання кількості академічних робіт з машинного навчання за останні роки:

Хоча цифри не доступні для 2024 року, звіт Стенфорду все ж таки драматично показує зростання кількості подань робіт з машинного навчання. Джерело: https://aiindex.stanford.edu/wp-content/uploads/2024/04/HAI_AI-Index-Report-2024_Chapter1.pdf

Поширення дифузійних рамок

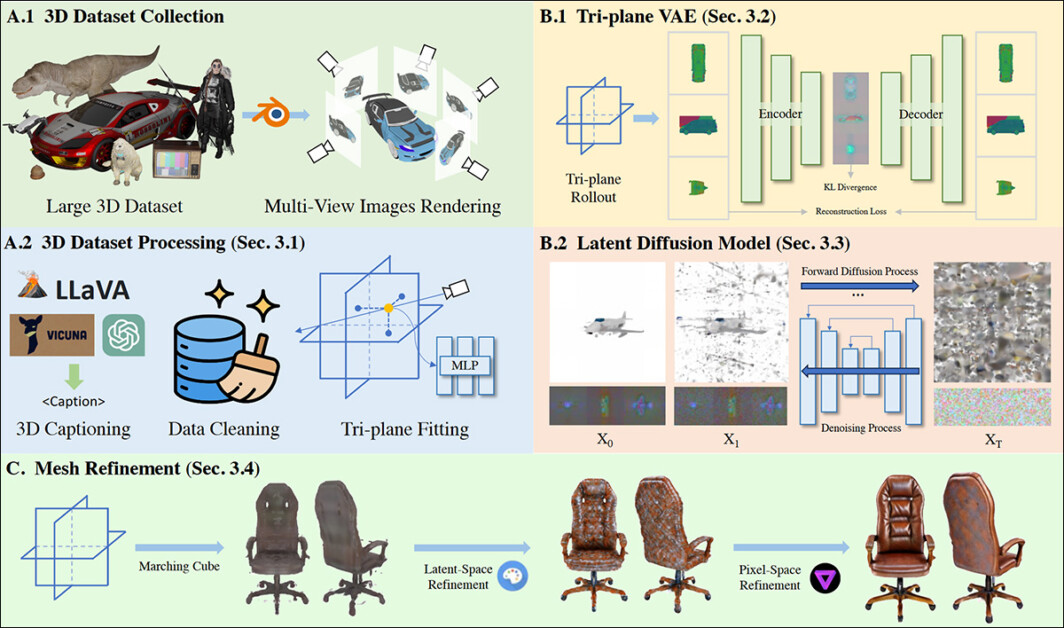

Іншою явною тенденцією, яка виникла для мене, було велике зростання робіт, які займаються використанням латентних дифузійних моделей (LDM) як генераторів моделей, заснованих на сітці, “традиційних” моделей CGI.

До таких проектів належать InstantMesh3D від Tencent, 3Dtopia, Diffusion2, V3D, MVEdit та GIMDiffusion, серед багатьох інших.

Генерація та уточнення сітки через дифузійний процес у 3Dtopia. Джерело: https://arxiv.org/pdf/2403.02234

Ця нова галузь досліджень може бути розглянута як невблаганне визнання тривалої нездоланності генераційних систем, таких як дифузійні моделі, які лише два роки тому вважалися потенційною заміною всіх систем, які зараз намагаються заповнити дифузійні>сіткові моделі; відводячи дифузію на роль інструменту в технологіях і робочих процесах, які датуються тридцятьма або більше роками.

Stability.ai, засновник відкритої моделі Stable Diffusion, щойно випустили Stable Zero123, який може, серед іншого, використовувати нейронне поле радіанції (NeRF) як міст для створення явної, сітчастої моделі CGI, яку можна використовувати в середовищах CGI, таких як Unity, у відеоіграх, доповненої реальності та інших платформах, які потребують явних 3D-координат, на відміну від імпліцитних (прихованих) координат неперервних функцій.

Натисніть, щоб відтворити. Зображення, згенеровані в Stable Diffusion, можна перетворити на раціональні моделі CGI. Тут ми бачимо результат роботи зображення>CGI з використанням Stable Zero 123. Джерело: https://www.youtube.com/watch?v=RxsssDD48Xc

3D-семантика

Простір генераційної штучної інтелект робить розрізнення між 2D- і 3D-системами реалізації зору та генераційних систем. Наприклад, фреймворки розпізнавання обличчя, хоча й представляють 3D-об’єкти (обличчя) у всіх випадках, не всі обов’язково обчислюють адресовані 3D-координати.

Популярний FANAlign систем, широко використовуваний у архітектурах deepfake 2017 року (серед інших), може задовольняти обидва ці підходи:

Вгорі генеруються 2D-орієнтири на основі визнаних ліній і особливостей обличчя. Внизу вони раціоналізуються у 3D-просторі X/Y/Z. Джерело: https://github.com/1adrianb/face-alignment

Отже, як і термін “deepfake” став двозначним і захопленим терміном, термін “3D” також став плутаним у дослідженнях комп’ютерного зору.

Для споживачів він зазвичай означав стерео-відео (наприклад, фільми, для яких глядач повинен носити спеціальні окуляри); для фахівців візуальних ефектів і моделерів він забезпечує розрізнення між 2D-мистецтвом (наприклад, концептуальними ескізами) і моделями сітки, які можна маніпулювати в “3D-програмі”, такій як Maya або Cinema4D.

Але у комп’ютерному зорі це просто означає, що картезійська система координат існує десь у латентному просторі моделі – не те, що її можна обов’язково звернутися або безпосередньо маніпулювати користувачем; принаймні, не без третьої сторони інтерпретативних систем CGI, таких як 3DMM або FLAME.

Отже, поняття дифузія>3D є неточним; не тільки будь-який тип зображення (включаючи реальну фотографію) можна використовувати як вхід для генерації моделі CGI, але й термін “сітка” є більш підходящим.

Однак, щоб ускладнити двозначність, дифузія потрібна для інтерпретації джерельної фотографії у сітку у більшості нових проектів. Отже, краще опис буде зображення-сітка, тоді як зображення>дифузія>сітка є ще більш точним описом.

Але це складна справа на засіданні ради директорів або у прес-релізі, призначеному для залучення інвесторів.

Докази архітектурних тупиків

Евен у порівнянні з 2023 роком, останні 12 місяців робіт демонструють зростаючу відчай щодо видалення жорстких практичних обмежень на генерацію, засновану на дифузії.

Ключовим каменем спотикання залишається генерація нарративно і тимчасово узгодженого відео, а також підтримання сталої появи персонажів і об’єктів – не тільки у різних відеокліпах, але й навіть протягом короткого часу одного згенерованого відеокліпу.

Остання епохальна інновація у сфері синтезу, заснованому на дифузії, була появою LoRA у 2022 році. Хоча новіші системи, такі як Flux, покращили деякі проблеми аутлієрів, такі як колишня нездатність Stable Diffusion відтворювати текстовий вміст у згенерованому зображенні, а загальна якість зображення покращилася, більшість робіт, які я вивчив у 2024 році, були фактично просто переміщенням їжі на тарілці.

Ці тупики траплялися раніше, з генераційними адверсаріальними мережами (GAN) і нейронними полями радіанції (NeRF), які обидва не виправдали своїх початкових потенційних можливостей – і обидва зараз все частіше використовуються у більш традиційних системах (наприклад, використання NeRF у Stable Zero 123, див вище). Це також відбувається з дифузійними моделями.

Дослідження Гауссового розсіювання

Було так, що наприкінці 2023 року метод розсіювання Гаусса (3DGS), який дебютував як медична техніка зображення на початку 1990-х років, мав раптово обігнати автоенкодерні системи синтезу людських зображень (таких як симуляція обличчя та його відтворення, а також передача ідентичності).

Документ ASH 2023 обіцяв повністю тіло Гауссового розсіювання, тоді як Гауссові аватари пропонували значно покращену деталізацію (у порівнянні з автоенкодерними та іншими конкуруючими методами), разом з вражаючими можливостями перезапису.

Цього року, однак, було відносно мало таких проривних моментів для синтезу людських зображень з використанням Гауссового розсіювання; більшість робіт, які займалися цією проблемою, були або похідними від вище згаданих робіт, або не змогли перевершити їхні можливості.

Натомість акцент на Гауссовому розсіюванні був у покращенні його фундаментальної архітектурної життєздатності, що призвело до цілої серії робіт, які пропонують покращені зовнішні середовища Гауссового розсіювання. Особлива увага була приділена підходам Simultaneous Localization and Mapping (SLAM) Гауссового розсіювання, у проектах таких як Гауссове розсіювання SLAM, Splat-SLAM, Гауссове-SLAM, DROID-Splat, серед багатьох інших.

Ті роботи, які намагалися продовжити або розширити синтез людських зображень з використанням Гауссового розсіювання, включали MIGS, GEM, EVA, OccFusion, FAGhead, HumanSplat, GGHead, HGM та Topo4D. Хоча є інші, жодна з цих робіт не мала такого самого впливу, як роботи, які з’явилися наприкінці 2023 року.

‘Ера Вайнштейна’ тестових зразків знаходиться у повільному зниженні

Дослідження з Південно-Східної Азії загалом (і Китаю зокрема) часто містять тестові приклади, які проблематичні для republicації у оглядовій статті, оскільки вони містять матеріал, який є трохи “пікантним”.

Чи це тому, що дослідники в цій частині світу намагаються привернути увагу до своєї роботи, залишається під сумнівом; однак за останні 18 місяців все більше робіт з генераційної штучної інтелект (зображення та/або відео) перейшли до використання молодих і напівоголених жінок та дівчат у прикладах проекту.

Це слідує загальним тенденціям субреддітів і інших спільнот, які зібралися навколо латентних дифузійних моделей (LDM), де правило 34 залишається дуже актуальним.

Конкурс знаменитостей

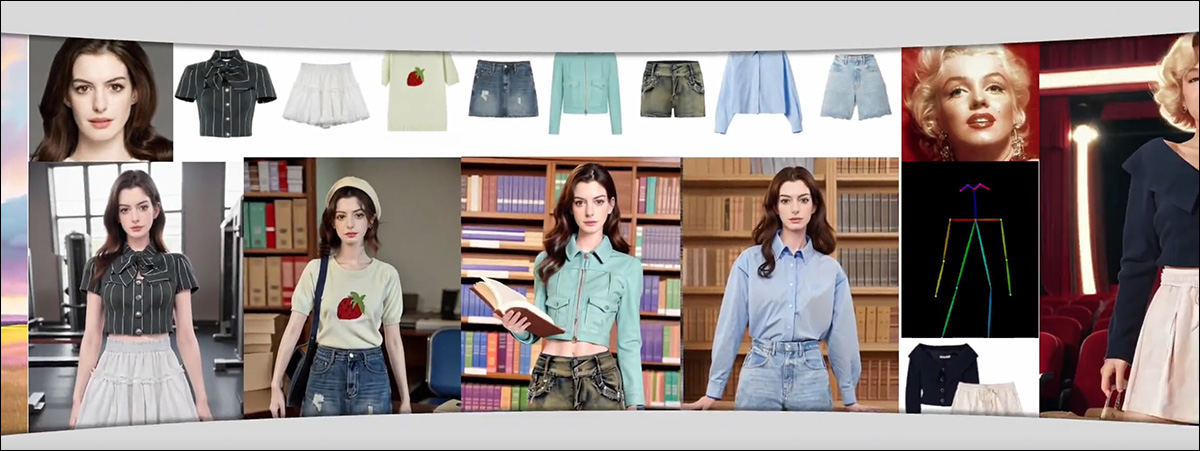

Такий тип неприйнятного прикладу перекривається з зростаючим визнанням того, що процеси штучної інтелект не повинні довільно експлуатувати знаменитості – особливо у дослідженнях, які некритично використовують приклади з відомими знаменитостями, часто жінками, і розміщують їх у сумнівних контекстах.

Одним з прикладів є AnyDressing, який, крім використання дуже молодих аніме-стильних жіночих персонажів, також вільно використовує ідентичності класичних знаменитостей, таких як Мерілін Монро, і сучасних, таких як Енн Гетевей (яка досить голосно виступала проти такого використання).

Вільне використання поточних і “класичних” знаменитостей все ще досить поширене у роботах з Південно-Східної Азії, хоча ця практика трохи знижується. Джерело: https://crayon-shinchan.github.io/AnyDressing/

У західних роботах ця практика була помітно знижена протягом 2024 року, під керівництвом великих випусків з FAANG і інших високорівневих дослідницьких органів, таких як OpenAI. Критично усвідомлюючи потенційну можливість майбутніх судових процесів, ці великі корпоративні гравці здаються все більш неохочими представляти навіть вигадані фотореалістичні люди.

Хоча системи, які вони створюють (такі як Imagen і Veo2), явно здатні до такого виходу, приклади з західних проектів генераційної штучної інтелект тепер схиляються до “милих”, диснеївських і дуже “безпечних” зображень і відео.

Незважаючи на те, що Imagen здатна створювати “фотореалістичний” вихід, зразки, пропоновані дослідницькою групою Google, зазвичай фантастичні, “сімейні” матеріали – фотореалістичні люди ретельно уникνονται або мінімально представлені. Джерело: https://imagen.research.google/

Очищення обличчя

У західній літературі з комп’ютерного зору ця нечесна підхід особливо помітна для систем налаштування – методів, які здатні створювати узгоджену подобу конкретної людини у декількох прикладах (наприклад, як LoRA і старша DreamBooth).

Приклади включають ортогональне візуальне вкладення, LoRA-Composer, InstructBooth від Google, і багато інших.

InstructBooth від Google підвищує рівень миловидності до 11, хоча історія свідчить про те, що користувачі більше зацікавлені у створенні фотореалістичних людей, ніж пушистих персонажів. Джерело: https://sites.google.com/view/instructbooth

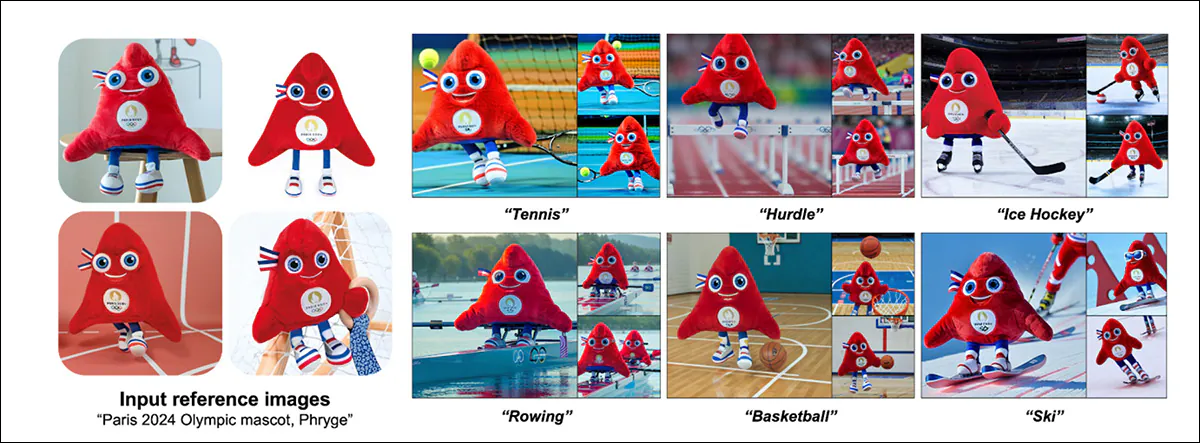

Однак зростання “милого прикладу” спостерігається в інших дослідженнях комп’ютерного зору та синтезу, у проектах таких як Comp4D, V3D, DesignEdit, UniEdit, FaceChain (яка визнає більш реалістичні очікування користувачів на своїй сторінці GitHub), і DPG-T2I, серед багатьох інших.

Легкість, з якою такі системи (наприклад, LoRAs) можуть бути створені домашніми користувачами з відносно скромним обладнанням, призвела до вибуху вільно завантажуваних моделей знаменитостей на домені civit.ai і спільноті. Таке незаконне використання залишається можливим завдяки відкриттю архітектур, таких як Stable Diffusion і Flux.

Хоча часто можливо пробити через функції безпеки генераційних текст-до-зображення (T2I) і текст-до-відео (T2V) систем для створення матеріалу, забороненого умовами використання платформи, розрив між обмеженими можливостями найкращих систем (таких як RunwayML і Sora) і необмеженими можливостями просто ефективних систем (таких як Stable Video Diffusion, CogVideo і локальні розгортання Hunyuan) не дійсно не зменшується, як багато хто вважає.

Натомість ці пропріетарні та відкриті системи, відповідно, загрожують стати рівно так само безкорисними: дорогі і гіпермасштабовані системи T2V можуть стати надмірно обмеженими через страх перед судовими процесами, тоді як відсутність інфраструктури ліцензування та нагляду за наборами даних у відкритих системах може виключити їх з ринку, оскільки вводяться все більш суворі регуляції.

Перша публікація у вівторок, 24 грудня 2024 року