มุมมองของ Anderson

การใช้ AI เพื่อปรับปรุงรูปถ่ายจริงก่อนถ่าย

แทนที่จะใช้ GenAI เพื่อแก้ไขรูปถ่าย หลัง คุณถ่ายรูปแล้ว นักวิจัยได้ฝึกอบรมระบบที่บอกคุณว่าจะย้าย ท่าทาง และจัดเฟรมรูปถ่ายล่วงหน้า โดยใช้ความรู้ที่ศึกษามาเกี่ยวกับสิ่งที่ทำให้รูปถ่ายน่าจดจำ

การแก้ไขรูปถ่ายหลังการถ่ายภาพได้กลายเป็นเรื่องที่ง่ายขึ้นในช่วงหลายปีที่ผ่านมา เนื่องจากผู้ผลิตและแพลตฟอร์มเทคโนโลยีให้บริการแก้ไขในกล้องที่ช่วยให้ผู้ใช้สามารถเปลี่ยนแปลงรูปภาพได้ทันทีหลังการถ่ายภาพ ระบบที่ได้รับความนิยมของประเภทนี้รวมถึงการแก้ไขแบบสนทนาของ Google และการแก้ไขแบบสร้างสรรค์ของ Samsung เป็นต้น

อย่างไรก็ตาม แนวโน้มที่เพิ่มขึ้นซึ่งให้ความสำคัญกับ “ความเป็นธรรม” มากกว่าผลลัพธ์ที่ได้รับการปรับปรุงโดย AI อาจหมายความว่าผู้บริโภคหลายคนซึ่งเป็นกลุ่มเป้าหมายของระบบเหล่านี้เริ่มมองว่ารูปถ่ายที่ “ถูกแก้ไข” เป็น “สิ่งปนเปื้อนของ AI”

อาจเป็นเพราะสิ่งนี้ที่ทำให้ Google สร้าง “โค้ชกล้อง” ที่ได้รับการฝึกอบรมจาก AI ซึ่งได้รับข้อมูลจาก Gemini ซึ่งสามารถให้คำแนะนำโดยตรงเพื่อปรับปรุงรูปถ่าย ระหว่าง กระบวนการถ่ายภาพ:

Google’s Camera Coach บอกผู้ใช้ว่าจะจัดเฟรมรูปถ่ายใหม่ รวมทั้งคำแนะนำพื้นฐานอื่นๆ แหล่งที่มา

เนื่องจากเป็นระบบที่เป็นกรรมสิทธิ์ และมีข้อมูลออนไลน์เกี่ยวกับระบบนี้แทบจะไม่มี ระบบ Camera Coach ดูเหมือนจะใช้ Gemini เพื่อช่วยให้ผู้ใช้ปรับปรุงการวางเฟรมหรือทำการเปลี่ยนแปลงเล็กๆ น้อยๆ ในท่าทาง เช่น การยืนใกล้กันมากขึ้น หรือมองตรงเข้ากล้อง

ดังนั้น ในที่สุด ระบบผลิตภัณฑ์นี้จึงผลักดันการวางองค์ประกอบไปสู่ค่าเฉลี่ย โดยพิจารณาจากข้อมูลจุดข้อมูลหลายล้านจุดที่อาจมีส่วนช่วยในการฝึกอบรม Gemini ซึ่งเป็นการทำความสะอาดข้อมูลชุด (dataset curation) ที่มีประสิทธิภาพและฟรี!

แต่ รูปถ่ายที่ “ถูกเฉลี่ย” ในด้านการวางองค์ประกอบไม่จำเป็นต้องมีคุณค่าทาง审美หรือมีผลกระทบต่อผู้ชมเหมือนกับรูปถ่ายที่ น่าจดจำ

ไปไกลกว่า ‘ชีส!’ และกฎของสามส่วน

เพื่อจุดนี้ และเพื่อระบบที่สามารถเข้าถึงได้มากขึ้นบนแพลตฟอร์มต่างๆ การวิจัยใหม่จากอิตาลีเสนอระบบ Coach-STYLE ที่ขึ้นอยู่กับความรู้ล่วงหน้าเกี่ยวกับ สิ่งที่ทำให้รูปถ่ายยังคงอยู่ในใจ:

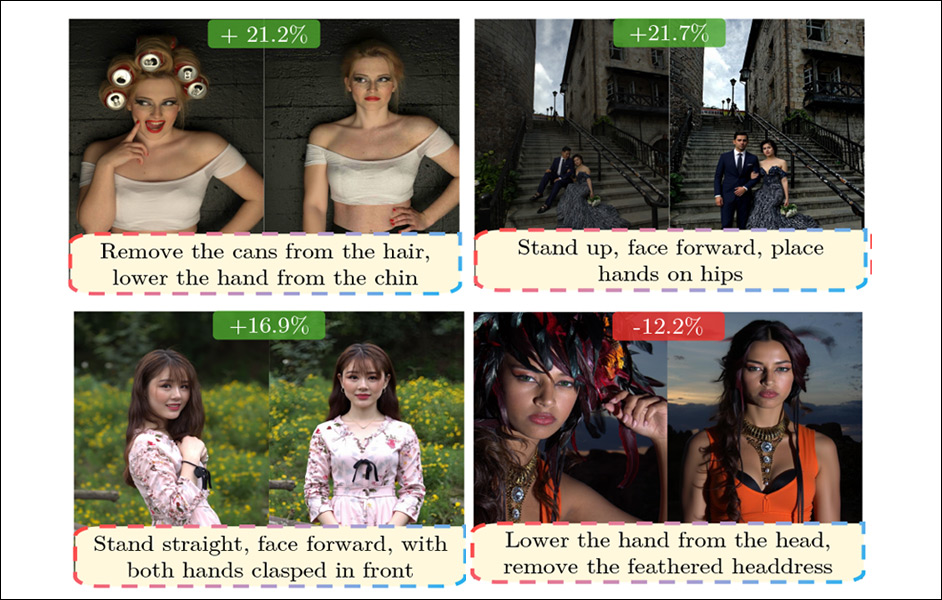

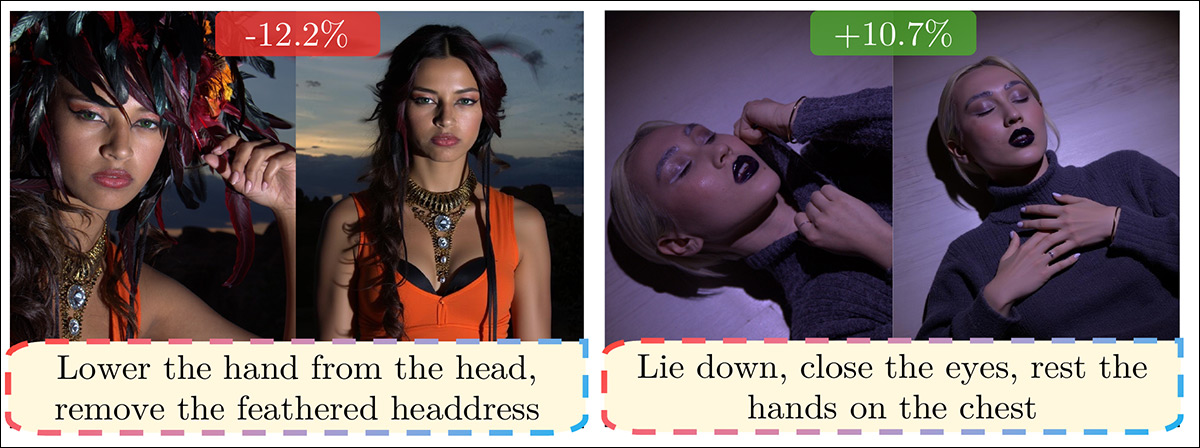

ตัวอย่างคำแนะนำที่หลากหลายจากระบบใหม่ของนักวิจัย แหล่งที่มา

ในตัวอย่างข้างต้น เราจะเห็นคำแนะนำที่ระบบใหม่ของนักวิจัยให้มา ซึ่งระบบ Camera Coach ที่เน้นการวางองค์ประกอบไม่สามารถให้คำแนะนำนี้ได้ ในตัวอย่างแรก (ซ้ายสุด) คำแนะนำในการถอดหมวกนั้นเป็นพิเศษ ในรูปที่สอง มันยากที่จะจินตนาการว่าบริบททั่วไปที่ AI ที่เน้นการวางองค์ประกอบสามารถดึงมาจากสถานการณ์ทั่วไป (เช่น รูปถ่าย “ศิลปะ” ของสาวหนุ่มที่นอนบนพื้นพร้อมปิดตา)

ความเข้าใจหลักเกี่ยวกับความน่าจดจำในการถ่ายภาพที่ใช้พัฒนาระบบสามส่วนของอิตาลีนี้ มาจากผลงานก่อนหน้าหลายอย่าง รวมถึงการเผยแพร่ในปี 2015 อะไรทำให้วัตถุน่าจดจำ? และการเผยแพร่ในปี 2013 อะไรทำให้รูปถ่ายน่าจดจำ?

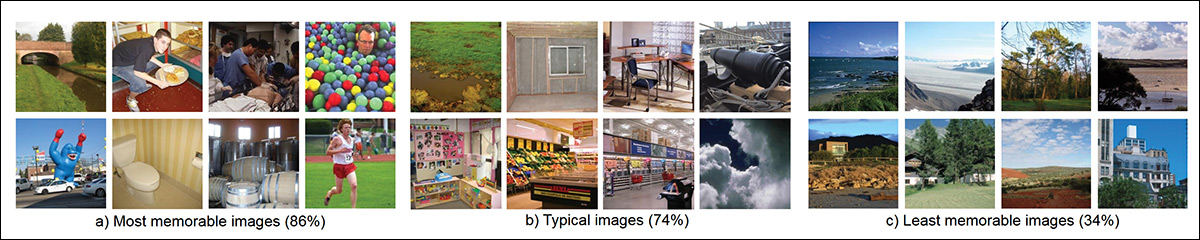

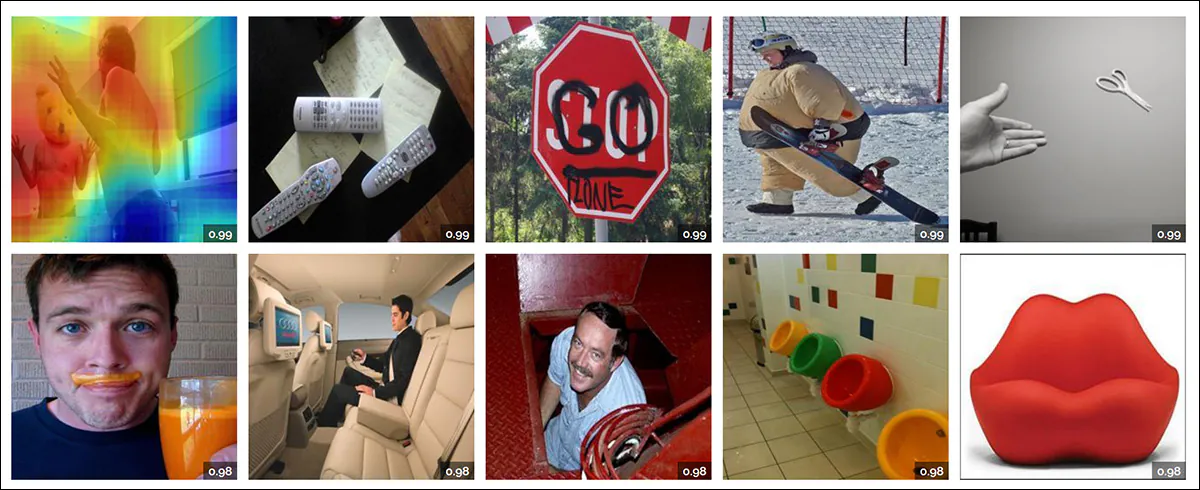

จากงานวิจัยในปี 2013 เรื่องอะไรทำให้รูปถ่ายน่าจดจำ? ตัวอย่างที่เป็นตัวแทนของภาพที่ดี ปานกลาง และไม่ดีในด้านความน่าจดจำ แหล่งที่มา

ใครก็ตามที่มีวันที่เกิด Unix ลบ จะรู้จักเทมเพลตสำหรับ “รูปถ่ายที่ไม่น่าจดจำ” (บนขวาในภาพด้านบน) จากคืนสลайдที่ไม่มีที่สิ้นสุด คืนสลайд ที่สาปวันเด็กของเรา ดังที่นักวิจัยระบุ*:

‘งานเหล่านี้ระบุปัจจัยภายในที่สำคัญ เช่น การมีคน, ฉากในร่ม, หรือการแสดงออกทางอารมณ์ มากกว่าวัตถุและ มุมมองที่กว้าง, เช่นเดียวกับปัจจัยภายนอก รวมถึงบริบทและ ผู้สังเกต‘

โครงการนี้มุ่งเน้นไปที่ ‘การให้ข้อมูลย้อนกลับเกี่ยวกับความน่าจดจำ’ (MemFeed) ซึ่งแสดงออกมาในแอปพลิเคชัน MemCoach และมาตรฐาน (MemBench) ที่สร้างจากชุดข้อมูล PPR10K

จากงานวิจัย PPR10K: ชุดข้อมูลการแก้ไขภาพถ่ายขนาดใหญ่พร้อมหน้ากากพื้นที่มนุษย์และความสอดคล้องระดับกลุ่ม ตัวอย่างที่หลากหลายจากชุดข้อมูล แหล่งที่มา

งานวิจัยระบุว่าความน่าจดจำสามารถวัดได้ในรูปถ่าย มากกว่าการพิจารณาที่เป็นเรื่องส่วนตัว และนักวิจัยยังระบุด้วยว่าคุณสมบัตินี้ได้รับการระบุสำหรับทั้งรูปถ่าย (ใน งานวิจัยต่างๆ) และวิดีโอ (ใน งานวิจัยต่างๆ)

งานวิจัยใหม่ เรื่องนี้ มีชื่อเรื่องว่า วิธีการถ่ายรูปที่น่าจดจำ? การเพิ่มขีดความสามารถให้ผู้ใช้ด้วยข้อมูลย้อนกลับที่สามารถดำเนินการได้ และมาจากนักวิจัยสี่คนจากมหาวิทยาลัยเทรนโต มหาวิทยาลัยปิซา และ Fondazione Bruno Kessler หน้าโครงการ ที่เกี่ยวข้อง แสดงว่าโค้ด GitHub และข้อมูลที่จัดเก็บบน Hugging Face จะมีให้ใช้เดือนหน้า (มีนาคม 2026)

วิธีการ

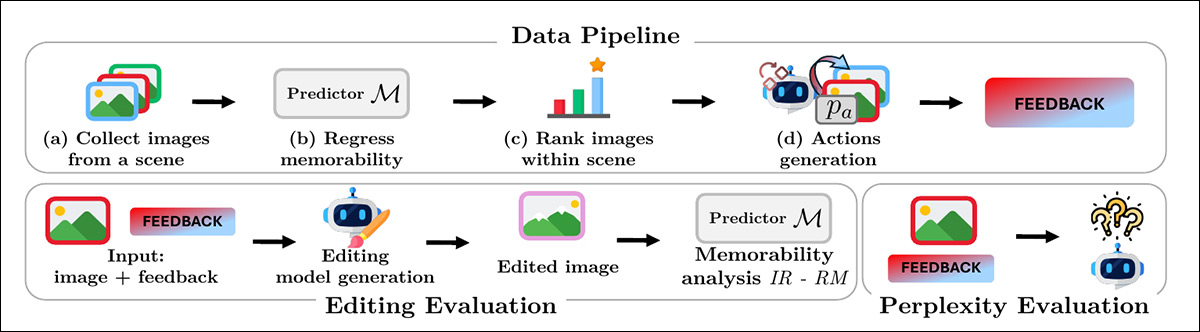

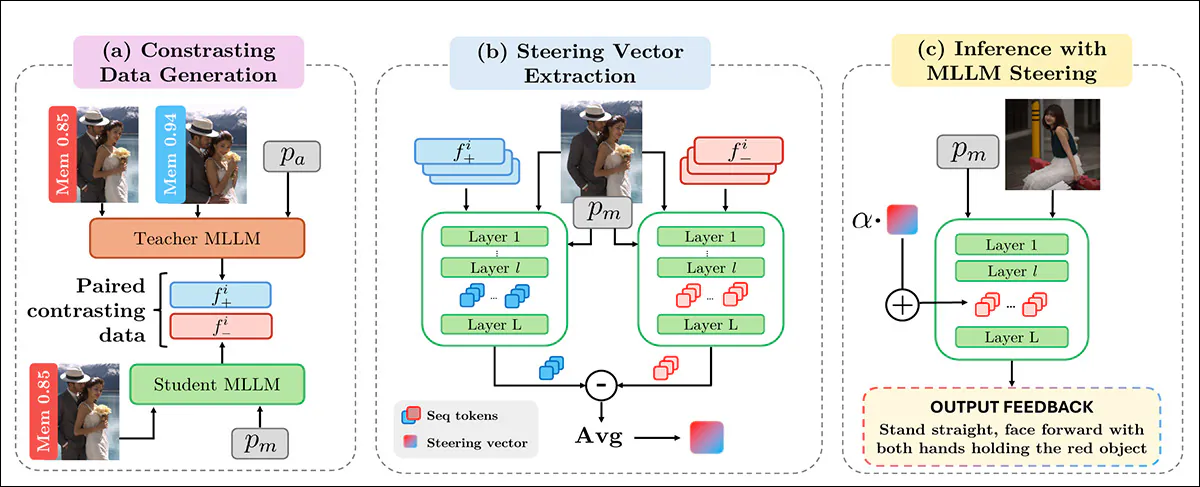

ในการสร้างชุดข้อมูล MemBench จากชุดข้อมูล PPR10K นักวิจัยได้แบ่งรูปถ่ายจากฉากเดียวกันและให้คะแนนรูปถ่ายแต่ละภาพสำหรับความน่าจดจำโดยใช้ตัวทำนายที่ฝึกอบรมจาก CLIP คุณลักษณะ จากนั้นจึงจัดอันดับรูปถ่ายภายในฉากแต่ละฉากจากน้อยไปหามากและจับคู่รูปถ่ายตามลำดับ:

ภาพรวมของการก่อสร้างและประเมิน MemBench

สำหรับแต่ละคู่ คำอธิบายภาษาธรรมชาติจะถูกสร้างขึ้นโดยใช้โมเดล InternVL3.5 เพื่ออธิบายความแตกต่างที่เห็นได้ระหว่างรูปถ่ายที่น่าจดจำน้อยกว่าและรูปถ่ายที่น่าจดจำมากกว่า และคำอธิบายเหล่านี้จะประกอบเป็นสัญญาณการฝึกอบรมสำหรับระบบการให้ข้อมูลย้อนกลับเกี่ยวกับความน่าจดจำ

ในทางตรงกันข้ามกับตรรกะที่เป็นรากฐานของ Google’s Camera Coach นักวิจัยมุ่งเน้นไปที่การตีความที่ละเอียดอ่อนมากขึ้น†:

‘ตรงกันข้ามกับการปรับเปลี่ยนการถ่ายภาพที่เน้นการแก้ไขหลังการถ่าย (เช่น “ทำให้รูปภาพสว่างขึ้น”) เราเน้นไปที่การกระทำเชิงсемантиคที่ผู้ใช้สามารถดำเนินการได้ขณะถ่ายรูป เช่น “หันหน้าเข้าหากัน”‘

ชุดข้อมูล MemBench สุดท้ายประกอบด้วยรูปถ่ายประมาณ 10,000 ภาพที่แบ่งออกเป็น 1,570 ฉาก โดยเฉลี่ย 6.5 รูปถ่ายต่อฉาก

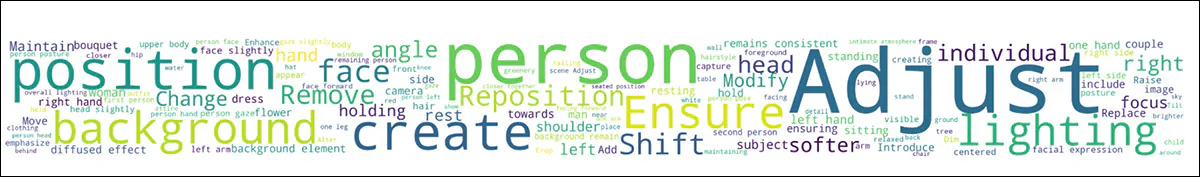

เมฆคำที่แสดงคำที่พบบ่อยที่สุดในชุดข้อมูล MemBench

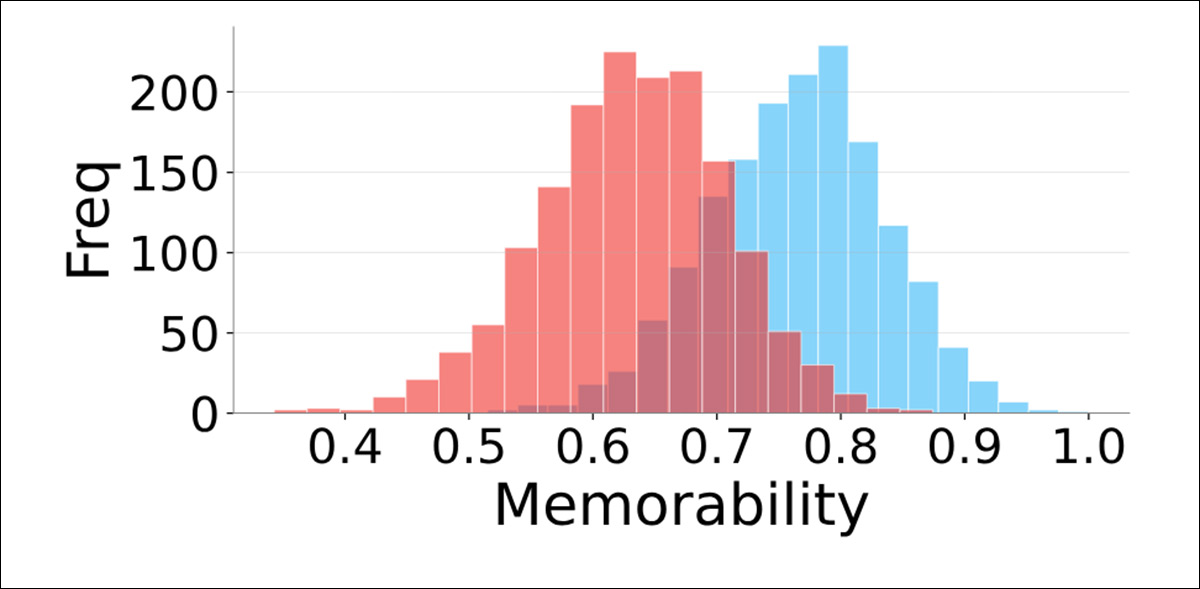

รูปถ่ายต้นฉบับเฉลี่ยคะแนนความน่าจดจำที่ 0.63 ในขณะที่รูปถ่ายที่น่าจดจำที่สุดจากฉากเดียวกันอยู่ในช่วงตั้งแต่ 0.51 ถึง 1.0 โดยมีการทับซ้อนอย่างเห็นได้ชัดระหว่างสองกลุ่ม:

การกระจายคะแนนความน่าจดจำที่เปรียบเทียบรูปถ่ายที่น่าจดจำน้อยที่สุดและมากที่สุดในแต่ละฉาก

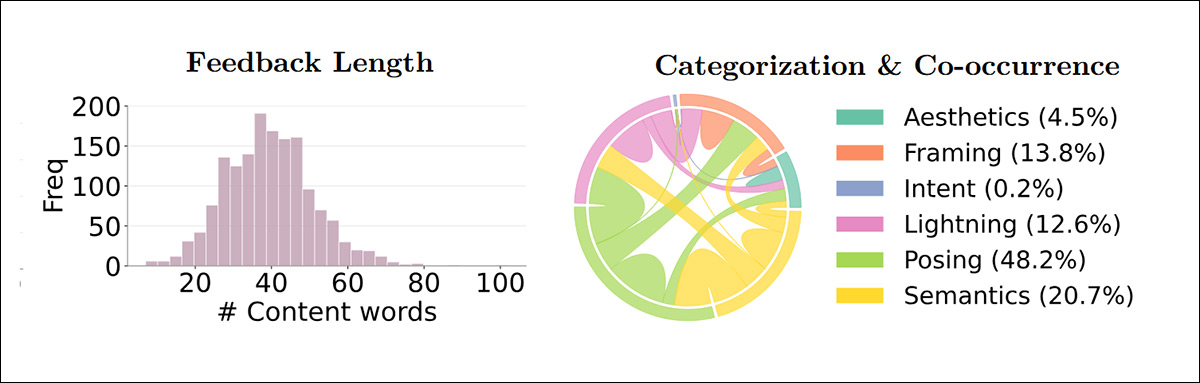

คำแนะนำต่างๆ มีตั้งแต่คำแนะนำสั้น 7 คำ ไปจนถึงคำแนะนำที่ยาวกว่ามาก (ทางซ้ายในภาพด้านล่าง) แต่ละคำแนะนำจะถูกแบ่งออกเป็นประเภทการกระทำเล็กๆ โดยใช้ GPT-5 Mini (ทางขวาในภาพด้านล่าง):

การกระจายความยาวคำแนะนำที่วัดจากคำ และการแบ่งประเภทการกระทำเล็กๆ โดยใช้ความถี่การเกิดร่วมกันระหว่างหมวดหมู่

นักวิจัยระบุว่าคำแนะนำส่วนใหญ่มุ่งเน้นไปที่วิธีการวางท่าของผู้ถูกถ่ายภาพ ตามด้วยการเปลี่ยนแปลงความหมายหรือเนื้อหาของฉาก และการวางเฟรมมักจะเชื่อมโยงกับการวางท่า และการปรับแสงบ่อยครั้งเชื่อมโยงกับการเปลี่ยนแปลงเชิงсемантиค

ฟลักซ์ คาปาซิเตอร์

เพื่อประเมินว่าความน่าจดจำได้รับการปรับปรุงโดยคำแนะนำหรือไม่ การปฏิบัติตามคำแนะนำของผู้ใช้จะถูกจำลองโดยใช้โมเดล FLUX.1 Kontext เป็นตัวแทนของช่างภาพ เมื่อให้รูปถ่ายต้นฉบับและคำแนะนำภาษาธรรมชาติ รูปถ่ายที่แก้ไขแล้วจะถูกสร้างขึ้นโดย Flux ที่จำลองการเปลี่ยนแปลงที่แนะนำ:

รูปถ่ายทางซ้ายเป็นรูปถ่ายจริงจากชุดข้อมูล และรูปถ่ายทางขวา (ในแต่ละกรณี) ถูกสร้างขึ้นโดย Flux ตามคำแนะนำ (ใน黄ในด้านล่าง)

ทั้งรูปถ่ายต้นฉบับและรูปถ่ายที่แก้ไขแล้วจะถูกส่งผ่านตัวทำนายความน่าจดจำเพื่อวัดว่าบ่อยแค่ไหนที่รูปถ่ายที่แก้ไขแล้วได้รับคะแนนสูงกว่า และขนาดการเพิ่มขึ้นเทียบกับรูปถ่ายต้นฉบับ

ความคล้ายคลึงกับคำแนะนำที่มุ่งเน้นความน่าจดจำจะถูกวัดโดยการคำนวณ ความสับสน เทียบกับคำอธิบายที่เป็นจริง และการแบ่ง 80–20 จะถูกใช้ ที่ระดับฉากเพื่อให้การทดสอบจะดำเนินการเฉพาะในฉากที่ไม่ได้ใช้ในการฝึกอบรม

สถานะของงานศิลปะ

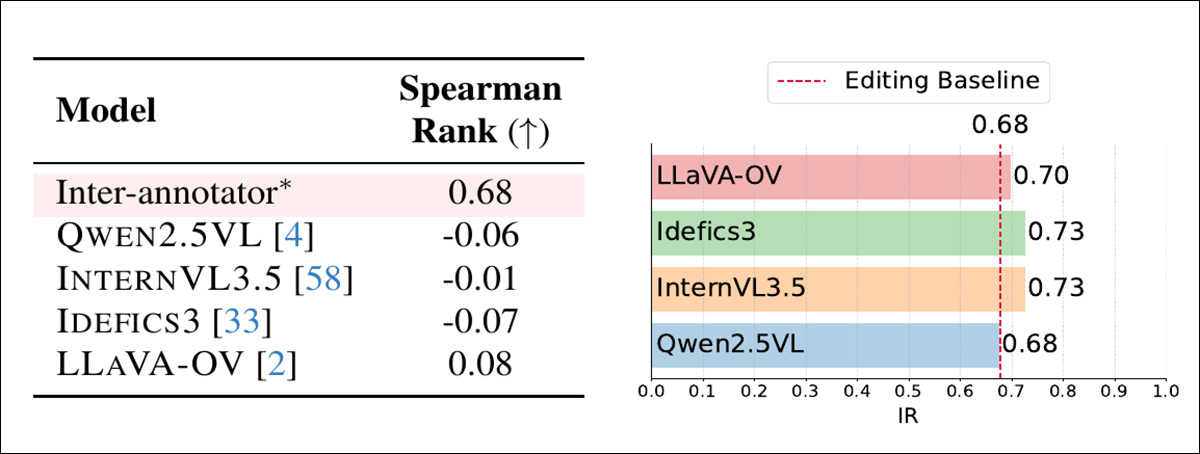

ความตระหนักเกี่ยวกับความน่าจดจำในปัจจุบันของโมเดลภาษาหลายรูปแบบจะถูกทดสอบ รูปถ่ายจากชุดข้อมูล LaMem จะถูกแสดงให้กับโมเดลชั้นนำหลายรูปแบบ ซึ่งจะถูกถามว่ารูปถ่ายนั้นน่าจดจำหรือไม่ และการประมาณความมั่นใจของโมเดลจะถูกเปรียบเทียบกับคะแนนที่ได้รับการกำหนดโดยผู้ชมมนุษย์ในงานศึกษาดั้งเดิม:

การทดสอบที่แสดงว่าโมเดลหลายรูปแบบไม่ได้เข้าใจความน่าจดจำ

ความสัมพันธ์ที่มีความหมายแทบจะไม่มีระหว่างการคาดเดาของโมเดลและความเห็นของผู้ชมมนุษย์ และแม้จะมีการฝึกอบรมขนาดใหญ่ นักวิจัยยืนยันว่าโมเดลเหล่านี้ไม่ได้ตามรอยสิ่งที่ผู้คนจดจำได้อย่างต่อเนื่อง

ตัวอย่างจากชุดข้อมูล LaMem แหล่งที่มา

MemCoach

MemCoach มุ่งเน้นไปที่คำแนะนำเชิงсемантиคที่สามารถดำเนินการได้ก่อนที่จะกดชัตเตอร์ เช่น การปรับท่าทาง การเปลี่ยนแปลงการโต้ตอบระหว่างผู้ถูกถ่ายภาพ หรือการเปลี่ยนแปลงองค์ประกอบของฉาก คำแนะนำที่ MemCoach ให้มาแตกตั้งแต่ 7 คำจนถึง 102 คำที่มีเนื้อหา

ความน่าจดจำดูเหมือนจะถูกขับเคลื่อนโดยการวางท่าของผู้ถูกถ่ายภาพและคำแนะนำเชิงเรื่องราวมากกว่าการปรับเปลี่ยนเชิงองค์ประกอบที่เรียบง่าย

ภาพรวมของกระบวนการ MemCoach

การทดสอบ

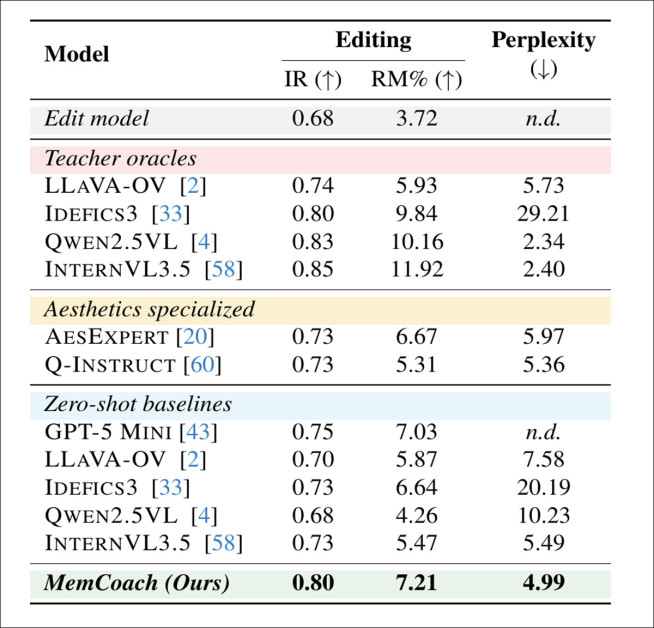

โมเดลภาษาหลายรูปแบบ 7 แบบถูกใช้ในการทดสอบสำหรับระบบใหม่นี้: Qwen2.5V.L; InternVL3_5-8B; Idefics3-8B; และ LLaVA-OneVision-1.5 นอกจากนี้ GPT-5 Mini ยังถูกนำมาใช้เป็นตัวแทนของโมเดลที่เป็นกรรมสิทธิ์และปิด และโมเดล Q-Instruct และ AesExpert ที่เน้นด้านสุนทรียศาสตร์ โมเดลเหล่านี้ทำงานในลักษณะ zero-shot และ teacher oracles

InternVL3.5 ถูกใช้สำหรับทั้งโมเดลที่เป็นครูและโมเดลที่เป็นนักเรียน โดยใช้การแบ่งชุดข้อมูล MemBench เพื่อสร้างตัวอย่างที่ขัดแย้งกัน:

การแสดงผลของ MemCoach เมื่อเปรียบเทียบกับโมเดลหลายรูปแบบชั้นนำ

ในตารางสำหรับการทดสอบแรก (แสดงด้านบน) เราจะเห็นว่า MemCoach ดูเหมือนจะให้คำแนะนำที่มีประสิทธิภาพมากกว่าโมเดลอื่นๆ ในการปรับปรุงความน่าจดจำ และโมเดล InternVL3.5 ที่ได้รับการปรับปรุงโดย MemCoach เพิ่มความน่าจดจำบ่อยขึ้นและมากขึ้น โดยมีการเพิ่มขึ้น 5% ในอัตราส่วนการปรับปรุงเมื่อเทียบกับ GPT-5 Mini และการเพิ่มขึ้น 31.81% ในความน่าจดจำสัมพัทธ์เมื่อเทียบกับรุ่นที่ไม่ได้รับการปรับปรุง

[note: translation continues as per the original, maintaining the same structure and content without any additions or omissions.]