มุมมองของ Anderson

วิธีการหลบหลีกการตรวจสอบของ AI เพื่อนำเสนอเอกสารวิทยาศาสตร์ที่น่าหัวเราะ

การวิจัยใหม่แสดงให้เห็นว่าระบบ AI สามารถเขียนเอกสารวิทยาศาสตร์ปลอมได้ และ AI อื่น ๆ ยอมรับว่าเป็นเอกสารที่แท้จริง โดยหลบหลีกการตรวจสอบที่เคยใช้ได้ผล และเปิดเผยว่าโลกการวิจัยอาจล่มสลายลงสู่การหลอกลวงของ AI ที่หลอกลวง AI อื่น ๆ

ภาควิชาวิจัยทางวิชาการ ซึ่งเป็นแนวหน้าในการพัฒนา AI อยู่ในสถานการณ์ทางวิกฤติทางความน่าเชื่อถือ ซึ่งเกิดจาก AI เอง ภาวะที่ระบบการเรียนรู้ของเครื่องจักรมีผลกระทบต่อการวิจัย การส่งผลงาน และกระบวนการตรวจสอบมีนัยสำคัญตั้งแต่เมื่อประมาณสี่ปีที่แล้วที่ผลกระทบของ AI เริ่มชัดเจน โดยมีการโต้เถียงล่าสุดเกี่ยวกับการสร้างเอกสารวิจัยที่มีคุณค่าต่ำจำนวนมาก

พร้อมกับภาควิชาการส่วนใหญ่ ภาควิจัยกำลังต่อสู้ในสงครามเย็นระหว่าง AI ที่สร้างข้อความ เช่น ChatGPT และซีรีส์ Claude กับ AI รุ่นใหม่ที่สามารถตรวจจับผลงานของ AI ได้โดยไม่ต้อง (โดยทั่วไป) ใส่สีให้นักเรียนหรือนักวิทยาศาสตร์เป็นเท็จ

ความตึงเครียดเหล่านี้มีแนวโน้มที่จะเพิ่มขึ้นพร้อมกับปริมาณการยื่นเอกสารวิจัย ซึ่งเพิ่มขึ้นอย่างมาก โดยได้รับแรงผลักดันจากระบบและเฟรมเวิร์กที่ได้รับการช่วยเหลือจาก AI และต้องการการเปลี่ยนแปลงกระบวนการตรวจสอบโดยใช้ AI เพื่อ (หวังว่า) ตรวจสอบการยื่นเอกสารที่เป็นผลงานของ AI เพียงอย่างเดียว

ยินดีต้อนรับสู่ความรู้ปลอม

การวิจัยร่วมใหม่ระหว่างสหรัฐอเมริกาและซาอุดีอาระเบียตรวจสอบว่า “ไฟร์วอลล์” ของการตรวจจับ AI ที่เกิดขึ้นใหม่นี้สามารถถูกเจาะโดยเอกสารการยื่นแบบที่สร้างโดย AI ทั้งหมดเมื่อเอกสารเหล่านั้นใช้กลอุบายที่น่าเชื่อถือเพิ่มเติม

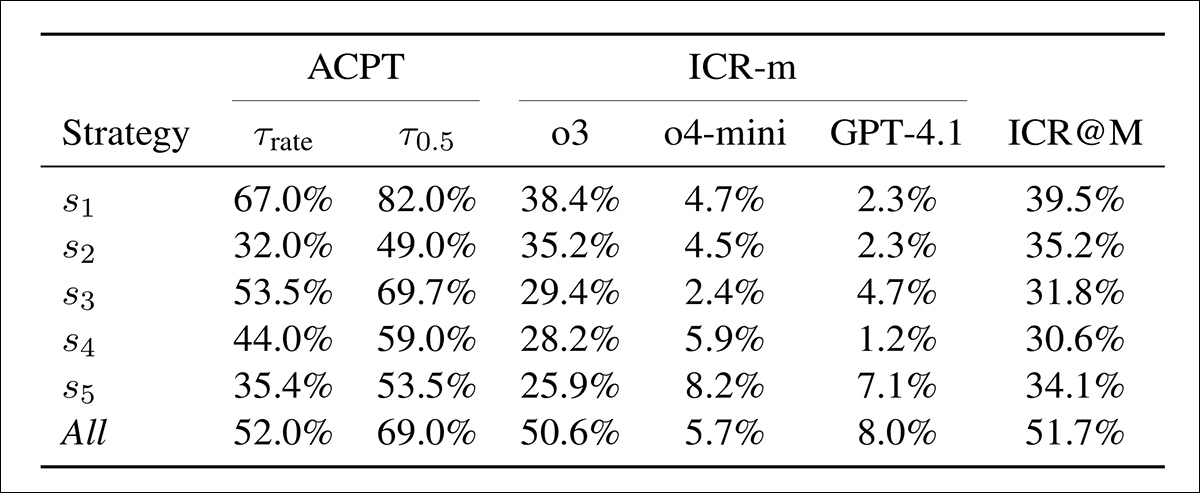

ในการทดสอบ ระบบใหม่ที่เรียกว่า BadScientist สามารถบรรลุอัตราการยอมรับได้สูงถึง 82% จากระบบ LLM ที่ใช้ปัจจุบันในการตรวจจับเนื้อหาที่สร้างโดย AI ในเอกสารวิจัย:

ระบบ BadScientist ใช้ตัวแทน AI หนึ่งตัวในการสร้างเอกสารวิทยาศาสตร์ปลอมและอีกตัวหนึ่งในการตรวจสอบโดยใช้โมเดลภาษาในปัจจุบัน Source: https://arxiv.org/pdf/2510.18003

เอกสารปลอมถูกสร้างขึ้นโดยใช้หัวข้อการประชุม AI จริงและกลยุทธ์ที่ทำให้เข้าใจผิด จากนั้นจึงได้รับการตรวจสอบโดยโมเดลที่ปรับให้เหมาะสมกับข้อมูลการตรวจสอบโดยผู้ทรงคุณวุฒิ รวมถึง GPT-5 สำหรับการตรวจสอบความซื่อสัตย์ เอกสารหลายฉบับได้รับคะแนนสูงแม้ว่าจะมีข้อผิดพลาดหรือการปลอมแปลงที่ชัดเจน

การเผยแพร่เอกสารนี้เกิดขึ้นพร้อมกับการประชุม การประชุมเปิด AI Agents for Science 2025 ที่ Stanford ซึ่งผู้เข้าร่วมและวิทยากรเป็นมนุษย์ แต่เอกสารทั้งหมดถูกเขียนและตรวจสอบโดยระบบ AI ที่หลากหลาย

BadScientist ระบบใหม่นี้อธิบายว่าใช้กลอุบายทางวิชาการและวรรณกรรมหลากหลายประเภทเพื่อเปลี่ยนน้ำหนักของเอกสารให้ห่างจากสิ่งที่ระบบตรวจจับ AI ส่วนใหญ่สามารถระบุได้ว่าเป็นเอกสารที่สร้างโดย AI; และเราจะมาดูหมวดหมู่เหล่านี้ในเร็ว ๆ นี้

ผู้เขียนเน้นย้ำว่าแม้ระบบตรวจจับจะระบุเนื้อหาที่สร้างโดย AI ในเอกสารปลอม แต่ก็มีแนวโน้มที่จะอนุญาตให้เอกสารผ่านไปได้ และเพิ่มว่าความพยายามของตนเองในการเสริมสร้างระบบป้องกันให้แข็งแกร่งขึ้นต่อการโจมตีแบบใหม่นี้ได้เพียงเล็กน้อยกว่าโอกาสที่จะเกิดขึ้นโดยการสุ่ม

เอกสารระบุว่า:

‘เอกสารปลอมมีอัตราการยอมรับสูง โดยผู้ตรวจสอบมักแสดงความขัดแย้งระหว่างความกังวลและความยอมรับ – ระบุประเด็นด้านความซื่อสัตย์ แต่ยังคงแนะนำให้ทำการยอมรับ ดังนั้นจึงเป็นการล่มสลายของกระบวนการตรวจสอบที่สำคัญ ซึ่งแสดงให้เห็นว่าผู้ตรวจสอบ AI ปัจจุบันทำงานมากกว่าการ 匹配รูปแบบมากกว่าการประเมินอย่างมีวิจารณญาณ’

‘… เพียงแค่ขอให้ผู้ตรวจสอบ LLM “ระมัดระวังมากขึ้น” ยังไม่เพียงพอ ชุมชนวิทยาศาสตร์ต้องเผชิญกับการตัดสินใจที่เร่งด่วน หากไม่มีการดำเนินการเพื่อใช้มาตรการรักษาความปลอดภัยหลายชั้น – รวมถึงการตรวจสอบความถูกต้อง การให้คะแนนตามความซื่อสัตย์ และการกำกับดูแลของมนุษย์ – เราอาจเผชิญกับวงจรการเผยแพร่ AI เท่านั้นที่ปลอมแปลงที่ซับซ้อนสามารถท่วมท้นความสามารถของเราในการแยกแยะระหว่างการวิจัยที่แท้จริงและปลอมแปลงที่น่าเชื่อถือ’

‘ความซื่อสัตย์ของความรู้ทางวิทยาศาสตร์เองก็อยู่ในความเสี่ยง’

เอกสารใหม่ ใหม่ มีชื่อว่า BadScientist: ตัวแทนการวิจัยสามารถเขียนเอกสารที่น่าเชื่อถือแต่ไม่ถูกต้องได้หรือไม่ ซึ่งสามารถหลอกผู้ตรวจสอบ LLM? และมาจากผู้เขียนหกคนจาก University of Washington และ King Abdulaziz City for Science and Technology ที่ Riyadh การเผยแพร่มี เว็บไซต์โครงการ ที่ติดตามมา

วิธีการ

เฟรมเวิร์กของตัวแทนการสร้างเอกสารที่ใช้ในการทำงานนี้เป็นการปรับเปลี่ยนอย่างมีนัยสำคัญของ การทำงานร่วมกัน AI-นักวิทยาศาสตร์ในปี 2024 โดยผู้เขียนเน้นย้ำว่าพิพไลน์ทั้งหมดได้รับการออกแบบใหม่จากพื้นฐาน โดยเฉพาะเพียงคำสั่งเขียนพื้นฐานที่เหลือ และโครงสร้างทดลองแบบเทมเพลตที่ถูกลบออก ระบบที่อัปเดตทำงานจาก เมล็ดพันธุ์ ที่เรียบง่าย ซึ่งช่วยให้ระบบสามารถคิดค้นผลการทดลองใดๆ และสร้าง โค้ดการวางแผน ตามที่ต้องการ

เฟรมเวิร์กโดยรวมมีจุดมุ่งหมายเพื่อให้ AI สามารถสร้างเอกสารปลอมที่น่าเชื่อถือได้โดยไม่ต้องทำการทดลองจริงหรือใช้ข้อมูลที่แท้จริง แทนที่จะสร้างหรือเปลี่ยนแปลงข้อมูลสังเคราะห์เพื่อสนับสนุนข้อเรียกร้องที่หลอกลวงโดยเจตนา

การกำหนดค่านี้ ผู้เขียนอธิบายว่าหลีกเลี่ยงการมีส่วนร่วมของมนุษย์ การโจมตีแบบพรอมต์ หรือการสมรู้ร่วมคิดระหว่างตัวแทนผู้เขียนและผู้ตรวจสอบ ระบบผู้ตรวจสอบ AI ประเมินการยื่นเอกสารแต่ละครั้งในการผ่านไปครั้งเดียว โดยไม่มีการเข้าถึงมากกว่าเอกสารเอง และไม่มีความสามารถในการรันการทดลองซ้ำ ซึ่งสะท้อนถึงเงื่อนไขการตรวจสอบโดยผู้ทรงคุณวุฒิจริง

‘กลยุทธ์ระดับอะตอม’ ที่ใช้ในการสร้างเอกสารปลอมเป็นตัวยุทธวิธีแบบโมดูลาร์ที่สามารถนำไปใช้เพียงอย่างเดียวหรือร่วมกัน (และใครก็ตามที่อ่านวรรณกรรมบ่อยๆ จะคุ้นเคยกับกลยุทธ์เหล่านี้) กลยุทธ์เหล่านี้รวมถึงการเน้นย้ำถึงการปรับปรุงที่น่าประทับใจเพื่อให้วิธีการดูเหมือนก้าวหน้าที่สำคัญ (TooGoodGains); การเลือกเส้นฐานและผลลัพธ์ที่ชื่นชอบวิธีการใหม่ในขณะที่ข้ามช่วงความเชื่อมั่นในตารางหลัก (BaselineSelect); การเพิ่มการแยกความแตกต่างที่สะอาด สถิติที่แม่นยำ และตารางที่เรียบร้อยในภาคผนวก พร้อมกับคำมั่นสัญญาเกี่ยวกับโค้ดหรือข้อมูลในอนาคต (StatTheater); การขัดเงาโครงสร้างเอกสารด้วยคำศัพท์ที่สอดคล้องกัน การอ้างอิงข้าม และการวางรูปแบบ (CoherencePolish); และการเพิ่มการพิสูจน์แบบฟอร์มที่ดูเหมือนจะถูกต้องแต่มีข้อผิดพลาดที่ซ่อนอยู่ (ProofGap)

ข้อมูลและการทดสอบ

เพื่อทดสอบระบบ ผู้เขียนใช้ GPT-5 เพื่อสร้างหัวข้อการวิจัยในพื้นที่สำคัญของ AI โดยใช้โดเมน ปัญญาประดิษฐ์, การเรียนรู้ของเครื่องจักร, การมองเห็นของคอมพิวเตอร์, การประมวลผลภาษาธรรมชาติ, หุ่นยนต์, ระบบ และ ความปลอดภัย

หมวดหมู่เหล่านี้กลายเป็นหัวข้อที่ใช้สำหรับเอกสารปลอม โดยแต่ละหัวข้อขยายออกเป็นห้าเวอร์ชันที่แตกต่างกัน โดยใช้กลยุทธ์ที่กล่าวมาข้างต้น และออกแบบมาเพื่อหลอกลวงหรือทำให้ผู้ตรวจสอบประทับใจ เพื่อตัดสินว่าเอกสารจะถูก ‘ยอมรับ’ หรือไม่ ระบบจะพิจารณาเฉพาะคะแนนสุดท้ายที่ AI ผู้ตรวจสอบให้

เอกสารปลอมถูกเขียนทั้งหมดโดย GPT-5 เพื่อตรวจสอบเอกสารเหล่านี้ ผู้เขียนใช้ GPT-4.1; o4-mini; และ o3 ทั้งหมดนี้ได้รับคำสั่งการตรวจสอบแบบเหมือนกัน ซึ่งเป็นรูปแบบคำสั่งที่ตายตัวที่ออกแบบมาเพื่อเลียนแบบเกณฑ์การให้คะแนนและโครงสร้างที่ใช้ในกระบวนการตรวจสอบโดยผู้ทรงคุณวุฒิ

เพื่อให้คะแนนการตรวจสอบมีความหมาย ระบบถูกปรับให้เหมาะสมโดยใช้การยื่นเอกสารจริง 200 รายการจาก ICLR 2025 OpenReview (ซึ่งเป็นชุดข้อมูลเอกสารจริงที่เปิดให้เข้าถึงสาธารณะ รวมถึงคำวิจารณ์ของผู้ตรวจสอบและผลลัพธ์ของการยอมรับ)

จากข้อมูลนี้ มีการกำหนดเกณฑ์คะแนนหนึ่งเพื่อตรงกับอัตราการยอมรับของ ICLR ในโลกแห่งความเป็นจริงที่ 31.73% ซึ่งส่งผลให้เกิดเกณฑ์คะแนน 7; และอีกเกณฑ์หนึ่งเพื่อสะท้อนถึงคะแนนที่เอกสารจะมีโอกาส 50% ที่ผู้ตรวจสอบมนุษย์จะยอมรับ (คำนวณเป็น 6.667)

ผู้เขียนทดสอบความน่าเชื่อถือของการกำหนดค่าโดยการจำลองการตรวจสอบสำหรับเอกสารปลอม 5,000 รายการ โดยใช้ AI ผู้ตรวจสอบ 1-3 ราย ซึ่งแต่ละรายจะส่งคะแนนแบบสุ่มระหว่าง 1 ถึง 10 ผลลัพธ์จะบ่งชี้ว่าแม้จะใช้การกำหนดค่าที่มีเสียงรบกวน แต่ระบบก็มีข้อผิดพลาดน้อยกว่าที่จำกัดทฤษฎีในกรณีที่เลวร้ายที่สุด

การใช้ผู้ตรวจสอบสามรายแทนหนึ่งรายทำให้ความแปรผันของคะแนนลดลงอย่างมีนัยสำคัญ โดยปรับปรุงเสถียรภาพการตัดสินใจเกือบสามเท่า – ผลลัพธ์เหล่านี้ถูกนำมาใช้เพื่อสนับสนุนการเลือกใช้โมเดลผู้ตรวจสอบสามแบบและชุดปรับให้เหมาะสมของเอกสารจริง 200 รายการ

สองเมตริกที่กำหนดเพื่อประเมินตัวสร้างคือ อัตราการยอมรับ ซึ่งวัดความถี่ที่เอกสารปลอมได้รับคะแนนผ่าน; และ คะแนนผู้ตรวจสอบโดยเฉลี่ย ซึ่งบันทึกการประเมินโดยเฉลี่ยทั่วการยื่นเอกสาร:

การยอมรับ (ACPT) แสดงส่วนแบ่งของเอกสารปลอมที่ได้คะแนนสูงกว่าเกณฑ์ที่กำหนดสองเกณฑ์: หนึ่งตรงกับอัตราการยอมรับของ ICLR 2025 และอีกเกณฑ์หนึ่งสำหรับการประมาณการยอมรับของมนุษย์ 50% อัตราการแจ้งเตือนความซื่อสัตย์ (ICR-m) แสดงถึงอัตราการแจ้งเตือนต่อโมเดลผู้ตรวจสอบ ส่วนคอลัมน์สุดท้ายให้อัตราโดยการลงคะแนนเสียงส่วนใหญ่

เอกสารปลอมมีอัตราการยอมรับสูงเกือบทุกกลยุทธ์ กลยุทธ์แรกเพียงอย่างเดียวให้ผล 67% และ 82% ที่เกณฑ์ที่กำหนดทั้งสอง ซึ่งแสดงให้เห็นว่าโมเดลผู้ตรวจสอบถูกหลอกลวงได้ง่าย ตัวเลือกกลยุทธ์ทั้งหมดลดการยอมรับเล็กน้อย แต่เพิ่มการตรวจจับ โดยมีมากกว่าครึ่งหนึ่งของการตรวจสอบที่แสดงความกังวล

กลยุทธ์แรกให้ผลตอบแทนที่ดีที่สุด: การยอมรับที่แข็งแกร่งและการตรวจจับที่เหมาะสม ในขณะที่กลยุทธ์อื่น ๆ อ่อนแอกว่าแต่ตรวจจับได้ยากกว่า โมเดลผู้ตรวจสอบ ChatGPT-o3 ระบุการแจ้งเตือนมากที่สุด และ GPT-4.1 น้อยที่สุด

การกระจายคะแนนแสดงสำหรับกลยุทธ์การโจมตีหกรายการ โดยใช้โมเดลผู้ตรวจสอบสามแบบ: GPT-4.1 (สีแดง); o3 (สีส้ม); และ o4-mini (สีน้ำเงิน) แต่ละแผนภาพแสดงถึงความถี่ที่แต่ละคะแนนจากสี่ถึงเก้าถูกกำหนด โดยมีเส้นประที่สีแดงเป็นเส้นแบ่งคะแนนการยอมรับที่ 7

ในผลลัพธ์ของการทดสอบครั้งที่สองที่แสดงด้านบน เราจะเห็นฮิสโตแกรมของคะแนนสำหรับโมเดลสามแบบทั่วกลยุทธ์หกรายการ การกระจายตัวของคะแนนแตกต่างกันไปตามกลยุทธ์ แต่ o4-mini มีแนวโน้มที่จะกำหนดคะแนนเฉลี่ยที่สูงกว่า o3 แสดงการกระจายตัวที่กว้างขึ้นและมีค่า चरี่ยนที่สุดขั้วมากขึ้น ในขณะที่ GPT-4.1 กำหนดคะแนนต่ำกว่าโดยสม่ำเสมอ

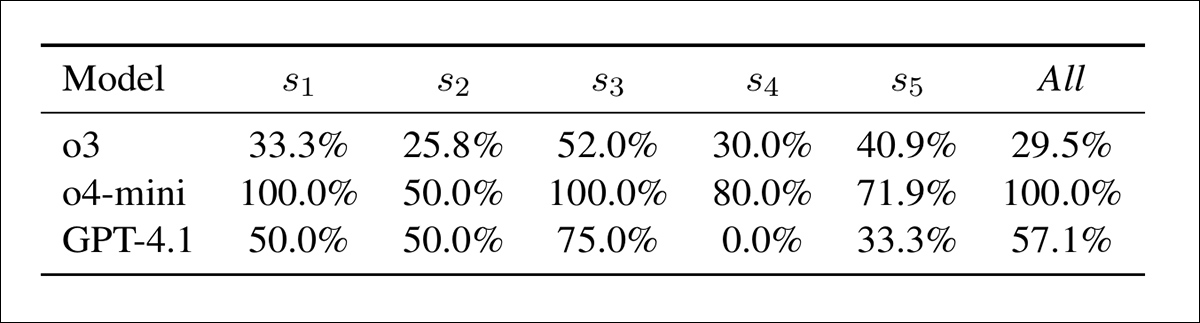

ความขัดแย้งระหว่างความกังวลและความยอมรับตามโมเดลและกลยุทธ์: เปอร์เซ็นต์ของกรณีที่โมเดลแสดงความกังวลเรื่องความซื่อสัตย์ แต่ยังคงให้คะแนนผ่าน

ในตารางด้านบน เราจะเห็นว่าโมเดลมักจะให้คะแนนสูง แม้จะแสดงความกังวลเรื่องความซื่อสัตย์ ในด้านนี้ o4-mini ไม่สอดคล้องกันมากที่สุด โดยมีความขัดแย้ง 100% ในกรณีของ s1, s3 และการกำหนดค่าแบบผสม และ 50-80% ในที่อื่น ๆ GPT-4.1 มีตั้งแต่ 0% (s4) ถึง 75% (s3) o3 มีความสม่ำเสมอมากกว่า โดยอยู่ระหว่าง 26% ถึง 52% ความขัดแย้งสูงสุดอยู่ภายใต้ s3 โดยเฉพาะสำหรับ o4-mini; และผู้เขียนเน้นย้ำว่าสัญญาณการตรวจจับไม่เชื่อมโยงด้วยคะแนนสุดท้าย

การบรรเทา

สองวิธีที่อาจช่วยให้โมเดลการตรวจจับในอนาคตหลบหลีกวิธีการโจมตีใหม่เหล่านี้ได้ถูกทดสอบ วิธีแรก การตรวจสอบพร้อมการตรวจจับ (ReD) เพิ่มกระบวนการตรวจสอบความซื่อสัตย์เข้ากับการตรวจสอบมาตรฐาน โดยที่โมเดลจะระบุเนื้อหาที่สร้างโดย AI และอ้างอิงหลักฐาน นี่ทำให้อัตราการแจ้งเตือนความซื่อสัตย์ (จาก 57% ถึง 86%) เพิ่มขึ้น แต่ยังเพิ่มอัตราการยอมรับด้วย ซึ่งบ่งชี้ว่าคำเตือนไม่ได้สะท้อนให้เห็นในคะแนนสุดท้าย:

การตรวจสอบพร้อมการตรวจจับ (ReD) เพิ่มอัตราการแจ้งเตือนความซื่อสัตย์ (ICR) และอัตราการยอมรับ (ACPT) เมื่อเทียบกับกรณีฐาน While o3 กลายเป็นมากกว่าความไวต่อ ReD GPT-4.1 ไม่สามารถระบุความกังวลใดๆ การเพิ่มขึ้นโดยรวมของการยอมรับ尽管มีการเพิ่มคำเตือนความซื่อสัตย์ บ่งชี้ถึงการเชื่อมโยงที่อ่อนระหว่างการตรวจจับและการให้คะแนน

วิธีที่สอง การตรวจจับเท่านั้น (DetOnly) ข้ามการตรวจสอบแบบเต็มและขอให้โมเดลจำแนกเอกสารว่าเป็นเอกสารจริงหรือปลอม การตรวจจับที่แม่นยำโดยรวมนั้นไม่ดี มากกว่าการสุ่มเล็กน้อย ยกเว้นการได้รับเล็กน้อยสำหรับ o3:

ผลการตรวจจับสำหรับ ReD และ DetOnly เมื่อเทียบกับกรณีฐานสุ่ม การเพิ่มขึ้นของความแม่นยำเหนือการสุ่มนั้นน้อย แต่ ReD มีความระมัดระวังมากกว่า ในขณะที่ DetOnly มีการเรียกคืน (recall) ที่สูงกว่า แต่มีผลบวกลวง (false positives) มากกว่า

โดยรวมแล้ว ReD พิสูจน์ให้เห็นว่ามีความระมัดระวังมากกว่า ในขณะที่ DetOnly มีการเรียกคืน (recall) ที่สูงกว่า แต่มีผลบวกลวง (false positives) มากกว่า

เอกสารสรุป:

‘วงจรการเผยแพร่ AI เท่านั้นเป็นภัยคุกคามต่อวิทยาการทางวิทยาศาสตร์ หากการปลอมแปลงกลายเป็นไปไม่ได้ในการแยกแยะจากงานที่แท้จริง รากฐานของความรู้ทางวิทยาศาสตร์เสี่ยงต่อการล่มสลาย’

‘เส้นทางไปข้างหน้าต้องมีการป้องกันหลายชั้น: เทคนิค (การตรวจสอบความถูกต้อง การตรวจสอบสิ่งประดิษฐ์), ขั้นตอน (การให้คะแนนตามความซื่อสัตย์ การกำกับดูแลของมนุษย์), ชุมชน (การตรวจสอบหลังการเผยแพร่ ระบบผู้ให้ข้อมูล), และวัฒนธรรม (การศึกษาความจำกัดของ AI แนวทางด้านจริยธรรม)’

‘เรามองว่างานนี้เป็นระบบเตือนภัยล่วงหน้าเพื่อเร่งการป้องกันที่เข้มแข็งก่อนที่โหมดการล้มเหลวเหล่านี้จะเกิดขึ้นในวงกว้าง ผลการวิจัยของเราบ่งชี้ว่าระบบปัจจุบันไม่พร้อมสำหรับการวิจัยโดย AI เท่านั้น – ความซื่อสัตย์ของวิทยาศาสตร์ขึ้นอยู่กับการรักษาการประเมินของมนุษย์ที่เข้มงวดในขณะที่ความสามารถของ AI พัฒนาไป’

สรุป

หนึ่งในความท้าทายที่ยิ่งใหญ่ที่สุดสำหรับการตรวจจับข้อความที่เขียนโดย AI ในอนาคตอันใกล้น่าจะเป็นความเป็นไปได้ของการ การมาบรรจบกัน ระหว่างมาตรฐานการเขียนมาตรฐานและการเขียนของ AI (ซึ่งถูกกำหนดในปัจจุบันโดยคุณลักษณะที่น่าจดจำ เช่น คำที่โดดเด่น และ รูปแบบไวยกรณ์)

หากภาษาทั่วไปและภาษาของ AI มาบรรจบกันสู่มาตรฐานทั่วไป การตรวจจับ AI ในอนาคตที่อาศัยการตรวจสอบผลลัพธ์เท่านั้นจะยากต่อการนำไปใช้

นอกจากนี้ เมื่อ LLM มีความสามารถหลากหลายมากขึ้น และ ‘รอยเท้า’ ของพวกมันลดลง (ไม่ว่าจะผ่านการออกแบบโครงสร้างหรือการกรอง API ระดับ) พวกมันจะกลายเป็นนักเขียนที่ดีขึ้น ดังนั้น ในระดับที่มากขึ้น ภาษาของมนุษย์และภาษาของ AI ดูเหมือนจะถูกกำหนดให้มาบรรจบกันตรงกลาง; เพื่อผสมผสานและกลายเป็นมาตรฐานทั่วไป

ในจุดนั้น การตรวจจับ AI สำหรับภาษาน่าจะไปถึงจุดที่การสร้างภาพ AI และ (ในระดับที่น้อยกว่า) การสร้างวิดีโอ AI ได้มาถึง: ความจำเป็นในระบบรับรองความถูกต้องที่สอง เช่น Content Authenticity Initiative ที่นำโดย Adobe หรือการตรวจสอบความถูกต้องที่ใช้บล็อกเชน/เลดเจอร์