ปัญญาประดิษฐ์

วันครบรอบปีแรกของ ChatGPT: พลิกโฉมอนาคตของการโต้ตอบของ AI

เมื่อพิจารณาถึงปีแรกของ ChatGPT เห็นได้ชัดว่าเครื่องมือนี้ได้เปลี่ยนแปลงฉาก AI ไปอย่างมาก ChatGPT เปิดตัวเมื่อปลายปี 2022 โดยโดดเด่นด้วยรูปแบบการสนทนาที่เป็นมิตรต่อผู้ใช้ ซึ่งทำให้การโต้ตอบกับ AI รู้สึกเหมือนการแชทกับบุคคลมากกว่าเครื่องจักร แนวทางใหม่นี้ดึงดูดสายตาของสาธารณชนได้อย่างรวดเร็ว ภายในเวลาเพียงห้าวันหลังจากการเปิดตัว ChatGPT ก็สามารถดึงดูดผู้ใช้ได้นับล้านคนแล้ว ภายในต้นปี 2023 จำนวนดังกล่าวเพิ่มขึ้นเป็นประมาณ 100 ล้านรายต่อเดือน และภายในเดือนตุลาคม แพลตฟอร์มดังกล่าวมีผู้เข้าชมประมาณ 1.7 พันล้านครั้งทั่วโลก ตัวเลขเหล่านี้บ่งบอกถึงความนิยมและประโยชน์ของมัน

ในปีที่ผ่านมา ผู้ใช้ได้ค้นพบวิธีที่สร้างสรรค์ทุกประเภทในการใช้ ChatGPT ตั้งแต่งานง่ายๆ เช่น การเขียนอีเมลและการอัปเดตเรซูเม่ ไปจนถึงการเริ่มต้นธุรกิจที่ประสบความสำเร็จ แต่ไม่ใช่แค่ว่าผู้คนใช้มันอย่างไรเท่านั้น เทคโนโลยีเองก็มีการเติบโตและปรับปรุง ในตอนแรก ChatGPT เป็นบริการฟรีที่ให้การตอบกลับข้อความโดยละเอียด ขณะนี้มี ChatGPT Plus ซึ่งรวมถึง ChatGPT-4 เวอร์ชันที่อัปเดตนี้ได้รับการฝึกอบรมเกี่ยวกับข้อมูลมากขึ้น ให้คำตอบที่ผิดน้อยลง และเข้าใจคำสั่งที่ซับซ้อนได้ดีขึ้น

หนึ่งในการอัปเดตที่ใหญ่ที่สุดคือตอนนี้ ChatGPT สามารถโต้ตอบได้หลายวิธี - สามารถฟัง พูด และแม้แต่ประมวลผลภาพได้ ซึ่งหมายความว่าคุณสามารถพูดคุยกับมันผ่านแอพมือถือและแสดงรูปภาพเพื่อรับการตอบกลับ การเปลี่ยนแปลงเหล่านี้ได้เปิดโอกาสใหม่ๆ ให้กับ AI และได้เปลี่ยนวิธีที่ผู้คนมองและคิดเกี่ยวกับบทบาทของ AI ในชีวิตของเรา

จากจุดเริ่มต้นในการสาธิตเทคโนโลยีจนถึงสถานะปัจจุบันในฐานะผู้เล่นหลักในโลกเทคโนโลยี การเดินทางของ ChatGPT ค่อนข้างน่าประทับใจ ในตอนแรกมันถูกมองว่าเป็นวิธีการทดสอบและปรับปรุงเทคโนโลยีโดยได้รับคำติชมจากสาธารณะ แต่มันกลายเป็นส่วนสำคัญของภูมิทัศน์ AI อย่างรวดเร็ว ความสำเร็จนี้แสดงให้เห็นว่าการปรับแต่งโมเดลภาษาขนาดใหญ่ (LLM) ได้อย่างมีประสิทธิภาพด้วยทั้งการเรียนรู้ภายใต้การดูแลและการตอบรับจากมนุษย์ ด้วยเหตุนี้ ChatGPT จึงสามารถจัดการกับคำถามและงานได้หลากหลาย

การแข่งขันเพื่อพัฒนาระบบ AI ที่มีความสามารถและหลากหลายที่สุดได้นำไปสู่การแพร่หลายของทั้งโมเดลโอเพ่นซอร์สและที่เป็นกรรมสิทธิ์ เช่น ChatGPT การทำความเข้าใจความสามารถทั่วไปจำเป็นต้องมีการวัดประสิทธิภาพที่ครอบคลุมในงานที่หลากหลาย ส่วนนี้จะสำรวจเกณฑ์มาตรฐานเหล่านี้ โดยให้ความกระจ่างว่าโมเดลต่างๆ รวมถึง ChatGPT แข่งขันกันอย่างไร

การประเมิน LLM: เกณฑ์มาตรฐาน

- MT-ม้านั่ง: เกณฑ์มาตรฐานนี้ทดสอบการสนทนาแบบหลายรอบและความสามารถในการปฏิบัติตามคำแนะนำในแปดโดเมน ได้แก่ การเขียน การแสดงบทบาทสมมติ การดึงข้อมูล การใช้เหตุผล คณิตศาสตร์ การเขียนโค้ด ความรู้ด้าน STEM และมนุษยศาสตร์/สังคมศาสตร์ LLM ที่แข็งแกร่งกว่าเช่น GPT-4 ถูกใช้เป็นผู้ประเมิน

- อัลปาก้าEval: ตามชุดการประเมิน AlpacaFarm ตัวประเมินอัตโนมัติที่ใช้ LLM นี้จะเปรียบเทียบแบบจำลองเทียบกับการตอบสนองจาก LLM ขั้นสูง เช่น GPT-4 และ Claude โดยคำนวณอัตราการชนะของแบบจำลองที่ผู้สมัครสอบ

- เปิดลีดเดอร์บอร์ด LLM: การใช้สายรัดการประเมินโมเดลภาษา บอร์ดผู้นำนี้จะประเมิน LLM บนเกณฑ์มาตรฐานหลัก XNUMX รายการ รวมถึงความท้าทายในการให้เหตุผลและการทดสอบความรู้ทั่วไป ทั้งในการตั้งค่าแบบ Zero-shot และแบบไม่กี่ช็อต

- ม้านั่งใหญ่: มาตรฐานความร่วมมือนี้ครอบคลุมงานภาษาใหม่กว่า 200 งาน ครอบคลุมหัวข้อและภาษาที่หลากหลาย โดยมีจุดมุ่งหมายเพื่อตรวจสอบ LLM และคาดการณ์ความสามารถในอนาคต

- ChatEval: กรอบการอภิปรายหลายตัวแทนที่ช่วยให้ทีมสามารถอภิปรายและประเมินคุณภาพของคำตอบจากแบบจำลองที่แตกต่างกันเกี่ยวกับคำถามปลายเปิดและงานการสร้างภาษาธรรมชาติแบบดั้งเดิมได้โดยอัตโนมัติ

ประสิทธิภาพเปรียบเทียบ

ในแง่ของเกณฑ์มาตรฐานทั่วไป LLM แบบโอเพ่นซอร์สได้แสดงให้เห็นถึงความก้าวหน้าที่น่าทึ่ง ลามะ-2-70Bตัวอย่างเช่น ได้รับผลลัพธ์ที่น่าประทับใจ โดยเฉพาะอย่างยิ่งหลังจากได้รับการปรับแต่งข้อมูลคำสั่งอย่างละเอียดแล้ว รุ่น Llama-2-chat-70B เก่งใน AlpacaEval ด้วยอัตราการชนะ 92.66% เหนือกว่า GPT-3.5-turbo อย่างไรก็ตาม GPT-4 ยังคงเป็นผู้นำด้วยอัตราการชนะ 95.28%

เซเฟอร์-7Bซึ่งเป็นรุ่นที่เล็กกว่า แสดงให้เห็นความสามารถเทียบได้กับ LLM ขนาดใหญ่กว่า 70B โดยเฉพาะใน AlpacaEval และ MT-Bench ในขณะเดียวกัน WizardLM-70B ซึ่งได้รับการปรับแต่งอย่างละเอียดด้วยข้อมูลคำสั่งที่หลากหลาย ได้คะแนนสูงสุดในบรรดา LLM แบบโอเพ่นซอร์สบน MT-Bench อย่างไรก็ตาม มันยังคงตามหลัง GPT-3.5-turbo และ GPT-4

รายการที่น่าสนใจ GodziLLa2-70B ได้รับคะแนนการแข่งขันบน Open LLM Leaderboard โดยแสดงให้เห็นถึงศักยภาพของแบบจำลองทดลองที่รวมชุดข้อมูลที่หลากหลาย ในทำนองเดียวกัน Yi-34B ซึ่งพัฒนาตั้งแต่เริ่มต้น โดดเด่นด้วยคะแนนที่เทียบได้กับ GPT-3.5-turbo และตามหลัง GPT-4 เพียงเล็กน้อยเท่านั้น

UltraLlama พร้อมการปรับแต่งข้อมูลที่หลากหลายและมีคุณภาพสูง จับคู่ GPT-3.5-turbo ในเกณฑ์มาตรฐานที่เสนอ และยังเหนือกว่าในด้านความรู้ทางวิชาชีพและระดับโลกอีกด้วย

การขยายขนาด: การเพิ่มขึ้นของ LLM ยักษ์ใหญ่

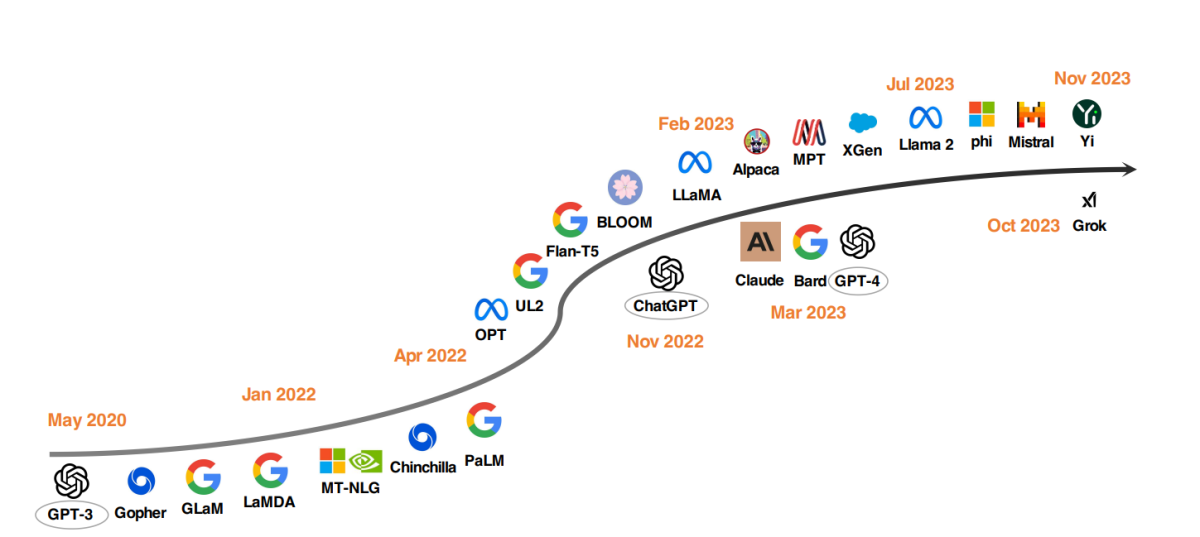

แนวโน้มที่โดดเด่นในการพัฒนา LLM คือการขยายขนาดของพารามิเตอร์โมเดล โมเดลอย่าง Gopher, GLaM, LaMDA, MT-NLG และ PaLM ได้ก้าวข้ามขีดจำกัด จนมาถึงจุดสูงสุดในโมเดลที่มีพารามิเตอร์มากถึง 540 พันล้านพารามิเตอร์ โมเดลเหล่านี้ได้แสดงให้เห็นถึงความสามารถที่โดดเด่น แต่ลักษณะแบบโอเพนซอร์สได้จำกัดการใช้งานในวงกว้าง ข้อจำกัดนี้ได้กระตุ้นความสนใจในการพัฒนา LLM แบบโอเพ่นซอร์ส ซึ่งเป็นแนวโน้มที่กำลังได้รับแรงผลักดัน

ควบคู่ไปกับการขยายขนาดแบบจำลอง นักวิจัยได้สำรวจกลยุทธ์ทางเลือกต่างๆ แทนที่จะแค่สร้างโมเดลให้ใหญ่ขึ้น พวกเขามุ่งเน้นไปที่การปรับปรุงการฝึกสอนโมเดลขนาดเล็กก่อน ตัวอย่าง ได้แก่ Chinchilla และ UL2 ซึ่งแสดงให้เห็นว่ายิ่งมากก็ไม่ได้ดีเสมอไป กลยุทธ์ที่ชาญฉลาดกว่าก็สามารถให้ผลลัพธ์ที่มีประสิทธิภาพได้เช่นกัน นอกจากนี้ ยังมีความสนใจอย่างมากในการปรับแต่งคำสั่งของโมเดลภาษา โดยโปรเจ็กต์อย่าง FLAN, T0 และ Flan-T5 มีส่วนสำคัญในด้านนี้

ตัวเร่งปฏิกิริยา ChatGPT

การเปิดตัวของ OpenAI ChatGPT ถือเป็นจุดเปลี่ยนในการวิจัย NLP เพื่อแข่งขันกับ OpenAI บริษัทอย่าง Google และ Anthropic ได้เปิดตัวโมเดลของตนเอง นั่นคือ Bard และ Claude ตามลำดับ แม้ว่าโมเดลเหล่านี้จะแสดงประสิทธิภาพที่เทียบเคียงได้กับ ChatGPT ในหลาย ๆ งาน แต่ก็ยังตามหลังโมเดลล่าสุดจาก OpenAI, GPT-4 ความสำเร็จของแบบจำลองเหล่านี้มีสาเหตุหลักมาจากการเรียนรู้แบบเสริมแรงจากผลตอบรับของมนุษย์ (RLHF) ซึ่งเป็นเทคนิคที่ได้รับการมุ่งเน้นการวิจัยเพิ่มขึ้นเพื่อการปรับปรุงเพิ่มเติม

ข่าวลือและการคาดเดาเกี่ยวกับ Q* (Q-Star) ของ OpenAI

รายงานล่าสุด แนะนำว่านักวิจัยที่ OpenAI อาจประสบความสำเร็จในการพัฒนา AI อย่างมีนัยสำคัญด้วยการพัฒนาโมเดลใหม่ที่เรียกว่า Q* (ออกเสียงว่า Q star) ถูกกล่าวหาว่า Q* มีความสามารถในการคำนวณคณิตศาสตร์ระดับชั้นประถมศึกษา ซึ่งเป็นความสำเร็จที่จุดประกายให้เกิดการอภิปรายในหมู่ผู้เชี่ยวชาญเกี่ยวกับศักยภาพของ Q* ในการก้าวไปสู่ปัญญาประดิษฐ์ทั่วไป (AGI) แม้ว่า OpenAI จะไม่ได้แสดงความคิดเห็นเกี่ยวกับรายงานเหล่านี้ แต่ความสามารถที่เป็นข่าวลือของ Q* ได้สร้างความตื่นเต้นและการคาดเดามากมายบนโซเชียลมีเดียและในหมู่ผู้ที่ชื่นชอบ AI

การพัฒนา Q* เป็นสิ่งที่น่าสังเกตเนื่องจากโมเดลภาษาที่มีอยู่ เช่น ChatGPT และ GPT-4 แม้ว่าจะมีความสามารถในการทำงานทางคณิตศาสตร์บางอย่าง แต่ก็ไม่เชี่ยวชาญเป็นพิเศษในการจัดการกับสิ่งเหล่านี้อย่างน่าเชื่อถือ ความท้าทายอยู่ที่ความจำเป็นที่โมเดล AI ไม่เพียงแต่จะต้องจดจำรูปแบบ เช่นเดียวกับที่พวกเขาทำผ่านการเรียนรู้เชิงลึกและการแปลงรูปแบบในปัจจุบัน แต่ยังต้องให้เหตุผลและเข้าใจแนวคิดเชิงนามธรรมด้วย คณิตศาสตร์ซึ่งเป็นเกณฑ์มาตรฐานในการให้เหตุผล กำหนดให้ AI ต้องวางแผนและดำเนินการหลายขั้นตอน ซึ่งแสดงให้เห็นถึงความเข้าใจอย่างลึกซึ้งเกี่ยวกับแนวคิดเชิงนามธรรม ความสามารถนี้จะเป็นการก้าวกระโดดครั้งสำคัญในความสามารถของ AI ซึ่งอาจขยายขอบเขตไปไกลกว่าคณิตศาสตร์ไปจนถึงงานที่ซับซ้อนอื่นๆ

อย่างไรก็ตาม ผู้เชี่ยวชาญเตือนอย่าให้เกินจริงกับการพัฒนานี้ แม้ว่าระบบ AI ที่สามารถแก้ปัญหาทางคณิตศาสตร์ได้อย่างน่าเชื่อถือจะเป็นความสำเร็จที่น่าประทับใจ แต่ก็ไม่ได้ส่งสัญญาณถึงการกำเนิดของ AI หรือ AGI ที่ชาญฉลาดเสมอไป การวิจัย AI ในปัจจุบัน รวมถึงความพยายามของ OpenAI ได้มุ่งเน้นไปที่ปัญหาเบื้องต้น โดยมีระดับความสำเร็จที่แตกต่างกันไปในงานที่ซับซ้อนมากขึ้น

ความก้าวหน้าในการใช้งานที่เป็นไปได้ เช่น Q* มีมากมาย ตั้งแต่การสอนเฉพาะบุคคลไปจนถึงการช่วยเหลือในการวิจัยทางวิทยาศาสตร์และวิศวกรรมศาสตร์ อย่างไรก็ตาม สิ่งสำคัญคือต้องจัดการความคาดหวังและตระหนักถึงข้อจำกัดและข้อกังวลด้านความปลอดภัยที่เกี่ยวข้องกับความก้าวหน้าดังกล่าว ข้อกังวลเกี่ยวกับ AI ที่ก่อให้เกิดความเสี่ยงที่มีอยู่ ซึ่งเป็นข้อกังวลพื้นฐานของ OpenAI ยังคงเกี่ยวข้อง โดยเฉพาะอย่างยิ่งเมื่อระบบ AI เริ่มเชื่อมต่อกับโลกแห่งความเป็นจริงมากขึ้น

การเคลื่อนไหว LLM โอเพ่นซอร์ส

เพื่อส่งเสริมการวิจัย LLM แบบโอเพ่นซอร์ส Meta ได้เปิดตัวโมเดลซีรีส์ Llama ซึ่งก่อให้เกิดการพัฒนาใหม่ ๆ ที่มีพื้นฐานมาจาก Llama ซึ่งรวมถึงโมเดลที่ได้รับการปรับแต่งอย่างละเอียดด้วยข้อมูลคำสั่ง เช่น Alpaca, Vicuna, Lima และ WizardLM การวิจัยยังขยายสาขาไปสู่การเพิ่มประสิทธิภาพความสามารถของตัวแทน การใช้เหตุผลเชิงตรรกะ และการสร้างแบบจำลองบริบทแบบยาวภายในกรอบงานที่ใช้ Llama

นอกจากนี้ มีแนวโน้มเพิ่มขึ้นในการพัฒนา LLM ที่ทรงพลังตั้งแต่เริ่มต้น โดยมีโครงการต่างๆ เช่น MPT, Falcon, XGen, Phi, Baichuan Mistral, กร๊ากและยี. ความพยายามเหล่านี้สะท้อนให้เห็นถึงความมุ่งมั่นที่จะทำให้ความสามารถของ LLM แบบปิดเป็นประชาธิปไตย ทำให้เครื่องมือ AI ขั้นสูงเข้าถึงได้และมีประสิทธิภาพมากขึ้น

ผลกระทบของ ChatGPT และโมเดลโอเพ่นซอร์สในการดูแลสุขภาพ

เรากำลังมองอนาคตที่ LLM ช่วยในการจดบันทึกทางคลินิก กรอกแบบฟอร์มเพื่อขอเงินคืน และสนับสนุนแพทย์ในการวินิจฉัยและการวางแผนการรักษา สิ่งนี้ดึงดูดความสนใจของทั้งยักษ์ใหญ่ด้านเทคโนโลยีและสถาบันด้านการดูแลสุขภาพ

ไมโครซอฟท์ การสนทนากับ Epicซึ่งเป็นผู้ให้บริการซอฟต์แวร์บันทึกสุขภาพอิเล็กทรอนิกส์ชั้นนำ ส่งสัญญาณการบูรณาการ LLM เข้ากับการดูแลสุขภาพ โครงการริเริ่มต่างๆ มีอยู่แล้วที่ UC San Diego Health และ Stanford University Medical Center ในทำนองเดียวกันของ Google ความร่วมมือกับ Mayo Clinic และ Amazon Web Services' การเปิดตัว HealthScribe ซึ่งเป็นบริการเอกสารทางคลินิก AI ถือเป็นความก้าวหน้าครั้งสำคัญในทิศทางนี้

อย่างไรก็ตาม การปรับใช้อย่างรวดเร็วเหล่านี้ทำให้เกิดความกังวลเกี่ยวกับการยกการควบคุมยาให้เป็นประโยชน์ต่อองค์กร ลักษณะที่เป็นกรรมสิทธิ์ของ LLM เหล่านี้ทำให้ประเมินได้ยาก การปรับเปลี่ยนหรือการหยุดที่เป็นไปได้เนื่องจากเหตุผลด้านผลกำไรอาจส่งผลกระทบต่อการดูแลผู้ป่วย ความเป็นส่วนตัว และความปลอดภัย

ความจำเป็นเร่งด่วนคือต้องมีแนวทางที่เปิดกว้างและครอบคลุมในการพัฒนา LLM ในด้านการดูแลสุขภาพ สถาบันด้านการดูแลสุขภาพ นักวิจัย แพทย์ และผู้ป่วยต้องร่วมมือกันทั่วโลกเพื่อสร้าง LLM แบบโอเพ่นซอร์สสำหรับการดูแลสุขภาพ แนวทางนี้คล้ายกับ Trillion parameter Consortium ที่จะอนุญาตให้มีการรวบรวมทรัพยากรด้านการคำนวณ การเงิน และความเชี่ยวชาญ