Artificiell intelligens

RigNeRF: En ny deepfakes-metod som använder Neural Radiance Fields

Ny forskning som utvecklats på Adobe erbjuder den första livskraftiga och effektiva deepfakes-metoden baserad på Neural Radiance Fields (NeRF) – kanske den första riktiga innovationen i arkitektur eller tillvägagångssätt under de fem år som har gått sedan deepfakes dök upp 2017.

Metoden, med titeln RigNeRF, använder 3D-morfningsbara ansiktsmodeller (3DMMs) som en mellanliggande instrumentell lager mellan den önskade ingången (dvs. identiteten som ska införas i NeRF-renderingen) och neurala rummet, en metod som har allmänt antagits av Generative Adversarial Network (GAN) ansikts syntes tillvägagångssätt, ingen av dem har ännu producerat funktionella och användbara ansiktsersättningsramverk för video.

Till skillnad från traditionella deepfake-videor, är ingen av den rörliga innehållet som visas här ‘verklig’, utan snarare en utforskbar neural rum som tränats på kort film. På höger sida ser vi 3D-morfningsbara ansiktsmodellen (3DMM) som fungerar som gränssnitt mellan de önskade manipulationerna (‘le’, ‘titta åt vänster’, ‘titta upp’, etc.) och de vanligtvis otillgängliga parametrarna för en Neural Radiance Field visualisering. För en högupplöst version av denna klipp, tillsammans med andra exempel, se projektets sida, eller de inbäddade videorna i slutet av den här artikeln. Källa: https://shahrukhathar.github.io/2022/06/06/RigNeRF.html

3DMMs är i princip CGI-modeller av ansikten, vars parametrar kan anpassas till mer abstrakta bildsyntes system, såsom NeRF och GAN, som annars är svåra att kontrollera.

Vad du ser i bilden ovan (mittenbilden, mannen i blå skjorta), samt bilden direkt under (vänsterbilden, mannen i blå skjorta), är inte en ‘verklig’ video där en liten del ‘falskt’ ansikte har lagts till, utan en helt syntetiserad scen som endast existerar som en volymetrisk neural rendering – inklusive kropp och bakgrund:

I exemplet direkt ovan används den riktiga videon på höger sida (kvinnan i röd klänning) för att ‘marionett’ den infångade identiteten (mannen i blå skjorta) på vänster sida via RigNeRF, som (författarna hävdar) är det första NeRF-baserade systemet som uppnår separation av pose och uttryck samtidigt som det kan utföra nya vy-synteser.

Den manliga figuren på vänster sida i bilden ovan ‘fångades’ från en 70-sekunders smartphone-video, och indata (inklusive hela sceninformationen) tränades därefter över 4 V100 GPU:er för att få scenen.

Eftersom 3DMM-stil parametriska riggar också finns tillgängliga som hela kroppens parametriska CGI-proxys (snarare än bara ansiktsriggar), öppnar RigNeRF potentiellt möjligheten för fullständiga deepfakes där riktiga mänskliga rörelser, textur och uttryck överförs till den CGI-baserade parametriska lagern, som sedan skulle översätta handling och uttryck till renderade NeRF-miljöer och videor.

Vad gäller RigNeRF – kvalificerar det som en deepfakes-metod i den nuvarande betydelsen som rubrikerna förstår termen? Eller är det bara en annan semi-handikappad också-ran till DeepFaceLab och andra arbetsintensiva, 2017-erans autoencoder deepfake system?

De nya forskares forskare är otvetydiga på denna punkt:

‘Att vara en metod som kan återanima ansikten, är RigNeRF benägen att missbrukas av dåliga aktörer för att generera deepfakes.’

Den nya artikeln har titeln RigNeRF: Fullständigt kontrollerbara neurala 3D-porträtt, och kommer från ShahRukh Atha från Stonybrook University, en praktikant på Adobe under RigNeRF:s utveckling, och fyra andra författare från Adobe Research.

Bortom autoencoder-baserade deepfakes

Majoriteten av virala deepfakes som har fångat rubriker under de senaste åren produceras av autoencoder-baserade system, som härrör från koden som publicerades på det snabbt förbjudna r/deepfakes subreddit 2017 – fast inte förrän det hade kopierats till GitHub, där det för närvarande har över ett tusen gånger, inte minst in i den populära (om kontroversiella) DeepFaceLab-distributionen, och också FaceSwap-projektet.

Förutom GAN och NeRF har autoencoder-ramverk också experimenterat med 3DMMs som ‘riktlinjer’ för förbättrade ansikts syntes-ramverk. Ett exempel på detta är HifiFace-projektet från juli 2021. Men ingen användbar eller populär initiativ verkar ha utvecklats från denna tillvägagångssätt hittills.

Data för RigNeRF-scener erhålls genom att fånga korta smartphone-videor. För projektet använde RigNeRF-forskarna en iPhone XR eller en iPhone 12 för alla experiment. För den första halvan av inspelningen, uppmanas föremålet att utföra en stor mängd ansiktsuttryck och tal medan de håller huvudet stilla medan kameran flyttas runt dem.

För den andra halvan av inspelningen, håller kameran en fast position medan föremålet måste flytta på huvudet medan de uttrycker en stor mängd uttryck. De resulterande 40-70 sekunder av film (cirka 1200-2100 ramar) representerar hela dataset som kommer att användas för att träna modellen.

Att minska på datainsamling

Till skillnad från autoencoder-system som DeepFaceLab, kräver det relativt mödosamma insamlingen och kureringen av tusentals olika foton, ofta tagna från YouTube-videor och andra sociala medier, samt från filmer (i fallet med kändisdeepfakes).

De resulterande tränade autoencoder-modellerna är ofta avsedda att användas i en mängd olika situationer. Men de mest noggranna ‘kändis’-deepfakers kan träna hela modeller från scratch för en enda video, trots att träningen kan ta en vecka eller mer.

Trots varningsnoten från de nya forskarnas forskare, verkar de ‘patchwork’ och breda dataset som driver AI-porr samt populära YouTube/TikTok ‘deepfake-omcastings’ osannolika att producera acceptabla och konsekventa resultat i ett deepfakes-system som RigNeRF, som har en scen-specifik metodik. Med tanke på begränsningarna för datainsamling som anges i den nya artikeln, kan detta visa sig vara en ytterligare säkerhetsåtgärd mot oaktsam appropriering av identitet av illvilliga deepfakers.

Att anpassa NeRF till deepfake-video

NeRF är en fotogrammetri-baserad metod där ett litet antal källbilder tagna från olika vinklar sätts samman till ett utforskbar 3D-neuralt rum. Detta tillvägagångssätt kom till framträdande tidigare i år när NVIDIA avslöjade sitt Instant NeRF-system, som kan skära ner de exorbitanta tränings tiderna för NeRF till minuter, eller till och med sekunder:

Instant NeRF. Källa: https://www.youtube.com/watch?v=DJ2hcC1orc4

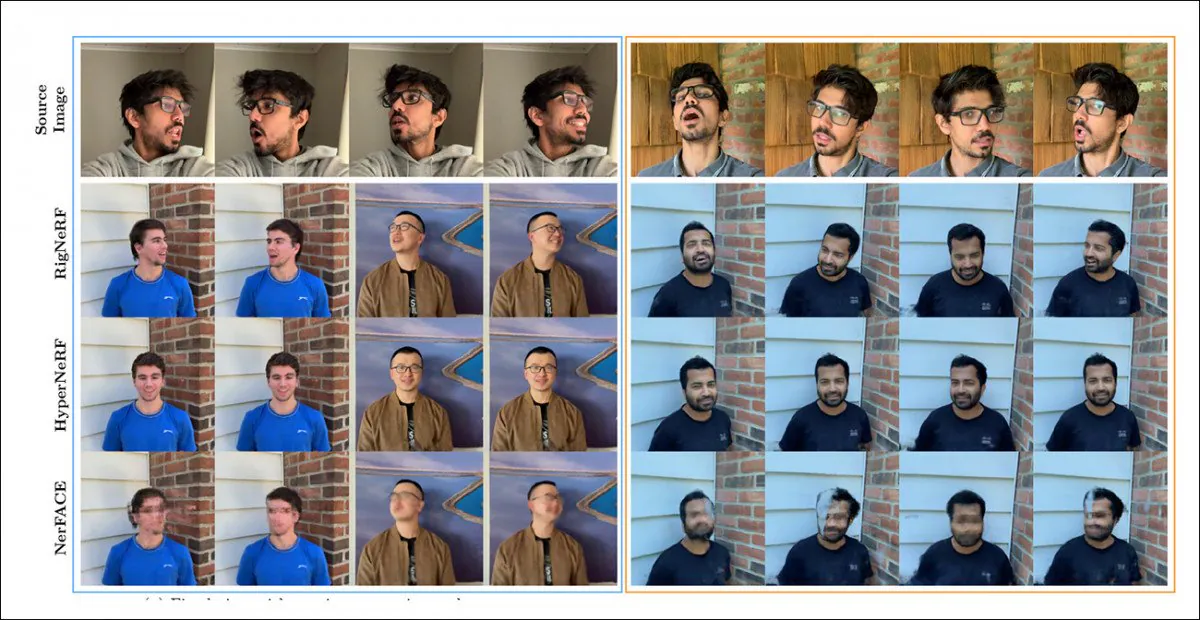

Det resulterande Neural Radiance Field-scenen är i princip en statisk miljö som kan utforskas, men som är svår att redigera. Forskarna noterar att två tidigare NeRF-baserade initiativ – HyperNeRF + E/P och NerFACE – har tagit ett försök att syntetisera ansiktsvideo, och (tydligen för att vara komplett och noggrann) har ställt RigNeRF mot dessa två ramverk i en testrunda:

En kvalitativ jämförelse mellan RigNeRF, HyperNeRF och NerFACE. Se de länkade källvideorna och PDF för högkvalitativa versioner. Statisk bildkälla: https://arxiv.org/pdf/2012.03065.pdf

Men i detta fall är resultaten, som gynnar RigNeRF, ganska anomala, av två skäl: först noterar författarna att ‘det finns inget existerande arbete för en äpple-till-äpple-jämförelse’; för det andra har detta nödvändiggjort att begränsa RigNeRF:s funktioner till att delvis matcha den mer begränsade funktionaliteten hos de tidigare systemen.

Eftersom resultaten inte är en inkrementell förbättring av tidigare arbete, utan snarare representerar ett ‘genombrott’ i NeRF-redigerbarhet och nytta, kommer vi att lämna testrundan åt sidan, och istället se vad RigNeRF gör annorlunda än sina föregångare.

Kombinerad styrka

Den primära begränsningen av NerFACE, som kan skapa pose/uttrycks kontroll i en NeRF-miljö, är att den antar att källfilmen kommer att spelas in med en statisk kamera. Detta innebär i princip att den inte kan producera nya vyer som sträcker sig bortom dess inspelning begränsningar. Detta resulterar i ett system som kan skapa ‘rörliga porträtt’, men som är olämpligt för deepfake-stil video.

HyperNeRF, å andra sidan, kan generera nya och hyper-realistiska vyer, men har ingen instrumentellitet som tillåter den att ändra huvudposen eller ansiktsuttrycken, vilket återigen inte resulterar i någon form av konkurrent till autoencoder-baserade deepfakes.

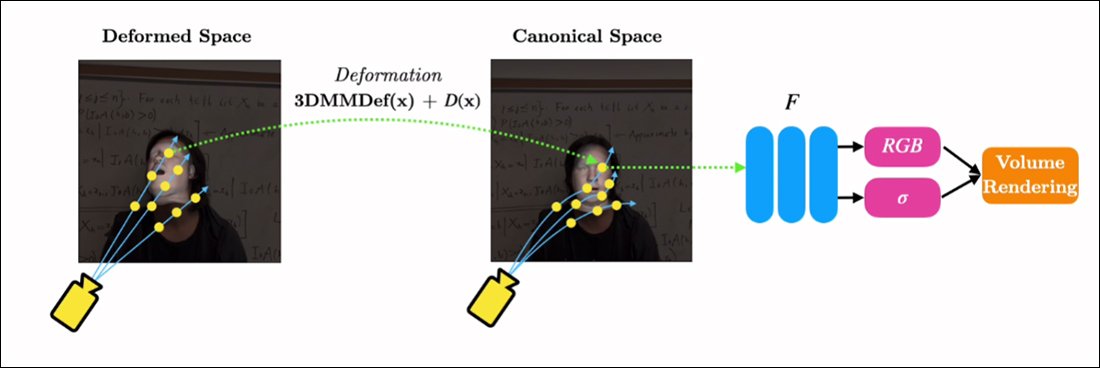

RigNeRF kan kombinera dessa två isolerade funktioner genom att skapa ett ‘kanoniskt rum’, en standardbas som avvikelser och deformationer kan utföras via indata från 3DMM-modulen.

Att skapa ett ‘kanoniskt rum’ (ingen pose, inget uttryck), på vilket deformationerna (dvs. poser och uttryck) som produceras via 3DMM kan agera.

Eftersom 3DMM-systemet inte kommer att matchas exakt med den infångade föremålet, är det viktigt att kompensera för detta i processen. RigNeRF åstadkommer detta med en deformation fält före som beräknas från en Multilayer Perceptron (MLP) som härrör från källfilmen.

Kameraparametrarna som behövs för att beräkna deformationer erhålls via COLMAP, medan uttrycks- och formparametrarna för varje ram erhålls från DECA.

Positioneringen optimeras ytterligare genom landmärkesanpassning och COLMAP:s kameraparametrar, och, på grund av begränsningar i beräkningsresurser, är videoutmatningen nedsampled till 256×256-upplösning för träning (en maskinvaru-begränsad krympningsprocess som också plågar autoencoder deepfake-scenen).

Efter detta tränas deformation-nätverket på de fyra V100:orna – en formidabel maskinvara som inte sannolikt kommer att finnas inom räckhåll för tillfälliga entusiaster (men där maskinlärningsträning är involverad, är det ofta möjligt att handla kraft för tid, och helt enkelt acceptera att modellträning kommer att vara en fråga om dagar eller till och med veckor).