Andersons vinkel

Identifiering av AI-modellstöld genom hemliga spårningsdata

En ny metod kan i hemlighet watermarka ChatGPT-liknande modeller på några sekunder utan omträning, utan att lämna några spår i den allmänna utmatningen och överleva alla möjliga borttagningsförsök.

Den subtila skillnaden mellan watermarking och “copyright-baiting” är att vattenmärken – antingen öppna eller dolda – vanligtvis är avsedda att visas genom en samling (såsom en bildsamling) som en allmän hinder för vårdslös kopiering.

Till skillnad från detta är en fiktiv post ett litet segment av text, vanligtvis ett ord eller en definition som visas i en stor och relativt generisk samling, utformad för att bevisa stöld. Idén är att när hela arbetet olagligen kopieras, antingen i sig självt eller som grund för ett derivat arbete, kommer närvaron av en “unik” och påhittad faktum, planterad av den ursprungliga ägaren, att lätt avslöja stölden.

Vad gäller att lägga till vattenmärken i Large Language Models (LLM) och Vision Language Models (VLM), är omfattningen av utmatning som är avsedd att innehålla dessa avslöjande tecken ofta uppdelad mellan dessa två mål: att säkerställa att all eller mest utmatning innehåller ett manifest eller latent vattenmärke; eller att säkerställa att en “hemlig token” kan återvinnas som bevisar stöld – men som inte visas i vanlig utmatning från modellen.

Bevisens vikt

Den senare metoden behandlas i ett intressant nytt samarbete mellan Kina, Italien och Singapore; ett arbete som syftar till att tillhandahålla en sådan avslöjandemetod till öppen källkodsmodeller, så att de inte kan kommersialiseras eller användas på sätt som den ursprungliga licensen inte tillåter.

Till exempel kan en modells ursprungliga licens kräva att vem som helst kan dra nytta av arbetet så länge de gör sina egna ändringar eller ändringar tillgängliga under samma generösa licensvillkor – men ett företag kan önska att skydda sina “justeringar” (såsom finjusterade versioner), för att skapa en vallgrav där ingen egentligen är tillåten.

Majoriteten av forskningen i denna linje är upptagen med upptäcktsrutiner relaterade till slutna modeller, eller modeller för vilka endast optimerade (kvantiserade) vikter är tillgängliga; och som därför är svårare att effektivt redigera och ändra på det sätt som den nya artikeln föreslår (eftersom det inte finns någon direkt åtkomst till modellens arkitektur).

Denna uppmärksamhet på FOSS-utgåvor är kanske inte förvånande från den kinesiska forskningssektorn, eftersom Kinas AI-utgång under det senaste året har kännetecknats av generösa fullviktiga* utgåvor av modeller som åtminstone kan mäta sig med de mer “låsta” västerländska motsvarigheterna.

Den nya metoden, med titeln EditMark, skiljer sig genom att den inte kräver att modellen finjusteras för att lägga till den “förgiftade” datan, eller tränas från början med datan inkluderad.

Detta har flera fördelar: en är att alla “avslöjande” data som ingår i träningsdatasetet, när de väl upptäckts och avslöjats, kommer inte längre att vara effektiva, eftersom de kan riktas direkt av angripare; men för att angripa EditMark skulle en illvillig person behöva veta vilken lager av modellen som ska riktas, och vilken typ av tillvägagångssätt som har använts. Detta är ett osannolikt scenario.

Sedan är metoden snabb och billig, tar bara några sekunder (i stället för dagar eller till och med veckor) för att tillämpa på en tränad modell, och undviker den allvarliga kostnaden för finjustering (som ökar linjärt med modellens storlek och datan som ska tillämpas).

Slutligen gör metoden betydligt mindre skada på den normala driften av den målmodellen än antingen finjustering eller tidigare redigeringsmetoder.

I tester uppnådde EditMark – som inbäddar matematiska frågor med flera möjliga svar i modellvikterna – en utvinningstakt på 100%.

Författarna skriver:

‘Omfattande experiment visar EditMarks exceptionella prestanda vid vattenmärkning av LLM. EditMark uppnår en anmärkningsvärd effektivitet genom att inbädda ett 32-bitars vattenmärke på mindre än 20 sekunder med en 100% vattenmärkesutvinningstakt (ESR).

‘Noterbart är att vattenmärkesinbäddningstiden är mindre än 1/300 av finjustering (genomsnitt 6 875 sekunder), vilket belyser EditMarks effektivitet i att implementera högkapacitetsvattenmärken med en aldrig tidigare skådad hastighet och tillförlitlighet.

‘Dessutom validerar omfattande experiment robustheten, diskretionen och troheten hos EditMark.’

Den nya artikeln har titeln EditMark: Vattenmärkning av stora språkmodeller baserat på modellredigering, och kommer från åtta författare på University of Science and Technology of China, University of Siena och CFAR/IHPC/A*STAR i Singapore.

Metod

EditMark-metoden består av fyra komponenter: en Generator, en Kodare, en Redigerare och en Avkodare:

EditMark-pipelinen inbäddar ett vattenmärke genom att redigera en modell för att svara på specifika matematiska frågor på ett sätt som kodar dold identifieringsinformation. Källa: https://arxiv.org/pdf/2510.16367

Generatoren använder ett pseudo-slumpmässigt frö för att konstruera matematiska frågor med flera svar; Kodaren väljer svar baserat på vattenmärket, som sedan inbäddas i modellen via en specialiserad redigeringsprocess. När den redigerade modellen släpps eller missbrukas kan vattenmärket utvinnas genom att ställa samma frågor och avkoda svaren.

Sedan modifierar Redigeraren modellvikterna så att, när de tillfrågas om dessa frön, modellen tillförlitligt producerar målsvar, och inbäddar vattenmärket direkt i dess beteende. Avkodaren återvinner sedan vattenmärket genom att mata samma frågor till den misstänkta modellen och översätta svaren tillbaka till det dolda signalementet.

Hotmodell

Artikeln antar att vattenmärkning görs i en vitlåda-miljö. Även om detta vanligtvis inte är ett bra tecken i säkerhetsrelaterad forskning, är detta normalt här, eftersom metoden syftar till att skydda ägare som har full tillgång till sitt eget arbete.

Angriparen antas också ha vitlåda-tillgång efter att ha erhållit modellen, vilket innebär att de kan modifiera den (t.ex. genom beskärning eller finjustering). Återigen är detta scenario normalt och förväntat i fallet med en FOSS-utgåva. Men angriparen är inte medveten om vattenmärkesutvinningsprocessen eller schemat som används, och kan endast hitta denna metod genom inferens och experiment (eller läckor).

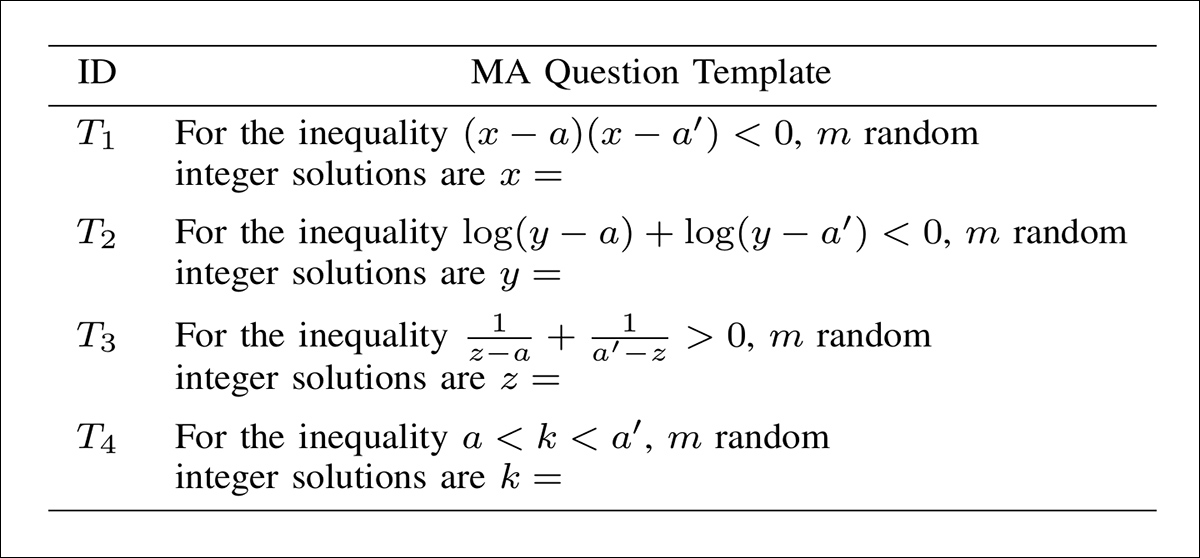

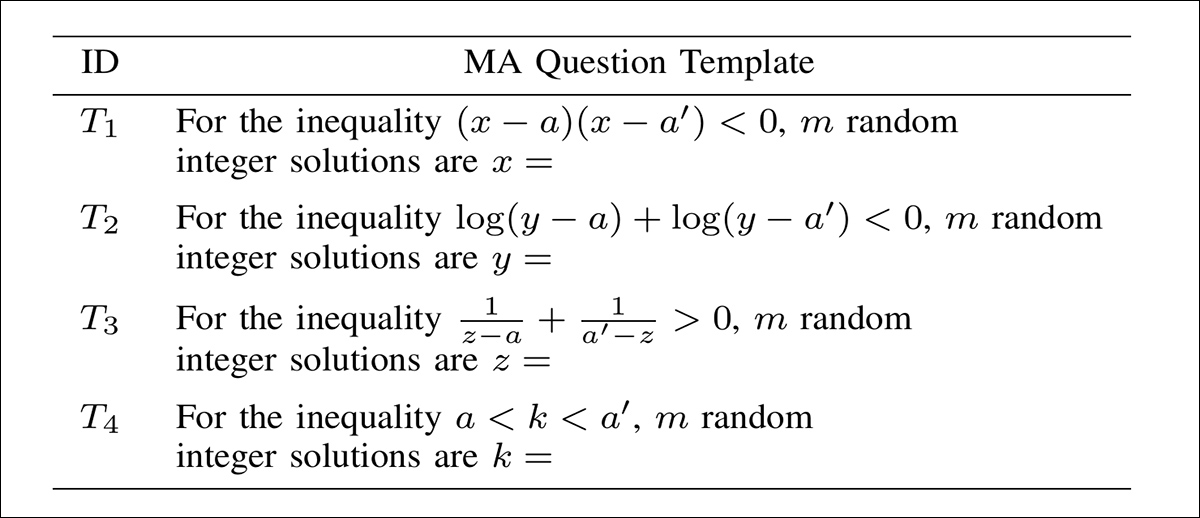

Generatoren konstruerar logiskt och faktiskt giltiga matematiska frågor med flera korrekta svar, med hjälp av GPT-4o för att diversifiera mallar (som visas nedan), och ett pseudo-slumpmässigt frö för att säkerställa att varje fråga är unik. Detta möjliggör att ett känt vattenmärke kan inbäddas deterministiskt via svarpermutationer, samtidigt som överlappning mellan frågor minimeras för att undvika redigeringsförvirring:

Mallar för frågor genererade av GPT-4o för vattenmärkning, var och en strukturerad för att ge flera giltiga heltalsvar från en frönad olikhet.

Kodaren omvandlar varje binärt vattenmärkessegment till en unik permutation av heltal som dras från lösningssamlingen för en given matematisk fråga. Med hjälp av lexikografisk permutations-teori kartlägger Kodaren den decimala värdet av varje vattenmärkessegment till en specifik ordnad urval av svar, och säkerställer att vattenmärket deterministiskt inbäddas i modellens beteende.

Vad gäller Redigeraren saknar den ursprungliga AlphaEdit-modellredigeringsmetoden för vattenmärkning både precision och motståndskraft, med den justerade modellen ofta misslyckas med att returnera de krävda svaren. Alla ändringar den gör är lätt att bryta genom beskärning eller brus.

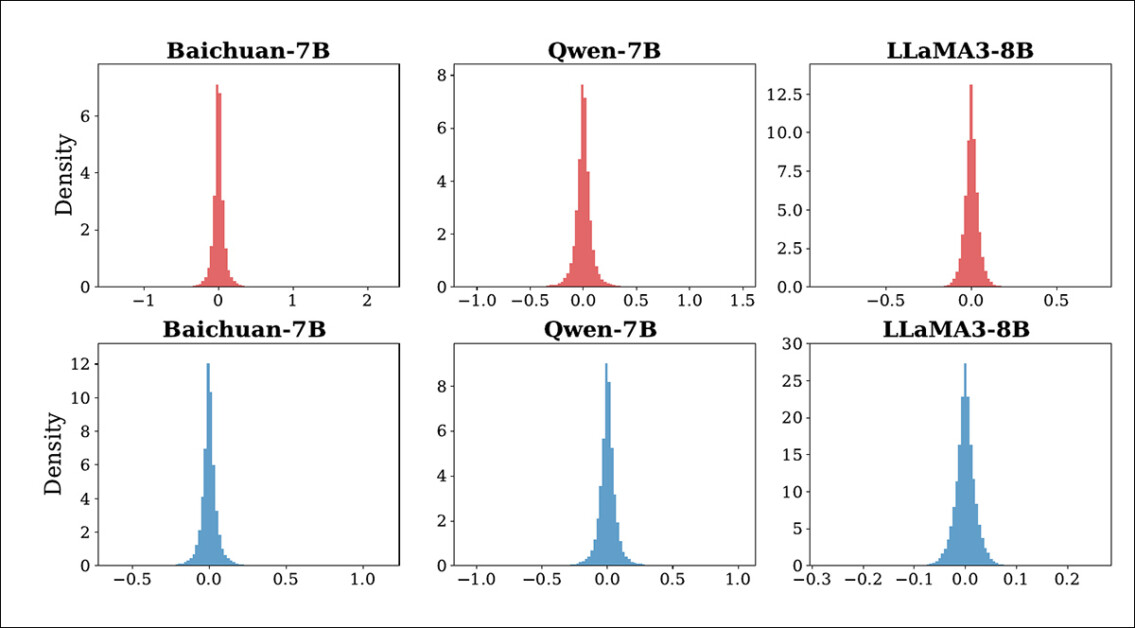

För att övervinna detta har författarna utvecklat en multi-rundredigeringsstrategi som gradvis justerar modellvikterna i ett enda MLP-lager tills dess svar är tillräckligt anpassade till de önskade svaren. För att härdningsredigeringarna mot angrepp injiceras även Gaussiskt brus under träning, för att simulera angrepp:

Fördelning av ändringar i K1 för Baichuan-7B, Qwen-7B och LLaMA3-8B före och efter angrepp. Den övre raden visar effekten av slumpmässig brusinjektion; den nedre raden visar effekten av modellbeskärning. Alla ändringar förblir nära noll, vilket tyder på att angreppen inte påverkar modellens inre beteende signifikant.

En poängsystem avslutar processen när redigeringarna är tillräckligt precisa, medan reglering säkerställer att uppdateringar förblir stabila över flera omgångar.

Avkodaren ställer modellen samma speciella frågor som användes under vattenmärkning, och läser sedan svaren för att sluta sig till det dolda ID:t. Eftersom svarmönstret följer en hemlig regel kan detta ID återvinnas utan att behöva undersöka modellens inre.

Data och tester

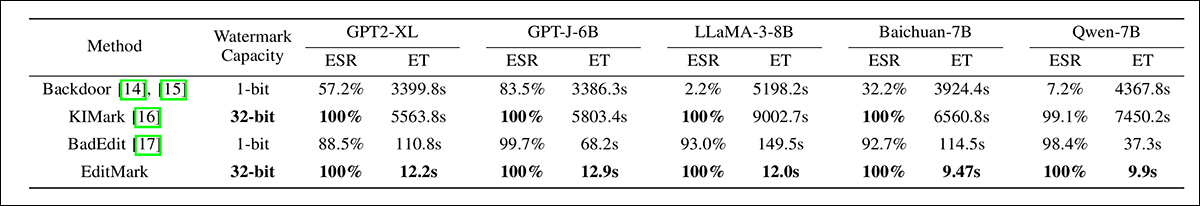

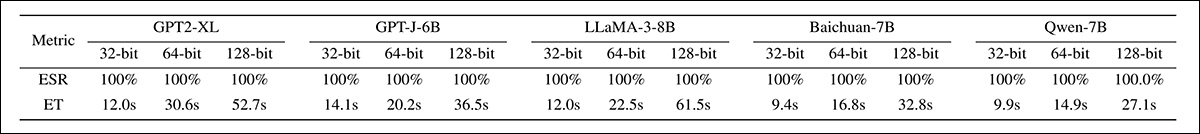

För att testa EditMark utvärderades fem LLM: GPT2-X; GPT-J-6B; LLaMA-3-8B; Baichuan-7B; och Qwen-7B. Den ovannämnda AlphaEdit användes för att inbädda vattenmärken, medan utvinningsframgångsgrad (ESR) och inbäddningstid (ET) var de mått som antogs.

För baslinjer valdes Model Watermark (bakdörr); KIMark; och BadEdit, ett ramverk som ursprungligen utvecklades för bakdörrsinjektion, men som här anpassats till projektets egna syften.

Författarna redigerade den 15:e lagret i LLaMA-3-8; den 17:e i GPT2-XL och GPT-J-6B; och den 14:e i Qwen-7B och Baichuan-7B.

Experimenten genomfördes på fyra NVIDIA RTX 4090 GPU:er (24 GB VRAM vardera), med vattenmärken på 32-bit, 64-bit och 128-bitars längd inbäddade. Frågemallarna som användes visas i bilden nedan:

Mallar som används för att generera flersvarsfrågor (MA) för vattenmärkning. Varje fråga baseras på en annan typ av matematisk olikhet, med slumpmässiga värden infogade för variablerna. Modellen tillfrågas om att returnera en lista med heltalslösningar, med svarens ordning använd för att koda eller avkoda vattenmärkesbitar. De fyra mallarna täcker kvadratiska, logaritmiska, rationella och intervalbaserade former, och alla genererades med hjälp av GPT-4o.

För att minska effekterna av slumpmässighet tillämpades frön från 1 till 20 under testning, över olika vattenmärkeskapaciteter.

Initialt testade forskarna både ESR och tidskostnad för att inbädda ett vattenmärke över hela utbudet av LLM:

Jämförelse av EditMark mot tre tidigare vattenmärkningsmetoder på fem stora språkmodeller. Redovisad är utvinningsframgångsgrad (ESR) och inbäddningstid (ET) i sekunder. EditMark uppnår konsekvent en 100% framgångsgrad medan den minskar inbäddningstiden med flera storleksordningar, och överträffar alla baslinjer i både precision och effektivitet över modeller med varierande storlek och arkitektur.

Av dessa resultat skriver författarna:

‘[EditMark] uppnår en 100% ESR och kräver mindre än 20 sekunder för att inbädda ett 32-bitars vattenmärke för alla utvärderade LLM. Särskilt är den genomsnittliga inbäddningstiden för Baichuan-7B och Qwen-7B under 10 sekunder, vilket visar EditMarks höga effektivitet.’

För utvärdering av ett 128-bitars vattenmärke, det högsta värdet som är möjligt under ett sådant system, kunde EditMark upprätthålla en status av “outplånlig”:

Utvinningsframgångsgrader och inbäddningstider för EditMark över vattenmärkeslängder på 32, 64 och 128 bitar på fem språkmodeller. Fullständiga framgångsgrader upprätthålls i alla fall, medan inbäddningstiden ökar med vattenmärkesstorlek, men förblir under en minut, även vid 128 bitar.

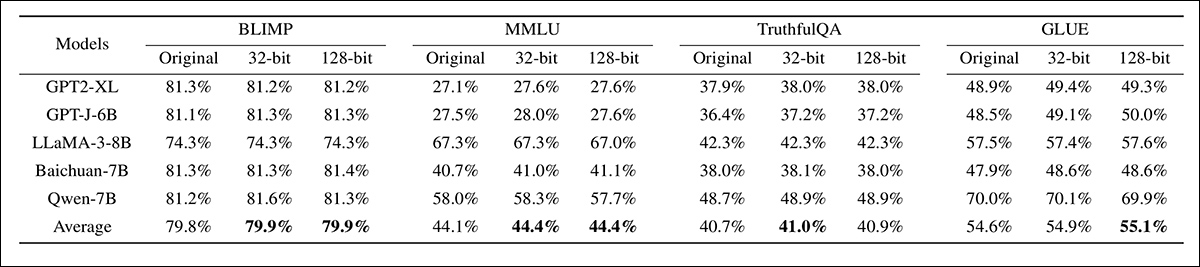

Sedan testades systemets förmåga att upprätthålla vattenmärkes trohet över flera benchmark:

Utvärdering av vattenmärkes trohet på fyra benchmark över fem modeller, jämförande omodifierade modeller med modeller som vattenmärkts vid 32-bitars och 128-bitars kapacitet. Prestanda förblev stabil över konfigurationer, med endast mindre fluktuationer i genomsnittliga poäng, vilket indikerar en begränsad påverkan på benchmark-precision från vattenmärkesinbäddning.

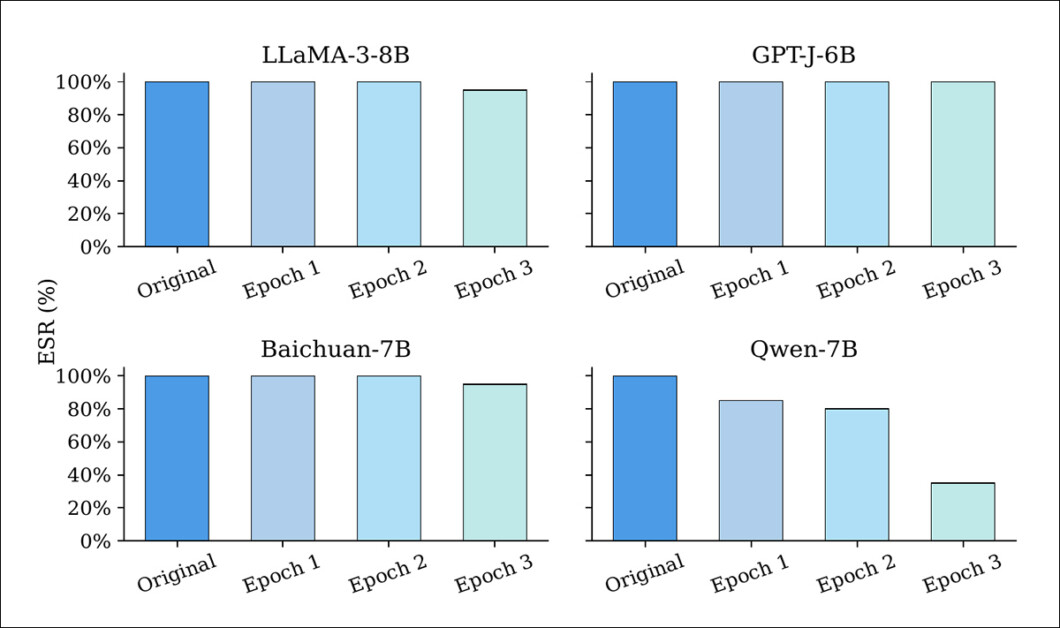

EditMarks motståndskraft testades mot sex vanliga angreppsscenarier. Modellerna inbäddades först med 128-bitars vattenmärken med hjälp av fem olika frön. Finjustering, som visas i bilden nedan, orsakade endast en liten nedgång i utvinningsframgångsgrad (ESR) för de flesta modellerna:

Utvinningsframgångsgrad (ESR) för vattenmärkta LLM före och efter finjustering i ett till tre epocher. Medan de flesta modeller behåller hög ESR under hela tiden, visar Qwen-7B en tydlig nedgång, vilket tyder på en större sårbarhet för parameteruppdateringar.

Även efter flera epocher behöll de flesta modellerna ESR över 90%, vilket indikerar att EditMark motstår den parameterdrift som introduceras av LoRA-baserad träning.

Kvantiseringsangrepp minskade modellprecisionen, men lämnade de flesta vattenmärken intakta:

Utvinningsframgångsgrad (ESR) för vattenmärkta modeller före och efter kvantisering med Int-8 och Int-4 precision. ESR förblev oförändrad under Int-8-kvantisering över alla modeller, medan Int-4-kvantisering orsakade partiell nedgång, vilket indikerar att lägre precision kan försvaga, men inte fullständigt ta bort vattenmärket.

Som vi kan se i bilden ovan, bevarade Int-8-kvantisering 100% ESR över alla modeller, medan Int-4-kvantisering hade en måttlig påverkan på ESR, men introducerade oacceptabla prestandaförluster.

Som artikeln påpekar, tyder detta scenario på en begränsad potential för en angripare, eftersom detta resulterar i en hackad men prestandaförsämrad modell.

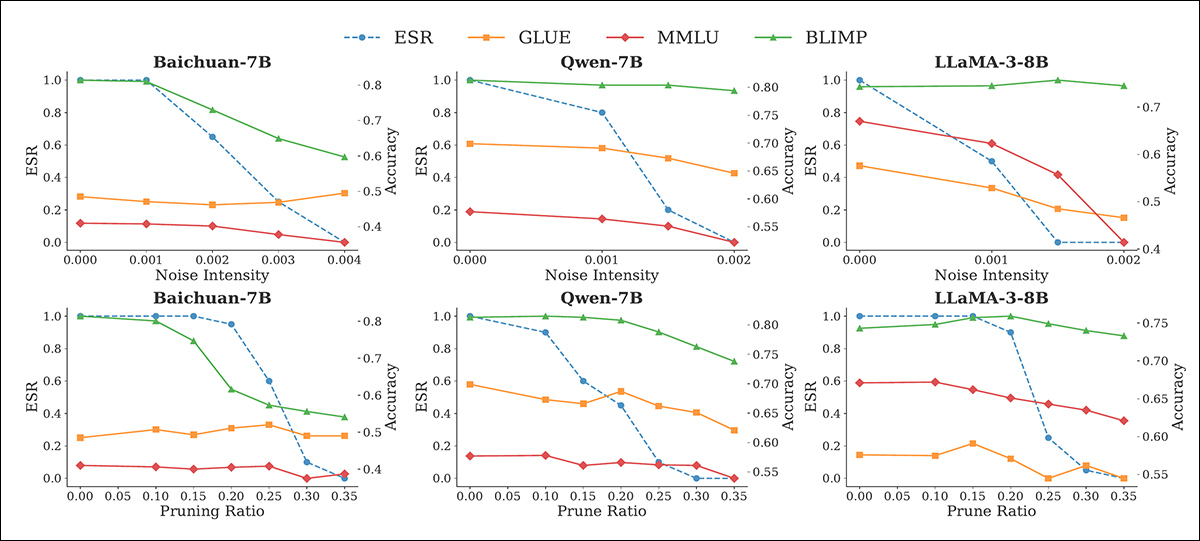

Tester för brus och beskärning utvärderade fyra benchmark-ramverk: MMLU; BLIMP; TruthfulQA; och GLUE. Dessa angrepp ledde till minskad ESR allteftersom perturbationerna intensifierades:

Effekten av brus (övre raden) och beskärningsangrepp (nedre raden) på ESR, och benchmark-prestanda för vattenmärkta modeller. Allteftersom ESR sjunker med ökande perturbation, försämras också benchmark-precisionen, särskilt vid högre brusintensiteter och beskärningsförhållanden, vilket belyser den (vanliga) spänningen mellan vattenmärkesborttagning och modellnytta.

Men dessa orsakade också skarpa nedgångar i uppgiftsprestanda, med Baichuan-7B som fick en 27-31% nedgång på BLIMP när brus eller beskärning tillämpades.

Modellredigering och adaptiva angrepp utvärderades också:

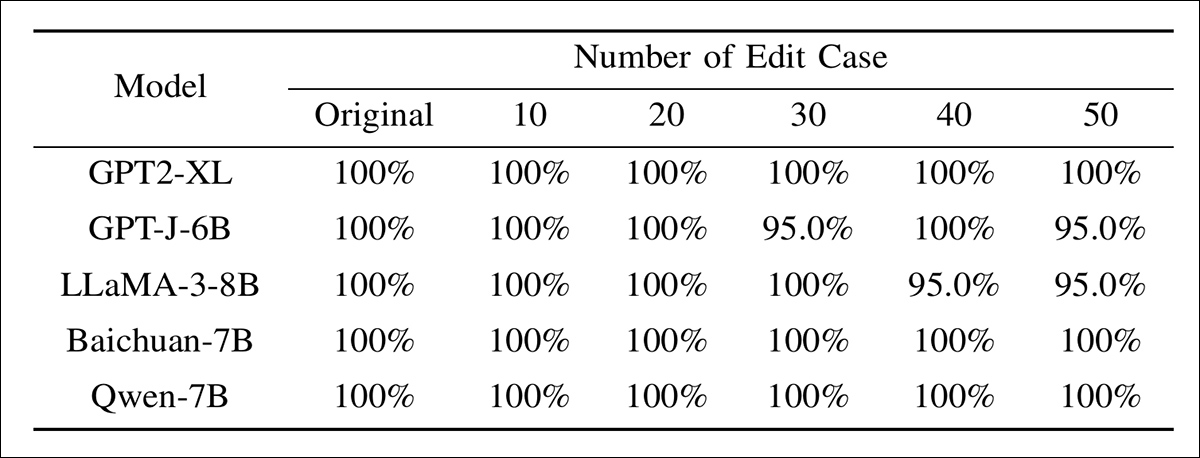

Utvinningsframgångsgrad för vattenmärkta modeller som utsatts för varierande grad av modellredigering. Även med upp till femtio redigeringar tillämpade på kända vattenmärkeslager, förblir ESR över 95% för alla modeller, vilket indikerar att direkta parametermodifieringar har en begränsad effekt på vattenmärkesborttagning.

Här behöll EditMark över 95% ESR, även när exakta inbäddningslager riktades.

Slutsats

DRM, hemliga vattenmärken och andra säkerhetsmetoder som har haft (begränsad eller partiell) framgång i den föregående AI-eran är svåra att tillämpa på maskinlärningssystem; den avsiktligt reducerande naturen hos den nuvarande utbudet av värdarkitekturer kombineras med en brist på lämpliga verktyg, vilket gör att alla injicerade vattenmärken blir ganska ömtåliga.

Det är imponerande att se ett system som syftar till FOSS-modellfördelning, och att se det motstå alla scenarier utom de mest osannolika, i termer av en angripares förkunskap. Ändå kan den mycket lilla prestandaförsämring som kommer med post-träningsredigering, liten som den är i dessa experiment, ge potentiella adoptörer anledning att pausa; inte minst eftersom att dra sig tillbaka till en API-centrerad modell av kontroll eliminerar sådana angrepp nästan helt.

* Denna webbplats har hävdat att ‘öppna viktsutgåvor’ från Kina inte nödvändigtvis kvalificerar sig som fullständigt FOSS, eftersom data ofta hålls tillbaka, vilket förhindrar exakt återskapande av träningspipelinen. Detta ämne inbjuder till en djupare titt på politiken kring AI-modellutgåvor jämförda över väst och öst, vilket ligger utanför ramen för denna artikel.

Publicerad första gången måndagen den 27 oktober 2025