ИИ 101

Что такое обучение с подкреплением?

Что такое обучение с подкреплением?

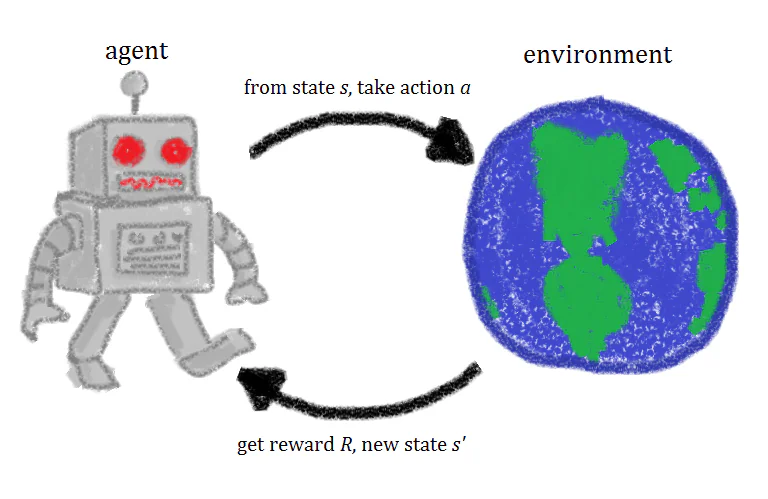

Просто говоря, обучение с подкреплением – это метод машинного обучения, который включает в себя обучение искусственного интеллекта посредством повторения действий и связанных с ними наград. Агент обучения с подкреплением экспериментирует в окружающей среде, выполняя действия и получая награды, когда выполняются правильные действия. Со временем агент учится выполнять действия, которые максимизируют его награду. Это быстрое определение обучения с подкреплением, но более близкий взгляд на концепции, лежащие в основе обучения с подкреплением, поможет вам получить лучшее, более интуитивное понимание его.

Термин “обучение с подкреплением” заимствован из концепции подкрепления в психологии. По этой причине давайте возьмем момент, чтобы понять психологическую концепцию подкрепления. В психологическом смысле термин подкрепление относится к чему-то, что увеличивает вероятность того, что определенный ответ/действие произойдет. Эта концепция подкрепления является центральной идеей теории оперантного условного рефлекса, впервые предложенной психологом Б.Ф. Скиннером. В этом контексте подкрепление – это все, что вызывает увеличение частоты определенного поведения. Если мы подумаем о возможном подкреплении для людей, это могут быть такие вещи, как похвала, повышение на работе, конфеты и увлекательные занятия.

В традиционном, психологическом смысле существует два типа подкрепления. Существует положительное подкрепление и отрицательное подкрепление. Положительное подкрепление – это добавление чего-то, чтобы увеличить поведение, например, когда вы даете своему собаке угощение, когда оно хорошо себя ведет. Отрицательное подкрепление предполагает удаление стимула, чтобы вызвать поведение, например, когда вы выключаете громкие звуки, чтобы выманить застенчивую кошку.

Положительное и отрицательное подкрепление

Положительное подкрепление увеличивает частоту поведения, в то время как отрицательное подкрепление уменьшает частоту. В целом, положительное подкрепление – это наиболее часто используемый тип подкрепления, используемый в обучении с подкреплением, поскольку оно помогает моделям максимизировать производительность на данной задаче. Не только это, но и положительное подкрепление приводит модель к более устойчивым изменениям, изменениям, которые могут стать устойчивыми закономерностями и сохраняться в течение длительного времени.

Напротив, хотя отрицательное подкрепление также делает поведение более вероятным, оно используется для поддержания минимального стандарта производительности, а не для достижения максимальной производительности модели. Отрицательное подкрепление в обучении с подкреплением может помочь обеспечить, чтобы модель избегала нежелательных действий, но оно не может заставить модель исследовать желаемые действия.

Обучение агента обучения с подкреплением

Когда агент обучения с подкреплением обучается, существует четыре разных ингредиента или состояния, используемых в обучении: начальные состояния (Состояние 0), новое состояние (Состояние 1), действия и награды.

Представьте, что мы обучаем агента обучения с подкреплением играть в платформенную видеоигру, где цель ИИ – добраться до конца уровня, перемещаясь вправо по экрану. Начальное состояние игры извлекается из окружающей среды, то есть первый кадр игры анализируется и передается модели. На основе этой информации модель должна принять решение о действии.

Во время начальных фаз обучения эти действия случайны, но по мере того, как модель подкрепляется, определенные действия становятся более распространенными. После выполнения действия окружающая среда игры обновляется, и создается новое состояние или кадр. Если действие, выполненное агентом, дало желаемый результат, скажем, в данном случае агент все еще жив и не был поражен врагом, агенту присваивается некоторая награда, и он становится более вероятным, что он совершит то же самое в будущем.

Эта базовая система постоянно повторяется, происходя снова и снова, и каждый раз агент пытается узнать немного больше и максимизировать свою награду.

Эпизодические против непрерывных задач

Задачи обучения с подкреплением обычно можно отнести к одной из двух разных категорий: эпизодические задачи и непрерывные задачи.

Эпизодические задачи выполняют цикл обучения/обучения и улучшают свою производительность до тех пор, пока не будут выполнены какие-либо критерии окончания, и обучение будет прекращено. В игре это может быть достижение конца уровня или падение в опасность, например, шипы. Напротив, непрерывные задачи не имеют критериев окончания, по сути, продолжая обучаться бесконечно, пока инженер не решит прекратить обучение.

Монте-Карло против временной разницы

Существует два основных способа обучения, или обучения, агента обучения с подкреплением. В подходе Монте-Карло награды присваиваются агенту (его счет обновляется) только в конце эпизода обучения. Другими словами, только когда условие окончания достигнуто, модель учится, насколько хорошо она выполнила свою задачу. Затем она может использовать эту информацию, чтобы обновить и когда следующий раунд обучения начнется, она отреагирует в соответствии с новой информацией.

Метод временной разницы отличается от метода Монте-Карло тем, что оценка значения, или оценка счета, обновляется во время эпизода обучения. Как только модель переходит к следующему шагу времени, значения обновляются.

Изучение против эксплуатации

Обучение агента обучения с подкреплением – это балансирование акта, включающего баланс двух разных метрик: изучения и эксплуатации.

Изучение – это акт сбора более подробной информации об окружающей среде, в то время как эксплуатация – это использование уже известной информации об окружающей среде, чтобы заработать наградные баллы. Если агент только исследует и никогда не эксплуатирует окружающую среду, желаемые действия никогда не будут выполнены. С другой стороны, если агент только эксплуатирует и никогда не исследует, агент научится выполнять только одно действие и не откроет другие возможные стратегии заработка наград. Следовательно, балансирование изучения и эксплуатации имеет решающее значение при создании агента обучения с подкреплением.

Случаи использования обучения с подкреплением

Обучение с подкреплением можно использовать в широком диапазоне ролей и лучше всего подходит для приложений, где задачи требуют автоматизации.

Автоматизация задач, выполняемых промышленными роботами, – это одна из областей, где обучение с подкреплением доказало свою полезность. Обучение с подкреплением также можно использовать для задач, таких как текстовая обработка, создание моделей, которые могут суммировать длинные тексты. Исследователи также экспериментируют с использованием обучения с подкреплением в области здравоохранения, где агенты обучения с подкреплением выполняют задачи, такие как оптимизация политики лечения. Обучение с подкреплением также можно использовать для создания индивидуальных образовательных материалов для студентов.

Сводка обучения с подкреплением

Обучение с подкреплением – это мощный метод создания агентов ИИ, который может привести к впечатляющим и иногда удивительным результатам. Обучение агента посредством обучения с подкреплением может быть сложным и трудным, поскольку оно требует многих итераций обучения и тонкого баланса между изучением и эксплуатацией. Однако, если это успешно, агент, созданный с помощью обучения с подкреплением, может выполнять сложные задачи в широком диапазоне окружающей среды.