Взгляд Anderson

Будущее RAG-расширенного генерирования изображений

Генеративные диффузионные модели, такие как Stable Diffusion, Flux и видеомодели, такие как Hunyuan, полагаются на знания, приобретенные во время одного ресурсоемкого сеанса обучения с использованием фиксированного набора данных. Любые концепции, введенные после этого обучения – называемые граничным знанием – отсутствуют в модели, если только они не дополняются с помощью тонкой настройки или внешних методов адаптации, таких как адаптация с низким рангом (LoRA).

Было бы идеально, если бы генеративная система, выдающая изображения или видео, могла обращаться к онлайн-источникам и включать их в процесс генерации по мере необходимости. Например, диффузионная модель, которая ничего не знает о последнем выпуске Apple или Tesla, могла бы все равно производить изображения, содержащие эти новые продукты.

В отношении языковых моделей большинство из нас знакомы с системами, такими как Perplexity, Notebook LM и ChatGPT-4o, которые могут включать новые внешние сведения в модели генерации с извлечением (RAG).

RAG-процессы делают ответы ChatGPT 4o более релевантными. Source: https://chatgpt.com/

Однако это необычная возможность, когда речь идет о генерации изображений, и ChatGPT признает свои собственные ограничения в этом отношении:

ChatGPT 4o сделал хорошую догадку о визуализации совершенно нового выпуска часов, основанного на общей линии и описаниях, которые он интерпретировал; но он не может «поглотить» и интегрировать новые изображения в генерацию на основе DALL-E.

Включение внешних данных, извлеченных из изображения, является сложной задачей, поскольку входящее изображение должно сначала быть разбито на токены и вложения, которые затем сопоставляются с ближайшими обученными знаниями модели о предмете.

Хотя этот процесс работает эффективно для пост-обучения инструментов, таких как ControlNet, такие манипуляции остаются в основном поверхностными, по сути пропуская извлеченное изображение через конвейер рендеринга, но без глубокой интеграции его во внутреннее представление модели.

В результате модель не имеет возможности генерировать новые перспективы так, как могут системы нейронного рендеринга, такие как NeRF, которые строят сцены с истинным пространственным и структурным пониманием.

Зрелая логика

Аналогичное ограничение применяется к RAG-основанным запросам в больших языковых моделях (LLM), таких как Perplexity. Когда модель этого типа обрабатывает внешние данные, она функционирует подобно взрослому человеку, который опирается на всю свою жизнь знаний, чтобы сделать выводы о вероятности темы.

Однако, как и человек не может ретроспективно интегрировать новые сведения в когнитивную основу, которая сформировала его фундаментальный взгляд на мир – когда его предубеждения и предконцепции еще формировались – LLM не может без проблем слить новые знания в свою предварительно обученную структуру.

Вместо этого он может только «влиять» или противопоставлять новые данные своим внутренним знаниям, используя выученные принципы для анализа и спекуляций, а не для синтеза на фундаментальном уровне.

Этот недостаток эквивалентности между противопоставленным и внутренним поколением более вероятно будет очевиден в сгенерированном изображении, чем в языковом поколении: более глубокие сетевые связи и повышенная креативность «родного» (а не RAG-основанного) поколения были установлены в различных исследованиях.

Скрытые риски RAG-способного генерирования изображений

Даже если бы было технически возможно без проблем интегрировать извлеченные интернет-изображения в новые синтезированные изображения в RAG-стиле,

многие наборы данных, используемые для обучения генеративных моделей, были отобраны для минимизации присутствия явного, расистского или жестокого контента, среди других чувствительных категорий. Однако этот процесс несовершенен, и остаточные ассоциации могут сохраниться. Чтобы смягчить это, системы, такие как DALL·E и Adobe Firefly, полагаются на вторичные механизмы фильтрации, которые проверяют как входные подсказки, так и сгенерированные выходные данные на предмет запрещенного контента.

В результате простой фильтр NSFW – который в основном блокирует явный контент – был бы недостаточным для оценки приемлемости извлеченных RAG-основанных данных. Такой контент все равно мог бы быть оскорбительным или вредным способами, которые выходят за пределы предварительно определенных параметров модерации модели, потенциально вводя материал, который ИИ не имеет контекстного осознания, чтобы правильно оценить.

Обнаружение недавней уязвимости в CCP-произведенном DeepSeek, предназначенном для подавления обсуждений запрещенного политического контента, подчеркнуло, как альтернативные пути ввода могут быть использованы для обхода этических гарантий модели; аргументированно, это также применяется к произвольным новым данным, извлеченным из интернета, когда они предназначены для включения в новое поколение изображения.

RAG для генерации изображений

Несмотря на эти проблемы и сложные политические аспекты, несколько проектов появились, которые пытаются использовать RAG-основанные методы для включения новых данных в визуальные поколения.

ReDi

Проект 2023 года Retrieval-based Diffusion (ReDi) – это обучающийся фреймворк, который ускоряет вывод диффузионной модели, извлекая подобные траектории из предварительно вычисленной базы знаний.

Значения из набора данных можно «одолжить» для нового поколения в ReDi. Source: https://arxiv.org/pdf/2302.02285

В контексте диффузионных моделей траектория – это пошаговый путь, который модель проходит для генерации изображения из чистого шума. Обычно этот процесс происходит постепенно на протяжении многих шагов, с каждым шагом, уточняющим изображение немного больше.

ReDi ускоряет этот процесс, пропуская некоторые из этих шагов. Вместо того, чтобы рассчитывать каждый отдельный шаг, он извлекает подобную прошлую траекторию из базы данных и переходит к более поздней точке в процессе. Это снижает количество необходимых вычислений, делая диффузионное генерирование изображений намного быстрее, сохраняя при этом качество.

ReDi не изменяет веса диффузионной модели, а вместо этого использует базу знаний для пропуска промежуточных шагов, тем самым снижая количество оценок функций, необходимых для выборки.

Конечно, это не то же самое, что включение конкретных изображений по желанию в запрос на генерацию; но это связано с подобными типами генерации.

Выпущенный в 2022 году, в год, когда латентные диффузионные модели захватили общественное воображение, ReDi, кажется, является одним из первых диффузионных подходов, опирающихся на RAG-методологию.

Хотя следует отметить, что в 2021 году Facebook Research выпустил Instance-Conditioned GAN, который стремился условить GAN-изображения на новых входных изображениях, этот тип проекции в латентное пространство чрезвычайно распространен в литературе, как для GAN, так и для диффузионных моделей; проблема заключается в том, чтобы сделать такой процесс обучающимся и функциональным в реальном времени, как RAG-основанные методы, ориентированные на LLM.

RDM

Другой ранний проект в RAG-усиленное генерирование изображений – это Retrieval-Augmented Diffusion Models (RDM), который вводит полу-параметрический подход к генеративному синтезу изображений. В то время как традиционные диффузионные модели хранят все выученные визуальные знания внутри своих нейронных сетевых параметров, RDM полагается на внешнюю базу данных изображений:

Извлеченные ближайшие соседи в иллюстративном псевдо-запросе в RDM*.

Во время обучения модель извлекает ближайших соседей (визуально или семантически подобные изображения) из внешней базы данных, чтобы руководить процессом генерации. Это позволяет модели условить свои выходные данные на реальных визуальных экземплярах.

Процесс извлечения основан на CLIP-вложениях, предназначенных для того, чтобы заставить извлеченные изображения иметь осмысленные сходства с запросом, и также для предоставления новой информации для улучшения генерации.

Этот подход снижает зависимость от параметров, облегчая более мелкие модели, которые достигают конкурентоспособных результатов без необходимости обширных обучающих наборов данных.

Подход RDM поддерживает пост-хок-модификации: исследователи могут заменить базу данных во время вывода, позволяя нулевому адаптации к новым стилям, доменам или даже совершенно другим задачам, таким как стилизация или условный синтез.

В нижних строках мы видим ближайших соседей, вовлеченных в процесс диффузии в RDM*.

Ключевым преимуществом RDM является его способность улучшать генерацию изображений без повторной настройки модели. Изменяя базу данных извлечения, модель может обобщаться на новые концепции, на которые она не была явно обучена. Это особенно полезно для приложений, где сдвиги домена происходят, такие как генерация медицинских изображений на основе эволюционирующих наборов данных или адаптация текст-изображение моделей для творческих приложений.

Однако подход, основанный на извлечении, такого типа зависит от качества и релевантности внешней базы данных, что делает курирование данных важным фактором для достижения высококачественных поколений; и этот подход остается далеко от эквивалентного генерации изображений вида RAG-основанных взаимодействий, типичных в коммерческих LLM.

ReMoDiffuse

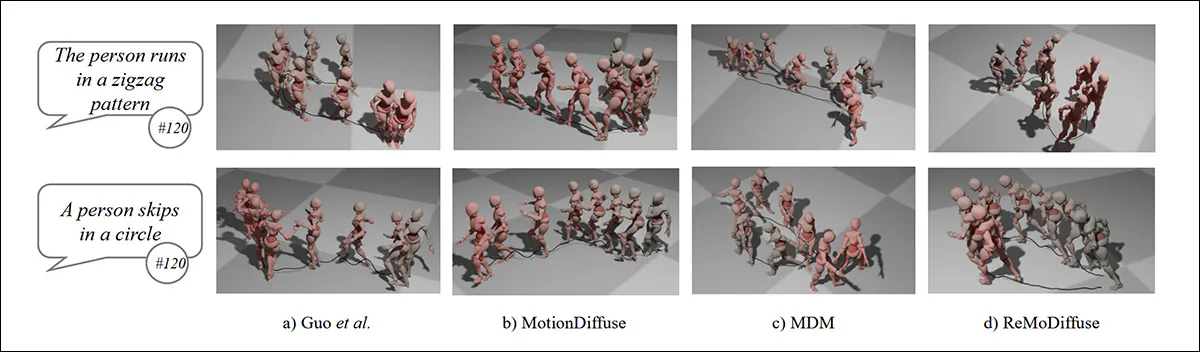

ReMoDiffuse – это RAG-усиленная модель диффузии движения для 3D-генерации человеческого движения. В отличие от традиционных моделей генерации движения, которые полагаются исключительно на выученные представления, ReMoDiffuse извлекает соответствующие образцы движения из большого набора данных движения и интегрирует их в процесс денойзинга, в схеме, подобной RDM (см. выше).

Сравнение RAG-усиленного ReMoDiffuse (самый правый) с предыдущими методами. Source: https://arxiv.org/pdf/2304.01116

Это позволяет модели генерировать последовательности движения, предназначенные для того, чтобы быть более естественными и разнообразными, а также семантически верными текстовым подсказкам пользователя.

ReMoDiffuse использует инновационный гибридный механизм извлечения, который выбирает последовательности движения на основе как семантических, так и кинематических сходств, с целью обеспечения того, чтобы извлеченные движения были не только тематически релевантными, но и физически правдоподобными при интеграции в новое поколение.

Модель затем уточняет эти извлеченные образцы с помощью трансформера, модулированного семантикой, который селективно включает знания из извлеченных движений, сохраняя при этом характерные качества сгенерированной последовательности:

Схема конвейера ReMoDiffuse.

Техника смеси условий проекта улучшает способность модели обобщаться на различные подсказки и условия извлечения, балансируя извлеченные образцы движения с текстовыми подсказками во время генерации и корректируя, какой вес каждый источник получает на каждом шаге.

Это может помочь предотвратить нереалистичные или повторяющиеся выходные данные, даже для редких подсказок. Это также решает проблему чувствительности масштаба, которая часто возникает в классификаторно-свободных методах руководства, обычно используемых в диффузионных моделях.

RA-CM3

Стэнфордский 2023 папер Retrieval-Augmented Multimodal Language Modeling (RA-CM3) позволяет системе получить доступ к реальным сведениям во время вывода:

Модель Стэнфордского Retrieval-Augmented Multimodal Language Modeling (RA-CM3) использует интернет-извлеченные изображения для дополнения процесса генерации, но остается прототипом без публичного доступа. Source: https://cs.stanford.edu/~myasu/files/RACM3_slides.pdf

RA-CM3 интегрирует извлеченный текст и изображения в конвейер генерации, улучшая как текст-изображение, так и изображение-текст синтез. Используя CLIP для извлечения и трансформер в качестве генератора, модель обращается к соответствующим многомодальным документам перед составлением выходных данных.

Бенчмарки на MS-COCO показывают заметные улучшения по сравнению с DALL-E и подобными системами, достигая 12-балльного Fréchet Inception Distance (FID) снижения, с гораздо более низкими вычислительными затратами.

Однако, как и в случае с другими подходами, основанными на извлечении, RA-CM3 не без проблем интегрирует свои извлеченные знания. Вместо этого он наложивает новые данные на свою предварительно обученную сеть, подобно LLM, дополняющей ответы результатами поиска. Хотя этот метод может улучшить фактическую точность, он не заменяет необходимость обновлений обучения в областях, где требуется глубокий синтез.

Кроме того, практическая реализация этой системы, кажется, не была выпущена, даже на платформе на основе API.

RealRAG

Новый выпуск из Китая, и тот, который вызвал этот взгляд на RAG-усиленные генеративные системы изображений, называется Retrieval-Augmented Realistic Image Generation (RealRAG).

Внешние изображения, вовлеченные в RealRAG (нижний средний).

RealRAG извлекает фактические изображения релевантных объектов из базы данных, отобранной из публично доступных наборов данных, таких как ImageNet, Stanford Cars, Stanford Dogs и Oxford Flowers. Затем он интегрирует извлеченные изображения в процесс генерации, решая пробелы в знаниях модели.

Ключевым компонентом RealRAG является саморефлексивное контрастное обучение, которое обучает модель извлечения для нахождения информативных справочных изображений, а не просто визуально подобных.

Авторы заявляют:

«Наш основной вывод заключается в том, чтобы обучить модель извлечения, которая извлекает изображения, находящиеся вне пространства генерации генератора, но близкие к представлению текстовых подсказок.

«Для этого мы сначала генерируем изображения из заданных текстовых подсказок, а затем используем сгенерированные изображения в качестве запросов для извлечения наиболее релевантных изображений в базе данных, основанной на реальных объектах. Эти наиболее релевантные изображения используются в качестве отражающих отрицательных примеров.»

Этот подход гарантирует, что извлеченные изображения вносят пропавшие знания в процесс генерации, а не подкрепляют существующие предубеждения модели.

Слева, извлеченное справочное изображение; в центре, без RAG; справа, с использованием извлеченного изображения.

Однако зависимость от качества извлечения и покрытия базы данных означает, что его эффективность может варьироваться в зависимости от наличия высококачественных справочных материалов. Если релевантное изображение не существует в наборе данных, модель может все равно испытывать трудности с незнакомыми концепциями.

RealRAG – это очень модульная архитектура, предлагающая совместимость с несколькими другими генеративными архитектурами, включая U-Net-основанные, DiT-основанные и автoregressive модели.

В целом извлечение и обработка внешних изображений добавляет вычислительную нагрузку, и производительность системы зависит от того, как хорошо механизм извлечения обобщается на различные задачи и наборы данных.

Вывод

Это представительный, а не исчерпывающий обзор многомодальных генеративных систем, извлекающих изображения. Некоторые системы этого типа используют извлечение исключительно для улучшения понимания зрения или курирования наборов данных, среди других разнообразных мотивов, а не для генерации изображений. Примером является Internet Explorer.

Многие других RAG-интегрированных проектов в литературе остаются не выпущенными. Прототипы, с только опубликованными исследованиями, включают Re-Imagen, который – несмотря на свое происхождение от Google – может получить доступ только к изображениям из локальной пользовательской базы данных.

Кроме того, в ноябре 2024 года Baidu объявила о Image-Based Retrieval-Augmented Generation (iRAG), новой платформе, которая использует извлеченные изображения «из базы данных». Хотя iRAG, как сообщается, доступен на платформе Ernie, кажется, что нет дальнейших подробностей об этом процессе извлечения, который, по-видимому, полагается на локальную базу данных (т.е. локальную для сервиса и не直接 доступную пользователю).

Дальнейшее 2024 папер Unified Text-to-Image Generation and Retrieval предлагает еще один RAG-основанный метод использования внешних изображений для дополнения результатов во время генерации – снова, из локальной базы данных, а не из ад-хок интернет-источников.

Волнение вокруг RAG-основанного дополнения в генерации изображений, вероятно, будет сосредоточено на системах, которые могут включать интернет-источники или загруженные пользователем изображения напрямую в процесс генерации, и которые позволяют пользователям участвовать в выборе или источниках изображений.

Однако это значительная проблема по至少 двум причинам; во-первых, потому что эффективность таких систем обычно зависит от глубоко интегрированных отношений, сформированных во время ресурсоемкого процесса обучения; и во-вторых, потому что проблемы безопасности, законности и ограничения авторских прав делают эту функцию маловероятной для API-ориентированного веб-сервиса и для коммерческой эксплуатации в целом.

* Источник: https://proceedings.neurips.cc/paper_files/paper/2022/file/62868cc2fc1eb5cdf321d05b4b88510c-Paper-Conference.pdf

Опубликовано во вторник, 4 февраля 2025