Взгляд Anderson

‘Rogue’ Данные, Загрязняющие Производительность Генеративного ИИ

Новое исследование показало, что многие популярные наборы изображений, используемые для обучения моделей ИИ, содержат тестовые изображения или gầnко-дубликаты, позволяя моделям обманывать, запоминая ответы вместо обучения. Утечка широко распространена, но в целом не обнаружена, тихо увеличивая оценки и давая несправедливое преимущество моделям, обученным на веб-мастабных данных.

Когда вы сдаете экзамен на вождение, вам обычно не сообщают заранее, какие именно дороги будут использоваться для экзамена. Если бы вы знали (и были немного нечестными), вы могли бы “оптимизировать” экзамен, практикуясь повторно на этом маршруте, вместо того, чтобы развивать более широкие навыки вождения, которые могут справиться с любым маршрутом достаточно хорошо.

В обучении моделей машинного обучения это разумная аналогия для тестового раздела – разделения набора данных для обучения между (обычно) 70% разделом для данных, которые будут использоваться для обучения модели, и оставшимися 30% для использования в качестве “дикой” данных.

Поскольку “дикая” данных никогда не видела модель, если модель работает хорошо на этих данных, можно предположить, что она эффективна и производительна; если нет, модель может переобучиться на хорошо сбалансированном наборе – или же данные требуют дополнительной куратории и определения.

В любом случае, не оценка моделей на их обучающих данных является краеугольным камнем текущего метода в исследованиях и разработке ИИ.

То же самое, пожалуйста

Согласно новой исследовательской работе из Японии, сектор исследований компьютерного зрения и генеративного ИИ не отдал должного усилий исследователей LLM, чтобы обеспечить, что тестовые данные не загрязняют обучающие данные; в тестах исследователи обнаружили, что каждый гипермасштабный визуальный набор данных, который они изучали, включая те, которые обеспечивают некоторые из самых больших текущих генеративных систем ИИ, имеет в некоторой степени допустил пересечение своих тестовых данных в обучающие данные – что означает, что оценки и отчеты о производительности моделей, обученных на этих разделах, не будут более точными, чем результат экзамена от человека, который подсматривал в справочник во время экзамена, и не будут отражать реальную производительность в действительно новых данных.

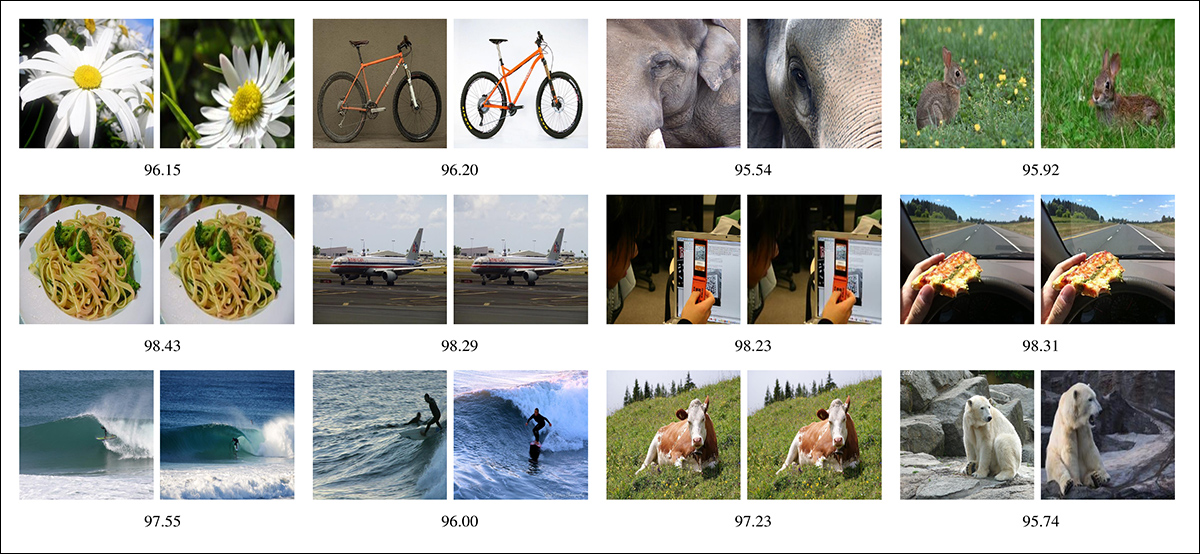

Примеры перекрестного загрязнения данных, обнаруженные исследователями, где дублирующие или gầnко-дублирующие данные существуют в обоих обучающих и тестовых данных. Источник: https://arxiv.org/pdf/2508.17416

В изображении выше, из новой работы, мы видим примеры либо дублирующих, либо gầnко-дублирующих данных, обнаруженных в обоих основных обучающих и тестовых данных различных моделей – достаточно, чтобы сделать недействительной производительность модели на этих данных, и слегка увеличить ее общие оценки, облегчая появление уровня обобщения, который модель может неactually достичь.

Чтобы сделать дела более сложными, загрязнение кажется происходящим через разнообразие возможных сценариев, включая ‘предварительное обучение‘, где веса старых предковых моделей используются для “запуска” новой модели. Если вверх, старая модель имеет некоторые из тех же данных, что и новый набор данных, который используется для предварительного обучения, то перекрестное загрязнение может произойти, даже если 70/30 или 80/20 разделение чисто.

Кумулятивный Эффект

Это几乎 определенно произойдет даже в самых последних наборах данных: объем визуальных/языковых наборов данных вырос enormозно за последние пять лет, включая не только самые новые изображения в сети, но и повторно собирая большую часть тех же данных, которые населяли старые, исторические наборы данных.

Кроме того, автоматические рутины, предназначенные для траллинга и фильтрации миллиардов изображений для дубликатов и gầnко-дубликатов, теперь сталкиваются с такой трудной задачей, что куратория сама по себе – ее стоимость в терминах времени и денег – должна теперь учитываться в контексте бюджетных ограничений

Между тем, дублирование изображений является неизбежным следствием вида ад хок веб-траллинга за массивными коллекциями, такими как Common Crawl, из-за распространенной практики перепостинга и перекомпрессии изображений, и применения редактирований, таких как обрезка, и даже переворачивания (чтобы избежать обнаружения, когда изображение может быть использовано без разрешения, например).

Авторы наблюдают*:

‘Утечка данных является широко распространенной проблемой, распространенной в большинстве визуальных наборов данных. Утечка может скрыть способность обобщения моделей, что особенно проблематично при сравнении моделей, обученных на разных наборах данных, что приводит к несправедливым сравнениям.

‘Мы призываем разработчиков наборов данных тщательно рассмотреть последствия этих оценок. Для более справедливой оценки моделей мы рекомендуем использовать детекторы дубликатов, которые учитывают как жесткую, так и мягкую утечку.

‘Идеально, утечка изображений должна быть удалена из обучающего набора, и если это невозможно, они должны быть хотя бы удалены из тестового набора.’

Работа подробно описывает ряд тестов, которые исследователи провели на массивных и популярных наборах данных – каждый из которых продемонстрировал некоторый уровень загрязнения.

Новая работа называется Утечка Данных в Визуальных Наборах, и исходит от трех исследователей из Университета Осаки.

Метод

Авторы работы определяют утечку в терминах трех измерений: модальность, покрытие, и степень.

Модальность различает, загрязняются ли только изображения или же и изображения, и метки; покрытие определяет, происходит ли пересечение внутри одного и того же набора данных или между разными наборами данных; и степень определяет, является ли дублирующий контент точно таким же или лишь соседним.

Что касается утечки, два сценария, рассмотренные в работе, являются внутренней утечкой (когда оценочные изображения повторяются в обучающем разделе одного и того же набора данных), и международной утечкой (когда оценочные изображения из одного набора данных присутствуют в другом наборе данных, используемом для обучения).

Что касается степени, два уровня, определенные, являются мягкой утечкой (когда изображения не идентичны, но демонстрируют незначительные вариации), и жесткой утечкой (когда изображения точно идентичны в обучающих и оценочных данных).

Исследователи решают обнаружение утечки в терминах извлечения изображений, используя кодировщики изображений для представления каждого изображения в виде вектора особенностей. Запросный набор является оценочными данными, в то время как коллекция является обучающим набором.

Для меньших наборов данных каждый запросный вектор был напрямую сравнен со всеми обучающими векторами с использованием косинусной подобия. Для более крупных наборов данных был построен Faiss индекс, чтобы ermögчить более быстрый поиск K-Nearest Neighbors (KNN).

Поскольку кодировщик должен захватить достаточно визуальной информации, чтобы обнаружить тонкие сходства, но все еще оставаться эффективным в условиях очень высоких объемов данных, авторы полагались на предварительно вычисленные CLIP особенности, предоставленные создателями набора данных, в случае коллекции LAION, которая обеспечивает стабильное распространение, и последующие проекты.

Авторы отмечают, что разрешение CLIP использовать его дистиллированное понимание набора данных (вместо опроса фактических файлов в масштабе) значительно ускоряет процесс и предлагает лучшую последовательность при сравнении.

Данные и Тесты

CLIP кодировщик изображений, использованный в тестах для новой работы, был по умолчанию CLIP ViT-B/32 originally использовался для сита LAION. Чтобы установить, связаны ли между собой разнообразные изображения, был использован KNN под AutoFaiss.

Наборы данных были сгруппированы в три типа: предварительное обучение наборов данных – большие, веб-скрепленные коллекции, используемые для обучения общих моделей; обучающие наборы данных – меньшие, часто аннотированные коллекции, предназначенные для прямого настройки моделей; и бенчмарк наборы данных – вручную аннотированные и используемые исключительно для оценки.

Анализ охватил двадцать разделов по семи наборам данных: Microsoft COCO был использован как обучающий и оценочный набор, включающий обучающий, проверочный, тестовый и неаннотированные разделы; Flickr30k служил исключительно в качестве бенчмарка; и коллекция Google Conceptual Captions (GCC) была рассмотрена как предварительный источник, с ее проверочной частью также использованной для оценки.

Кроме того, ImageNet был использован для обучения и бенчмаркинга, в то время как набор данных LAION-400M был использован исключительно для предварительного обучения.

OpenImages v4 внес вклад в обучающие и бенчмаркные данные, и TextCaps предоставил как обучающие, так и тестовые разделы для оценки.

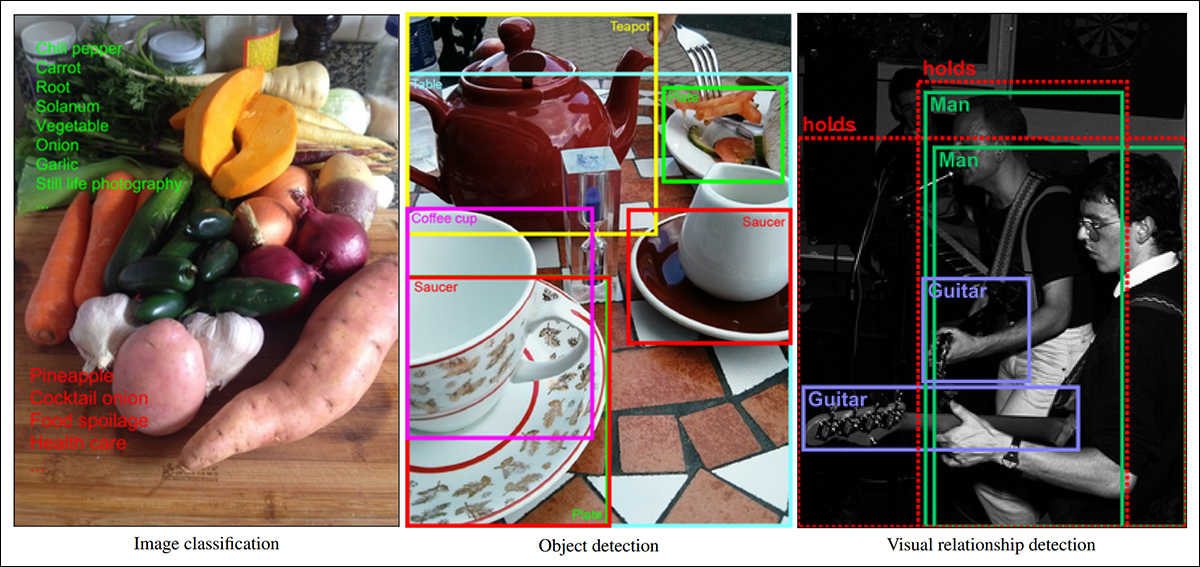

Примеры аннотаций изображений из набора данных Google Open Images, рассмотренные в новой работе. Источник: https://arxiv.org/pdf/1811.00982

Чтобы оценить, насколько хорошо метод может обнаружить утечку, когда изображения были тонко изменены путем изменения размера, обрезки или подобных не-семантических преобразований, авторы протестировали на Flickr30k, случайно выбирая 5 000 изображений в качестве запросов и используя весь набор данных в качестве справочного.

Каждое запросное изображение было преобразовано перед кодированием (т.е. подвергалось не-семантическому изменению, такому как изменение размера или обрезка), и затем сопоставлено с наиболее похожим элементом в коллекции с использованием косинусной подобия; совпадение было засчитано только в том случае, если исходное изображение было возвращено в качестве лучшего результата.

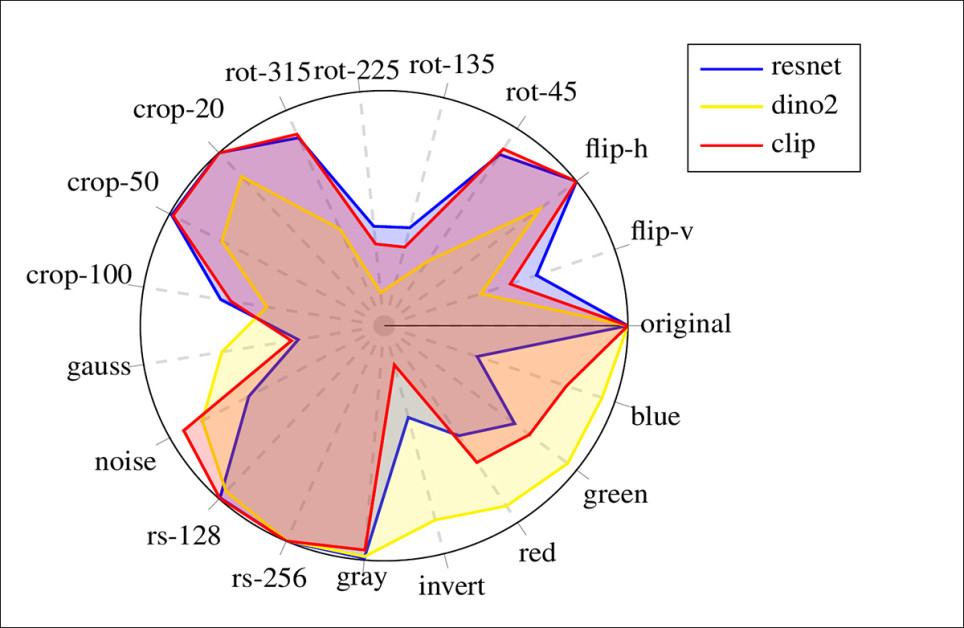

Три кодировщика были сравнены: ResNet-152; DINOv2 ViT-B/14; и CLIP ViT-B/32.

Четыре типа не-семантических преобразований изображений были использованы: геометрические (перевороты и вращения); обрезка (удаление 20, 50 или 100 пикселей с каждого края); пикселизация (гауссовское размытие, добавление шума или уменьшение до 128 или 256 пикселей); и цвет (оттенки серого, инверсия или наложения красного, зеленого или синего).

Из дополнительного материала, примеры преобразований, примененных к данным – типичные рутины также в предварительной обработке данных.

Авторы затем протестировали на утечку в извлечении изображений:

Точность обнаружения утечки на 5 000 запросных изображениях Flickr30k, подвергнутых различным не-семантическим преобразованиям.

Все три кодировщика достигли идеальной производительности на неизменных изображениях, и CLIP остался надежным на протяжении обрезки, горизонтальных переворотов, шума и изменения размера, превосходя ResNet на пиксельных и цветовых изменениях.

DINOv2 показал сильную устойчивость к цветовым преобразованиям (вероятно, из-за его самообучаемого дизайна, считают авторы), но был заметно слабее на геометрических редакциях и обрезке – оба из которых являются распространенными в дублированных наборах данных.

Поскольку LAION уже включает в себя вложения CLIP, и учитывая его последовательную надежность и скорость, CLIP был выбран в качестве кодировщика по умолчанию для основного анализа.

Жесткая и Мягкая Утечка

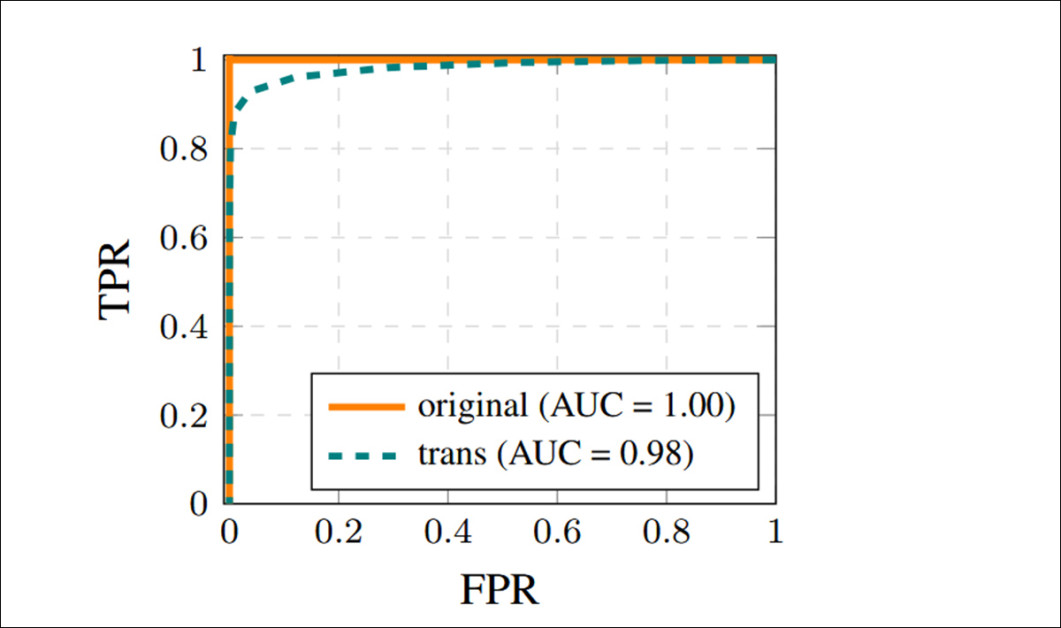

Производительность была оценена через различные пороги косинусной подобия, чтобы различать идентичные и gầnко-идентичные изображения (жесткая и мягкая утечка).

Порог 0,98 был выбран для определения жесткой утечки, в результате чего не было ложных положительных результатов и идеальное обнаружение идентичных изображений.

Для мягкой утечки был выбран порог 0,95, что позволило обнаружить больше gầnко-дубликатов, сохраняя при этом почти нулевую скорость ложных положительных результатов. Приоритет был отдан точности над полнотой, и результаты были поэтому консервативно оценены:

Кривые оперативной характеристики получателя были использованы для выбора жестких и мягких порогов для обнаружения утечки. Высокие баллы AUC под обоими преобразованными и не-преобразованными условиями демонстрируют, что gầnко-дубликаты могут быть надежно различены от несвязанных изображений, даже при минимальных изменениях.

Внутренняя Утечка

Внутренняя утечка была вычислена путем определения перекрестного загрязнения между обучающими и оценочными разделами внутри одного и того же набора данных. Только наборы данных с как бенчмаркными, так и обучающими или предварительными разделами были допущены, что сузило анализ до COCO, GCC, ImageNet, OpenImages и TextCaps.

Для COCO тестовый набор был сравнен с обучающим набором, проверочным набором и неаннотированным поднаборами, и проверочный набор был сравнен с обучающим и неаннотированным поднаборами.

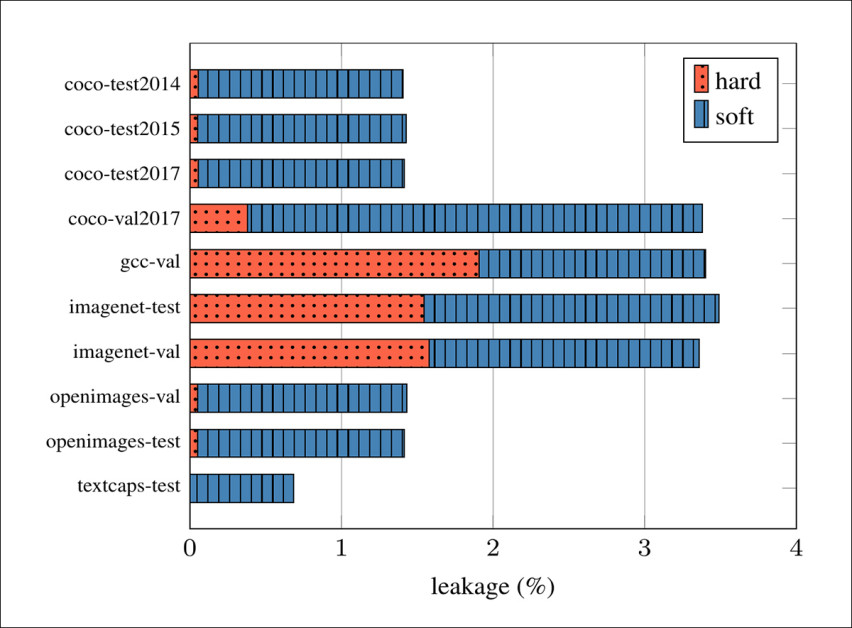

Самые высокие показатели внутренней утечки были обнаружены в тестовом и проверочном разделах ImageNet, с жесткой утечкой до 1,58% и мягкой утечкой чуть ниже 2%. GCC и COCO последовали, с COCO val2017, показавшим мягкую утечку 3% и его тестовыми разделами, варьирующимися от 1,35% до 1,38%. OpenImages показал низкую жесткую утечку на уровне 0,05%, но мягкая утечка превысила 1,3% в обоих тестовых и проверочных разделах. TextCaps показал самый низкий общий показатель утечки, на уровне 0,69%, без обнаружения жесткой утечки:

Показатели внутренней утечки, показывающие долю каждого оценочного раздела, перекрывающегося с его связанным обучающим набором.

Что касается этих результатов, авторы заявляют†:

‘Эти результаты показывают, что внутренняя утечка происходит во всех проанализированных наборах данных, либо в жесткой, либо в мягкой степени.

‘Учитывая, что утечка данных может поставить под угрозу оценку модели и что наборы данных специально предназначены для этой цели, внутренняя утечка является риском, который по дизайну не должен существовать.

‘Однако мы обнаружили множество случаев во всех наборах данных.’

Межнаборная Утечка

Чтобы измерить межнаборную утечку (когда модель обучается на одном наборе данных и оценивается на другом), четыре набора данных были использованы в качестве источников обучающих данных: GCC train, ImageNet train, OpenImages train, и LAION.

Эти были сопоставлены с оценочными данными, извлеченными из тестового и проверочного разделов COCO 2014, Flickr30K, тестового раздела TextCaps, тестового и проверочного разделов OpenImages, и тестового и проверочного разделов ImageNet.

Вложения CLIP ViT-B/32 были извлечены для всех наборов данных, кроме LAION, который предоставляет свои предварительно вычисленные вложения. Однако, поскольку эти вложения слегка отличаются от тех, которые генерируются с использованием официальной реализации CLIP, запросные изображения были масштабированы в соответствии с методом, использованным в репозитории clip-retrieval, чтобы обеспечить совместимость.

Поиск был выполнен с использованием поиска KNN, хотя масштаб LAION потребовал разделения на блоки по миллиону изображений, с каждым индексированным отдельно:

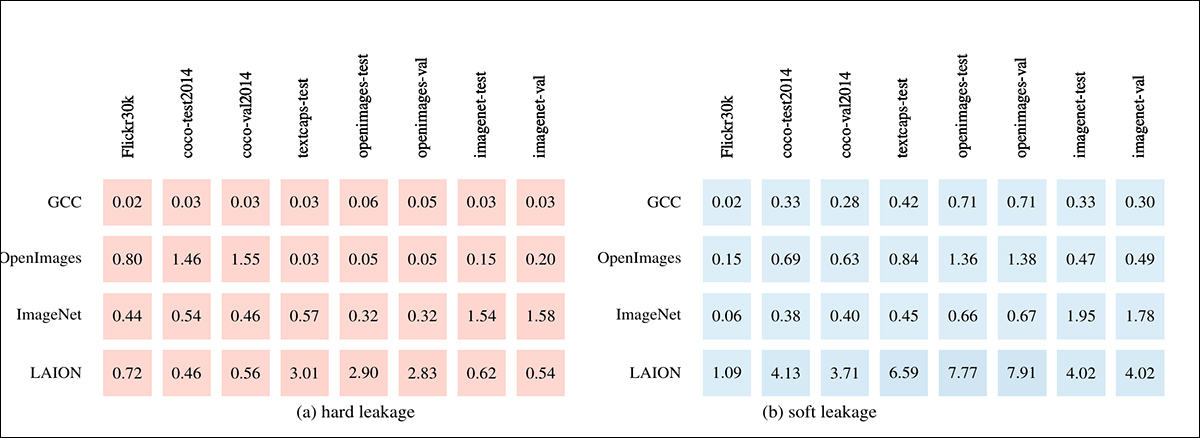

Межнаборная утечка между бенчмаркными наборами данных (столбцы) и предварительными наборами данных (строки). Слева мы видим ‘жесткую’ утечку (идентичные изображения), и справа ‘мягкую’ утечку (гнарко-дубликаты).

Перекрестное загрязнение было обнаружено во всех бенчмаркных наборах данных, с разной степенью тяжести. LAION показал самые высокие показатели жесткой утечки (идентичные изображения), особенно для OpenImages и TextCaps тестовых данных, каждый из которых превысил 3%. OpenImages также внес небольшой вклад в жесткую утечку в COCO.

Хотя менее выраженная, ImageNet все еще содержал жесткие дубликаты из каждого бенчмаркного набора, проанализированного; и GCC показал самый низкий общий показатель жесткой утечки, оставаясь ниже 1%. Мягкая утечка (гнарко-дубликаты) была более распространена: LAION снова произвел самые высокие показатели, с до 7,9% перекрытия для определенных бенчмарков; OpenImages и TextCaps были наиболее затронутыми бенчмаркными наборами; и Flickr30k показал наименьшее загрязнение.

Хотя такие перекрытия могут составлять только небольшую часть оценочных наборов, авторы отмечают, что их присутствие может позволить запоминанию и поставить под угрозу достоверность теста:

Примеры утечек изображений. Слева мы видим случаи ‘жесткой’ утечки, где изображения идентичны внутри набора данных (вверху) или между наборами данных (внизу); справа мы видим случаи ‘мягкой’ утечки, где изображения визуально гнарко-идентичны.

Влияние на Нижеоценку

Работа затем рассматривает, как утечка данных влияет на нижеоценку (т.е. производительность на стандартных задачах, когда предварительно обученные модели тестируются на бенчмарках, содержащих дублированные обучающие данные).

Три задачи были рассмотрены: классификация с нулевым выстрелом; классификация с учителем; и извлечение изображения-текста.

Для каждой задачи производительность модели была оценена на бенчмаркном наборе данных, для которого уже были обнаружены утечки в предварительном обучающем наборе. Результаты были сравнены через четыре поднабора: полный бенчмарк; поднабор утечек; поднабор неутечек; и случайно выбранный поднабор того же размера, что и утечка (использованный в качестве контроля).

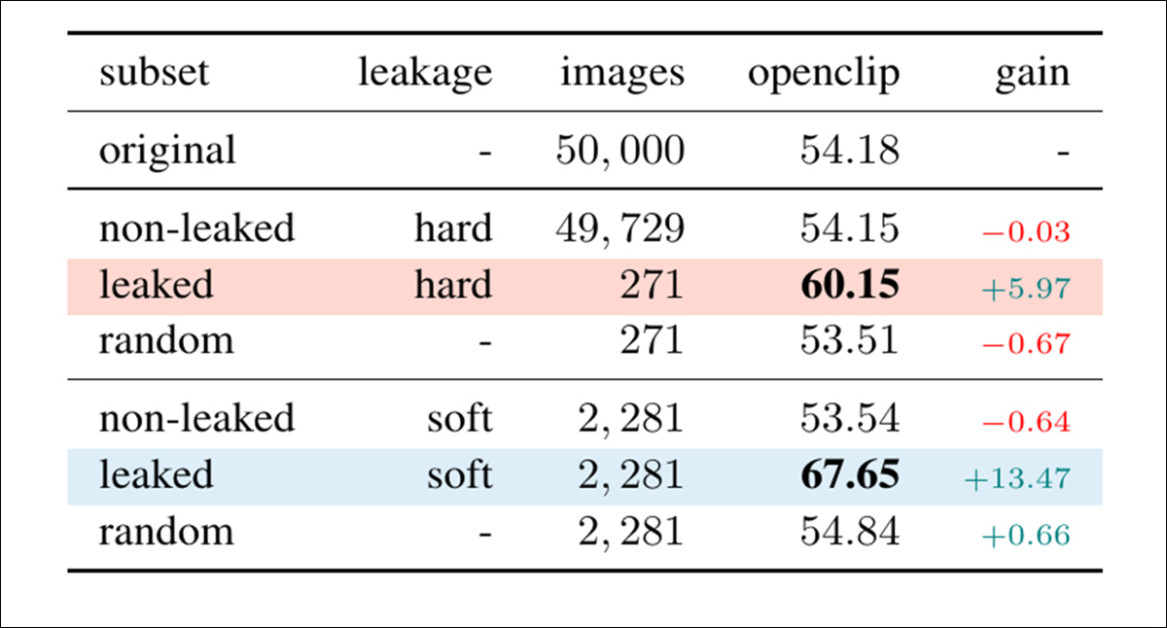

Влияние утечки данных на три нижеоценки было измерено с использованием бенчмаркных поднаборов, известных как содержащие утечки. В классификации с нулевым выстрелом модель, предварительно обученная на LAION, достигла заметно более высокой точности на утечных изображениях из набора оценки ImageNet, подтверждая, что воздействие даже гнарко-дубликатов во время обучения обеспечивает измеримое преимущество:

Точность классификации с нулевым выстрелом на наборе оценки ImageNet через поднаборы с и без утечки. Последний столбец сообщает о точности, относительной к полному набору, и выделенные строки соответствуют утечным поднаборам.

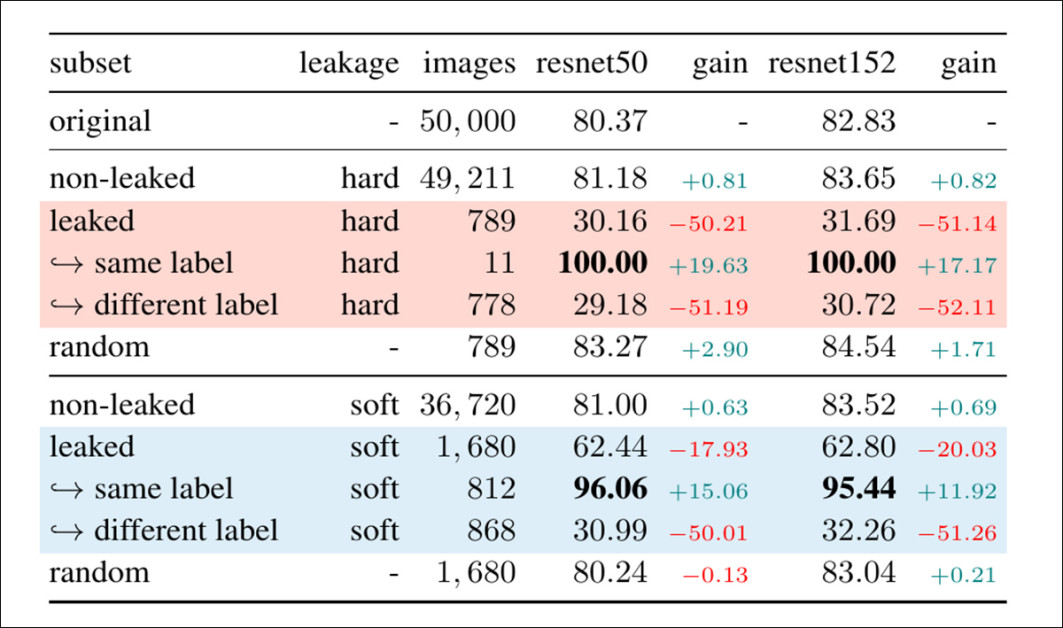

Для классификации с учителем утечка в ImageNet вызвала драматическое падение производительности – если только утечное изображение не имело того же метки в обоих разделах, в котором случае модель достигла почти идеальной точности, раскрывая сильный эффект запоминания:

Точность классификация с учителем на наборе оценки ImageNet для поднаборов с и без утечки. Столбцы ‘прирост’ показывают изменение, относительное к полному набору. Утечные поднаборы выделены.

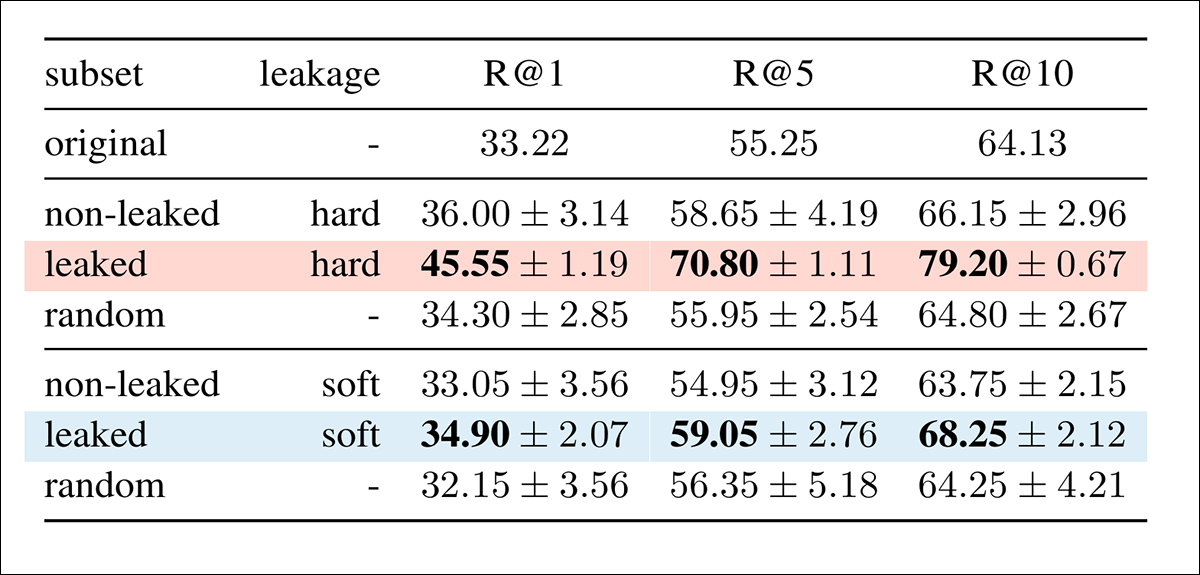

В извлечении изображения-текста производительность снова улучшилась для утечных образцов, с как жесткой, так и мягкой утечкой, приводящей к более высокой отзывчивости, и с утечными поднаборами, также дающими более последовательные результаты через запуски:

Производительность извлечения изображения-текста на Flickr30k через поднаборы с и без утечки, с утечными поднаборами, выделенными.

Авторы заключили:

‘В целом, мы [показываем] последовательные доказательства того, что утечка представляет серьезную угрозу для справедливой оценки моделей в визуальных наборах данных, компрометируя один из наиболее фундаментальных принципов машинного обучения: не оценивать модели на их обучающих данных.’

Заключение

Одним из шокирующих аспектов работы, хотя и не новым, является отчет о необходимости использования CLIP для получения вложений для огромной горы изображений в LAION, представляющей собой масштаб, который больше не может быть решен никаким другим способом, кроме агрегатного, имеющего дело с токенизированными метаданными вместо более подробных характеристик, которые могут быть осмотрены, когда набор данных более управляем.

Это яркая иллюстрация того, насколько обучение моделей компьютерного зрения и языка окончательно превысило границы и возможности человеческого надзора или любого вида ручной куратории, за исключением представительных подвыборок.

* Возможно, несколько запутанно, проблема дублирования определяется в работе как ‘утечка’.

† Акцент авторов.

Опубликовано впервые во вторник, 26 августа 2025