Искусственный интеллект

Использование внимания человека может улучшить изображения, сгенерированные ИИ

Новые исследования из Китая предложили метод для улучшения качества изображений, сгенерированных моделями Latent Diffusion Models (LDM) таких как Stable Diffusion.

Метод фокусируется на оптимизации выделяющихся регионов изображения – областей, которые с наибольшей вероятностью привлекут внимание человека.

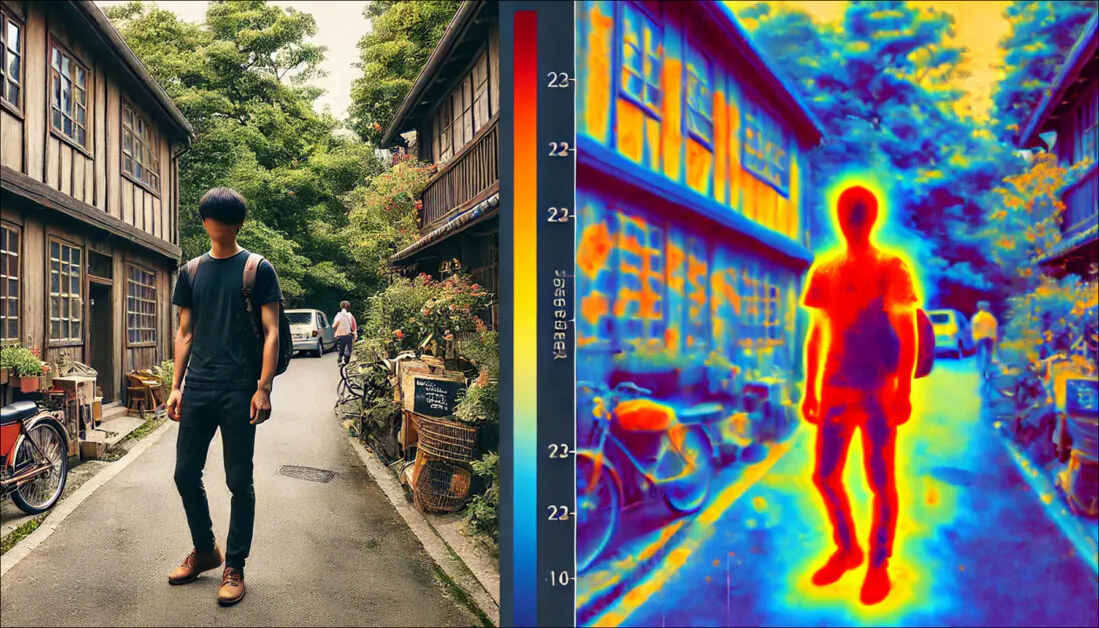

Новые исследования показали, что карты выделения (четвертый столбец слева) можно использовать как фильтр или ‘маску’ для управления вниманием в процессе денойзинга в сторону областей изображения, которые люди с наибольшей вероятностью будут рассматривать. Источник: https://arxiv.org/pdf/2410.10257

Традиционные методы оптимизируют все изображение равномерно, в то время как новый подход использует детектор выделения для выявления и приоритизации более ‘важных’ регионов, как это делают люди.

В количественных и качественных тестах метод исследователей смог превзойти предыдущие модели на основе диффузии, как в плане качества изображения, так и в плане соответствия текстовым подсказкам.

Новый подход также показал лучшие результаты в тесте восприятия человека с 100 участниками.

Естественный отбор

Выделение, способность приоритизировать информацию в реальном мире и в изображениях, является неотъемлемой частью человеческого зрения.

Простой пример этого – повышенное внимание к деталям, которое классическое искусство уделяет важным областям картины, таким как лицо в портрете или мачты корабля в морской сцене; в таких примерах внимание художника сосредотачивается на центральной теме, что означает, что общие детали, такие как фон портрета или далекие волны шторма, более приблизительны и представительны, чем детализированы.

Информированные человеческими исследованиями, методы машинного обучения возникли в последнее десятилетие, которые могут воспроизводить или хотя бы приближаться к человеческому фокусу интереса в любой картине.

Сегментация объектов (семантическая сегментация) может помочь в выделении аспектов изображения и разработке соответствующих карт выделения. Источник: https://arxiv.org/pdf/1312.6034

В потоке исследовательской литературы наиболее популярным детектором карт выделения за последние пять лет является инициатива 2016 года Gradient-weighted Class Activation Mapping (Grad-CAM), которая позже эволюционировала в улучшенную систему Grad-CAM++, среди других вариантов и усовершенствований.

Grad-CAM использует градиент активации семантического токена (такого как ‘собака’ или ‘кот’) для создания визуальной карты того, где концепция или аннотация, скорее всего, представлена в изображении.

Примеры из оригинальной статьи Grad-CAM. Во втором столбце гайдед бэкпропагация выделяет все вкладывающиеся особенности. В третьем столбце семантические карты нарисованы для двух концепций ‘собака’ и ‘кот’. Четвертый столбец представляет собой конкатенацию двух предыдущих выводов. Пятый – окклюзия (маскирование) карта, соответствующая выводу; и, наконец, в шестом столбце визуализируются Grad-CAM на уровне ResNet-18. Источник: https://arxiv.org/pdf/1610.02391

Опросы людей о результатах, полученных этими методами, показали соответствие между этими математическими выделениями ключевых точек интереса в изображении и человеческим вниманием (при просмотре изображения).

SGOOL

Новая статья рассматривает, что выделение может принести в системы текст-изображение (и, потенциально, текст-видео) такие как Stable Diffusion и Flux.

Когда интерпретируется текстовая подсказка пользователя, модели Latent Diffusion исследуют их обученное латентное пространство для обученных визуальных концепций, соответствующих словам или фразам, использованным в подсказке. Затем они парсят эти найденные данные через процесс денойзинга, где случайный шум постепенно эволюционирует в творческую интерпретацию текстовой подсказки пользователя.

В этой точке, однако, модель уделяет равное внимание каждой части изображения. С тех пор, как модели диффузии стали популярными в 2022 году с запуском OpenAI доступного Dall-E генераторов изображений, и последующим открытием Stability.ai фреймворка Stable Diffusion, пользователи обнаружили, что ‘существенные’ секции изображения часто недооценены.

Учитывая, что в типичном изображении человека лицо (которое имеет максимальную важность для зрителя) занимает не более 10-35% от общего изображения, этот демократический метод распределения внимания работает против как природы человеческого восприятия, так и истории искусства и фотографии.

Когда кнопки на джинсах человека получают такое же вычислительное усилие, как и их глаза, распределение ресурсов можно назвать неоптимальным.

Следовательно, новый метод, предложенный авторами, озаглавленный Оптимизация диффузионных латентных переменных с помощью выделения (SGOOL), использует детектор выделения для увеличения внимания к пренебрегаемым областям изображения, уделяя меньше ресурсов секциям, которые, скорее всего, останутся на периферии внимания зрителя.

Метод

Пайплайн SGOOL включает в себя генерацию изображения, карту выделения и оптимизацию, с общим изображением и уточненным изображением, обработанными совместно.

Концептуальная схема для SGOOL.

Латентные вложения модели диффузии оптимизируются直接 с файн-тюнингом, удаляя необходимость в обучении конкретной модели. Метод выборки Denoising Diffusion Implicit Model (DDIM) Стэнфордского университета, знакомый пользователям Stable Diffusion, адаптирован для включения вторичной информации, предоставляемой картами выделения.

В статье говорится:

‘Мы сначала используем детектор выделения, чтобы имитировать человеческую систему внимания и выделить выделенные регионы. Чтобы избежать повторного обучения дополнительной модели, наш метод直接 оптимизирует латентные переменные диффузии.

‘Кроме того, SGOOL использует обратимый процесс диффузии и наделяет его достоинствами реализации с постоянной памятью. Следовательно, наш метод становится параметро-эффективным и методом файн-тюнинга, который можно подключить и использовать. Были проведены обширные эксперименты с несколькими метриками и оценкой человека.’

Поскольку этот метод требует нескольких итераций процесса денойзинга, авторы приняли Direct Optimization Of Diffusion Latents (DOODL) фреймворк, который предоставляет обратимый процесс диффузии – хотя он все еще применяет внимание ко всей картинке.

Чтобы определить области человеческого интереса, исследователи использовали фреймворк TransalNet Университета Данди 2022 года.

Примеры обнаружения выделения из проекта TransalNet 2022 года. Источник: https://discovery.dundee.ac.uk/ws/portalfiles/portal/89737376/1_s2.0_S0925231222004714_main.pdf

Выделенные регионы, обработанные TransalNet, затем обрезались для генерации заключительных секций выделения, которые, скорее всего, будут наиболее интересны реальным людям.

Разница между пользовательским текстом и изображением должна быть рассмотрена в плане определения функции потерь, которая может определить, работает ли процесс. Для этого использовалась версия Contrastive Language–Image Pre-training (CLIP) от OpenAI – теперь основа сектора исследований синтеза изображений – вместе с учетом оцененной семантической дистанции между текстовой подсказкой и глобальным (не-выделенным) выходом изображения.

Авторы утверждают:

‘[Окончательная функция потерь] учитывает отношения между выделенными частями и глобальным изображением одновременно, что помогает сбалансировать локальные детали и глобальную последовательность в процессе генерации.

‘Эта функция потерь, осведомленная о выделении, используется для оптимизации латентных переменных изображения. Градиенты вычисляются на зашумленных [латентных переменных] и используются для усиления эффекта условирования входной подсказки на выделенные и глобальные аспекты исходного сгенерированного изображения.’

Данные и тесты

Чтобы протестировать SGOOL, авторы использовали ‘ванилльную’ дистрибуцию Stable Diffusion V1.4 (обозначенную как ‘SD’ в результатах тестов) и Stable Diffusion с руководством CLIP (обозначенную как ‘базовая’ в результатах).

Система была оценена против трех публичных наборов данных: CommonSyntacticProcesses (CSP), DrawBench и DailyDallE*.

Последний содержит 99 сложных подсказок от художника, представленного в одной из блог-постов OpenAI, в то время как DrawBench предлагает 200 подсказок по 11 категориям. CSP состоит из 52 подсказок, основанных на восьми различных грамматических случаях.

Для SD, базовой и SGOOL в тестах использовалась модель CLIP для генерации изображений и текстовых вложений. Использовалась одна и та же подсказка и случайное семя. Размер выхода был 256×256, и использовались значения по умолчанию и настройки TransalNet.

Помимо метрики балла CLIP, использовался оцененный Балл предпочтения человека (HPS), а также реальный тест с 100 участниками.

Количественные результаты, сравнивающие SGOOL с предыдущими конфигурациями.

В отношении количественных результатов, изображенных в таблице выше, статья гласит:

‘[Наша] модель значительно превосходит SD и Базовую на всех наборах данных как по баллу CLIP, так и по метрике HPS. Средние результаты нашей модели по баллу CLIP и HPS на 3,05 и 0,0029 выше, чем у второго места, соответственно.’

Авторы进一步 оценили ящиковые графики баллов HPS и CLIP по отношению к предыдущим подходам:

Ящиковые графики для баллов HPS и CLIP, полученных в тестах.

Они комментируют:

‘Можно увидеть, что наша модель превосходит другие модели, что указывает на то, что наша модель более способна генерировать изображения, соответствующие подсказкам.

‘Однако на ящиковом графике не легко визуализировать сравнение из-за размера этой метрики оценки [0, 1]. Следовательно, мы продолжаем рисовать соответствующие гистограммы.

‘Можно увидеть, что SGOOL превосходит SD и Базовую на всех наборах данных как по баллу CLIP, так и по метрике HPS. Количественные результаты демонстрируют, что наша модель может генерировать более семантически последовательные и предпочитаемые человеком изображения.’

Исследователи отмечают, что хотя базовая модель может улучшить качество выхода изображения, она не учитывает выделенные области изображения. Они утверждают, что SGOOL, достигая компромисса между глобальной и выделенной оценкой изображения, получает лучшие изображения.

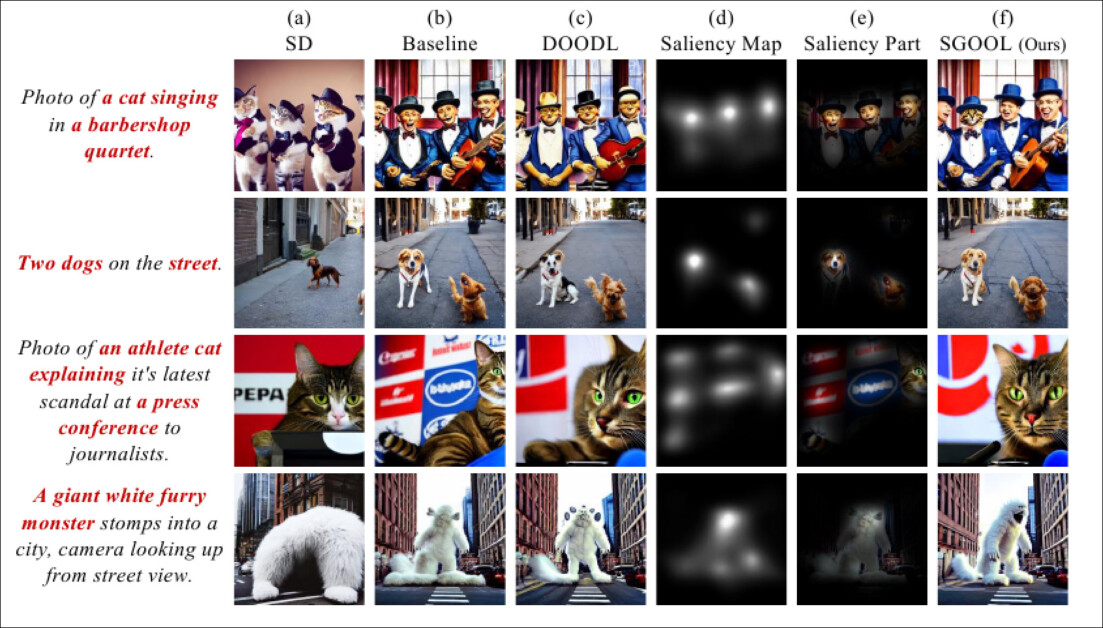

В качественных (автоматизированных) сравнениях количество оптимизаций было установлено на 50 для SGOOL и DOODL.

Качественные результаты для тестов. Пожалуйста, обратитесь к исходной статье для лучшего определения.

Здесь авторы наблюдают:

‘В [первом ряду] предметами подсказки являются “кот, поющий” и “барбер-шоп квартет”. В изображении, сгенерированном SD, четыре кота, и содержание изображения плохо согласовано с подсказкой.

‘Кот игнорируется в изображении, сгенерированном Базовой, и в изображении не хватает деталей в изображении лица и деталей в изображении. DOODL пытается сгенерировать изображение, соответствующее подсказке.

‘Однако, поскольку DOODL оптимизирует глобальное изображение напрямую, люди в изображении оптимизируются к коту.’

Они进一步 отмечают, что SGOOL, напротив, генерирует изображения, которые более соответствуют исходной подсказке.

В тесте восприятия человека 100 волонтеров оценили тестовые изображения по качеству и семантической последовательности (т. е. насколько близко они соответствовали исходным текстовым подсказкам). Участники имели неограниченное время для принятия решений.

Результаты теста восприятия человека.

Как отмечается в статье, метод авторов заметно предпочтителен над предыдущими подходами.

Вывод

Не lâu после того, как недостатки, рассмотренные в этой статье, стали очевидными в локальных установках Stable Diffusion, различные специальные методы (такие как After Detailer) появились для того, чтобы заставить систему применить дополнительное внимание к областям, которые представляют больший интерес для человека.

Однако этот тип подхода требует, чтобы система диффузии сначала прошла через свой нормальный процесс применения равного внимания ко всей картинке, с дополнительной работой, выполняемой на дополнительной стадии.

Доказательства из SGOOL предполагают, что применение базовой человеческой психологии к приоритизации секций изображения может значительно улучшить первоначальный вывод, без пост-обработочных шагов.

* Статья предоставляет один и тот же ссылку для этого, что и для CommonSyntacticProcesses.

Опубликовано впервые в среду, 16 октября 2024