Взгляд Anderson

Привнесение изображений, сгенерированных ИИ, в свет с помощью HDR

Изображения и видео, сгенерированные ИИ, могут быть впечатляющими, но они не соответствуют «профессиональному» стандарту – проблема, которую стремится решить новый исследовательский проект.

В профессиональном аудиовизуальном сообществе одна из наиболее частых возражений против вторжения ИИ заключается в отсутствии профессиональных стандартов воспроизведения изображений и видео. Не в последнюю очередь это связано с возможностью работать с изображениями и видео с высоким динамическим диапазоном (HDR).

Изображения HDR являются современным эквивалентом 19-го/20-го века фотографической практики, называемой брекетингом, когда одна и та же картинка снимается несколько раз с увеличивающимся количеством света, допускаемого к пленке:

Выше, короткая брекетированная последовательность. Вставка ниже, высокий динамический диапазон, который можно экстраполировать из этих фотографий в одно изображение. Источник

В традиционной фотографии это приводило к нескольким картинкам, которые могли, с некоторой экспертизой и усилиями, быть составлены в одну печать, которая бы выиграла от всех различных уровней деталей, доступных в диапазоне экспозиций. Но это не было тривиальным или простым процессом.

В наши дни «авто-брекетированная» последовательность изображений может либо производить несколько изображений, либо объединяться в одно изображение HDR – эффективно, множество экспозиций в одном изображении, которое приложения для редактирования изображений, поддерживающие HDR, такие как Photoshop, могут проходить через них и позволять фотографу оркестрировать в одно идеальное выходное изображение.

Если вы задумываетесь, почему вам следует заботиться об этом, или как это влияет на вашу собственную фотографию, иллюстрация к этой статье предназначена для демонстрации этого в знакомой форме:

Выше, слева мы видим типичный пример изображения sRGB (т.е. не-HDR). Просто осветление (показано справа) не показывает монстра в шкафу, потому что эта деталь была выброшена, когда фотограф и автоматические процессы камеры решили, что следует отдать предпочтение в фотографии:

Ниже показано, насколько «выцветшим» должен быть передний план на момент экспозиции, чтобы зарегистрировать монстра в шкафу в не-HDR-фотографии, и (справа) как монстр погружается в темноту, когда экспозиция делается подходящей для хорошо освещенных фоновых объектов:

Ниже мы видим, какой детали можно «спасти» из изображения HDR или последовательности изображений. В этом случае монстр «прятался» в самых низких визуальных регистрах последовательности HDR, на уровне, где остальной контент был бы «выброшен» в gần-белый (выше, слева). Указав, что широкий диапазон уровней яркости должен быть выражен выборочно в одном изображении, эти диссонансные элементы могут быть составлены в одно рациональное изображение:

Изображение не-HDR известно как отображаемое изображение, а высокогамутное изображение HDR известно как сценарное изображение.

HDR-видео также существует, и этот тип тональной гибкости и пластичности действительно дает кинематографистам некоторую свободу действий, чтобы спасти, оценить и интерпретировать кадры различными творческими и последовательными способами; не удивительно, что творческие люди неохотно работают с «сплющенным» выходом sRGB, типичным для большинства генеративных框ок ИИ.

HDR в ИИ

Естественно, что исследовательская сцена заинтересована в том, чтобы привести генеративные框ки ИИ в эпоху HDR. Однако это не тривиальная задача, как из-за фундаментальной архитектуры диффузионных генеративных систем, так и потому, что хорошие данные HDR занимают много места на диске, что делает их неуклюжими коллекциями; следовательно, наборы данных, подходящие для этой задачи, скудны.

Тем не менее, сотрудничество между университетом в Сингапуре и исследовательским центром Adobe предлагает метод производства последовательностей изображений HDR, в методологии, которая может быть теоретически применена к видео, а также к статичным изображениям:

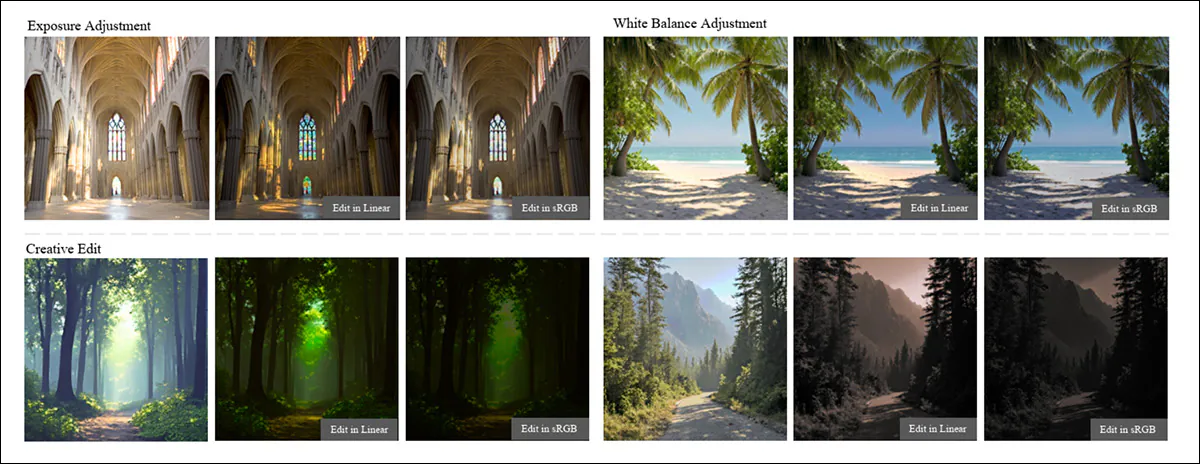

С сайта проекта для новой работы, примеры «брекетированного» текст-изображения. Источник

Новая система генерирует несколько согласованных версий одного и того же изображения на разных уровнях яркости и учитывает, насколько ярко сцена была на самом деле, затем объединяет их в одно результирующее изображение, которое сохраняет детали как в тени, так и в бликах, позволяя последующим редактированиям экспозиции или цвета вести себя более как корректировки реальной камеры, а не хрупкие корректировки полностью обработанного изображения.

Система использует разнообразие различных моделей для этой задачи, включая варианты Qwen и Flux:

Примеры из новой статьи, показывающие, как система может генерировать несколько версий экспозиции одной и той же сцены, сохраняя при этом неизменной основную структуру. Начиная с простой карты краев, модель производит согласованные изображения через очень темные до очень ярких настроек, будь то лунный свет, солнечный свет, закат или даже небольшой объект, такой как воздушный шар, с предметом и композицией, остающимися стабильными, поскольку только освещение меняется. Метод может варьировать яркость в контролируемом, камероподобном виде, а не дрейфовать или изобретать новый контент, когда экспозиция меняется. Источник

Авторы заявляют:

‘Генерировать линейные изображения сложно, поскольку предварительно обученные VAE в диффузионных моделях испытывают трудности в сохранении одновременно экстремальных бликов и теней из-за более высокого динамического диапазона и глубины цвета.

‘С этой целью мы представляем линейное изображение как последовательность экспозиционных брекетов, каждый из которых захватывает определённую часть динамического диапазона, и предлагаем архитектуру DiT на основе потокового сопоставления для генерации экспозиционных брекетов, управляемой текстом.

‘Мы далее демонстрируем последующие применения, включая текст-управляемое линейное редактирование изображений и структуру-управляемую генерацию через ControlNet.’

Новая работа называется Генерация линейных изображений путем синтеза экспозиционных брекетов, и исходит от четырёх авторов из S-Lab в Наньянском технологическом университете, Adobe NextCam и исследовательского центра Adobe. Кроме упомянутой страницы проекта и видео на YouTube, сопровождающего выпуск, также есть (пока скудный) репозиторий GitHub, и обещание выпуска набора данных.

Хотя авторы предоставляют много примеров выхода из системы на связанной странице проекта, зрителям понадобится монитор, поддерживающий HDR, чтобы действительно различить характеристики выхода HDR, представленного. Тем не менее, пожалуйста, найдите обзор исследователей на YouTube в конце этой статьи – но будьте осведомлены, что различия между показанными примерами могут не быть ясны на не-HDR-мониторе.

Метод и данные

Авторы подчеркивают степень, в которой сбор данных является проблемой в этом конкретном преследовании:

‘Получение большого количества линейных изображений чрезвычайно сложно на практике. Более того, большинство публичных наборов данных HDR либо панорамны (и, таким образом, фокусируются почти исключительно на контенте крупномасштабной сцены), либо не предоставляют истинные линейные изображения, что делает их непригодными для наших целей.

‘Следовательно, мы в основном используем наборы данных RAW-изображений в качестве основы для обучения.’

Исследователи сделали творческое использование немногих доступных вариантов, используя набор данных RAISE в качестве фактических данных для обучения и набор данных MIT-Adobe FiveK в качестве оценочных данных*.

Чтобы построить пригодные для использования данные HDR-обучения, исследователи запустили файлы камеры RAW через стандартизированный конвейер, чтобы удалить камера-специфические причуды, преобразовав изображения в последовательный, сценарно-относящийся линейный формат:

Схема рабочего процесса авторов: система начинается с шума, представляющего четыре уровня экспозиции одной и той же сцены, вместе с текстовым промптом и токеном яркости, и обрабатывает их через стэкованные трансформер-блоки, которые сохраняют различные экспозиции согласованными, корректируя освещение. Затем система предсказывает как набор изображений экспозиции, так и общую шкалу яркости, и последовательно декодирует и объединяет их в одно сценарно-относящееся изображение, сохраняя детали как в тени, так и в бликах.

Это включало в себя реконструкцию полного RGB из данных датчика, применение цветовой коррекции, нормализацию белого баланса и кратковременное перемещение в воспринимаемое цветовое пространство для шумоподавления, прежде чем вернуться к чистому линейному сигналу. Фактический свет в сцене затем был восстановлен с помощью настроек экспозиции камеры, так что каждый пиксель отражал бы реальную яркость, а не отображаемую приближение.

Поскольку такие значения могут варьироваться широко, данные затем стабилизировались путем масштабирования каждого изображения на основе его собственной яркостной распределения, используя статистику среднего и бликов, чтобы избежать как выцветших изображений, так и выброшенных бликов, в конечном итоге получив нормализованное линейное изображение, которое сохраняло истинный диапазон света в сцене, оставаясь при этом стабильным enough для обучения.

Текстовые метки для изображений затем создавались с помощью модели Qwen2.5-VL 7B, с промптами, созданными для соответствия характеристикам модели Flux, которая будет использоваться во время генерации.

Каждое изображение делилось на экспозиционные «срезы» и проходило через общий VAE-кодировщик, преобразуя все экспозиции в общее латентное пространство, предназначенное для захвата полного диапазона яркости. Латентные затем уточнялись из шума и декодировались обратно в изображения, позволяя последовательной реконструкции через темные и яркие области, без коллапса их в одну «сплющенную» экспозицию.

LoRA-тонкая настройка использовалась для адаптации предварительно обученной модели Flux к линейным данным изображений с минимальными дополнительными параметрами, помогая модели Single-Diffusion Transformers (single-DiT) оставаться стабильной, даже когда яркость варьировалась через экспозиционные брекеты.

Экспозиционная модуляция само-внимания (центральный столбец в иллюстрации схемы выше) была введена для совместной обработки всех брекетов, позволяя яркости корректироваться на экспозицию, сохраняя при этом структуру и мелкие детали согласованными.

3D-Ротационная позиционная вложенность (3D-R[o]PE) использовалась для кодирования как пространственного положения, так и идентификатора экспозиции, чтобы модель могла различать, какой брекет принадлежит каждому токену, сохраняя при этом пространственную согласованность, что позволяло чисто отделять изменение яркости от содержания сцены.

Обзор набора данных, используемого в исследовании, показывающий, как изображения распределены по типам контента и внутренним и внешним сценам, а также распределение значений яркости в обработанных данных. Гистограммы рисуют яркость и шкалу радианса в логарифмическом пространстве, иллюстрируя, насколько широко может варьироваться реальная яркость, с более высокими значениями радианса, соответствующими физически более ярким сценам, и подчеркивая сильный динамический диапазон, с которым обучена модель.