Угол Андерсона

HunyuanCustom представляет Deepfakes с одним изображением видео, со звуком и синхронизацией губ

В этой статье обсуждается новая версия мультимодальной модели мира Hunyuan Video под названием «HunyuanCustom». Широта охвата новой статьи в сочетании с рядом вопросов, затронутых во многих представленных видео-примерах, Проект страницу*, ограничивает нас более общим охватом, чем обычно, и ограниченным воспроизведением огромного количества видеоматериалов, сопровождающих этот релиз (поскольку многие из видео требуют значительного повторного редактирования и обработки для улучшения читабельности макета).

Обратите внимание, что в статье генеративная система Kling, основанная на API, называется «Keling». Для ясности я буду использовать слово «Kling».

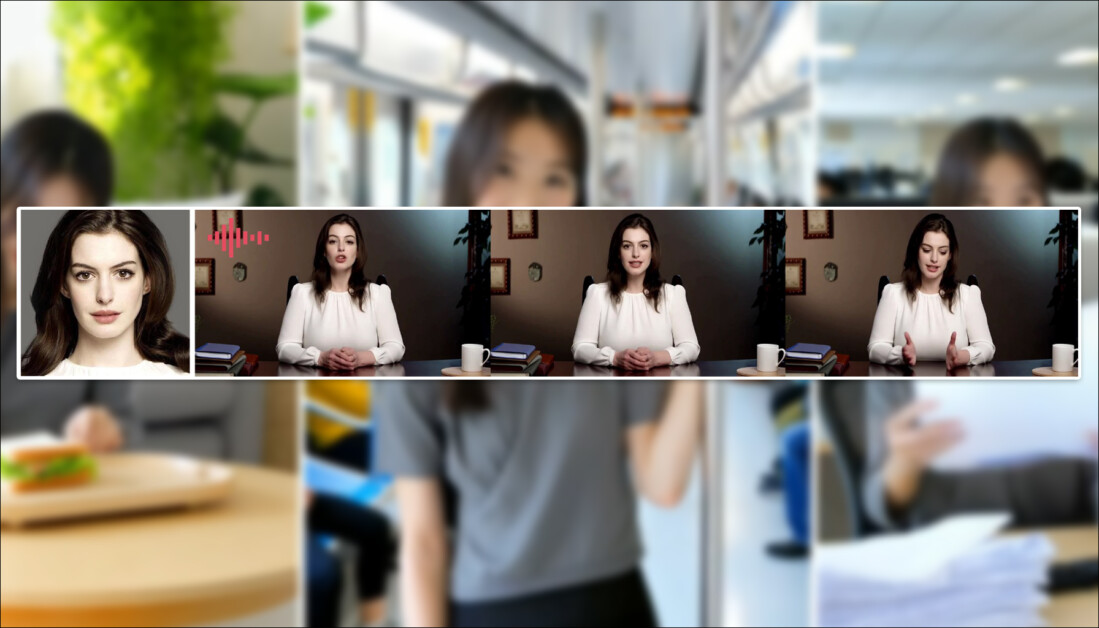

Tencent находится в процессе выпуска новой версии своего Хунюань Видео модель, Под названием HunyuanCustom. Новый релиз, по-видимому, способен сделать Модели Hunyuan LoRA избыточным, позволяя пользователю создавать настройки видео в стиле «дипфейк» с помощью одинарной Изображение:

Нажмите, чтобы играть. Подсказка: «Мужчина слушает музыку и готовит лапшу с улитками на кухне». Новый метод сравнивается как с методами с закрытым, так и с открытым исходным кодом, включая метод Клинга, который является серьёзным конкурентом в этой области. Источник: https://hunyuancustom.github.io/ (предупреждение: сайт, интенсивно использующий процессор и память!)

В крайнем левом столбце видео выше мы видим исходное изображение, предоставленное HunyuanCustom, а во втором столбце рядом с ним — интерпретацию запроса новой системой. Остальные столбцы показывают результаты, полученные с помощью различных собственных и открытых систем: Клинг; Виду; Пика; Хайлуо; и ВанНа основе SkyReels-A2.

На видео ниже мы видим рендеры трех сценариев, важных для этого релиза: соответственно, человек + объект; эмуляция одного символаи виртуальная примерка (человек + одежда):

Нажмите, чтобы играть. Три примера, отредактированные из материалов на сайте поддержки Hunyuan Video.

Из этих примеров можно сделать несколько выводов, в основном касающихся системы, полагающейся на изображение из одного источника, вместо нескольких изображений одного и того же предмета.

В первом клипе мужчина по сути все еще смотрит в камеру. Он наклоняет голову вниз и вбок не более чем на 20-25 градусов вращения, но при наклоне большем, системе действительно придется угадывать, как он выглядит в профиль. Это трудно, вероятно, невозможно точно оценить по одному фронтальному изображению.

Во втором примере мы видим, что маленькая девочка улыбаться В отрендеренном видео она выглядит так же, как на единственном статическом исходном изображении. Опять же, используя это единственное изображение в качестве ориентира, HunyuanCustom пришлось бы делать относительно необоснованные предположения о том, как выглядит её «лицо в состоянии покоя». Более того, её лицо не отклоняется от положения, обращённого к камере, больше, чем в предыдущем примере («мужчина ест чипсы»).

В последнем примере мы видим, что поскольку исходный материал — женщина и одежда, которую ей предлагают надеть, — не являются полными изображениями, рендер обрезал сценарий, чтобы он вписался, — что на самом деле является довольно хорошим решением проблемы с данными!

Дело в том, что хотя новая система может обрабатывать несколько изображений (например, человек + чипсы или человек + одежда), по-видимому, он не допускает множественных углов или альтернативных точек зрения одного персонажа, так что можно было бы разместить разнообразные выражения или необычные углы. В этом смысле система может поэтому бороться за замену растущей экосистемы моделей LoRA, которые возникли вокруг HunyuanVideo с момента его выпуска в декабре прошлого года, поскольку они могут помочь HunyuanVideo создавать единообразных персонажей с любого ракурса и с любым выражением лица, представленным в обучающем наборе данных (обычно 20–60 изображений).

Проводной для звука

Для аудио HunyuanCustom использует LatentSync система (которая, как известно, сложна в настройке для любителей и получении хороших результатов) для получения движений губ, соответствующих аудио и тексту, которые вводит пользователь:

Включает аудио. Нажмите, чтобы воспроизвести. Различные примеры синхронизации губ с дополнительного сайта HunyuanCustom, отредактированные вместе.

На момент написания статьи примеров на английском языке не было, но они кажутся довольно хорошими — тем более, что метод их создания прост в установке и доступен.

Редактирование существующего видео

Новая система предлагает, по-видимому, весьма впечатляющие результаты для редактирования видео в видео (V2V или Vid2Vid), где сегмент существующего (реального) видео маскируется и разумно заменяется субъектом, указанным в одном опорном изображении. Ниже приведен пример с сайта дополнительных материалов:

Нажмите, чтобы играть. В качестве цели выступает только центральный объект, но то, что остается вокруг него, также изменяется в проходе HunyuanCustom vid2vid.

Как мы видим, и как это стандартно в сценарии vid2vid, все видео в некоторой степени изменяется процессом, хотя больше всего изменяется в целевой области, т.е. плюшевой игрушке. Предположительно, конвейеры могут быть разработаны для создания таких преобразований под мусорный матовый подход, который оставляет большую часть видеоконтента идентичным оригиналу. Это то, что Adobe Firefly делает под капотом, и делает это довольно хорошо – но это недостаточно изученный процесс в генеративной сцене FOSS.

Тем не менее, большинство представленных альтернативных примеров лучше справляются с этими интеграциями, как мы можем видеть в собранной ниже компиляции:

Нажмите, чтобы играть. Разнообразные примеры вставленного контента с использованием vid2vid в HunyuanCustom, демонстрирующие заметное уважение к нецелевому материалу.

Новый старт?

Эта инициатива является развитием Хунюань Видеопроект, не слишком сильно отклоняясь от этого направления разработки. Улучшения проекта представляют собой отдельные архитектурные вставки, а не масштабные структурные изменения, что позволяет модели сохранять точность идентичности между кадрами, не полагаясь на предметно-специфический тонкая настройка, как в случае с LoRA или подходами текстовой инверсии.

Таким образом, для ясности следует отметить, что HunyuanCustom не обучается с нуля, а представляет собой тонкую настройку базовой модели HunyuanVideo от декабря 2024 года.

Те, кто разработал HunyuanVideo LoRA, могут задаться вопросом, будут ли они работать с этой новой версией или им придется заново изобретать велосипед LoRA. еще раз если им требуется больше возможностей настройки, чем встроено в эту новую версию.

В общем, тщательно настроенный выпуск гипермасштабной модели изменяет вес модели достаточно того, что LoRA, созданные для более ранней модели, не будут работать должным образом или вообще не будут работать с новой усовершенствованной моделью.

Однако иногда популярность мелодии может поставить под сомнение ее происхождение: один из примеров того, как мелодия становится эффективной вилка, с собственной экосистемой и последователями, является Пони Диффузия настройка Стабильная диффузия XL (SDXL). В настоящее время Pony имеет более 592,000 XNUMX загрузок на постоянно меняющихся Домен CivitAI с широким спектром LoRA, которые используют Pony (а не SDXL) в качестве базовой модели и которым требуется Pony во время вывода.

Отпустив

Проект страницу для Новый документ (который называется HunyuanCustom: Мультимодальная архитектура для создания персонализированного видео) содержит ссылки на Сайт GitHub который, как я уже писал, только что стал функциональным и, по-видимому, содержит весь код и необходимые веса для локальной реализации, а также предлагаемую временную шкалу (единственное важное, что еще предстоит сделать, — это интеграция ComfyUI).

На момент написания статьи проект Присутствие обнимающего лица все еще 404. Однако есть Версия на основе API где можно, по-видимому, продемонстрировать систему, если вы предоставите скан-код WeChat.

Я редко видел столь тщательно продуманное и обширное использование столь широкого спектра проектов в одной сборке, как это очевидно в HunyuanCustom, и, по-видимому, некоторые лицензии в любом случае обязывают к полному выпуску.

На странице GitHub анонсированы две модели: версия 720px1280px, требующая 8) ГБ пиковой памяти GPU, и версия 512px896px, требующая 60 ГБ пиковой памяти GPU.

В репозитории указано «Минимальный необходимый объём памяти графического процессора составляет 24 ГБ для 720px1280px129f, но это очень медленно… Мы рекомендуем использовать графический процессор с 80 ГБ памяти для лучшего качества генерации». – и напоминает, что пока система была протестирована только на Linux.

Более ранняя модель Hunyuan Video с момента официального выпуска была квантуется до размеров, при которых она может работать на менее чем 24 ГБ видеопамяти, и кажется разумным предположить, что новая модель также будет адаптирована сообществом в более удобные для потребителя формы, и что она быстро будет адаптирована для использования в системах Windows.

Из-за ограничений по времени и огромного объёма информации, сопровождающей этот релиз, мы можем рассмотреть его лишь в общих чертах, а не подробно. Тем не менее, давайте немного приоткроем завесу тайны над HunyuanCustom.

Взгляд на статью

Конвейер данных для HunyuanCustom, по-видимому, соответствующий GDPR фреймворк, включает в себя как синтезированные, так и открытые наборы видеоданных, включая OpenHumanVid, представлено восемь основных категорий: людей, животные, растений, пейзажи, транспортные средства, объекты, архитектура и аниме.

Обзор различных пакетов, входящих в конвейер конструирования данных HunyuanCustom, из релизной документации. Источник: https://arxiv.org/pdf/2505.04512

Первоначальная фильтрация начинается с Писценедетект, который сегментирует видео на отдельные клипы. ТекстBPN-Плюс-Плюс затем используется для удаления видео, содержащих избыточный экранный текст, субтитры, водяные знаки или логотипы.

Для устранения несоответствий в разрешении и продолжительности клипы стандартизированы до пяти секунд в длину и изменены до 512 или 720 пикселей по короткой стороне. Эстетическая фильтрация выполняется с помощью Коала-36Мс пороговым значением 0.06, примененным к пользовательскому набору данных, отобранному исследователями новой статьи.

Процесс извлечения субъекта объединяет Qwen7B Большая языковая модель (LLM), YOLO11X фреймворк распознавания объектов и популярный InsightFace архитектура, позволяющая идентифицировать и подтверждать идентичность человека.

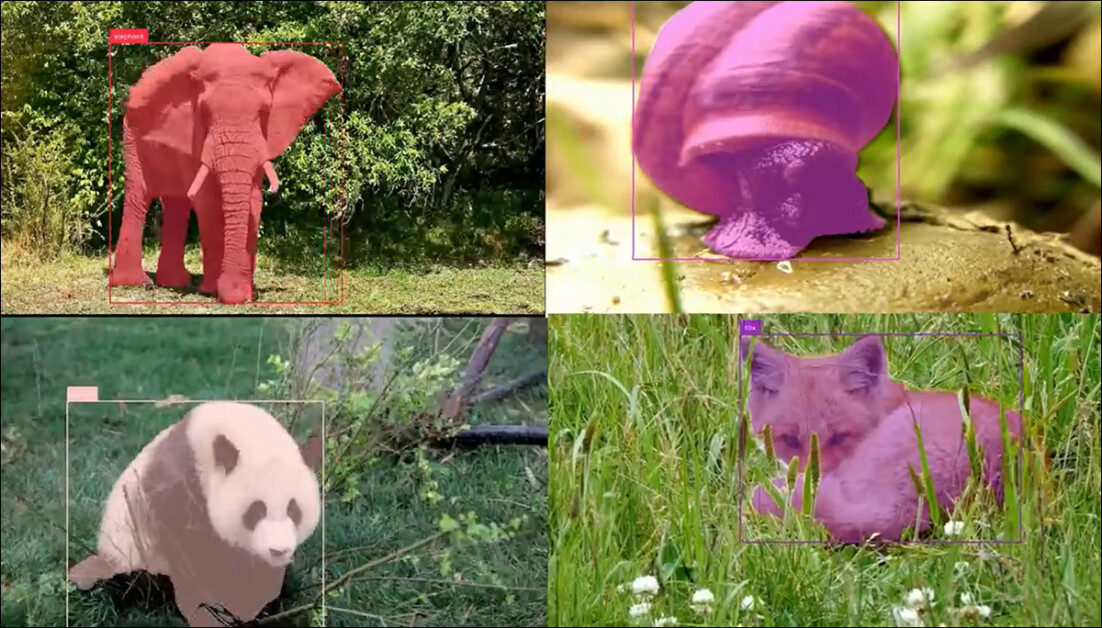

Для нечеловеческих субъектов, QwenVL и Заземленный SAM 2 используются для извлечения соответствующих ограничивающих рамок, которые отбрасываются, если они слишком малы.

Примеры семантической сегментации с использованием Grounded SAM 2, использованной в проекте Hunyuan Control. Источник: https://github.com/IDEA-Research/Grounded-SAM-2

Многосубъектное извлечение использует Флоренция2 для аннотации ограничивающего прямоугольника и Grounded SAM 2 для сегментации с последующей кластеризацией и временной сегментацией обучающих кадров.

Обработанные клипы дополнительно улучшаются с помощью аннотаций, используя фирменную систему структурированной маркировки, разработанную командой Hunyuan, которая предоставляет многоуровневые метаданные, такие как описания и сигналы движения камеры.

Маска увеличения Во время обучения применялись стратегии, включая преобразование в ограничивающие рамки, чтобы уменьшить переобучения и обеспечить адаптацию модели к объектам различной формы.

Аудиоданные синхронизировались с помощью вышеупомянутой функции LatentSync, и клипы отбрасывались, если показатели синхронизации опускались ниже минимального порогового значения.

Структура слепой оценки качества изображения ГиперIQA Для исключения видео с оценкой ниже 40 (по специальной шкале HyperIQA) использовался этот метод. После этого корректные аудиодорожки обрабатывались с помощью Whisper для извлечения признаков для последующих задач.

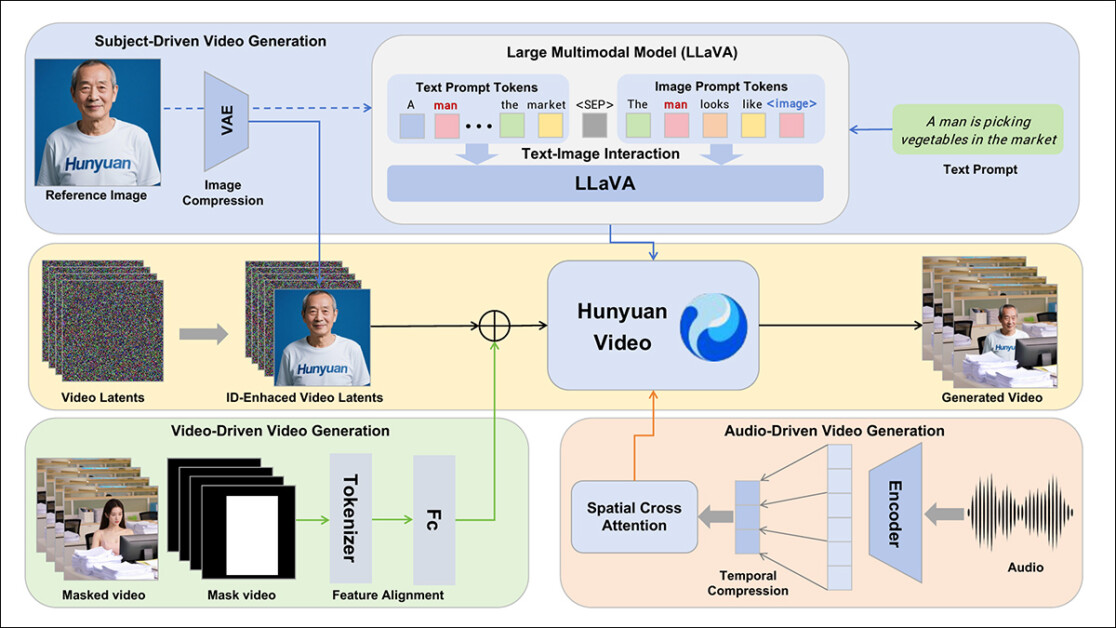

Авторы включают ЛЛаВА модель помощника языка на этапе аннотации, и они подчеркивают центральное положение, которое эта структура занимает в HunyuanCustom. LLaVA используется для генерации подписей к изображениям и помогает согласовывать визуальный контент с текстовыми подсказками, поддерживая построение согласованного обучающего сигнала по модальностям:

Фреймворк HunyuanCustom поддерживает генерацию видео с сохранением идентичности на основе входных данных текста, изображений, аудио и видео.

Используя возможности LLaVA по согласованию визуального языка, конвейер получает дополнительный уровень семантической согласованности между визуальными элементами и их текстовыми описаниями, что особенно ценно в многопредметных или сложных сценариях.

Пользовательское видео

Чтобы обеспечить генерацию видео на основе эталонного изображения и подсказки, были созданы два модуля, ориентированные на LLaVA, в первую очередь адаптировав структуру ввода HunyuanVideo таким образом, чтобы она могла принимать изображение вместе с текстом.

Это включало форматирование подсказки таким образом, чтобы изображение встраивалось напрямую или помечалось коротким описанием идентичности. Для того чтобы встраивание изображения не перегружало содержимое подсказки, использовался токен-разделитель.

Поскольку визуальный кодер LLaVA имеет тенденцию сжимать или отбрасывать мелкие пространственные детали во время выравнивания изображений и текстовых объектов (особенно при переводе одного эталонного изображения в общее семантическое вложение), модуль улучшения идентичности был включен. Поскольку почти все модели скрытой диффузии видео имеют некоторые трудности с сохранением идентичности без LoRA, даже в пятисекундном клипе, производительность этого модуля в тестировании в сообществе может оказаться значительной.

В любом случае, затем размер эталонного изображения изменяется, и оно кодируется с использованием каузального 3D-VAE из исходной модели HunyuanVideo, и его латентной вставляется в скрытое видео по временной оси с пространственным смещением, применяемым для предотвращения непосредственного воспроизведения изображения на выходе, при этом по-прежнему управляя генерацией.

Модель была обучена с использованием Согласование потока, с образцами шума, взятыми из логит-нормальный распределение – и сеть была обучена восстанавливать правильное видео из этих шумных латентных сигналов. LLaVA и видеогенератор были тонко настроены вместе, чтобы изображение и подсказка могли направлять вывод более плавно и сохранять постоянную идентичность субъекта.

Для многопредметных подсказок каждая пара изображение-текст была встроена отдельно и ей была назначена определенная временная позиция, что позволяло различать личности и поддерживало генерацию сцен с участием с разными взаимодействующие субъекты.

Звук и Видение

HunyuanCustom управляет генерацией звука/речи, используя как вводимый пользователем звук, так и текстовые подсказки, позволяя персонажам говорить в сценах, отражающих описываемую обстановку.

Для поддержки этого, модуль AudioNet Identity-disentangled вводит аудиофункции, не нарушая сигналы идентичности, встроенные из опорного изображения и подсказки. Эти функции согласуются с временной шкалой сжатого видео, делятся на сегменты на уровне кадров и вводятся с использованием пространственного перекрестное внимание механизм, который сохраняет каждый кадр изолированным, сохраняя последовательность объекта и избегая временных помех.

Второй модуль временной инъекции обеспечивает более точный контроль над временем и движением, работая в тандеме с AudioNet, сопоставляя аудиохарактеристики с определенными областями скрытой последовательности и используя Многослойный персептрон (MLP) для их преобразования в по токенам смещения движения. Это позволяет жестам и мимике с большей точностью следовать ритму и акценту устного ввода.

HunyuanCustom позволяет напрямую редактировать объекты в существующих видео, заменяя или вставляя людей или объекты в сцену без необходимости перестраивать весь клип с нуля. Это делает его полезным для задач, которые включают изменение внешнего вида или движения целевым образом.

Нажмите, чтобы играть. Еще один пример с дополнительного сайта.

Для обеспечения эффективной замены сюжета в существующих видео новая система избегает ресурсоемкого подхода последних методов, таких как популярный в настоящее время ВАСЕ, или те, которые объединяют целые видеопоследовательности вместе, отдавая предпочтение сжатию эталонного видео с использованием предварительно обученного каузального 3D-VAE – выравнивая его с внутренними скрытыми видеосигналами конвейера генерации, а затем складывая их вместе. Это делает процесс относительно легким, в то же время позволяя внешнему видеоконтенту направлять вывод.

Небольшая нейронная сеть обрабатывает выравнивание между чистым входным видео и шумными латентами, используемыми при генерации. Система тестирует два способа введения этой информации: объединение двух наборов признаков перед их повторным сжатием; и добавление признаков кадр за кадром. Авторы обнаружили, что второй метод работает лучше и позволяет избежать потери качества, сохраняя вычислительную нагрузку неизменной.

Данные и тесты

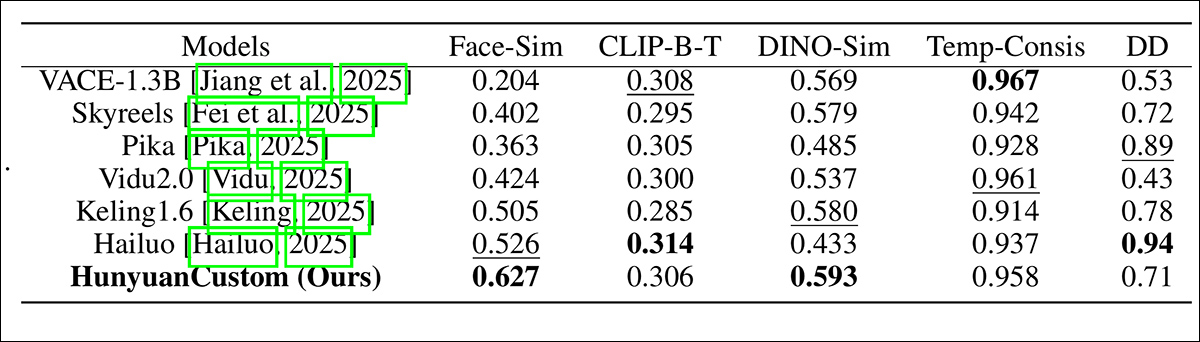

В тестах использовались следующие метрики: модуль согласованности идентичности в ArcFace, который извлекает вставки лиц как из эталонного изображения, так и из каждого кадра сгенерированного видео, а затем вычисляет среднее косинусное сходство между ними; сходство предмета, путем отправки сегментов YOLO11x в Дино 2 для сравнения; КЛИП-Бвыравнивание текста и видео, которое измеряет сходство между подсказкой и сгенерированным видео; снова CLIP-B, для расчета сходства между каждым кадром и его соседними кадрами и первым кадром, а также временной согласованности; и динамическая степень, как определено формулой VBench.

Как было указано ранее, базовыми конкурентами с закрытым исходным кодом были Hailuo; Vidu 2.0; Kling (1.6); и Pika. Конкурирующими фреймворками FOSS были VACE и SkyReels-A2.

Оценка производительности модели, сравнивающая HunyuanCustom с ведущими методами настройки видео по согласованности идентификатора (Face-Sim), сходству субъекта (DINO-Sim), выравниванию текста и видео (CLIP-BT), временной согласованности (Temp-Consis) и интенсивности движения (DD). Оптимальные и неоптимальные результаты выделены жирным шрифтом и подчеркнуты соответственно.

Авторы этих результатов заявляют:

«Наш [HunyuanCustom] обеспечивает наилучшую согласованность идентификаторов и субъектов. Он также демонстрирует сопоставимые результаты в следовании подсказкам и временной согласованности. [Hailuo] имеет лучший результат по клипам, поскольку хорошо выполняет текстовые инструкции, обладая только согласованностью идентификаторов, жертвуя согласованностью нечеловеческих объектов (худший DINO-Sim). С точки зрения динамической степени [Vidu] и [VACE] показывают плохие результаты, что может быть связано с небольшим размером модели».

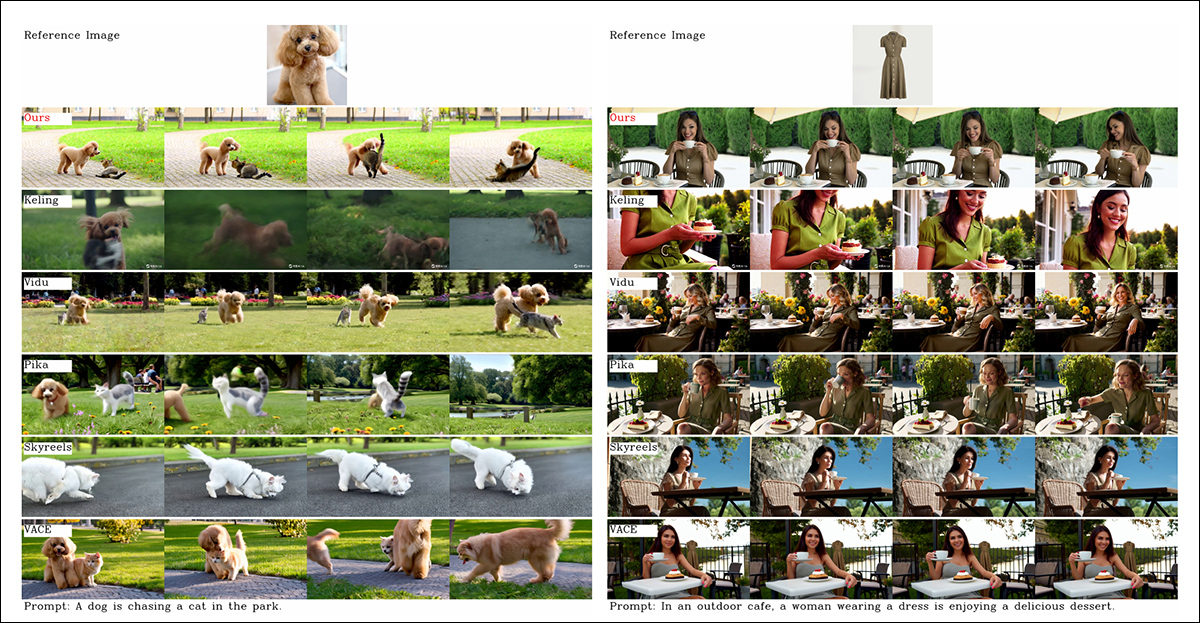

Хотя сайт проекта переполнен сравнительными видео (макет которых, похоже, был разработан для эстетики веб-сайта, а не для простого сравнения), в настоящее время он не содержит видеоэквивалент статических результатов, собранных в PDF, в отношении первоначальных качественных тестов. Хотя я включил его сюда, я призываю читателя внимательно изучить видео на сайте проекта, поскольку они дают лучшее представление о результатах:

Из статьи, сравнение объектно-центрированной настройки видео. Хотя зритель должен (как всегда) обратиться к исходному PDF для лучшего разрешения, видео на сайте проекта могут быть более ярким ресурсом в этом случае.

Авторы комментируют здесь:

«Можно увидеть, что [Vidu], [Skyreels A2] и наш метод достигают относительно хороших результатов в быстром выравнивании и согласованности сюжета, но качество нашего видео лучше, чем у Vidu и Skyreels, благодаря хорошей производительности генерации видео нашей базовой модели, т. е. [Hunyuanvideo-13B].

«Среди коммерческих продуктов, хотя [Kling] и обеспечивает хорошее качество видео, в первом кадре видео есть [проблема копирования-вставки], а иногда объект движется слишком быстро и [размывается], что приводит к плохому впечатлению от просмотра».

Авторы также отмечают, что Pika плохо справляется с точки зрения временной согласованности, внося артефакты в субтитры (эффекты, возникающие из-за плохого отбора данных, когда текстовые элементы в видеоклипах искажают основные концепции).

Они утверждают, что Hailuo сохраняет идентичность лица, но не сохраняет согласованность всего тела. Среди методов с открытым исходным кодом VACE, утверждают исследователи, не способен поддерживать согласованность идентичности, тогда как они утверждают, что HunyuanCustom создает видео с сильным сохранением идентичности, сохраняя при этом качество и разнообразие.

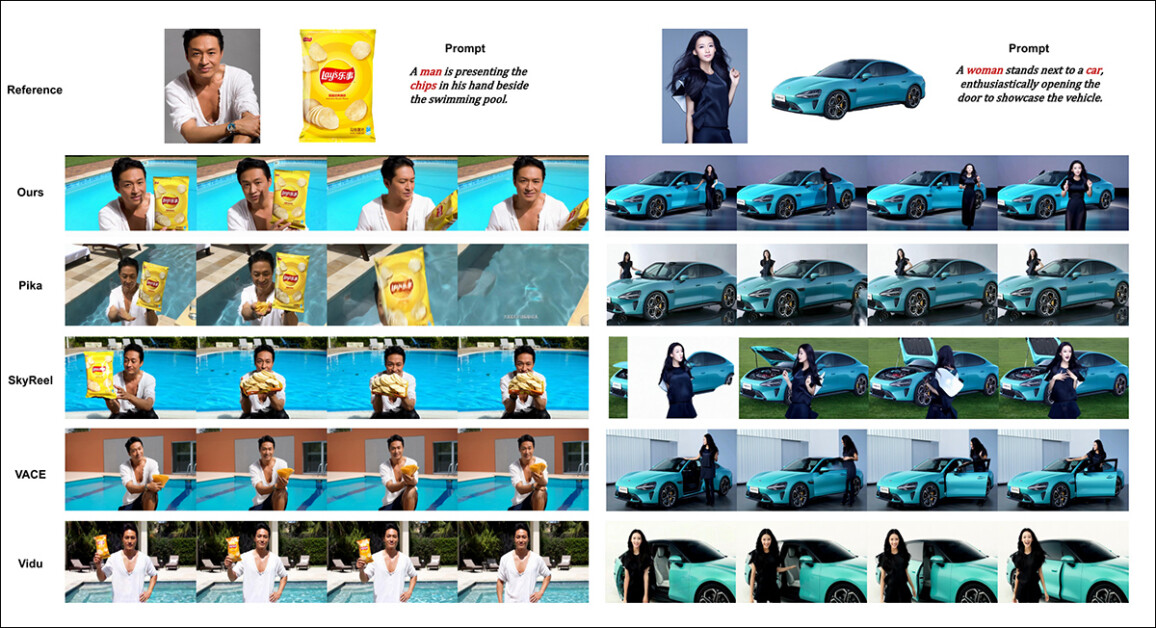

Далее были проведены испытания для многотематическая настройка видео, против тех же участников. Как и в предыдущем примере, сглаженные результаты PDF не являются печатными эквивалентами видео, доступных на сайте проекта, но являются уникальными среди представленных результатов:

Сравнения с использованием многопредметных видеонастроек. Пожалуйста, смотрите PDF для лучшей детализации и разрешения.

В документе говорится:

«[Pika] может генерировать указанные объекты, но демонстрирует нестабильность в видеокадрах, в одном из сценариев мужчина исчезает, а женщина не открывает дверь, когда ее просят. [Vidu] и [VACE] частично улавливают человеческую личность, но теряют существенные детали нечеловеческих объектов, что указывает на ограничение в представлении нечеловеческих объектов.

«[SkyReels A2] испытывает сильную нестабильность кадров с заметными изменениями чипов и многочисленными артефактами в правильном сценарии.

«В отличие от этого, наш HunyuanCustom эффективно фиксирует как человеческие, так и нечеловеческие идентичности субъектов, генерирует видеоролики, которые соответствуют заданным подсказкам, и поддерживает высокое визуальное качество и стабильность».

Еще одним экспериментом стала «виртуальная человеческая реклама», в рамках которой фреймворкам было поручено интегрировать продукт с человеком:

Примеры нейронного «продакт-плейсмента» из раунда качественного тестирования. Для более подробной информации и более высокого разрешения см. PDF-файл.

В этом раунде авторы заявляют:

«[Результаты] демонстрируют, что HunyuanCustom эффективно сохраняет личность человека, сохраняя при этом детали целевого продукта, включая текст на нем.

«Более того, взаимодействие человека и продукта выглядит естественным, а видео точно соответствует заданной теме, что подчеркивает значительный потенциал HunyuanCustom в создании рекламных видеороликов».

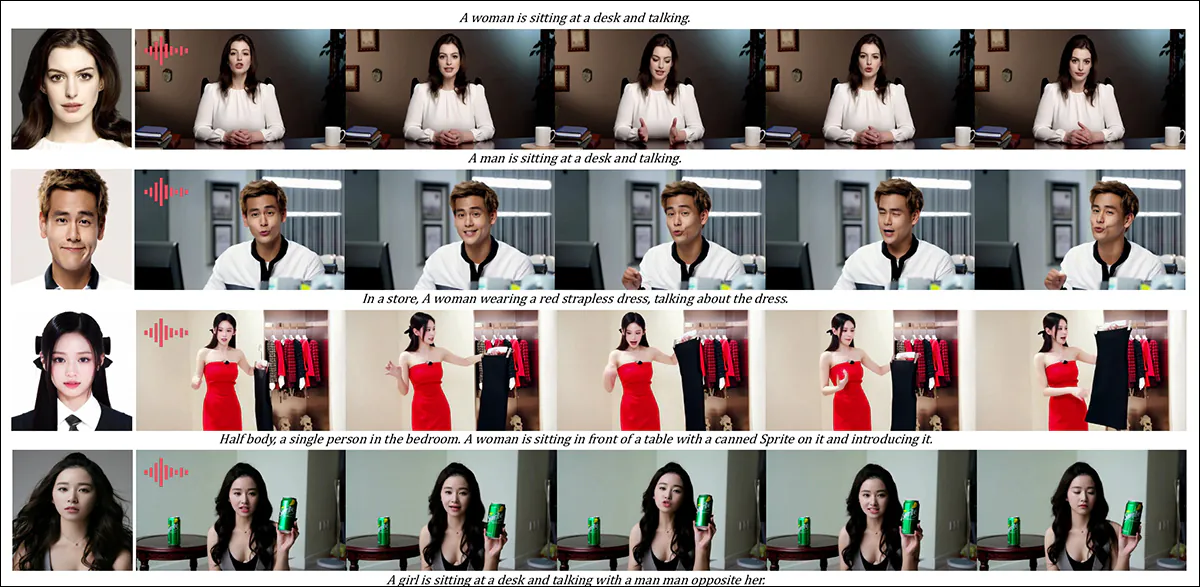

Одной из областей, где результаты видео были бы очень полезны, был качественный раунд для настройки субъекта на основе аудио, где персонаж произносит соответствующую аудиозапись из описанной в тексте сцены и позы.

Частичные результаты, представленные для аудио раунда – хотя видео результаты могли бы быть предпочтительнее в этом случае. Здесь воспроизведена только верхняя половина рисунка PDF, так как он большой и его трудно разместить в этой статье. Пожалуйста, обратитесь к исходному PDF для получения более подробных сведений и разрешения.

Авторы утверждают:

«Предыдущие методы анимации человека на основе звука предполагали ввод изображения человека и звука, при этом поза человека, его одежда и окружающая среда соответствовали заданному изображению и не могли генерировать видео с другими жестами и окружающей средой, что могло [ограничить] их применение.

«…[Наш] HunyuanCustom позволяет настраивать человека с помощью звука, когда персонаж произносит соответствующую звуковую фразу в описанной текстом сцене и позе, что позволяет создавать более гибкую и управляемую анимацию человека с помощью звука».

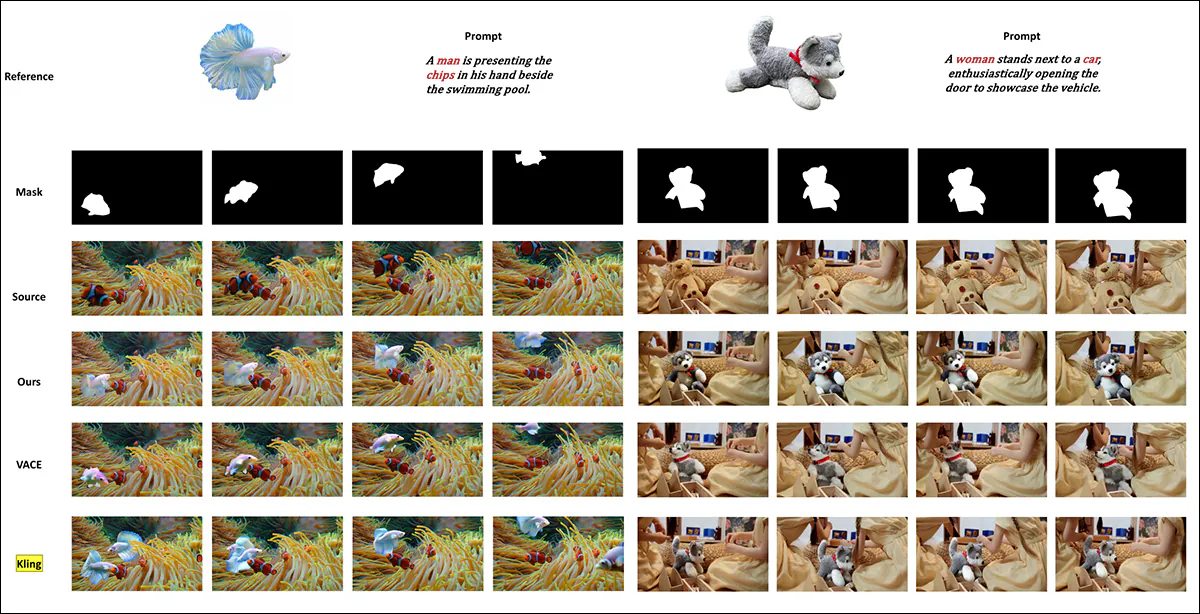

Дальнейшие испытания (подробности см. в PDF-файле) включали раунд, в котором новая система сравнивалась с VACE и Kling 1.6 для замены видеообъектов:

Тестирование замены субъекта в режиме видео-видео. Пожалуйста, обратитесь к исходному PDF для получения более подробной информации и разрешения.

Из этих последних тестов, представленных в новой статье, исследователи высказывают следующее мнение:

«VACE страдает от артефактов границ из-за строгого соблюдения входных масок, что приводит к неестественным формам объектов и нарушению непрерывности движения. [Kling], напротив, демонстрирует эффект копирования-вставки, когда объекты непосредственно накладываются на видео, что приводит к плохой интеграции с фоном.

«Для сравнения, HunyuanCustom эффективно избегает артефактов на границах, обеспечивает бесшовную интеграцию с фоновым видео и обеспечивает надежное сохранение идентичности, демонстрируя свою превосходную производительность при выполнении задач по редактированию видео».

Заключение

Это захватывающий релиз, хотя бы потому, что он решает проблему, на которую в последнее время жалуются вечно недовольные любители, а именно отсутствие синхронизации губ, так что возросший реализм, который возможен в таких системах, как Hunyuan Video и Wan 2.1, может получить новое измерение подлинности.

Хотя расположение практически всех сравнительных примеров видео на сайте проекта делает сравнение возможностей HunyuanCustom с предыдущими конкурентами довольно затруднительным, следует отметить, что очень, очень немногие проекты в области синтеза видео осмеливаются соревноваться в тестах с Kling, коммерческим API распространения видео, который всегда находится на верхних строчках списков лидеров или близок к ним; Tencent, похоже, добился впечатляющего прогресса по сравнению с этим устоявшимся игроком.

* Проблема в том, что некоторые видео настолько широкие, короткие и имеют такое высокое разрешение, что они не воспроизводятся в стандартных видеоплеерах, таких как VLC или Windows Media Player, и показывают черный экран.

Впервые опубликовано Четверг, 8 мая 2025 г.