Лидеры мнений

От Кодирования к Исцелению: Следующая Революция ИИ Нуждается в Руке (И Глазах)

Как агентные системы, умные очки XR и робототехника будут усиливать возможности человека, а не заменять их

Мы живем в парадоксе в области искусственного интеллекта.

На экранах ИИ является сверхчеловеческим. Большие языковые модели пишут функциональный код Python за секунды. Генеративные системы производят фотографически реалистичные изображения и видео за минуты. Нобелевские системы, такие как AlphaFold, предсказали структуры почти всех известных белков. Цифровые победы накапливаются.

Однако в физическом мире биомедицинских исследований процесс открытия остается мучительно ручным. Мы не чувствуем, что ИИ ускоряет науку или медицину, по крайней мере, пока нет. Цифры раскрывают глубину проблемы. Опрос Nature, проведенный среди более 1500 ученых, показал, что более 70% пытались и не смогли воспроизвести эксперименты другого исследователя. Еще более тревожно: более половины не смогли воспроизвести свою собственную работу. В области биологии рака конкретно восьмилетний проект по воспроизводимости показал, что только 40% результатов с высоким влиянием можно было воспроизвести и 68% экспериментов не имели достаточной документации, чтобы даже попытаться воспроизвести.

Это грязный секрет современной науки: у нас есть проблема с захватом знаний, а не только с открытием. Критические экспериментальные детали живут в головах исследователей, а не в статьях. Протоколы дрейфуют. Неявные знания уходят за дверь, когда стажеры заканчивают обучение. Системы ИИ, обученные на опубликованной литературе, наследуют все эти пробелы.

Основная проблема заключается в том, что хотя ИИ может спроектировать новый белок для терапии рака в цифровом симуляторе, он не может взять пипетку, чтобы протестировать его. Он не может ориентироваться в грязной, непредсказуемой реальности мокрой лаборатории, чтобы проверить свою собственную гипотезу. Он не может смотреть на руки опытного ученого и учиться тонким техникам, которые делают эксперименты работоспособными.

Этот “пробел в выполнении” является самой большой проблемой, которая мешает революции ИИ стать медицинской революцией. Пока большинство компаний по робототехнике все еще заняты обучением машин складывать белье или загружать посудомойки, они отстают от действительно трансформирующих возможностей этих достижений в таких областях, как медицина.

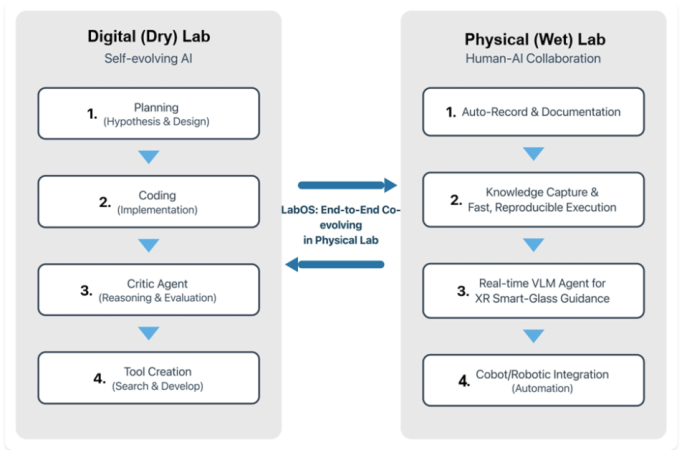

Чтобы решить эту проблему, нам нужно выйти за рамки чат-ботов и перейти к ИИ-соучастникам, агентным системам, которые мостят цифровой и физический мир, продвигаясь за пределы планирования и кодирования и в реальное выполнение. В Стэнфорде мы разрабатываем LabOS, цифрово-физическую框架 ИИ, которая демонстрирует, как агентные системы ИИ, умные очки XR и робототехника могут объединиться, чтобы закрыть этот пробел, превращая научные эксперименты в совместный разговор между человеком и машиной, а также автоматически захватывая знания, которые в настоящее время теряются.

Большой Раздел: Почему ИИ Нуждается в “Глазах” и “Руках”

Многие из самых заметных побед ИИ произошли в областях, где окружение полностью цифровое: репозитории кода, отредактированные наборы данных или симулированные бенчмарки (где ИИ соревнуется в управлении виртуальным бизнесом или цифровых инвестициях в акции).

Мокрые лаборатории отличаются. Биология, и в целом научное открытие, является очень шумным процессом. Инструменты дрейфуют, операторы импровизируют, и “протокол” часто живет частично в головах людей. Разница между чистым результатом и неудачным запуском может быть углом пипетки, схемой вихревого движения, заменой реагента или инкубацией, которая длилась на 10 минут дольше. Эти контекстные детали редко попадают в статью и они являются именно тем, что модель ИИ нуждается, если она собирается обобщать за пределы набора данных.

Это почему лабораторный ИИ нуждается в глазах (чтобы воспринимать, что происходит в контексте), руках (чтобы стандартизировать и безопасно автоматизировать высоко-варьирующиеся шаги) и памяти (чтобы записать, что фактически произошло). Без этих возможностей модели могут рекомендовать, что делать, но они не могут надежно перевести рекомендации в проверенное физическое выполнение или объяснить неудачи, когда реальность отклоняется от плана.

За пределами Чат-ботов: От Ко-Пилотов к Ко-Ученым

Термин “агентный ИИ” иногда используется свободно. В биомедицинских условиях он должен означать что-то точное: систему, которая может взять цель (например, “оптимизировать эффективность редактирования генов CRISPR, минимизируя оф-таргет”), разложить ее на последовательность задач, выполнить эти задачи через инструменты, оценить результаты и адаптировать план под ограничениями и с аудиторной принятием решений.

Это имеет значение, потому что исследовательские рабочие процессы не являются единственным вызовом модели. Они являются конечными пайплайнами, которые охватывают формулировку гипотезы, экспериментальный дизайн, обработку данных, статистическое тестирование и интерпретацию. Недавняя мысль в открытии лекарств начала подчеркивать агентные системы, которые могут масштабировать эти пайплайны, а не просто ускорять отдельные шаги (например, обсуждение Unite.AI агентов в открытии малых молекул).

В программной инженерии мы уже видели ранние эмпирические доказательства того, что ИИ-ко-пилоты могут увеличить производительность разработчиков. В биомедицинской области аналогичная возможность заключается не только в написании кода, но и в написании и проверке протоколов, структурировании данных, мониторинге выполнения и закрытии петли между предсказанием и измерением, соединяя ИИ с человеческими учеными в лабораториях.

LabOS: Когда ИИ Запускается на Операционной Системе для Лабораторий Завтрашнего Дня

В нашей работе в Стэнфорде на AI4Science, охватывающей ко-пилотов редактирования генов таких как CRISPR-GPT и системы совместного выполнения ИИ-XR таких как LabOS, которые помогают ученым в биомедицинских и материаловедческих лабораториях, мы исследовали архитектурный сдвиг:

1. Проектирование конечного пайплайна “лабораторной операционной системы”, который связывает цифровую (сухую) лабораторию с физической (мокрой) лабораторией.

Предпосылка проста: если лабораторный блокнот является памятью науки, то лабораторная операционная система должна быть слоем выполнения, захватывающим намерение, переводящим его в действия, наблюдая результаты и превращая каждое выполнение в структурированные знания.

Фигура. Концептуальный вид LabOS, связывающий саморазвивающийся цифровой лабораторный петль (планирование, кодирование, критика, создание инструментов) с человеческим ИИ-мокрой лабораторной петлей (авто-документация, захват знаний, XR-руководство и роботизированная интеграция).

2. ИИ в Цифровой Лаборатории – Саморазвивающееся Планирование и Создание Инструментов

В цифровой (сухой) лаборатории мы можем позволить ИИ делать то, что он уже делает хорошо: поиск, синтез и предложение. Но мы также хотим, чтобы он был самосовершенствующимся. Не за счет “галлюцинации новой науки”, а за счет обучения лучшим инструментам и рабочим процессам из обратной связи.

Практический цифровой лабораторный петль можно сформировать как четыре повторяющихся этапа:

- Планирование (гипотеза + дизайн): предложить гипотезы, выбрать экспериментальные переменные, предвидеть конфаундеры и указать измеримые конечные точки.

- Кодирование (реализация): сгенерировать или адаптировать скрипты анализа, симуляционные пайплайны и шаблоны управления инструментами, где это уместно.

- Критик-агент (обоснование + оценка): проверить предположения, проверить статистическую мощность, предложить контроли и указать вероятные режимы неудач.

- Создание инструментов (поиск + разработка): когда рабочий процесс не имеет компонента (парсера, QC-рутины, панели управления), создать его и добавить обратно в набор инструментов.

3. ИИ в Физической Лаборатории – ИИ с “Глазами” (Очки XR) и “Руками” (Робототехника)

Физическая (мокрая) лаборатория является местом, где система либо заслуживает доверие, либо его теряет. Цель состоит не в том, чтобы заменить ученого, а в том, чтобы уменьшить трение и ошибку, увеличивая наблюдаемость.

Мы рассматриваем физическую лабораторную петль как четыре дополнительные возможности:

- Авто-запись и документация: захватить действия, временные метки, настройки инструментов и отклонения автоматически, так что документация не является после мысли.

- Захват знаний для быстрого, воспроизводимого выполнения: преобразовать выполнения в структурированные, запросные артефакты (версии протоколов, наборы параметров, результаты QC) в соответствии с принципами управления данными, такими как FAIR.

- В режиме реального времени руководство языком-видением через очки XR: использовать многомодальные модели для интерпретации сцены (что делает оператор, какой реагент в руке) и предоставлять пошаговое руководство и проверки безопасности. AR/XR уже продемонстрировал свою ценность в высоко-ставочных физических рабочих процессах, таких как экспериментальное руководство (LabOS, Стэнфорд, Принстон, в сотрудничестве с NVIDIA).

- Интеграция кобота/робототехники для автоматизации: стандартизировать повторяющиеся шаги, облегчить безопасную передачу и уменьшить вариативность. Платформы для симуляции-реальных рабочих процессов (например, NVIDIA Isaac) и обработки ИИ в режиме реального времени на краю, такие как прямая трансляция умных очков и взаимодействие человека-ИИ в LabOS, являются важными слоями.

Эта архитектура соответствует более широкому направлению в области: “самоходные” или автономные лаборатории, которые объединяют автоматизацию с машинным обучением, чтобы спланировать следующий эксперимент. Что LabOS добавляет, так это более плотный человеческий интерфейсный слой, так что автономность не происходит за счет прозрачности.

Почему Лабораторный ИИ Не Просто “ИИ на Наборе Данных”

Системы ИИ для биомедицинской/научной сверхинтеллекта часто выглядят впечатляющими в ретроспективной оценке или сдаче экзаменов, а затем показывают плохие результаты в физической лаборатории. Причина редко является единственной ошибкой. Это обычно несоответствие между предположениями модели и реальностью лаборатории.

Три пробела появляются повторно:

- Контекстный пробел: наборы данных обычно опускают контекстные переменные, которые операторы знают, что имеют значение (температурные отклонения, номера партий реагентов, тонкие отклонения протокола).

- Действенный пробел: многие системы ИИ могут рекомендовать, что делать, но не могут надежно перевести эту рекомендацию в проверенные физические шаги.

- Обратный пробел: без структурированной, высококачественной обратной связи от выполнения модели не могут учиться, где они терпят неудачу – и ученые не могут проверить, почему.

Закрытие этих пробелов является менее связано с изобретением новой архитектуры нейронной сети, а больше с построением инструментария, интерфейсов и контрактов данных, которые делают лабораторию понятной для машин и позволяют ИИ видеть и работать с людьми.

Доверие по Дизайну: Безопасность и Управление для ИИ, который Может Действовать

Агентный ИИ в исследовательских работах не только вызывает знакомые проблемы с точностью. Он вводит новые режимы неудач, потому что он может действовать. В лаборатории действие означает потенциал для отходов, вреда или вводящих в заблуждение выводов, особенно когда эксперименты питают клинические гипотезы.

Полезная установка ума заключается в том, чтобы рассматривать стопку ИИ-лаборатории как социотехническую систему, которая требует гарантий. Несколько существующих рамок помогают, но они должны быть переведены в лабораторную реальность:

- Управление рисками как непрерывная практика: рамка управления рисками ИИ NIST (AI RMF 1.0) предоставляет практический словарь для картографирования, измерения и управления рисками ИИ на протяжении всего жизненного цикла.

- Регуляторное соответствие для медицински-прилегающего ИИ: работа FDA по программному обеспечению ИИ/МЛ в качестве медицинского устройства (SaMD), включая ее План действий и связанные рекомендации, предлагает конкретный взгляд на то, что выглядит “хорошей практикой”, когда ИИ влияет на уход за пациентами.

Для редактирования генов и других областей с высокими последствиями управление уже является глобальным разговором. Рекомендации обсуждаются на редактирование генома человека, чтобы подчеркнуть необходимость надлежащих механизмов надзора и ответственного управления, таких как те, которые выдвинуты Американским обществом генной и клеточной терапии, или ASGCT. Системы, такие как LabOS, должны быть разработаны так, чтобы сделать соблюдение более простым, а не более трудным.

Проверочный Список: Контроли для Безопасных ИИ-Со-Ученых для Научного Открытия

В нашем мнении, система лабораторной операционной системы, ориентированная на безопасность, должна реализовать хотя бы следующие конструкции:

- Происхождение по умолчанию: каждый набор данных, версия протокола и вывод модели должны быть отслеживаемы до входных данных и временных меток.

- Ограниченная автономность: система должна иметь явные разрешения (что она может делать без подтверждения) и правила эскалации (когда она должна спросить).

- Человеческий обход и плавное ухудшение: когда датчики или потоки данных не работают, или неопределенность высока, система должна вернуться к более безопасному, более простому режиму.

- Непрерывная проверка: прогнозы в режиме реального времени должны быть парными с физической лабораторной проверкой; физические лабораторные выполнения должны включать ворота QC до выводов, которые распространяются вниз по потоку к моделям/агентам в цифровом мире.

- Безопасность и осведомленность о двойном использовании: защитить лабораторную инфраструктуру от篡改.

Власть Людей Повсюду: Может Ли ИИ-Со-Ученые Уровнять Игровое Поле?

Одним из самых убедительных обещаний ИИ-XR “со-ученого” является не только скорость для элитных учреждений, но и доступность для всех. Рассмотрите, что в настоящее время ограничивает меньшие лаборатории, стартапы и удаленные/сельские/региональные клиники:

- Ограниченный доступ к специализированной экспертизе для золотых стандартов протоколов и инструментов.

- Более высокая относительная стоимость обучения, ошибок и переделки.

- Фрагментированное инструментирование: блокноты, электронные таблицы, журналы инструментов и скрипты анализа редко соединяются чисто.

Система, которая может руководить выполнением в контексте (через очки XR), захватить, что произошло автоматически, и предложить следующий лучший шаг на основе предыдущих выполнений, может сделать передовые анализы более повторяемыми на разных сайтах. В принципе, она также может поддерживать распределенные клинические исследования, где протоколы должны быть выполнены последовательно, даже когда ресурсы варьируются.

График: Когда Каждый Ученый и Клинический Специалист Получит Со-Ученого?

Вкратце, мы ближе, чем многие думают, для некоторых высокоценных, высокочастотных задач (таких как производство лекарства надежно в лаборатории) и дальше, чем большинство демонстраций подразумевают для других (таких как ИИ полностью решает большие проблемы, такие как рак или болезнь Альцгеймера). Реалистичный дорожная карта выглядит следующим образом:

- Ближайший срок (в течение 1 года): Ко-пилоты рабочих процессов, которые уменьшают административную нагрузку: черновик протокола, синтез литературы, шаблоны анализа и автоматические отчеты QC. Ограничивающим фактором является интеграция, а не способность модели.

- Среднесрочный период (1-2 года): Системы совместного выполнения в лаборатории: руководство очками XR, автоматическая документация и избирательная робототехника для высоко-варьирующихся шагов. Доверие будет зависеть от аудиторских следов и плотного дизайна человека в петле.

- Долгосрочный период (3+ года): Ко-исследователи, пересекающие области открытия и перевода: связывающие лабораторные данные с клиническими конечными точками, мониторинг сигналов безопасности и помощь в проектировании испытаний – при соблюдении регуляторных и этических ожиданий.

От Кодирования к Исцелению: Путь Вперед к 1000x Научному Открытию

LabOS – это одна попытка ответить на простой вопрос: что, если эксперимент можно было бы запустить как разговор, где намерение, выполнение и доказательства связаны конечным концом? Если мы построим эти системы хорошо, они могут помочь решить проблему перевода, которая замедляет биомедицину и многие физические научные дисциплины (например, материаловедение). Если мы построим их плохо, они будут усиливать нерепроизводимость и создавать новые риски безопасности.

Самая важная работа в ближайшие годы будет основополагающей: стандартизированные данные и интерфейсы устройств через построение операционной системы (как iOS запускает все виды приложений), построение бенчмарков ИИ, которые включают выполнение и неопределенность (как бенчмарк LabSuperVision в LabOS), и начало развертывания в реальном мире, которое поощряет инновации, сохраняя при этом целостность исследований и защиту пациентов.

Для исследователей и клинических специалистов вопрос заключается не в том, войдет ли ИИ в лабораторию. Он уже вошел. Вопрос заключается в том, интегрируем ли мы его как коллекцию несвязанных инструментов или как систему, заслуживающую доверия, предназначенную для реалий биомедицинской науки.

Рекомендуемая литература и источники

- Опрос воспроизводимости (Nature, 2016): https://www.nature.com/articles/533452a

- Статья CRISPR-GPT, прошедшая рецензирование (Nature Biomedical Engineering): https://www.nature.com/articles/s41551-025-01463-z

- Новости Стэнфордской медицины о CRISPR-GPT (2025): https://med.stanford.edu/news/all-news/2025/09/ai-crispr-gene-therapy.html

- Предварительная версия LabOS (arXiv): https://arxiv.org/abs/2510.14861

- Веб-сайт бенчмарка LabOS и LabSuperVision: https://ai4lab.stanford.edu

- Рамка управления рисками ИИ NIST (AI RMF 1.0): https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

- Обзор FDA программного обеспечения ИИ/МЛ в качестве медицинского устройства: https://www.fda.gov/medical-devices/software-medical-device-samd/artificial-intelligence-software-medical-device

- Принципы FAIR-данных (Scientific Data, 2016): https://doi.org/10.1038/sdata.2016.18

- Unite.AI о пробелах в открытии малых молекул: https://www.unite.ai/how-ai-is-breaking-down-the-bottlenecks-in-small-molecule-drug-discovery/

- Unite.AI о ИИ и роботизированной хирургии: https://www.unite.ai/how-ai-is-ushering-in-a-new-era-of-robotic-surgery/