Ângulo de Anderson

Pesquisa Sugere que ChatGPT Tem Alta Credibilidade como Fornecedor de Notícias

Nova pesquisa sugere que as etiquetas de verificação de fatos do ChatGPT superam likes, compartilhamentos e até marcas de notícias confiáveis quando se trata de moldar o que as pessoas acreditam e desejam compartilhar online.

Um novo estudo com 1.000 pessoas descobriu que, quando o ChatGPT dá uma pontuação de credibilidade a notícias políticas, isso frequentemente muda o que as pessoas acreditam e se elas desejam compartilhá-las – independentemente de suas visões políticas iniciais. Fatores de influência mais tradicionais, como likes ou compartilhamentos, não tiveram muito efeito, mas o julgamento do AI fortemente moldou como confiáveis as notícias pareciam:

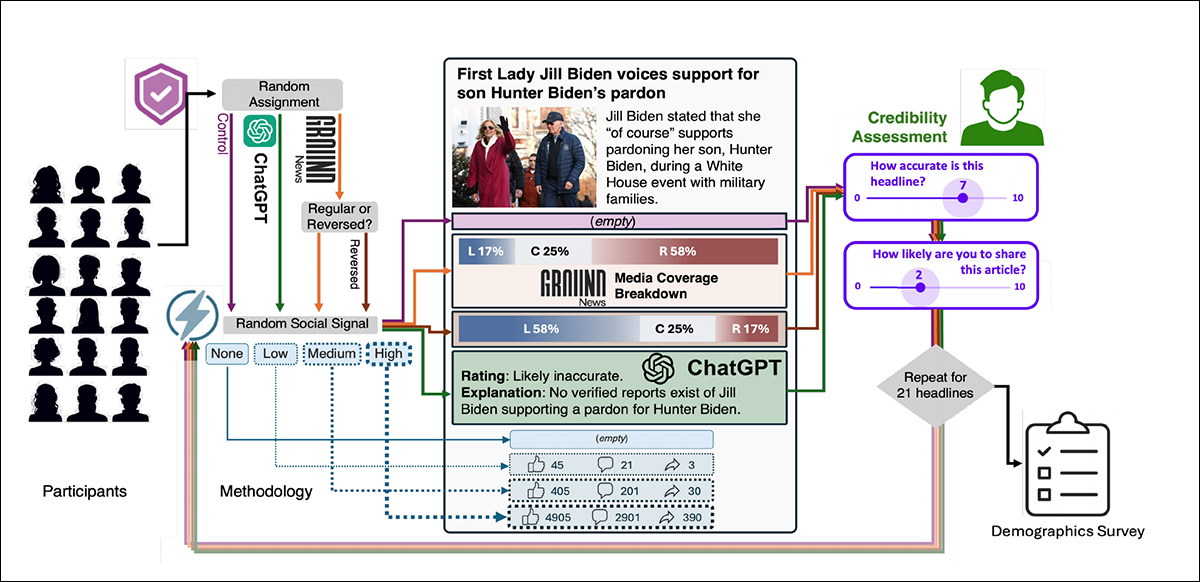

![Do novo artigo, uma ilustração de como as pessoas avaliam um título de notícia, com base em três sinais interativos: se a história alinha com sua identidade política; quanto engajamento parece ter nas mídias sociais; e os sinais de credibilidade fornecidos por instituições ou sistemas de IA. Essas influências combinam para moldar tanto a precisão percebida quanto a probabilidade de compartilhar o conteúdo. [ Fonte ] https://arxiv.org/pdf/2511.02370](https://www.unite.ai/wp-content/uploads/2025/11/figure-1.jpg)

Do novo artigo, uma ilustração de como as pessoas avaliam um título de notícia, com base em três sinais interativos: se a história alinha com sua identidade política; quanto engajamento parece ter nas mídias sociais; e os sinais de credibilidade fornecidos por instituições ou sistemas de IA. Essas influências combinam para moldar tanto a precisão percebida quanto a probabilidade de compartilhar o conteúdo. Fonte

A extensão com que resumos de IA são considerados fontes de notícias confiáveis é talvez um dos tópicos mais importantes na mídia por muitos anos, não menos porque os resumos de IA do Google drenaram o tráfego de quase todos os principais veículos de mídia online em 2025, sem certeza de para onde essa transferência de poder pode estar indo no longo ou mesmo médio prazo.

Os autores do novo trabalho afirmam:

‘Esses resultados destacam tanto o potencial quanto o risco do feedback algorítmico em moldar a compreensão pública. Os sinais gerados por IA podem ajudar a mitigar o viés e melhorar a discernimento da credibilidade, mas sua influência varia por identidade política e carrega riscos éticos relacionados à superconfiança […]

‘…A influência desproporcional do ChatGPT destaca uma troca crítica: enquanto persuasivo, o feedback de IA pode deslocar o pensamento crítico se não for cuidadosamente estruturado.’

Os autores sugerem que a pesquisa futura deve se concentrar em intervenções de credibilidade de IA melhoradas que sejam mais independentes e apoiem fatos conhecidos, e observam que isso é especialmente importante em tópicos polarizantes.

Além da aparente ascensão do ChatGPT como uma ‘autoridade’, e da influência inesperadamente baixa de sinais de compartilhamento nos testes (que os autores pensam que possa ser atribuída às condições de teste ligeiramente estéreis), outro resultado interessante dos testes dos pesquisadores relaciona-se a demografia e gênero:

‘Mulheres e participantes minoritários racialmente (particularmente usuários negros e latinos) responderam mais positivamente ao feedback baseado em IA do que a etiquetas institucionais.’

O novo trabalho é intitulado Sinais de Credibilidade de IA Superam Instituições e Engajamento em Moldar a Percepção de Notícias nas Mídias Sociais, e vem de três pesquisadores da Universidade de Notre Dame.

Vamos dar uma olhada mais de perto nos métodos e conclusões do artigo.

Método

Quatro hipóteses foram testadas: que as pessoas classificariam manchetes como mais precisas quando essas manchetes refletissem suas visões políticas; que as pontuações de credibilidade geradas por IA seriam mais influentes do que sinais de instituições estabelecidas; que manchetes com alto engajamento (i.e., medido por meio de likes, compartilhamentos ou comentários) seriam vistas como mais confiáveis; e que os usuários tenderiam a aceitar o julgamento da IA sobre a precisão de uma manchete, mesmo quando isso conflitasse com suas próprias crenças.

Os participantes do estudo foram obtidos da plataforma Prolific, e foram requisitados para serem fluentes em inglês, bem como consumidores regulares de notícias; e um processo de randomização assegurou que os participantes representassem uma diversidade de pontos de vista raciais e de gênero.

No experimento*, os participantes foram divididos em quatro grupos, cada um mostrado um tipo diferente de feedback ao lado das manchetes de notícias.

No primeiro grupo (a condição de controle) nenhuma informação extra foi dada sobre quão credível a manchete poderia ser; no segundo grupo, as manchetes foram rotuladas com uma classificação de viés do GroundNews, um serviço que classifica fontes de notícias como de esquerda, centro ou direita.

Um terceiro grupo viu as mesmas etiquetas do GroundNews, mas deliberadamente invertidas, criando uma discordância destinada a testar se os usuários detectariam a distorção.

O grupo final foi mostrado avaliações de credibilidade escritas pelo ChatGPT, oferecendo uma explicação curta e uma classificação como ‘provavelmente impreciso’:

Esquema conceitual para o experimento: cada participante foi mostrado manchetes políticas com combinações variadas de etiquetas de credibilidade e sinais de engajamento social. Respostas foram coletadas sobre quão precisa cada manchete parecia e quão provável era que fosse compartilhada, com a sequência completa repetida em 21 itens.

Dados e Testes

Cada participante foi mostrado uma sequência de 21 manchetes de notícias políticas. Para cada manchete, o nível de engajamento social foi variado; às vezes mostrava nenhum like ou compartilhamento, às vezes muitos. Esses sinais de engajamento foram randomizados para evitar padrões fixos.

As manchetes em si vieram de uma mistura de perspectivas políticas e foram marcadas como de esquerda, de direita ou centristas.

Após cada manchete, os participantes foram perguntados sobre quão precisa eles achavam que era, e se considerariam compartilhá-la. Porque cada participante já havia declarado sua própria afiliação política, foi possível analisar se as manchetes do mesmo lado do espectro político eram classificadas mais favoravelmente.

Os participantes pontuaram cada manchete duas vezes: uma para quão precisa parecia e outra para quão provável era que a compartilhassem, com suas respostas medidas em uma escala de 0 a 10.

Os pesquisadores então combinaram essas respostas com dados adicionais: informações demográficas e de uso de mídia de cada participante; etiquetas políticas para cada manchete; o tipo de sinal de credibilidade mostrado; e o nível de engajamento social atribuído.

Influência da Identidade Política

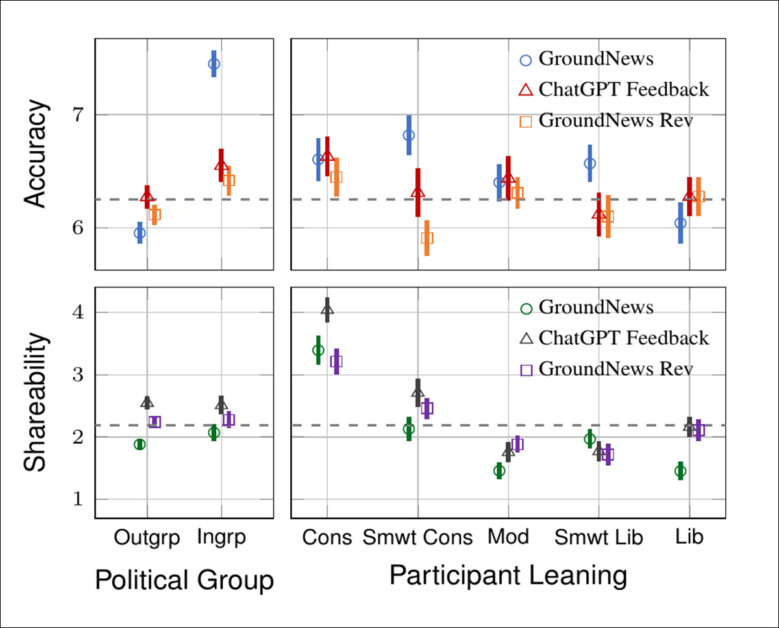

No primeiro teste, que investigou se as pessoas classificam manchetes como mais precisas quando a posição política da manchete coincide com suas próprias visões, os resultados indicaram que os participantes eram mais propensos a acreditar em manchetes que coincidiam com suas visões políticas – mas que isso dependia do grupo.

Moderados mostraram o viés mais forte em direção ao seu próprio lado, enquanto liberais e conservadores tendiam a confiar mais em manchetes centristas; e, no geral, manchetes neutras foram classificadas como mais precisas do que as de esquerda ou direita.

Uma ilustração de como as classificações de precisão e compartilhamento mudaram dependendo da posição política da manchete e da afiliação política do participante. Moderados foram mais propensos a classificar manchetes ‘do grupo’ como precisas, enquanto liberais e conservadores favoreceram manchetes centristas. O comportamento de compartilhamento seguiu um padrão semelhante, com viés de grupo limitado fora do grupo moderado.

Nos resultados desse primeiro experimento, um efeito de grupo modesto na compartilhabilidade foi encontrado; mas apenas para moderados, que estavam mais inclinados a compartilhar manchetes politicamente alinhadas (i.e., neutras). Liberais e conservadores não mostraram tal tendência.

A análise de variância (ANOVA), um método usado para detectar diferenças entre grupos, mostrou que o alinhamento afetou a compartilhabilidade apenas quando interagia com a identidade política. Credibilidade e compartilhamento estavam vinculados, mas apenas moderados mostraram um padrão claro em ambos.

Credibilidade Institucional vs. IA

O próximo teste perguntou se as pessoas confiam mais em classificações de IA do que em fontes tradicionais, como sites de classificação de notícias – especialmente quando as classificações possam discordar de suas políticas:

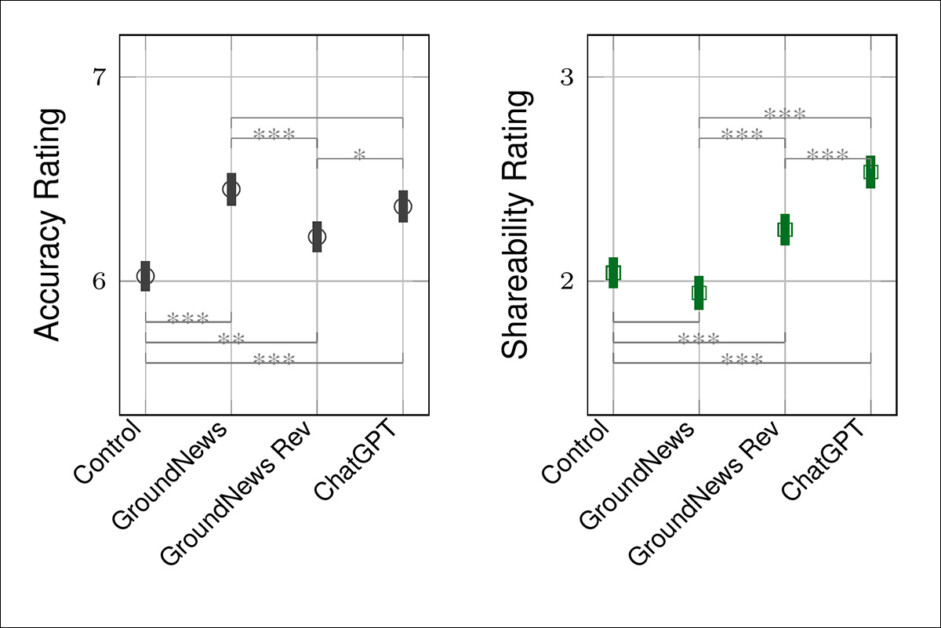

Classificações de credibilidade e compartilhamento por fontes de feedback: todos os três sinais aumentaram a precisão em comparação com o controle, com o GroundNews rendendo as classificações mais altas. No entanto, o ChatGPT produziu os maiores ganhos em compartilhamento, sugerindo que teve um impacto persuasivo mais amplo. Barras de erro mostram intervalos de confiança de 95%, e asteriscos marcam diferenças pairadas significativas.

Todos os feedbacks aumentaram a precisão percebida; mas o GroundNews foi mais eficaz quando se alinhava com a política do usuário.

O ChatGPT aumentou as classificações de precisão em todos os aspectos, indicando que foi visto como mais neutro. Conservadores foram menos influenciados pelo GroundNews, mas responderam ao ChatGPT de forma semelhante aos outros grupos:

Aqui podemos ver os efeitos do feedback do ChatGPT na precisão percebida. Os resultados indicam que a confiança nos sinais institucionais depende do alinhamento, enquanto a confiança nos sinais algorítmicos não. O ChatGPT aumentou tanto a credibilidade quanto a compartilhabilidade em todos os grupos – especialmente para conservadores.

Métricas Sociais Têm Pouco Impacto

A terceira análise testou se sinais de engajamento social visíveis, como likes, compartilhamentos e comentários, aumentariam a credibilidade ou a compartilhabilidade agindo como prova social; mas nenhum efeito foi observado.

Testes encontraram que os níveis de engajamento, como likes ou compartilhamentos, não tiveram efeito real sobre quão precisa as manchetes pareciam, e apenas um efeito fraco e não confiável sobre quão compartilháveis elas pareciam; ao contrário de sinais algorítmicos ou institucionais, esses sinais sociais não pareceram influenciar os julgamentos nesse contexto, pelas razões mencionadas anteriormente no artigo.

Feedback de IA Influencia o que as Pessoas Confiem

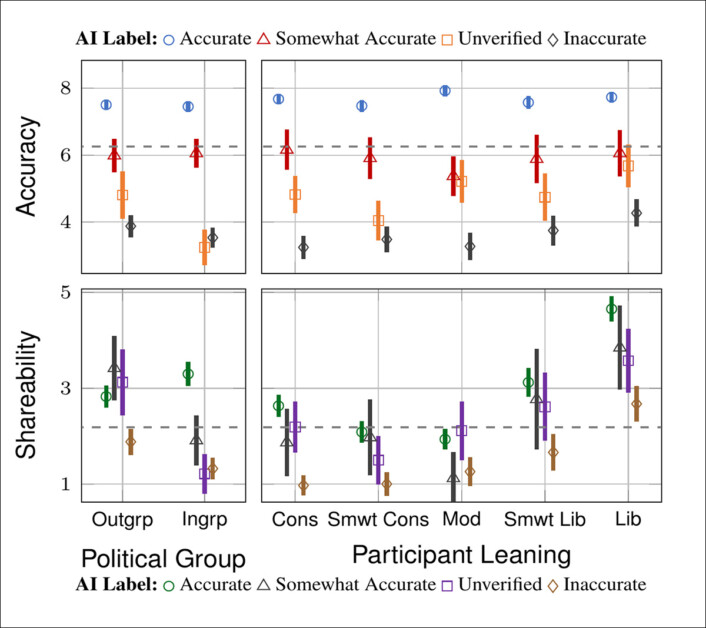

O quarto e último experimento testou se os usuários ajustariam seus julgamentos de credibilidade e compartilhamento em resposta a etiquetas geradas por IA: preciso; um pouco preciso; não verificado; ou impreciso, todos atribuídos pelo ChatGPT.

Os participantes responderam fortemente às etiquetas de credibilidade geradas por IA. As classificações de precisão subiram ou caíram de acordo com o feedback do ChatGPT, com os efeitos mais significativos vistos quando as manchetes foram marcadas como preciso ou impreciso:

O feedback do ChatGPT influenciou tanto as classificações de precisão quanto as de compartilhamento. Topo: As classificações de precisão subiram com rótulos mais positivos, especialmente quando as manchetes foram marcadas como ‘Preciso’, e caíram quando rotuladas como ‘Impreciso’. Abaixo: A compartilhamento seguiu um padrão semelhante, mas mostrou maior variação por grupo: liberais responderam mais fortemente a sinais negativos, enquanto conservadores mostraram mudanças mais sutis.

A identidade política moldou esses efeitos, com os usuários confiando mais no ChatGPT quando seu feedback se alinhava com suas próprias visões.

O comportamento de compartilhamento seguiu um padrão semelhante: manchetes do grupo marcadas como precisas foram compartilhadas com mais frequência, especialmente sob rótulos ambíguos como um pouco preciso.

Esses resultados, o artigo propõe, sugerem que o feedback de IA pode mudar o comportamento do usuário; e que também arrisca reforçar divisões partidárias ou desencorajar o pensamento crítico.

Quem Confia mais na IA?

Análise de acompanhamento examinou como as demografias do usuário moldaram reações às etiquetas de credibilidade. O feedback do ChatGPT aumentou as classificações de precisão no geral, mas o efeito foi mais fraco entre usuários altamente educados e consumidores frequentes de mídia social, que mostraram mais ceticismo.

Esses mesmos grupos reagiram negativamente ao GroundNews e aos sinais revertidos, sugerindo, o artigo propõe, que marcadores de viés óbvios possam alienar usuários mais literados em mídia.

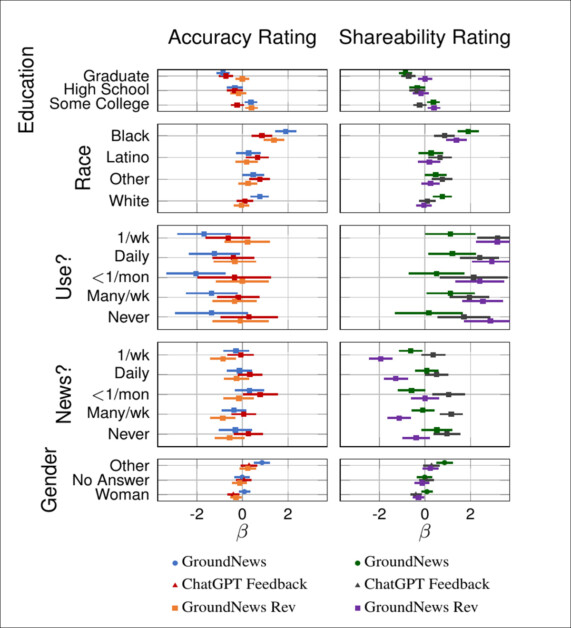

Por contraste, mulheres e participantes minoritários racialmente, especialmente usuários negros e latinos, responderam mais positivamente ao ChatGPT do que a sinais institucionais:

Respostas demográficas a tipos de feedback, com cada painel mostrando como um grupo particular respondeu a diferentes sinais de credibilidade. As classificações do ChatGPT tiveram a influência mais forte e consistente sobre a precisão, enquanto os efeitos sobre a compartilhamento foram menos uniformes, com variação por raça, gênero e uso de mídia.

O comportamento de compartilhamento ecoou essa divisão: o GroundNews reduziu a compartilhamento mais acentuadamente entre usuários de mídia social e viciados em notícias, enquanto os efeitos do ChatGPT foram mais mistos, até aumentando a compartilhamento em alguns grupos, com titulares de diplomas de graduação especialmente responsivos a todos os tipos de feedback.

Os autores concludem:

‘Esses resultados têm implicações diretas para o design de intervenções de credibilidade em sistemas sociotécnicos. Os usuários estão cada vez mais influenciados pelo feedback algorítmico, que pode superar sinais institucionais e moderar o viés partidário – mas também arrisca promover a superconfiança.

‘Os sinais institucionais permanecem eficazes para alguns usuários, mas seu impacto diminui em ambientes polarizados ou de baixa confiança. Enquanto isso, métricas de engajamento, como likes e compartilhamentos, foram amplamente ignoradas, sugerindo um valor persuasivo reduzido quando apresentadas sem contexto social.

‘Para apoiar a avaliação de notícias equitativa e informada, as intervenções impulsionadas por IA devem ser transparentes, explicativas e projetadas para melhorar a agência do usuário.

‘O trabalho futuro deve examinar esses mecanismos em configurações mais ecologicamente válidas, avaliar enquadramentos de credibilidade de IA alternativos e desenvolver sistemas adaptativos que fomentem o engajamento crítico em audiências politicamente diversas.’

Conclusão

Dada a tendência de todos os sistemas de IA gerativos atuais a alucinar e distorcer a verdade, é arguivelmente de alguma preocupação que a adoção em massa (mesmo que esteja desacelerando um pouco) do ChatGPT também represente um enorme salto de fé de que as arquiteturas desses sistemas não possam justificar nem suportar.

Um problema em confiar na representação de notícias da IA é a falta de sistemas eficazes que possam contextualizar fontes de notícias como ‘afiliadas politicamente’, ou inclinadas para um ou outro extremo do espectro político.

Mesmo entre as fontes de quarta-estação mais respeitáveis, a escolha do que e o que não é coberto é em si uma declaração política. Nem o ChatGPT nem seus companheiros de equipe estão atualmente em posição de navegar essas camadas de viés interpretativo, e o tópico em si convida discussão em vez de conclusões sólidas.

Outro problema é que sistemas desse tipo chegaram à cena em um dos períodos mais polarizados e divisivos da história humana em 80 anos, e em um momento em que a sociedade está mais disposta a ouvir ‘vozes alternativas’ – como um gênero completamente novo de tecnologia que está sendo divulgado como um filtro essencial da verdade do mundo, em vez do que realmente é: um preditor de probabilidades estatísticas, alimentado por quantidades de alta volume de informações partidárias.

* Detalhes dos quais os autores tornaram disponíveis online (veja o artigo-fonte, parte inferior da P2, para URLs). No entanto, esses dados requerem registro para visualizar, e desde que eu não levei o assunto adiante naquele momento, não posso confirmar que possam ser visualizados inteiramente sem pagamento e/ou credenciais específicas.

Publicado pela primeira vez na quarta-feira, 5 de novembro de 2025