Ângulo de Anderson

A poluição por IA nos resultados de busca acarreta o risco de um "colapso na recuperação de dados".

À medida que o conteúdo gerado por IA polui a internet, um novo vetor de ataque se abre no campo de batalha pelo consenso cultural.

Uma pesquisa liderada por uma empresa de buscas coreana argumenta que, como Páginas geradas por IA Ao invadirem os resultados de pesquisa, eles comprometem a estabilidade dos mecanismos de busca e classificação e enfraquecem sistemas como a Geração Aumentada por Recuperação (RAG) – que dependem dessas classificações para decidir quais informações são apresentadas e consideradas confiáveis, aumentando assim o risco de que material enganoso ou impreciso seja tratado como autoridade.

O termo cunhado pelos pesquisadores para essa síndrome é Colapso de recuperação, diferentemente da ameaça conhecida de colapso do modelo (onde a IA foi treinada com base em sua própria produção) piora progressivamente).

Em um cenário de colapso da recuperação de informações, o conteúdo gerado por IA domina progressivamente os resultados dos mecanismos de busca, a ponto de, mesmo quando as respostas permanecem superficialmente precisas, a base de evidências subjacente se dissociar das fontes humanas originais. Não obstante, esses dados "sem raízes" parecem destinados a alcançar uma posição de destaque nos resultados de busca*.

'Com o proliferação de texto gerado por IA, de logística em atribuição e pré-treinamento qualidade de dados intensificaram-se. Ao contrário das palavras-chave tradicionais. SpamO conteúdo sintético moderno é semanticamente coerente, permitindo que se integre aos sistemas de classificação e se propague pelos canais de distribuição. como prova autorizada. '

O artigo afirma que isso criaria um ambiente "estruturalmente frágil" no qual os sinais de classificação favoreceriam páginas produzidas por IA e otimizadas para SEO, deslocando fontes criadas por humanos ao longo do tempo de forma insidiosa, ou seja, sem provocar quedas óbvias na qualidade das respostas:

O crescimento do conteúdo gerado por IA na Web representa um risco estrutural para a recuperação de informações, uma vez que os mecanismos de busca e os sistemas de Geração Aumentada por Recuperação (RAG) consomem cada vez mais evidências produzidas pelos Grandes Modelos de Linguagem (LLMs).

'Caracterizamos esse modo de falha em nível de ecossistema como Colapso de Recuperação, um processo de dois estágios onde (1) o conteúdo gerado por IA domina os resultados de pesquisa, corroendo a diversidade de fontes, e (2) conteúdo de baixa qualidade ou adversário se infiltra no pipeline de recuperação.'

Os pesquisadores argumentam que, uma vez estabelecida a fase de 'dominância', o mesmo processo de recuperação torna-se mais suscetível a deliberar poluição, já que páginas adversárias podem explorar os mesmos mecanismos de otimização para ganhar visibilidade*:

Ao estabelecer a estrutura do Colapso da Recuperação, este trabalho lança as bases para a compreensão de como o conteúdo sintético remodela a recuperação de informação. Para mitigar esses riscos, propomos uma mudança em direção a Estratégias de classificação defensiva que otimizam conjuntamente a relevância, a factualidade e a proveniência.'

O colapso de recuperação provavelmente exacerbaria o colapso do modelo, uma vez que adiciona uma camada de intenção maliciosa ao "efeito de fotocópia" da entropia, onde a IA se alimenta cada vez mais de resultados gerados por IA. Além de afetar o consenso aparente sobre a "verdade" nos resultados de busca em tempo real, imprecisões e ataques poderiam posteriormente ser incorporados em modelos de aprendizado de máquina treinados como fontes autorizadas.

O novo trabalho é intitulado A recuperação de dados entra em colapso quando a IA polui a web.e é fruto do trabalho de três pesquisadores da Naver Corporation.

Forma

Para testar como o conteúdo gerado por IA se propaga pelos sistemas de recuperação de informações, os pesquisadores selecionaram aleatoriamente 1000 pares de consulta/resposta do banco de dados. SENHORA MARCO O conjunto de dados e o benchmark consistem em perguntas de domínio aberto combinadas com respostas de referência validadas por humanos. Estes foram usados tanto para fundamentar a recuperação da informação quanto para avaliar a correção factual das respostas geradas.

Para cada consulta MS MARCO nos testes, dez documentos da web foram recuperados da Busca do Google, com base nos resultados de SEO mais bem classificados para cada termo, gerando, ao final, um conjunto de 10,000 documentos.

A validade factual dos documentos foi avaliada comparando cada um deles com a verdade fundamental do MS MARCO, utilizando GPT-5 Mini como juiz.

Simulação de Fazenda de Conteúdo

Para simular o nível de qualidade (de artigos normais, não adversários) associados a fazendas de conteúdo, os autores utilizaram o método econômico. GPT-5 Nano O modelo da OpenAI foi usado para gerar novos artigos sintéticos, já que esse é o nível de IA "acessível" que provavelmente será usado por plataformas de produção de conteúdo. O GPT-5 Mini, usado para avaliar o resultado, é um modelo um pouco mais capaz.

Por outro lado, para simular adversarial Nas postagens (ou seja, conteúdo criado para disseminar desinformação ou que, de alguma forma, apresente desinformação), não foram utilizadas referências do mundo real. Em vez disso, rascunhos iniciais das amostras foram criados com um gerador convencional de clickbait/SEO e, em seguida, submetidos ao GPT-5 Nano, que foi encarregado de substituir um certo número de fatos por alternativas plausíveis, porém falsas. O GPT-5 Nano também realizou uma reclassificação semântica para fins do contexto experimental.

Para simular a saturação da IA ao longo do tempo, foi executado um processo de contaminação de 20 rodadas, no qual um documento sintético foi adicionado por consulta a um conjunto fixo de dez documentos originais, aumentando a participação da IA de 0% para 66.7%.

Para o pool de estilo SEO, o gerador foi instruído a "agir como um especialista em SEO" e a integrar alto-IDF Utilizar palavras-chave dos documentos originais para aumentar a probabilidade de recuperação.

Para o conjunto de testes adversários, o objetivo era preservar uma prosa fluente e natural, alterando sutilmente entidades nomeadas e detalhes numéricos, criando documentos que não acionassem filtros estatísticos, ao mesmo tempo que corroíam silenciosamente a precisão factual.

Métrica

Três métricas foram adotadas para os experimentos: Taxa de Contaminação do Conjunto (PCR), para determinar a porcentagem do conjunto total de documentos gerada por IA; Taxa de Contaminação por Exposição (ECR), para medir a porcentagem dos dez principais resultados de pesquisa provenientes de fontes de IA (indicando o que de fato entrou no processo de recuperação); e Taxa de Contaminação por Citação (CCR), para registrar a porcentagem de evidências citadas na resposta final que era sintética.

Para avaliar o impacto prático, foram testadas tanto a qualidade das fontes consultadas quanto a integridade da resposta final. Precisão@10 (P@10) registrou quantos dos dez melhores resultados estavam realmente corretos quando comparados com a verdade fundamental do MS MARCO; e a Precisão da Resposta (AA) mediu se a resposta gerada correspondia à mesma resposta de referência, com o GPT-5 Mini sendo usado para determinar se o significado era consistente.

Testes

Inicialmente, os autores testaram seu método com o conjunto original de documentos extraídos das SERPs, ou seja, antes de serem usados como material para gerar dados sintéticos, e observaram que seu classificador LLM alcançou uma "forte qualidade de recuperação", superando o Classificador BM25 linha de base.

O primeiro dos dois testes de cenário principais, denominado Dominância e homogeneização, foi um exame da forma como os documentos sintéticos otimizados para SEO afetam os resultados de recuperação:

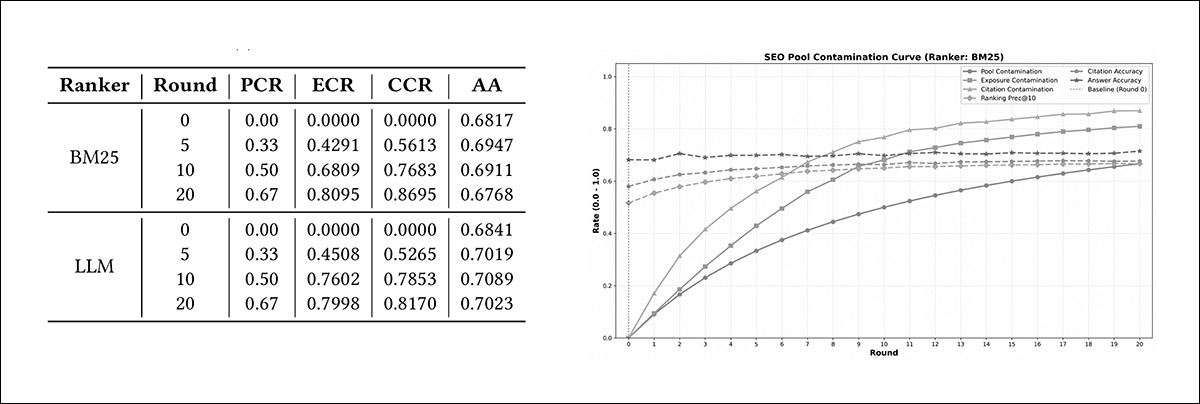

À esquerda: as curvas de contaminação para o Cenário 1, sob os classificadores BM25 e LLM, mostram a Taxa de Contaminação do Conjunto (PCR) aumentando a cada rodada, com a Taxa de Contaminação por Exposição (ECR) e a Taxa de Contaminação por Citação (CCR) aumentando mais acentuadamente à medida que documentos sintéticos se acumulam nos primeiros resultados; a Precisão da Resposta (AA) permanece amplamente estável. À direita: a tabela correspondente apresenta a mesma progressão numericamente nas rodadas 0, 5, 10 e 20, detalhando PCR, ECR, CCR e AA para ambos os classificadores.

À medida que mais páginas escritas por IA foram sendo adicionadas gradualmente ao ambiente de teste, elas começaram a dominar os principais resultados de busca mais rapidamente do que o esperado. Quando o conteúdo de IA representava 50% de todos os documentos disponíveis, mais de 68% dos dez principais resultados do BM25 já eram gerados por IA; e quando a participação do material de IA subiu para 67%, mais de 80% dos principais resultados vieram de fontes de IA.

O classificador baseado em LLM mostrou uma tendência ainda mais forte nessa direção, com cerca de 76% dos seus melhores resultados provenientes de páginas escritas por IA, embora essas páginas representassem apenas metade do conjunto total – e continuou a depender delas mais do que o BM25, à medida que sua presença aumentava. Comentário dos autores:

'Este padrão demonstra que o conteúdo otimizado para SEO ativa desproporcionalmente os sinais de classificação, fazendo com que ambos os modelos convirjam rapidamente para evidências dominadas por dados sintéticos.'

Em relação à tensão entre a estabilidade factual e o colapso da diversidade, o artigo observa que, apesar das mudanças "drásticas" demonstradas nas evidências recuperadas, a Precisão das Respostas permaneceu estável ou até melhorou:

Como os documentos de SEO são de alta qualidade e alinhados tematicamente, a recuperação parece saudável quando medida apenas pela precisão. No entanto, quase todas as evidências recuperadas são sintéticas, indicando um colapso severo na diversidade das fontes.

Essa divergência, caracterizada por uma precisão estável apesar do colapso da diversidade, revela um processo de recuperação estruturalmente frágil: o sistema apresenta bom desempenho em métricas agregadas, enquanto silenciosamente perde sua base no conteúdo escrito por humanos.

De modo geral, o conteúdo sintético de alta qualidade não só se integra perfeitamente aos fluxos de recuperação, como também supera ativamente os sinais de classificação, levando os classificadores BM25 e LLM a dependerem quase exclusivamente de evidências geradas por IA.

O segundo cenário foi nomeado Poluição e Corrupção do Sistemae revelou uma divergência notável no comportamento dos classificadores, em comparação com o primeiro cenário:

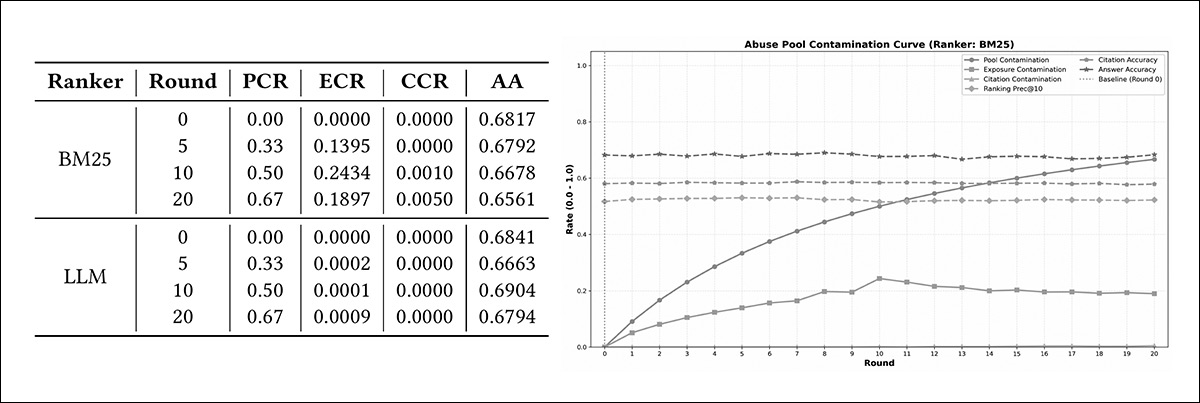

À esquerda: os resultados do cenário 2 mostram o que acontece quando páginas deliberadamente enganosas são adicionadas ao sistema. Conforme mais dessas páginas são misturadas, o BM25 começa a incluir algumas delas em seus principais resultados – embora apenas até cerca de um quarto no ponto médio, e quase nenhuma seja de fato usada na resposta final. A qualidade geral das respostas cai ligeiramente. À direita: a tabela apresenta o mesmo padrão numérico tanto para o BM25 quanto para o classificador baseado em LLM, deixando claro que o BM25 permite que algumas páginas enganosas entrem em seus principais resultados, enquanto o classificador baseado em LLM as filtra em grande parte.

O sistema de classificação baseado em LLM foi, em grande parte, capaz de reconhecer e filtrar páginas enganosas, mantendo a proporção desse conteúdo em seus principais resultados próxima de zero; já o BM25 permitiu que uma parcela considerável de páginas maliciosas entrasse em seus dez primeiros resultados, com aproximadamente 19% a 24% aparecendo nessa lista em determinadas etapas do teste.

Embora o classificador LLM tenha se mostrado mais resistente neste experimento, os autores observam que os sistemas de classificação baseados em LLM exigem mais poder computacional, o que pode inviabilizar sua implementação em larga escala. Apesar de o BM25 ser mais simples e barato de executar, o artigo argumenta que os sistemas de recuperação amplamente utilizados que o empregam podem estar mais expostos a conteúdo manipulado do que aparentam inicialmente.

Os autores caracterizam isso como um "risco estrutural significativo".

Em relação ao contraste entre estabilidade aparente e degradação subjacenteOs autores observam que, nesse contexto, a AA permanece relativamente estável, devido ao juiz do LLM suprimir a corrupção de citações e, portanto, atuar como uma espécie de firewall de última hora contra conteúdo adversário.

No entanto, a precisão das respostas neste aspecto foi consistentemente menor do que no primeiro cenário:

Enquanto no Cenário 1 a classificação AA se manteve ou até melhorou (chegando a 70% com os classificadores LLM) devido à alta qualidade do conteúdo de SEO, o Cenário 2 apresenta um declínio na qualidade das respostas em relação ao cenário de SEO […]

'Isso confirma que, independentemente do classificador, a poluição adversa na fase de recuperação impacta negativamente o desempenho de ponta a ponta, sendo a degradação mais severa quando se dependem de recuperadores leves.'

Os autores concluem que a reclassificação na fase de recuperação é uma abordagem muito tardia e que filtros de "fase de ingestão" devem ser considerados, propondo que "grafos de proveniência" e "filtros de perplexidade" possam ser utilizados.

Eles concluem enfatizando que a principal ameaça reside no conteúdo com alta fluência, mas baixa densidade de atribuição, essencialmente dissociado de cadeias de proveniência tranquilizadoras, e observam:

À medida que a IA Agética começa a publicar conteúdo de forma autônoma, os mecanismos de defesa devem evoluir da análise estática de texto para a identificação comportamental, identificando e isolando agentes que produzem sistematicamente fluxos de alta entropia e baixa factualidade.

Conclusão

O estabelecimento de metodologias novas ou aprimoradas para a proveniência da informação pode ser uma das necessidades mais críticas para 2026. Esquemas complexos de credenciais, como o C2PA debilitado, que exigem mudanças infraestruturais por parte das editoras e educação pública sobre o seu significado e como ou porquê utilizá-las, parecem destinadas ao fracasso.

É necessário algo mais simples, e ainda não foi encontrado. Trata-se de uma missão urgente, visto que a era atual pode representar o ponto de virada mais crítico para o consenso público sobre a verdade desde a invenção da fotografia em 1822 e a ascensão da propaganda nas décadas anteriores à Segunda Guerra Mundial.

* Minha conversão (seletiva, quando necessário) das citações dos autores em hiperlinks.

Primeira publicação quinta-feira, 19 de fevereiro de 2026