Ângulo de Anderson

Codificação de Vibrações Sofre Quando o Papel da IA se Expande

Um novo estudo descobre que a codificação de vibrações melhora quando os humanos dão as instruções, mas declina quando a IA o faz, com o melhor setup híbrido mantendo os humanos em primeiro lugar, com a IA como árbitro ou juiz.

Nova pesquisa nos Estados Unidos, examinando o que acontece quando os sistemas de IA são permitidos para direcionar codificação de vibrações, em vez de simplesmente executar instruções humanas, descobriu que quando os Modelos de Linguagem Grande (LLMs) assumem um papel direcional maior, os resultados são quase sempre piores.

Embora os pesquisadores tenham usado o GPT-5 da OpenAI como o framework para seus experimentos colaborativos humanos/IA, eles posteriormente confirmaram que tanto o Claude Opus 4.5 da Anthropic quanto o Google Gemini 3 Pro estavam sujeitos à mesma curva de deterioração à medida que as responsabilidades crescem, afirmando que ‘even a limited human involvement steadily improves performance’:

‘[Humanos] fornecem orientação de alto nível eficaz em todas as iterações, [enquanto] a orientação da IA frequentemente leva a uma colapso de desempenho. Além disso, descobrimos que uma alocação cuidadosa de papéis que mantém os humanos no comando da direção enquanto transfere a avaliação para a IA pode melhorar o desempenho híbrido.’

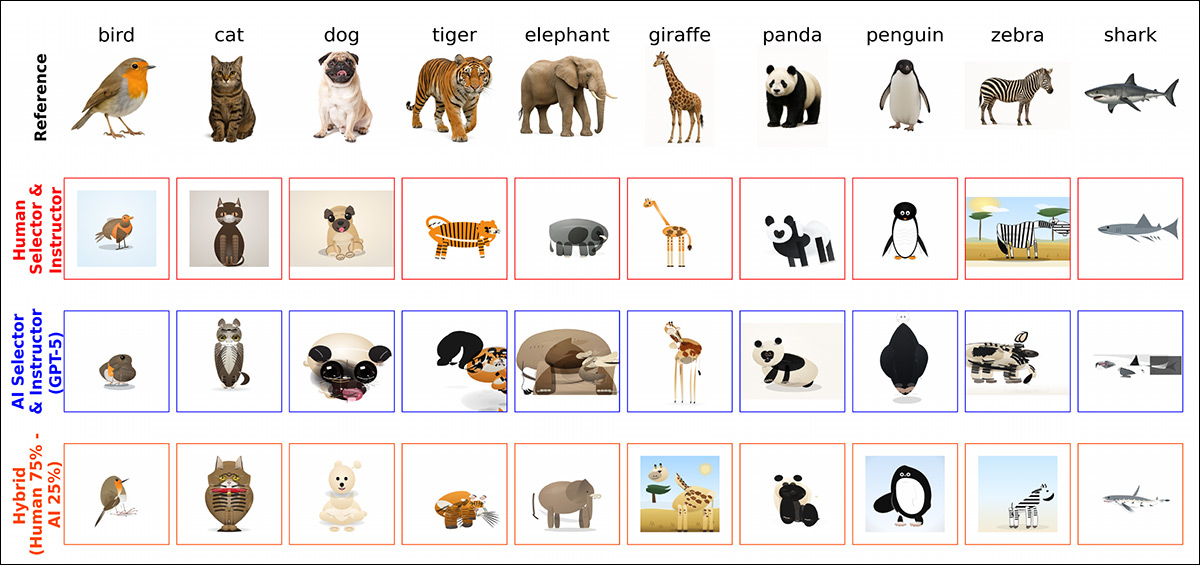

Para fornecer um teste consistente que pudesse ser avaliado igualmente por humanos e por IA, um framework experimental controlado foi construído em torno de uma tarefa de codificação iterativa na qual uma imagem de referência – apresentando uma foto de um gato, cão, tigre, pássaro, elefante, pinguim, tubarão, zebra, girafa ou panda – tinha que ser recriada usando gráficos vetoriais escaláveis (SVG), e essa recriação julgada contra a foto fonte da qual foi derivada:

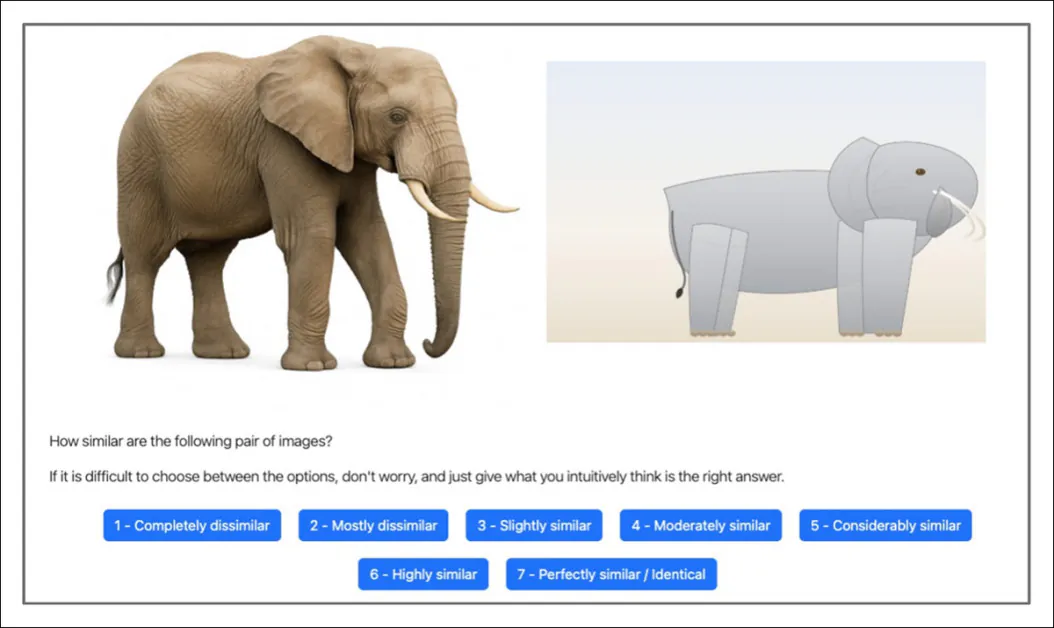

Both human and AI participants foram mostrados uma imagem de referência fotográfica ao lado de uma reconstrução SVG gerada por IA, e solicitados a avaliar o quão semelhantes as duas eram em uma escala de sete pontos. Source

Em cada rodada, um agente fornecia instruções de alto nível em linguagem natural para guiar um gerador de código, e outro decidia se manter a nova versão ou reverter para a anterior – um loop estruturado que espelha fluxos de trabalho colaborativos reais.

Ao longo de 16 experimentos envolvendo 604 participantes e milhares de chamadas de API, rodadas de teste lideradas totalmente por humanos foram comparadas diretamente com rodadas lideradas totalmente por IA, sob condições idênticas.

Algumas das soluções variadas alcançadas por diferentes combinações de colaboração humano/IA porcentagens e tipos (retiradas de uma ilustração maior no papel de origem, ao qual nos referimos o leitor).

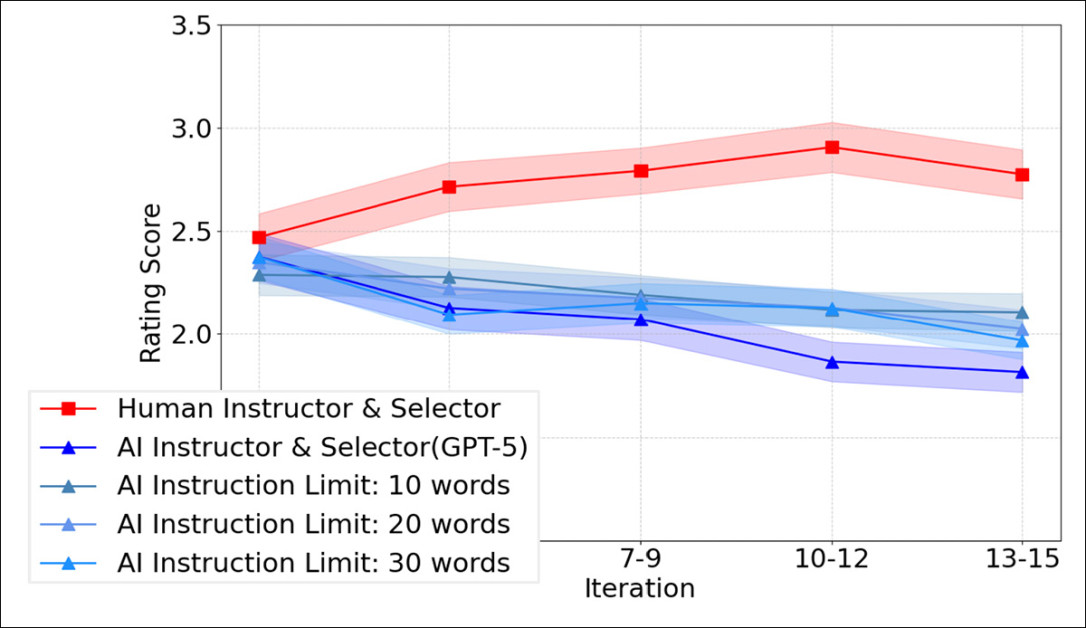

Embora humanos e IA tenham performado em níveis semelhantes no início dos testes, ao longo do tempo, suas trajetórias divergiram: quando humanos forneceram as instruções e fizeram as decisões de seleção, as pontuações de semelhança aumentaram ao longo das iterações, com melhoria cumulativa constante; mas quando os sistemas de IA preencheram ambos os papéis, o desempenho não mostrou ganhos consistentes e frequentemente declinou ao longo das rodadas – mesmo quando o mesmo modelo subjacente foi usado para geração de código e a IA teve acesso às mesmas informações que os participantes humanos.

O Efeito da Prolixidade

Os resultados também mostraram que as instruções humanas eram tipicamente curtas e orientadas para a ação, focando no que mudar em seguida na imagem atual; ao contrário, as instruções da IA eram muito mais longas e descritivas (um fator que foi parametrizado para GPT-5), detalhando atributos visuais em vez de priorizar a correção incremental.

Mas, como visto no gráfico abaixo, impor limites estritos de palavra nas instruções da IA não reverteu o padrão; mesmo quando limitadas a 10, 20 ou 30 palavras, as cadeias lideradas por IA ainda não melhoraram ao longo do tempo:

Avaliações de semelhança ao longo das iterações para rodadas lideradas por humanos em comparação com rodadas lideradas por IA e cadeias lideradas por IA limitadas a 10, 20 ou 30 palavras de instrução. Evidentemente, encurtar os prompts da IA não impede o declínio de desempenho observado quando a IA direciona tanto a instrução quanto a seleção.

Experimentos híbridos tornaram o padrão mais claro, mostrando que adicionar um pouco de envolvimento humano melhorou os resultados, em comparação com configurações totalmente lideradas por IA; no entanto, o desempenho geralmente declinou à medida que a participação da orientação da IA aumentou.

Quando os papéis foram separados, a avaliação e a seleção puderam ser transferidas para a IA com uma perda de qualidade relativamente pequena; mas substituir a instrução de alto nível humana por orientação da IA levou a declínios notáveis no desempenho, sugerindo que o que mais importa não é quem gera o código, mas quem define e sustenta a direção ao longo das iterações.