Inteligência artificial

Uma Visão Pessoal Sobre Tendências na Literatura de Visão Computacional em 2024

Tenho seguido continuamente a cena de pesquisa de visão computacional (CV) e síntese de imagens no Arxiv e em outros lugares por cerca de cinco anos, então as tendências se tornam evidentes com o tempo, e elas mudam em novas direções a cada ano.

Portanto, à medida que 2024 chega ao fim, pensei que seria apropriado dar uma olhada em algumas características novas ou em evolução nas submissões do Arxiv na seção de Visão Computacional e Reconhecimento de Padrões section. Essas observações, embora informadas por centenas de horas estudando a cena, são estritamente anecdotadas.

A Ascensão Contínua da Ásia Oriental

No final de 2023, eu havia notado que a maioria da literatura na categoria de síntese de voz estava vindo da China e de outras regiões da Ásia Oriental. No final de 2024, eu tenho que observar (anecdoticamente) que isso agora se aplica também à cena de pesquisa de síntese de imagem e vídeo.

Isso não significa que a China e os países adjacentes estejam necessariamente sempre produzindo o melhor trabalho (de fato, há algumas evidências em contrário); nem isso leva em conta a alta probabilidade de que, na China (assim como no Ocidente), alguns dos sistemas mais interessantes e poderosos em desenvolvimento sejam proprietários e excluídos da literatura de pesquisa.

Mas isso sugere que a Ásia Oriental está superando o Ocidente em volume, nesse aspecto. O que isso vale depende da extensão com que você acredita na viabilidade da persistência no estilo de Edison, que geralmente se prova ineficaz diante de obstáculos intransponíveis.

Há muitos obstáculos como esses na IA gerativa, e não é fácil saber quais podem ser resolvidos abordando arquiteturas existentes, e quais precisarão ser reconsiderados do zero.

Embora os pesquisadores da Ásia Oriental pareçam estar produzindo um número maior de artigos de visão computacional, eu notei um aumento na frequência de projetos do tipo “Frankenstein” – iniciativas que constituem uma mistura de trabalhos anteriores, adicionando novidade arquitetônica limitada (ou possivelmente apenas um tipo diferente de dados).

Este ano, um número muito maior de entradas da Ásia Oriental (primariamente colaborações chinesas ou chinesas) pareciam ser impulsionadas por quotas em vez de mérito, aumentando significativamente a relação sinal-ruído em um campo já supersubscrito.

Ao mesmo tempo, um número maior de artigos da Ásia Oriental também chamou minha atenção e admiração em 2024. Então, se isso é tudo um jogo de números, não está falhando – mas também não é barato.

Aumento do Volume de Submissões

O volume de artigos, de todos os países de origem, evidentemente aumentou em 2024.

O dia de publicação mais popular muda ao longo do ano; no momento, é terça-feira, quando o número de submissões para a seção de Visão Computacional e Reconhecimento de Padrões é frequentemente de 300 a 350 em um único dia, nos períodos de pico (maio-agosto e outubro-dezembro, ou seja, temporada de conferências e “temporada de prazos de quotas anuais”, respectivamente).

Além da minha própria experiência, o Arxiv próprio relata um número recorde de submissões em outubro de 2024, com 6000 novas submissões, e a seção de Visão Computacional é a segunda mais submetida após Aprendizado de Máquina.

No entanto, como a seção de Aprendizado de Máquina no Arxiv é frequentemente usada como uma “categoria adicional” ou super-categoria agregada, isso argumenta que Visão Computacional e Reconhecimento de Padrões é na verdade a categoria mais submetida do Arxiv.

As próprias estatísticas do Arxiv certamente mostram que a ciência da computação é a líder clara em submissões:

A ciência da computação (CS) domina as estatísticas de submissão do Arxiv nos últimos cinco anos. Fonte: https://info.arxiv.org/about/reports/submission_category_by_year.html

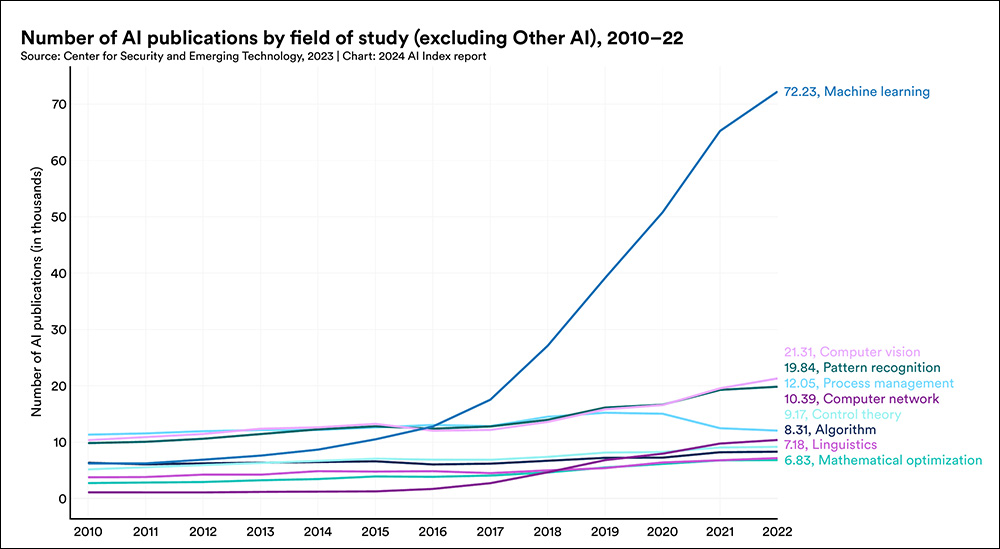

O Índice de IA de 2024 da Universidade de Stanford também enfatiza o notável aumento nas submissões de artigos acadêmicos sobre aprendizado de máquina nos últimos anos:

Com números não disponíveis para 2024, o relatório da Stanford ainda mostra dramaticamente o aumento do volume de submissões de artigos de aprendizado de máquina. Fonte: https://aiindex.stanford.edu/wp-content/uploads/2024/04/HAI_AI-Index-Report-2024_Chapter1.pdf

Diffusion>Mesh Frameworks Proliferate

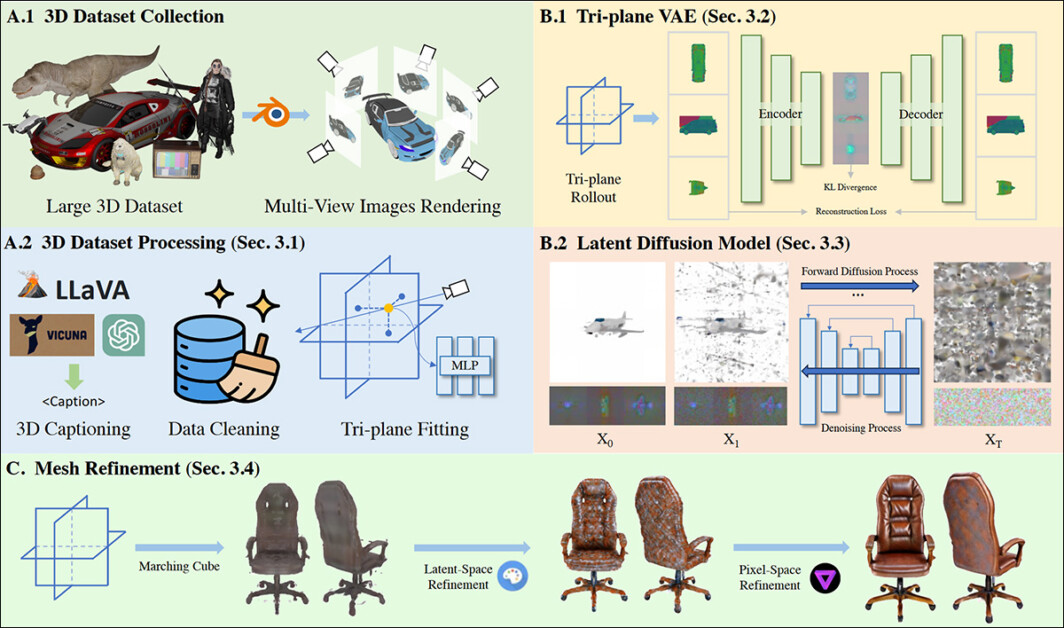

Outra tendência clara que surgiu para mim foi um grande aumento nos artigos que lidam com a utilização de Modelos de Difusão Latente (LDMs) como geradores de modelos de CGI baseados em malha.

Projetos desse tipo incluem o InstantMesh3D da Tencent, 3Dtopia, Diffusion2, V3D, MVEdit e GIMDiffusion, entre muitas outras ofertas.

Geração e refinamento de malha via um processo baseado em difusão no 3Dtopia. Fonte: https://arxiv.org/pdf/2403.02234

Essa nova linha de pesquisa pode ser vista como uma concessão tácita à intransponibilidade contínua de sistemas gerativos, como os modelos de difusão, que apenas dois anos atrás estavam sendo divulgados como um potencial substituto para todos os sistemas que os modelos de difusão>malha agora estão buscando povoar; relegando a difusão ao papel de uma ferramenta em tecnologias e fluxos de trabalho que datam de trinta ou mais anos.

A Stability.ai, originadora do modelo de difusão estável de código aberto Stable Diffusion, acaba de lançar Stable Zero123, que pode, entre outras coisas, usar uma interpretação de Neural Radiance Fields (NeRF) de uma imagem gerada por IA como uma ponte para criar um modelo de CGI baseado em malha explícito que pode ser usado em arenas de CGI, como Unity, em videogames, realidade aumentada e em outras plataformas que exigem coordenadas 3D explícitas, em vez das coordenadas implícitas de funções contínuas.

Clique para reproduzir. Imagens geradas no Stable Diffusion podem ser convertidas em malhas de CGI racionais. Aqui, vemos o resultado de um fluxo de trabalho de imagem para CGI usando o Stable Zero 123. Fonte: https://www.youtube.com/watch?v=RxsssDD48Xc

Semântica 3D

O espaço de IA gerativa faz uma distinção entre implementações de sistemas de visão e gerativos 2D e 3D. Por exemplo, frameworks de marcação facial, embora representem objetos 3D (faces) em todos os casos, nem todos necessariamente calculam coordenadas 3D endereçáveis.

O popular sistema FANAlign, amplamente usado em arquiteturas de deepfakes de 2017 (entre outras), pode acomodar ambos os abordagens:

Acima, marcos 2D são gerados com base apenas em lineamentos e recursos faciais reconhecidos. Abaixo, eles são racionalizados no espaço 3D X/Y/Z. Fonte: https://github.com/1adrianb/face-alignment

Então, assim como ‘deepfake’ se tornou um termo ambíguo e apropriado, ‘3D’ também se tornou um termo confuso na pesquisa de visão computacional.

Para os consumidores, ele tem tipicamente significado mídia estereoenabled (como filmes em que o espectador precisa usar óculos especiais); para profissionais de efeitos visuais e modeladores, ele fornece a distinção entre arte 2D (como esboços conceituais) e modelos baseados em malha que podem ser manipulados em um “programa 3D” como Maya ou Cinema4D.

Mas na visão computacional, ele simplesmente significa que um sistema de coordenadas cartesianas existe em algum lugar no espaço latente do modelo – não que ele possa necessariamente ser endereçado ou manipulado diretamente por um usuário; pelo menos, não sem sistemas interpretativos de CGI de terceiros, como 3DMM ou FLAME.

Portanto, a noção de diffusion>3D é inexata; não apenas qualquer tipo de imagem (incluindo uma foto real) pode ser usado como entrada para produzir um modelo de CGI gerativo, mas o termo menos ambíguo ‘malha’ é mais apropriado.

No entanto, para compor a ambiguidade, a difusão é necessária para interpretar a foto de origem em uma malha, na maioria dos projetos emergentes. Então, uma descrição melhor pode ser imagem-para-malha, enquanto imagem>difusão>malha é uma descrição ainda mais precisa.

Mas isso é uma venda difícil em uma reunião de diretoria ou em um comunicado de imprensa projetado para engajar investidores.

Evidências de Impasses Arquiteturais

Mesmo em comparação com 2023, a safra de artigos dos últimos 12 meses exibe um aumento da desesperança em torno da remoção dos limites práticos difíceis da geração baseada em difusão.

O obstáculo principal permanece a geração de vídeo narrativa e temporalmente consistente, e manter uma aparência consistente de personagens e objetos – não apenas em diferentes cliques de vídeo, mas mesmo durante a curta execução de um único vídeo gerado.

A última inovação época na síntese baseada em difusão foi a advento do LoRA em 2022. Embora sistemas mais novos, como o Flux, tenham melhorado alguns dos problemas de outliers, como a antiga incapacidade do Stable Diffusion de reproduzir conteúdo de texto dentro de uma imagem gerada, e a qualidade geral da imagem tenha melhorado, a maioria dos artigos que estudei em 2024 foi basicamente apenas movendo a comida no prato.

Esses impasses ocorreram antes, com Redes Adversárias Gerativas (GANs) e Campos de Radiância Neural (NeRF), ambos os quais não atenderam ao seu potencial aparente inicial – e ambos os quais estão sendo cada vez mais utilizados em sistemas mais convencionais (como o uso do NeRF no Stable Zero 123, veja acima). Isso também parece estar acontecendo com os modelos de difusão.

Pesquisa de Gaussian Splatting Muda de Direção

Parecia que, no final de 2023, o método de rasterização 3D Gaussian Splatting (3DGS), que estreou como uma técnica de imagem médica no início dos anos 90, estava prestes a superar sistemas baseados em autoencoder de desafios de síntese de imagem humana (como simulação e recriação facial, bem como transferência de identidade).

O artigo ASH de 2023 prometia humanos 3DGS de corpo inteiro, enquanto Gaussian Avatars oferecia detalhes massivamente melhorados (em comparação com métodos concorrentes), juntamente com uma reencenação impressionante.

Este ano, no entanto, foi relativamente curto em momentos de quebra de barreiras para a síntese humana 3DGS; a maioria dos artigos que abordaram o problema foram ou derivados dos trabalhos acima ou não conseguiram exceder suas capacidades.

Em vez disso, a ênfase no 3DGS tem sido em melhorar sua viabilidade arquitetônica fundamental, levando a uma onda de artigos que oferecem ambientes externos 3DGS aprimorados. Atenção particular tem sido dada a abordagens de Localização e Mapeamento Simultâneos (SLAM) 3DGS, em projetos como Gaussian Splatting SLAM, Splat-SLAM, Gaussian-SLAM, DROID-Splat, entre muitos outros.

Os projetos que tentaram continuar ou estender a síntese humana baseada em splat incluíram MIGS, GEM, EVA, OccFusion, FAGhead, HumanSplat, GGHead, HGM e Topo4D. Embora haja outros além disso, nenhuma dessas saídas igualou o impacto inicial dos artigos que surgiram no final de 2023.

A Era ‘Weinstein’ de Amostras de Teste Está em Declínio Lento

Pesquisas do sudeste da Ásia em geral (e da China em particular) frequentemente apresentam exemplos de teste problemáticos para republicar em um artigo de revisão, pois eles apresentam material que é um pouco ‘picante’.

Se isso é porque os cientistas de pesquisa daquela parte do mundo estão buscando chamar atenção para sua saída é algo a ser debatido; mas nos últimos 18 meses, um número crescente de artigos sobre IA gerativa (imagem e/ou vídeo) têm recorrido a usar jovens e mulheres seminuas e meninas em exemplos de projetos. Exemplos de limite de NSFW incluem UniAnimate, ControlNext e até mesmo artigos muito “secos” como Evaluating Motion Consistency by Fréchet Video Motion Distance (FVMD).

Isso segue as tendências gerais de subreddits e outras comunidades que se reuniram em torno de Modelos de Difusão Latente (LDMs), onde a Regra 34 permanece muito em evidência.

Confronto de Celebridades

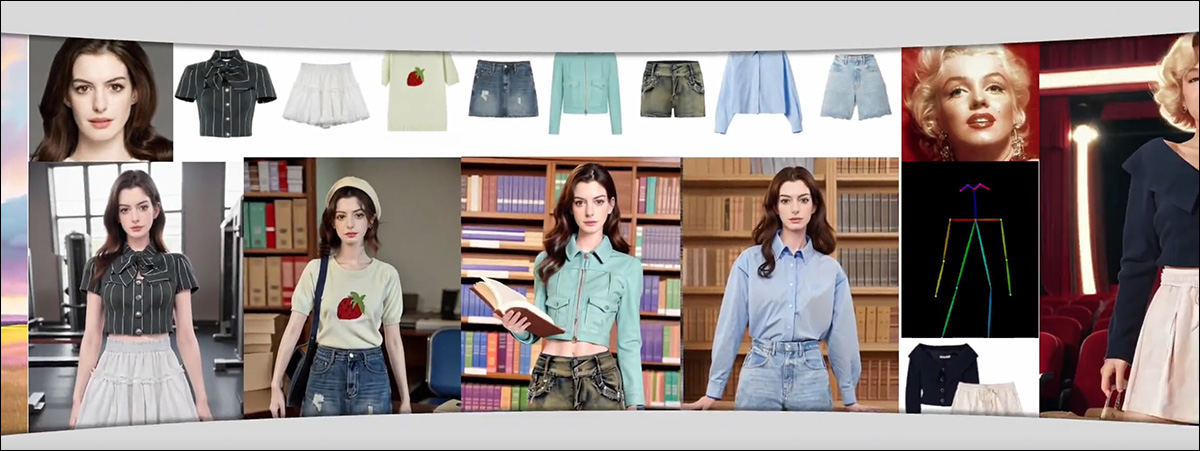

Esse tipo de exemplo inadequado se sobrepõe ao reconhecimento crescente de que os processos de IA não devem explorar arbitrariamente semelhanças de celebridades – particularmente em estudos que usam exemplos com celebridades atraentes, frequentemente femininas, e as colocam em contextos questionáveis.

Um exemplo é AnyDressing, que, além de apresentar personagens femininas de anime muito jovens, também usa liberalmente as identidades de celebridades clássicas, como Marilyn Monroe, e atuais, como Ann Hathaway (que denunciou esse tipo de uso muito vocalmente).

Uso arbitrário de celebridades atuais e ‘clássicas’ ainda é bastante comum em artigos do sudeste da Ásia, embora a prática esteja ligeiramente em declínio. Fonte: https://crayon-shinchan.github.io/AnyDressing/

Em artigos ocidentais, essa prática particular está notavelmente em declínio ao longo de 2024, liderada pelos lançamentos mais importantes de FAANG e outros grandes corpos de pesquisa, como a OpenAI. Cientes do potencial de litígios futuros, esses grandes jogadores corporativos parecem cada vez mais relutantes em representar até personagens fictícios fotorealistas.

Embora os sistemas que estão criando (como Imagen e Veo2) sejam claramente capazes de tal saída, os exemplos de projetos de IA gerativa ocidentais agora tendem a imagens e vídeos “fofos” e extremamente “seguros”.

Apesar de proclamar a capacidade do Imagen de criar saída fotorealista, as amostras promovidas pela Google Research são tipicamente fantásticas, ‘família’ – humanos fotorealistas são cuidadosamente evitados ou exemplos mínimos fornecidos. Fonte: https://imagen.research.google/

Lavagem de Rosto

Na literatura de CV ocidental, essa abordagem desonesta é particularmente evidente para personalização de sistemas – métodos que são capazes de criar semelhanças consistentes de uma pessoa específica em múltiplos exemplos (ou seja, como LoRA e o mais antigo DreamBooth).

Exemplos incluem orthogonal visual embedding, LoRA-Composer, o InstructBooth da Google e muitos mais.

O InstructBooth da Google aumenta o fator de fofura para 11, embora a história sugira que os usuários estejam mais interessados em criar humanos fotorealistas do que personagens fofos ou peludos. Fonte: https://sites.google.com/view/instructbooth

No entanto, o aumento do “exemplo fofo” é visto em outras linhas de pesquisa de CV e síntese, em projetos como Comp4D, V3D, DesignEdit, UniEdit, FaceChain (que concede expectativas de usuário mais realistas em sua página do GitHub), e DPG-T2I, entre muitos outros.

A facilidade com que esses sistemas (como LoRAs) podem ser criados por usuários domésticos com hardware relativamente modesto levou a uma explosão de modelos de celebridades gratuitos no domínio civit.ai e comunidade. Esse uso ilícito permanece possível por meio da abertura de arquiteturas como Stable Diffusion e Flux.

Embora seja frequentemente possível “furar” os recursos de segurança de sistemas de imagem para texto (T2I) e texto para vídeo (T2V) para produzir material proibido pelos termos de uso de uma plataforma, a lacuna entre as capacidades restritas dos melhores sistemas (como RunwayML e Sora) e as capacidades ilimitadas dos sistemas apenas performáticos (como Stable Video Diffusion, CogVideo e implantações locais de Hunyuan) não está realmente fechando, como muitos acreditam.

Em vez disso, esses sistemas proprietários e de código aberto, respectivamente, ameaçam se tornar igualmente inúteis: sistemas T2V de escala empresarial podem se tornar excessivamente limitados devido a medos de litígios, enquanto a falta de infraestrutura de licenciamento e supervisão de conjuntos de dados em sistemas de código aberto pode excluí-los completamente do mercado à medida que regulamentações mais rigorosas sejam implementadas.

Publicado pela primeira vez na terça-feira, 24 de dezembro de 2024