Inteligência artificial

Por Que os Sistemas de Vídeo Gerativos Não Podem Criar Filmes Completos?

O advento e o progresso do vídeo gerativo de IA têm levado muitos observadores casuais a prever que o aprendizado de máquina provará a morte da indústria cinematográfica como a conhecemos – em vez disso, criadores individuais poderão criar blockbusters no estilo de Hollywood em casa, seja em sistemas GPU locais ou baseados em nuvem.

Isso é possível? Mesmo que seja possível, é iminente, como muitos acreditam?

Que indivíduos eventualmente poderão criar filmes, na forma que os conhecemos, com personagens consistentes, continuidade narrativa e fotorealismo total, é bastante possível – e talvez até inevitável.

No entanto, existem várias razões fundamentalmente verdadeiras por que isso não é provável que ocorra com sistemas de vídeo baseados em Modelos de Difusão Latente.

Este último fato é importante porque, no momento, essa categoria inclui todos os sistemas populares de texto-para-vídeo (T2) e imagem-para-vídeo (I2V) disponíveis, incluindo Minimax, Kling, Sora, Imagen, Luma, Amazon Video Generator, Runway ML, Kaiber (e, até onde podemos discernir, a funcionalidade de vídeo pendente do Adobe Firefly’s pending); entre muitos outros.

Aqui, estamos considerando a perspectiva de verdadeiras auteur produções de IA gerativas de longa-metragem, criadas por indivíduos, com personagens consistentes, cinematografia e efeitos visuais pelo menos iguais ao estado atual da arte em Hollywood.

Vamos dar uma olhada em alguns dos principais obstáculos práticos para os desafios envolvidos.

1: Você Não Pode Obter uma Foto de Acompanhamento Precisa

A inconsistência narrativa é o maior desses obstáculos. O fato é que nenhum sistema de geração de vídeo atualmente disponível pode fazer uma foto de acompanhamento verdadeiramente precisa*.

Isso ocorre porque o modelo de difusão de desenoise no coração desses sistemas depende de ruído aleatório, e esse princípio fundamental não é propenso a reinterpretar exatamente o mesmo conteúdo duas vezes (ou seja, de diferentes ângulos, ou desenvolvendo a foto anterior em uma foto de acompanhamento que mantém a consistência com a foto anterior).

Onde os prompts de texto são usados, sozinhos ou juntos com imagens ‘seed’ carregadas (entrada multimodal), os tokens derivados do prompt elicitarão conteúdo semanticamente apropriado do espaço latente treinado do modelo.

No entanto, ainda mais dificultado pelo fator de ‘ruído aleatório’, ele nunca fará da mesma maneira duas vezes.

Isso significa que as identidades das pessoas no vídeo tenderão a mudar, e objetos e ambientes não corresponderão à foto inicial.

Isso é por que os cliques virais que mostram visuais extraordinários e saída de nível de Hollywood tendem a ser ou fotos únicas, ou uma ‘montagem de showcase’ das capacidades do sistema, onde cada foto apresenta personagens e ambientes diferentes.

Trechos de uma montagem de IA gerativa de Marco van Hylckama Vlieg – fonte: https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ/

A implicação nesses conjuntos de gerações de vídeo ad hoc (que podem ser desonestas no caso de sistemas comerciais) é que o sistema subjacente pode criar narrativas contíguas e consistentes.

A analogia sendo explorada aqui é um trailer de filme, que apresenta apenas um ou dois minutos de footage do filme, mas dá ao público razão para acreditar que o filme inteiro existe.

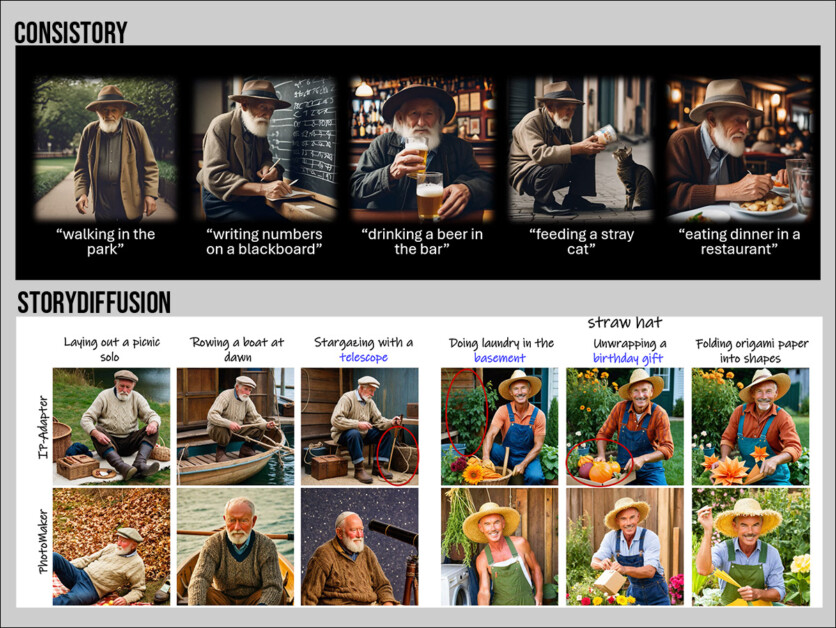

Os únicos sistemas que atualmente oferecem consistência narrativa em um modelo de difusão são aqueles que produzem imagens estáticas. Esses incluem o ConsiStory da NVIDIA, e projetos diversos na literatura científica, como TheaterGen, DreamStory, e StoryDiffusion.

Dois exemplos de ‘narrativa estática’ de continuidade, de modelos recentes:: Fontes: https://research.nvidia.com/labs/par/consistory/ e https://arxiv.org/pdf/2405.01434

Em teoria, você poderia usar um sistema melhor desses (nenhum dos acima é verdadeiramente consistente) para criar uma série de fotos de imagem-para-vídeo, que poderiam ser unidas em uma sequência.

No estado atual da arte, essa abordagem não produz fotos de acompanhamento plausíveis; e, de qualquer forma, já partimos do sonho auteur ao adicionar uma camada de complexidade.

Podemos, adicionalmente, usar Low Rank Adaptation (LoRA) modelos, treinados especificamente em personagens, coisas ou ambientes, para manter melhor consistência entre fotos.

No entanto, se um personagem desejar aparecer em um novo traje, um novo LoRA geralmente precisará ser treinado que incorpore o personagem vestido dessa forma (embora sub-conceitos como ‘vestido vermelho’ possam ser treinados em LoRAs individuais, juntamente com imagens apropriadas, eles não são sempre fáceis de trabalhar).

Isso adiciona considerável complexidade, mesmo a uma cena de abertura em um filme, onde uma pessoa sai da cama, coloca um roupão, boceja, olha pela janela do quarto e vai ao banheiro para escovar os dentes.

Uma cena dessas, contendo cerca de 4-8 fotos, pode ser filmada em uma manhã por procedimentos de filmagem convencionais; no estado atual da arte em IA gerativa, isso potencialmente representa semanas de trabalho, múltiplos LoRAs treinados (ou outros sistemas auxiliares), e uma quantidade considerável de pós-processamento

Alternativamente, vídeo-para-vídeo pode ser usado, onde footage mundano ou CGI é transformado por meio de prompts de texto em interpretações alternativas. Runway oferece tal sistema, por exemplo.

CGI (esquerda) do Blender, interpretado em um experimento de vídeo-para-vídeo auxiliado por texto da Runway por Mathieu Visnjevec – Fonte: https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/?

Há dois problemas aqui: você já está tendo que criar o footage básico, então você já está fazendo o filme duas vezes, mesmo que você esteja usando um sistema sintético como o MetaHuman da UnReal.

Se você criar modelos CGI (como no clipe acima) e usá-los em uma transformação de vídeo-para-imagem, a consistência deles entre fotos não pode ser confiável.

Isso ocorre porque os modelos de difusão de vídeo não veem o ‘quadro geral’ – em vez disso, criam um novo quadro com base em quadros anteriores, e, em alguns casos, consideram um quadro futuro próximo; mas, para comparar o processo a um jogo de xadrez, eles não podem pensar ‘dez movimentos à frente’, e não podem lembrar dez movimentos atrás.

Em segundo lugar, um modelo de difusão ainda lutará para manter uma aparência consistente entre as fotos, mesmo que você inclua múltiplos LoRAs para personagem, ambiente e estilo de iluminação, por razões mencionadas no início desta seção.

2: Você Não Pode Editar uma Foto Facilmente

Se você representa um personagem caminhando pela rua usando métodos CGI tradicionais, e você decide que deseja alterar algum aspecto da foto, você pode ajustar o modelo e renderizá-lo novamente.

Se for uma filmagem real, você simplesmente redefine e filma novamente, com as alterações apropriadas.

No entanto, se você produzir uma foto de vídeo de IA que você ama, mas deseja alterar um aspecto dela, você só pode fazer isso por meio de métodos de pós-produção laboriosos desenvolvidos nos últimos 30-40 anos: CGI, rotoscopia, modelagem e matting – todos procedimentos laboriosos e caros, demorados e demorados.

A forma como os modelos de difusão funcionam, simplesmente alterar um aspecto de um prompt de texto (mesmo em um prompt multimodal, onde você fornece uma imagem ‘seed’ completa) alterará múltiplos aspectos da saída gerada, levando a um jogo de ‘whack-a-mole’ de prompts.

3: Você Não Pode Confiar nas Leis da Física

Métodos CGI tradicionais oferecem uma variedade de modelos de física baseados em algoritmos que podem simular coisas como dinâmica de fluidos, movimento gasoso, cinemática inversa (modelagem precisa do movimento humano), dinâmica de tecidos, explosões e diversos outros fenômenos do mundo real.

No entanto, métodos baseados em difusão, como vimos, têm memória curta, e também um alcance limitado de priores de movimento (exemplos de tais ações, incluídos no conjunto de treinamento) para usar.

Em uma versão anterior da página de aterrissagem da OpenAI para o aclamado sistema gerativo Sora, a empresa admitiu que o Sora tem limitações nesse sentido (embora esse texto tenha sido removido desde então):

‘[Sora] pode ter dificuldade em simular a física de uma cena complexa, e pode não compreender instâncias específicas de causa e efeito (por exemplo: um biscoito pode não mostrar uma marca após um personagem mordê-lo).

‘O modelo também pode confundir detalhes espaciais incluídos em um prompt, como discernir esquerda de direita, ou lutar com descrições precisas de eventos que se desenrolam ao longo do tempo, como trajetórias de câmera específicas.’

O uso prático de vários sistemas gerativos de vídeo baseados em API revela limitações semelhantes na representação de física precisa. No entanto, certos fenômenos físicos comuns, como explosões, parecem ser melhor representados em seus conjuntos de treinamento.

Alguns embeddings de priors de movimento, seja treinados no modelo gerativo ou alimentados a partir de um vídeo de origem, levam algum tempo para serem concluídos (como uma pessoa realizando uma sequência de dança complexa e não repetitiva em um traje elaborado) e, uma vez mais, a janela de atenção míope do modelo de difusão provavelmente transformará o conteúdo (ID facial, detalhes de traje, etc.) até que o movimento tenha sido concluído. No entanto, os LoRAs podem mitigar isso, até certo ponto.

Consertando em Pós-Produção

Há outras deficiências na geração de vídeo de IA ‘single user’ pura, como a dificuldade que eles têm em representar movimentos rápidos, e o problema geral e muito mais premente de obter consistência temporal na saída de vídeo.

Além disso, criar performances faciais específicas é quase uma questão de sorte na geração de vídeo de IA, assim como a sincronização labial para diálogos.

Em ambos os casos, o uso de sistemas auxiliares como LivePortrait e AnimateDiff está se tornando muito popular na comunidade de efeitos visuais, desde que isso permite a transposição de pelo menos expressões faciais amplas e sincronização labial para saídas geradas existentes.

Um exemplo de transferência de expressão (vídeo de direção em baixo à esquerda) sendo imposta em um vídeo-alvo com LivePortrait. O vídeo é do Generative Z TunisiaGenerative. Veja a versão completa em melhor qualidade em https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/?

Além disso, uma miríade de soluções complexas, incorporando ferramentas como a interface do usuário ComfyUI ComfyUI da Stable Diffusion e o aplicativo profissional de composição e manipulação Nuke, bem como a manipulação do espaço latente, permitem que os profissionais de efeitos visuais de IA obtenham maior controle sobre expressão facial e disposição.

Embora ele descreva o processo de animação facial no ComfyUI como ‘tortura’, o profissional de efeitos visuais Francisco Contreras desenvolveu tal procedimento, que permite a imposição de fonemas labiais e outros aspectos da representação da cabeça/facial

A Stable Diffusion, ajudada por um fluxo de trabalho ComfyUI alimentado pelo Nuke, permitiu que o profissional de efeitos visuais Francisco Contreras obtivesse controle incomum sobre aspectos faciais. Para o vídeo completo, em melhor resolução, vá para https://www.linkedin.com/feed/update/urn:li:activity:7243056650012495872/

Conclusão

Nada disso é promissor para a perspectiva de um usuário único gerar filmes coherentes e fotorealistas de estilo blockbuster, com diálogos realistas, sincronização labial, performances, ambientes e continuidade.

Além disso, os obstáculos descritos aqui, pelo menos em relação a modelos de vídeo gerativos baseados em difusão, não são necessariamente solucionáveis ‘a qualquer momento’ agora, apesar de comentários de fóruns e atenção da mídia que fazem esse caso. As restrições descritas parecem ser intrínsecas à arquitetura.

Na pesquisa de síntese de IA, como em todas as pesquisas científicas, ideias brilhantes periodicamente nos deslumbram com seu potencial, apenas para que pesquisas adicionais descubram suas limitações fundamentais.

No espaço de síntese/geração, isso já aconteceu com Redes Adversárias Gerativas (GANs) e Campos de Radiância Neurais (NeRF), ambos os quais provaram ser muito difíceis de instrumentalizar em sistemas comerciais performáticos, apesar de anos de pesquisa acadêmica nesse sentido. Essas tecnologias agora aparecem mais frequentemente como componentes auxiliares em arquiteturas alternativas.

Assim como os estúdios de cinema podem esperar que o treinamento em catálogos de filmes licenciados legitimamente possa eliminar artistas de efeitos visuais, a IA está adicionando papéis à força de trabalho no momento.

Se os sistemas de vídeo baseados em difusão realmente podem ser transformados em geradores de filmes narrativamente consistentes e fotorealistas, ou se o negócio todo é apenas outra busca alquímica, deve ficar claro nos próximos 12 meses.

Pode ser que precisemos de uma abordagem completamente nova; ou pode ser que o Gaussian Splatting (GSplat), que foi desenvolvido no início dos anos 1990 e recentemente ganhou destaque no espaço de síntese de imagens, represente uma alternativa potencial à geração de vídeo baseada em difusão.

Já que o GSplat levou 34 anos para se destacar, também é possível que os contendores mais antigos, como NeRF e GANs – e até mesmo os modelos de difusão latente – ainda tenham seu dia.

* A funcionalidade de Storyboard da Kaiber oferece essa funcionalidade, mas os resultados que eu vi não são de qualidade de produção.

Martin Anderson é o ex-chefe de conteúdo de pesquisa científica da metaphysic.ai

Publicado pela primeira vez em segunda-feira, 23 de setembro de 2024