Inteligência artificial

A Definição Elusiva de ‘Deepfake’

Um estudo novo e convincente da Alemanha critica a definição do termo ‘deepfake’ no Regulamento de IA da UE como excessivamente vaga, particularmente no contexto da manipulação de imagens digitais. Os autores argumentam que a ênfase do Regulamento em conteúdo que se assemelha a pessoas ou eventos reais – mas que pode parecer falso – carece de clareza.

Eles também destacam que as exceções do Regulamento para ‘edição padrão’ (ou seja, modificações menores feitas com o auxílio de IA em imagens) não consideram a influência generalizada da IA em aplicações de consumo e a natureza subjetiva das convenções artísticas que precedem a chegada da IA.

Legislação imprecisa sobre essas questões dá origem a dois riscos principais: um ‘efeito de arrefecimento’, onde a lei de alcance interpretativo amplo sufoca a inovação e a adoção de novos sistemas; e um ‘efeito de desrespeito’, onde a lei é desconsiderada como excessiva ou irrelevante.

Em qualquer caso, leis vagas transferem efetivamente a responsabilidade de estabelecer definições legais práticas para decisões judiciais futuras – uma abordagem cautelosa e avessa a riscos para a legislação.

As tecnologias de manipulação de imagens baseadas em IA permanecem notavelmente à frente da capacidade da legislação de abordá-las, parece. Por exemplo, um exemplo notável da crescente elasticidade do conceito de pós-processamento ‘automático’ impulsionado por IA é a função ‘Scene Optimizer’ em câmeras Samsung recentes, que pode substituir imagens de usuário tiradas da lua (um assunto desafiador) por uma imagem ‘refinada’ impulsionada por IA:

<img class=" wp-image-210152" src="https://www.unite.ai/wp-content/uploads/2024/12/samsung-moon-photo.jpg" alt="Topo à esquerda, um exemplo do novo artigo de uma imagem real tirada por um usuário da lua, à esquerda de uma versão aprimorada do Samsung criada automaticamente com Scene Optimizer; Direita, ilustração oficial da Samsung do processo por trás disso; inferior esquerda, exemplos do usuário do Reddit u/ibreakphotos, mostrando (esquerda) uma imagem intencionalmente desfocada da lua e (direita), reimaginação da Samsung desta imagem – mesmo que a foto de origem fosse uma imagem de um monitor, e não a lua real. Fontes (no sentido horário a partir do topo): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

No canto inferior esquerdo da imagem acima, vemos duas imagens da lua. A da esquerda é uma foto tirada por um usuário do Reddit. Aqui, a imagem foi intencionalmente desfocada e reduzida pelo usuário.

À sua direita, vemos uma foto da mesma imagem degradada tirada com uma câmera Samsung com pós-processamento impulsionado por IA habilitado. A câmera ‘melhorou’ automaticamente o objeto ‘lua’ reconhecido, mesmo que não fosse a lua real.

O artigo critica mais profundamente a função Best Take incorporada nos smartphones recentes da Google – uma controversa funcionalidade de IA que edita juntos os ‘melhores’ partes de uma foto de grupo, digitalizando múltiplos segundos de uma sequência de fotografia para que sorrisos sejam rearranjados para a frente ou para trás no tempo conforme necessário – e ninguém é mostrado no meio de piscar.

O artigo sustenta que esse tipo de processo composto tem o potencial de distorcer eventos:

‘[Em] um ambiente típico de foto de grupo, um espectador médio provavelmente ainda consideraria a foto resultante como autêntica. O sorriso que é inserido existia dentro de alguns segundos da foto restante sendo tirada.

‘Por outro lado, o quadro de tempo de dez segundos da funcionalidade de melhor tom é suficiente para uma mudança de humor. Uma pessoa pode ter parado de sorrir enquanto o resto do grupo ri sobre uma piada às suas expensas.

‘Como consequência, assumimos que esse tipo de foto de grupo pode muito bem constituir um deep fake.’

O novo artigo é intitulado O que constitui um Deep Fake? A linha borrada entre processamento legítimo e manipulação sob o Regulamento de IA da UE, e vem de dois pesquisadores do Laboratório de Direito Computacional da Universidade de Tübingen e da Universidade de Saarland.

Velhas Táticas

Manipular o tempo na fotografia é muito mais antigo do que a IA de nível de consumo. Os autores do novo artigo observam a existência de técnicas muito mais antigas que podem ser argumentadas como ‘não autênticas’, como a concatenação de múltiplas imagens sequenciais em uma foto de Alta Definição Dinâmica (HDR) ou uma ‘foto costurada’ panorâmica.

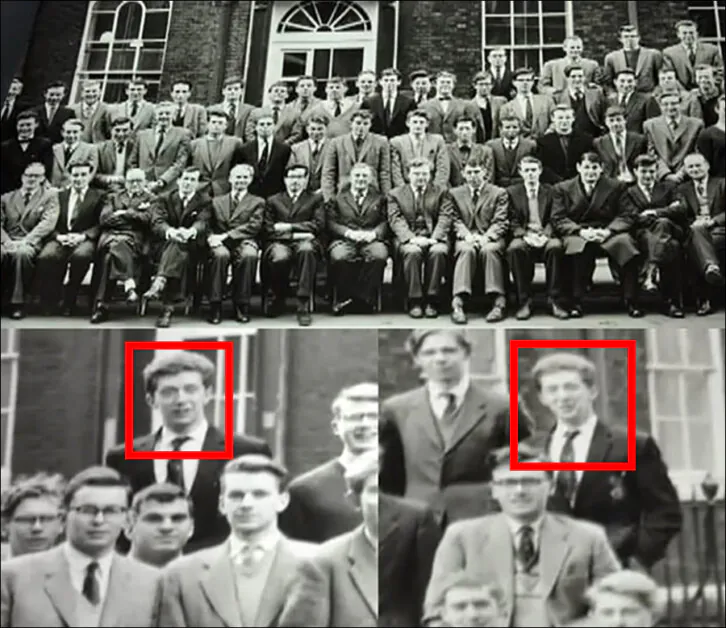

De fato, alguns dos falsos fotográficos mais antigos e divertidos foram tradicionalmente criados por crianças em idade escolar correndo de um lado para o outro de um grupo escolar, à frente da trajetória das câmeras panorâmicas que eram usadas para fotografia escolar e esportiva – permitindo que o aluno aparecesse duas vezes na mesma imagem:

A tentação de enganar as câmeras panorâmicas durante as fotos de grupo era grande demais para muitos alunos, que estavam dispostos a arriscar uma sessão ruim no escritório do diretor para ‘clonar’ a si mesmos nas fotos escolares. Fonte: https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

A menos que você tire uma foto no modo RAW, que basicamente descarrega o sensor da lente da câmera para um arquivo grande sem qualquer tipo de interpretação, é provável que suas fotos digitais não sejam completamente autênticas. Os sistemas de câmera aplicam algoritmos de ‘melhoria’ como afinação de imagem e balanceamento de branco por padrão – e têm feito isso desde a origem da fotografia digital de nível de consumo.

Os autores do novo artigo argumentam que mesmo esses tipos mais antigos de aumento de foto digital não representam ‘realidade’, pois esses métodos são projetados para tornar as fotos mais agradáveis, não mais ‘reais’.

O estudo sugere que o Regulamento de IA da UE, mesmo com emendas posteriores como recitais 123–27, coloca toda a saída fotográfica dentro de um quadro probatório inadequado para o contexto em que as fotos são produzidas hoje, em oposição à (nominalmente objetiva) natureza de filmagens de câmeras de segurança ou fotografia forense. A maioria das imagens abordadas pelo Regulamento de IA da UE é mais provável de originar em contextos onde os fabricantes e as plataformas online ativamente promovem a interpretação criativa de fotos, incluindo o uso de IA.

Os pesquisadores sugerem que as fotos ‘nunca foram uma representação objetiva da realidade’. Considerações como a localização da câmera, a profundidade de campo escolhida e as escolhas de iluminação contribuem para tornar uma fotografia profundamente subjetiva.

O artigo observa que tarefas de ‘limpeza’ rotineiras – como remover poeira do sensor ou linhas de energia indesejadas de uma cena bem composta – eram apenas semi-automatizadas antes do surgimento da IA: os usuários tinham que selecionar manualmente uma região ou iniciar um processo para alcançar o resultado desejado.

Hoje, essas operações são frequentemente acionadas por prompts de texto do usuário, mais notadamente em ferramentas como o Photoshop. No nível de consumo, esses recursos são cada vez mais automatizados sem entrada do usuário – um resultado que aparentemente é considerado pelos fabricantes e plataformas como ‘obviamente desejável’.

O Significado Diluído de ‘Deepfake’

Um desafio central para a legislação em torno de imagens alteradas e geradas por IA é a ambiguidade do termo ‘deepfake’, que teve seu significado notavelmente estendido nos últimos dois anos.

Originalmente, os termos se aplicavam apenas à saída de vídeo de sistemas baseados em autoencoder como DeepFaceLab e FaceSwap, ambos derivados de código anônimo publicado no Reddit no final de 2017.

A partir de 2022, a chegada de Modelos de Difusão Latente (LDMs) como Stable Diffusion e Flux, bem como sistemas de texto-para-vídeo como Sora, permitiriam a troca de identidade e personalização, com resolução, versatilidade e fidelidade aprimoradas. Agora era possível criar modelos baseados em difusão que pudessem retratar celebridades e políticos. Como o termo ‘deepfake’ já era um tesouro que atraía manchetes para os produtores de mídia, ele foi estendido para cobrir esses sistemas.

Mais tarde, tanto na mídia quanto na literatura de pesquisa, o termo também passou a incluir impersonação baseada em texto. Nesse ponto, o significado original de ‘deepfake’ estava quase perdido, enquanto seu significado estendido estava constantemente evoluindo e se tornando cada vez mais diluído.

Mas como a palavra era tão incendiária e galvanizadora, e agora era um poderoso ponto de contato político e midiático, provou ser impossível abandoná-la. Ela atraía leitores para sites, financiamento para pesquisadores e atenção para políticos. Essa ambiguidade lexical é o foco principal da nova pesquisa.

Como os autores observam, o artigo 3(60) do Regulamento de IA da UE define quatro condições que definem um ‘deepfake’.

1: Lua Verdadeira

Em primeiro lugar, o conteúdo deve ser gerado ou manipulado, ou seja, criado do zero usando IA (geração) ou alterado a partir de dados existentes (manipulação). O artigo destaca a dificuldade em distinguir entre resultados de edição de imagem ‘aceitáveis’ e deepfakes manipuladores, considerando que as fotos digitais nunca são representações verdadeiras da realidade.

O artigo argumenta que uma lua gerada pela Samsung é arguivelmente autêntica, desde que a lua é improvável que mude de aparência, e desde que o conteúdo gerado por IA, treinado em imagens lunares reais, é provavelmente preciso.

No entanto, os autores também afirmam que, desde que o sistema da Samsung foi mostrado para gerar uma imagem ‘melhorada’ da lua em um caso em que a imagem de origem não era a lua em si, isso seria considerado um ‘deepfake’.

Seria impraticável elaborar uma lista abrangente de casos de uso diferentes em torno dessa funcionalidade ad hoc. Portanto, a carga de definição parece passar, mais uma vez, para os tribunais.

2: TextFakes

Em segundo lugar, o conteúdo deve ser na forma de imagem, áudio ou vídeo. Conteúdo de texto, embora sujeito a outras obrigações de transparência, não é considerado um deepfake sob o Regulamento de IA da UE. Isso não é coberto em detalhes no novo estudo, embora possa ter um impacto notável na eficácia de visuais deepfakes (ver abaixo).

3: Problemas do Mundo Real

Em terceiro lugar, o conteúdo deve se assemelhar a pessoas, objetos, lugares, entidades ou eventos existentes. Essa condição estabelece uma conexão com o mundo real, significando que imagens puramente fabricadas, mesmo que fotorealistas, não se qualificariam como deepfakes. Recital 134 do Regulamento de IA da UE enfatiza o aspecto de ‘semelhança’ adicionando a palavra ‘apreciavelmente’ (um aparente adiamento para julgamentos legais subsequentes).

Os autores, citando trabalho anterior, consideram se uma face gerada por IA precisa pertencer a uma pessoa real ou se precisa apenas ser suficientemente semelhante a uma pessoa real para atender a essa definição.

Por exemplo, como pode ser determinado se uma sequência de imagens fotorealistas que retratam o político Donald Trump tem a intenção de imitar, se as imagens (ou textos anexados) não mencionam especificamente ele? Reconhecimento facial? Pesquisas de usuário? Uma definição de ‘senso comum’ de um juiz?

Voltando ao problema dos ‘TextFakes’ (ver acima), as palavras frequentemente constituem uma parte significativa do ato de um visual deepfake. Por exemplo, é possível pegar uma imagem (não alterada) ou vídeo de ‘pessoa a’ e dizer, em uma legenda ou postagem de mídia social, que a imagem é de ‘pessoa b’ (supondo que as duas pessoas se pareçam).

Nesse caso, não é necessário IA, e o resultado pode ser surpreendentemente eficaz – mas isso também constitui um ‘deepfake’?

4: Retoque, Remodelagem

Finalmente, o conteúdo deve parecer autêntico ou verdadeiro para uma pessoa. Essa condição enfatiza a percepção dos espectadores humanos. Conteúdo que é reconhecido como representando uma pessoa ou objeto real apenas por um algoritmo não seria considerado um deepfake.

De todas as condições em 3(60), esta é a que mais obviamente se refere ao julgamento posterior de um tribunal, pois não permite nenhuma interpretação por meios técnicos ou mecanizados.

Há claramente algumas dificuldades inerentes em chegar a um consenso sobre essa estipulação subjetiva. Os autores observam, por exemplo, que diferentes pessoas e diferentes tipos de pessoas (como crianças e adultos) podem ser variadamente inclinadas a acreditar em um deepfake particular.

Os autores observam ainda que as capacidades avançadas de IA de ferramentas como o Photoshop desafiam as definições tradicionais de ‘deepfake’. Embora esses sistemas possam incluir salvaguardas básicas contra conteúdo controverso ou proibido, eles expandem dramaticamente o conceito de ‘retocar’. Os usuários agora podem adicionar ou remover objetos de maneira convincente e fotorealista, alcançando um nível profissional de autenticidade que redefine os limites da manipulação de imagens.

Os autores afirmam:

‘Argumentamos que a definição atual de deepfakes no Regulamento de IA e as obrigações correspondentes não estão suficientemente especificadas para lidar com os desafios impostos pelos deepfakes. Ao analisar o ciclo de vida de uma foto digital, desde o sensor da câmera até os recursos de edição digital, encontramos que:

‘(1.) Os deepfakes estão mal definidos no Regulamento de IA da UE. A definição deixa muito espaço para o que é um deepfake.

‘(2.) Não está claro como as funções de edição, como a funcionalidade “melhor tom” do Google, podem ser consideradas como uma exceção às obrigações de transparência.

‘(3.) A exceção para imagens substancialmente editadas levanta questões sobre o que constitui edição substancial de conteúdo e se essa edição deve ser perceptível por uma pessoa natural.’

Tirando Exceção

O Regulamento de IA da UE contém exceções que, os autores argumentam, podem ser muito permissivas. Artigo 50(2), eles afirmam, oferece uma exceção nos casos em que a maioria da imagem de origem não é alterada. Os autores observam:

‘O que pode ser considerado conteúdo no sentido do Artigo 50(2) em casos de áudio, imagens e vídeos digitais? Por exemplo, no caso de imagens, devemos considerar o espaço de pixels ou o espaço perceptível por humanos? Manipulações substantivas no espaço de pixels podem não alterar a percepção humana, e por outro lado, pequenas perturbações no espaço de pixels podem alterar a percepção dramaticamente.’

Os pesquisadores fornecem o exemplo de adicionar uma arma de fogo à foto de uma pessoa que está apontando para alguém. Ao adicionar a arma, está mudando tão pouco quanto 5% da imagem; no entanto, o significado semântico da parte alterada é notável. Portanto, parece que essa exceção não leva em conta nenhum ‘entendimento de senso comum’ do efeito que um detalhe pequeno pode ter sobre o significado geral de uma imagem.

A Seção 50(2) também permite exceções para uma ‘função de edição assistida padrão’. Como o Regulamento não define o que significa ‘edição padrão’, mesmo recursos de pós-processamento extremos como a funcionalidade Best Take do Google parecem ser protegidos por essa exceção, observam os autores.

Conclusão

A intenção declarada do novo trabalho é encorajar o estudo interdisciplinar sobre a regulação de deepfakes e servir como um ponto de partida para novos diálogos entre cientistas da computação e estudiosos do direito.

No entanto, o artigo em si sucumbe à tautologia em vários pontos: ele usa frequentemente o termo ‘deepfake’ como se seu significado fosse evidente por si só, enquanto critica o Regulamento de IA da UE por não definir o que realmente constitui um deepfake.

Publicado pela primeira vez na segunda-feira, 16 de dezembro de 2024