Líderes de pensamento

Um Livro de Instruções Prático para Saídas de LLM Defensáveis

Existe uma suposição silenciosa que permeia a maioria das implantações de GenAI em empresas: se a saída parece certa, ela é certa. Em ambientes de baixo risco, essa é uma atalho razoável. Em indústrias regulamentadas, como saúde, finanças, farmacêuticas e garantia de qualidade, é uma responsabilidade que pode surgir a qualquer momento.

No momento em que uma saída de LLM influencia uma decisão clínica, um registro financeiro ou um documento de conformidade, a fluência deixa de ser um proxy para a confiabilidade. E quando um auditor, regulador ou equipe jurídica pergunta quais dados foram usados, quais regras foram aplicadas e quem aprovou, “o modelo disse assim” não é uma resposta que alguém possa assinar.

Essa é a lacuna de responsabilidade que a maioria das equipes de GenAI não está projetando. Aqui está como fechá-la.

Por que “Parece Certo” é o Padrão Errado

A avaliação tradicional de IA se concentra em precisão, latência e custo. Essas coisas importam. Mas ambientes regulamentados introduzem um quarto eixo que os outros não podem substituir: auditoria.

O EU AI Act, agora em vigor, exige que sistemas de IA de alto risco mantenham documentação técnica, logs de rastreabilidade e evidências de supervisão humana ao longo de todo o seu ciclo de vida. O primeiro rascunho de orientação da FDA sobre IA no desenvolvimento de medicamentos e biológicos sinaliza a mesma direção para as ciências da vida. Esses quadros não avaliam a fluência. Eles exigem sistemas que possam ser reconstruídos, inspecionados e defendidos.

Uma saída de LLM defensável é aquela que pode ser rastreada por uma cadeia de evidências verificável: quais dados ela utilizou, quais restrições a moldaram, quem a revisou e o que foi retido para inspeção futura. Sem essa cadeia, mesmo uma saída correta é indefensável.

Isso redefini o que “pronto para produção” realmente significa para IA em ambientes governados.

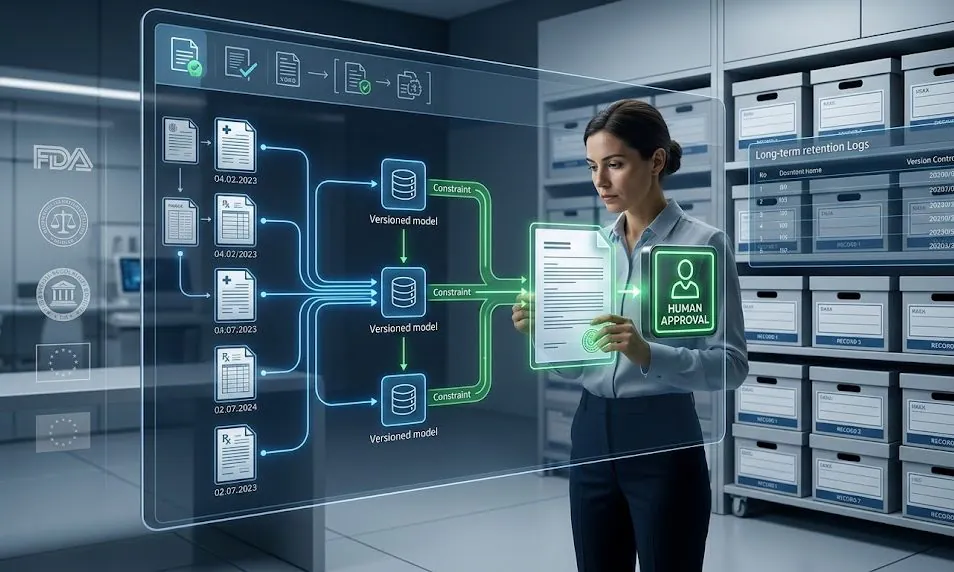

Os Quatro Pilares de GenAI Pronto para Auditoria

Construir sistemas de LLM defensáveis se resume a quatro requisitos de engenharia. Eles não são princípios abstratos – são decisões de infraestrutura que determinam se o seu sistema pode sobreviver a um exame.

1. Proveniência: Controle de Onde o Modelo Obtém Suas Informações

O modo de falha mais comum em IA empresarial também é o menos visível: modelos que se baseiam em conhecimento geral ou fontes de dados mal definidas. Quando não há uma fronteira de conhecimento controlada, as saídas não podem ser rastreadas até uma fonte auditável, e a reconstrução se torna impossível.

Um conserto prático é estabelecer uma fronteira de conhecimento aprovada: documentos e conjuntos de dados versionados e de propriedade que o sistema é explicitamente autorizado a usar. Cada resposta deve carregar um pacote mínimo de evidências: um identificador de fonte com versão e data efetiva, um log de recuperação mostrando o que foi consultado e selecionado, e citações em linha. Uma regra de operação útil: sem citação, sem afirmação.

Isso converte o sistema de geração baseada em memória para raciocínio baseado em evidências. A distinção se torna crítica quando alguém precisa reconstruir uma saída específica semanas ou meses após sua geração.

2. Restrições: Substituir Improvisação por Comportamento Controlado

LLMs são construídos para ser convincentes. Sem restrições, eles otimizam a plausibilidade, e a plausibilidade em um contexto regulamentado é onde o risco vive.

As restrições são o mecanismo que transforma um gerador de texto probabilístico em um componente de execução limitada. Na prática, isso significa:

- Geração vinculada à fonte: Cada afirmação exige uma fonte aprovada e versionada. Sem fonte significa sem resposta — apenas recusa ou escalonamento.

- Esquemas de saída estruturados: Respostas seguem formatos definidos que máquinas e auditores podem validar, e não apenas ler.

- Enforcement de limite de confiança: O conteúdo recuperado é tratado como entrada, abordando diretamente os riscos de injeção de prompt que podem comprometer tanto a segurança quanto a auditoria.

- Acesso de menor privilégio: O modelo interage apenas com os dados e ferramentas que realmente precisa, mantendo os registros de auditoria limpos.

As restrições não são uma caixa de seleção de conformidade. São a decisão arquitetônica que determina se o seu sistema pode ser auditado.

3. Revisão: Tornar a Supervisão Humana uma Camada de Controle Formal

Em IA regulamentada, a revisão humana não pode ser ad hoc. Ela precisa ser estratificada por risco (saídas de alto risco acionam validação mais estrita) e acionada por eventos, ativando quando a confiança do modelo é baixa, as fontes estão ausentes ou anomalias são detectadas.

O EU AI Act explicitamente exige que os humanos possam interpretar, anular e interromper decisões impulsionadas por IA em casos de alto risco. Atender a esse requisito significa que os registros de revisão precisam capturar quem aprovou uma saída, sob quais condições e com que nível de escrutínio. “Alguém verificou” não é um controle. Um registro de revisão documentado e com carimbo de data/hora é.

Isso eleva a revisão de QA manual para uma camada de governança formal, que é exatamente como os reguladores estão começando a tratá-la.

4. Retenção: Tornar a Responsabilidade Duradoura

Sem logs, não há um registro de auditoria. Sem um registro de auditoria, a responsabilidade é teórica.

Ao mesmo tempo, reter tudo cria seus próprios riscos, particularmente onde dados de saúde ou financeiros sensíveis estão sujeitos a requisitos de minimização sob quadros como GDPR ou HIPAA.

A abordagem prática é um modelo em camadas. Sempre armazene metadados do modelo e da versão, identificadores de fonte, decisões de política e carimbos de data/hora. Armazene o conteúdo de interação (prompts, saídas e rastros completos) seletivamente, com base na classificação de risco, com redação e controles de acesso apropriados. O objetivo é permitir a reconstrução de qualquer saída sem coletar dados que criem exposição downstream.

Como Isso Parece na Prática

Considere como isso se aplica nas ciências da vida, onde CFR 21 Parte 11 exige que os registros eletrônicos sejam atribuíveis, legíveis, contemporâneos, originais e precisos. Um LLM que gera documentação regulamentar deve atender a todos os cinco critérios – não apenas produzir texto legível.

Nesse contexto, os quatro pilares não são melhorias opcionais. Eles são a barra mínima para um sistema conforme.

A proveniência garante que a saída é atribuível e original. As restrições garantem que ela permaneça dentro de limites definidos. A revisão garante que seja contemporânea com a supervisão humana. A retenção garante que seja legível e inspecionável.

A mesma lógica se aplica aos serviços financeiros, onde MiFID II exige registros de decisões e a lógica por trás delas, e na saúde, onde os sistemas de apoio a decisões clínicas enfrentam um escrutínio crescente sobre explicabilidade e viés.

A Mudança Maior

O GenAI está passando da experimentação para a infraestrutura operacional. Essa transição eleva o padrão para o que os sistemas aceitáveis parecem.

Uma saída útil não é mais suficiente. As organizações precisam de saídas que possam ser explicadas, rastreadas e defendidas sob escrutínio, porque a IA está sendo solicitada a fazer coisas que têm consequências reais.

As equipes que projetam a defensibilidade desde o início estarão posicionadas para dimensionar a IA com segurança e manter a confiança regulatória. Aqueles que não o fazem eventualmente enfrentarão o mesmo momento: uma auditoria, uma pergunta direta sobre uma saída específica e nada para mostrar.

Construir IA pronta para auditoria não é sobre desacelerar. É sobre construir algo que possa durar.