Sztuczna inteligencja

Wykrywacze Deepfake idą na nowy grunt: modele dyfuzji latentnej i GAN

Opinia

Od niedawna społeczność badawcza zajmująca się wykrywaniem deepfake, która od końca 2017 roku była zajęta prawie wyłącznie ramą opartą na autoencoderze, która zadebiutowała w tym czasie i wywołała publiczne zdumienie (i zaniepokojenie), zaczęła interesować się mniej statycznymi architekturami, w tym modelami dyfuzji latentnej, takimi jak DALL-E 2 i Stable Diffusion, a także wyjściem Generative Adversarial Networks (GANs). Na przykład w czerwcu, UC Berkeley opublikował wyniki swoich badań nad rozwojem wykrywacza dla wyjścia DALL-E 2.

Poruszające się obrazy

W obu przypadkach czynnikiem galwanizującym wydaje się być perspektywa następnego sprintu rozwojowego dla syntezy wideo. Początek października – i główny sezon konferencyjny 2022 roku – był charakteryzowany przez lawinę niespodziewanych rozwiązań dla różnych długotrwałych problemów związanych z syntezą wideo: zaraz po tym, jak Facebook opublikował próbki swojej własnej platformy text-to-video, Google Research szybko przytłumił ten początkowy entuzjazm, ogłaszając nową architekturę Imagen-to-Video T2V, zdolną do generowania wysokiej rozdzielczości (choć tylko za pomocą 7-warstwowej sieci upsamplującej).

Jeśli uważasz, że tego rodzaju rzeczy przychodzi w trzech, rozważ również enigmatyczne obietnice stability.ai, że “wideo jest w drodze” do Stable Diffusion, najwyraźniej później w tym roku, podczas gdy współtwórca Stable Diffusion, Runway, złożył podobną obietnicę, choć nie jest jasne, czy odnoszą się do tego samego systemu. Wiadomość Discord od CEO Stability, Emada Mostaque, obiecała również ‘audio, wideo [i] 3d’.

Co więcej, z niespodzianą ofertą nowych ram audio (niektóre oparte na dyfuzji latentnej) i nowym modelem dyfuzji, który może generować autentyczne ruchy postaci, pomysł, że “statyczne” ramy, takie jak GAN i dyfuzory, w końcu zajmą swoje miejsce jako wspierające dodatki do zewnętrznych ram animacji, zaczyna zyskiwać realną przyczepność.

Krótko mówiąc, wydaje się prawdopodobne, że świat deepfake’ów opartych na autoencoderach, który może skutecznie zastąpić tylko środkową część twarzy, może być za tym czasem w przyszłym roku zaćmiony przez nowe pokolenie technologii opartych na dyfuzji, popularnych, otwartych podejść z potencjałem do fotorealistycznego fałszowania nie tylko całych ciał, ale także całych scen.

Dlatego też społeczność badawcza przeciwdziałająca deepfake’om zaczyna traktować syntezę obrazu poważnie i zdaje sobie sprawę, że może służyć więcej niż tylko generowaniu fałszywych zdjęć profilowych na LinkedIn; i że jeśli wszystkie ich niewykonalne przestrzenie latentne mogą osiągnąć w zakresie ruchu czasowego, to może to być więcej niż wystarczające.

Łowca androidów

Najnowsze dwie prace, które zajmują się odpowiednio wykrywaniem deepfake’ów opartych na modelach dyfuzji latentnej i GAN, to DE-FAKE: Wykrywanie i identyfikacja fałszywych obrazów wygenerowanych przez modele dyfuzji tekst-obraz, współpraca pomiędzy CISPA Helmholtz Center for Information Security i Salesforce; oraz BLADERUNNER: Szybkie przeciwdziałanie syntetycznym (wygenerowanym przez AI) twarzom StyleGAN, z Adamem Dorianem Wongiem z Laboratorium Lincolna w MIT.

Przed wyjaśnieniem nowej metody, drugi artykuł poświęca trochę czasu na zbadanie poprzednich podejść do określenia, czy obraz został wygenerowany przez GAN (artykuł zajmuje się konkretnie rodziną StyleGAN od NVIDII).

Metoda “Brady Bunch” – być może bezsignifikacyjna odniesienie dla kogoś, kto nie oglądał telewizji w latach 70. lub kto przegapił adaptacje filmowe z lat 90. – identyfikuje fałszywe treści GAN na podstawie stałych pozycji, które określone części twarzy GAN zajmują z powodu szablonowego i seryjnego charakteru “procesu produkcyjnego”.

Metoda ‘Brady Bunch’ przedstawiona przez webcast z SANS Institute w 2022 roku: generator twarzy GAN będzie wykonywał nieprawdopodobnie jednolitą umieszczenie pewnych cech twarzy, zdradzając pochodzenie zdjęcia, w pewnych przypadkach. Źródło: https://arxiv.org/ftp/arxiv/papers/2210/2210.06587.pdf

Inny użyteczny znany wskazanie jest częsta niezdolność StyleGAN do renderowania wielu twarzy (pierwsze zdjęcie poniżej), jeśli jest to konieczne, a także brak talentu w koordynacji akcesoriów (środkowe zdjęcie poniżej), oraz tendencja do używania linii włosów jako początku improwizowanego kapelusza (trzecie zdjęcie poniżej).

Trzecia metoda, na którą zwraca uwagę badacz, to nałożenie zdjęć (przykład można zobaczyć w naszym artykule z sierpnia na temat diagnostyki zaburzeń zdrowia psychicznego za pomocą oceny wyrazu twarzy AI), która wykorzystuje oprogramowanie do komponowania “scalania obrazów” takie jak seria CombineZ, aby połączyć wiele obrazów w jeden, często ujawniając podstawowe podobieństwa w strukturze – potencjalne wskazanie syntetyzowania.

Architektura proponowana w nowym artykule nosi tytuł (możliwe przeciwko wszelkim radom SEO) Blade Runner, nawiązując do testu Voight-Kampff, który określa, czy antagonistyczne postacie w franczyzie sci-fi są “fałszywe”, czy nie.

Potok składa się z dwóch faz, z których pierwsza to analyzer PapersPlease, który może ocenić dane pobrane z znanych witryn twarzy GAN, takich jak thispersondoesnotexist.com lub generated.photos.

Chociaż wersja kodu może być zbadana na GitHub (patrz poniżej), niewiele szczegółów jest dostarczonych na temat tego modułu, poza tym, że OpenCV i DLIB są używane do zaznaczenia i wykrycia twarzy w zebranym materiale.

Drugi moduł to AmongUs detektor. System jest zaprojektowany do wyszukiwania skoordynowanego umieszczenia oczu na zdjęciach, trwałej cechy wyjścia twarzy StyleGAN, typowej w scenariuszu “Brady Bunch” opisanym powyżej. AmongUs jest napędzany przez standardowy detektor 68 punktów.

Adnotacje punktów twarzy za pomocą Intelligent Behaviour Understanding Group (IBUG), których kod do wykresu punktów twarzy jest używany w pakiecie Blade Runner.

AmongUs opiera się na wstępnie wyuczonych punktach orientacyjnych na podstawie znanych współrzędnych “Brady Bunch” z PapersPlease i jest przeznaczony do użycia przeciwko żywym, internetowym próbkom obrazów twarzy opartych na StyleGAN.

Blade Runner, autor sugeruje, jest rozwiązaniem plug-and-play przeznaczonym dla firm lub organizacji, które nie mają zasobów, aby rozwijać rozwiązania wewnętrzne do wykrywania deepfake’ów, i “środka zapobiegawczego, aby kupić czas na bardziej trwałe przeciwdziałania”.

W istocie, w sektorze bezpieczeństwa, który jest tak lotny i dynamiczny, nie ma wielu rozwiązań na zamówienie lub gotowych rozwiązań chmurowych, do których firma z ograniczonymi zasobami może obecnie zwrócić się z zaufaniem.

Chociaż Blade Runner działa słabo przeciwko okularowym fałszywym osobom StyleGAN, jest to dość powszechny problem w podobnych systemach, które oczekują, że będą mogły ocenić kontury oczu jako punkty odniesienia, zaciemnione w takich przypadkach.

Zmniejszona wersja Blade Runner została opublikowana na GitHub. Bardziej rozbudowana wersja własnościowa istnieje, która może przetwarzać wiele zdjęć, a nie pojedyncze zdjęcie na operację w repozytorium open source. Autor zamierza, mówi, uaktualnić wersję GitHub do tego samego standardu, gdy tylko pozwoli na to czas. Przyznaje również, że StyleGAN najprawdopodobniej ewoluować będzie poza swoimi znanymi lub bieżącymi słabościami, a oprogramowanie również będzie musiało się rozwijać wraz z nim.

DE-FAKE

Architektura DE-FAKE ma na celu nie tylko osiągnięcie “uniwersalnego wykrywania” dla obrazów wyprodukowanych przez modele dyfuzji tekst-obraz, ale także dostarczenie metody do rozróżnienia, który model dyfuzji latentnej wygenerował obraz.

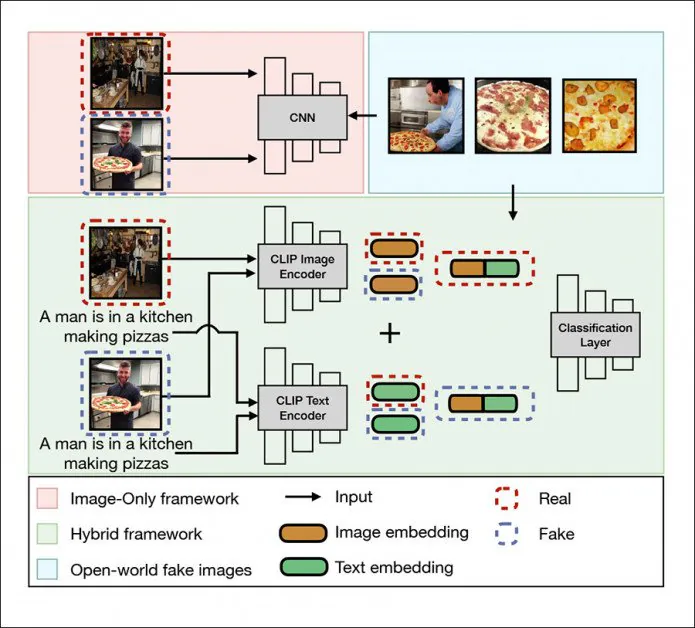

Uniwersalna ramka wykrywania w DE-FAKE zajmuje się lokalnymi obrazami, hybrydową ramą (zieloną) i obrazami ze świata otwartego (niebieską). Źródło: http://export.arxiv.org/pdf/2210.06998

Być może, w tym momencie, jest to dość prosta zadanie, ponieważ wszystkie popularne modele LD mają znaczące cechy różnicujące.

Ponadto, większość z nich dzieli pewne wspólne słabości, takie jak skłonność do obcinania głów, z powodu dowolnego sposobu, w jaki niekwadratowe obrazy zebrane z sieci są wprowadzane do ogromnych zbiorów danych, które napędzają systemy takie jak DALL-E 2, Stable Diffusion i MidJourney:

Modele dyfuzji latentnej, podobnie jak wszystkie modele widzenia komputerowego, wymagają wejścia w formacie kwadratowym; ale agregatywny webscraping, który napędza zestaw danych LAION5B, nie oferuje żadnych “luksusowych dodatków”, takich jak możliwość rozpoznawania i koncentrowania się na twarzach (lub czymkolwiek innym), i brutalnie przycina obrazy zamiast wypełniać je (co zachowałoby całe źródłowe zdjęcie, ale w niższej rozdzielczości). Źródła: https://blog.novelai.net/novelai-improvements-on-stable-diffusion-e10d38db82ac i Stable Diffusion.

DE-FAKE jest przeznaczony do bycia algorytmicznie niezależnym, długo pożądanym celem badaczy autoencoderów przeciwdziałających deepfake’om, i teraz, w odniesieniu do systemów LD, jest to dość osiągalne.

Architektura wykorzystuje bibliotekę multimodalną OpenAI Contrastive Language-Image Pretraining (CLIP) jako sposób na wyodrębnienie osadzeń z “sfałszowanych” obrazów LD i przeszkolenie klasyfikatora na obserwowanych wzorcach i klasach.

W bardziej “czarnej skrzynce” scenariuszu, gdzie chunki PNG, które przechowują informacje o procesie generowania, zostały dawno usunięte przez procesy uploadu i z innych powodów, badacze wykorzystują ramę BLIP od Salesforce (również składnik w co najmniej jednej dystrybucji Stable Diffusion), aby “ślepo” przepytać obrazy o prawdopodobnej strukturze semantycznej podpowiedzi, które je wygenerowały.

Badacze wykorzystali Stable Diffusion, Latent Diffusion (samodzielny produkt), GLIDE i DALL-E 2, aby zaludnić zestaw danych szkoleniowych i testowych, wykorzystując MSCOCO i Flickr30k.

Zwykle przyjrzeliśmy sięby bardzo dokładnie wynikom eksperymentów badaczy dla nowej ramy; ale w istocie, wyniki DE-FAKE wydają się bardziej użyteczne jako przyszły punkt odniesienia dla późniejszych iteracji i podobnych projektów, niż jako znacząca miara sukcesu projektu, biorąc pod uwagę lotny środowisko, w którym działa, i że system, z którym konkurował w próbach artykułu, jest prawie trzy lata starszy – z powrotem, kiedy scena syntezy obrazu była naprawdę pierwotna.

Dwa lewe obrazy: poprzednia ramka, pochodząca z 2019 roku, przewidywalnie radzi sobie gorzej przeciwko DE-FAKE (dwa prawe obrazy) w czterech testowanych systemach LD.

Wyniki zespołu są przytłaczająco pozytywne z dwóch powodów: jest niewiele poprzednich prac, z którymi można by je porównać (i żadnej, która oferowałaby uczciwe porównanie, tj. która obejmowałaby zaledwie dwanaście tygodni od momentu, gdy Stable Diffusion został opublikowany na licencji open source).

Po drugie, jak wspomniano powyżej, chociaż pole syntezy obrazu LD rozwija się w tempie wykładniczym, zawartość wyjściowa bieżących ofert skutecznie “znakuje” sama siebie dzięki własnym strukturalnym (i bardzo przewidywalnym) słabościom i ekscentrycznościom – wiele z nich prawdopodobnie zostanie usuniętych w przypadku Stable Diffusion, przynajmniej przez wydanie lepiej wykonującego się punktu kontrolnego 1.5 (tj. modelu 4GB, który napędza system).

Jednocześnie Stability.ai już sygnalizował, że ma wyraźną mapę drogową dla wersji 2 i 3 systemu. Biorąc pod uwagę nagłówki z ostatnich trzech miesięcy, każda bierność korporacyjna ze strony OpenAI i innych konkurentów w przestrzeni syntezy obrazu została najwyraźniej rozwiązana, co oznacza, że można oczekiwać podobnego tempa postępu również w przestrzeni syntezy obrazu o zamkniętym źródle.

Pierwotnie opublikowano 14 października 2022.