Cyberbezpieczeństwo

Dlaczego ataki na obrazy przeciwnika nie są żartem

Atakowanie systemów rozpoznawania obrazów za pomocą starannie przygotowanych obrazów przeciwnika było uważane za zabawną, ale trywialną demonstrację możliwości przez ostatnie pięć lat. Jednak nowe badania z Australii sugerują, że niefrasobliwe używanie bardzo popularnych zbiorów danych obrazów w komercyjnych projektach AI może stworzyć trwały nowy problem bezpieczeństwa.

Przez kilka lat grupa akademików z Uniwersytetu w Adelajdzie próbuje wyjaśnić coś bardzo ważnego o przyszłości systemów rozpoznawania obrazów opartych na AI.

To coś, co byłoby trudne (i bardzo drogie) do naprawienia teraz, i które byłoby niezwykle kosztowne do naprawienia, gdy obecne trendy w badaniach nad rozpoznawaniem obrazów zostaną w pełni rozwinęte w komercyjne i przemysłowe wdrożenia w ciągu 5-10 lat.

Przed tym, jak się w to zagłębimy, przyjrzyjmy się kwiatowi, który jest klasyfikowany jako prezydent Barack Obama, z jednego z sześciu filmów, które zespół opublikował na stronie projektu:

Źródło: https://www.youtube.com/watch?v=Klepca1Ny3c

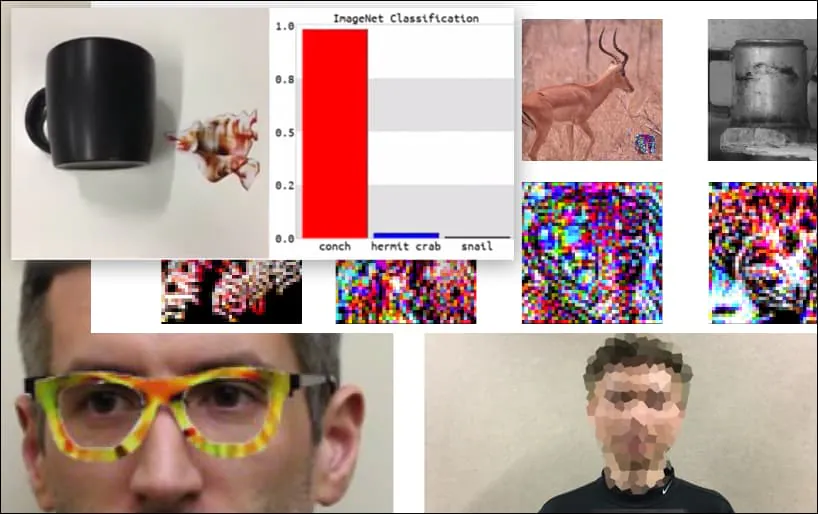

Na powyższym obrazie system rozpoznawania twarzy, który wyraźnie wie, jak rozpoznać Baracka Obamę, jest oszukany i z 80% pewnością, że anonimowy mężczyzna trzymający spreparowany, wydrukowany obraz przeciwnika jest również Barack Obama. System nie dba o to, że “fałszywa twarz” jest na piersiach osoby, a nie na ramionach.

Chociaż jest imponujące, że badacze byli w stanie osiągnąć ten rodzaj przechwycenia tożsamości, generując spójny obraz (kwiat) zamiast zwykłego szumu losowego, wydaje się, że takie głupie eksploity, jak ten, pojawiają się dość regularnie w badaniach bezpieczeństwa nad widzeniem komputerowym. Na przykład, te dziwne okulary z wzorami, które były w stanie oszukać rozpoznawanie twarzy w 2016 roku, lub specjalnie spreparowane obrazy przeciwnika, które próbują zmienić znaczenie znaków drogowych.

Jeśli jesteś zainteresowany, model CNN atakowany w powyższym przykładzie to VGGFace (VGG-16), wytrenowany na zbiorze danych PubFig z Uniwersytetu Columbia. Inne próbki ataków opracowane przez badaczy wykorzystywały różne zasoby w różnych kombinacjach.

Klawiatura jest ponownie sklasyfikowana jako muszla, w modelu WideResNet50 na ImageNet. Badacze upewnili się również, że model nie ma skłonności do muszli. Zobacz pełny film, aby uzyskać dodatkowe demonstracje na https://www.youtube.com/watch?v=dhTTjjrxIcU

Rozpoznawanie obrazów jako nowy wektor ataku

Wiele imponujących ataków, które badacze przedstawiają i ilustrują, nie są krytyką poszczególnych zbiorów danych lub konkretnych architektur sztucznej inteligencji, które je wykorzystują. Nie mogą one być również łatwo obronione przez zmianę zbiorów danych lub modeli, ponowne trenowanie modeli lub jakiekolwiek inne “łatwe” środki, które powodują, że praktycy ML lekceważą okazjonalne demonstracje tego rodzaju sztuczek.

Zamiast tego, eksploity zespołu z Adelajdy ilustrują centralną słabość w całej obecnej architekturze rozwoju AI do rozpoznawania obrazów; słabość, która może być narażona na łatwą manipulację przez atakujących i może umieścić wszelkie późniejsze środki obronne w defensywie.

Wyobraź sobie najnowsze obrazy ataków przeciwnika (takie jak kwiat powyżej) dodane jako “zero-day exploits” do systemów bezpieczeństwa przyszłości, tak jak bieżące ramy antywirusowe i przeciwmalware aktualizują swoje definicje wirusów każdego dnia.

Potencjał nowych ataków na obrazy przeciwnika byłby nieograniczony, ponieważ podstawowa architektura systemu nie przewidziała problemów, które pojawią się w przyszłości, tak jak to miało miejsce z internetem, błędem tysiąclecia i przechylającą się wieżą w Pizie.

W jaki sposób zatem tworzymy tę sytuację?

Pobieranie danych do ataku

Obrazy przeciwnika, takie jak przykład “kwiatu” powyżej, są generowane przez dostęp do zbiorów danych, które wytrenowały modele komputerowe. Nie potrzebujesz “prywatnego” dostępu do danych szkoleniowych (lub architektur modeli), ponieważ najpopularniejsze zbiory danych (i wiele wytrenowanych modeli) są powszechnie dostępne w silnym i stale aktualizowanym scenariuszu.

Na przykład, potężny Goliath zbiorów danych komputerowego widzenia, ImageNet, jest dostępny do pobrania za pomocą Torrent we wszystkich swoich wielu iteracjach, omijając jego zwyczajowe ograniczenia, i udostępniając kluczowe elementy wtórne, takie jak zbiory walidacyjne.

Źródło: https://academictorrents.com

Jeśli masz dane, możesz (jak zauważają badacze z Adelajdy) skutecznie “odwrócić inżynierię” każdy popularny zbiór danych, taki jak CityScapes lub CIFAR.

W przypadku PubFig, zbioru danych, który umożliwił “kwiat Obamy” w poprzednim przykładzie, Uniwersytet Columbia zajmuje się rosnącym trendem w kwestiach praw autorskich związanych z redystrybucją zbiorów danych obrazów, instruując badaczy, jak odtworzyć zbiór danych za pomocą wyselekcjonowanych linków, zamiast udostępniać skompilowany zbiór danych bezpośrednio, obserwując ‘Wygląda na to, że tak rozwijają się inne duże bazy danych internetowe’.

W większości przypadków nie jest to konieczne: Kaggle szacuje, że dziesięć najpopularniejszych zbiorów danych obrazów w komputerowym widzeniu to: CIFAR-10 i CIFAR-100 (oba bezpośrednio pobieralne); CALTECH-101 i 256 (oba dostępne i obecnie dostępne jako torrenty); MNIST (oficjalnie dostępny, również na torrentach); ImageNet (patrz powyżej); Pascal VOC (dostępny, również na torrentach); MS COCO (dostępny i na torrentach); Sports-1M (dostępny); i YouTube-8M (dostępny).

Dostępność ta jest również reprezentatywna dla szerszego zakresu dostępnych zbiorów danych komputerowego widzenia, ponieważ niejasność jest śmiercią w kulturze rozwoju open source “opublikuj lub zgiń”.

W każdym razie, rzadkość zarządzalnych nowych zbiorów danych, wysoki koszt tworzenia zbiorów obrazów, uzależnienie od “starych ulubieńców” i tendencja do po prostu adaptacji starszych zbiorów danych wszystko to pogarsza problem przedstawiony w nowym artykule z Adelajdy.

Typowe krytyki metod ataków na obrazy przeciwnika

Najczęstsza i najbardziej wytrwała krytyka inżynierów machine learning wobec skuteczności najnowszej techniki ataku na obrazy przeciwnika polega na tym, że atak jest specyficzny dla konkretnego zbioru danych, konkretnego modelu lub obu; że nie jest “uogólnialny” do innych systemów; i w związku z tym reprezentuje tylko trywialne zagrożenie.

Drugą najczęstszą skargą jest to, że atak na obrazy przeciwnika jest ‘biała skrzynka’, co oznacza, że potrzebujesz bezpośredniego dostępu do środowiska szkoleniowego lub danych. Jest to niezwykle nieprawdopodobny scenariusz, w większości przypadków – na przykład, jeśli chciałbyś wykorzystać proces szkolenia dla systemów rozpoznawania twarzy londyńskiej policji metropolitalnej, musiałbyś włamać się do NEC, albo za pomocą konsoli, albo toporem.

Długoterminowe “DNA” popularnych zbiorów danych komputerowego widzenia

Odnośnie do pierwszej krytyki, powinniśmy rozważyć nie tylko to, że zaledwie garstka zbiorów danych komputerowego widzenia dominuje w branży rok w rok (tj. ImageNet dla wielu typów obiektów, CityScapes dla scen drogowych i FFHQ dla rozpoznawania twarzy); ale również to, że jako proste dane obrazów z adnotacjami, są one “niezależne od platformy” i bardzo przenośne.

W zależności od ich możliwości, każda architektura szkolenia komputerowego widzenia znajdzie jakiś cechy obiektów i klas w zbiorze danych ImageNet. Niektóre architektury mogą znaleźć więcej cech niż inne, lub nawiązać więcej użytecznych połączeń niż inne, ale wszystkie powinny znaleźć co najmniej najwyższe cechy:

To “wysokie poziomy” cech, które różnicują i “odciskają palce” zbiór danych, i które są niezawodnymi “hakami”, na których można zawiesić długoterminową metodologię ataku na obrazy przeciwnika, która może przechodzić przez różne systemy i rozwijać się wraz z “starym” zbiorem danych, gdy ten jest kontynuowany w nowych badaniach i produktach.

Bardziej zaawansowana architektura wyprodukuje bardziej dokładne i drobne identyfikacje, cechy i klasy:

Jednakże, im więcej generator ataku na obrazy przeciwnika opiera się na tych niższych cechach (tj. “Młody mężczyzna pochodzenia kaukaskiego” zamiast “Twarz”), tym mniej skuteczny będzie w przechodzeniu przez architektury, które wykorzystują inne wersje oryginalnego zbioru danych – takie jak podzbiór lub przefiltrowany zbiór, w którym wiele oryginalnych obrazów z pełnego zbioru danych nie jest obecnych:

Ataki na obrazy przeciwnika na “wyzerowanych”, wstępnie wytrenowanych modelach

Co z przypadkami, w których po prostu pobierasz wstępnie wytrenowany model, który był pierwotnie wytrenowany na bardzo popularnym zbiorze danych, i dajesz mu całkowicie nowe dane?

Model został już wytrenowany na (na przykład) ImageNet, i wszystko, co pozostaje, to wagi, które mogły zajmować tygodnie lub miesiące szkolenia, i są teraz gotowe pomóc ci zidentyfikować podobne obiekty do tych, które istniały w oryginalnych (teraz nieobecnych) danych.

Z oryginalnymi danymi usuniętymi z architektury szkoleniowej, pozostaje ‘predyspozycja’ modelu do klasyfikowania obiektów w sposób, w jaki pierwotnie się nauczył, co w zasadzie spowoduje, że wiele oryginalnych ‘sygnatur’ odtworzy się i stanie się ponownie podatnym na te same stare metody ataków na obrazy przeciwnika.

Te wagi są cenne. Bez danych lub wag, masz w zasadzie pustą architekturę bez danych. Będziesz musiał ją wytrenować od początku, przy ogromnym nakładzie czasu i zasobów obliczeniowych, tak jak pierwotni autorzy (prawdopodobnie na bardziej potężnym sprzęcie i z wyższym budżetem niż masz do dyspozycji).

Problem polega na tym, że wagi są już dość dobrze ukształtowane i odporne. Chociaż będą się nieco adaptować w trakcie szkolenia, będą zachowywać się podobnie na twoich nowych danych, jak na oryginalnych danych, wytwarzając sygnatury cech, na które system ataku na obrazy przeciwnika może ponownie zareagować.

W długiej perspektywie, to również zachowuje “DNA” zbiorów danych komputerowego widzenia, które są dwanaście lub więcej lat stare, i mogły przejść przez znaczącą ewolucję od otwartych źródeł przez komercyjne wdrożenia – nawet w przypadku, gdy oryginalne dane szkoleniowe zostały całkowicie usunięte na początku projektu. Niektóre z tych komercyjnych wdrożeń mogą nie nastąpić przez kilka lat.

Brak białej skrzynki

Odnośnie do drugiej powszechnej krytyki systemów ataków na obrazy przeciwnika, autorzy nowego artykułu odkryli, że ich zdolność do oszukania systemów rozpoznawania z pomocą spreparowanych obrazów kwiatów jest bardzo przenośna na wiele architektur.

Podczas obserwowania, że ich metoda “Universal NaTuralistic adversarial paTches” (TnT) jest pierwszą, która wykorzystuje rozpoznawalne obrazy (zamiast szumu losowego) do oszukania systemów rozpoznawania obrazów, autorzy stwierdzają:

‘[TnTs] są skuteczne przeciwko wielu najnowocześniejszym klasyfikatorom, od powszechnie używanego WideResNet50 w zadaniu dużej skali rozpoznawania wizualnego ImageNet do modeli VGG-face w zadaniu rozpoznawania twarzy PubFig w obu celowanych i niecelowanych atakach.

‘TnTs mogą posiadać: i) naturalizm osiągalny [z] wyzwaniami używanymi w metodach ataku Trojan; i ii) uogólnialność i przenośność przykładów przeciwnika do innych sieci.

‘To podnosi obawy dotyczące bezpieczeństwa i already wdrożonych DNN, a także przyszłych wdrożeń DNN, w których atakujący mogą używać niewidocznych, naturalnie wyglądających łat, aby wprowadzać w błąd systemy neuronowe bez ingerencji w model i ryzyka odkrycia.’

Autorzy sugerują, że konwencjonalne środki obronne, takie jak pogorszenie czystej dokładności sieci, mogą teoretycznie zapewnić pewną ochronę przed łatami TnT, ale że ‘TnTs nadal mogą pomyślnie ominąć te SOTA provable defense methods z większością systemów obronnych, które osiągają 0% wytrzymałości’.

Możliwe rozwiązania obejmują federated learning, w którym pochodzenie obrazów jest chronione, oraz nowe podejścia, które mogą bezpośrednio “zaszyfrować” dane w czasie szkolenia, takie jak niedawno zaproponowane przez Uniwersytet Aeronautyki i Astronautyki w Nanjing.

Nawet w tych przypadkach ważne byłoby trenowanie na prawdziwie nowych danych obrazów – obecnie obrazy i powiązane adnotacje w małej grupie najpopularniejszych zbiorów danych CV są tak głęboko osadzone w cyklach rozwojowych na całym świecie, że przypominają oprogramowanie, a nie dane; oprogramowanie, które często nie zostało znacząco zaktualizowane od lat.

Podsumowanie

Ataki na obrazy przeciwnika są możliwe nie tylko dzięki praktykom open source machine learning, ale także dzięki kulturze rozwoju AI, która jest zmotywowana do ponownego wykorzystania dobrze ugruntowanych zbiorów danych komputerowego widzenia z kilku powodów: są one już skuteczne; są o wiele tańsze niż “rozpoczynanie od zera”; i są utrzymywane i aktualizowane przez pionierów i organizacje w całej akademii i przemyśle, na poziomach finansowania i personelu, które byłyby trudne do replikacji przez jedną firmę.

Ponadto, w wielu przypadkach, w których dane nie są oryginalne (np. CityScapes), obrazy zostały zebrane przed niedawnymi kontrowersjami wokół praktyk prywatności i gromadzenia danych, pozostawiając te starsze zbiory danych w rodzaju półprawnej limbo, które mogą wyglądać jak “bezpieczna przystań” z punktu widzenia firmy.

TnT Attacks! Universal Naturalistic Adversarial Patches Against Deep Neural Network Systems jest współautorem Bao Gia Doan, Minhui Xue, Ehsan Abbasnejad, Damith C. Ranasinghe z Uniwersytetu w Adelajdzie, wraz z Shiqing Ma z Wydziału Informatyki na Uniwersytecie Rutgers.

Zaktualizowano 1 grudnia 2021, 7:06 GMT+2 – poprawiono błąd.