Kąt Andersona

Używanie ‘prawdopodobieństwa’ jako metryki wykrywania Deepfake

Jeśli AI-generowane wideo i audio staną się wystarczająco dobre, wykrywacze deepfake oparte na artefaktach wizualnych lub innych tradycyjnych sygnałach nie będą już działać. Ale biorąc pod uwagę, jak rzadko ludzie odbiegają od przewidywalnego zachowania, być może ‘prawdopodobieństwo’ mogłoby być przyjęte głębiej jako sygnał, czy wideo lub plotka jest prawdopodobnie prawdziwa.

Opinia Na początku lat 90-tych, szanowany były brytyjski piłkarz i komentator sportowy David Icke przypadkowo ujawnił w programie talk-show, że jest ‘synem Boga’ – dziwacznym i nieoczekiwanym objawieniem, które ewoluowałoby w ciągu następnych dekad w trwałą i rozwiniętą teorię spisku o tajemniczym i potężnym globalnym klanie ‘ludzi-jaszczurów’.

Z adoptowaniem internetu wciąż kilka lat w przyszłości, a nadejściem mediów społecznościowych jeszcze dalej w przyszłości, ogromna dyssonans między sławą Icke’a a naturą jego nowych spostrzeżeń miała głęboki wpływ na brytyjską publiczność – nie tylko ze względu na całkowity brak kontekstu lub jakiegokolwiek rodzaju przygotowania do tego ogromnego zwrotu, od znanej i ugruntowanej osobowości sportowej.

Ponad dwadzieścia lat później, podobna i o wiele ciemniejsza odsłona tego społecznego szoku wystąpiła, gdy ukochany aktywista charytatywny i prezenter programu dla dzieci Jimmy Savile został pośmiertnie uznany za seryjnego i żarłocznego sprawcę przestępstw na tle seksualnym przez całe życie, który wykorzystywał swój niewinny publiczny wizerunek, aby ułatwić swoje zbrodnie.

Późniejsze śledztwo policyjne Operation Yewtree ujawniłoby wielu więcej brytyjskich celebrytów z długimi historiami przestępstw na tle seksualnym; później, proces Harveya Weinsteina doprowadziłby do podobnego odkrycia celebrytów-sprawców przestępstw na tle seksualnym w USA, ewoluując w ruch #metoo, i na stałe wkomponowując się w amerykańską kulturę w programach takich jak The Morning Show. ‘Szokujące’ wiadomości zdawały się rozwijać nowy i nagły szablon – jeden, który ostatecznie zostałby przyjęty przez atakujących deepfake.

Koniec ‘tradycyjnego’ wykrywania Deepfake?

Nawet gdyby media społecznościowe i AI były dostępne w początku lat 90-tych, żaden system predykcyjny na świecie nie mógłby przewidzieć objawień Icke’a w programie talk-show, które (jak dobrze pamiętam) nie były w żaden sposób zapowiedziane w latach poprzedzających to wydarzenie.

Ale gdyby AI było dostępne, mogłoby to zająć trochę czasu, aby przekonać szerszą publiczność, że deklaracje Icke’a nie były produktem Google Veo 3, czy innego nowego rodzaju hiper-realnych frameworków audio/wideo deepfake.

To dopiero w ciągu ostatnich 6-12 miesięcy, że metody AI deepfake stały się wystarczająco skuteczne, aby spełnić lata medialnych przepowiedni o deepfake’ach w wyborach, i zdolne do generowania rodzaju szybkiego uderzenia w reputację, które jest fałszywe, ale trudne do wymazania w coraz bardziej naiwnej kulturze.

Do tej pory, wyjście wideo AI zwykle nie osiąga prawdziwego realizmu, ograniczone przez przeszkody techniczne i coraz bardziej spolaryzowane przez rosnącą lukę między restrykcyjnymi modelami zachodnimi a chińskimi otwartymi wydaniami źródłowymi**.

Niemniej, zauważam coraz częściej w literaturze badawczej zbliżającą się koncesję tej zimnej wojny, na przykład w nowym artykule Performance Decay in Deepfake Detection†:

‘[Przyjmujemy, że deepfake filmy będą nadal zawierać funkcje uczące maszyn, które niezawodnie odróżniają je od prawdziwych filmów. W miarę jak możliwości generatywnego AI będą się szybko rozwijać, to założenie może się rozpaść.

‘W takim scenariuszu, znakowanie wodne i inne metody śledzenia pochodzenia będą oferować jedyną możliwość utrzymania zaufania do mediów cyfrowych.’

Jednak ten sam artykuł uznaje, że rozwiązania oparte na pochodzeniu, takie jak inicjatywa Content Authenticity Initiative prowadzona przez Adobe (i wiele mniejszych badań ofert z ostatnich 7-8 lat) wymagają tak szerokiej adopcji, aby były niewiarygodne; i artykuł kończy się na ogólnym tonie odwrotu, jeśli nie porażki.

Jeśli metody wykrywania deepfake audio-wizualnego są przewyższone przez generatywne AI, a globalna adopcja inwazyjnego systemu znakowania wodnego lub śledzenia pochodzenia pada na różne logistyczne przeszkody, jaki powszechny centralny element mógłby zastąpić je jako wskaźniki potencjalnie sfałszowanych danych? Czy musimy się poddać światu, w którym wszystkie media są wątpliwe, a Liar’s Dividend przeważa?

Graphy wiedzy

Wydaje się, że nadszedł czas, aby głębiej wykorzystać prawdopodobieństwo i prawdopodobieństwo ‘zgłaszanych zdarzeń’ jako charakterystyczny sygnał w wykrywaniu deepfake. Ponadto, ponieważ systemy generatywne AI wideo i audio są coraz bardziej zbieżne, może również nadszedł czas, aby oddzielne nurty badań ‘fałszywych wiadomości’ (jako narracyjne wydarzenie oparte na tekście) i fałszywych obrazów/wideo również zbiegły się.

Metoda prawdopodobieństwa deepfake nie jest taka sama jak RAG-pomagana weryfikacja faktów, gdzie model AI może przywołać bieżące wyniki wyszukiwania, aby uzyskać wiedzę o zdarzeniach, które wystąpiły po jego kolumnie daty, i/lub potwierdzić swoje twierdzenia.

Zamiast tego, wykonywałoby przewidywania na podstawie ogólnie wskazujących trendów statystycznych, pochodzących z historycznych wzorców, które są zgodne z bieżącym zapytaniem.

W tym sensie, metoda prawdopodobieństwa jest bliższa analizie statystycznej niż nowocześniejszym wątkom w bieżącej scenie machine learning.

Chociaż wcześniej zaćmione przez bardziej nowoczesne podejścia z epoki Transformer, graphy wiedzy robią pewnego rodzaju powrót w przestrzeni przedsiębiorstw, i wydają się dostosowane do potencjalnego wdrożenia ‘prawdopodobieństwa’ metryk w wykrywaniu deepfake.

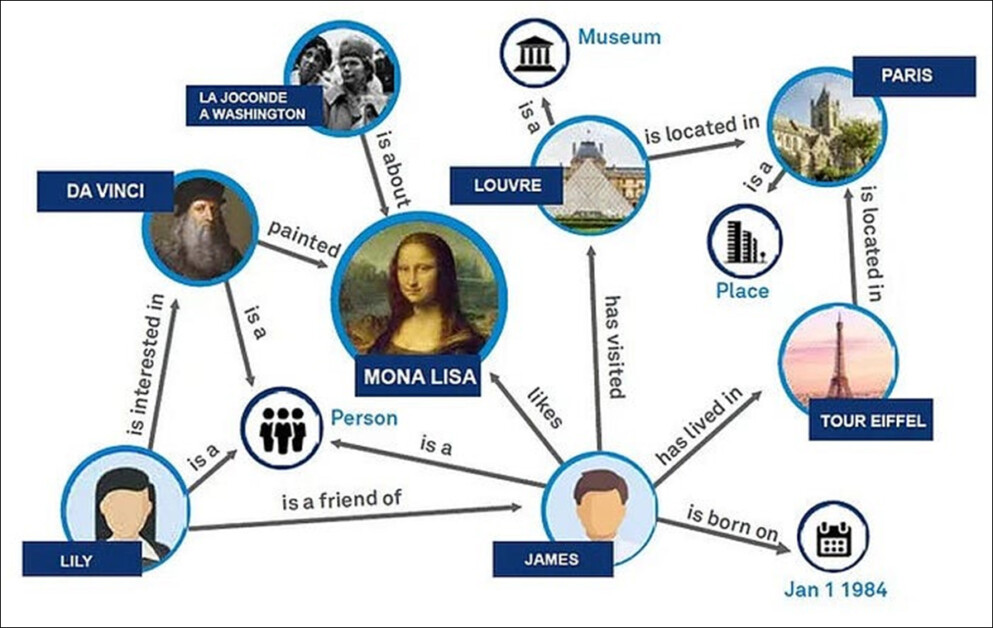

Uproszczony graf wiedzy ilustrujący, jak ludzie, miejsca, dzieła sztuki i wydarzenia mogą być połączone za pomocą opisanych relacji, umożliwiając maszynom rozumowanie nad rzeczywistymi encjami i ich połączeniami. Źródło

Graf wiedzy jest sposobem organizacji informacji poprzez mapowanie rzeczywistych rzeczy, takich jak ludzie, firmy, wydarzenia lub idee, w sieć połączonych faktów.

Każda pod-encja jest węzłem, a połączenia między nimi (krawędzie) opisują, jak się ze sobą wiążą. Na przykład ‘Microsoft’ (węzeł) może być połączony z ‘OpenAI’ (innym węzłem) przez krawędź, która mówi ‘jest klientem’. Te połączenia są często przechowywane w bazach danych grafów i podążają za strukturą podmiot-przedmiot, taką jak ‘Microsoft jest klientem OpenAI’.

Pamięć trwała

Jeden chiński badanie z września tego roku zaproponowało metodę bez szkolenia, która wykorzystuje graficzne rozumnienie, aby wykryć subtelne niekonsekwencje w multimodalnych deepfake’ach.

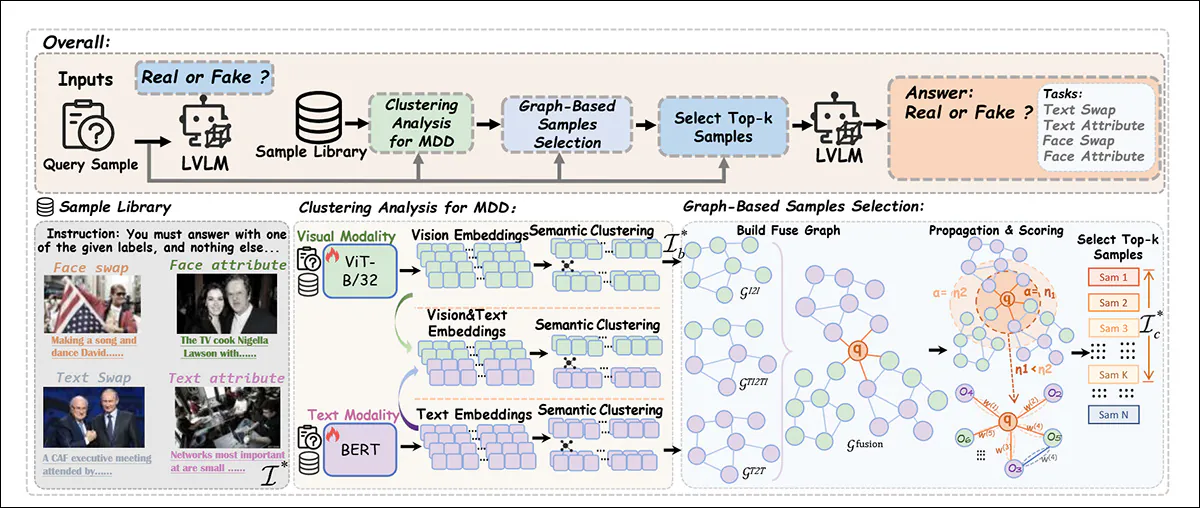

Zamiast generowania uzasadnień lub dokształcania dużych modeli, system pobiera pary obrazu i tekstu, buduje graf podobieństwa i ocenia połączenia, aby pobrać najbardziej istotne przykłady, i te prowadzą osąd modelu bez potrzeby nowego szkolenia:

Przegląd ramy GASP-ICL, która poprawia wykrywanie deepfake, łącząc graficzny wybór próbek z nauką w kontekście, umożliwiając zamrożonemu modelowi językowo-wizualnemu klasyfikację par obrazu/tekstu jako prawdziwych lub fałszywych, bez szkolenia lub dokształcania. Źródło

To jest prawdopodobnie najbliższa praca, która przeszła moją drogę, do ‘poinformowanego’ i świadomego historycznie podejścia do oceny i weryfikacji nowych danych multimedialnych. Dla większości, podejścia komputerowego widzenia nadal analizują obrazy (w tym ramki wideo i anomalie czasowe obejmujące wiele ramek) podczas gdy ramy wykrywania ‘fałszywych wiadomości’ nadal podkreślają dane oparte na tekście, nawet w multimodalnych projektach.

Przerost cech

Wyzwaniem systemu predykcyjnego tego rodzaju jest zakres nadzoru, który może być niezbędny, aby uczynić podejście w pełni wydajnym – przynajmniej poza analizą celebrytów i postaci publicznych, dla których już istnieją dostępne dane.

Prawdopodobnie najbardziej podobny bieżący wątek badań to dziedzina przestępstwa, która etykietyzuje różne sygnały wywiadowcze multimodalne jako ‘podejrzane’, i przedstawia się jako niezawodny strach na wróble AI w programach takich jak Person of Interest (2011-2016) i Minority Report (2002).

Chociaż system nadzoru w stylu Person of Interest wyprodukowałby optymalne wyniki, jest mało prawdopodobne, że zachodnia kultura mogłaby sankcjonować poziom osobistej inwazyjności, jaki chińskie sieci wewnętrzne nakładają na swoich obywateli.

Dlatego, w odniesieniu do potencjalnie fałszywych wiadomości o nie-celebrytach, tylko agencje rządowe, takie jak policja (oraz urzędy stanu cywilnego i urzędy skarbowe) miałyby wystarczająco istotne informacje historyczne, aby poinformować prawdopodobieństwa w graficznym przepływie pracy; i nawet one potrzebowalyby wolę, zdolność, ustawodawstwo i zasoby w stylu CCCP, aby objąć zwykłych obywateli w swoim zakresie i analizach (tj. poza banalnymi, ale obowiązkowymi punktami danych, takimi jak numery paszportów i rejestracje samochodów).

Ocena prawdopodobieństwa

Wydaje się, że potencjalna skuteczność systemu tego rodzaju byłaby ograniczona do najbardziej oczywistych (bieżących) przypadków użycia deepfake: destabilizacja (państwowe deepfake); celebrycki i ‘nieznany’ pornograficzny deepfake (które oba mogą być uważane za szkodliwe, chociaż drugi przypadek tendencję do przyciągania głębszych mediów); oszustwo (w tym audio/wideo deepfake zaprojektowane do wykonania ‘impersonacji“); i polityczna charakterobójstwo.

System oparty na wiedzy wymagałby skali prawdopodobieństwa dla różnorodnych możliwych zdarzeń. Na jednym końcu spektrum, powszechne ludzkie słabości, takie jak wątpliwa zarządzanie finansami, niewierność, uzależnienie, nieostrożność itp.; na drugim… ujawnienie, że jesteś synem Boga w żywej telewizyjnej rozmowie (lub zdarzenia podobnej skali i wpływu).

Nawet w tym drugim przypadku, czynniki historyczne osobiste dla każdej jednostki ważyłyby wynik prawdopodobieństwa: prominentna postać polityczna, która publicznie zwątpiła w kontrowersyjne sprawy (takie jak prawdziwość lądowań na Księżycu w latach 60-tych i 70-tych), aby zyskać kapitał z coraz bardziej ‘inaczej poinformowanym‘ elektoratem, mogłaby zyskać dodatkowy wildcard status w rutynach weryfikacji, w porównaniu z bardziej powściągliwymi kolegami.

W przypadku celebryckiego pornograficznego deepfake, istnieje wystarczający kontekst świata rzeczywistego (tj. 2012 celebryckie wycieki zdjęć, wśród innych – dość rzadkich – incydentów), aby wygenerować umiarkowany Liar’s Dividend, w pewnych kontekstach; ale ponieważ te incydenty outlier działają jako wyjątki potwierdzające regułę, większość bieżącej partii deepfake’ów wideo celebrytów byłaby uważana za ekstremalnie ‘nieprawdopodobne’ (chociaż to nie rozwiązuje problemu przywłaszczenia tożsamości ludzi do takich celów).

W kwestii narodowego zakłócenia, istnieje znaczna ilość danych statystycznych, które mogą pomóc w ocenianiu prawdopodobieństwa ‘katastrofalnych’ raportów. Nawet w starożytności, wybuch niezidentyfikowanego wulkanu Wezuwiusza w 79 roku n.e. został poprzedzony sejsmiczną aktywnością, jeśli tylko zwróciło się wystarczającą uwagę; i poza dostępnością wielu rządowych i NGO-wspieranych kanałów, rozwijająca się zdolność AI do wyodrębniania struktury z surowych danych może dostarczyć dodatkowy historyczny kontekst do oceny prawdopodobieństwa.

Podsumowanie

Nawet dobrze wdrożony system predykcyjny tego rodzaju nie mógłby uwzględnić przypadku, aktów Bożych, zdarzeń freak lub złośliwych zdarzeń wymyślonych poza wszelką kontrolą.

Ponadto, ogromny zakres i głębokość danych potrzebnych, aby zapewnić pokrycie również dla nieznanych ludzi, byłby punktem politycznym – przynajmniej na razie.

Jednak wybory zdają się się zacieśniać; analiza wizualna jest skazana na niepowodzenie w obliczu ulepszonych generatywnych AI, podczas gdy systemy weryfikacji i pochodzenia noszą obciążenie technicznego długu i tarcie przeciw adopcji. To sprawia, że rozwiązania takie jak inicjatywa Content Authenticity Initiative i niespełniony system Metaphysic.ai Metaphysic Pro są trudne do popularyzacji.

W ich najszerszym użyciu, systemy RAG-oparte mogą jedynie określić, czy źródło autorytatywne potwierdza niesprawdzoną twierdzenie; i ponieważ wiele dużych (prawdziwych) historii wiadomości pojawia się bez wcześniejszego kontekstu, brak potwierdzenia ze strony źródeł autorytatywnych niekoniecznie jest istotny.

Ich wartość może okazać się większa, jeśli mogą stanowić część większego ekosystemu danych zajmującego się tym, co najbardziej AI znajduje wyzwaniem – kontekstem historycznym.

* Nie mylić z wczesnymi autoencoder wersjami, które zadebiutowały w 2017 roku i ostatecznie zostały zastąpione przez lepsze podejścia.

† https://arxiv.org/abs/2511.07009

** Which can usually run freely on more powerful home PCs, instead of only being available via gate-kept APIs such as ChatGPT and the Veo series.

††† Omitting legitimate entertainment uses, such as professional visual effects in movie and TV productions.

Pierwotnie opublikowane w czwartek, 13 listopada 2025