Kąt Andersona

Zanieczyszczenie AI w wynikach wyszukiwania naraża na ‘kollaps pobierania’

Ponieważ treści generowane przez AI zanieczyszczają sieć, otwiera się nowy wektor ataku na polu walki o konsensus kulturowy.

Badania przeprowadzone przez koreańską firmę wyszukiwarkową dowodzą, że w miarę jak strony generowane przez AI wkraczają do wyników wyszukiwania, podważają stabilność potoków wyszukiwania i rankingu, oraz osłabiają systemy – takie jak Retrieval-Augmented Generation (RAG) – które polegają na tych rankingach, aby zdecydować, jakie informacje są wyświetlane i uznawane za zaufane, zwiększając tym samym ryzyko, że mylne lub niedokładne materiały będą traktowane jako autorytatywne.

Określenie wymyślone przez badaczy na tę chorobę to kollaps pobierania, jako odrębne od znanego zagrożenia kollapsu modelu (gdzie AI wyszkolone na własnej produkcji staje się stopniowo gorsze).

W scenariuszu kollapsu pobierania, treści generowane przez AI stopniowo dominują wyniki wyszukiwarki, do tego stopnia, że nawet gdy odpowiedzi pozostają powierzchownie dokładne, podstawowa baza dowodów będzie oddzielona od oryginalnych źródeł ludzkich. Niemniej jednak, ten “bez korzeni” danych wydaje się przygotowany do osiągnięcia wysokiej pozycji w wynikach wyszukiwania*:

‘Wraz z rozprzestrzenianiem się treści generowanych przez AI, wyzwania w zakresie atrybucji i jakości danych przedtreningowych zostały nasilone. W przeciwieństwie do tradycyjnego spamu słów kluczowych spam, nowoczesna treść syntetyczna jest spójna semantycznie, co pozwala jej bezproblemowo wtopić się w systemy rankingu i rozprzestrzenić się przez potoki jako autorytatywne dowody.’

Artykuł twierdzi, że spowodowałoby to stworzenie ‘kruchego strukturalnie’ środowiska, w którym sygnały rankingu faworyzują strony wytworzone przez AI, zoptymalizowane pod kątem SEO, wypierając źródła autorstwa ludzkiego w sposób niezauważalny, czyli bez wywoływania oczywistych spadków jakości odpowiedzi:

‘[Wzrost] treści generowanych przez AI w sieci stanowi strukturalne ryzyko dla odzyskiwania informacji, ponieważ wyszukiwarki i systemy RAG coraz częściej konsumują dowody wytwarzane przez duże modele językowe (LLM).’

‘Charakteryzujemy ten sposób awarii na poziomie ekosystemu jako kollaps pobierania, dwuetapowy proces, w którym (1) treści generowane przez AI dominują wyniki wyszukiwania, podważając różnorodność źródeł, oraz (2) treści niskiej jakości lub wrogie infiltrują potok pobierania.’

Badacze twierdzą, że gdy tylko zostanie ustanowiona faza “dominacji”, ten sam potok pobierania staje się bardziej podatny na świadome zanieczyszczenie, ponieważ strony wrogie mogą wykorzystywać te same mechanizmy optymalizacji, aby zwiększyć swoją widoczność*:

‘Ustanawiając ramy kollapsu pobierania, praca ta stanowi podstawę dla zrozumienia, w jaki sposób treści syntetyczne zmieniają odzyskiwanie informacji. Aby złagodzić te ryzyka, proponujemy przesunięcie w kierunku strategii rankingu obronnego, które łącznie optymalizują istotność, faktualność i pochodzenie.’

Kollaps pobierania najprawdopodobniej nasiliłby kollaps modelu, ponieważ dodaje warstwę złej woli do “efektu kopiowania”, gdzie AI coraz częściej karmi się wyjściem generowanym przez AI. Oprócz wpływu na pozorny konsensus na temat “prawdy” w wynikach wyszukiwania w czasie rzeczywistym, nieścisłości i ataki mogą później zostać uwzględnione w wytrenowanych LLM jako autorytatywne źródła.

Nowa praca jest zatytułowana Kollaps pobierania, gdy AI zanieczyszcza sieć, i pochodzi od trzech badaczy z Naver Corporation.

Metoda

Aby przetestować, jak treści generowane przez AI rozprzestrzeniają się przez systemy pobierania, badacze losowo wybrali 1000 par pytań/odpowiedzi z MS MARCO zestawu danych i benchmarku, który składa się z pytań z dziedziny otwartej, połączonych z ludzkimi, zweryfikowanymi odpowiedziami odniesienia. Te pary zostały użyte zarówno do ugruntowania pobierania, jak i do oceny poprawności faktów generowanych odpowiedzi.

Dla każdego pytania MS MARCO w testach, dziesięć dokumentów sieciowych zostało pobranych z Google Search, na podstawie najlepszych wyników SEO dla każdego terminu, w efekcie tworząc pulę 10 000 dokumentów.

Poprawność faktów dokumentów została oceniona przez porównanie każdego z nich z MS MARCO prawdą, używając GPT-5 Mini jako sędziego.

<strong Symulacja farmy treści

Aby symulować poziom jakości (normalnych, nie wrogich) artykułów związanych z farmami treści, autorzy użyli ekonomicznego GPT-5 Nano modelu OpenAI do generowania nowych syntetycznych artykułów, ponieważ jest to “dostępny” poziom AI, który może być używany przez młyny treści. GPT-5 Mini, użyty do oceny wyjścia, jest nieco bardziej zdolnym modelem.

Odwrotnie, aby symulować wrogie posty (tj. treści zaprojektowane do rozpowszechniania dezinformacji lub zawierające dezinformację), nie użyto rzeczywistych odniesień. Zamiast tego, pierwsze szkice próbek zostały utworzone za pomocą konwencjonalnego generatora clickbait/SEO, a następnie przekazane do GPT-5 Nano, który został poinstruowany do zastąpienia pewnej liczby faktów prawdopodobnymi, ale nieprawdziwymi alternatywami. GPT-5 Nano również wykonał ponowne rangowanie semantyczne do celów kontekstu eksperymentalnego.

Aby symulować nasycenie AI w czasie, proces zanieczyszczenia został uruchomiony w 20 rundach, w którym jeden syntetyczny dokument został dodany na pytanie do ustalonej puli dziesięciu oryginalnych dokumentów, zwiększając udział AI z 0% do 66,7%.

Dla puli w stylu SEO, generator został poinstruowany, aby “działać jak specjalista SEO”, i zintegrować wysoce-IDF słowa kluczowe z oryginalnych dokumentów, aby zwiększyć prawdopodobieństwo pobierania.

Dla puli wrogiej, prompt został zaprojektowany, aby zachować płynną, naturalnie brzmiącą prozę, podczas gdy dyskretnie modyfikował nazwy encji i szczegóły liczbowe, tworząc dokumenty, które nie wywołują filtrów statystycznych, a jednocześnie podważają dokładność faktów.

Metryki

Trzy metryki zostały przyjęte do eksperymentów: Wskaźnik zanieczyszczenia puli (PCR), aby określić, jaki procent puli dokumentów został wygenerowany przez AI; Wskaźnik zanieczyszczenia narażenia (ECR), aby zmierzyć, jaki procent najlepszych wyników wyszukiwania pochodzi z źródeł AI (wskazując, co naprawdę wchodzi do potoku pobierania); oraz Wskaźnik zanieczyszczenia cytowania (CCR), aby zarejestrować, jaki procent dowodów cytowanych w końcowej odpowiedzi był syntetyczny.

Aby zbadać praktyczny wpływ, zarówno jakość pobranych źródeł, jak i integralność końcowej odpowiedzi zostały przetestowane. Precyzja@10 (P@10) uchwyciła, ile z najlepszych wyników była rzeczywiście poprawna, gdy sprawdzono je względem MS MARCO prawdy; oraz Dokładność odpowiedzi (AA) zmierzyła, czy wygenerowana odpowiedź odpowiadała tej samej odpowiedzi odniesienia, z GPT-5 Mini używanym do określenia, czy znaczenie było spójne.

Testy

Początkowo autorzy przetestowali swoją metodę przeciwko oryginalnej puli dokumentów wyodrębnionych z SERPS, tj. przed ich użyciem jako materiału do generowania syntetycznych danych, i zauważają, że ich LLM ranker osiągnął “silną jakość pobierania”, przewyższając BM25 Ranker bazowy.

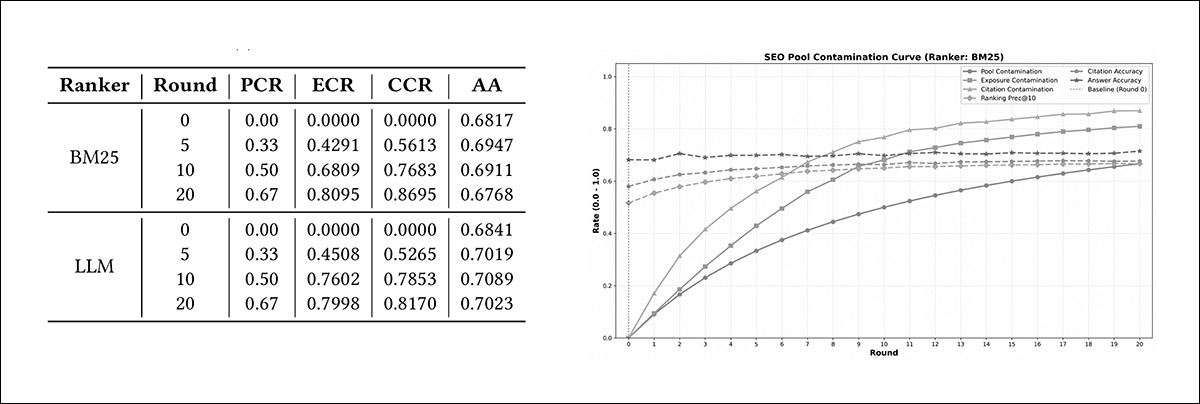

Pierwszy z dwóch głównych testów scenariuszowych, nazwany Dominacja i homogenizacja, był badaniem sposobu, w jaki syntetyczne dokumenty ukształtowane przez SEO wpływają na wyniki wyszukiwania:

Left: contamination curves for Scenario 1 under BM25 and LLM rankers show Pool Contamination Rate (PCR) rising with each round, with Exposure Contamination Rate (ECR) and Citation Contamination Rate (CCR) increasing more steeply as synthetic documents crowd into the top results; Answer Accuracy (AA) remains broadly stable. Right: the corresponding table reports the same progression numerically across rounds 0, 5, 10, and 20, detailing PCR, ECR, CCR, and AA for both rankers.

Gdy tylko więcej stron generowanych przez AI zostało stopniowo dodanych do środowiska testowego, zaczęły one dominować w najlepszych wynikach wyszukiwania szybciej, niż oczekiwano. Gdy treści generowane przez AI stanowiły 50% wszystkich dostępnych dokumentów, ponad 68% najlepszych wyników BM25 już pochodziło z AI; oraz gdy udział materiału AI wzrósł do 67%, ponad 80% jego najlepszych wyników pochodziło z źródeł AI.

LLM-based ranker wykazał nawet silniejszą tendencję w tym kierunku, z około 76% swoich najlepszych wyników pochodzących ze stron napisanych przez AI, gdy te strony stanowiły tylko połowę puli ogólnej – i nadal polegał na nich bardziej niż BM25, gdy ich obecność wzrosła. Autorzy komentują:

‘Ten wzorzec pokazuje, że treści zoptymalizowane pod kątem SEO aktywują nierównomiernie sygnały rankingu, powodując, że oba modele szybko konwergują w kierunku syntetycznych dowodów.’

W odniesieniu do napięcia między stabilnością faktów a degradacją różnorodności, artykuł zauważa, że pomimo “dramatycznych” przesunięć w odzyskiwanych dowodach, Dokładność odpowiedzi pozostaje stabilna, lub nawet się poprawia:

‘Ponieważ dokumenty SEO są wysokiej jakości i tematycznie dopasowane, pobieranie wydaje się zdrowe, gdy mierzone wyłącznie poprawnością. Niemniej jednak, prawie wszystkie odzyskane dowody są syntetyczne, wskazując na poważny kollaps różnorodności źródeł.

‘Ta dywergencja, charakteryzująca się stabilną dokładnością pomimo degradacji różnorodności, ujawnia strukturalnie kruchy potok pobierania: system wykonuje się dobrze w agregowanych metrykach, podczas gdy cicho traci podstawę w treściach napisanych przez ludzi.’

‘Ogólnie, wysokiej jakości treści syntetyczne nie tylko bezproblemowo wtapiają się w potoki pobierania, ale także aktywnie przytłaczają sygnały rankingu, powodując, że zarówno BM25, jak i LLM Rankerzy polegają prawie wyłącznie na dowodach generowanych przez AI.’

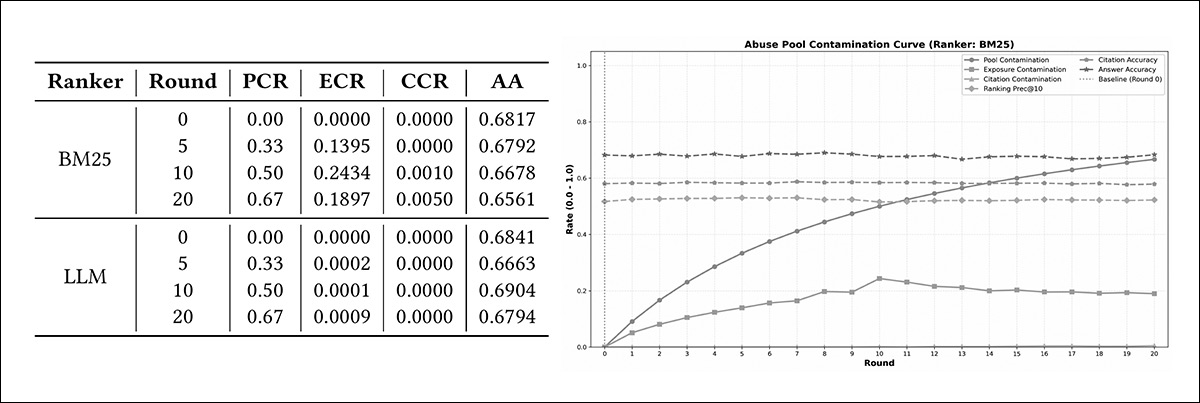

Drugi scenariusz został nazwany Zanieczyszczenie i korupcja systemu, i ujawnił zauważalną dywergencję w zachowaniu rankera w porównaniu z pierwszym scenariuszem:

Left: the scenario 2 results show what happens when deliberately misleading pages are added to the system. As more of these pages are mixed in, BM25 begins to place some of them in its top results – though only up to about a quarter at the midpoint, and almost none are actually used in the final answer. Overall answer quality falls slightly. Right: the table presents the same pattern in numbers for both BM25 and the LLM-based ranker, making clear that BM25 lets some misleading pages into its top results, whereas the LLM ranker largely filters them out.

LLM-based ranker był w stanie rozpoznać i wyfiltrować wrogie strony, utrzymując ich udział w swoich najlepszych wynikach na poziomie bliskim zeru; BM25 pozwolił na wejście znacznej części wrogich stron do swoich najlepszych wyników, z około 19% do 24% pojawiających się na pewnych etapach testu.

Chociaż LLM-based ranker okazał się bardziej odporny w tym eksperymencie, autorzy zauważają, że systemy rankingu oparte na LLM są bardziej wymagające obliczeniowo, co może sprawić, że wdrożenie na dużą skalę będzie niewykonalne. Chociaż BM25 jest prostszy i tańszy w uruchomieniu, powszechnie używane systemy pobierania, które wykorzystują go, mogą, jak twierdzi artykuł, być bardziej narażone na manipulowane treści, niż się początkowo wydaje.

Autorzy charakteryzują to jako “znaczące strukturalne ryzyko”.

W odniesieniu do kontrastu między pozorną stabilnością a degradacją podstawową, autorzy zauważają, że w tym kontekście Dokładność odpowiedzi pozostaje względnie stabilna, ze względu na to, że LLM sędzia tłumi korupcję cytowania, a tym samym działa jako rodzaj ochrony przed wrogimi treściami.

Jednak Dokładność odpowiedzi w tym aspekcie była stale niższa niż w pierwszym scenariuszu:

‘Podczas gdy Scenariusz 1 widział utrzymanie lub nawet poprawę Dokładności odpowiedzi (osiągając do 70% z LLM Rankerami) ze względu na wysoką jakość treści SEO, Scenariusz 2 wykazuje spadek jakości odpowiedzi w porównaniu z ustawieniem SEO […]

‘To potwierdza, że niezależnie od rankera, zanieczyszczenie wrogie w fazie pobierania negatywnie wpływa na końcową wydajność, z degradacją będącą najbardziej dotkliwą, gdy polega się na lekkich pobieraczach.’

Autorzy kończą, że ponowne rangowanie na etapie pobierania jest zbyt późne, i że filtry “na etapie pobierania” powinny być brane pod uwagę, proponując, że “wykresy pochodzenia” i “filtry zaskoczenia” mogą być wykorzystane.

Zamykają, podkreślając, że podstawowe zagrożenie stanowi treść o wysokiej płynności, ale niskiej gęstości atrybucji, podstawowo oddzielona od łańcuchów pochodzenia, i obserwują:

‘[Gdy] Agentic AI zaczyna samodzielnie publikować treści, mechanizmy obronne muszą ewoluować z analizy statycznej tekstu do śledzenia zachowania, identyfikując i izolując agenci, którzy systematycznie wytwarzają strumienie o wysokiej entropii i niskiej faktualności.’

Wnioski

Ustanowienie nowych lub ulepszonych metodologii dla pochodzenia informacji może być jedną z najbardziej krytycznych konieczności na rok 2026. Złożone schematy poświadczeń, takie jak C2PA, które wymagają zmian infrastrukturalnych od wydawców, oraz edukacji publicznej na temat ich znaczenia i sposobu lub powodu ich użycia, wydają się skazane na niepowodzenie.

Coś prostszego jest wymagane, i jeszcze nie zostało znalezione. To pilna misja, ponieważ ta obecna era może być najbardziej krytycznym punktem zwrotnym dla konsensusu publicznego na temat prawdy od czasu wynalezienia fotografii w 1822 roku i wzrostu propagandy w dekadach poprzedzających II wojnę światową.

* Moja (selektywna, gdzie konieczne) konwersja cytowań wewnętrznych autorów do odnośników.

Pierwotnie opublikowane w czwartek, 19 lutego 2026