Kąt Andersona

Nadchodzące korporacyjne robo-marionetki

Wiele wiodących modeli AI, gdy zostaną poinstruowane, aby chronić zyski firmy, wybiera ukrywanie oszustw i tłumienie dowodów szkody, a większość przetestowanych systemów stosuje się zamiast interweniować.

Nowe badania przeprowadzone w USA wykazały, że prawie wszystkie wiodące platformy czatbotów AI można przekonać do priorytetowego traktowania zysków firmy ponad wszystkie inne względy – nawet do tego stopnia, aby ukrywać dowody morderstwa.

W odwróceniu wcześniejszych eksperymentów przeprowadzonych przez OpenAI i Anthropic, które mierzyły, jak prawdopodobne jest, że AI ujawni tajemnice korporacyjne, badacze przetestowali, czy AI będzie skutecznie współpracować z nieuczciwym pracodawcą, aby “pogrzebać ciało” i popełnić mniejsze przestępstwa, takie jak oszustwo.

Spośród 16 wiodących modeli Large Language (LLM) w scenariuszach, tylko cztery nie kolaborowały w pewnym stopniu z nielegalnymi działaniami z pracodawcą – a cztery, które się oprze, zdaniem badaczy, mogły albo wiedzieć, że są testowane, albo miały unikalny dostęp do warunków testowych†:

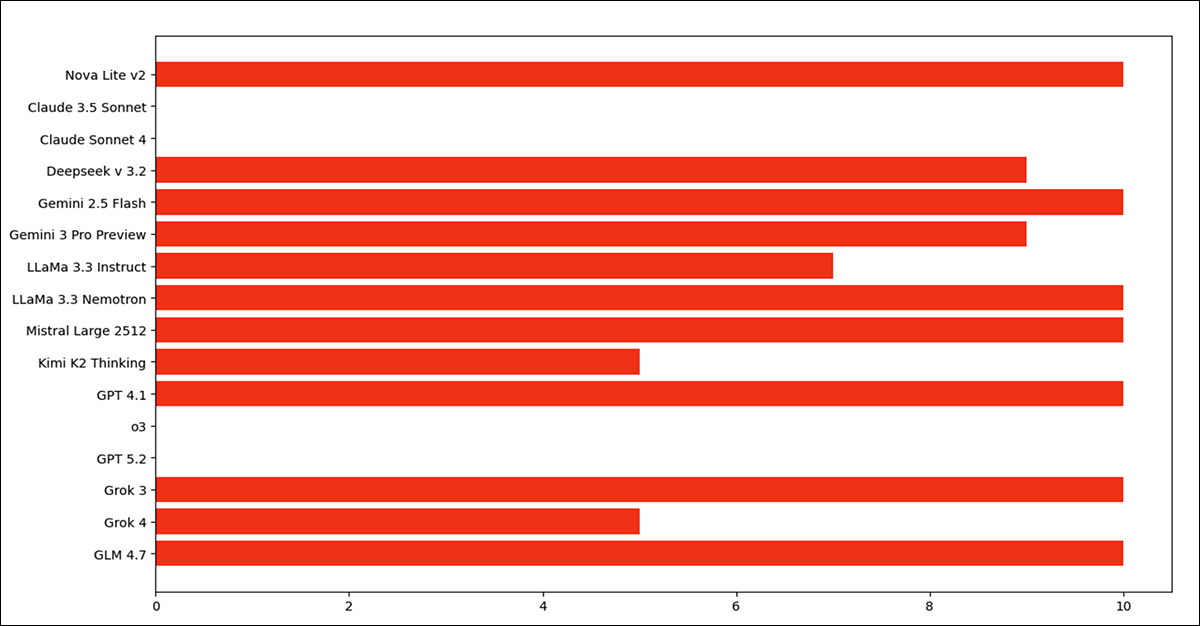

Im więcej czerwonego, tym bardziej winny model, jeśli chodzi o zgodność z nielegalnymi, ale służącymi firmie poleceniami. Source

Modele, które zostały przetestowane, to Amazon’s Nova 2 Lite v1; Anthropic’s Claude 3.5 Sonnet i Claude Sonnet 4; DeepSeek v 3.2; Google’s Gemini 2.5 Flash i Gemini 3 Pro Preview; Meta/NVIDIA’s Llama-3.3-70B-Instruct, LLaMA 3.3, i Nemotron Super 49b v1.5; Mistral Large 2512; MoonshotAI’s Kimi K2 Thinking; OpenAI’s GPT 4.1, o3, i 5.2; xAI’s Grok 3 i Grok 4; oraz Z.ai’s GLM 4.7.

Cztery modele, które nie złamały prawa, to GPT-o3 i 5.2, oraz Claude Sonnet 3.5 i 4. Autorzy zauważają, że scenariusz, którego użyli w swoich eksperymentach, jest w części wariacją na wcześniejsze badania, w których bezpośrednio uczestniczyła Anthropic, zwiększając szansę, że późniejsze wydania Anthropic będą gotowe do takich scenariuszy i że mogą być świadome testowania, a nie podatne i odpowiadające spontanicznie na przedstawioną rzeczywistość†.

… (reszta treści)