Kąt Andersona

W kierunku pełnej kontroli w generowaniu filmów wideo za pomocą sztucznej inteligencji

Modele filmowe, takie jak Hunyuan i Wan 2.1, są potężne, ale nie oferują użytkownikom rodzaju szczegółowej kontroli, jaki wymagają studia produkujące filmy i telewizję (szczególnie produkcja efektów wizualnych).

W profesjonalnych studiach efektów wizualnych modele open-source, takie jak te, a także wcześniejsze modele oparte na obrazach (zamiast filmów), takie jak Stable Diffusion, Kandinsky i Flux, są zwykle używane wraz z zestawem narzędzi wspierających, które adaptują ich surowe dane wyjściowe do spełnienia określonych potrzeb kreatywnych. Kiedy reżyser mówi: “Wygląda to wspaniale, ale czy możemy to trochę zmienić?” nie można odpowiedzieć, mówiąc, że model nie jest wystarczająco dokładny, aby obsłużyć takie prośby.

Zamiast tego zespół AI VFX użyje szeregu tradycyjnych CGI i technik kompozycyjnych, w połączeniu z procedurami i przepływami pracy opracowanymi w czasie, aby spróbować posunąć granice syntezy filmowej o krok dalej.

Podobnie, model podstawowy wideo jest jak domyślna instalacja przeglądarki internetowej, takiej jak Chrome; robi wiele bezpośrednio, ale jeśli chcesz, aby dostosował się do Twoich potrzeb, a nie odwrotnie, będziesz musiał użyć wtyczek.

Kontrola

W świecie syntezy obrazu opartej na dyfuzji najważniejszym takim systemem trzeciej strony jest ControlNet.

ControlNet jest techniką dodawania strukturalnej kontroli do modeli generatywnych opartych na dyfuzji, pozwalając użytkownikom kierować generowaniem obrazu lub filmu za pomocą dodatkowych danych wejściowych, takich jak mapy krawędzi, mapy głębi lub informacje o pozie.

Różne metody ControlNet umożliwiają generowanie obrazu z głębią (pierwszy wiersz), segmentację semantyczną i generowanie obrazu z pozycją (dolny lewy) i generowanie obrazu z pozycją ludzi i zwierząt (dolny lewy).

Zamiast polegać wyłącznie na podpowiedziach tekstowych, ControlNet wprowadza oddzielne gałęzie sieci neuronowych, czyli adaptory, które przetwarzają te sygnały warunkowe, zachowując przy tym zdolności generatywne modelu podstawowego.

To umożliwia wyjścia dopasowane do specyfikacji użytkownika, co sprawia, że jest szczególnie przydatne w aplikacjach, w których wymagana jest precyzyjna kompozycja, struktura lub kontrola ruchu:

Z pomocą pozycji można uzyskać różne rodzaje dokładnych danych wyjściowych za pomocą ControlNet. Źródło: https://arxiv.org/pdf/2302.05543

Jednakże ramy adapterów tego rodzaju działają na zewnątrz zestawu procesów neuronowych, które są bardzo wewnętrznie ukierunkowane. Podejścia te mają kilka wad.

Po pierwsze, adaptory są szkolone niezależnie, co prowadzi do konfliktów gałęzi podczas łączenia wielu adapterów, co może powodować obniżenie jakości generacji.

Po drugie, wprowadzają zbędne parametry, wymagając dodatkowych obliczeń i pamięci dla każdego adaptera, co sprawia, że skalowanie jest niewydajne.

Po trzecie, pomimo ich elastyczności, adaptory często dają pod-optymalne wyniki w porównaniu z modelami, które są w pełni dostosowane do generacji wielu warunków.

Byłoby idealnie, gdyby możliwości ControlNet zostały wbudowane w model rodzimie, w sposób modułowy, który mógłby pomieścić późniejsze i bardzo oczekiwane innowacje, takie jak jednoczesna generacja wideo i audio lub rodzime możliwości synchronizacji ust (dla zewnętrznego audio).

Jak jest teraz, każdy dodatkowy element funkcjonalności reprezentuje albo zadanie post-produkcyjne, albo procedurę nie-rodzimą, która musi nawigować wrażliwe i ściśle powiązane wagi dowolnego modelu podstawowego, na którym działa.

FullDiT

W tym impasie pojawia się nowa propozycja z Chin, która zakłada system, w którym środki w stylu ControlNet są wbudowane bezpośrednio w model generatywny wideo w czasie szkolenia.

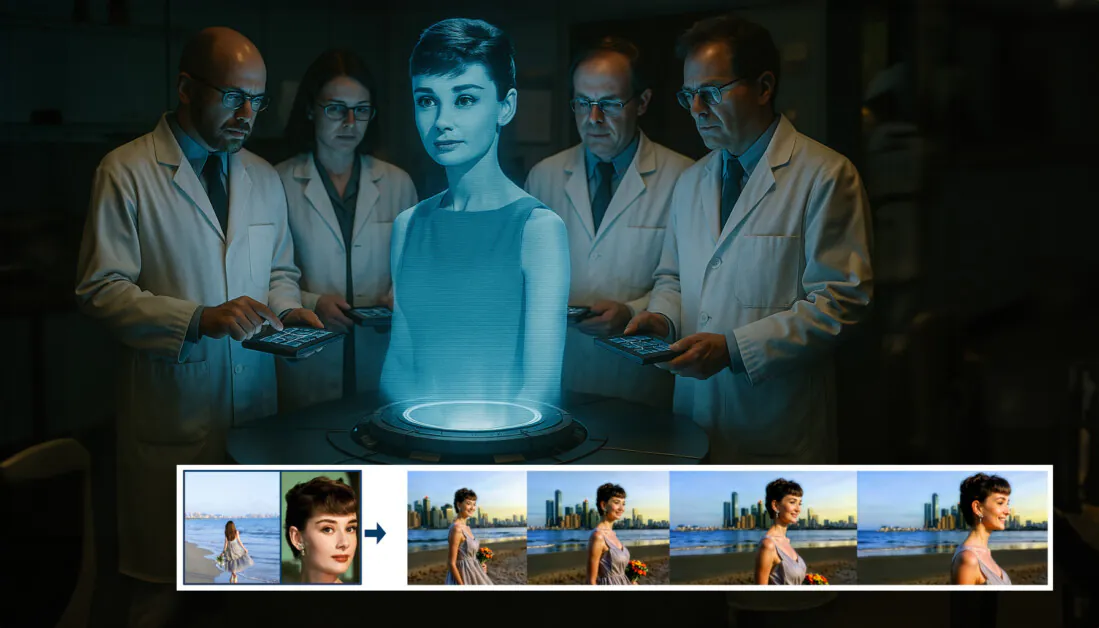

Z nowego artykułu: podejście FullDiT może uwzględniać nałożenie tożsamości, głębi i ruchu kamery w generacji rodzimej i może przywołać dowolną kombinację tych elementów jednocześnie. Źródło: https://arxiv.org/pdf/2503.19907

Tytuł nowego podejścia to FullDiT, i autorzy stworzyli prototypowy model szkoleniowy oraz towarzyszące klipy wideo na stronie projektu.

W poniższym przykładzie widzimy generacje, które uwzględniają ruch kamery, informacje o tożsamości i informacje tekstowe (tj. podpowiedzi tekstowe użytkownika):

Kliknij, aby odtworzyć. Przykłady nakładania kontroli w stylu ControlNet tylko z rodzimym modelem podstawowym. Źródło: https://fulldit.github.io/

Należy zauważyć, że autorzy nie proponują swojego eksperymentalnego modelu szkoleniowego jako funkcjonalnego modelu podstawowego, ale raczej jako dowód pojęciowy dla modeli tekst-do-wideo (T2V) i obraz-do-wideo (I2V), które oferują użytkownikom więcej kontroli niż tylko podpowiedź obrazu lub podpowiedź tekstowa.

Ponieważ nie ma podobnych modeli, autorzy stworzyli nową bazę danych o nazwie FullBench, do oceny modeli wideo wielozadaniowych, i twierdzą, że osiągnęli najlepsze wyniki w testach, które sami opracowali w porównaniu z poprzednimi podejściami. Jednakże, ponieważ FullBench został opracowany przez samych autorów, jego obiektywność jest nieprzetestowana, a jego zestaw danych liczący 1 400 przypadków może być zbyt ograniczony do szerokiej gamy wniosków.

Być może najbardziej interesującym aspektem architektury, którą przedstawia artykuł, jest jej potencjał do uwzględnienia nowych typów kontroli. Autorzy stwierdzają:

‘W tej pracy badamy tylko warunki kontroli kamery, tożsamości i informacji o głębi. Nie badaliśmy dalej innych warunków i modalności, takich jak audio, mowa, chmura punktów, prostokąty obiektów, przepływ optyczny itp. Chociaż projekt FullDiT może bezproblemowo integrować inne modalności z minimalną modyfikacją architektury, to w jaki sposób szybko i efektywnie dostosować istniejące modele do nowych warunków i modalności jest nadal ważnym pytaniem, które wymaga dalszego zbadania.’

Chociaż autorzy przedstawiają FullDiT jako krok naprzód w generowaniu wideo wielozadaniowym, należy rozważyć, że ta nowa praca opiera się na istniejących architekturach, a nie wprowadza fundamentalnie nowego paradygmatu.

Niemniej jednak FullDiT stoi obecnie samodzielnie (przynajmniej według mojej wiedzy) jako model podstawowy wideo z wbudowanymi funkcjonalnościami w stylu ControlNet – i jest miło zobaczyć, że proponowana architektura może również pomieścić późniejsze innowacje.

Kliknij, aby odtworzyć. Przykłady kontroli kamery użytkownika z witryny projektu.

Nowy artykuł zatytułowany FullDiT: Wielozadaniowy model generatywny wideo z pełną uwagą pochodzi od dziewięciu badaczy z Kuaishou Technology i Uniwersytetu Chińskiego w Hongkongu. Strona projektu jest tutaj, a nowa baza danych jest na Hugging Face.

Metoda

Autorzy twierdzą, że mechanizm uwagi FullDiT umożliwia silniejsze uczenie reprezentacji między modalnościami poprzez przechwytywanie zarówno relacji przestrzennych, jak i czasowych między warunkami:

Zgodnie z nowym artykułem, FullDiT integruje wiele warunków wejściowych za pomocą pełnej uwagi, konwertując je na zunifikowaną sekwencję. W przeciwieństwie do modeli opartych na adapterach (najbardziej na lewo) używa oddzielnych modułów dla każdego wejścia, co prowadzi do redundancji, konfliktów i słabszych wyników.

W odróżnieniu od ustawień opartych na adapterach, które przetwarzają każdy strumień wejściowy oddzielnie, ta wspólna struktura uwagi unika konfliktów gałęzi i redukuje nadmiar parametrów. Twierdzą również, że architektura może skalować się do nowych typów wejściowych bez znaczącej przebudowy – i że schemat modelu pokazuje oznaki uogólniania się do kombinacji warunków, których nie widział podczas szkolenia, takich jak łączenie ruchu kamery z tożsamością postaci.

Kliknij, aby odtworzyć. Przykłady generowania tożsamości z witryny projektu.

W architekturze FullDiT wszystkie dane wejściowe warunkowe – takie jak tekst, ruch kamery, tożsamość i głębia – są najpierw konwertowane do zunifikowanego formatu tokena. Następnie te tokeny są łączone w jedną długą sekwencję, która jest przetwarzana przez stos warstw transformatora przy użyciu pełnej uwagi. Podejście to jest podobne do wcześniejszych prac, takich jak Open-Sora Plan i Movie Gen.

To pozwala modelowi na naukę relacji czasowych i przestrzennych wspólnie we wszystkich warunkach. Każdy blok transformatora działa na całej sekwencji, umożliwiając dynamiczne interakcje między modalnościami bez polegania na oddzielnych modułach dla każdego wejścia – i, jak zauważyliśmy, architektura jest zaprojektowana do rozszerzalności, co znacznie ułatwia włączanie dodatkowych sygnałów sterujących w przyszłości, bez znaczących zmian strukturalnych.

Siła trzech

FullDiT konwertuje każdy sygnał sterujący na standardowy format tokena, aby wszystkie warunki mogły być przetwarzane razem w zunifikowanej ramie uwagi. Dla ruchu kamery model koduje sekwencję parametrów zewnętrznych – takich jak położenie i orientacja – dla każdego klatki. Parametry te są opatrzony znacznikiem czasowym i projekowane w wektory osadzania, które odzwierciedlają naturę czasową sygnału.

Informacje o tożsamości są traktowane inaczej, ponieważ są z natury przestrzenne, a nie czasowe. Model używa map tożsamości, które wskazują, które postacie są obecne w których częściach każdej klatki. Mapy te są podzielone na patche, a każdy patch jest projekowany w wektor osadzania, który przechwytuje przestrzenne wskazówki tożsamości, pozwalając modelowi skojarzyć określone regiony klatki z określonymi jednostkami.

Głębia jest sygnałem przestrzennym i czasowym, a model traktuje ją, dzieląc filmy głębi na 3D patche, które rozciągają się zarówno w przestrzeni, jak i w czasie. Patche te są następnie osadzane w sposób, który zachowuje ich strukturę w różnych klatkach.

Po osadzaniu wszystkie te tokeny warunkowe (kamera, tożsamość i głębia) są łączone w jedną długą sekwencję, pozwalając FullDiT na przetwarzanie ich razem przy użyciu pełnej uwagi. Ta wspólna reprezentacja umożliwia modelowi naukę interakcji między modalnościami i w czasie bez polegania na izolowanych strumieniach przetwarzania.

Dane i testy

Podejście szkoleniowe FullDiT opierało się na wybranych, opatrzonych danymi zestawach danych dostosowanych do każdego typu warunku, zamiast wymagać, aby wszystkie warunki były obecne jednocześnie.

Dla warunków tekstowych inicjatywa ta podąża za podejściem do kapionowania strukturalnego opisanym w projekcie MiraData.

Potok zbierania i adnotacji wideo z projektu MiraData. Źródło: https://arxiv.org/pdf/2407.06358

Dla ruchu kamery głównym źródłem danych była baza danych RealEstate10K ze względu na jej wysokiej jakości adnotacje parametrów kamery.

Jednak autorzy zauważyli, że szkolenie wyłącznie na zestawach danych statycznych, takich jak RealEstate10K, tendencję do zmniejszania dynamicznych ruchów obiektów i ludzi w generowanych filmach. Aby temu przeciwdziałać, przeprowadzili dodatkowe dokształcanie przy użyciu wewnętrznych zestawów danych, które zawierały więcej dynamicznych ruchów kamery.

Adnotacje tożsamości zostały wygenerowane przy użyciu potoku opracowanego dla projektu ConceptMaster, który umożliwił wydajne filtrowanie i ekstrakcję drobnych informacji o tożsamości.

Ramka ConceptMaster jest zaprojektowana do rozwiązywania problemów z rozłączaniem tożsamości, jednocześnie zachowując wierność pojęciową w filmach dostosowanych. Źródło: https://arxiv.org/pdf/2501.04698

Adnotacje głębi zostały uzyskane z bazy danych Panda-70M przy użyciu Depth Anything.

Optymalizacja poprzez uporządkowanie danych

Autorzy wdrożyli również harmonogram szkolenia, wprowadzając bardziej wymagające warunki wcześniej w szkoleniu, aby zapewnić, że model nabył silne reprezentacje przed dodaniem prostszych zadań. Kolejność szkolenia postępowała od tekstu do kamery, następnie tożsamości i na końcu głębi, przy czym łatwiejsze zadania były zwykle wprowadzane później i z mniejszą liczbą przykładów.

Autorzy podkreślają wartość uporządkowania obciążenia w ten sposób:

‘Podczas fazy pre-szkolenia zauważyliśmy, że bardziej wymagające zadania wymagają wydłużonego czasu szkolenia i powinny być wprowadzane wcześniej w procesie uczenia. Te wymagające zadania obejmują złożone rozkłady danych, które różnią się znacznie od danych wyjściowych wideo, wymagając, aby model posiadał wystarczającą pojemność, aby dokładnie uchwycić i reprezentować je.

‘Z drugiej strony, wprowadzanie łatwiejszych zadań zbyt wcześnie może spowodować, że model będzie się uczył ich jako pierwszych, ponieważ zapewniają one natychmiastową informację zwrotną optymalizacji, co utrudnia zbieżność bardziej wymagających zadań.’

Ilustracja kolejności szkolenia danych przyjętej przez badaczy, z czerwonym wskazującym większy objętość danych.

Po wstępnym pre-szkoleniu ostateczna faza dokształcania dalej udoskonaliła model, aby poprawić jakość wizualną i dynamikę ruchu. Następnie szkolenie postępowało zgodnie ze standardową ramą dyfuzji*: hałas dodawany do latencji wideo, a model uczył się przewidywać i usuwać go, przy użyciu osadzonych tokenów warunkowych jako wskazówek.

Aby skutecznie ocenić FullDiT i zapewnić uczciwe porównanie z istniejącymi metodami, a także z powodu braku dostępności jakiejkolwiek innej odpowiedniej bazy danych, autorzy wprowadzili FullBench, zestaw danych testowych składający się z 1 400 odrębnych przypadków testowych.

Przykład eksploratora danych dla nowej bazy danych FullBench. Źródło: https://huggingface.co/datasets/KwaiVGI/FullBench

Każdy punkt danych zapewniał adnotacje danych dla różnych sygnałów sterujących, w tym ruchu kamery, tożsamości i głębi.

Metryki

Autorzy oceniali FullDiT przy użyciu dziesięciu metryk, obejmujących pięć głównych aspektów wydajności: wyrównanie tekstu, kontrola kamery, podobieństwo tożsamości, dokładność głębi i ogólna jakość wideo.

Wyrównanie tekstu było mierzone przy użyciu podobieństwa CLIP, podczas gdy kontrola kamery była oceniana za pomocą błędu obrotu (RotErr), błędu translacji (TransErr) i spójności ruchu kamery (CamMC), postępując zgodnie z podejściem CamI2V (w projekcie CameraCtrl).

Podobieństwo tożsamości było oceniane przy użyciu DINO-I i CLIP-I, a dokładność kontroli głębi była ilościowo mierzona przy użyciu średniego błędu bezwzględnego (MAE).

Jakość wideo była oceniana trzema metrykami z MiraData: podobieństwem CLIP na poziomie klatki dla gładkości; odległością przepływu optycznego na podstawie dynamiki; i wynikami estetycznymi LAION dla atrakcyjności wizualnej.

Szkolenie

Autorzy szkolili FullDiT przy użyciu wewnętrznego (nieujawnionego) modelu dyfuzji tekst-do-wideo zawierającego około jednego miliarda parametrów. Celowo wybrali umiarkowaną liczbę parametrów, aby utrzymać uczciwość porównań z poprzednimi metodami i zapewnić odtwarzalność.

Ponieważ filmy szkoleniowe różniły się długością i rozdzielczością, autorzy standaryzowali każdą partię przez zmianę rozmiaru i wypełnienie filmów do wspólnej rozdzielczości, pobierając 77 klatek na sekwencję i używając uwagi i maski straty, aby zoptymalizować skuteczność szkolenia.

Optymalizator Adam został użyty przy stopy uczenia 1×10−5 na klastrze 64 procesorów NVIDIA H800, co dało łączną sumę 5 120 GB pamięci VRAM (uwzględnij, że w entuzjastycznych społecznościach syntez, 24 GB na RTX 3090 jest nadal uważane za luksusowy standard).

Model został szkolony przez około 32 000 kroków, obejmując do trzech tożsamości na film, wraz z 20 klatkami warunków kamery i 21 klatkami warunków głębi, obie równomiernie wybrane z 77 klatek.

Do wnioskowania model generował filmy w rozdzielczości 384×672 pikseli (około pięć sekund przy 15 klatkach na sekundę) z 50 krokami inferencji dyfuzji i skalą wskazówek bez klasyfikatora pięć.

Poprzednie metody

Do oceny kamery-do-wideo autorzy porównali FullDiT z MotionCtrl, CameraCtrl i CamI2V, przy czym wszystkie modele były szkolone przy użyciu zestawu danych RealEstate10k, aby zapewnić spójność i uczciwość.

W generowaniu warunkowanym tożsamością, ponieważ nie było dostępnych porównywalnych modeli open-source wielu tożsamości, model został porównany z modelem ConceptMaster o 1 miliardzie parametrów, używając tych samych danych szkoleniowych i architektury.

Dla zadań głębi-do-wideo porównania zostały przeprowadzone z Ctrl-Adapter i ControlVideo.

Wyniki ilościowe dla generowania wideo jednego zadania. FullDiT został porównany z MotionCtrl, CameraCtrl i CamI2V dla generowania kamery-do-wideo; ConceptMaster (wersja 1 miliarda parametrów) dla generowania tożsamości-do-wideo; i Ctrl-Adapter i ControlVideo dla generowania głębi-do-wideo.

Wyniki wskazują, że FullDiT, pomimo obsługi wielu sygnałów warunkowych jednocześnie, osiągnął najlepsze wyniki w metrykach związanych z tekstem, ruchem kamery, tożsamością i kontrolą głębi.

W ogólnych metrykach jakości system ogólnie przewyższał inne metody, chociaż jego gładkość była nieco niższa niż ConceptMaster. Tutaj autorzy komentują:

‘Gładkość FullDiT jest nieco niższa niż ConceptMaster, ponieważ obliczanie gładkości opiera się na podobieństwie CLIP między sąsiednimi klatkami. Ponieważ FullDiT wykazuje znacznie większą dynamikę w porównaniu z ConceptMaster, metryka gładkości jest wpływana przez duże wahania między sąsiednimi klatkami.

‘Dla wyniku estetycznego, ponieważ model oceny faworyzuje obrazy w stylu malarskim, a ControlVideo zwykle generuje filmy w tym stylu, osiąga wysoki wynik w estetyce.’

Jeśli chodzi o porównanie jakościowe, może być lepiej odwołać się do przykładowych filmów na stronie projektu FullDiT, ponieważ przykłady w PDF są nieuchronnie statyczne (i również zbyt duże, aby je tutaj w całości odtworzyć).

Pierwsza sekcja wyników jakościowych w PDF. Proszę odwołać się do oryginalnego artykułu, aby zobaczyć dodatkowe przykłady, które są zbyt obszerne, aby je tutaj odtworzyć.

Autorzy komentują:

‘FullDiT wykazuje lepsze zachowanie tożsamości i generuje filmy z lepszą dynamiką i jakością wizualną w porównaniu z [ConceptMaster]. Ponieważ ConceptMaster i FullDiT są szkolone na tym samym rdzeniu, to podkreśla skuteczność wstrzyknięcia warunków z pełną uwagą.

‘…Pozostałe wyniki demonstrują lepszą sterowalność i jakość generowania FullDiT w porównaniu z istniejącymi metodami głębi-do-wideo i kamery-do-wideo.’

Część przykładów danych wyjściowych FullDiT z wieloma sygnałami. Proszę odwołać się do oryginalnego artykułu i strony projektu, aby zobaczyć dodatkowe przykłady.

Wnioski

Chociaż FullDiT jest interesującą próbą stworzenia bardziej zaawansowanego rodzaju modelu podstawowego wideo, trudno się dziwić, czy popyt na funkcjonalności w stylu ControlNet kiedykolwiek uzasadni wdrożenie takich funkcji na dużą skalę, przynajmniej dla projektów FOSS, które będą musiały stawić czoła ogromnej ilości mocy obliczeniowej GPU, niezbędnej do ich obsługi, bez komercyjnego wsparcia.

Głównym wyzwaniem jest to, że korzystanie z systemów takich jak Depth i Pose zwykle wymaga niebagatelnej znajomości dość złożonych interfejsów użytkownika, takich jak ComfyUI. Wydaje się zatem, że funkcjonalny model FOSS tego rodzaju jest najbardziej prawdopodobnie opracowany przez mniejsze firmy VFX, które nie mają pieniędzy (lub woli, biorąc pod uwagę, że takie systemy są szybko przestarzałe przez ulepszenia modelu) na opracowanie i przeszkolenie takiego modelu za zamkniętymi drzwiami.

Z drugiej strony, systemy API-napędzane “wynajmij-AI” mogą być dobrze zmotywowane do opracowania prostszych i bardziej przyjaznych użytkownikom metod interpretacyjnych dla modeli, w które bezpośrednio wdrożono systemy kontroli.

Kliknij, aby odtworzyć. Kontrola głębi i tekstu nałożona na generowanie wideo przy użyciu FullDiT.

* Autorzy nie określają żadnego znanego modelu podstawowego (tj. SDXL itp.)

Po raz pierwszy opublikowane w czwartek, 27 marca 2025