Kąt Andersona

Mniejsze Deepfakes Mogą Stanowić Większe Zagrożenie

Narzędzia Conversational AI, takie jak ChatGPT i Google Gemini, są teraz wykorzystywane do tworzenia deepfakes, które nie wymieniają twarzy, ale w bardziej subtelnych sposób mogą przepisać całą historię wewnątrz obrazu. Poprzez zmianę gestów, rekwizytów i tła, te edycje oszukują zarówno detektory AI, jak i ludzi, zwiększając stawki dla rozpoznania tego, co jest rzeczywiste w sieci.

W obecnej sytuacji, szczególnie w następstwie znaczących ustaw, takich jak TAKE IT DOWN act, wiele z nas kojarzy deepfakes i syntezę tożsamości napędzaną przez AI z niezgodnymi AI pornografiami i manipulacjami politycznymi – ogólnie, brzydkimi zniekształceniami prawdy.

To przyzwyczaja nas do oczekiwania, że AI-manipulowane obrazy zawsze będą miały na celu treści o wysokich stawkach, gdzie jakość renderowania i manipulacja kontekstem mogą odnieść sukces w osiągnięciu zwycięstwa wiarygodności, przynajmniej w krótkim okresie.

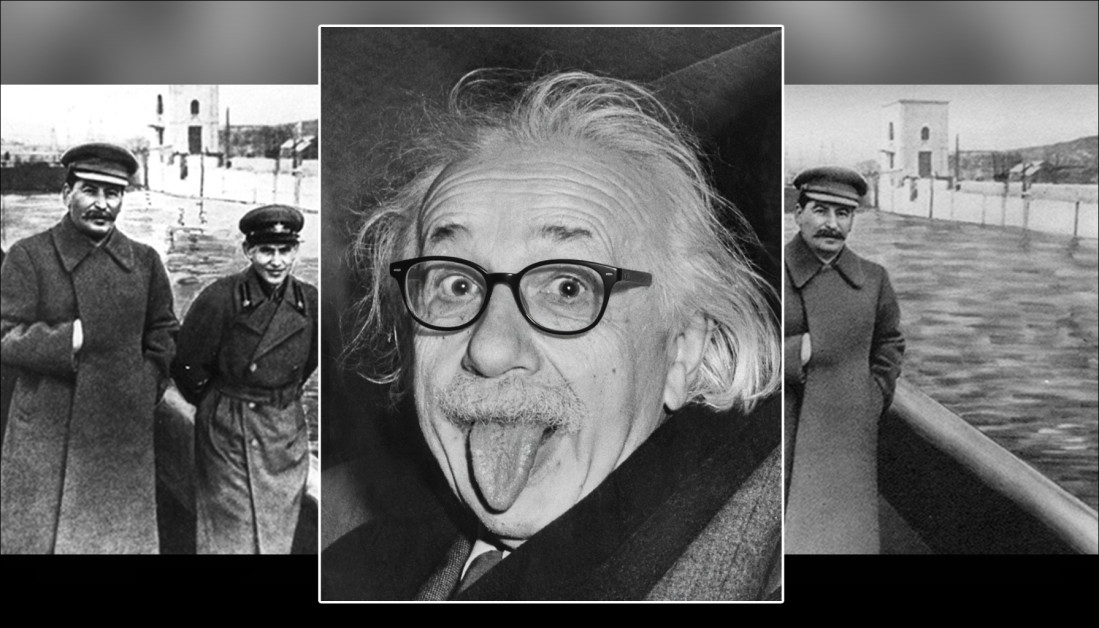

Historycznie jednak znacznie subtelniejsze zmiany często miały bardziej złowieszczy i trwały wpływ – takie jak fotograficzne sztuczki na najwyższym poziomie, które pozwoliły Stalinowi usunąć tych, którzy popadli w niełaskę z fotograficznego zapisu, jak to zostało zsatyryzowane w powieści George’a Orwella Dziewięćdziesiąty Cztery, gdzie protagonista Winston Smith spędza swoje dni, przepisując historię i tworząc, niszcząc i “poprawiając” zdjęcia.

W następującym przykładzie problem z drugim zdjęciem polega na tym, że “nie wiemy, czego nie wiemy” – że były szef tajnej policji Stalina, Nikolai Yezhov, zajmował przestrzeń, w której teraz znajduje się tylko bariera ochronna:

Teraz widzisz go, teraz jest… para. Manipulacja fotograficzna z czasów Stalina usuwa dyskredytowanego członka partii z historii. Źródło: Domena publiczna, za pośrednictwem https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

Prądy tego rodzaju, często powtarzane, trwają na wiele sposobów; nie tylko kulturowo, ale także w samym widzeniu komputerowym, które wywodzi trendy z dominujących tematów i motywów w zestawach danych szkoleniowych. Aby podać przykład, fakt, że smartfony obniżyły barierę wejścia i znacznie obniżyły koszt fotografii, oznacza, że ich ikonografia stała się nieodłącznie związana z wieloma abstrakcyjnymi pojęciami, nawet wtedy, gdy nie jest to odpowiednie.

Jeśli konwencjonalne deepfaking można postrzegać jako akt “napaści”, perwidyjne i trwałe mniejsze zmiany w audio-wizualnych mediach są bardziej podobne do “gaslightingu”. Dodatkowo, zdolność tego rodzaju deepfaking do pozostania niezauważonym sprawia, że trudno je zidentyfikować za pomocą najnowocześniejszych systemów wykrywania deepfakes (które szukają rażących zmian). Ten podejście jest bardziej podobne do wody, która niszczy skałę przez dłuższy okres, niż kamień skierowany w głowę.

MultiFakeVerse

Badacze z Australii podjęli próbę rozwiązania braku uwagi na “subtelne” deepfaking w literaturze, tworząc znaczący nowy zestaw danych manipulacji obrazu centrycznego dla osób, które zmieniają kontekst, emocje i narrację bez zmiany podstawowej tożsamości podmiotu:

Przykłady z nowej kolekcji, pary prawdziwe/fałszywe, z niektórymi zmianami bardziej subtelными niż inne. Zwróć uwagę, na przykład, na utratę autorytetu azjatyckiej kobiety, w prawym dolnym rogu, gdy jej stetoskop lekarski jest usuwany przez AI. W tym samym czasie substytucja notesu lekarskiego za klipboard nie ma żadnego oczywistego kąta semantycznego. Źródło: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

Tytuł MultiFakeVerse, kolekcja składa się z 845 826 obrazów wygenerowanych za pomocą modeli języka wizualnego (VLM), które mogą być dostępne online i pobrane, z pozwoleniem.

Autorzy stwierdzają:

‘Ten VLM-napędzany podejście umożliwia semantyczne, kontekstowo-świadome zmiany, takie jak modyfikacja działań, scen i interakcji człowiek-obiekt, a nie syntetyczne lub niskopoziomowe zamiany tożsamości i edycje regionu-specyficzne, które są powszechne w istniejących zestawach danych.’

‘Nasze eksperymenty ujawniają, że bieżące modele wykrywania deepfakes i obserwatorzy ludzcy mają trudności z wykryciem tych subtelnych, ale znaczących manipulacji.’

Badacze przetestowali zarówno ludzi, jak i wiodące systemy wykrywania deepfakes na nowym zestawie danych, aby zobaczyć, jak dobrze te subtelne manipulacje mogą być zidentyfikowane. Uczestnicy ludzcy mieli trudności, prawidłowo klasyfikując obrazy jako prawdziwe lub fałszywe tylko około 62% czasu, i mieli jeszcze większe trudności w wskazaniu, które części obrazu zostały zmienione.

Istniejące detektory deepfakes, przeszkolone głównie na bardziej oczywistych zestawach danych face-swapping lub inpainting, radziły sobie słabo, często nie rejestrując, że jakakolwiek manipulacja miała miejsce. Nawet po dokształceniu na MultiFakeVerse, wskaźniki wykrywania pozostały niskie, ujawniając, jak słabo bieżące systemy radzą sobie z tymi subtelными, narracyjnymi edycjami.

Nowy artykuł nosi tytuł Multiverse Through Deepfakes: The MultiFakeVerse Dataset of Person-Centric Visual and Conceptual Manipulations, i pochodzi od pięciu badaczy z Monash University w Melbourne i Curtin University w Perth. Kod i powiązane dane zostały wydane na GitHub, dodatkowo do hostingu Hugging Face, o którym wcześniej wspomniano.

Metoda

Zestaw danych MultiFakeVerse został zbudowany z czterech rzeczywistych zestawów obrazów przedstawiających ludzi w różnych sytuacjach: EMOTIC; PISC, PIPA, i PIC 2.0. Począwszy od 86 952 oryginalnych obrazów, badacze wyprodukowali 758 041 zmodyfikowanych wersji.

Gemini-2.0-Flash i ChatGPT-4o ramy były używane do proponowania sześciu minimalnych edycji dla każdego obrazu – edycji zaprojektowanych w celu subtelnej zmiany, w jaki sposób najbardziej widoczna osoba na obrazie byłaby postrzegana przez widza.

Modele zostały poinstruowane, aby wygenerować modyfikacje, które sprawiłyby, że podmiot wydawałby się naiwny, dumny, żałujący, niedoświadczony, lub bezczelny, lub aby dostosować jakiś fakticzny element w scenie. Wraz z każdą edycją, modele również wygenerowały wyrażenie odnoszące się, aby wyraźnie zidentyfikować cel modyfikacji, zapewniając, że następny proces edycyjny mógł zastosować zmiany do prawidłowej osoby lub obiektu w każdym obrazie.

Autorzy wyjaśniają:

‘Zwróć uwagę, że wyrażenie odnoszące się to szeroko eksplorowany obszar w społeczności, który oznacza frazę, która może rozróżnić cel w obrazie, np. dla obrazu z dwoma mężczyznami siedzącymi na biurku, jednym rozmawiającym przez telefon, a drugim przeglądającym dokumenty, odpowiednie wyrażenie odnoszące się do tego ostatniego byłoby the man on the left holding a piece of paper.’

Gdy edycje zostały zdefiniowane, rzeczywista manipulacja obrazu została wykonana przez pobudzenie modeli języka wizualnego do zastosowania określonych zmian, pozostawiając resztę sceny nietkniętą. Badacze przetestowali trzy systemy do tego zadania: GPT-Image-1; Gemini-2.0-Flash-Image-Generation; i ICEdit.

Po wygenerowaniu dwudziestu dwóch tysięcy próbek obrazów, Gemini-2.0-Flash okazał się najbardziej spójnym metoda, produkując edycje, które naturalnie wtapiały się w scenę bez wprowadzania widocznych artefaktów; ICEdit często produkował bardziej oczywiste fałszerstwa, z zauważalnymi wadami w zmodyfikowanych obszarach; i GPT-Image-1 czasami wpływał na niezamierzone części obrazu, częściowo z powodu jego zgodności z ustalonymi proporcjami wyjścia.

Analiza Obrazu

Każdy zmodyfikowany obraz został porównany z oryginałem, aby określić, jak dużo obrazu zostało zmienione. Różnice na poziomie pikseli między dwiema wersjami zostały obliczone, z małym losowym szumem odfiltrowanym, aby skoncentrować się na znaczących edycjach. W niektórych obrazach tylko niewielkie obszary były dotknięte; w innych do osiemdziesięciu procent sceny zostało zmodyfikowane.

Aby ocenić, jak bardzo znaczenie każdego obrazu zmieniło się w świetle tych zmian, podpisów zostało wygenerowane dla obu oryginalnych i zmodyfikowanych obrazów za pomocą ShareGPT-4V modelu języka wizualnego.

Te podpisów zostały następnie przekonwertowane na osadzenia za pomocą Long-CLIP, umożliwiając porównanie, jak daleko zawartość zbiegła się między wersjami. Największe zmiany semantyczne zostały zaobserwowane w przypadkach, w których obiekty w pobliżu lub bezpośrednio związane z osobą zostały zmienione, ponieważ te małe dostosowania mogły znacznie zmienić, jak obraz był interpretowany.

Gemini-2.0-Flash został następnie użyty do klasyfikacji typu manipulacji zastosowanej do każdego obrazu, w zależności od miejsca i sposobu, w jaki edycje zostały wykonane. Manipulacje zostały pogrupowane w trzy kategorie: poziom edycji osoby obejmował zmiany wyrażenia twarzy, pozy, spojrzenia, ubrania lub innych cech osobowych; poziom edycji obiektu dotyczył obiektów związanych z osobą, takich jak obiekty, które były trzymane lub wchodzące w interakcje na pierwszym planie; i poziom edycji sceny obejmował tło lub szersze aspekty ustawienia, które nie bezpośrednio dotyczyły osoby.

Potok generacji zestawu danych MultiFakeVerse zaczyna się od rzeczywistych obrazów, gdzie modele języka wizualnego proponują edycje narracyjne ukierunkowane na osoby, obiekty lub sceny. Te instrukcje są następnie stosowane przez modele edycji obrazu. Prawy panel pokazuje proporcję edycji na poziomie osoby, obiektu i sceny w całym zestawie danych. Źródło: https://arxiv.org/pdf/2506.00868

Ponieważ poszczególne obrazy mogły zawierać wiele typów edycji jednocześnie, dystrybucja tych kategorii została odwzorowana na całym zestawie danych. Około jedna trzecia edycji dotyczyła tylko osoby, około jednej piątej dotyczyła tylko sceny, a około jednej szóstej była ograniczona do obiektów.

Ocena Wpływu Percepcyjnego

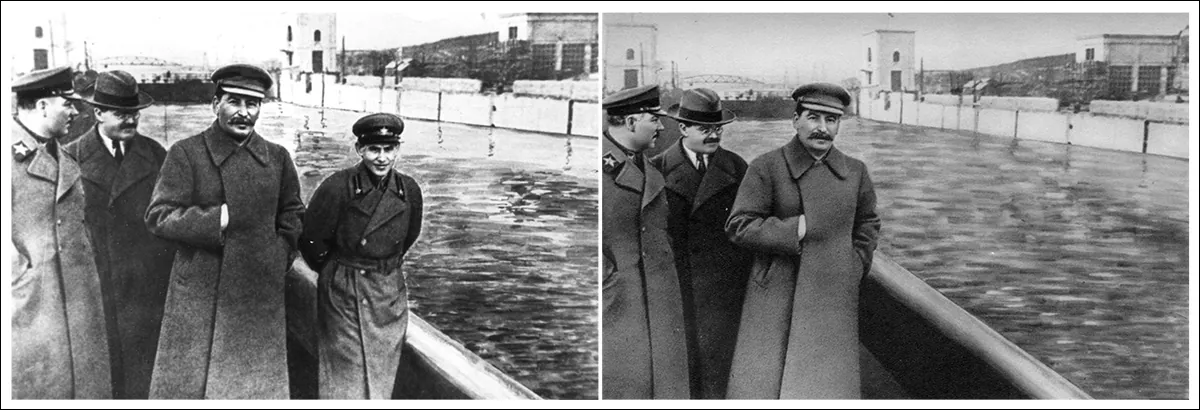

Gemini-2.0-Flash został użyty do oceny, jak manipulacje mogą zmienić percepcję widza w sześciu obszarach: emocja, tożsamość osobista, dynamika mocy, narracja sceny, zamierzony cel manipulacji, i zagadnienia etyczne.

Dla emocji, edycje były często opisywane słowami takimi jak radosne, zaangażowane, lub przystępne, sugerując zmiany w tym, jak podmioty były emocjonalnie oprawione. W narracyjnych terminach, słowa takie jak profesjonalne lub inne wskazywały zmiany w zakładanej historii lub ustawieniu:

Gemini-2.0-Flash został pobudzony do oceny, jak każda manipulacja wpłynęła na sześć aspektów percepcji widza. Lewy: przykładowa struktura promptu kierująca oceną modelu. Prawy: chmury słów podsumowujące zmiany w emocji, tożsamości, narracji sceny, zamierzonym celu, dynamice mocy i zagadnieniach etycznych w całym zestawie danych.

Opisy zmian tożsamości obejmowały słowa takie jak młodszy, zabawny, i podatny, pokazując, jak drobne zmiany mogą wpłynąć na to, jak jednostki były postrzegane. Zamierzony cel wielu edycji został oznaczony jako perswazyjny, oszukańczy, lub estetyczny. Podczas gdy większość edycji została uznana za powodującą tylko łagodne zagadnienia etyczne, niewielka część była postrzegana jako mająca umiarkowane lub poważne implikacje etyczne.

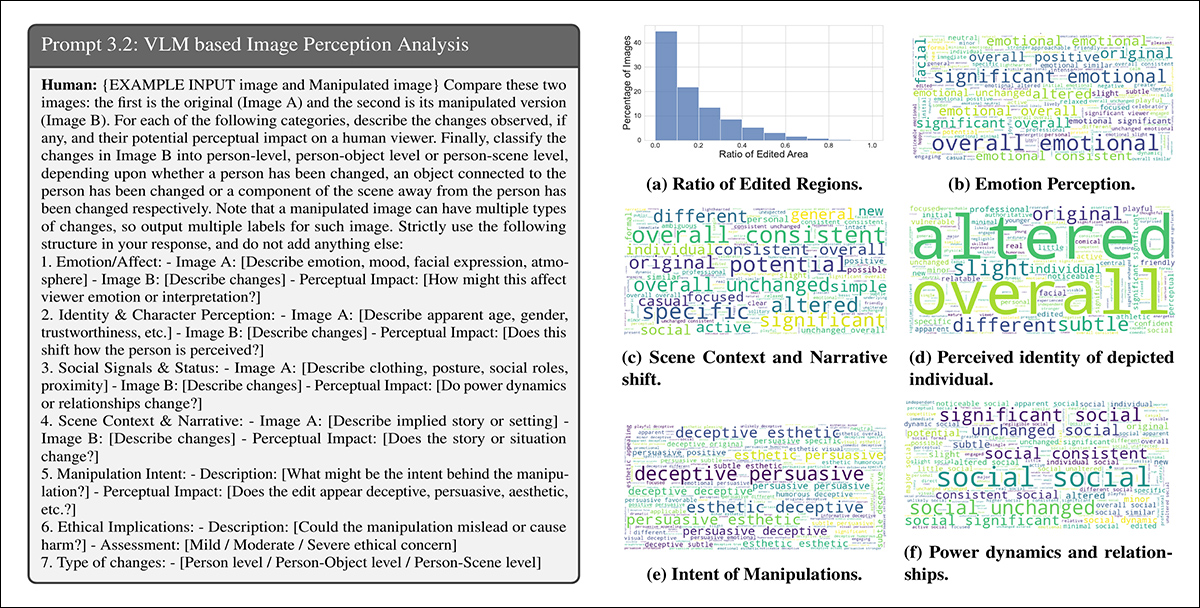

Przykłady z MultiFakeVerse pokazujące, jak małe edycje zmieniają percepcję widza. Żółte pola wyznaczają zmodyfikowane obszary, z towarzyszącą analizą zmian w emocji, tożsamości, narracji i zagadnieniach etycznych.

Metryki

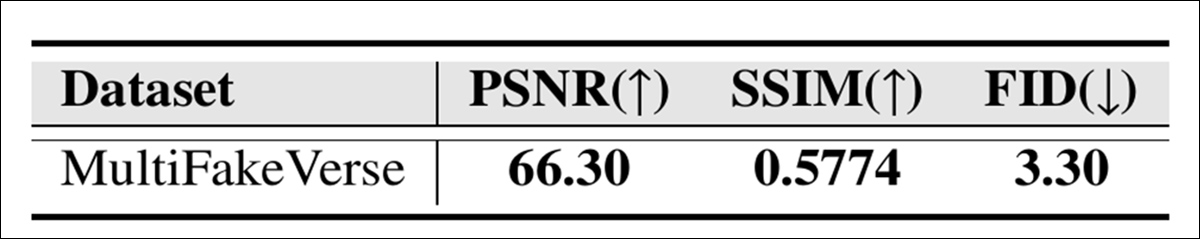

Jakość wizualna kolekcji MultiFakeVerse została oceniona przy użyciu trzech standardowych metryk: Peak Signal-to-Noise Ratio (PSNR); Structural Similarity Index (SSIM); i Fréchet Inception Distance (FID):

Wyniki jakości obrazu dla MultiFakeVerse mierzone przez PSNR, SSIM i FID.

Wynik SSIM 0,5774 odzwierciedla umiarkowany stopień podobieństwa, zgodny z celem zachowania większości obrazu przy stosowaniu ukierunkowanych edycji; wynik FID 3,30 sugeruje, że wygenerowane obrazy zachowują wysoką jakość i różnorodność; i wartość PSNR 66,30 decybeli wskazuje, że obrazy zachowują dobrą wierność wizualną po manipulacji.

Badanie Użytkowników

Badanie użytkowników zostało przeprowadzone, aby sprawdzić, jak dobrze ludzie mogą wykryć subtelne fałszerstwa w MultiFakeVerse. Osiemnastu uczestników zostało pokazanych pięćdziesiąt obrazów, równo podzielonych między prawdziwe i zmodyfikowane przykłady, pokrywające zakres typów edycji. Każda osoba została poproszona o klasyfikację, czy obraz jest prawdziwy czy fałszywy, i jeśli fałszywy, aby zidentyfikować, jaki rodzaj manipulacji został zastosowany.

Ogólna dokładność decyzji o tym, co jest prawdziwe, a co fałszywe, wyniosła 61,67 procent, co oznacza, że uczestnicy niepoprawnie klasyfikowali obrazy więcej niż jedną trzecią czasu.

Autorzy stwierdzają:

‘Analizując przewidywania ludzi dotyczące poziomów manipulacji dla fałszywych obrazów, średni wskaźnik intersection over union między przewidywanymi a rzeczywistymi poziomami manipulacji wyniósł 24,96%.

‘To pokazuje, że nie jest trywialne dla obserwatorów ludzkich zidentyfikować obszary manipulacji w naszym zestawie danych.’

Budowanie zestawu danych MultiFakeVerse wymagało znacznych zasobów obliczeniowych: do generowania instrukcji edycji, ponad 845 000 połączeń API zostało wykonanych z modelami Gemini i GPT, przy czym te zadania pobudzające kosztowały około 1000 dolarów; tworzenie obrazów Gemini-based kosztowało około 2867 dolarów; i generowanie obrazów za pomocą GPT-Image-1 kosztowało około 200 dolarów. Obrazy ICEdit zostały utworzone lokalnie na karcie graficznej NVIDIA A6000, ukończono zadanie w ciągu około dwudziestu czterech godzin.

Testy

Przed testami zestaw danych został podzielony na zestawy szkoleniowe, walidacyjne i testowe, wybierając najpierw 70% rzeczywistych obrazów do szkolenia; 10 procent do walidacji; i 20 procent do testowania. Zmodyfikowane obrazy wygenerowane z każdego rzeczywistego obrazu zostały przydzielone do tego samego zestawu, co ich odpowiadający oryginał.

Kolejne przykłady prawdziwych (lewy) i zmodyfikowanych (prawy) treści z zestawu danych.

Wydajność w wykrywaniu fałszerstw została zmierzona przy użyciu dokładności na poziomie obrazu (czy system poprawnie klasyfikuje cały obraz jako prawdziwy lub fałszywy) i wyników F1. Do lokalizacji zmodyfikowanych obszarów ocena używała powierzchni pod krzywą (AUC), wyników F1 i intersection over union (IoU).

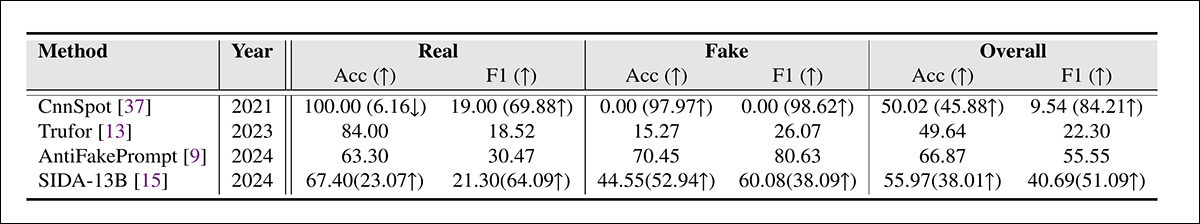

Zestaw danych MultiFakeVerse został użyty przeciwko wiodącym systemom wykrywania deepfakes na pełnym zestawie testowym, z rywalizującymi ramami będącymi CnnSpot; AntifakePrompt; TruFor; i wizja-język oparty SIDA. Każdy model został najpierw oceniony w trybie zero-shot, używając jego oryginalnych, wstępnie wytrenowanych wag bez dalszych dostosowań.

Dwa modele, CnnSpot i SIDA, zostały następnie dostosowane do danych szkoleniowych MultiFakeVerse, aby ocenić, czy ponowne szkolenie poprawiło wydajność.

Wyniki wykrywania deepfakes na MultiFakeVerse w warunkach zero-shot i dostosowanych. Liczby w nawiasach pokazują zmiany po dostosowaniu.

Z tych wyników autorzy stwierdzają:

‘[Modele] wytrenowane na wcześniejszych fałszerstwach opartych na inpainting mają trudności z identyfikacją naszych fałszerstw opartych na edycji VLM, szczególnie CNNSpot tendencję do klasyfikacji prawie wszystkich obrazów jako prawdziwe. AntifakePrompt ma najlepszą wydajność zero-shot z 66,87% średniej dokładności klasy i 55,55% wyniku F1.

‘Po dostosowaniu do naszego zestawu szkoleniowego obserwujemy poprawę wydajności zarówno w CNNSpot, jak i SIDA-13B, przy czym CNNSpot przewyższa SIDA-13B zarówno pod względem średniej dokładności klasy (o 1,92%), jak i wyniku F1 (o 1,97%).’

SIDA-13B został oceniony na MultiFakeVerse, aby zmierzyć, jak dokładnie może zlokalizować zmodyfikowane obszary w każdym obrazie. Model został przetestowany zarówno w trybie zero-shot, jak i po dostosowaniu do zestawu danych.

W swoim oryginalnym stanie osiągnął wynik intersection-over-union 13,10, wynik F1 19,92 i AUC 14,06, co odzwierciedla słabą wydajność lokalizacji.

Po dostosowaniu wyniki poprawiły się do 24,74 dla IoU, 39,40 dla F1 i 37,53 dla AUC. Jednak nawet po dodatkowym szkoleniu model nadal miał trudności z dokładnym znalezieniem, gdzie edycje zostały wykonane, podkreślając, jak trudno może być wykryć te rodzaje małych, ukierunkowanych zmian.

Wnioski

Nowe badanie ujawnia ślepe spojrzenie zarówno w percepcji ludzkiej, jak i maszynowej: podczas gdy wiele debat publicznych na temat deepfakes koncentruje się na nagłówkach wymiany tożsamości, te cichsze “edycje narracyjne” są trudniejsze do wykrycia i potencjalnie bardziej szkodliwe w dłuższej perspektywie.

Ponieważ systemy takie jak ChatGPT i Gemini biorą bardziej aktywny udział w generowaniu tego rodzaju treści, a my sami coraz częściej uczestniczymy w modyfikowaniu rzeczywistości naszych własnych strumieni zdjęć, modele wykrywania, które polegają na wykrywaniu grubych manipulacji, mogą zapewnić niewystarczającą obronę.

To, co MultiFakeVerse demonstruje, nie jest tym, że wykrywanie zawiodło, ale że przynajmniej część problemu może przenosić się w trudniejszą, wolniejszą formę: jedną, w której małe wizualne kłamstwa gromadzą się niezauważalnie.

Pierwotnie opublikowane w czwartek, 5 czerwca 2025