Kąt Andersona

Filtry piękności są potencjalnym narzędziem ataku Deepfake

Filtry piękności robią teraz więcej niż tylko ukrywają niedoskonałości: mogą pomóc deepfake’om i morfingom przekrać się przez systemy wykrywania. Nowe badanie pokazuje, że nawet delikatne efekty wygładzania dezorientują detektory AI, sprawiając, że fałszywe obrazy wyglądają jak prawdziwe, a prawdziwe wyglądają jak fałszywe. Jeśli tendencja się utrzyma, filtry piękności mogą stanowić ograniczenia w kontekstach o wysokich stawkach, od kontroli granicznej do spotkań korporacyjnych na platformie Zoom.

W współpracy akademickiej z 2024 roku pomiędzy Hiszpanią a Włochami, badacze donieśli, że 90% kobiet w wieku od 18 do 30 lat używało filtrów piękności przed publikowaniem zdjęć w mediach społecznościowych. W tym sensie, filtry piękności są algorytmicznymi lub wspomaganymi przez AI metodami zmiany wyglądu twarzy, tak aby był on rzekomo udoskonalony w stosunku do oryginału:

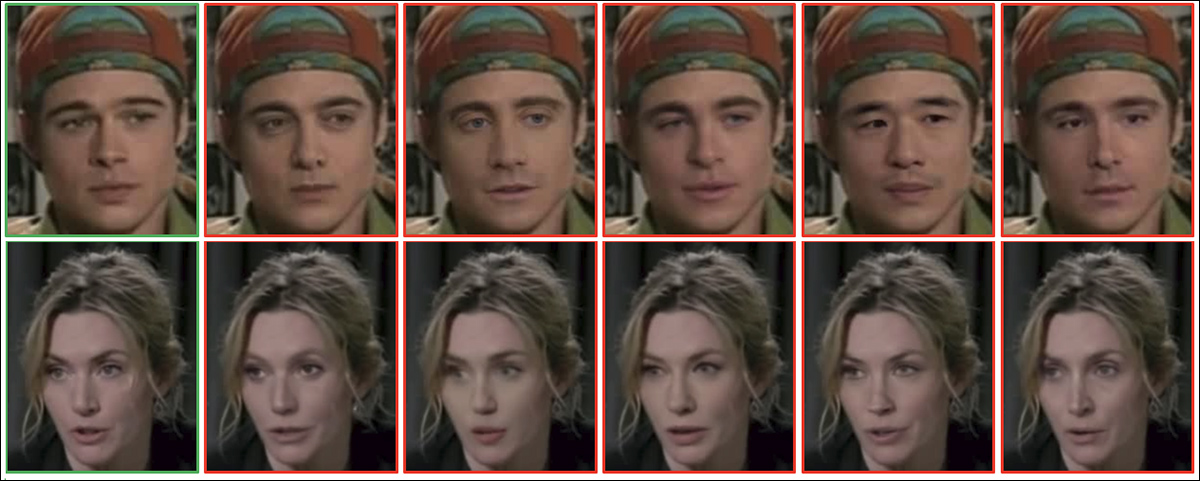

Z badań z 2024 roku: przykładowe twarze kobiece (po lewej) i męskie (po prawej) przed i po zastosowaniu filtrów piękności. Filtr zmienił takie cechy, jak odcień skóry, oczy, nos, usta, brodę i kości policzkowe, aby zwiększyć postrzeganą atrakcyjność. Źródło: https://arxiv.org/pdf/2407.11981

Tego typu filtry są również powszechnie dostępne jako funkcjonalność natywna lub dodatkowa w popularnych systemach wideo, w tym Snapchat i Zoom, oferując możliwość wygładzania “nieidealnej” skóry, a nawet zmiany wieku osoby, aż do punktu, w którym tożsamość może być znacznie zmieniona:

Kliknij, aby odtworzyć: trzy kobiety wyłączają swoje filtry “piękności” wideo, ujawniając, w jakim stopniu ich fizjonomia jest zmieniana przez algorytmy lub AI. Źródło: https://www.youtube.com/watch?v=gtCpea_5qxw

Zjawisko to wydawało się osiągać punkt nasycenia, jak tylko technologia była względnie dojrzała; badanie z 2020 roku z City University of London ujawniło, że 90% młodych użytkowników Snapchat w Stanach Zjednoczonych, Francji i Wielkiej Brytanii używało filtrów w swoich aplikacjach, podczas gdy Meta zgłosiła, że ponad 600 milionów młodych ludzi używało filtrów na Facebooku lub Instagramie.

Badając negatywne skutki takich filtrów na zdrowie psychiczne, raport Psychology Today powtórzył, że spośród badanych, 90% młodych kobiet, ze średnim wiekiem 20 lat, albo używało filtrów, albo w jakiś sposób edytowało swoje zdjęcia. Najpopularniejsze filtry były te, które służyły do wyrównania odcienia skóry; nadania opalenizny; wybielenia zębów; oraz nawet zmniejszenia rozmiaru ciała.

Starcie

Ponieważ filtry twarzy są nastawione na korzyści z rewolucji z 2025 roku w syntezie wideo, a ogólnie z trwającym zainteresowaniem tym sektorem badań, stopień, w jakim możemy “odtworzyć” lub wyobrazić sobie siebie w rozmowach wideo, coraz bardziej ociera się o obawy społeczności bezpieczeństwa dotyczące fałszywych lub przestępczych technik wideo Deepfake.

Jednym z problemów jest to, że cały zakres ‘łatwych’ testów opracowanych w ostatnich latach w celu ujawnienia fałszywego wideo, które może być wykorzystywane do oszustw w kontekście korporacyjnym, staje się niezbędnie mniej skuteczne, ponieważ te słabości są uwzględniane w danych szkoleniowych i czasie inferencji:

Kliknij, aby odtworzyć: trzy lub cztery lata temu, machanie ręką przed fałszywą twarzą było niezawodnym testem dla połączeń wideo, ale możemy zobaczyć, że dedykowane wysiłki ze strony TikTok robią głębokie postępy w klasycznych “powiadaniach”. Źródło: Ibid i https://archive.is/mofRV#wavehands

Co gorsza, powszechne używanie filtrów zmieniających lub zmieniających piękność twarzy zaciemnia wody dla nowej i wschodzącej generacji detektorów Deepfake, których zadaniem jest utrzymanie oszustów poza wideorozmowami w sali konferencyjnej i z dala od potencjalnych ofiar ‘porwania’ i ‘oszustwa.

Łatwiej jest stworzyć przekonywujące Deepfake, czy to zdjęcie, czy wideo, jeśli rozdzielczość obrazu jest niska lub obraz jest w jakiś sposób zdegradowany, ponieważ podstawowy system fałszerstwa może ukryć swoje własne niedociągnięcia za tym, co wydaje się problemami z łącznością lub platformą.

W efekcie, najpopularniejsze filtry piękności usuwają niektóre z najbardziej przydatnych materiałów w identyfikowaniu Deepfake’ów wideo, takich jak tekstura skóry i inne obszary szczegółów twarzy – i warto rozważyć, że im starsza twarz, tym więcej takich szczegółów zawiera, a zatem użycie filtrów odmładzających może być szczególną pokusą w takim przypadku.

Jeśli wygląd pozbawiony szczegółów, ‘androidalny’, jest w modzie, detektory Deepfake mogą nie mieć materiału, którego potrzebują, aby odróżnić prawdziwe i fałszywe obrazy i wideo postacie. Źródło: https://www.instagram.com/reel/DMyGerPtTPF/?hl=en

Papier The Royal Society z późnego 2024 roku Co jest piękne, jest nadal dobre: efekt aureoli atrakcyjności w erze filtrów piękności potwierdził, że użycie filtrów powszechnie zwiększa ogólną atrakcyjność zarówno u mężczyzn, jak i u kobiet (chociaż zwiększona atrakcyjność ma tendencję do obniżania ogólnej oceny inteligencji u kobiet z filtrem piękności).

Dlatego też można powiedzieć, że jest to popularna technologia; że działa; i że byłoby to rodzajem szoku kulturowego, gdyby nagle stała się przedmiotem ograniczeń bezpieczeństwa lub była zabroniona w różnych kontekstach.

Niemniej jednak, w okresie, w którym wideo Deepfake zagrażają, by stać się nieodróżnialne od prawdziwych uczestników wideo, zarówno pod względem wyglądu, jak i mowy, możliwe, że globalny “szum” z filtrów piękności może musieć być złagodzony w przyszłości, ze względów bezpieczeństwa.

Łagodni przestępcy

Problem został najnowszej zbadany w nowym artykule z Uniwersytetu w Cagliari we Włoszech, zatytułowanym Deceptive Beauty: Evaluating the Impact of Beauty Filters on Deepfake and Morphing Attack Detection.

W nowym badaniu, badacze zastosowali filtry piękności do twarzy z dwóch zbiorów danych benchmarkowych i przetestowali kilka detektorów Deepfake i ataków morfingu na oryginalnych i zmodyfikowanych obrazach.

W niemal każdym przypadku, dokładność wykrywania spadła po zabiegu piękności; najbardziej dramatyczne spadki wystąpiły, gdy filtry wygładzały zmarszczki, rozjaśniały odcień skóry lub delikatnie zmieniały rysy twarzy. Te zmiany usunęły lub zniekształciły same sygnały, na których polegają modele wykrywania.

Na przykład, najlepszy model na MorphDB stracił ponad 9% dokładności po zastosowaniu filtra, a problem utrzymywał się w wielu architekturach wykrywania, wskazując, że obecne systemy nie są odporne na powszechne kosmetyczne udoskonalenia.

Autorzy konkludują:

‘[Filtry piękności] stanowią zagrożenie dla integralności systemów uwierzytelniania biometrycznego i analizy sądowej, sprawiając, że wykrywanie Deepfake i ataków morfingu w takich warunkach jest krytycznym otwartym wyzwaniem.

‘Przyszłe badania powinny priorytetowo traktować rozwój systemów wykrywania manipulacji cyfrowych, które są odporne na takie subtelne, realne zmiany, niezależnie od ich zamiaru, aby zapewnić niezawodne rozpoznanie tożsamości i weryfikację zawartości w kontekstach codziennych i krytycznych dla bezpieczeństwa.’

Metoda i dane

Aby ocenić, jak filtry piękności wpływają na wykrywanie Deepfake i morfingu, badacze zastosowali filtr wygładzający do obrazów testowych i przetestowali wyniki na dwóch sieciach neuronowych (CNN) dobrze skorelowanych z problemem docelowym: AlexNet i VGG19.

Każda z dwóch zbiorów danych testowych zawierała przykłady odpowiednich manipulacji twarzy. Pierwszy to CelebDF, duży zbiór wideo zawierający 590 prawdziwych i 5 639 sfałszowanych klipów utworzonych za pomocą zaawansowanych technik zamiany twarzy. Zbiór oferuje szeroki zakres warunków oświetleniowych, pozycji głowy i naturalnych wyrazów twarzy wśród 59 osób, co sprawia, że jest on dobrze przystosowany do oceny wytrzymałości detektorów Deepfake w realnych scenariuszach multimedialnych:

Przykładowe obrazy twarzy, z CelebDF. Źródło: https://github.com/yuezunli/celeb-deepfakeforensics

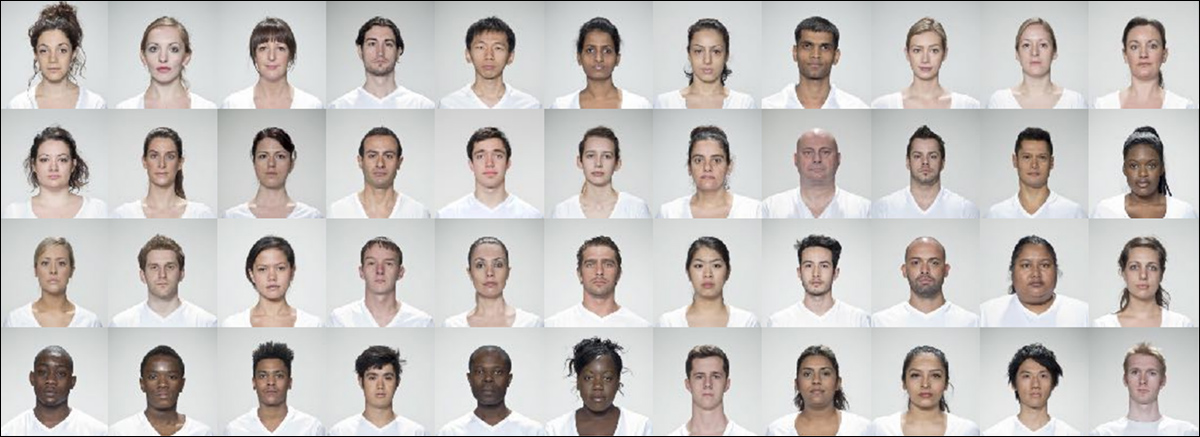

Drugi to AMSL (wymaga rejestracji), zbiór ataków morfingu zbudowany z kolekcji Face Research Lab London, zawierający zarówno prawdziwe, jak i syntetycznie zmieszane twarze. Zbiór zawiera wyrazy neutralne i uśmiechnięte z 102 osób i został opracowany w celu odzwierciedlenia realistycznych wyzwań dla systemów uwierzytelniania biometrycznego w kontekstach takich jak kontrola graniczna.

Obrazy z oryginalnego zbioru Face Research Lab London (FRLL), wykorzystanego w AMSL. Źródło: https://figshare.com/articles/dataset/Face_Research_Lab_London_Set/5047666?file=8541955

Każda sieć była trenowana na 80% zbioru danych Deepfake lub morfingu, a pozostałe 20% wykorzystano do walidacji. Aby przetestować wytrzymałość na filtry piękności, badacze zastosowali filtr wygładzający do obrazów testowych, zwiększając promień rozmycia z 3% do 5% wysokości twarzy:

Przykładowe twarze z CelebDF (góra) i AMSL (dół), pokazane przed i po zastosowaniu filtru piękności opartego na wygładzaniu. Promień filtra został skalibrowany względem wysokości twarzy, z c = 3% i c = 5% dając coraz silniejsze efekty.

Jeśli chodzi o metryki, każdy model został oceniony przy użyciu współczynnika błędu (EER) na oryginalnych i urodzonych próbkach testowych. Analiza również zgłosiła Bona Fide Presentation Classification Error Rate (BPCER), czyli fałszywą szybkość pozytywną, i Attack Presentation Classification Error Rate (APCER), czyli fałszywą szybkość negatywną, przy progu ustalonym na podstawie danych oryginalnych:

Obrazy morfingu z AMSL.

Aby lepiej ocenić wyniki, badacze przeanalizowali również obszar pod krzywą ROC i rozkład punktacji dla prawdziwych i fałszywych obrazów.

Testy

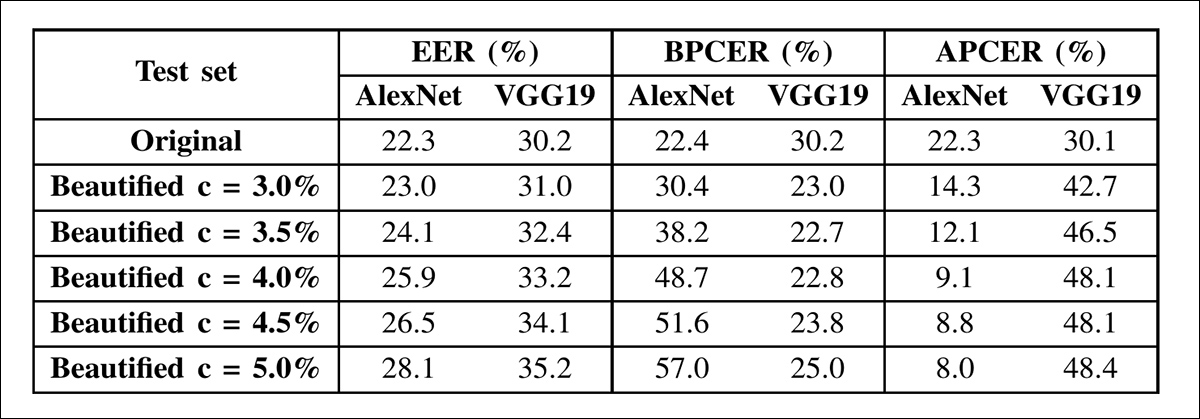

W wynikach wykrywania Deepfake, obie sieci wykazały rosnące współczynniki błędu wraz ze zwiększaniem się intensywności piękności. Współczynnik błędu AlexNet wzrósł z 22,3% na oryginalnych obrazach do 28,1% na najwyższym poziomie wygładzania, podczas gdy VGG19 zwiększył się z 30,2% do 35,2%. Spadek wydajności następował według różnych wzorców w każdym przypadku:

Wyniki wykrywania Deepfake na zbiorze CelebDF przy użyciu AlexNet i VGG19. Obie sieci zostały przetestowane na oryginalnych i urodzonych obrazach z rosnącym poziomem wygładzania twarzy. Metryki obejmują współczynnik błędu (EER), Bona Fide Presentation Classification Error Rate (BPCER) i Attack Presentation Classification Error Rate (APCER), przy progach ustalonych na podstawie oryginalnych danych testowych. Dokładność wykrywania spadła wraz ze zwiększaniem się intensywności piękności, chociaż wzorzec degradacji różnił się między architekturami.

Podczas zwiększania się piękności, AlexNet stawał się coraz bardziej skłonny do mylenia prawdziwych twarzy z fałszywymi, co widać w stałym wzroście fałszywej szybkości pozytywnej (BPCER). VGG19, z drugiej strony, głównie miał trudności z wykryciem fałszywych twarzy, co skutkowało rosnącą fałszywą szybkością negatywną (APCER). Obie sieci reagowały inaczej na filtry, wskazując, że nawet dobrze znane architektury mogą zawieść na różne sposoby, gdy są konfrontowane z kosmetycznymi modyfikacjami.

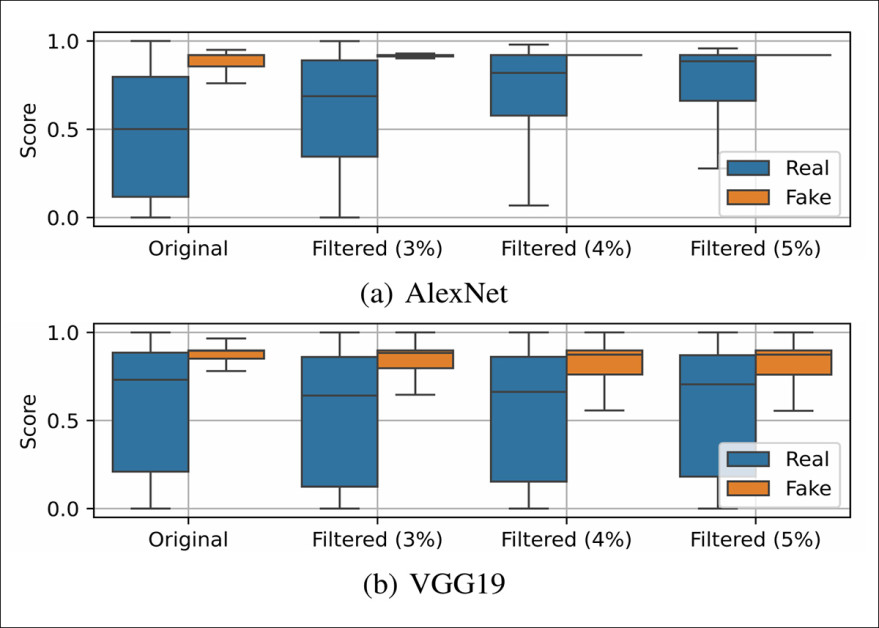

Aby lepiej zrozumieć te wyniki, badacze zastosowali filtr piękności oddzielnie do prawdziwych i fałszywych obrazów i zmierzyli wpływ na wyniki wykrywania. Ten podział, przedstawiony w poniższej tabeli wyników, wyjaśnia źródło wrażliwości każdego modelu:

Dokładność wykrywania dla AlexNet i VGG19 podczas częściowego zastosowania piękności na zbiorze CelebDF. Tabela raportuje trzy scenariusze: urodzone prawdziwe vs urodzone fałszywe (F-Real vs F-Fake); urodzone prawdziwe vs oryginalne fałszywe (F-Real vs O-Fake); oraz oryginalne prawdziwe vs urodzone fałszywe (O-Real vs F-Fake), z spadkiem dokładności wskazującym na obniżoną wydajność detektora. AlexNet był najbardziej dotknięty, gdy prawdziwe obrazy były urodzone, podczas gdy VGG19 miał największe trudności, gdy filtry były stosowane do fałszywych obrazów.

Dla AlexNet, wyniki wykrywania spadły, gdy prawdziwe obrazy były urodzone, ale poprawiły się, gdy tylko fałszywe obrazy były wygładzane. Dla VGG19, wyniki poprawiły się nieznacznie z urodzonymi prawdziwymi obrazami, ale pogorszyły się, gdy Deepfake były filtrowane. We wszystkich przypadkach, silniejsze piękności redukowały dokładność.

Wykresy pudełkowe pokazujące rozkład punktacji wyjściowych AlexNet i VGG19 na prawdziwych i fałszywych próbkach z CelebDF, podczas zwiększania się piękności. Im silniejsze wygładzanie, tym mniej rozróżnialne są rozkłady punktacji dla prawdziwych i fałszywych obrazów, wskazując na obniżoną niezawodność wykrywania. AlexNet staje się mniej pewny w identyfikowaniu prawdziwych twarzy, podczas gdy VGG19 staje się bardziej skłonny do błędnej klasyfikacji fałszywych.

Artykuł stwierdza:

‘Te wyniki mają istotne implikacje i ujawniają, że konieczne jest uwzględnienie potencjalnego zastosowania filtrów piękności w wykrywaniu Deepfake, ponieważ mogą one mieć nieprzewidywalny wpływ na wyniki. W szczególności, różne architektury reagują inaczej na manipulacje twarzy, nawet jeśli te manipulacje nie są przeznaczone do oszustwa.

‘Na przykład, w zależności od konkretnego detektora Deepfake, filtry piękności mogą znacznie zmienić wynik, sprawiając, że prawdziwe obrazy są identyfikowane jako fałszywe, a co gorsza, pozwalając Deepfake oszukać wykrywanie.

‘Dlatego konieczne jest skupienie się na rozwoju detektorów, które są bardziej odporne na takie subtelne, niekoniecznie złowrogie modyfikacje, które mogą służyć jako kamuflaż dla złowrogich manipulacji Deepfake.’

W scenariuszu ataku morfingu, syntetyczne obrazy zostały utworzone przez połączenie cech twarzy dwóch osób. Obrazy te zostały wykorzystane do oszukania systemów rozpoznawania twarzy, umożliwiając obu osobom uwierzytelnienie się jako ta sama osoba. Takie ataki są uważane za szczególnie istotne w kontekstach bezpieczeństwa, gdzie systemy biometryczne mogą być mylone i akceptują morfowaną twarz do oficjalnej identyfikacji.

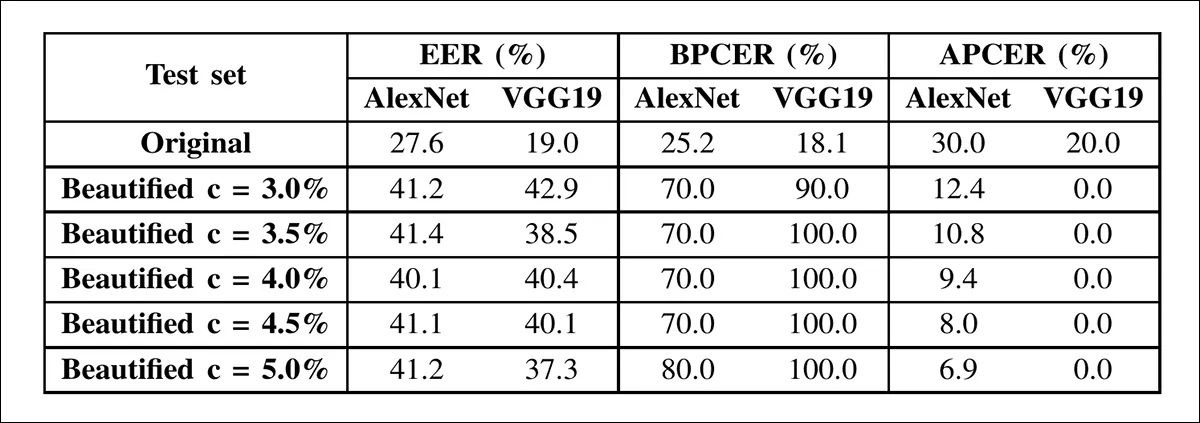

Tabela powyżej pokazuje wyniki wykrywania ataków morfingu na obrazach AMSL przed i po zastosowaniu piękności, z obiema sieciami wykazującymi gwałtowny wzrost błędów wraz ze zwiększaniem się intensywności wygładzania.

W scenariuszu ataku morfingu, wyniki uległy większemu pogorszeniu niż w wykrywaniu Deepfake. Współczynnik błędu AlexNet wzrósł z 27,6% do 41,2%, a VGG19 z 19,0% do 37,3%, głównie z powodu fałszywych pozytywów: prawdziwe twarze zostały błędnie sklasyfikowane jako morfy. Przy promieniu wygładzania 3%, fałszywa szybkość pozytywna VGG19 osiągnęła 90%.

Ten wzorzec utrzymywał się, gdy filtry były stosowane selektywnie. Wygładzanie prawdziwych twarzy pogorszyło wykrywanie, podczas gdy wygładzanie tylko morfowanych twarzy poprawiło wyniki. Im silniejsze wygładzanie, tym mniej rozróżnialne były rozkłady punktacji dla prawdziwych i fałszywych obrazów, a VGG19 stał się szczególnie niestabilny.

Te wyniki, jak wskazują autorzy, sugerują, że filtry piękności mogą pomóc morfom uniknąć wykrycia jeszcze skuteczniej niż Deepfake, co budzi poważne obawy bezpieczeństwa.

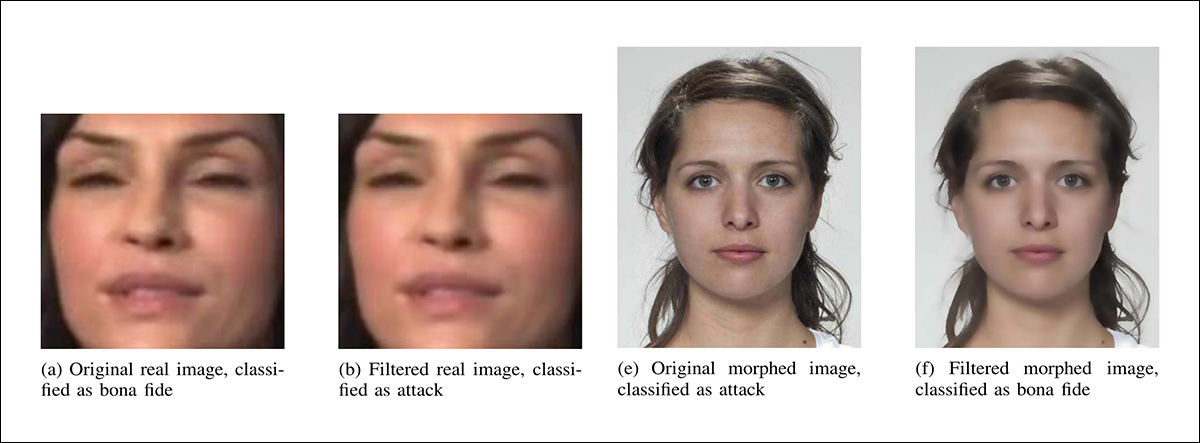

Częściowe przykłady (ze względu na brak miejsca) tego, jak minimalne piękności (promień wygładzania 3%) zmieniły klasyfikację AlexNet. Po lewej, prawdziwy obraz został błędnie sklasyfikowany jako atak po zastosowaniu filtra, a po prawej, morfowany obraz został błędnie sklasyfikowany jako autentyczny po zastosowaniu filtra.

Wreszcie, badacze stwierdzili, że nawet łagodne filtry piękności mogą znacznie pogorszyć wyniki detektorów Deepfake i morfingu.

Wpływ różnił się w zależności od architektury, przy czym AlexNet wykazywał stopniowy spadek, a VGG19 załamał się przy minimalnym filtrowaniu. Ponieważ filtry te są powszechne i nie są wewnętrznie złowrogie, ich zdolność do ukrywania ataków stanowi, jak sugerują autorzy, praktyczne zagrożenie, szczególnie w systemach biometrycznych. Artykuł podkreśla potrzebę modeli wykrywania, które są odporne na takie subtelne manipulacje obrazu.

Podsumowanie

Jednym z powodów, dla których może być trudno trenować systemy wykrywania Deepfake, które mogą ignorować filtry piękności, jest brak materiału kontrastowego; ostatecznie wersja “urodzona” jest tą, która jest powszechnie rozpowszechniana, a w przeciwieństwie do wideo, które osadziliśmy wcześniej jako ilustrację, jest bardzo rzadkie, aby “przed” zdjęcie zostało zastosowane.

Inną przeszkodą jest to, że wiele filtrów wykonuje dokładnie ten sam rodzaj wygładzania, co operacje kompresji podczas zapisywania obrazów lub kompresji wideo (co jest korzystne dla dostawców pasma, oprócz cyfrowego liftingu dla tych, którzy używają filtra).

Sektor badań nad wykrywaniem Deepfake jest już głęboko zaangażowany w zwalczanie przypadków rzeczywistego pogorszenia jakości obrazu z powodu problemów takich jak słaba jakość kamer, nadmierna kompresja lub złe połączenie sieciowe – wszystkie te warunki są bezpośrednim korzystaniem dla oszustów Deepfake, którzy są zmuszeni do większych starań w scenariuszu o wysokiej jakości i wysokiej rozdzielczości.

Czy filtry piękności ostatecznie staną się zagrożeniem bezpieczeństwa wydaje się zależeć od stopnia, w jakim okazują się przeszkodą dla metod wykrywania Deepfake, czy ostatecznie staną się rodzajem de facto firewalla, który będzie bardziej korzystny dla malwersantów niż dla tych, którzy z nimi walczą.

Po raz pierwszy opublikowane w środę, 24 września 2025