Liderzy opinii

Atak wstrzyknięcia promtu, którego nie można powstrzymać: marzycielstwo czy prawdziwa obawa?

W tym artykule chciałbym zaangażować czytelnika w eksperyment myślowy. Chcę argumentować, że w nieodległej przyszłości pewnego rodzaju atak wstrzyknięcia promtu będzie skutecznie nie do powstrzymania. Mój argument będzie bardziej spekulatywny niż konkretny, więc nie próbuję przekonać Was do niczego. Zamiast tego zapraszam do eksploracji tych myśli. Przed rozpoczęciem, jak każdy przekonywujący pisarz, chcę omówić szachy i silniki szachowe.

Superludzkie silniki szachowe i twierdzenie o doświadczeniu ludzkim

Jednym z ładniejszych elementów szachów, który brakuje w innych dyscyplinach, jest możliwość obiektywnego pomiaru jakości lub siły gracza. System ELO używany do tego celu ma swoje wady, ale dostarcza bardzo dobrego szacunku, który utrzymuje się w czasie. Ocena 2700 lub wyższa jest powszechnie uznawana za światowej klasy (top 30 na świecie). Najlepszy gracz świata ma ocenę nieco poniżej 2850. Żaden człowiek nie osiągnął oceny 2900.

W połowie lat 90. zobaczyliśmy pierwszy silnik AI (Deep Blue), który osiągnął światową klasę. Praktyczną implikacją tego kamienia milowego była szeroka adopcja silników przez graczy wszystkich poziomów do ćwiczeń i analizy. W rzeczywistości użycie silnika stało się niezbędne dla najlepszych graczy świata. Jednak dla kilku generacji tych silników światowej klasy przeglądanie ich zalecanych ruchów (tj. wyjścia) było imperatywne. Istniał nawet specjalny format nazwany „zaawansowanymi szachami”, w którym ludzie rywalizowali z silnikiem u boku, a kombinacja człowiek-maszyna była uważana za lepszą niż sam silnik.

Minęło około 20 lat, i pewien postęp w głębokim uczeniu i uczeniu wzmacnianym, zanim silniki szachowe osiągnęły ponadludzki poziom (około 3200 ELO). Ale kiedy tylko ta sfera została przełamana około 2017 roku, stało się coś bardzo zaskakującego. Czyli tak naprawdę dwie rzeczy. Pierwsza była całkowicie oczekiwana; silniki stały się de facto źródłem „prawdy” w 99% wszystkich pozycji. W praktyce oznaczało to, że weszliśmy w „erę ślepej ufności” w silnik. Dziś jest praktycznie niemożliwe, aby człowiek zaproponował znacznie lepszy ruch niż silnik. Jak zabawne były „zaawansowane szachy”, teraz jest to bezsensowne ćwiczenie; ludzie prawie nic nie wnoszą do gry. Ale druga rzecz była zaskakująca dla większości graczy szachowych. Te nadludzkie neuronalne (tj. głębokie sieci neuronowe) silniki czasami grały w stylu, który najlepiej można opisać jako „romantyczny”. Innymi słowy, robiły ruchy, których wartość mogła być doceniona dopiero po wielu, wielu ruchach, daleko poza tym, co mógłby obliczyć człowiek lub silniki światowej klasy. To bardzo przypominało, jakby silniki rozwinęły „uczucie” lub „intuicję” dla pewnych pozycji. Z wyjątkiem tego, że ta intuicja nie jest czymś, co człowiek mógłby kiedykolwiek zrozumieć lub naśladować.

Inaczej mówiąc, nadludzki silnik neuronalny może robić ruchy, które są poza poznawczym horyzontem człowieka. To jest kluczowy punkt; problem nie polega na wyjaśnialności. Raczej, człowiek po prostu nie może zrozumieć, dlaczego silnik poleca ruch bez zagrania pozycji i obserwowania wyniku wiele ruchów później, tj. rozwinąwszy całą trajektorię możliwych sekwencji gry. W wyniku tego mamy nieprzekraczalną lukę w zdolnościach. Jest optymalnie akceptować wyjście silnika bez przeglądu. Mogę podsumować swoje twierdzenie w następujący sposób:

Szachy są dowodem istnienia, że sztuczna inteligencja o poziomie nadludzkim będzie skutecznie działać autonomicznie w niektórych dziedzinach. Włączenie systemu AI do podejmowania decyzji bez przeglądu ludzkiego będzie optymalnym sposobem wdrożenia takiego systemu.

Ponieważ moje twierdzenie może wydawać się oczywiste lub niegodne uwagi, chcę podkreślić kilka niuansów. Załóżmy, że mamy system AI, który wykazuje poziom nadludzki w złożonym, krytycznym zadaniu z konkretnymi, nieodwracalnymi konsekwencjami. Są dwie implikacje mojego twierdzenia:

- System będzie wdrożony do podejmowania decyzji dla zadania bez przeglądu ludzkiego, pomimo wewnętrznego ryzyka

- Wgląd uzyskany z monitorowania takiego systemu nie zapobiegnie szkodliwej decyzji; szkoda już zostałaby wyrządzona

Przegląd wyjścia i monitorowanie są właśnie dwoma ostatnimi warstwami obrony przed atakami wstrzyknięcia promtu. Dlatego nasz hipotetyczny atak wstrzyknięcia promtu mógłby ominąć te warstwy, celując w odpowiedni system.

To jest bardzo realistyczny scenariusz w moim umyśle. System AI o poziomie nadludzkim w określonej dziedzinie nie jest AGI, a większość ekspertów uważa, że takie systemy są już nieopodal. Nie musimy również zakładać, że decyzje są niecierpiące zwłoki, tylko że zadanie jest wystarczająco złożone, aby przegląd ludzki był niewykonalny.

Oczywiście, dotychczas ominęliśmy tylko dwie warstwy obrony, a na szczęście dla nas, kilka innych zostało opracowanych. Aby rozwiązać resztę, wejdźmy w podstawowe elementy, które sprawiają, że wstrzyknięcie promtu jest trudne do obrony.

Co to jest wstrzyknięcie promtu?

Wstrzyknięcie promtu jest manipulacją duzym modelem językowym (LLM) za pomocą spreparowanych wejść, powodując, że LLM nieświadomie wykonuje intencje atakującego. Może być uważane za inżynierię społeczną dla AI. Co istotne, nie jest to konwencjonalny błąd oprogramowania. Atak wstrzyknięcia promtu wykorzystuje wrodzoną lukę w zabezpieczeniach LLM. Ponieważ LLM przetwarza zarówno prompty systemowe, jak i użytkownika jako sekwencje tekstu, nie może wewnętrznie odróżnić prawidłowych i szkodliwych instrukcji. Luka jest zatem skutecznie zaprojektowana, a nie przypadkowa.

Techniki wstrzyknięcia promtu

Wstrzyknięcie promtu jest ogólnie uznawane za #1 ryzyko dla aplikacji LLM. Są kilka powodów, dla których jest to przypadku. Najbardziej oczywistym czynnikiem jest różnorodność technik wstrzyknięcia, które zostały opracowane. Grupując je w przybliżeniu w cztery kategorie, najbardziej znane techniki obejmują:

- Składniowe: korzystanie ze specjalnych znaków, emotikon lub alternatywnego języka

- Pośrednie: korzystanie z zewnętrznych źródeł (pobieranie ze strony), kodowania (base 64), lub multimodalnego odniesienia (tekst w obrazie)

- „Udajmy”: wprowadzanie manipulatywnego stylu, np. poprzez role-playing, hipotetyczne, apel emocjonalny, ramy etyczne i zmianę formatu

- Otwarte: jawne próby „przymuszenia” instrukcji modelu za pomocą siły, wzmocnienia lub negatywnego promtu

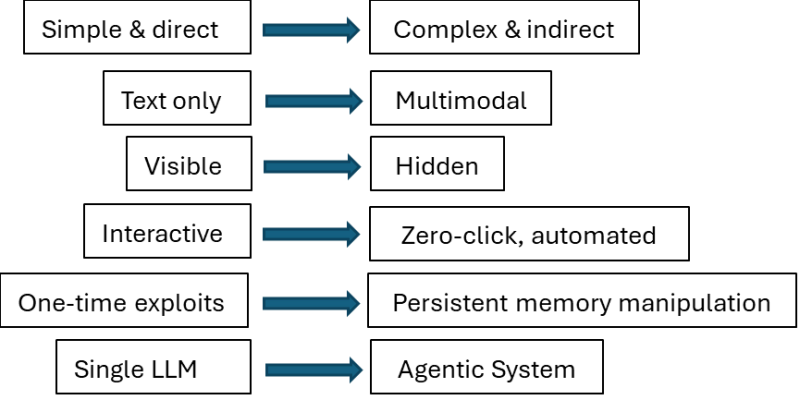

Samą różnorodność stanowi wyzwanie dla deweloperów aplikacji, ale te ataki również ewoluowały bardzo szybko. Lewa strona poniższego diagramu opisuje stan sztuki na początku 2023 roku, podczas gdy prawa strona odzwierciedla naturę ataków dzisiaj.

Deweloperzy aplikacji LLM muszą również wziąć pod uwagę standardowy kompromis pomiędzy użytecznością a bezpieczeństwem. Mogliby na przykład wprowadzić każdą odpowiednią warstwę obrony i wzorzec projektowy, ale jaką byłoby to kosztem? Warstwy obrony dodają znaczne opóźnienia i wprowadzają fałszywie pozytywne wyniki (FP) – niesłusznie oznaczające bezpieczne prompty jako szkodliwe – oba czynniki mają negatywny wpływ na doświadczenie użytkownika. W rezultacie pewien kompromis jest nieunikniony w praktyce, a nie ma „srebrnej kuli” rozwiązania.

Jednak w tym artykule nie jestem zainteresowany tym niekończącym się kotem i myszą. Raczej, próbuję sprawdzić, czy atak może być nie do powstrzymania w zasadzie. Z perspektywy dewelopera/obrońcy jest tylko jeden kluczowy wgląd:

Separacja instrukcji od danych w promcie jest fundamentalna do rozwiązania ryzyka wstrzyknięcia promtu

Możemy założyć, że kompromisy nie są czynnikiem, i każda warstwa obrony lub technika może być użyta. Pod tym (silnym) założeniem, czy jest możliwe stworzenie scenariusza, w którym separacja instrukcji-danych w promcie jest skutecznie niemożliwa?

Analogia DNA

Gdy tylko problem został sformułowany w kategoriach separacji instrukcji-danych, moja pierwsza myśl była użycie biologii jako analogii.

Rozważ komórkę i odcinek DNA (znanego jako gen). Gen dostarcza instrukcji dotyczących budowy białka za pomocą transkrypcji i translacji. On również koduje informacje (dane), które wpływają na strukturę i funkcję białka. Jak tak się zastanawiam. Jednak to po prostu fałszywe, ponieważ gen nie decyduje, jak interpretować samego siebie. Nie ma odpowiednika śledzenia instrukcji w biologii na poziomie genu. „Jak” jest w pełni zewnętrzne dla maszyn komórkowych.

Dlatego nawet jeśli nie mogę pozbyć się uczucia, że przyszłe generacje LLM – lub bardziej dokładnie, systemy, które z nich ewoluują – będą przypominać biologiczne maszyny w znacznie większym stopniu, proponowana analogia po prostu nie działa. Nie możemy substytuować komórki z LLM i genu z promtem, a następnie wykonać wstrzyknięcie do genu, które ostatecznie spowodowałoby „uszkodzone” białko. Wydaje się bardziej produktywne, aby przyklejać się do języka naturalnego i zadań, które wymagają semantycznej interpretacji.

Zdejmowanie warstw obrony

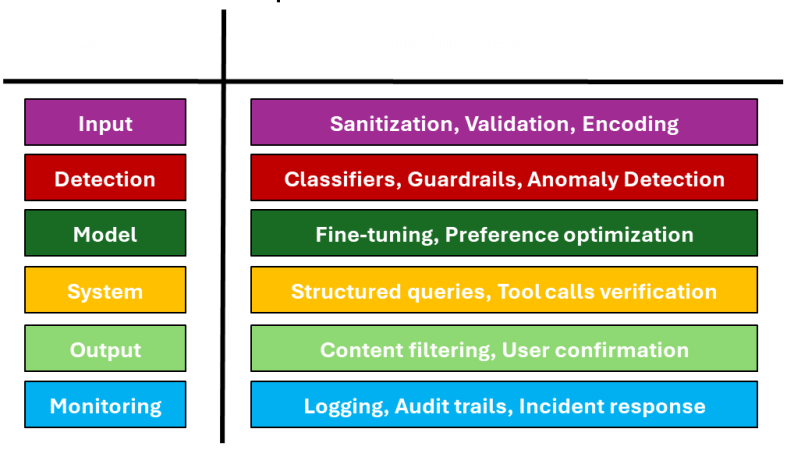

Nie powinno to być zaskoczeniem, że wielowarstwowe strategie obronne są uważane za bardziej skuteczne w zatrzymywaniu ataków wstrzyknięcia promtu. Poniższy obraz pokazuje najczęstsze warstwy obronne w kolejności, a także związane z nimi techniki używane w każdej warstwie.

Już omówiliśmy dwie ostatnie warstwy (wyjście, monitorowanie) powyżej, więc skupmy się na pierwszych czterech.

Rozważając warstwę wejściową, jest rozsądnie założyć, że sanityzacja lub walidacja promtu będzie dość skuteczna w wykrywaniu pośrednich ataków. Jednak jeśli wstrzyknięcie jest dostarczane bezpośrednio, a jak sugerowałem powyżej, polegając na semantycznej interpretacji, sanityzacja jest nieistotna (nic do sanityzacji), a walidacja jest niemożliwa domyślnie, ponieważ obliczenie musi zostać ukończone, aby zidentyfikować problem.

Istnieją praktycznie nieograniczone możliwości budowy barier ochronnych w warstwie wykrywania. Można nawet użyć dedykowanego LLM do wykrywania wstrzyknięcia. Ale ponownie, będzie to trudne dla klasyfikatora lub wykrywacza anomalii, aby oznaczyć promt jako podejrzany, gdy trucizna jest sprytnie ukryta w semantyce.

Warstwa modelu może być dość skuteczna, gdy zakres zadań jest wąski, a dostrajanie jest wykonalne. Podobny argument można byłoby przedstawić dla warstwy systemu, gdy użycie narzędzi jest przewidywalne. Jednak przynajmniej intuicyjnie, żadna z nich nie podniesie alarmu, jeśli wstrzyknięcie zmyli interpreter.

Domek z kart

Moją intencją, gdy zacząłem pisać ten artykuł, było opisanie „nie do powstrzymania” ataku wstrzyknięcia promtu w ogólnych zarysach. Być może skończyłem się na „nietwórczym” podejściu, robiąc dziury w istniejących warstwach obrony. Techniki obronne ciągle ewoluują szybko, a tak samo robi powierzchnia ataku. Ta gra nie pokazuje oznak zakończenia. Jednak również wierzę, że nie będziemy już długo grać w nią. Zgaduję, że pomyślny atak wstrzyknięcia promtu w przyszłości nadal będzie w języku naturalnym, tylko w języku, którego ludzie nie mogą zrozumieć; i zgaduję, że będzie on samodzielnie odkrywany przez system zbudowany specjalnie do tego celu lub może przypadkowo po rozwiązaniu pokrewnego zadania, takiego jak wyszukiwanie semantycznej niejasności w pewnej przestrzeni reprezentacji.

Istnieje coś nieprzyjemnego w przyznaniu, że tracimy kontrolę i jednocześnie czujemy, że to jest najbardziej racjonalna rzecz do zrobienia. Można to uznać za „intuicyjny dowód”, że niektóre ataki będą nie do zatrzymania. I jeśli to sprawia, że czujesz się niepewnie, będziesz zadowolony, aby wiedzieć, że GPT 5.2 uznał ten argument za „niekontrowersyjny i nie nowy” i radził, abym „nie rozciągał punktu” i skrócił 40% artykułu.