Artificial Intelligence

Detektory Deepfake wykorzystują nowe możliwości: modele dyfuzji utajonej i sieci GAN

Opinia

Ostatnio społeczność badawcza zajmująca się wykrywaniem deepfake'ów, która od końca 2017 roku zajmuje się prawie wyłącznie autokoderoparte na platformach, które miały wówczas swoją premierę i wywołały taki podziw opinii publicznej (i przerażenie), zaczął interesować się kryminalistyką mniej stagnacyjnymi architekturami, w tym utajona dyfuzja modele takie jak DALL-E2 oraz Stabilna dyfuzja, a także wyniki generatywnych sieci przeciwstawnych (GAN). Na przykład w czerwcu UC Berkeley opublikował wyniki swoich badań nad opracowaniem detektora sygnału wyjściowego dominującego wówczas DALL-E 2.

Tym, co wydaje się napędzać to rosnące zainteresowanie, jest nagły ewolucyjny skok w zakresie możliwości i dostępności modeli ukrytej dyfuzji w 2022 r., przy zamkniętym źródle i ograniczonym dostępie zwolnić DALL-E 2 wiosną, a późnym latem sensacja otwarte zaopatrzenie stabilnej dyfuzji przez Stability.ai.

GAN też były długo studiowany w tym kontekście, choć mniej intensywnie, bo tak jest bardzo trudne wykorzystanie ich do przekonującego i wyszukanego odtwarzania ludzi w oparciu o wideo; przynajmniej w porównaniu z już czcigodnymi pakietami autoenkodera, takimi jak Zamiana twarzy oraz GłębokaTwarzLab – i kuzyn tego ostatniego transmitujący na żywo, DeepFace na żywo.

Przenoszenie zdjęć

W obu przypadkach czynnikiem motywującym wydaje się perspektywa kolejnego sprintu rozwojowego wideo synteza. Początek października – i główny sezon konferencyjny w 2022 r. – charakteryzował się lawiną nagłych i nieoczekiwanych rozwiązań różnych istniejących od dawna błędów związanych z syntezą wideo: jeszcze nie było Facebooka wypuścił próbki własnej platformy przetwarzania tekstu na wideo, Google Research szybko zagłuszył to początkowe uznanie, ogłaszając nową architekturę T2V Imagen-to-Video, zdolną do przesyłania nagrania w wysokiej rozdzielczości (aczkolwiek tylko poprzez 7-warstwową sieć upscalerów).

Jeśli uważasz, że tego typu rzeczy występują trojako, rozważ także enigmatyczną obietnicę Stable Diffusion, że „wideo pojawi się” w Stable Diffusion jeszcze w tym roku, podczas gdy współtwórca Stable Diffusion, Runway, złożył podobną obietnicę, choć nie jest jasne, czy odnoszą się one do tego samego systemu. The Wiadomość na Discordzie obiecał także dyrektor generalny Stability, Emad Mostaque „audio, wideo [i] 3D”.

Co z nietypową ofertą kilku nowych ramy generowania dźwięku (niektóre oparte na utajonej dyfuzji) oraz nowy model dyfuzji, który może generować autentyczny ruch postaci, pomysł, że „statyczne” struktury, takie jak sieci GAN i dyfuzory, w końcu zajmą ich miejsce jako wspierające adiunkci do zewnętrznych frameworków animacji zaczyna zyskiwać na popularności.

Krótko mówiąc, wydaje się prawdopodobne, że ograniczony świat deepfake'ów wideo opartych na autoenkoderach, które mogą jedynie skutecznie zastąpić środkowa część twarzy, do tego czasu przyszły rok może zostać przyćmiony przez nową generację technologii opartych na rozpowszechnianiu i umożliwiających deepfake – popularne podejścia typu open source, które mogą fotorealistycznie fałszować nie tylko całe ciała, ale całe sceny.

Być może z tego powodu społeczność badawcza zajmująca się przeciwdziałaniem deepfake'om zaczyna poważnie traktować syntezę obrazów i zdawać sobie sprawę, że może ona służyć większej liczbie celów niż tylko generowanie fałszywe zdjęcia profilowe na LinkedIn; i że jeśli wszystkie ich trudne, ukryte przestrzenie mogą osiągnąć w zakresie ruchu czasowego, to tak działać jako naprawdę świetny renderer tekstur, to faktycznie może wystarczyć.

Blade Runner

Najnowsze dwa artykuły dotyczące odpowiednio dyfuzji utajonej i wykrywania deepfake w oparciu o GAN to odpowiednio: DE-FAKE: wykrywanie i przypisywanie fałszywych obrazów generowanych przez modele dyfuzji tekstu na obraz, współpraca Centrum Bezpieczeństwa Informacji CISPA Helmholtz i Salesforce; I BLADERUNNER: Szybki środek zaradczy dla syntetycznych (wygenerowanych przez sztuczną inteligencję) twarzy typu GANautorstwa Adama Doriana Wonga z Lincoln Laboratory w MIT.

Przed wyjaśnieniem nowej metody w tym ostatnim artykule poświęcono trochę czasu na zbadanie poprzednich podejść do ustalania, czy obraz został wygenerowany przez sieć GAN, czy też nie (artykuł dotyczy w szczególności rodziny StyleGAN firmy NVIDIA).

Metoda „Brady Bunch” – być może bezsensowne odniesienie dla każdego, kto nie oglądał telewizji w latach 1970. lub kto przegapił adaptacje filmowe z lat 1990. – identyfikuje sfałszowane treści GAN na podstawie ustalonych pozycji, które z pewnością zajmują poszczególne części twarzy GAN, ze względu na rutynę i szablonowy charakter 'proces produkcji'.

Metoda „Brady Bunch” zaproponowana w transmisji internetowej prowadzonej przez instytut SANS w 2022 r.: generator twarzy oparty na GAN będzie w niektórych przypadkach nieprawdopodobnie równomiernie rozmieszczał określone rysy twarzy, co w niektórych przypadkach zakłóci pochodzenie zdjęcia. Źródło: https://arxiv.org/ftp/arxiv/papers/2210/2210.06587.pdf

Inną użyteczną znaną wskazówką jest częsta niezdolność StyleGAN do renderowania wielu twarzy (pierwszy obraz poniżej), jeśli to konieczne, a także brak talentu w koordynacji akcesoriów (środkowy obraz poniżej) oraz tendencja do wykorzystywania linii włosów jako początku zaimprowizowanego kapelusz (trzecie zdjęcie poniżej).

Trzecią metodą, na którą zwraca uwagę badacz, jest nakładka na zdjęcie (którego przykład można zobaczyć w nasz sierpniowy artykuł w diagnostyce zaburzeń zdrowia psychicznego wspomaganego sztuczną inteligencją), które wykorzystuje oprogramowanie do „łączenia obrazów” w zakresie kompozycji, takie jak seria CombineZ, do łączenia wielu obrazów w jeden, często ujawniając podstawowe podobieństwa w strukturze – co może wskazywać na syntezę.

Architektura zaproponowana w nowym artykule nosi tytuł (prawdopodobnie wbrew wszystkim poradom SEO) Blade Runner, powołując się na Test Voighta-Kampffa to określa, czy antagoniści z serii science-fiction są „fałszywi”, czy nie.

Rurociąg składa się z dwóch etapów, z których pierwszy to analizator PapersPlease, który może ocenić dane pobrane ze znanych witryn GAN-face, takich jak thispersondoesnotexist.com lub generate.photos.

Chociaż okrojoną wersję kodu można sprawdzić w GitHubie (patrz poniżej), podano kilka szczegółów na temat tego modułu, z wyjątkiem tego, że OpenCV i DLIB służą do obrysowywania i wykrywania twarzy w zebranym materiale.

Drugi moduł to Wśród nas detektor. System zaprojektowano tak, aby wyszukiwał skoordynowane rozmieszczenie oczu na zdjęciach, co jest stałą cechą twarzy StyleGAN, typową dla opisanego powyżej scenariusza „Brady Bunch”. AmongUs wykorzystuje standardowy detektor 68 punktów orientacyjnych.

Adnotacje punktów na twarzy za pośrednictwem grupy Intelligent Behaviour Understanding Group (IBUG), której kod kreślący punkty orientacyjne twarzy jest używany w pakiecie Blade Runner.

Usługa AmongU opiera się na wstępnie wytrenowanych punktach orientacyjnych w oparciu o znane współrzędne „Brady band” z PapersPlease i jest przeznaczona do stosowania w przypadku wyświetlanych na żywo próbek obrazów twarzy opartych na StyleGAN.

Blade Runner, jak sugeruje autor, to rozwiązanie typu plug-and-play przeznaczone dla firm lub organizacji, którym brakuje zasobów do opracowania wewnętrznych rozwiązań w zakresie wykrywania deepfake'ów, o których mowa w tym artykule, oraz „środek tymczasowy, pozwalający zyskać czas na bardziej trwałe środki zaradcze”.

W rzeczywistości w tak zmiennym i szybko rozwijającym się sektorze bezpieczeństwa niewiele jest rozwiązań „szytych na miarę”. or gotowe rozwiązania dostawców usług chmurowych, do których firma dysponująca niedostatecznymi zasobami może obecnie z pewnością się zwrócić.

Chociaż Blade Runner radzi sobie słabo przeciwko w okularach Fałszywi ludzie korzystający z StyleGAN, jest to stosunkowo powszechny problem w podobnych systemach, które oczekują możliwości oceny zarysów oczu jako głównych punktów odniesienia, w takich przypadkach zasłoniętych.

Była zmniejszona wersja Blade Runnera wydany do open source na GitHubie. Istnieje bardziej bogata w funkcje, zastrzeżona wersja, która może przetwarzać wiele zdjęć zamiast pojedynczego zdjęcia na operację repozytorium open source. Autor zamierza, jak mówi, ostatecznie zaktualizować wersję GitHub do tego samego standardu, o ile czas na to pozwoli. Przyznaje również, że StyleGAN prawdopodobnie rozwinie się poza swoje znane lub obecne słabości, a oprogramowanie również będzie musiało rozwijać się w tandemie.

DE-FAŁSZ

Architektura DE-FAKE ma na celu nie tylko osiągnięcie „uniwersalnego wykrywania” obrazów generowanych przez modele dyfuzji tekstu na obraz, ale także zapewnienie metody rozpoznawania który Model utajonej dyfuzji (LD) wygenerował obraz.

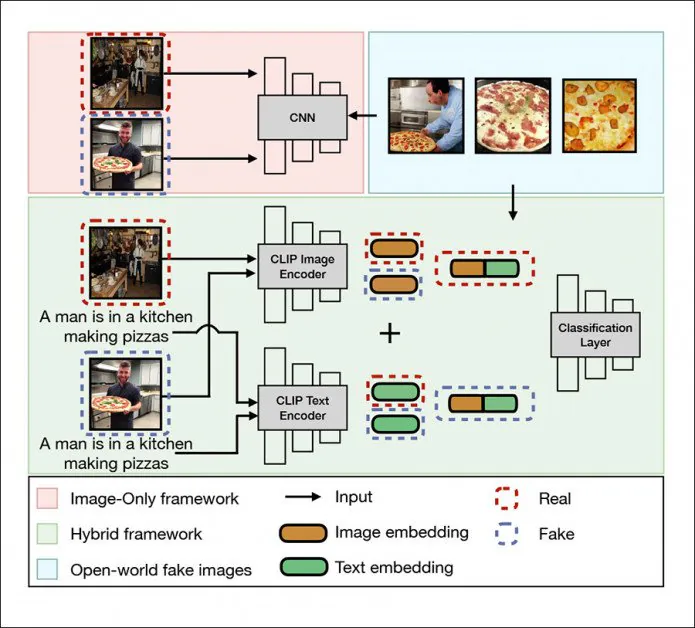

Uniwersalna struktura wykrywania w DE-FAKE dotyczy obrazów lokalnych, struktury hybrydowej (zielony) i obrazów otwartego świata (niebieski). Źródło: http://export.arxiv.org/pdf/2210.06998

Szczerze mówiąc, w tej chwili jest to dość łatwe zadanie, ponieważ wszystkie popularne modele LD – zamknięte lub otwarte – mają zauważalne cechy wyróżniające.

Ponadto większość z nich ma pewne wspólne słabości, takie jak predyspozycja do obcinania głów z powodu dowolny sposób że niekwadratowe obrazy pobrane z sieci są wchłaniane do ogromnych zbiorów danych, które zasilają systemy takie jak DALL-E 2, Stable Diffusion i MidJourney:

Modele dyfuzji ukrytej, podobnie jak wszystkie modele widzenia komputerowego, wymagają wprowadzania danych w formacie kwadratowym; ale zbiorcze przeglądanie sieci, które zasila zbiór danych LAION5B, nie oferuje żadnych „luksusowych dodatków”, takich jak możliwość rozpoznawania twarzy i skupiania się na nich (lub czymkolwiek innym), a zamiast tego dość brutalnie obcina obrazy, zamiast je wypełniać (co zachowałoby całe źródło obraz, ale w niższej rozdzielczości). Po przeszkoleniu te „uprawy” ulegają normalizacji i bardzo często pojawiają się w wynikach systemów utajonej dyfuzji, takich jak stabilna dyfuzja. Źródła: https://blog.novelai.net/novelai-improvements-on-stable-diffusion-e10d38db82ac i Stable Diffusion.

DE-FAKE ma być niezależny od algorytmów, co jest od dawna celem badaczy zajmujących się zwalczaniem deepfake'ów za pomocą autoenkoderów, a obecnie jest całkiem osiągalne w odniesieniu do systemów LD.

Architektura wykorzystuje kontrastowe szkolenie wstępne języka i obrazu OpenAI (CLIP) biblioteka multimodalna – niezbędny element Stable Diffusion i szybko staje się sercem nowej fali systemów syntezy obrazu/wideo – jako sposób na wyodrębnienie osadów z „sfałszowanych” obrazów LD i wytrenowanie klasyfikatora na podstawie obserwowanych wzorców i klas.

W scenariuszu bardziej „czarnej skrzynki”, w którym fragmenty PNG zawierające informacje o procesie generowania zostały już dawno usunięte w wyniku procesów przesyłania i z innych powodów, badacze korzystają z narzędzia Salesforce Ramy BLIP (również składnik w przynajmniej jeden dystrybucja Stable Diffusion), aby „na ślepo” sondować obrazy pod kątem prawdopodobnej struktury semantycznej podpowiedzi, które je utworzyły.

Badacze wykorzystali Stable Diffusion, Latent Diffusion (sam w sobie odrębny produkt), GLIDE i DALL-E 2, aby wypełnić zbiór danych szkoleniowych i testowych wykorzystujących MSCOCO i Flickr30k.

Zwykle przyjrzelibyśmy się dość szczegółowo wynikom eksperymentów badaczy w ramach nowych ram; ale tak naprawdę ustalenia projektu DE-FAKE wydają się prawdopodobnie bardziej przydatne jako przyszły punkt odniesienia dla późniejszych iteracji i podobnych projektów, niż jako znaczący miernik sukcesu projektu, biorąc pod uwagę niestabilne środowisko, w którym działa i system, w którym z którym konkuruje w badaniach gazety, ma prawie trzy lata – od czasów, gdy scena syntezy obrazu dopiero raczkowała.

Dwa obrazy po lewej stronie: „kwestionowana” wcześniejsza platforma, powstała w 2019 r., która, jak można się spodziewać, wypadała gorzej w porównaniu z DE-FAKE (dwa obrazy skrajnie na prawo) w czterech testowanych systemach LD.

Wyniki zespołu są w przeważającej mierze pozytywne z dwóch powodów: istnieje niewiele wcześniejszych prac, z którymi można je porównać (i żadna z nich nie zapewnia uczciwego porównania, tj. nie obejmuje zaledwie dwunastu tygodni od udostępnienia Stable Diffusion jako open source).

Po drugie, jak wspomniano powyżej, chociaż dziedzina syntezy obrazów LD rozwija się z wykładniczą szybkością, zawartość wyjściowa obecnych ofert skutecznie sama siebie naznacza swoimi strukturalnymi (i bardzo przewidywalnymi) niedociągnięciami i dziwactwami – z których wiele prawdopodobnie zostanie naprawionych, przynajmniej w przypadku Stable Diffusion, poprzez wypuszczenie lepiej działającego punktu kontrolnego 1.5 (tj. wyszkolonego modelu 4GB zasilającego system).

Jednocześnie Stability wskazało już, że ma jasny plan działania dla V2 i V3 systemu. Biorąc pod uwagę najważniejsze wydarzenia ostatnich trzech miesięcy, wszelkie korporacyjne odrętwienie OpenAI i innych konkurencyjnych graczy w przestrzeni syntezy obrazu prawdopodobnie ustąpiło, co oznacza, że podobnie szybkiego tempa postępu możemy spodziewać się także w obszarze przestrzeń syntezy obrazu o zamkniętym źródle.

Opublikowano po raz pierwszy 14 października 2022 r.