Kąt Andersona

Czy AI może rozwinąć węszę do wiadomości?

AI staje się coraz lepsze w pisaniu artykułów, ale nie poprawia się znacząco w identyfikowaniu ich.

Opinia W ciągu pięciu lat od kiedy po raz ostatni przyjrzeliśmy się możliwościom AI w znajdowaniu gorących wiadomości, krajobraz zmienił się znacząco, z coraz większym stopniem automatyzacji AI, a także nieuniknionymi bólami wzrostu i kontrowersjami.

Ostatnio raport WSJ na temat płodnego, wspieranego przez AI współpracownika Fortune przedstawił dziennikarza przyszłości jako wyzwolonego od pracy poniżej pasa, takiej jak transliterowanie komunikatów prasowych, pozostawiając im pole do napisania artykułów i wykonania pracy wykopaliskowej, której tylko większe wydawnictwa zwykle mają budżet.

Ale o czym słyszymy znacznie rzadziej, to zdolność AI do wykrywania wiadomości.

Zmniejszanie hałasu

W artykule z 2021 roku skupiłem się na pisarzach zajmujących się badaniami, ponieważ to tam spędzam większość czasu; i być może największym efektem, jaki nowa rewolucja AI miała na to, jest to, że stworzyła niekontrolowaną burzę zgłoszeń badań wspomaganych przez AI, podnosząc stosunek sygnału do szumu tak wysoko, że nawet obszerny przegląd domen związanych z AI w Arxiv jest teraz poza możliwościami jednej osoby.

Czyż to nie jest obszar, w którym AI się sprawdza – w iterowaniu przez ogromne ilości danych, których ludzie nie mogą rozwiązać, aby znaleźć ‘odstępstwa’ (do których będziemy dochodzić niebawem) w sekundach, co zajęłoby ludziom dni, gdyby w ogóle byli w stanie to zrobić.

Dlaczego więc AI wciąż jest tak słabe w identyfikowaniu gorącej wiadomości spośród tysięcy, a nawet dziesiątek tysięcy, codziennych kandydatów?

AI patrzące wstecz

Ten ogromny rozkwit treści generowanych przez AI dzieje się znacznie poza sektorem akademickim, o którym wcześniej dyskutowałem. Pod koniec zeszłego roku oszacowano, że połowa wszystkich nowych tekstów w sieci jest teraz ‘napisana przez AI’, z jeszcze większym przyspieszeniem tego trendu, które ma nastąpić. Dlatego hałas jest ogłuszający wszędzie, nie tylko w akademii.

Chociaż w ciągu ostatnich kilku lat nastąpił pewien postęp w identyfikacji AI/algorytmicznej ‘gorącej’ historii, systemy te tendencję mają do koncentrowania się na warstwowych i przewidywalnie zorganizowanych strumieniach danych, co oznacza, że mogą działać tylko w dość kruchym kontekście.

W tym zakresie Stanford postdoktorancki badacz i były dziennikarz Alexander Spangher podjął kilka prób zdefiniowania ‘nowości’ w sposób, który może być zastosowany w procesach uczenia maszynowego i analizie statystycznej; i wyprodukował dowody automatycznego generowania wiodących korpusów takich jak akta sądowe, projekty ustaw, oraz posiedzenia rady miasta, a także dokumenty publiczne – rodzaj danych, który może zostać przekształcony przez AI-wspomaganego pisarza w 6-7 artykułów dziennie:

‘Heat’ of word distributions gleaned from corpora of public documents. In this case, we can see that ‘authorizing’ has a high score, perhaps because it represents decision, change and novelty. Source

Jednak problemem z podejściami takimi jak praca z 2023 Tracking the Newsworthiness of Public Documents jest to, że w typowy dla AI sposób, koncentrują się one na obserwowanych trendach w danych. Innymi słowy, obserwują rzeczy, które wcześniej stanowiły dobre wiadomości, i idą dalej, szukając więcej tego samego.

W świecie rzeczywistym nieoczekiwane źródła niemal zawsze okazują się ‘jednorazowym cudem’; i pomimo okazjonalnych prób wykorzystania ulotnej sławy lub kontrowersji, zwykle nigdy nie dadzą nic użytecznego ponownie.

Znak czasu

Dlatego, ponieważ monitorowanie tego rodzaju źródeł ‘jednorazowych’ wiadomości zazwyczaj tylko dodaje więcej hałasu do ogólnej burzy, czy AI nie mogłoby zidentyfikować wskaźników źródła, które kiedyś stanie się owocne? Gdyby można było dowiedzieć się, jaki rodzaj źródła może ostatecznie przynieść wiadomości, można by się skoncentrować na jego charakterystyce zamiast kontekście lub metodach.

Poprzez tę logikę można by wywnioskować z ujawnień Edwarda Snowdena z lat 2010, że ktokolwiek, kto niedawno opuścił CIA (lub podobną organizację), byłby wart śledzenia jako potencjalne źródło przyszłego skandalu.

Jednak nie ma RSS ani API, które mogłyby zautomatyzować tego rodzaju ciągłe monitorowanie, ponieważ LinkedIn i wiele innych wcześniej otwartych źródeł danych wycofują się w obliczu pożądliwych i przekraczających granice AI-web-scrapers. Nawet gdyby takie źródła istniały, częstotliwość byłaby problemem, ponieważ nie można przeskanować API lub strony co pięć sekund; poza kosztami zasobów, odpowiedzi z platform w postaci zablokowania IP uczyniłyby tę działalność niezrównoważoną.

Ponadto jest oczywiste, że istnieje ‘ludzki wymiar’ takich ujawnień, który jest trudny do zautomatyzowania.

Gromadzenie wiadomości z osobistym sztucznym dotykiem: ujęcie z wydania dysku filmu ‘All The President’s Men’ z 1976 roku, z informującym wychodzącym z cienia. Source

Również w świecie rzeczywistym jest ogromnie trudno zidentyfikować charakterystyczne cechy przyszłego źródła wiadomości. Prawdopodobnie nie jest to ‘ludzie, którzy niedawno opuścili CIA’, i na pewno nie jest określone przez protokół: platformy takie jak X lub GitHub same wytwarzają zbyt wiele sygnału, a nawet zawężanie do kategorii wyszukiwania lub postów nie robi znaczącej różnicy – tylko wtedy, gdy jesteś zaangażowany w problem i zaangażowany w społeczność (lub repo, itp.), jesteś naprawdę w stanie rozpoznać znaczenie rozwoju.

Nawet termin taki jak ‘alert bezpieczeństwa’ nie może kontekstualizować prawdziwej powagi lub nowości incydentu, ponieważ odniesienia tego rodzaju są rzucone codziennie, przez tysiące, w takich społecznościach – a nawet jeśli ograniczy się to do języka angielskiego, potencjalne różnice w idiomy, wraz z użyciem ukrytego języka, uczyniłyby to bardzo trudnym do sparsowania ‘w dziczy’ posta w prawdziwą wiadomość.

Wąska ścieżka

Bieżąca generacja systemów AI do wykrywania nowości opiera się na sformalizowanych strukturach danych (takich jak dane wyjściowe JSON z API) lub na nieformalnych strukturach danych, które algorytmy opracowane przez AI mają szansę sparsować w schemat strukturalny (takich jak komunikaty prasowe z określonej organizacji):

Sparsowany feed RSS / XML, ujawniający sztywną hierarchię kontenerów danych. Source

Oczywiście, podejścia tego rodzaju są dobrze przystosowane do programowego wyjścia, takiego jak monotonne prace, o których mówi powyższy reporter WSJ, w tym raporty o pogodzie, akcjach i wynikach sportowych, a także rutynowe komunikaty prasowe z organizacji rządowych.

Chociaż jest możliwe dołączenie ‘wyzwalaczy alarmowych’ do statystycznych strumieni, takich jak pogoda (nagłe burze), akcje (nagłe spadki) i sport (niespodziewane zwycięstwa / porażki, z pewnym przygotowaniem), ponownie, uwaga ludzka byłaby nadal potrzebna, nawet dla bardzo warstwowych wydawnictw rządowych, aby ocenić nowość.

Chociaż terminy takie jak ‘śmierć’, ‘niespodziewana choroba’, ‘wyciek’ i ‘wypadek’ mogą wszystkie pomóc w zidentyfikowaniu nowych wydarzeń, nie mogą one uwzględnić języka alternatywnego (lub języków).

Powrót elitarnych pisarzy?

W ostatnich latach dziennikarstwo oparte na danych stało się wznoszącym się filarem w sprawozdawczości, z redakcjami, które nie są już ograniczone do układów ‘scoop’ przyznających im wczesne wydanie specjalnych raportów i białych książek od dużych wydawców; zamiast tego mogą one same analizować liczby.

Jednakże nie jest to darmowy lunch; ponieważ oczywista wartość parsowania publicznych danych z AI w ten sposób wzrosła, odpowiedź oparta na czynszu / blokowaniu AI nastąpiła – lub nawet przewidziała – popyt, prowadząc głównych graczy AI do taktyk stealth.

Dodatkowa friccja Nowego Wycofania się argumentuje, że przywraca pewną ilość mocy ‘dziennikarzom obywatelom’ z powrotem do mediów tradycyjnych – lub przynajmniej, dobrze finansowanym organizacjom medialnym, które mają pasmo do absorbowania dodatkowej ręcznej pracy wymaganej w gromadzeniu, doskonaleniu i ocenianiu danych, w erze, w której wydawcy i domeny coraz bardziej ograniczają swobodny dostęp.

Więc w pewnym sensie, może praktyczna manifestacja AI w dziennikarstwie, w zakresie, w jakim główni gracze i rynki zareagowali na innowacje i przyjęcie AI, może tak naprawdę prowadzić nas wstecz w czasie: od-demokratyzując środki produkcji wiadomości, i dodając przeszkody do znaczących systemów oceny nowości opartych na danych.

Wspólne instynkty

Te ograniczenia prowadzą nas z powrotem do ‘instynktu’ jako nieuniknionego składnika w ocenie nowości wiadomości.

Naturalnie, jest to pocieszające dla tych, którzy są zawodowo zaangażowani w tym aspekcie; ale samozadowolenie byłoby błędem, ponieważ ten instynkt może, do pewnego stopnia, zostać wydestylowany i zoperacjonalizowany w sposób ogólny, który nie zależy od studiowania obsesji lub hobby-konia jednostki lub organizacji: w badaniu z 2022 roku, badacze z Northwestern University użyli ocen crowd-sourced potencjalnie nowych wiadomości, aby przeszkolić model predykcyjny, konkretnie zajmujący się nowością nowo opublikowanych prac badawczych w Arxiv:

Pytania ankiety przedstawione uczestnikom badania w celu uzyskania danych szkoleniowych dla modelu ‘przewidywania nowości’. Source

System ten klasyfikuje kandydatów dość dobrze, z około 80% jego najlepszych wyborów również uznanych za nowe przez ekspertów. Jednak zgodność z ekspertami okazała się tylko umiarkowana, z wynikami, które pomijały takie czynniki, jak ramy lub dopasowanie do publiczności.

System ten opiera się na zasadach przedstawionych w pracy z 2020 roku Computational News Discovery: Towards Design Considerations for Editorial Orientation Algorithms in Journalism. Jak w przypadku większości podobnych projektów, praca ta zajmuje się dziennikarstwem naukowym, a nie abstrakcyjnym gromadzeniem wiadomości – być może dlatego, że literatura naukowa skłania się ku szablonowym wyjściom, które mogą być potencjalnie sparsowane w danych szkoleniowych i interpretowalnych.

Cóż, jak zauważyłem wcześniej, byłoby to przypadkiem, chyba że naukowcy często nadużywają konwencji składania prac badawczych, aby ukryć lub zbagatelizować nieimponujące wyniki lub nawet jawne niepowodzenia.

Jeszcze większym wyzwaniem jest ogromna trudność, z jaką systemy AI mają w interpretowaniu rysunków i tabel w pracach naukowych, do tego stopnia, że ostatnio stało się aktywnym nurtem w literaturze:

Z pracy ‘SciFigDetect: A Benchmark for AI-Generated Scientific Figure Detection’, przedstawiającej prawdziwe naukowe rysunki, ich generatywne prompty i syntetyczne odpowiedniki wytworzone przez Nano Banana i GPT w trzech kategoriach: ilustracja, przegląd i rysunki eksperymentalne. Source

Często tabela lub rysunek zawiera wyniki, które główny tekst pracy może albo raportować z selektywnym uprzedzeniem, albo całkowicie zignorować jakiekolwiek negatywne konsekwencje wynikające z wyników tabeli / rysunku. Dlatego ten przeszkoda w AI-napędzanym dziennikarstwie naukowym nie jest drobną.

Samotność

Metoda crowd-sourced, opisana powyżej, sugeruje pewną zgodność między powszechnym konsensusem na temat potencjalnych wiadomości a profesjonalną oceną tych samych. Ale bez kontekstu tylko najszersze cechy nowości mogą być ocenione.

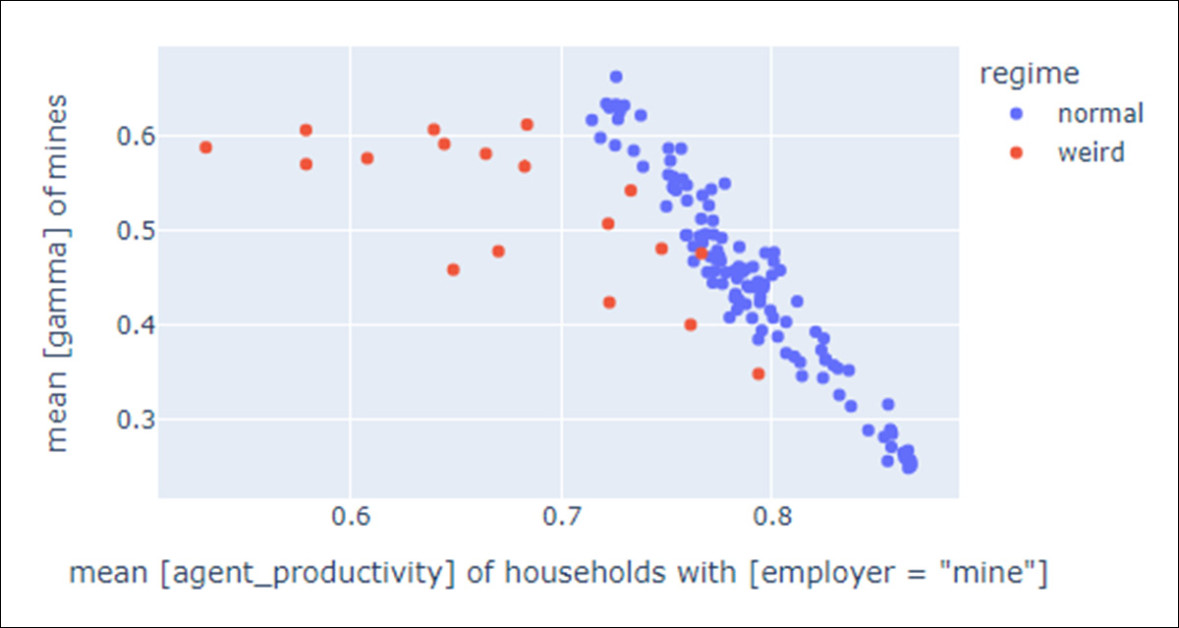

Właśnie siła AI leży w jej zdolności, w zależności od konfiguracji, do izolowania odstępstw – albo w celu odrzucenia ich jako krzywe i nieznaczące wyjątki od trendów w zbiorze danych, albo (bardziej istotne dla gromadzenia wiadomości) w celu identyfikacji znaczących i wartościowych niezwykłych przypadków i zdarzeń:

Odstępstwa (w czerwonym) na wykresie rozproszenia. Source

Na zasadzie, że piorun rzadko uderza dwa razy, niemal wszystkie nowe wiadomości są odstępstwami. W przypadkach, w których pochodzą one z aktywnej i dynamicznej dziedziny, takiej jak trwająca wojna, tę dziedzinę można skrupulatnie przeskanować z wysokim prawdopodobieństwem pojawienia się nowych wiadomości – ale za cenę ogromnej kontestacji, ponieważ powszechna uwaga jest również prawdopodobnie skupiona na tej dziedzinie.

Wiele nowych wiadomości naukowych jest, przez definicję, nie w centrum rozkładu języka. Są to rzadkie kombinacje metod, zaskakujące wyniki negatywne lub anomalne replikacje. Jeśli kompetencja modelu maleje nieproporcjonalnie w takich niskoczęstotliwościowych grupach, to obszar, w którym ‘nose’ redaktorski musi być ostry, staje się obszarem, w którym model jest najmniej niezawodny.

Problemy zaufania

Podczas poszukiwania nowych historii dziennikarze balansują między wieloma ograniczeniami, w tym czasem, dostępem, wiarygodnością, publicznością i priorytetami organizacyjnymi, co prowadzi do nieoczywistych wyborów. Przegląd literatury z 2022 roku z Danii scharakteryzował dziennikarzy jako balansujących między wieloma problemami, będącymi świadomymi, że źródła mogą mieć agendy lub być mylnie poinformowane; i często omijających bezpośrednią weryfikację na rzecz pośrednich wskazówek zaufania, gdy działają pod presją.

Te same ‘problemy zaufania’ stanowiłyby przeszkodę rozwojową w każdym ostatecznym systemie AI do identyfikacji nowości, ponieważ zaangażowanie w taką platformę wymagałoby, aby użytkownik zaufał, że jakiekolwiek algorytmicznie odrzucone artykuły nie są godne czasu pisarza.

Rozległe testy beta i ponowne szkolenie lub dostosowywanie, z nadzorem ludzkim, które podnosi strays i stragglers, mogłyby ostatecznie poprawić niezawodność takiego podejścia; ale zmiana w kulturze narodowej lub globalnej – taka jak zaskakujące zmiany w krajobrazie politycznym lub wybuch wojny – mogłaby nieuchronnie wywrócić wszystkie podstawowe priorytety takiego starannie skalibrowanego systemu, pozostawiając AI-zależnego pisarza do odbudowy niezbędnego ‘wewnętrznego modelu domeny’ niemal od podstaw.

Pierwotnie opublikowane w poniedziałek, 20 kwietnia 2026