Kąt Andersona

Artykuł „Survey Paper DDos Attack”, który przytłacza naukowe badania

Modele generatywne AI, takie jak ChatGPT, zalewają obecnie platformy publikacji akademickiej AI wygenerowanymi pracami przeglądowymi w takim stopniu, że stosunek sygnału do szumu staje się krytyczny. Nowe badanie twierdzi, że ten potop przytłacza badaczy, zniekształca cytaty i niszczy zaufanie do naukowych rekordów, porównując lawinę prac AI do „ataku DDoS” na samą naukę.

(Częściowo) opinia W zeszłym tygodniu, po raz pierwszy w ciągu siedmiu lat, podczas których był na bieżąco z naukową literaturą dotyczącą AI, musiałem uznać porażkę i przyznać, że przynajmniej w czasie szczytu muszę wybierać pomiędzy pozostawaniem na bieżąco z nowymi publikacjami a mając jakikolwiek czas, aby pisać o niektórych z nich.

Całkowita liczba wpisów w bardzo ograniczonej liczbie odpowiednich kategorii (Computer Vision, Machine Learning, Language Models i kilka innych mniej popularnych sekcji) wynosiła znacznie ponad tysiąc – tylko za jeden dzień.

Przy takim objętości, nawet przeglądanie wszystkich nowych tytułów i okazjonalne czytanie niektórych streszczeń byłoby niewykonalne.

To było wtorek, 7 października. W przeciwieństwie do tego, w kategorii Machine Learning, ten wtorek (14 października) oferował objętość publikacji nieco mniej intensywną niż 400 wpisów z wtorku poprzedniego tygodnia; miała zaledwie 354 wpisy:

354 zgłoszenia w kategorii Machine Learning w ciągu jednego dnia. Źródło: https://arxiv.org/

Musiałbyś czytać Arxiv każdego dnia przez kilka lat, aby zrozumieć, jak szalone stają się te liczby.

Zgodnie z oczekiwaniami, wtorek to „godzina szczytu” Arxiv dla zgłoszeń, być może dlatego, że jest to najwcześniejszy dzień roboczy, który występuje poza długimi weekendami, z których korzystają wpływowi ludzie, których badacze nadzieję sięgnąć; a kategoria Machine Learning jest sekcją „catch-all” z mniejszą liczbą unikalnych prac (prac, które nie są publikowane jednocześnie w bardziej specjalistycznych kanałach).

Niemniej jednak, wzrost liczby zgłoszeń jest już zauważalnym zjawiskiem w akademii i w mediach.

Być może najbardziej szokującym aspektem tego eskalacji jest to, jak wszystkie inne sąsiednie kategorie są mniej więcej niezmienione w swojej częstotliwości w ciągu ostatnich trzech lat, podczas gdy kategoria Computer Science (zobacz, czy możesz ją znaleźć w oficjalnych danych Arxiv poniżej) jest na ostrym wzrostie:

Wzrost prac z dziedziny computer science (CS) w ciągu ostatnich trzech lat. Źródło: https://info.arxiv.org/about/reports/submission_category_by_year.html

Niedawno, około trzy lata temu, szacowano, że wydajność prac AI na Arxiv podwaja się co kilka lat; i będzie interesujące przeczytać własną roczną analizę trendów Arxiv na koniec 2025 roku.

Objętość na 11

Dwie najbardziej oczywiste przyczyny, dla których tak się dzieje, to a) bezprecedensowe zaangażowanie finansowe w generatywne AI przyciąga ogromne nakłady badawcze w sektorze prywatnym i akademickim, które często współpracują; i b) fakt, że systemy modeli językowych AI, takie jak ChatGPT, sprawiają, że składanie prac badawczych (w tym prac o AI) staje się prawie zindustrializowanym procesem.

Jednak jakość zgłoszeń badawczych nie rośnie wraz z objętością (chociaż błędne dane wyjściowe AI mają tendencję do robienia więcej nagłówków w sektorze prawnym niż akademickim, nie tylko dlatego, że konsekwencje są tam bardziej oczywiste).

Polityka zero-tolerancji jest trudna do wdrożenia w tym przypadku, nawet jeśli rozpoznawanie treści wygenerowanej przez AI było łatwiejsze; poza tym, że AI sama w sobie jest wyraźnym bonusem dla ogólnych badań naukowych, jej użycie w zgłoszeniach prac badawczych ogólnie* poprawiło klarowność prac wielu osób nie posługujących się językiem angielskim – osób i zespołów, które do tej pory działały w niekorzystnej sytuacji.

Ale problem polegający na obniżeniu bariery językowej w ten sposób polega na tym, że również zwiększa ogólną liczbę globalnych zgłoszeń, bez zwiększania poziomu nadzoru ludzkiego, który nadaje wartość takiej pracy.

Jeśli poziom zgłoszeń będzie nadal rosł wykładniczo, stosunek sygnału do szumu stanie się tak niekontrolowany, że tylko sama AI mogłaby możliwie nawigować nowe powodzie i dopływy prac AI; zadanie, którego nie jest w stanie wykonać lepiej niż sprawdzanie własnego wyjścia. Ironicznie, badania naukowe są intensywnie ludzkim przedsięwzięciem.

Atak na badania

Przyczyną tego rozważania jest interesująca nowa współpraca z Chin zatytułowana Stop DDoS Attacking the Research Community with AI-Generated Survey Papers.

Nowy artykuł koncentruje się szczególnie na pracach przeglądowych – wysiłkach podsumowujących określone nurty w badaniach, które tradycyjnie wymieniały i kontekstualizowały, interpretowały trendy i dokonywały świadomych przewidywań:

Znikoma część ogromnie rosnącego zbioru prac przeglądowych w sekcjach związanych z machine learning i AI, na arxiv.org

Ponieważ prace przeglądowe kurują raczej niż tworzą, są niezwykle łatwe do zautomatyzowania za pomocą AI, a autorzy nowej pracy charakteryzują proliferację niskowysiłkowych prac przeglądowych w kategoriach zagrożenia bezpieczeństwa dla sektora badawczego†:

‘[Ostatni] wzrost prac przeglądowych wygenerowanych przez AI, zwłaszcza umożliwiony przez duże modele językowe (LLM), przekształcił tę tradycyjnie wymagającą pracy gatunek w niskowysiłkową, wysokowolumenową produkcję. Chociaż taka automatyzacja obniża bariery wejścia, wprowadza również krytyczne zagrożenie: zjawisko, które nazywamy „atakiem DDoS prac przeglądowych” na społeczność badawczą.

‘Odnosi się to do niekontrolowanego rozprzestrzeniania się powierzchownie kompletnych, ale często redundantnych, niskiej jakości lub nawet urojonych rękopisów prac przeglądowych, które zalewają platformy preprintowe, przytłaczają badaczy i niszczą zaufanie do naukowych rekordów.

‘[My] twierdzimy, że musimy przestać wysyłać ogromne ilości prac przeglądowych wygenerowanych przez AI (tj. atak DDoS prac przeglądowych) do społeczności badawczej, poprzez wprowadzenie silnych norm dla AI-pomaganego pisania recenzji.’

Autorzy twierdzą, że ten nieograniczony przyrost produkcji prac przeglądowych zagraża zalać ekosystem badawczy błyszczącymi raportami, które nie posiadają krytycznej głębi, i które prawdopodobnie będą propagować błędne dane i/lub urojone cytaty.

Praca ostrzega, że bez lepszych zasad lub nadzoru prace przeglądowe wygenerowane przez AI mogą stać się płytkimi kopiami, które zniekształcają, które tematy są ważne, ukrywają znaczącą analizę i sprawiają, że przeglądy literatury stają się mniej godne zaufania:

‘Konsekwencje dla jakości badań i zaufania są głębokie. Po pierwsze, prawdziwe postępy ryzykują być zaciemnione przez algorytmicznie wygenerowane powtórzenia istniejących prac.

‘Nowicjusze i badacze międzydyscyplinarni mogą mieć trudności ze znalezieniem wiarygodnych przeglądów pośród szumu. Co więcej, błędy lub uprzedzenia wprowadzone przez automatyczne pisanie mogą się niekontrolowanie rozprzestrzeniać, zasiewając następne badania błędnymi założeniami.

‘Podsumowując, powódź nieprzeglądanych prac przeglądowych wygenerowanych przez AI zagraża zarówno rygorowi przeglądów literatury, jak i wiarygodności naukowych rekordów.’

‘Nienormalni’ autorzy

Badacze nowej pracy zapewnili kilka interesujących analiz dotyczących ewolucji prac przeglądowych:

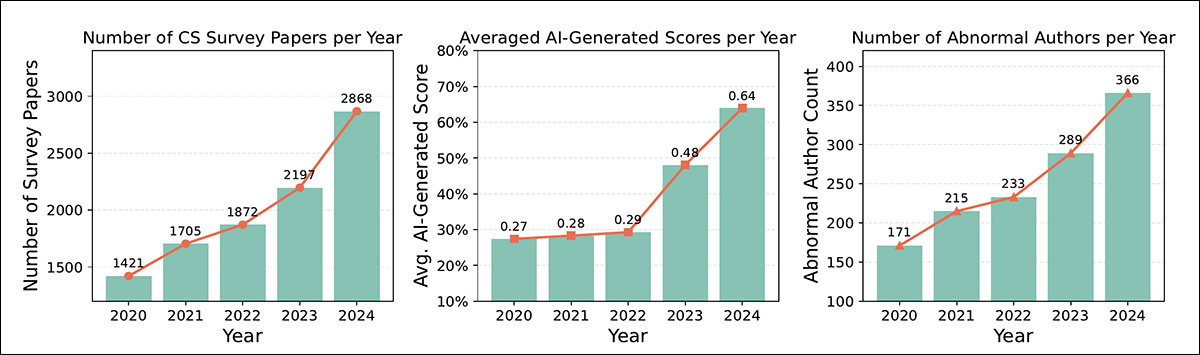

Lewy: roczna liczba prac przeglądowych z dziedziny computer science z 2020 do 2024. Środkowy: średnie wyniki generacji AI dla tych prac w tym samym okresie. Prawy: liczba autorów oznaczonych jako niezwykli (ci, którzy mają niezwykle wysoką produkcję prac przeglądowych, ograniczoną różnorodność współautorów i powtarzające się wzorce instytucjonalne) każdego roku. Wszystkie trzy trendy pokazują gwałtowny wzrost od 2023 roku, zbiegający się z wydaniem ChatGPT i innych dużych modeli językowych.

W pierwszej kolumnie widzimy trendy wzrostu: krzywa zaczyna się stroma około 2022 roku, zaraz gdy ChatGPT pojawił się i duże modele językowe zaczęły się masowo pojawiać, a następne modele, takie jak Claude, PaLM i Gemini utrzymały ten impet w 2023 roku.

Środkowy wykres pokazuje gwałtowny wzrost zgłoszeń po 2022 roku, zbiegający się z wydaniem ChatGPT. Jeden zespół badawczy stwierdził, że do 2024 roku ponad 10% abstraktów naukowych zostało wygenerowanych przez LLM. Odrębne sprawozdanie z firmy zajmującej się wykrywaniem AI podało, że skok po wydaniu ChatGPT wyniósł 72% dla prac na arXiv, które mogły być napisane z pomocą AI.

Liczba prac z wysokimi wynikami generacji AI również podwoiła się w ciągu roku, z 3,6% do 6,2%.

Trzeci, prawy wykres pokazuje stały wzrost liczby „niezwykłych” wzorców autorów (badaczy składających trzy lub więcej prac przeglądowych w ciągu miesiąca, pracujących z mniej niż dwoma współpracownikami), z gwałtowniejszym wzrostem od 2022 roku.

Autorzy twierdzą, że wiele z tych prac przeglądowych mogło zostać napisanych przez AI, z różnych powodów; niektóre są napisane przez autorów samotnych lub małych grup, które składają wiele prac przeglądowych w krótkim czasie; wiele dotyczy niespokrewnionych tematów; a w niektórych przypadkach autorzy nie mają wcześniejszego doświadczenia w dziedzinach, które podsumowują.

Ponadto niektóre są publikowane pod anonimowymi zbiorami bez wyraźnych powiązań instytucjonalnych – wzorce sugerujące skoordynowane zalewanie dziedziny szybkimi pracami przeglądowymi, możliwe w celu uzyskania cytowań lub poprawy profili akademickich, a nie w celu wniesienia prawdziwego wkładu w literaturę.

Problemy

Chociaż nie możemy objąć wszystkich kontrowersji nowej pracy, powinniśmy przyjrzeć się niektórym z najbardziej godnych uwagi spostrzeżeń, a także rzucić krytyczne spojrzenie na proponowane przez autorów rozwiązania tych problemów.

Jakość i oryginalność

Problem nie jest tylko objętością: wiele prac przeglądowych napisanych przez AI pomija to, co sprawia, że dobra praca przeglądowa jest przydatna: klarowną strukturę, głęboką analizę, poprawne i staranne uznanie, oraz prawdziwą wgląd.

Autorzy obserwują, że prace przeglądowe napisane przez AI często brakuje struktury, ale raczej po prostu wymieniają prace bez wyraźnego kierunku, pomijając kluczowe sekcje i nie tworząc kontekstu. Prace przeglądowe napisane przez ludzi tendencję do tworzenia właściwych kategorii i opowiadania bardziej spójnej historii.

Ponadto wiele potencjalnie AI-pomaganych prac przeglądowych wydaje się po prostu kopiować istniejące podziały tematów, czasem prosto z Wikipedii. Na przykład, praca zauważa, że wiele prac przeglądowych na temat Vision Transformers zawiera wspólne tytuły sekcji i strukturę, zdradzając wyjście z szablonu AI:

‘W przeciwieństwie do tego, dobrze napisana praca przeglądowa może wprowadzić nową taksonomię, np. klasyfikującą ViT według strategii efektywności. Brak takiej oryginalnej struktury w wielu ostatnich pracach przeglądowych budzi obawy, że mogły one zostać wygenerowane przez AI z ograniczoną ludzką inspiracją.’

Nie cytuj mnie

Być może najbardziej publicznie zawstydzające, prace przeglądowe napisane przez AI często mają błędne cytaty, brakuje im kluczowych prac, w tym niewłaściwych prac, i czasem nawet wymieniają nieistniejące prace – błędy, które sugerują, że cytaty pochodzą z powierzchownego dopasowania wzorców, a nie z prawdziwej ekspertyzy.

Autorzy zauważają również, że niektóre ostatnie prace przeglądowe, często z całkowicie różnych zespołów, dzielą się aż 70% swoich list cytowań – poziom nachodzenia, który jest tak wysoki, że sugeruje wspólną zależność od LLM, które czerpią z tego samego wąskiego basenu materiałów źródłowych.

W istocie, użytkownicy ChatGPT wiedzą, że im bardziej temat jest nieznany, tym mniej różnorodnych źródeł jest dostępnych dla modelu; bardzo często lokalizowanie własnych ograniczonych źródeł modelu w sieci jest bardziej przydatne niż interakcja z tą informacją za pośrednictwem AI, która nie miała wystarczających danych w określonej dziedzinie.

„Homogeniczny styl”

Autorzy zauważają również, że wiele prac przeglądowych napisanych przez AI na ten sam temat wygląda i brzmi niemal identycznie, ponieważ LLM-y ponownie wykorzystują frazy i strukturę, szczególnie w przypadku popularnych tematów, w wyniku czego powstaje lawina prawie identycznych prac, które dodają niewiele wartości i również generują znaczny szum dla badaczy poszukujących odpowiedzi w dziedzinie*:

‘Gdy wielu autorów prosi LLM o „napisanie przeglądu literatury na temat X”, model często wytwarza bardzo podobne odpowiedzi, zwłaszcza dla powszechnych definicji lub dobrze znanych faktów. Ostatnie badania wykazały gwałtowny wzrost stosowania pewnych wzorców pisarskich związanych z LLM, co sugeruje, że wiele prac teraz dzieli ten sam styl.’

Twoja ChatGPT jest widoczna

Praca zauważa, że szybkim sposobem na wykrycie prac przeglądowych napisanych przez AI jest obecność fraz, takich jak ‘as an AI language model‘ lub ‘my knowledge cutoff‘, co sugeruje minimalne lub nawet żadne kuratowanie wyjścia z modeli językowych przed złożeniem prac (chociaż celowe wyszukiwanie w czasie pisania nie ujawniło takich wskaźników zindeksowanych w Google Search).

Praca zauważa, że wiele „podejrzanych” prac przeglądowych wykazuje niższą różnorodność słów i powtarzające się frazy, na przykład rozpoczynające wiele akapitów od Furthermore. Taki wzorzec, twierdzą autorzy, jest typowy dla pisarstwa w stylu GPT, i mógłby być przydatnym wskaźnikiem do wykrywania automatycznie wygenerowanego tekstu.

(Moja osobista uwaga na ten temat jest taka, że surowce internetowego dziennikarstwa często wymagają, aby pisarz wymienił wiele elementów w postaci prozy, niestylizowanej. Dlatego ChatGPT i jego koledzy prawdopodobnie nauczyli się tego złego nawyku od pisarzy ludzkich, którzy mieli ograniczoną liczbę leksykalnych alternatyw. Ponadto konjektura autorów pokazuje, że bawią się w zasadach wykrywania treści AI, co jest skomplikowaną i rozwijającą się dziedziną, z niewielką liczbą trwałych stałych, jak sugerują autorzy)

Chociaż badacze kontynuują fascynującą dyskusję na temat negatywnego wpływu prac przeglądowych AI na kulturę badawczą i zaufanie, musimy odesłać czytelnika do źródłowej pracy w celu uzyskania większej głębi na ten temat.

Rozwiązania?

Rozwiązanie proponowane w pracy jest fascynujące, radykalne i jednocześnie niewiarygodnie niewygórowane: że użyteczność prac przeglądowych powinna zostać zastąpiona przez Dynamiczny Przegląd Na Żywo – według interpretacji, rodzaj hybrydy między Wiki a stroną GitHub, ciągle zasilaną nowymi danymi z LLM i innych systemów AI, ale z komitetami dokonywanymi tylko przez ludzi, tak aby AI nie mogła „auto-publikować” aktualizacji.

Proponowany system dzieliłby wersjonowanie i gałęzie GitHub, podstawowo przekształcając zasób informacji w ciągle aktualizowaną listę podobną do „awesome” listy na GitHub:

‘W ramach tego frameworku członek społeczności najpierw ustanawia wiki tematu przeglądu, określając zakres, kluczowe pytania badawcze i podstawowe cytaty, co tym samym ustanawia wyraźną granicę tematyczną i początkową strukturę.

‘Następnie agent LLM oparty na ingesti kontynuuje monitorowanie archiwów preprintów, procedur konferencyjnych i tabel wyników. Automatycznie wyodrębnia abstrakty, rysunki i kluczowe wskaźniki wydajności; syntetyzuje zwięzłe podsumowania nowych wyników; aktualizuje graf cytatów, aby odzwierciedlić relacje między pracami; i flaguje pojawiające się trendy badawcze do dalszego przeglądu.

‘Zgodnie z projektem, te automatyczne aktualizacje występują w ciągu godzin od publikacji, zapewniając, że repozytorium pozostaje na bieżąco.’

‘Następnie współpracownicy ludzcy wkraczają, aby dostarczyć głębię interpretacyjną, której maszyny same nie mogą dostarczyć. Udoskonalają ewoluujące taksonomie, aby uchwycić subtelne różnice metodologiczne, koordynują sprzeczne interpretacje innowacji algorytmicznych w różnych poddziedzinach i dostarczają głębsze porównania krytyczne do dokumentu.’

Księga zmian

Autorzy rozwijają swoją propozycję z entuzjazmem i obszernością, i w zasadzie uzasadniają ją czymś, co jest bardzo prawdziwe: prace przeglądowe napisane przez ludzi na temat niestabilnych tematów związanych z AI są tak szybko przestarzałe, że prawie nie warto ich pisać; i praca zauważa, że trzymiesięczny okres na nową pracę przeglądową oznacza, że będzie ona przestarzała (lub nawet znacznie przestarzała) do czasu jej planowanej daty publikacji:

‘Rok po roku społeczności są zalewane powtarzalnymi lub powierzchownymi przeglądami, które szybko tracą znaczenie, pozostawiając praktyków i nowicjuszy, aby odróżnić sygnał od szumu. Tradycyjny cykl publikacji (tj. projekt, złożenie, przegląd i publikacja) może trwać kilka miesięcy, do tego czasu krytyczne przełomy mogą już zmienić krajobraz.

‘Ponadto, rosnąca liczba statycznych prac przeglądowych dodaje do przeciążenia poznawczego, ponieważ czytelnicy muszą przefiltrować wiele nakładających się dokumentów, aby znaleźć istotne spostrzeżenia.’

Niestety, rozwiązanie proponowane w pracy dzieli wiele z najgorszych i najbardziej krytykowanych cech Discord: szczególnie, że byłaby to zasobem ciągle zmieniającym się i ewoluującym.

Ponieważ każda część Dynamicznego Przeglądu Na Żywo mogłaby zniknąć lub zostać zmieniona w dowolnym momencie, byłoby niemożliwe do użycia jako cytowalnego, stabilnego źródła; chyba, że poprzez linkowanie do „poprzedniego komitu”, w podobny sposób, jak archive.is i Wayback Machine, wśród innych stron archiwizujących, zapewniają linkowalne migawki zawartości strony internetowej, zamrożone w określonym czasie. Ale jakie zasoby potrzebowałby taki komitet, i czy mógłby być ufundowany, aby pozostać aktywny w czasie?

Ponadto platforma/Wiki z ciągle zmieniającą się definicją i zawartością byłaby wyzwaniem do indeksowania, zarówno przez tradycyjne wyszukiwarki, jak i LLM-y.

Być może najsłabszą częścią proponowanego systemu jest idea, że prawdziwi ludzie powinni nadzorować komity od agentów LLM; jak zawsze, prawdziwi ludzie są drodzy. To, co jest proponowane, to coś pomiędzy muzeum a biblioteką – obie będą potrzebować mięsopustego zaopatrzenia proporcjonalnego do objętości danych i liczby tematów objętych.

Jeśli „użyj prawdziwych ludzi” jest jedyną odpowiedzią na problem rozwoju AI, to można powiedzieć, że problem pozostaje otwarty i nierozwiązany.

Podsumowanie

W tym momencie krótki okres przydatności prac przeglądowych na temat AI jest irytujący; jeśli obecny trend w kierunku wysokoskalowego pisarstwa automatycznego i składania będzie kontynuowany, jak to zostało wyobrażone w nowej pracy, stosunek sygnału do szumu stanie się chroniczny, a literatura stanie się niekontrolowalna.

W takiej sytuacji byłoby jeszcze trudniej niż teraz, aby głosy mniejszości, nie-FAANG, były słyszalne w burzy zgłoszeń, a liderzy rynku głównego nurtu prawdopodobnie zyskaliby jeszcze większą dominację.

Oprócz przeglądów na żywo nowa praca proponuje, że autorzy nie tylko powinni być ograniczeni do deklarowania, kiedy AI jest używana w jakiejkolwiek części zgłoszenia, ale także, że sekcje wspomagane przez AI powinny być wyraźnie oznaczone w pracy (może z plikiem JSON…?).

Ponieważ jest to uciążliwa perspektywa, praca proponuje alternatywnie, co mogę tylko scharakteryzować jako „getto AI” – odrębną sekcję w zgłoszeniu, która jest przeznaczona dla wkładu AI.

W skrócie, nowa praca nie ma, przynajmniej moim zdaniem, realistycznych odpowiedzi do zaoferowania; ale autorzy wykonali użyteczną pracę, ramy wyzwań, które nadchodzą.

Praca Stop DDoS Attacking the Research Community with AI-Generated Survey Papers można znaleźć pod adresem https://arxiv.org/abs/2510.09686, i jest napisana przez sześciu autorów z wydziałów na Uniwersytecie w Szanghaju.

___________________________________

* Nie wszyscy uważają, że jest to prawda.

†Podkreślenie autorów, a nie moje. Również, gdzie stosowne, moja konwersja cytatów wewnętrznych autorów w linki.

Pierwotnie opublikowane w piątek, 17 października 2025