Kąt Andersona

Nawet podstawowy AI może teraz pisać newsy, które przypominają teksty napisane przez ludzi

Nowe badania wskazują, że nawet niewielkie lokalne modele AI mogą teraz pisać newsy, których ludzie nie mogą odróżnić od prawdziwego dziennikarstwa, dorównując najlepszym systemom i pozostawiając czytelników niezdolnych do określenia, kto napisał co.

Zgodnie z nowym współpracą badawczą między Niemcami a Francją, ludzie nie mogą powiedzieć, czy artykuł informacyjny został napisany przez AI, czy przez człowieka – nawet jeśli został napisany przez modele open source, które można pobrać i uruchomić na stosunkowo przeciętnych komputerach klasy biurkowej.

W innym wskaźniku, że małe AI są w górę, ankieta 2 318 ocen zebranych od 1 054 uczestników w dedykowanym portalu badawczym wykazała, że czytelnicy ludzcy nie mogli określić pochodzenia artykułu na poziomie wyższym niż losowy, nawet gdy był generowany przez względnie skromne modele z takimi parametrami, jak siedem miliardów, w tym Mistral i Llama warianty:

Średnie wyniki ocen źródła i autentyczności dla LLM testowanych. Te testowane w badaniu to Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o i GPT-3.5. Źródło

Autorzy powracają do tematu, który po raz pierwszy zbadali w 2024 roku wydaniu Błogosławieństwo czy przekleństwo? Badanie wpływu sztucznej inteligencji na fałszywe wiadomości. Same wyniki są nowo opublikowanymi wynikami z większego projektu, który został po raz pierwszy ogłoszony w styczniu i wykorzystuje własną ramę JudgeGPT online.

Siła lekka

Tytuł Czy ludzie mogą powiedzieć? Dwuosiowy study of human perception of LLM-Generated News, pochodzący od trzech badaczy z Frankfurt University of Applied Sciences i jednostki badawczej IRISA w Nantes, nowe badanie robi ważne rozróżnienie między ‘fałszywymi wiadomościami’ a ‘wiadomościami napisanymi przez AI’ (ponieważ fałszywe wiadomości mogą być napisane przez ludzi lub przez AI, a dwa aspekty nie są koniecznie synonimami).

Jednak najbardziej interesującym aspektem jest wniosek, że małe modele, w tym Mistral 7B i Gemma 7B, mogą, z tylko siedmioma miliardami parametrów, równać się z modelem ChatGPT (4o) z 200 miliardami parametrów:

‘Modele o wagach otwartych z takimi parametrami, jak 7 miliardów, produkują tekst, który jest oceniany nie inaczej niż wyjście GPT-4o, co wskazuje, że zdolność do generowania tekstu, który nie można odróżnić od ludzkiego, nie jest już ograniczona do modeli na granicy.’

Jednak ‘wiadomości wygenerowane przez AI’ mogą reprezentować wiele różnych rodzajów współpracy człowiek-AI, od sprawdzania pisowni po pełne, zakończenie wysiłku, a badanie nie wyjaśnia dokładnie, jaki rodzaj zawartości AI został wyprodukowany do testów (chociaż opisuje metodologię ich produkcji – patrz poniżej).

Metoda

Dla uczestników zaangażowanych w platformę JudgeGPT, każdy fragment wiadomości był oceniany za pomocą dwuosiowej ramy, w której dostarczali trzy niezależne oceny na ciągłych suwakach 0-100:

Interfejs portalu JudgeGPT, gdzie oceniający oceniają materiał pod kątem atrybucji źródła; autentyczności; i znajomości tematu. Proszę odnieść się do źródłowego dokumentu, aby uzyskać lepszą rozdzielczość.

Ocena źródła ujmuje, czy fragment wydaje się napisany przez maszynę, czy przez człowieka; ocena autentyczności, czy jest postrzegany jako fałszywy lub prawdziwy; i znajomość tematu, jak dobrze czytelnik zna temat.

Suwaki ciągłe były używane zamiast skali Likerta, aby uchwycić stopnie pewności bardziej precyzyjnie i wesprzeć analizę statystyczną, w tym korelację Pearsona i klastering.

Fragmetry tekstu wygenerowane przez maszynę były produkowane przez własną ramę RogueGPT autorów, architekturę wejściową dla JudgeGPT. RogueGPT koordynuje wkład sześciu dużych modeli językowych (LLM): ChatGPT-4; ChatGPT-3.5; ChatGPT-4o; LLaMA-2 13B; Gemma 7B; i Mistral 7B.

Wyzwalacz oparty na osobowości był używany do generowania tekstów, a generacje AI były oparte na prawdziwych tematach informacyjnych i były sprawdzane przez ludzi.

Odwrócony, fragmenty napisane przez ludzi były pobierane z ‘ustanowionych serwisów informacyjnych’ i niespecyfikowanych ‘baz danych informacyjnych’.

Autorzy zauważają:

‘Zestaw bodźców jest celowo przesunięty w kierunku fragmentów pochodzących z maszyny (∼98%), z elementami pochodzącymi z ludzi służącymi jako kotwice kalibracyjne.

‘To wybór projektu odzwierciedla focus badania na wewnątrz-AI zmiany (przez modele) zamiast porównania człowiek-AI; uczestnicy nie są informowani o stawce podstawowej, a wyniki bliskie losowości [wyniki] utrzymują się, gdy analizowane są na podstawie podzbioru pochodzącego od ludzi.’

Uczestnicy najpierw wyrazili zgodę i wypełnili kwestionariusz demograficzny, obejmujący wiek, wykształcenie, orientację polityczną i znajomość AI, po czym oceniali sekwencję fragmentów informacyjnych.

Każda osoba przeglądała od 5 do 87 elementów, z medianą 12, podczas gdy kolejność prezentacji była losowa, a przypisanie modelu było zrównoważone wśród uczestników, aby zmniejszyć stronniczość. Platforma rejestrowała trzy oceny suwakowe wraz z czasem odpowiedzi i anonimowym identyfikatorem, umożliwiając połączenie indywidualnych ocen z czynnikami tła.

Autorzy zwracają uwagę, że próba była przesunięta w kierunku wykształconych uczestników europejskich, z 68% wykształconych na poziomie uniwersyteckim i 74% z Europy – stronniczość, którą dokument uznaje za ograniczenie ogólnej generalizacji.

Testy

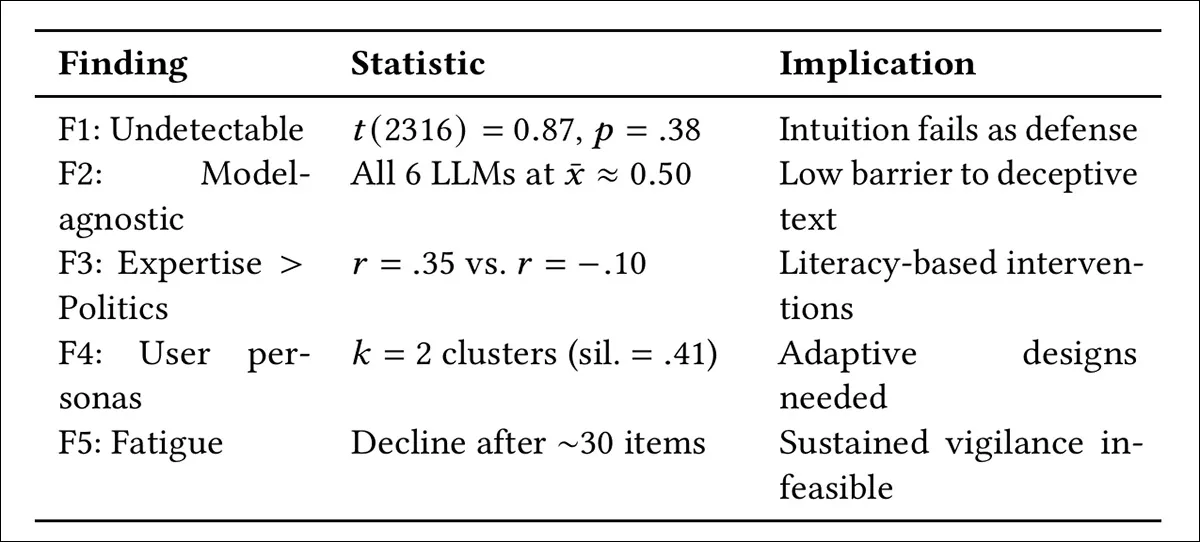

Testy są podzielone na pięć typów wyników: rozróżnianie tekstu wygenerowanego przez maszynę od napisanego przez człowieka; porównywanie wykrywania na różnych LLM; badanie wpływu ekspertyzy domenowej na orientację polityczną na dokładność; identyfikowanie odrębnych strategii odpowiedzi wśród uczestników; i śledzenie, jak dokładność zmienia się podczas powtarzanych ocen, ze względu na zmęczenie:

Podsumowanie pięciu podstawowych wyników z 2 318 ocenami wśród 1 054 uczestników, pokazujące, że wykrywanie tekstu napisanego przez AI przez ludzi pozostawało na poziomie losowym we wszystkich modelach, że dokładność była związana z ekspertyzą domenową, a nie z orientacją polityczną, że uczestnicy klastry w odrębne profile zaufania, i że wydajność spadła po około 30 ocenach, ze względu na zmęczenie poznawcze.

Test pokazał, że nie ma znaczącej różnicy ponad losowość w ocenach źródła między warunkami, co wskazuje, że uczestnicy nie mogą rozróżnić tekstu wygenerowanego przez AI od wyjścia ludzkiego:

Rozkład ocen źródła i autentyczności dla fragmentów pochodzących z maszyny i ludzi pokazuje znaczne nakładanie się, bez znaczącego rozdzielenia między dwoma warunkami, a testy statystyczne – wskazujące, że uczestnicy nie mogli niezawodnie rozróżnić tekstu wygenerowanego przez AI od zawartości napisanej przez człowieka.

Dla drugiego aspektu, jak pokazano na wykresie na początku artykułu, niepowodzenie wykrywania nie różniło się w zależności od modelu, ponieważ dane wyjściowe ze wszystkich LLM były skupione wokół ocen na poziomie losowości, bez znaczących różnic między nimi. Nawet mniejsze systemy o wagach otwartych, takie jak Mistral 7B i Gemma 7B, były oceniane nie inaczej niż GPT-4o, co wskazuje, że tekst nie do odróżnienia od ludzkiego może nie być już ograniczony do największych modeli.

Dla trzeciego aspektu dokładność była silniej związana z ekspertyzą domenową niż z orientacją polityczną, ponieważ znajomość fałszywych wiadomości była skorelowana z lepszymi ocenami, podczas gdy poglądy polityczne nie wykazywały znaczącego wpływu, co sugeruje, że umiejętności analityczne oparte na doświadczeniu mogą być bardziej istotne niż ideologia:

Wyniki trzeciej linii badawczej wykazały, że orientacja polityczna nie miała znaczącego wpływu na atrybucję źródła ani ocenę autentyczności, z tylko słabymi, nieistotnymi trendami, podczas gdy samoocena znajomości fałszywych wiadomości była związana z wyższą dokładnością w obu osiach. To sugeruje, że umiejętność analityczna oparta na doświadczeniu była silniejszym predyktorem wydajności niż pozycja ideologiczna. Proszę odnieść się do źródłowego dokumentu, aby uzyskać lepszą rozdzielczość.

Czwarty wynik wykazał, że uczestnicy klastry w dwie odrębne style odpowiedzi, określane jako ‘Sceptycy’ – którzy przypisywali niskie zaufanie do zawartości niezależnie od pochodzenia – i ‘Wierzący’ – którzy utrzymywali wyższy poziom zaufania.

Wreszcie, w odniesieniu do piątego celu, analiza przewijana sekwencyjnych ocen wykazała, że uczestnicy początkowo stawali się lepsi w zadaniu, z dokładnością poprawiającą się przez około pierwsze 15-20 ocen, gdy dostosowywali się do formatu:

Średnie przewijane ocen atrybucji źródła i autentyczności w sekwencji ocen uczestników pokazują krótką fazę poprawy na początku, gdy użytkownicy zdają się dostosowywać do zadania w ciągu pierwszych 15–20 elementów, po których następuje stały spadek w obu miarach po około 30 ocenach. Proszę odnieść się do źródłowego dokumentu, aby uzyskać lepszą rozdzielczość.

Jednak ten efekt był krótkotrwały, ponieważ wydajność zaczęła spadać po około 30 elementach, z uczestnikami, którzy coraz częściej oznaczali zawartość jako fałszywą – zmianę interpretowaną jako zmęczenie poznawcze, co sugeruje wyraźne ograniczenia, jak długo podejścia oparte na wykrywaniu mogą pozostać skuteczne w praktyce.

To może stanowić pewne dowody empiryczne, że, wyczerpani perspektywą rozróżniania fałszywych wiadomości od prawdziwych, wiadomości AI od ludzkich, możemy tendencję do przyjmowania założenia, że wiadomości są AI i/lub fałszywe (niekoniecznie to samo), aby być ‘po bezpiecznej stronie’. Ci, którzy uważają to za ‘lenistwo’ i uważają, że ludzie powinni sami sprawdzić, czy potencjalna fałszywa wiadomość jest wiarygodna, mogą być zainteresowani tym, że badanie z 2024 roku wskazało, że to tylko pogarsza problemy.

Autorzy sugerują, że niepowodzenie osądu ludzkiego, jak wynika z wyników, wskazuje, że możemy musieć przekazać te sprawy technologiom proveniencji kryptograficznej, takim jak inicjatywa C2PA prowadzona przez Adobe. Inne możliwe rozwiązania wymienione są przez autorów własną ramę OriginLens i inny projekt zaangażowany przez autorów o nazwie CRED-1.

Autorzy kończą:

‘Czy ludzie mogą powiedzieć? Nasz dwuosiowy study of 2 318 ocen wśród sześciu rodzin LLM dostarcza wyraźną empiryczną odpowiedź: nie mogą.

‘Tekst wygenerowany przez maszynę jest nie do odróżnienia od pisarstwa ludzkiego, niezależnie od rozmiaru modelu lub rodziny, ekspertyza domenowa lepiej przewiduje dokładność wykrywania niż orientacja polityczna, uczestnicy przyjmują odrębne strategie zaufania, a zmęczenie poznawcze ogranicza trwałe wykrywanie.

‘Te wyniki wspierają przesunięcie od wykrywania na poziomie użytkownika do środków przeciwdziałających na poziomie systemu, w tym proveniencji zawartości, wskaźników zaufania i interwencji o ograniczonym wpływie.’

Wnioski

Niepokojącym aspektem tego dokumentu jest sieć wsparcia projektów i dokumentów, które autorzy – lub niektórzy z autorów, w zależności od pracy – zainicjowali lub mają udział w; i na pewno byłoby oświecające, gdyby można było zbadać próbki tekstu AI i ludzkiego, które wyprodukowały te wyniki, aby lepiej zrozumieć rodzaj wyjścia, jaki opisana metoda generowania produkuje.

Niemniej jednak jest interesujące usłyszeć, że modele o wagach otwartych i otwartym źródle mogą być porównywalne z gigantami API, takimi jak seria ChatGPT – czy może być tak, że zadanie jest tak naprawdę nie tak trudne, a model z 200 miliardami parametrów jest nadmiarem dla takich zadań? Musielibyśmy wiedzieć trochę więcej o próbkach źródłowych AI i ludzkich, aby odpowiedzieć na to pytanie.

Tymczasem, zgodnie ze stroną canirun.ai, Mistral 7B (który był mniej więcej na równi z ChatGPT-4o w testach) ‘działa dobrze’ na NVIDIA RTX 3080 z 16 GB pamięci VRAM, i ‘działa przyzwoicie’ na 3060 z 6 GB pamięci VRAM – nie są to najnowsze ani najlepsze karty graficzne w grze*. Ktoś, kto chce opracować własną metodologię dla próbek, może również uczestniczyć w tych eksperymentach.

* Gemma 7B nie jest wymieniona na stronie.

Pierwotnie opublikowane w czwartek, 9 kwietnia 2026