Andersons vinkel

AI’s Pursuit of Beauty

Et nytt AI-drevet skjønnhetsvurderingssystem vurderer hvor attraktive ansikter ser ut, mens det trener raskere enn typiske dyptlæringsmodeller, potensielt gjør stor skala automatisert skjønnhetsvurdering mer praktisk.

Ansikts skjønnhetsprediksjon (FBP) er storforretning, og en ganske sterk tråd i forskningslitteraturen. Selv om det bryter praktisk talt hver eneste grunnregel bak bekjempelse av fordommer i AI og maskinlæringspraksis, og selv om det på mange måter støtter objektifisering og reduksjonisme i algoritmiske persepsjoner av kvinner, tiltrekker det likevel interessen til flere multi-milliardindustrier, de fleste av dem er rettet direkte mot kvinner, som kosmetikk, kosmetisk ansiktskirurgi, direktesending, og mote, blant andre:

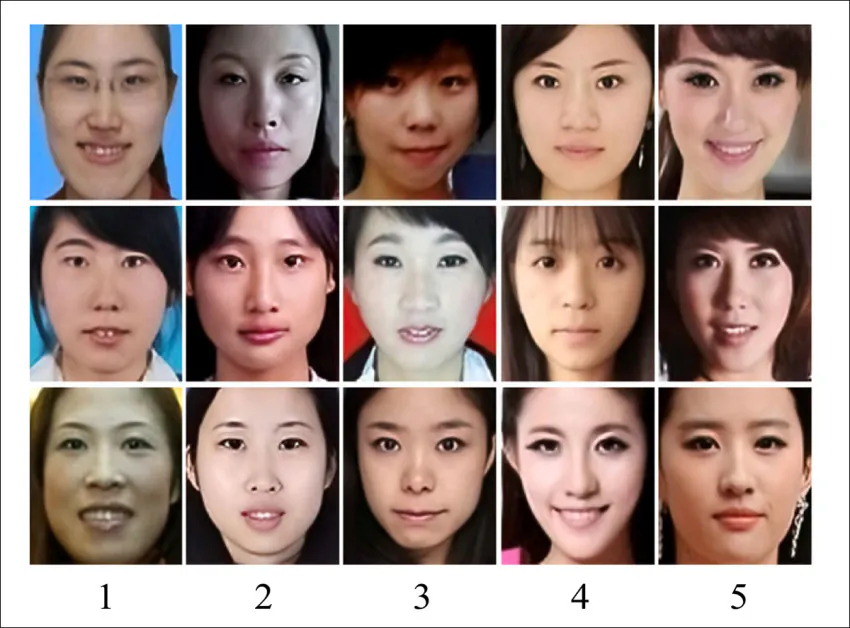

Kvinner vurdert fra 1-5, fra papiret ‘Asian Female Facial Beauty Prediction Using Deep Neural Networks via Transfer Learning and Multi-Channel Feature Fusion’. Kilde

Utenfor disse åpenbare kvinnelige forretningsenklaver, har reklame og flere andre industrier, inkludert underholdning og utgivelse, betydelige innsatser i å forstå hva både menn og kvinner finner ‘attraktive’, nødvendigvis på en per-kulturell basis.

Det faktum at samlede persepsjoner av skjønnhet varierer over regioner, betyr at ingen definitive globale datasett kan bli oppnådd, og at ny forskning må enten forbli provinsiell, eller konsentrere seg om ‘høy-nivå’-metoder som kan bli brukt over diverse kulturelle data.

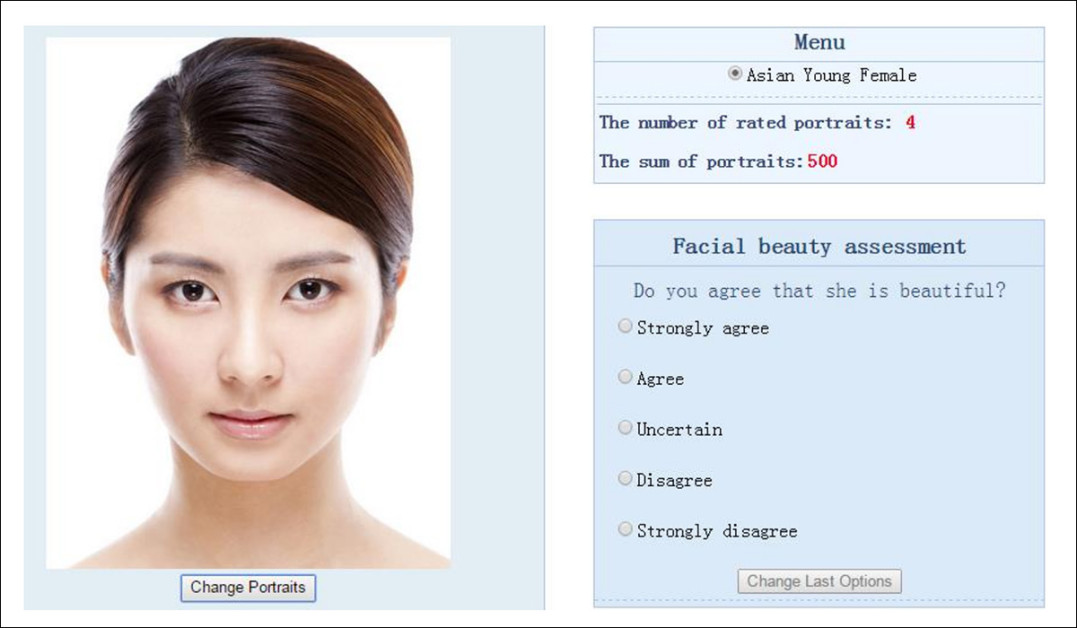

En grensesnitt for et ansikts skjønnhetsvurderingssystem for 2015 SCUT-FBP-prosjektet. Kilde

Ofte er geografisk beliggenhet ikke den eneste begrensningen, siden tiltrekning-fokuserte datasett kan slite med å gi like effektivitet over kjønn, eller kan ha blitt kuratert med en bestemt anvendelse i mente – og dette kan begrense samlingens bruk i andre domener.

For eksempel, i 2025 rapporterte jeg om utviklingen av et relativt stort datasett (100 000+ identiteter) for å vurdere tiltrekning i direktesending, hvis nærklipte standarder kan trenge betydelig tilpasning til bredere prosjekter, til tross for den enorme innsatsen bak initiativet.

Ansiktsrendition

Som kan være tydelig fra lenkene og bildene ovenfor, er asiatiske forskningsorganer ofte ikke opererende under de samme kulturelle begrensningene som deres vestlige motparter, som ville være hardt presset å våge å publisere en vitenskapelig illustrasjon som vurderer fem vestlige kvinner fra minst til mest attraktive, som vi ser i ovennevnte studie.

Det kan argumenteres for at hvor asiatiske systemer av denne typen er bevist effektive i offentligheten, uten frykt for lokal kritikk, kan vestlige interesser bruke eller tilpasse slik forskning til proprietære, private implementeringer. Oppgaven med å ‘vurdere kvinner’ i den scenarioen, er rendert til en lokalitet hvor det kan bli forfulgt uten kritikk.

Uansett om dette er vanlig eller om mindre offentliggjorte vestlige ekvivalente systemer tenderer til å bli utviklet bort fra åpen kildekode-samarbeid og fra offentlig skråning, er det rimelig å anta at målet er av globalt interesse, på grunn av det store antallet profesjonelle sektorer som kan eller kunne dra nytte av nøyaktige vurderinger av tiltrekning.

Overlevelse av den sterkeste

Det kan synes som om massive web-skrapable korpus som Tik Tok, Instagram og YouTube ville være utmerkede dommere for skjønnhet, ved å korrelere følgere, lik og trafikk til tiltrekning, siden dette er en vanlig og rimelig assosiasjon (om enn med noen unntak).

Liksom, eksisterende samlinger – som ImageNet og LAION – som viser skuespillere og modeller som har ‘reist til toppen’– vil vanligvis inneholde attraktive individer (om enn med for mange datapunkter av for få mennesker), og tillate videre kulturelle mekanismer å fungere som en proxy for tiltrekning.

Men dette tar ikke med i betraktning skiftende smak i hva mennesker finner attraktive over tid (la alene geografisk). Derfor, igjen, er høy-nivå og data-agnostiske systemer nødvendige, ikke individuelle og spesielle samlinger eller kureringer som vil slite med å reflektere skiftende smak.

Kombinasjon hud

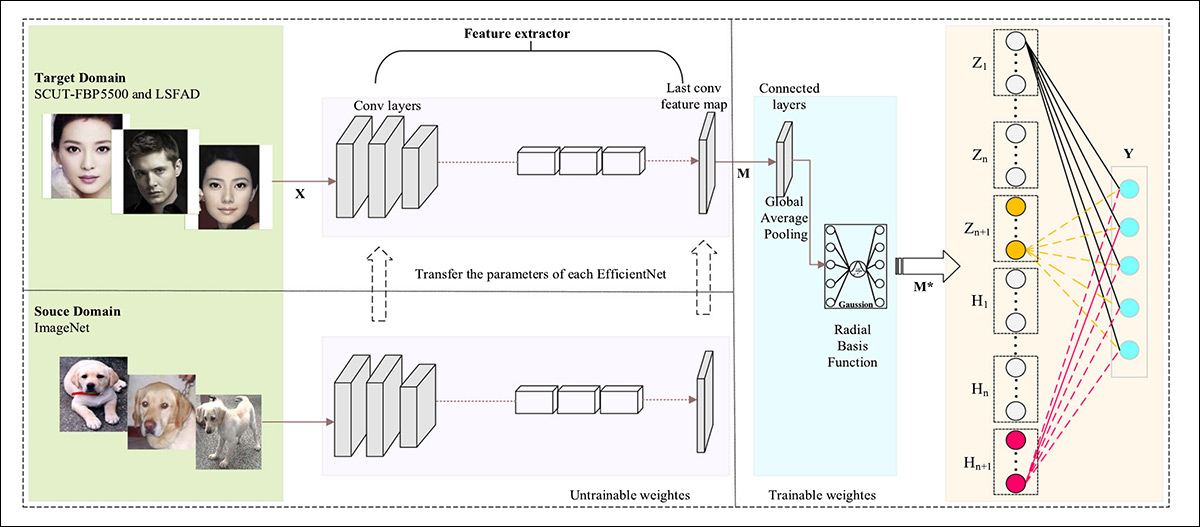

Den siste akademiske inngangen for å takle disse utfordringene kommer fra Kina, hvor overføringslæring og Broad Learning System (BLS) kombineres for å adresse den langvarige avveien mellom nøyaktighet og beregningskostnad.

Konvensjonelle neurale nettverk tenderer til å oppnå sterke resultater bare med tung trening, mens lettere systemer som BLS trener raskt, men sliter med å fange nok detalj. Den nye arbeidet broer denne gapen ved å bruke et forhåndstreent visuelt modell til å trekke ut ansiktsfunksjoner, som deretter blir sendt til en rask BLS-basert system for scoring, og tillater funksjoner å bli gjenbrukt i stedet for å bli lært fra scratch, samtidig som treningen holdes effektiv:

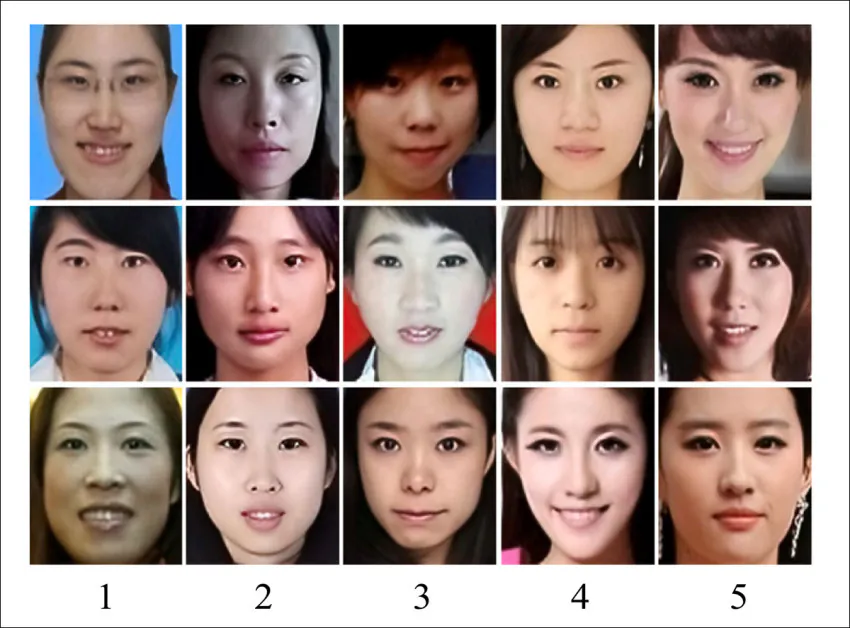

Eksempelbilder fra LSAFBD-datasettet, som viser kvinnelige ansikter gruppert etter menneske-tildelte skjønnhetspoeng fra 1 til 5. Vurderinger ble oppnådd fra multiple annotatorer, og brukt som overvåket labels for trening og evaluering av ansikts skjønnhetsprediksjon-modeller over variasjoner i pose, lys, og utseende. Kilde

Den første av de to variasjonene, E-BLS, fôrer ekstraherte funksjoner direkte inn i det lette systemet, mens den andre, ER-BLS, legger til en enkel mellomliggende prosess som standardiserer og forbedrer disse funksjonene før vurdering, og hjelper med å forbedre konsistensen uten å sakke prosessen.

Testene utført av forfatterne beviste, hevder de, at deres tilnærming er overlegen til både metoder alene, og til andre konkurransemetoder.

Den nye artikkelen er tittel Ansikts skjønnhetsprediksjon fusjonering overføringslæring og Broad Learning System, og kommer fra seks forskere ved Wuyi University, Jiangmen.

Metode

Den ovennevnte Broad Learning System er en lett alternativ til dyptlæringsmodeller, som hopper over å stable flere lag, og i stedet spreder læring over et bredt sett av enklere forbindelser, og tillater modeller å trene raskt – men vanligvis på bekostning av å gå glipp av finere visuell detalj.

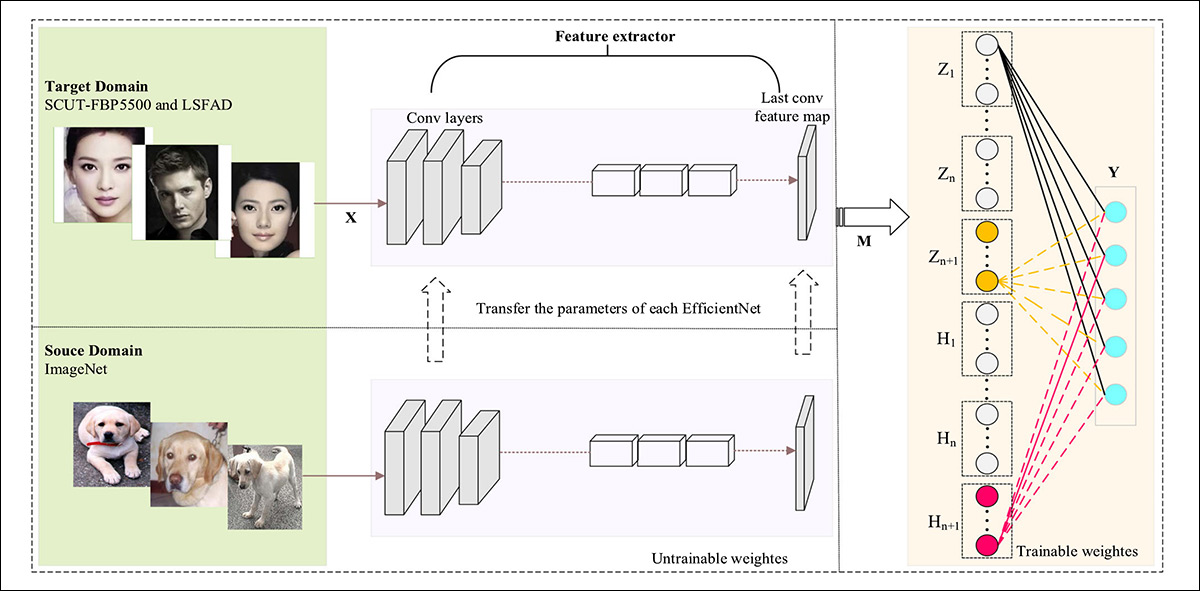

Den første av de to variasjonene, E-BLS, kombinerer EfficientNet-basert overføringslæring med BLS, og trekker ut detaljerte visuelle funksjoner fra et ansikt, og sender dem deretter til BLS, og omfatter en endelig vurdering som unngår behovet for å trene et fullt dypt neuralt nettverk fra scratch:

Arkitektur-skjema for E-BLS-modellen.

EfficientNet, forhåndstreent på ImageNet-1k, og stort sett holdt uendret, konverterer hver innputt-bilde til en kompakt sett av egenskapsverdier som beskriver ansiktet på en strukturert måte, mens BLS tar disse verdiene og prosesserer dem gjennom et nettverk av enkle, tilfeldig tilkoblede noder som transformerer og kombinerer informasjonen, før de produserer den endelige tiltrekningsscoren.

Fordi BLS ikke avhenger av dypt lagdelte strukturer, kan E-BLS bli oppdatert ved å legge til flere noder i stedet for å trene hele systemet på nytt,. Dette holder treningen rask, og gjør det enklere å forbedre modellen når nye data blir introdusert.

Den andre av de to variasjonene, ER-BLS, bygger på E-BLS ved å legge til en ekstra prosesseringsskritt mellom EfficientNet-egenskaps-ekstraktoren og BLS, med målet å forbedre hvordan disse ekstraherte funksjonene blir forberedt før de blir brukt til vurdering:

Arkitektur av ER-BLS-modellen.

I stedet for å sende de rå EfficientNet-egenskapene direkte inn i BLS, sender ER-BLS dem først gjennom en forbedringslag som standardiserer og omformer dataene, og hjelper med å redusere støy, og gjør funksjonene mer konsistente over forskjellige bilder. Dette skrittet er designet for å forbedre hvordan systemet generaliserer, spesielt når ansikter varierer i lys, pose eller andre visuelle forhold som kan ellers introdusere ustabilitet i vurderingene.

De forbedrede funksjonene blir deretter sendt inn i samme BLS-struktur som brukes i E-BLS, hvor egenskapsnoder og forbedringsnoder transformerer og kombinerer informasjonen for å produsere den endelige tiltrekningsscoren.

Data og tester

For å teste deres tilnærming, brukte forfatterne SCUT-FBP5500-datasettet, en ansikts skjønnhetsprediksjon-samling fra South China University, som inneholder 5 500 frontale ansiktsbilder på 350x350px, med diverse raser, kjønn og alder:

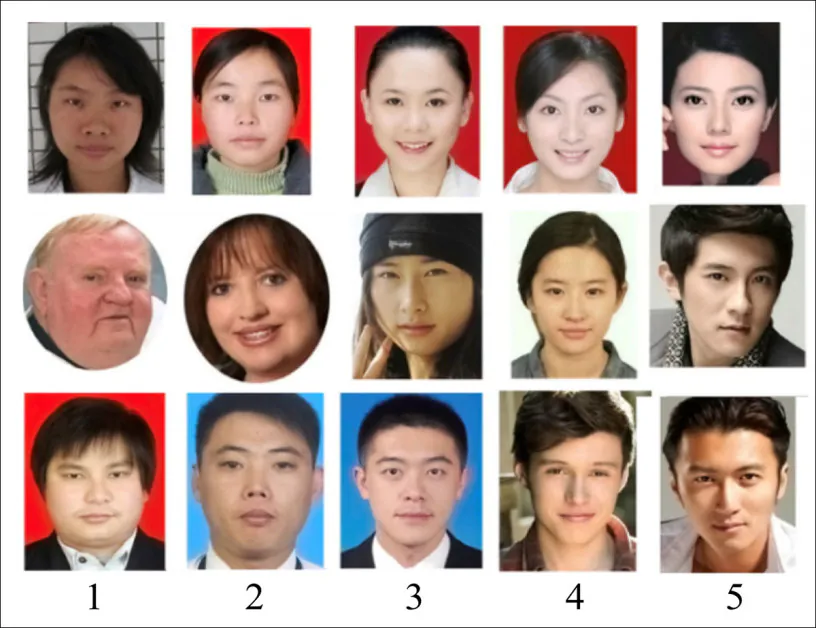

Eksempel-SCUT-FBP5500-datasett ansiktsbilder vurdert fra minst (1) til mest (5) attraktive.

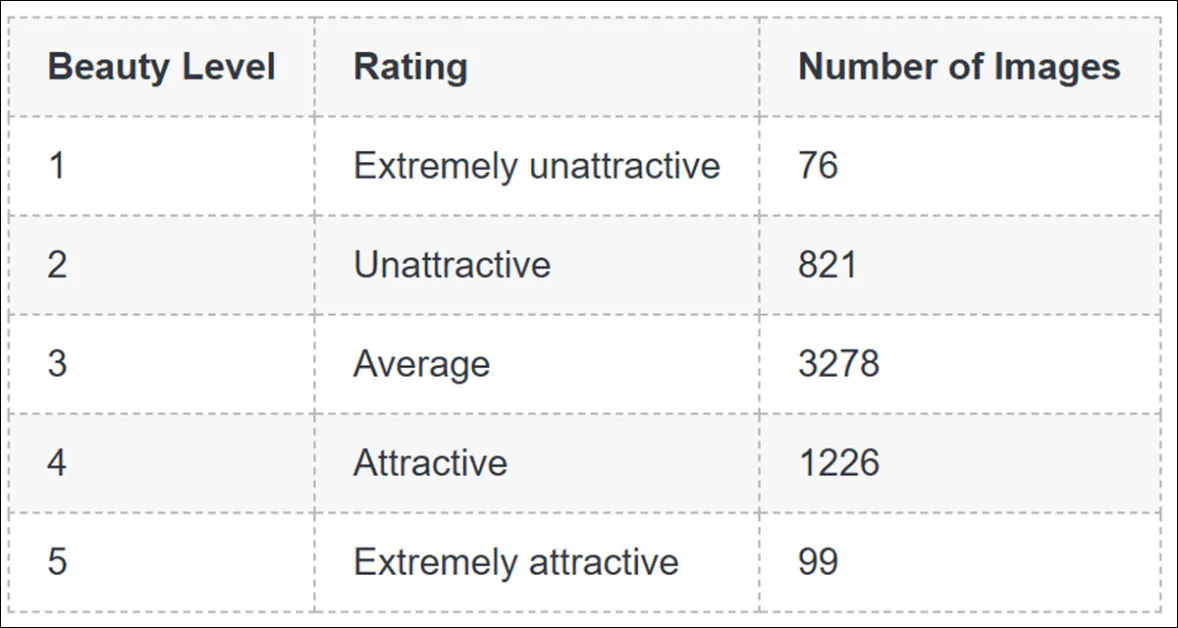

Hver bilde ble vurdert med en skjønnhetspoeng av 60 frivillige, på en 1-5 skala, som går fra ekstremt uattraktive (1) til ekstremt attraktive (5):

Fordelingen av proporsjoner av bilder etter skjønnhetspoeng.

Den andre database som ble brukt var Large-Scale Asian Female Beauty Dataset (LSAFBD)-samlingen, en datasett kuratert av forfatterne selv.

Eksempel-LSAFBD-datasett ansiktsbilder vurdert fra minst (1) til mest (5) attraktive.

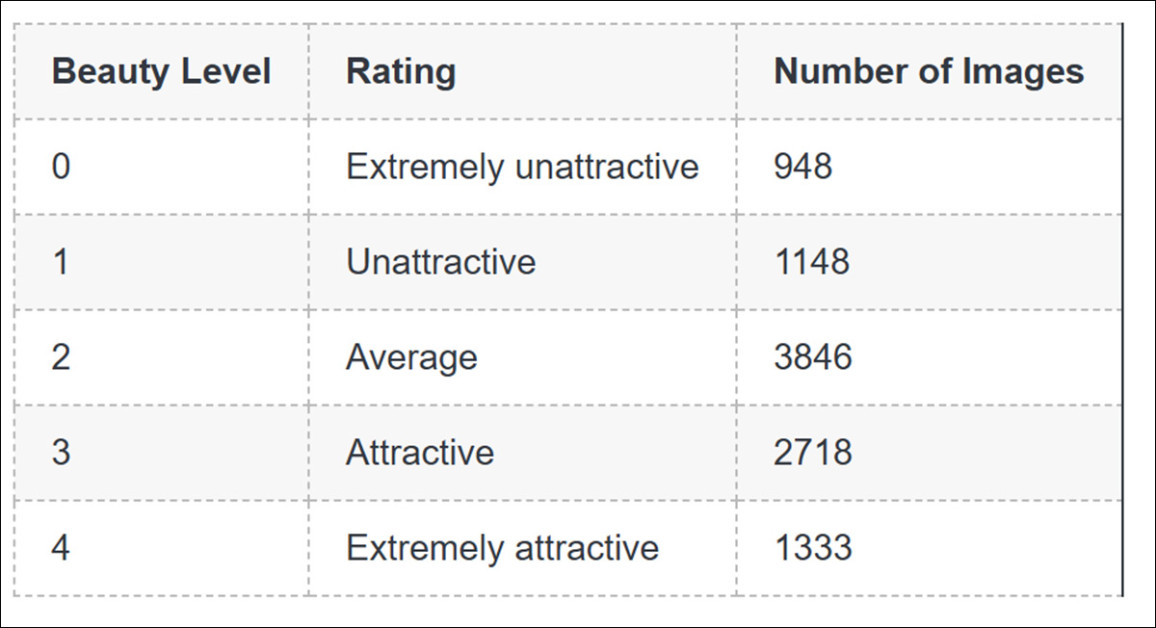

Samlingen består av 80 000 ubeskrivende bilder på 144x144px-oppløsning, med variasjoner i pose og bakgrunn, samt alder. Disse ble vurdert av 75 frivillige for samme kriterier som det forrige datasettet, denne gangen på en 0-4 skala:

Fordelingen for LSAFBD-datasettet.

Hver datasett ble delt inn i trening- og testsegmenter på en 8/20-forhold, og kryssvalidering ble brukt for å stabilisere resultater over løp. BLS-komponenten ble konfigurert gjennom antall funksjonsvinduer; antall noder per vindu; og antall forbedringsnoder, med Hyperopt brukt til å søke etter effektive kombinasjoner.

For å etablere en basis, ble en standard BLS-modell trent under identiske innstillinger, etterfulgt av en rekke overføringslæringsmodeller, inkludert ResNet50, Inception-V3, DenseNet121, InceptionResNetV2, EfficientNetB7, MobileNetV2, NASNet, og Xception – alle initialisert med ImageNet-1k-vektorer, og trent med deres siste lag ufrosset.

Trening brukte en læringshastighet på 0,001 (redusert når fremgangen stagnerte), og en batch-størrelse på 16, over 50 epoker, med regularisering og rektifisert lineær aktivering (ReLU) brukt gjennom hele.

Ytelsen ble evaluert ved hjelp av nøyaktighet og Pearson-korrelasjon, sammen med total treningstid, med resultater gjennomsnittlig over fem løp.

Forfatterne rapporterer treningssettet som en Intel-i7 3,6 GHz CPU og 64GB RAM på en ‘desktop-computer’:

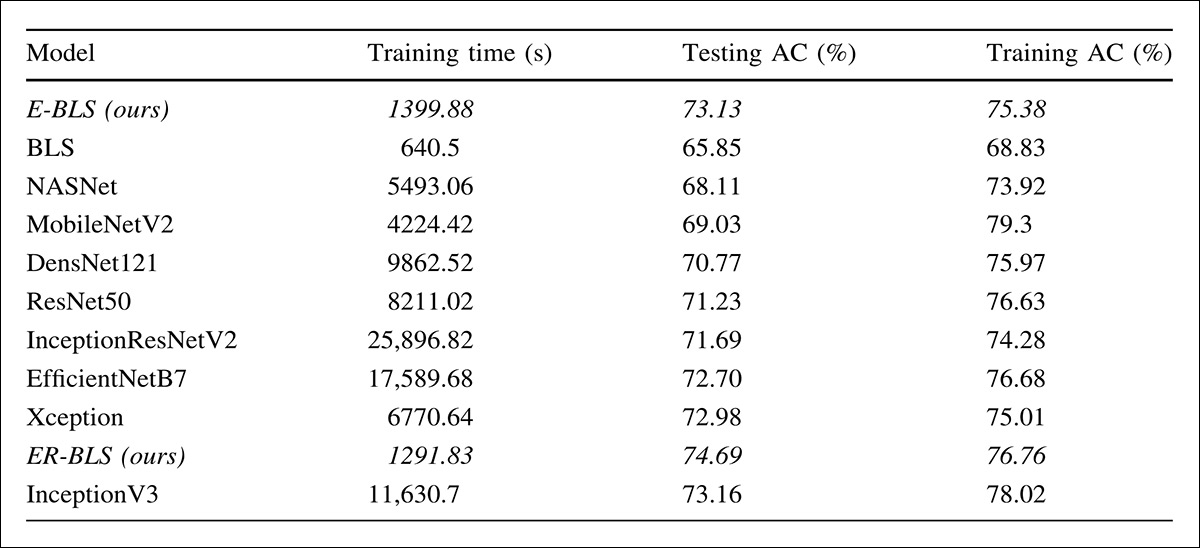

Ytelseskomparasjon på SCUT-FBP5500, hvor E-BLS og ER-BLS oppnår konkurranse-nyaktighet mot dyptlæringsmodeller inkludert ResNet50, EfficientNetB7, InceptionV3, og Xception, mens de krever betydelig mindre treningstid – og fremhever effisiens-gevinstene ved å kombinere overføringslæring med et Broad Learning System.

Resultatene indikerte at E-BLS forbedret nøyaktigheten fra 65,85% til 73,13%, mens ER-BLS nådde 74,69%, og overgikk alle sammenlignbare modeller. Treningstiden forblev betydelig lavere enn dyptlæringsmodeller, på omtrent 1 300 sekunder, i motsetning til flere tusen til over 25 000 sekunder.

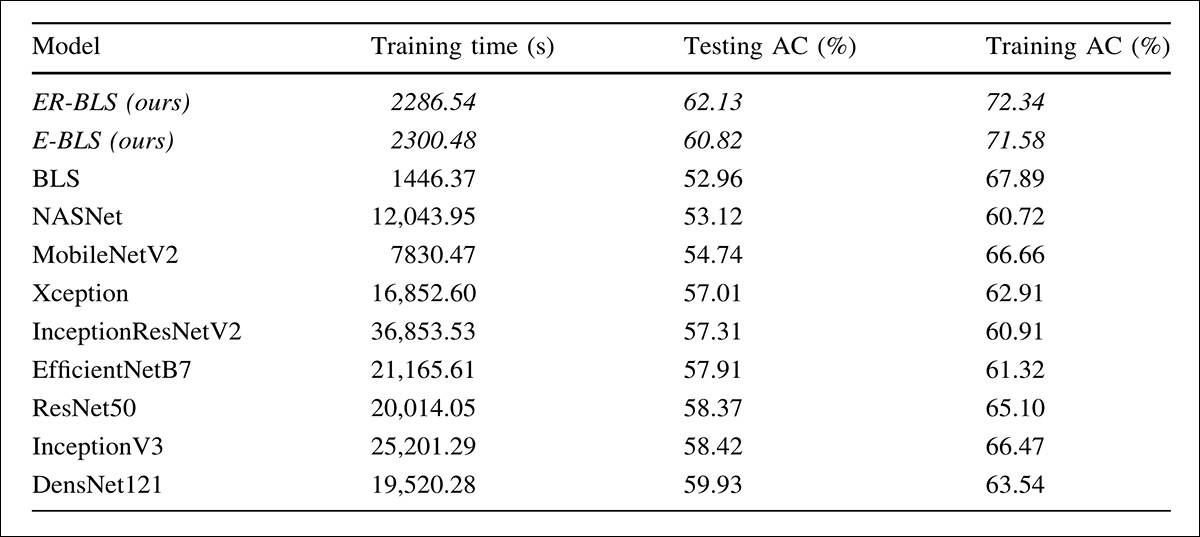

For testene på LSAFBD, viste resultatene at E-BLS forbedret nøyaktigheten over vanlig BLS, mens ER-BLS oppnådde den høyeste nøyaktigheten blant alle sammenlignbare metoder:

Ytelse på LSAFBD, hvor ER-BLS og E-BLS leverer høyere nøyaktighet enn alle basis- og overføringslæringsmodeller, mens de krever kun en brøkdel av deres treningstid, og indikerer en konsekvent fordel i effisiens uten å ofre prediktiv kvalitet.

Begge variasjonene opprettholdt betydelig lavere treningstid enn dyptlæringsmodeller, og indikerte en mer effektiv balanse mellom ytelse og beregningskostnad.

Konklusjon

Dette er en slags ‘throwback’-publikasjon, som bevises av dens bruk av pre-boom-favoritter som CNN, og ved dens laveste-nivå-trening-utstyr jeg har møtt i en ny artikkel i mange år.

Likevel, det handler om et overraskende resilientt mål i datavisualisering; ett som berører tungt på menneskelig erfaring og subjektiv tolkning, og som krever en skjema som transcenderer de estetiske trendene i øyeblikket, og kan forsyne en virkelig resilient pipeline for oppgaven.

Først publisert torsdag, 19. mars 2026