Andersons vinkel

På jakt etter ‘ugler og øgler’ i en annonsørs publikum

Siden det online annonsemarkedet estimeres å ha brukt 740,3 milliarder USD i 2023, er det lett å forstå hvorfor annonsebedrifter investerer betydelige ressurser i denne spesielle grenen av datavisjonsforskning.

Til tross for at bransjen er lukket og beskyttende, publiserer den studier som antyder mer avansert proprietær arbeid i ansikts- og øyegaze-gjenkjenning – inkludert aldergjenkjenning, som er sentral for demografiske analytikkstatistikk:

Estimere alder i en i-felt-annonsekontekst er av interesse for annonserere som kan målrette en bestemt aldersdemografisk gruppe. I dette eksperimentelle eksempelet på automatisk ansiktsalderestimering, følges alderen til artisten Bob Dylan over årene. Kilde: https://arxiv.org/pdf/1906.03625

Disse studiene, som sjelden dukker opp i offentlige repositorier som Arxiv, bruker legitimt rekrutterte deltakere som grunnlag for AI-drevet analyse som har til hensikt å bestemme i hvilken utstrekning, og på hvilken måte, seeren engasjrer seg i en annonse.

Dlibs Histogram of Oriented Gradients (HoG) brukes ofte i ansiktsestimeringssystemer. Kilde: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

Dyrenavn

I denne sammenhengen er det naturlig at annonseindustrien er interessert i å bestemme feilpositive (tilfeller der et analytisk system misforstår en persons handlinger), og i å etablere klare kriterier for når personen som ser på deres reklame ikke er fullt engasjert i innholdet.

Så langt skjermbasert annonsering angår, fokuserer studiene på to problemer i to miljøer. Miljøene er ‘skrivebord’ eller ‘mobil’, hver med sine særegne karakteristika som krever tilpassede sporingsløsninger; og problemene – fra annonserens synspunkt – representeres av ugleatferd og øgleatferd – seernes tendens til ikke å gi full oppmerksomhet til en annonse som er foran dem.

Eksempler på ‘ugle’ og ‘øgle’ atferd i en deltaker i et annonseforskningsprosjekt. Kilde: https://arxiv.org/pdf/1508.04028

Hvis du ser bort fra den ønskede annonsen med hele hodet, er dette ‘ugleatferd’; hvis hodestillingen er statisk, men øynene vandrer bort fra skjermen, er dette ‘øgleatferd’. I sammenheng med analyse og testing av nye annonser under kontrollerte forhold, er disse essensielle handlinger for et system å kunne fange.

En ny artikkel fra SmartEyes Affectiva-overtagelse tar opp disse problemene, og tilbyr en arkitektur som utnytter flere eksisterende rammeverk for å gi en kombinerende og konkatenerende funksjonssett over alle nødvendige betingelser og mulige reaksjoner – og å kunne si om en seer er kjedelig, engasjert eller på noen måte fjern fra innhold som annonsereren ønsker dem å se.

Eksempler på sanne og feilpositive detektert av det nye oppmerksomhetssystemet for ulike distraksjonssignaler, vist separat for skrivebord og mobile enheter. Kilde: https://arxiv.org/pdf/2504.06237

Forfatterne skriver*:

‘Begrenset forskning har dykket ned i å overvåke oppmerksomhet under online annonser. Mens disse studiene fokuserte på å estimere hodeposisjon eller gaze-retning for å identifisere eksempler på avledet gaze, ser de bort fra kritiske parametre som enhetstype (skrivebord eller mobil), kamera-plassering i forhold til skjermen og skjermstørrelse. Disse faktorene påvirker betydelig oppmerksomhetsdeteksjon.

‘I denne artikkelen foreslår vi en arkitektur for oppmerksomhetsdeteksjon som omfatter deteksjon av ulike distraktorer, inkludert både ugle- og øgleatferd av gaze av skjermen, samt snakking, søvighet (gjennom gape og forlenget øyelukking) og ubeskyttede skjermer.

‘I motsetning til tidligere tilnærminger, integrerer vår metode enhetsspesifikke funksjoner som enhetstype, kamera-plassering, skjermstørrelse (for skrivebord) og kamera-orientering (for mobile enheter) med rå gaze-estimering for å forbedre oppmerksomhetsdeteksjonens nøyaktighet.’

Det nye arbeidet har tittelen Overvåking av seernes oppmerksomhet under online annonser, og kommer fra fire forskere ved Affectiva.

Metode og data

Largely på grunn av hemmelighold og lukkede kildekoder for slike systemer, sammenligner den nye artikkelen ikke forfatternes tilnærmning direkte med rivaler, men presenterer sine funn eksklusivt som ablasjonsstudier; heller ikke følger artikkelen den vanlige formaten for datavisjonslitteratur. Derfor skal vi se på forskningen som den presenteres.

Forfatterne betoner at bare en begrenset mengde studier har behandlet oppmerksomhetsdeteksjon spesifikt i sammenheng med online annonser. I AFFDEX SDK, som tilbyr sanntids multi-ansiktsgjenkjenning, antas oppmerksomhet utelukkende fra hodeposisjon, med deltakere merket som uoppmerksomme hvis hodevinkelen passerer en definert terskel.

Et eksempel fra AFFDEX SDK, et Affectiva-system som baserer seg på hodeposisjon som en indikator for oppmerksomhet. Kilde: https://www.youtube.com/watch?v=c2CWb5jHmbY

I 2019-samarbeidet Automatisk måling av visuell oppmerksomhet til videoinnhold ved hjelp av dyp læring, ble et datasett på rundt 28 000 deltakere annotert for ulike uoppmerksomme atferder, inkludert gaze vekk, øyelukking eller engasjement i relatert aktivitet, og et CNN-LSTM-modell ble trent for å detektere oppmerksomhet fra ansiktsutseende over tid.

Fra 2019-artikkelen, et eksempel som illustrerer forventede oppmerksomhetsstater for en seer som ser på videoinnhold. Kilde: https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

Men forfatterne observerer at disse tidligere forsøkene ikke tok hensyn til enhetsspesifikke faktorer, som om deltakeren brukte en skrivebord eller mobil enhet; og heller ikke tok hensyn til skjermstørrelse eller kamera-plassering. I tillegg fokuserte AFFDEX-systemet bare på å identifisere gaze-avledning, og utelot andre kilder for distraksjon, mens 2019-arbeidet forsøkte å detektere en bredere sett av atferder – men bruken av en enkelt, grunnleggjende CNN kan, ifølge artikkelen, ha vært utilstrekkelig for denne oppgaven.

Forfatterne observerer at noen av de mest populære forskningene i denne retningen ikke er optimalisert for annonsetesting, som har andre behov sammenlignet med domener som kjøring eller utdanning – hvor kamera-plassering og kalibrering vanligvis er fikset på forhånd, og i stedet baserer seg på ukalibrerte oppsett, og opererer innenfor den begrensede gaze-området til skrivebord og mobile enheter.

Derfor har de utviklet en arkitektur for å detektere seernes oppmerksomhet under online annonser, ved å utnytte to kommersielle verktøy: AFFDEX 2.0 og SmartEye SDK.

Eksempler på ansiktsanalyse fra AFFDEX 2.0. Kilde: https://arxiv.org/pdf/2202.12059

Disse tidligere arbeidene trekker ut lavnivåfunksjoner, som ansiktsuttrykk, hodeposisjon og gaze-retning. Disse funksjonene blir deretter prosessert for å produsere høyere nivåindikatorer, inkludert gaze-posisjon på skjermen; gape; og snakking.

Systemet identifiserer fire distraktortyper: gaze vekk fra skjermen; søvighet,; snakking; og ubeskyttede skjermer. Det justerer også gaze-analyse basert på om seeren er på en skrivebord eller mobil enhet.

Datasett: Gaze

Forfatterne brukte fire datasett for å drive og evaluere oppmerksomhetsdeteksjonssystemet: tre som fokuserte på gaze-atferd, snakking og gape; og en fjerde som var trukket fra sanntids annonsetest-sesjoner som inneholdt en blanding av distraktortyper.

På grunn av de spesielle kravene til arbeidet, ble egne datasett laget for hver av disse kategoriene. Alle datasettene som ble kuratert, ble hentet fra en proprietær repository som inneholdt millioner av innspilte sesjoner av deltakere som så på annonser i hjemme- eller arbeidsmiljø, ved hjelp av et web-basert oppsett, med informert samtykke – og på grunn av begrensningene i disse samtykkesavtalene, kan datasettene for det nye arbeidet ikke gjøres offentlig tilgjengelige.

For å konstruere gaze-datasettet, ble deltakerne bedt om å følge en flyttende punkt over ulike punkter på skjermen, inkludert kantene, og deretter se vekk fra skjermen i fire retninger (opp, ned, venstre og høyre) med sekvensen gjentatt tre ganger. På denne måten ble forholdet mellom fangst og dekning etablert:

Skjermbilder som viser gaze-video-stimulansen på (a) skrivebord og (b) mobile enheter. Første og tredje rammer viser instruksjoner for å følge en flyttende punkt, mens andre og fjerde prompter deltakerne til å se vekk fra skjermen.

De flyttende punkt-segmentene ble merket som oppmerksomme, og av-skjerm-segmentene som uoppmerksomme, og produserte et merket datasett av både positive og negative eksempler.

Hver video varte omtrent 160 sekunder, med separate versjoner laget for skrivebord og mobile plattformer, hver med oppløsninger på 1920×1080 og 608×1080, henholdsvis.

Til sammen ble 609 videoer samlet inn, bestående av 322 skrivebord og 287 mobile innspillinger. Etiketter ble påført automatisk basert på videoinnholdet, og datasettet delt inn i 158 treningsprøver og 451 for testing.

Datasett: Snakking

I denne sammenhengen er ett av kriteriene for ‘uoppmerksomhet’ når en person snakker i lengre enn ett sekund (som kan være et øyeblikkelig kommentar, eller selv et host).

Ettersom det kontrollerte miljøet ikke registrerer eller analyserer lyd, antas snakking ved å observere indre bevegelser av estimerte ansiktslandemerker. Derfor ble et datasett basert utelukkende på visuell input laget, trukket fra deres interne repository, og delt inn i to deler: den første inneholdt omtrent 5 500 videoer, hver manuelt merket av tre annotatorer som enten snakking eller ikke snakking (av disse ble 4 400 brukt til trening og validering, og 1 100 til testing).

Den andre bestod av 16 000 sesjoner som ble automatisk merket basert på sesjonstype: 10 500 inneholdt deltakere som så stille på annonser, og 5 500 viste deltakere som uttrykte meninger om merker.

Datasett: Gape

Selv om noen ‘gape’-datasett eksisterer, inkludert YawDD og Driver Fatigue, hevder forfatterne at ingen av disse er egnet for annonsetest-scenarier, ettersom de enten inneholder simulert gape eller inneholder ansiktsforvridninger som kan forveksles med frykt eller andre, ikke-gape-handlinger.

Derfor brukte forfatterne 735 videoer fra deres interne samling, og valgte sesjoner som sannsynligvis inneholdt en underkjeve-bevegelse som varte lengre enn ett sekund. Hver video ble manuelt merket av tre annotatorer som enten aktiv eller inaktiv gape. Bare 2,6 prosent av rammer inneholdt aktiv gape, og understreker klassens ubalanse, og datasettet ble delt inn i 670 treningsvideoer og 65 for testing.

Datasett: Distraksjon

Distraksjons-datasettet ble også trukket fra forfatternes annonsetest-repository, hvor deltakere hadde sett på faktiske annonser uten noen tildelte oppgaver. Til sammen 520 sesjoner (193 på mobile og 327 på skrivebord) ble tilfeldig valgt og manuelt merket av tre annotatorer som enten oppmerksomme eller uoppmerksomme.

Uoppmerksom atferd inkluderte gaze vekk fra skjermen, snakking, søvighet og ubeskyttede skjermer. Sesjonene omfattet diverse regioner over hele verden, med skrivebord-innspillinger mer vanlige på grunn av fleksibel webkamera-plassering.

Oppmerksomhetsmodeller

Den foreslåtte oppmerksomhetsmodellen prosesserer lavnivå-visuelle funksjoner, nemlig ansiktsuttrykk; hodeposisjon; og gaze-retning – trukket ut gjennom ovennevnte AFFDEX 2.0 og SmartEye SDK.

Disse funksjonene blir deretter konvertert til høyere nivåindikatorer, med hver distraktor håndtert av en separat binær klassifikator trent på eget datasett for uavhengig optimalisering og evaluering.

Schema for det foreslåtte overvåkningssystemet.

Gaze-modellen bestemmer om seeren ser på eller vekk fra skjermen ved hjelp av normaliserte gaze-koordinater, med separate kalibreringer for skrivebord og mobile enheter. En lineær Support Vector Machine (SVM), trent på romlige og tidsmessige funksjoner, hjelper denne prosessen, og inkluderer en minne-vindu for å glatte rask gaze-bevegelse.

For å detektere snakking uten lyd, brukte systemet avkortede munn-regioner og en 3D-CNN trent på både konversasjonelle og ikke-konversasjonelle video-segmenter. Etiketter ble tildelt basert på sesjonstype, med tidsmessig glatting som reduserte feilpositive som kunne følge av korte munnbevegelser.

Gape ble detektert ved hjelp av fullt ansikts-bilder, for å fange bredere ansiktsbevegelser, med en 3D-CNN trent på manuelt merkte ramer (selv om oppgaven ble komplisert av gapes lavfrekvens i naturlig visning, og av dens likhet med andre uttrykk).

Skjerm-forlating ble identifisert gjennom fravær av et ansikt eller ekstrem hodeposisjon, med prediksjoner gjort av en beslutningstre.

Endelig oppmerksomhetsstatus ble bestemt ved hjelp av en fast regel: hvis noen modul detekterte uoppmerksomhet, ble seeren merket uoppmerksom – en tilnærmning som prioriterer sensitivitet, og justert separat for skrivebord og mobile kontekster.

Tester

Som nevnt tidligere, følger testene en ablativ metode, hvor komponenter fjernes og effekten på resultatet noteres.

Forskjellige kategorier av oppfattet uoppmerksomhet identifisert i studien.

Gaze-modellen identifiserte av-skjerm-atferd gjennom tre nøkkelsteg: normalisering av rå gaze-estimater, finjustering av utgangen og estimering av skjermstørrelse for skrivebord-enheter.

For å forstå hvor viktig hver komponent er, fjernet forfatterne dem enkeltvis og evaluerte ytelsen på 226 skrivebord- og 225 mobile videoer trukket fra to datasett. Resultatene, målt med G-mean og F1-poeng, vises nedenfor:

Resultater som indikerer ytelsen til den fullstendige gaze-modellen, sammen med versjoner med enkeltstående prosesseringssteg fjernet.

I alle tilfeller sank ytelsen når et steg ble utelatt. Normalisering viste seg å være spesielt verdifull på skrivebord, hvor kamera-plassering varierer mer enn på mobile enheter.

Studien vurderte også hvordan visuelle funksjoner forutså mobil-kamera-orientering: ansiktslokasjon, hodeposisjon og øyegaze scoret 0,75, 0,74 og 0,60, mens deres kombinasjon nådde 0,91, og understreker – ifølge forfatterne – fordelen ved å integrere flere signaler.

Snakking-modellen, trent på vertikal leppe-avstand, oppnådde en ROC-AUC på 0,97 på det manuelt merkte testsettet, og 0,96 på det større automatisk merkte datasettet, og indikerer konsistent ytelse over begge.

Gape-modellen nådde en ROC-AUC på 96,6 prosent ved å bruke munn-aspekt-forhold alene, som forbedret seg til 97,5 prosent når kombinert med handlingseenhet-prediksjoner fra AFFDEX 2.0.

Skjerm-forlating-modellen klassifiserte øyeblikk som uoppmerksomme når både AFFDEX 2.0 og SmartEye feilet i å detektere et ansikt i mer enn ett sekund. For å vurdere gyldigheten av dette, annoterte forfatterne manuelt alle slike ingen-ansikts-hendelser i reell distraksjons-datasettet, og identifiserte den underliggende årsaken til hver aktivering. Tvetydige tilfeller (som kamera-beskyttelse eller video-forvrengning) ble ekskludert fra analysen.

Som vist i resultat-tabellen nedenfor, var bare 27 prosent av ‘ingen-ansikt’-aktiveringer på grunn av brukere som faktisk forlot skjermen.

Forskjellige årsaker til at et ansikt ikke ble funnet, i visse tilfeller.

Artikkelen sier:

‘Til tross for at ubeskyttede skjermer utgjorde bare 27% av instansene som utløste ingen-ansikt-signalet, ble det utløst for andre årsaker som indikerte uoppmerksomhet, som deltakere som så vekk fra skjermen med en ekstrem vinkel, gjorde eksessiv bevegelse eller skjulte ansiktet betydelig med et objekt/hånd.’

I den siste av de kvantitative testene, vurderte forfatterne hvordan progressivt å legge til forskjellige distraksjonssignaler – av-skjerm-gaze (via gaze og hodeposisjon), søvighet, snakking og ubeskyttede skjermer – påvirkte den totale ytelsen til deres oppmerksomhetsmodell.

Testing ble utført på to datasett: reell distraksjons-datasettet og en test-undergruppe av gaze-datasettet. G-mean og F1-poeng ble brukt til å måle ytelse (selv om søvighet og snakking ble ekskludert fra gaze-datasett-analysen, på grunn av deres begrensede relevans i denne sammenhengen).

Som vist nedenfor, forbedret oppmerksomhetsdeteksjonen seg konsistent når flere distraktortyper ble lagt til, med av-skjerm-gaze som den vanligste distraktoren, og ga den sterkeste basislinjen.

Effekten av å legge til forskjellige distraksjonssignaler til arkitekturen.

Av disse resultater sier artikkelen:

‘Fra resultater kan vi først konkludere at integreringen av alle distraksjonssignaler bidrar til forbedret oppmerksomhetsdeteksjon.

‘For det andre er forbedringen i oppmerksomhetsdeteksjon konsistent over både skrivebord og mobile enheter. For det tredje viser mobile sesjoner i det reelle datasettet betydelige hodebevegelser når de ser vekk, som lett kan detekteres, og fører til bedre ytelse for mobile enheter sammenlignet med skrivebord. For det fjerde har tillegget av søvighetssignalet en relativt liten forbedring sammenlignet med andre signaler, ettersom det vanligvis er sjeldent.

‘Til slutt har ubeskyttet-skjerm-signalet en relativt større forbedring på mobile enheter sammenlignet med skrivebord, ettersom mobile enheter lett kan bli forlatt.’

Forfatterne sammenlignet også sin modell med AFFDEX 1.0, en tidligere system brukt i annonsetesting – og selv den nåværende modellens hode-baserte gaze-deteksjon overgikk AFFDEX 1.0 over begge enhetstyper:

‘Dette er et resultat av å inkorporere hodebevegelser i både yaw- og pitch-retninger, samt normalisere hodeposisjonen for å ta hensyn til mindre endringer. De uttalte hodebevegelsene i det reelle mobile datasettet har ført til at vår hode-modell utfører seg likt med AFFDEX 1.0.’

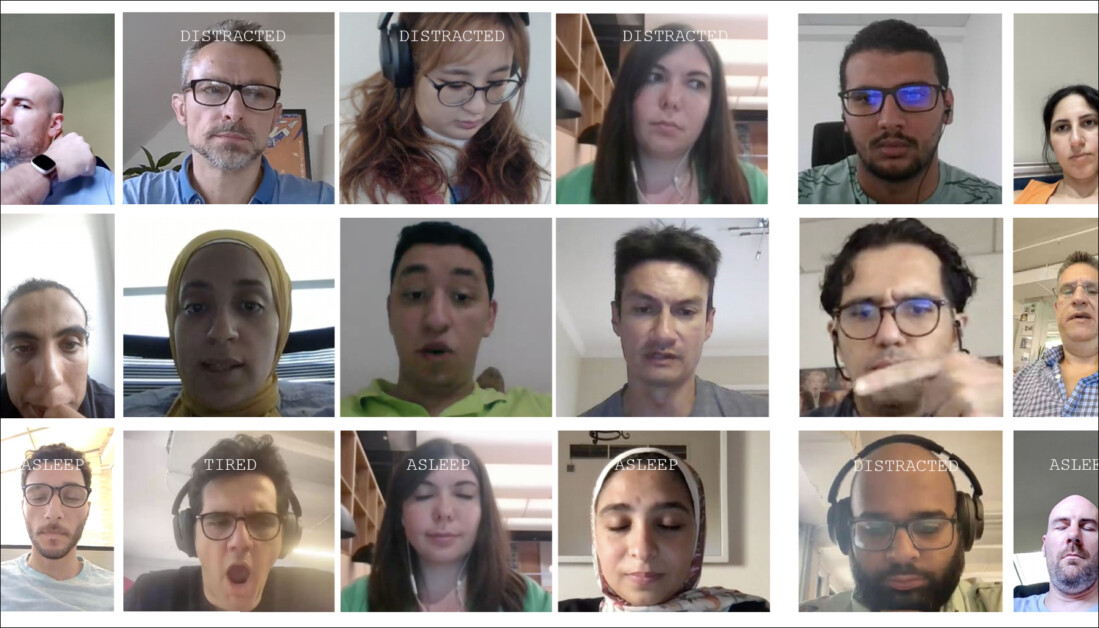

Forfatterne avslutter artikkelen med en (kanskje ganske perfunctorisk) kvalitativ test-runde, vist nedenfor.

Eksempler på utdata fra oppmerksomhetsmodellen over skrivebord og mobile enheter, hvor hver rad presenterer eksempler på sanne og feilpositive for ulike distraktortyper.

Forfatterne skriver:

‘Resultatene indikerer at vår modell effektivt detekterer ulike distraktorer i ukontrollerte miljøer. Likevel kan den av og til produsere feilpositive i visse ekstreme tilfeller, som ekstrem hode-helling mens de holder gaze på skjermen, noen munn-ocklusjoner, usedvanlig blærøye eller sterkt mørke ansiktsbilder. ‘

Konklusjon

Selv om resultater representerer en målt, men betydelig fremgang over tidligere arbeid, ligger den dypere verdien av studien i det glimt den tilbyr inn i den vedvarende drivkraften for å få tilgang til seerens interne tilstand. Selv om dataene ble samlet inn med samtykke, peker metoden mot fremtidige rammeverk som kan utvides utover strukturerte, markedsforsknings-miljøer.

Denne ganske paranoide konklusjonen støttes bare av den lukkede, begrensede og beskyttede naturen til denne spesielle grenen av forskning.

* Min konvertering av forfatternes inline-referanser til hyperlenker.

Først publisert onsdag, 9. april 2025